一种基于人类语音结构的语音干扰噪声设计方法

1.本发明属于语音隐私保护领域,尤其是涉及一种基于人类语音结构的语音干扰噪声设计方法。

背景技术:

2.随着科学技术的发展,手机,智能电视,智能音箱等具有录音功能的设备在我们生活中越来越常见。由于这些智能设备的黑盒性质,用户并不能完全知晓这些设备内部的程序运行内容,这给用户的隐私带来了极大的威胁。攻击者可以通过控制这些设备来窃听环境中用户的语音信息,再利用现在飞速发展的基于深度学习的语音识别系统来识别这些语音信息的内容,从而窃取用户的隐私。

3.因此,使得如何有效的防止窃听成为了一个热门的研究方向。现有的一些防窃听的产品,如project alias和paranoid home wave可以通过往麦克风中注入白噪声来防止麦克风进行录音,但是他们需要知道具体的麦克风的位置并且为每一个麦克风都配置一个噪声发射器,这极大的限制了设备的使用场景。同时,研究发现利用白噪声干扰录音并不是一个可靠的解决方案,现有的一些去噪方法如xiang hao等在《fullsubnet:a full-band and sub-band fusion model for real-time single-channel speech enhancement》中所提出的基于深度学习的语音去噪算法可以有效的去除音频中的白噪声干扰,这意味着使用白噪声进行干扰并不能有效的防止语音隐私的泄漏。

4.近年来,有学者提出了基于超声波的录音干扰方案,其基本原理是基于设备麦克风的非线性进行噪声的注入,从而达到在不干扰环境中用户的前提下干扰窃听设备的效果。yuxin chen等人在《wearable microphone jamming》中设计了一种可穿戴的手环,手环上有多个超声波发射探头,可以持续的发射超声波以干扰环境中的录音设备。lingkun li等人在《patronus:preventing unauthorized speech recordings with support for selective unscrambling》中设计了一种超声发射装置,可以基于预先生成的密钥发送变频噪声,在干扰未授权录音设备的同时可以允许授权的录音设备进行录音。

5.上述的多种干扰方法虽然可以有效的将噪声注入到窃听设备,但是他们使用的噪声形式都过于简单,比如白噪声,变频噪声等。现有的一些去噪算法,如基于深度学习的fullsubnet,基于噪声特征的谱减法和滤波法等,都可以将这些噪声从语音中去除,使得目前的录音干扰方法不能有效的防止攻击者从含噪声的录音中窃取用户的隐私信息,不能满足目前的安全需求。

技术实现要素:

6.针对现有的语音窃听干扰方案的不足,本发明提供了一种基于人类语音结构的语音干扰噪声设计方法,产生的干扰噪声可以在低能量下高效的干扰语音并保持较强的鲁棒性,使得受扰语音无法被人类听觉系统或者机器语音识别系统识别,同时现有的语音增强和噪声去除等算法无法有效地将干扰噪声从原有的语音中去除,从而避免用户隐私信息的

泄漏。

7.一种基于人类语音结构的语音干扰噪声设计方法,包括如下步骤:

8.(1)获取大量包含不同说话人、不同说话内容的语音数据,对语音数据中的每个说话人进行声纹信息提取,构建初始语音数据集;

9.(2)对于每个用户,获取少量的用户语音数据,对用户语音数据进行声纹信息提取;基于提取的用户声纹信息,利用声纹信息匹配算法在步骤(1)生成的初始语音数据集中匹配最为接近的语音数据;

10.(3)对步骤(2)匹配得到的语音数据进行数据增广;

11.(4)利用音素切割算法对增广后的语音数据进行音素级别的切分,分别构成元音数据集和辅音数据集;

12.(5)基于元音数据集和辅音数据集构建三段噪声序列,其中两段为元音数据的拼接,一段为辅音数据的拼接;将三段噪声序列叠加后得到干扰噪声;

13.(6)持续生成随机干扰噪声并播放,将干扰噪声持续注入录音中实现连续干扰,使录音难以被窃取隐私信息。

14.优选地,步骤(1)和步骤(2)中,均采用神经网络进行声纹信息的提取,神经网络的输入为连续的时域语音信号,输出为代表声纹信息的向量;其中,神经网络表示为e=f(x),x为长度大于1.6秒的语音信号,e为输出的声纹信息,维度为1

×

256。

15.优选地,步骤(2)中,所述的声纹信息匹配算法采用基于余弦距离的匹配算法,具体为:

16.假设当前用户的声纹信息为e

t

,初始语音数据集中每个说话人的声纹信息为ei,其中i∈[1,n],n为初始语音数据集中说话人的数量;则匹配到的数据集中的最相近的说话人j需要满足以下表达式:

[0017][0018]

其中,d(x,y)为两个向量之间的余弦距离,

[0019]

优选地,步骤(2)中,获取用户语音数据的长度为8~15秒,用于精确的提取用户声纹信息。

[0020]

优选地,步骤(3)中,基于语音情绪特征的增广算法进行数据增广,分为语速修改、平均基频修改、基频曲线修改、能量修改和时间顺序修改这五种增广方式。

[0021]

进行语速修改时,语速修改参数从均匀分布u(0.3,1.8)中随机采样得到,大于1为加速,小于1为减速;

[0022]

进行平均基频修改时,平均基频修改参数从均匀分布u(0.9,1.1)中随机采样得到,大于1为提高基础频率,小于1为降低基础频率;

[0023]

进行基频曲线修改时,基频曲线修改参数从均匀分布u(0.7,1.3)中随机采样得到,大于1为将原有的基频曲线进行拉伸,小于1为将原有的基频曲线进行压缩;

[0024]

进行能量修改时,能量修改参数从均匀分布u(0.5,2)中随机采样得到,将原音频信号为s(t)与能量修改参数相乘;

[0025]

进行时间顺序修改时,直接将语音在时域内倒序。

[0026]

优选地,步骤(4)中,音素切割算法为基于prosodylab-aligner的对齐算法,具体

切分过程为:

[0027]

首先使用开源的数据集如aidatatang_200zh等训练一个基于高斯混合模型的、与说话人无关的声学模型。以这个模型为基础,基于步骤(1)构建的初始语音数据集中每个说话人的数据对模型进行微调,最终针对每个说话人都生成一个专门的声学模型。在进行切分过程中,首先选择相应说话人的声学模型,输入音频和相应的文本,模型会按顺序输出音频中音素的种类以及对应的时间戳。基于该时间戳可以将音频中的每个音素切割出来,并根据其种类分类为元音和辅音,构成元音数据集和辅音数据集。

[0028]

步骤(5)的具体过程为:

[0029]

从元音数据集中随机选择元音并进行拼接,拼接处使用长度为25ms的汉明窗进行平滑,并将得到的序列加速至原来的1.1倍,得到第一条噪声信号;

[0030]

再从元音数据集中随机选择元音,每个元音速度修改为原来的α倍,α为从均匀分布u(0.3,1.8)随机采样得到的随机数,对于每个元音都进行重新采样;将速度修改之后的元音进行拼接,并在元音之间插入空白间隔,间隔长度为均匀分布u(0.001,0.1)秒的随机采样,得到第二条噪声信号;

[0031]

再从辅音数据集中随机选择辅音并进行拼接,拼接处使用长度为25ms的汉明窗进行平滑,得到第三条噪声信号;

[0032]

最后将三条噪声信号进行直接叠加,得到最终的干扰噪声。

[0033]

与现有技术相比,本发明具有以下有益效果:

[0034]

1、相比于现有的语音干扰噪声(如白噪声等),本发明中设计的干扰噪声可以在同能量下实现更强的干扰效果。

[0035]

2、相比于现有的语音干扰噪声,本发明中设计的噪声具有更强的鲁棒性,更难以被现有的去噪算法去除。

[0036]

3、相比于现有的无目标的语音干扰噪声,本发明中设计的噪声是针对每个用户生成的,具有更强的针对性,干扰效果更好。

[0037]

4、基于语料库的多样性以及本发明中提出的语音数据增广算法,本发明中设计的干扰噪声重复率很低,具有更强的多样性,干扰普适性更强。

附图说明

[0038]

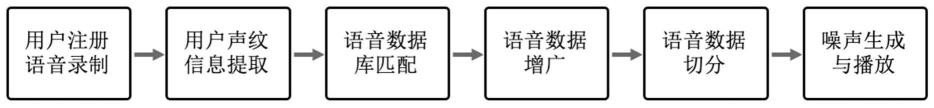

图1为本发明实施例一种基于人类语音结构的语音干扰噪声设计方法整体流程图;

[0039]

图2为本发明实施例中通过元音数据集和辅音数据集生成干扰噪音的设计框图;

[0040]

图3为含扰动噪声的语音在不同语音识别模型下的识别错词率;

[0041]

图4为使用语音去噪算法处理前后的含扰动噪声的语音在不同语音识别模型下的识别错词率。

具体实施方式

[0042]

下面结合附图和实施例对本发明做进一步详细描述,需要指出的是,以下所述实施例旨在便于对本发明的理解,而对其不起任何限定作用。

[0043]

当前,语音隐私泄漏问题收到了广泛关注。攻击者可以通过控制广泛分布的智能

设备来录音并窃取目标的语音隐私信息。现有的语音干扰噪声存在干扰效果差,鲁棒性低等缺点,并不能很好的保护用户隐私。

[0044]

基于此本发明提供了一种基于人类语音结构的语音干扰噪声设计方法,设计的语音干扰噪声可以实现在实际场景中对录音的干扰,使得攻击者难以从受扰的语音中提取出目标的隐私信息。同时该噪声鲁棒性强,攻击者难以利用现有的去噪算法将干扰噪声从录音中去除。

[0045]

如图1所示,一种基于人类语音结构的语音干扰噪声设计方法,包括以下步骤:

[0046]

s1,构建语音数据集。

[0047]

语音数据集内容应尽可能丰富,可以广泛涵盖不同年龄,性别,口音,情绪的说话人,并且说话内容应该尽可能丰富。可以利用公开数据集,如librispeech,gigaspeech等。并基于深度学习的方法计算所获得的语音数据集中每个说话人的声纹信息。

[0048]

s2,用户注册。

[0049]

利用手机等具有录音功能的设备录制用户10秒钟的语音数据,并基于该数据利用和s1中相同的方法提取用户的声纹信息。

[0050]

s3,最相近语音数据获取。

[0051]

从所构建的语音数据集中获取与用户声纹信息最相似的说话人的语音数据。其中相似性的定义为声纹信息之间的余弦距离,余弦距离越大则相似性越低,反之则越高。

[0052]

基于余弦距离的匹配算法具体为:假设当前用户的声纹信息为e

t

,数据库中每个说话人的声纹信息为ei,其中i∈[1,n],n为语音数据集中说话人的数量。则匹配到的数据库中的最相近的说话人j需要满足下面表达式:其中d(x,y)为两个向量之间的余弦距离,

[0053]

s4,语音增广。

[0054]

基于语音情绪特征对匹配到的语音数据进行增广。分为语速修改、平均基频修改、基频曲线修改、能量修改和时间顺序修改这五种增广方式。假设原音频信号为s(t),具体增广算法如下:

[0055]

语速修改参数α为从均匀分布u(0.3,1.8)中随机采样得到,大于1为加速,小于1为减速。语速修改有两种可选的方式。第一种是使用ffmpeg工具包,可以直接对语音速度进行修改。得到的语音s1(t)=ffmpeg.a_speed(s(t),α)。其优点是转换效果好,但是缺点是速度比较慢。另一种方式是基于相位声码器的方法,现将语音转换为频域信号,再在频域上逐帧对频谱进行内插,最后再转换回时域。得到的语音s1(t)=phasevocoder(s(t),α)。其优点是转换速度快,但是缺点是转换效果差一些。

[0056]

基础频率修改参数α为从均匀分布u(0.9,1.1)中随机采样得到,大于1为提高基础频率,小于1为降低基础频率。修改方式为首先使用上述的语速修改方式将语速修改为原来的倍,得到s1(t),再对得到的音频进行插值,插值为原来的倍,得到

[0057]

基频曲线修改参数α为从均匀分布u(0.7,1.3)中随机采样得到,大于1为将原有的

基频曲线进行拉伸,小于1为将原有的基频曲线进行压缩。具体操作方法为首先基于world声码器提取语音的基频曲线f0=world.harvest(s(t))和平均基础频率再修改音频的基频曲线再基于world声码器计算音频的周期参数sp=world.cheaptrick(s(t),f0′

)和非周期参数ap=world.d4c(s(t),f

′0)。最后基于world声码器合成修改之后的语音s3(t)=world.synthesize(f

′0,sp,ap)。

[0058]

能量修改参数α为从均匀分布u(0.5,2)中随机采样得到。得到的修改之后的语音为s4(t)=αs(t)。

[0059]

时间修改为直接将语音在时域内倒序。

[0060]

s5,音素切分。

[0061]

基于prosodylab-aligner算法利用相应说话人的声学模型将增广之后的语音数据切分为单个的元音和辅音,构成一个元音的集合和一个辅音的集合。

[0062]

s6,干扰噪声生成。

[0063]

基于噪声生成算法持续的生成语音干扰噪声。如图2所示,具体过程为:

[0064]

从得到的元音数据集中随机选择元音并进行拼接,拼接处使用长度为25ms的汉明窗进行平滑,并将得到的序列加速至原来的1.1倍,得到第一条噪声信号。再从元音数据集中随机选择元音,每个元音速度修改为原来的α倍,α为从均匀分布u(0.3,1.8)随机采样得到的随机数,对于每个元音都进行重新采样。将速度修改之后的元音进行拼接,并在元音之间插入空白间隔,间隔长度为均匀分布u(0.001,0.1)秒的随机采样,得到第二条噪声信号。再从辅音数据集中随机选择辅音并进行拼接,拼接处使用长度为25ms的汉明窗进行平滑,得到第三条噪声信号。最后将三条噪声信号进行直接叠加,得到最终的干扰噪声。

[0065]

s7,噪声发送。

[0066]

噪声发送有多种选择,可以使用普通的扬声器发送干扰噪声,也可以基于超声波传输的方式在不影响环境中说话人的情况下发送干扰噪声。用户可以根据自己需要进行选择。

[0067]

为验证本发明的效果,对上述基于人类语音结构的语音干扰噪声设计方法进行了实验。

[0068]

实验一为验证所设计的干扰噪声在不同信噪比的干扰效果,同时与传统的白噪声干扰进行对比。将干扰噪声和原有语音以不同的能量比混合(信噪比在-5到5之间),再将含有噪声的语音数据语音识别模型中进行识别并计算识别结果与真实文本的错词率(wer,一种度量识别结果与真实文本差距的预测,值越大,差别越大)。本实验中测试了三种语音识别模型(亚马逊语音识别,讯飞语音识别,和谷歌语音识别),结果如图3所示。在这三种模型中,除了一种情况外(信噪比为5的情况下使用亚马逊语音识别),本发明设计的噪声对语音的干扰效果均好于现有的白噪声干扰方式。

[0069]

实验二为验证所设计的干扰噪声对于现有去噪算法的鲁棒性,同时与传统的白噪声干扰的棒性进行对比。将干扰噪声和原有语音以不同能量比混合(信噪比在-5到5之间),再利用现有的语音去噪算法对含噪语音进行处理,最后将处理前后的音频输入到三种语音识别模型中进行识别并将去噪前后的识别结果进行对比。本实验中测试了三种语音识别模型(腾讯语音识别,deepspeech语音识别,和wenet语音识别),结果如图4所示。在这三种模

型中,相比于现有的白噪声干扰,本发明所设计的干扰噪声均展现出了更强的鲁棒性,在经过语音去噪算法处理之后受扰动的语音识别准确率并不会提高。

[0070]

以上所述的实施例对本发明的技术方案和有益效果进行了详细说明,应理解的是以上所述仅为本发明的具体实施例,并不用于限制本发明,凡在本发明的原则范围内所做的任何修改、补充和等同替换,均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1