传感器融合的时序同步方法与流程

本发明涉及一种时序同步方法,特别是涉及一种融合不同传感器的传感器融合的时序同步方法。

背景技术:

1、不论是包含了traffic jam assist(交通堵塞辅助机能)而符合level 3程度的自动驾驶系统,或是level 4的自主性驾驶(autonomous drive,ad)系统,都需要考虑各种不同传感器如,雷达、光达(lidar,激光雷达)及摄影机等的信息并比对结合再输出侦测以便后续的自驾控制,故多重感知融合系统被视为必要技术发展。

2、各感测组件有其不同优势,例如,摄影机(camera)负责计算机视觉处理,用于辨识行人、交通号志等实际物体的成像,激光雷达(lidar)用于探测目标的距离、方位、高度、速度、姿态等特征量。然而,各传感器的感测数据及取样时间皆不相同,例如,摄影机是在每33ms拍摄一影像,光达是在每100ms获得一点云数据,因而存在时间无法同步的问题,将导致各感测数据时序不一致,以及存在彼此之间的空间位姿关系相依问题,故实有必要提出一解决方案。

技术实现思路

1、本发明的目的在于提供一种进行不同传感器的时序同步的传感器融合的时序同步方法。

2、本发明一种传感器融合的时序同步方法,通过存储有用于根据距离误差获得对应该距离误差的时间误差的转换模型的运算装置来实施,该运算装置与设置于移动载具上的影像拍摄装置与光达模块电连接,该影像拍摄装置用于持续且周期性地拍摄位于该移动载具前方的多个障碍物的一连串影像并传送至该运算装置,该光达模块用于持续且周期性地获得位于该移动载具前方且包含所述障碍物的一连串点云数据并传送至该运算装置,该传感器融合的时序同步方法包含以下步骤:

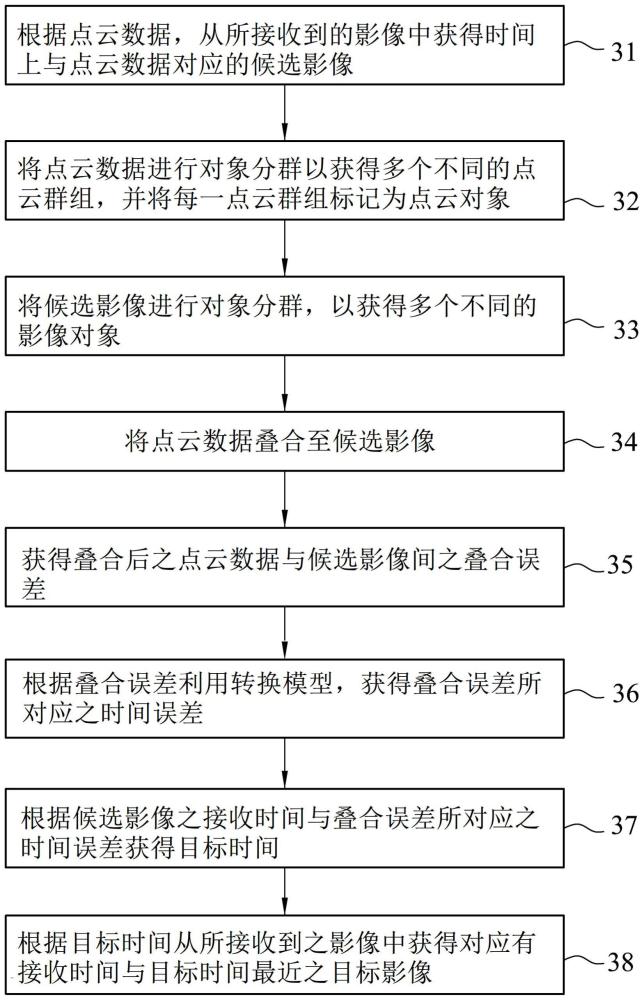

3、每当该运算装置自该光达模块接收到点云数据时,该运算装置进行以下步骤

4、(a)根据该点云数据,从已自该影像拍摄装置所接收到的影像中获得时间上与该点云数据对应的候选影像,

5、(b)将该点云数据叠合至该候选影像,

6、(c)获得叠合后的点云数据与该候选影像间的叠合误差,

7、(d)根据该叠合误差,利用该转换模型,获得该叠合误差所对应的时间误差,

8、(e)根据该候选影像的接收时间与该叠合误差所对应的该时间误差获得目标时间,及

9、(f)根据该目标时间,从已自该影像拍摄装置所接收到的影像中获得对应有接收时间与该目标时间最近的目标影像。

10、本发明所述传感器融合的时序同步方法,该运算装置还存储有多笔训练数据,每笔训练数据包含训练距离误差及训练时间误差,在接收所述点云数据前,还包含以下步骤:

11、(g)根据所述训练数据,利用机器学习算法,获得该转换模型。

12、本发明所述传感器融合的时序同步方法,步骤(b)包含以下子步骤:

13、(b-1)根据相关于该点云数据的点云坐标系与该候选影像的像素坐标系的坐标系转换的坐标转换参数组,将该点云数据转换为二维点云数据;及

14、(b-2)将该二维点云数据与该候选影像叠合。

15、本发明所述传感器融合的时序同步方法,在步骤(b)前,还包含以下步骤:

16、(h)将该点云数据进行对象分群以获得多个不同的点云群组,并将每一点云群组标记为点云对象;及

17、(i)将该候选影像进行对象分群,以获得多个不同的影像对象。

18、本发明所述传感器融合的时序同步方法,在步骤(h)中,是透过基于密度的聚类算法及k-平均算法的其中一者来将该点云数据进行对象分群以获得多个不同的点云群组,且在步骤(i)中,是透过该基于密度的聚类算法及该k-平均算法的其中一者来将该候选影像进行对象分群,以获得多个不同的影像对象。

19、本发明所述传感器融合的时序同步方法,步骤(c)包含以下子步骤:

20、(c-1)自该候选影像的影像对象中获得至少一待比对对象,其中每一待比对对象位置上与叠合后的点云数据所对应的点云对象的其中一者对应;

21、(c-2)获得该候选影像的至少一待比对对象的几何特征;

22、(c-3)获得叠合后的点云数据所对应的点云对象中对应该至少一待比对对象的至少一基准对象的几何特征;及

23、(c-4)计算该至少一待比对对象的几何特征与该至少一基准对象的几何特征间的距离差值,以作为该叠合误差。

24、本发明所述传感器融合的时序同步方法,在步骤(c-2)中,是透过随机抽样一致性算法及快速特征点提取和描述的算法的其中一者来获得该至少一待比对对象的几何特征,且在步骤(c-3)中,是透过该随机抽样一致性算法及该快速特征点提取和描述的算法的其中一者来获得该至少一基准对象的几何特征。

25、本发明所述传感器融合的时序同步方法,在步骤(c-4)中是透过计算该至少一待比对对象的几何特征与该至少一基准对象的几何特征间的欧式距离及马氏距离的其中一者来获得该距离差值。

26、本发明的有益效果在于:通过先自该影像拍摄装置所接收到的影像中初步获得该候选影像,接着计算叠合后的点云数据与该候选影像间的该叠合误差,且根据该叠合误差利用该转换模型,获得该时间误差,再根据该时间误差获得该目标影像,借此针对该时间误差进行时间补偿,以使得最后所获得的目标影像与该点云数据在感测时间上最接近甚至是同步,进而达成不同传感器的时序同步。

技术特征:

1.一种传感器融合的时序同步方法,通过存储有用于根据距离误差获得对应该距离误差的时间误差的转换模型的运算装置来实施,该运算装置与设置于移动载具上的影像拍摄装置与光达模块电连接,该影像拍摄装置用于持续且周期性地拍摄位于该移动载具前方的多个障碍物的一连串影像并传送至该运算装置,该光达模块用于持续且周期性地获得位于该移动载具前方且包含所述障碍物的一连串点云数据并传送至该运算装置,其特征在于,该传感器融合的时序同步方法包含以下步骤:

2.根据权利要求1所述的传感器融合的时序同步方法,其特征在于,该运算装置还存储有多笔训练数据,每笔训练数据包含训练距离误差及训练时间误差,在接收所述点云数据前,还包含以下步骤:

3.根据权利要求1所述的传感器融合的时序同步方法,其特征在于,步骤(b)包含以下子步骤:

4.根据权利要求1所述的传感器融合的时序同步方法,其特征在于,在步骤(b)前,还包含以下步骤:

5.根据权利要求4所述的传感器融合的时序同步方法,其特征在于,在步骤(h)中,是透过基于密度的聚类算法及k-平均算法的其中一者来将该点云数据进行对象分群以获得多个不同的点云群组,且在步骤(i)中,是透过该基于密度的聚类算法及该k-平均算法的其中一者来将该候选影像进行对象分群,以获得多个不同的影像对象。

6.根据权利要求4所述的传感器融合的时序同步方法,其特征在于,步骤(c)包含以下子步骤:

7.根据权利要求6所述的传感器融合的时序同步方法,其特征在于,在步骤(c-2)中,是透过随机抽样一致性算法及快速特征点提取和描述的算法的其中一者来获得该至少一待比对对象的几何特征,且在步骤(c-3)中,是透过该随机抽样一致性算法及该快速特征点提取和描述的算法的其中一者来获得该至少一基准对象的几何特征。

8.根据权利要求6所述的传感器融合的时序同步方法,其特征在于,在步骤(c-4)中是透过计算该至少一待比对对象的几何特征与该至少一基准对象的几何特征间的欧式距离及马氏距离的其中一者来获得该距离差值。

技术总结

一种传感器融合的时序同步方法,每当运算装置自光达模块接收到点云数据时,进行以下步骤:(A)根据点云数据,从已自影像拍摄装置所接收到的影像中获得时间上与点云数据对应的候选影像;(B)将点云数据叠合至候选影像;(C)获得叠合后的点云数据与候选影像间的叠合误差;(D)根据叠合误差,利用转换模型,获得叠合误差所对应的时间误差;(E)根据候选影像的接收时间与时间误差获得目标时间;(F)根据目标时间,从已自影像拍摄装置所接收到的影像中获得对应有接收时间与目标时间最近的目标影像。借此使得最后所获得的目标影像与该点云数据在感测时间上最接近甚至是同步,进而达成不同传感器的时序同步。

技术研发人员:黄韦翔,林义傑

受保护的技术使用者:财团法人车辆研究测试中心

技术研发日:

技术公布日:2024/4/24

- 还没有人留言评论。精彩留言会获得点赞!