处理方法以及利用其的处理装置与流程

本公开涉及处理技术,尤其涉及执行针对输入的信息的处理的处理方法以及利用其的处理装置。

背景技术:

1、在图像识别处理中例如使用deep learning(深度学习)。deep learning(深度学习)作为使用多层神经网络的机械学习的方法论而已知,多层神经网络例如使用卷积神经网络。卷积神经网络由反复进行局部区域的卷积(convolution)和池化(pooling)的多层神经网络形成。进而,提出了将构成卷积神经网络的全连接层设为卷积层的完全卷积神经网络的构造(例如,参照专利文献1)。

2、[在先技术文献]

3、[专利文献]

4、专利文献1:国际公开第19/159419号

技术实现思路

1、[发明要解决的课题]

2、由于完全卷积神经网络是局部区域的处理的叠加,因此成为处理对象的图像内的要素的位置关系不确定。为了提高神经网络中的图像识别的精度,优选能够确定图像内的要素的位置关系。

3、本公开鉴于以上状况而完成,其目的在于提供一种提高不包含全连接层的神经网络中的图像识别的精度的技术。

4、[用于解决技术课题的技术方案]

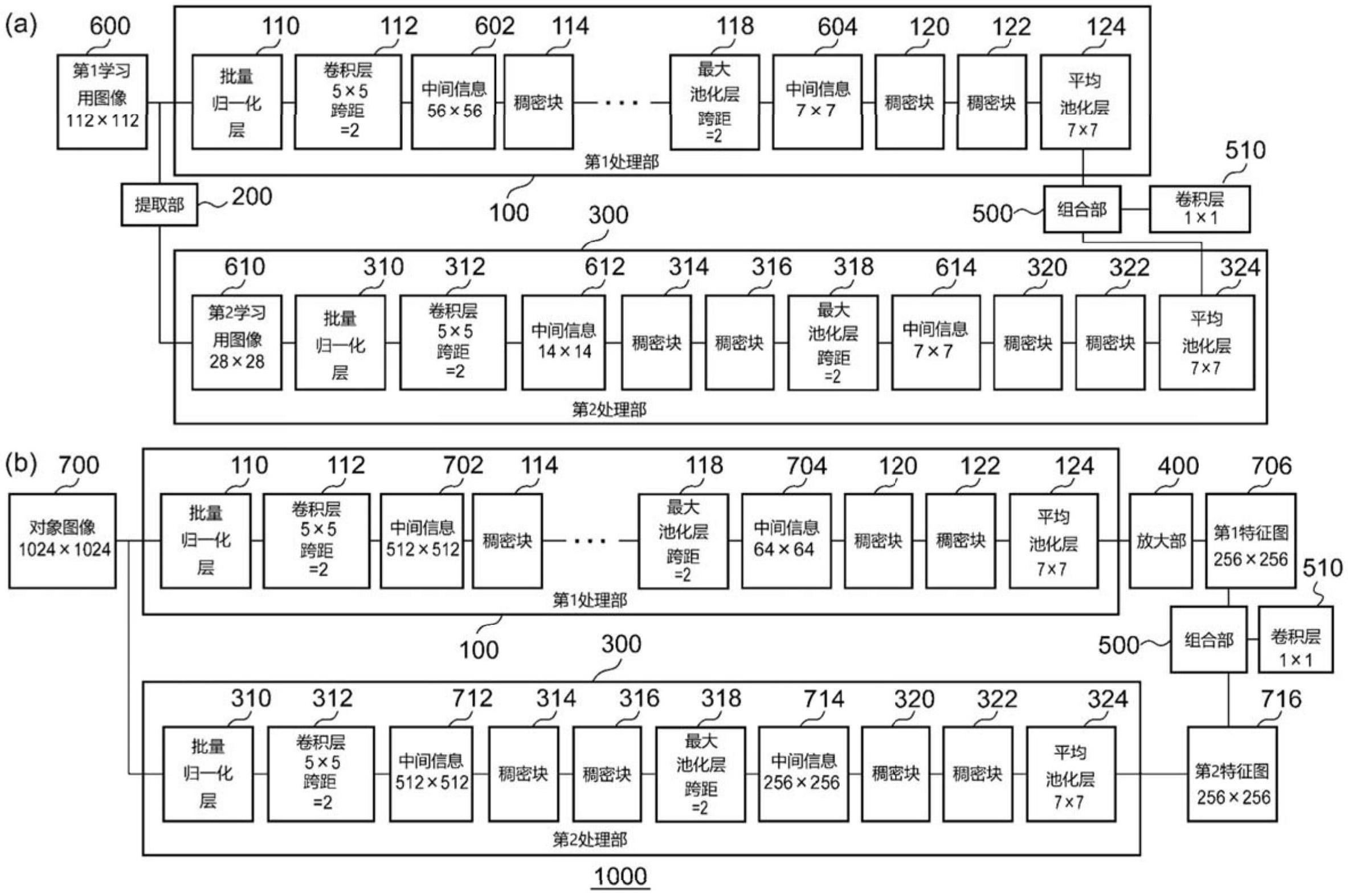

5、为了解决上述课题,本公开的一个方案的处理装置包括:第1处理部,其通过对成为处理对象的对象图像执行第1神经网络的处理,而生成成为对象图像的(1/m)×(1/n)倍的尺寸的第1特征图;放大部,其将在第1处理部中生成的第1特征图放大n倍;第2处理部,其通过对对象图像执行第2神经网络的处理,而生成成为对象图像的(1/m)倍的尺寸的第2特征图;以及组合部,其将在放大部中放大了n倍的第1特征图和在第2处理部中生成的第2特征图组合。第1处理部的第1神经网络和第2处理部的第2神经网络不包含全连接层,在学习时,向第1处理部的第1神经网络输入第1学习用图像,在学习时,向第2处理部的第2神经网络输入第2学习用图像,该第2学习用图像是第1学习用图像的一部分且为第1学习用图像的(1/n)倍的尺寸,在学习时,组合部不经由放大部地与第1处理部连接,并且与第2处理部连接。

6、本公开的另一方案是处理方法。该方法包括:通过对成为处理对象的对象图像执行第1神经网络的处理,而生成成为对象图像的(1/m)×(1/n)倍的尺寸的第1特征图的步骤;将生成的第1特征图放大n倍的步骤;通过对对象图像执行第2神经网络的处理,而生成成为对象图像的(1/m)倍的尺寸的第2特征图的步骤;以及将放大了n倍的第1特征图和生成的第2特征图组合的步骤。第1神经网络和第2神经网络不包含全连接层,在学习时,向第1神经网络输入第1学习用图像,在学习时,向第2神经网络输入第2学习用图像,该第2学习用图像是第1学习用图像的一部分且为第1学习用图像的(1/n)倍的尺寸,在学习时,不进行n倍放大地进行组合。

7、此外,以上构成要素的任意组合、将本公开的表现在方法、装置、系统、计算机程序或记录了计算机程序的记录介质等之间进行转换的方式,作为本公开的方式也是有效的。

8、[发明效果]

9、根据本公开,能够提高不包含全连接层的神经网络中的图像识别的精度。

技术特征:

1.一种处理装置,包括:

2.如权利要求1所述的处理装置,

3.如权利要求1或2所述的处理装置,

4.如权利要求1或2所述的处理装置,其特征在于,

5.如权利要求1至4的任意一项所述的处理装置,

6.如权利要求1至4的任意一项所述的处理装置,

7.一种处理方法,包括:

技术总结

第1处理部(100)通过对成为处理对象的对象图像(700)执行第1神经网络的处理,而生成成为对象图像(700)的(1/m)×(1/n)倍的尺寸的第1特征图。放大部(400)将在第1处理部(100)中生成的所述第1特征图放大n倍。第2处理部(300)通过对对象图像(700)执行第2神经网络的处理,而生成成为对象图像(700)的(1/m)倍的尺寸的第2特征图(716)。组合部(500)将在放大部(400)中放大了n倍的第1特征图(706)和在第2处理部(300)中生成的第2特征图(716)组合。

技术研发人员:堀井俊嗣

受保护的技术使用者:松下知识产权经营株式会社

技术研发日:

技术公布日:2024/1/13

- 还没有人留言评论。精彩留言会获得点赞!