一种面向小目标超分辨重建图像的目标识别模型构建方法

1.本发明属于目标识别技术领域,更具体地,涉及一种面向小目标超分辨重建图像的目标识别模型构建方法。

背景技术:

2.现实生活中,随着摄像设备的小型化和便携化,这些设备每时每刻都在产生海量的图像数据。这些设备采集到的图像数据中存在着许许多多像素尺寸较小的目标,例如利用卫星遥感拍摄的一些地面小目标、港口摄像头拍摄的远处驶向港口的船只,监控摄像头拍摄的车辆牌照数字等小尺寸目标。因此,对小目标进行精确识别对于分析和处理这些图像数据显得非常重要,并且在医疗图像分析、视频监控与跟踪、自动驾驶等领域也有着非常重要的价值。较小尺寸的目标相比常规尺寸的目标,只有几个或者几十个像素,并且存在分辨率低,携带的图像信息很少等问题,导致小目标的特征表达能力弱,识别起来更加困难。可以先对图像进行超分辨率预处理,提升目标的像素分辨率尺寸,然后再进行目标识别。

3.图像超分辨率重建是指将低分辨率图像转为超分辨率图像的一种图像复原技术。在现实生活中,图像超分辨率重建不仅能帮助提升图像感知质量,也可以作为前置的预处理步骤,有助于改善其它的计算机视觉任务。但是超分辨率重建处理并不能完全恢复出物体清晰的边缘和表面的纹理,会附带有一定程度的模糊,也会对后续的目标识别任务产生一定的干扰。

4.近几年深度学习发展迅猛,国内外经历了目标识别的研究热潮,目标识别的输入是一张目标图像,输出该目标所对应的类别。但是对于经历了超分辨率重建的目标图像而言,重建后图像会存在一定程度模糊、携带的信息少,这使得vgg,resnet,densenet等深度网络的识别性能就出现了明显的下降,很难与其它相似的目标进行区分。

技术实现要素:

5.针对现有技术的缺陷和改进需求,本发明提供了一种面向小目标超分辨重建图像的目标识别模型构建方法,其目的在于提出一种目标识别器构建方法,以解决现有目标识别器在超分辨率重建后的小目标图像上识别性能差的技术问题。

6.为实现上述目的,按照本发明的一个方面,提供了一种面向小目标超分辨重建图像的目标识别模型构建方法,包括:

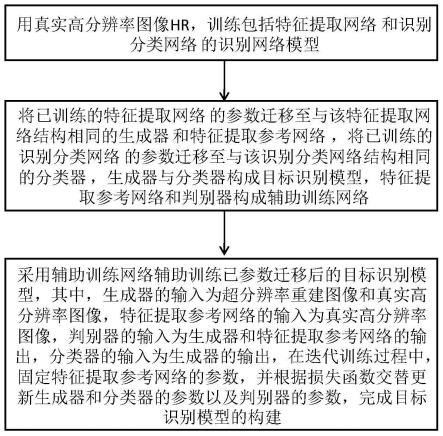

7.采用小目标的真实高分辨率图像,训练包括特征提取网络和识别分类网络的识别网络模型;并将已训练的特征提取网络的参数迁移至与该特征提取网络结构相同的生成器和特征提取参考网络,将已训练的识别分类网络的参数迁移至与该识别分类网络结构相同的分类器,所述生成器与所述分类器构成目标识别模型,所述特征提取参考网络和所述判别器构成辅助训练网络;

8.采用所述辅助训练网络辅助训练已参数迁移后的所述目标识别模型,其中,所述生成器的输入为超分辨率重建图像和真实高分辨率图像,所述特征提取参考网络的输入为

真实高分辨率图像,所述判别器的输入为所述生成器和所述特征提取参考网络的输出,输出为相应输入属于真实高分辨率图像的概率,所述分类器的输入为所述生成器的输出;在迭代训练过程中,固定所述特征提取参考网络的参数,根据损失函数交替更新所述生成器和所述分类器的参数以及所述判别器的参数,完成目标识别模型的构建。

9.进一步,将resnet50网络结构划分成两部分,构建包括特征提取网络和识别分类网络的所述识别网络模型。

10.进一步,所述损失函数包括:

11.用于更新所述生成器和所述分类器参数的损失函数l

comb

=10l

cls

+l

adv

+200l

fm

,以及用于更新所述判别器的参数的判别器损失函数;

12.其中,l

cls

表示分类损失,l

adv

表示对抗损失,l

fm

表示特征匹配损失。

13.进一步,采用所述生成器输出的特征图和所述特征提取参考网络输出的特征图,计算所述特征匹配损失l

fm

,使得所述生成器输出的特征图尽可能靠近所述特征提取参考网络输出的特征图,学习超分辨率重建图像和真实高分辨率图像之间的模糊不变特征。

14.进一步,所述特征匹配损失l

fm

为所述生成器输出的特征图和所述特征提取参考网络输出的特征图之间的smooth l1损失,表示为:

[0015][0016]

式中,x,y分别表示真实高分辨率图像和超分辨率重建图像;p

data(x,y)

表示x,y数据的概率分布;表示x,y数据分布情况下,方括号内函数表达式的期望;g、d和ref分别表示生成器netg、判别器netd和特征提取参考网络net

ref

;netg(y)表示当输入为y时生成器netg的输出;net

ref

(x)表示当输入为x时特征提取参考网络net

ref

的输出。

[0017]

进一步,所述分类损失l

cls

为交叉熵损失,其中n是总类别数量,ti是二元分类标签,pi是分类器输出的目标属于类别i的概率;

[0018]

所述对抗损失:

[0019][0019]

其中x,y分别表示真实高分辨率图像和超分辨率重建图像;p

data(x,y)

表示x,y数据的概率分布;表示x,y数据分布情况下,方括号内函数表达式的期望;g、d和ref分别表示生成器netg、判别器netd和特征提取参考网络net

ref

;ref(x)表示net

ref

的输入为x时对应的输出;g(y)表示netg的输入为y时对应的输出;d(ref(x),y)表示将特征提取参考网络net

ref

输出的ref(x)和超分辨率重建图像y作为判别器netd的输入时所得到的输出;d(g(y),y)表示将生成器netg输出的g(y)和超分辨率重建图像y作为判别器netd的输入时所得到的输出;ming|和maxd|分别表示判别器参数固定时最小化生成器损失和生成器参数固定时最大化判别器损失。

[0020]

进一步,所述判别器损失函数为:

[0021][0022]

式中,x,y分别表示真实高分辨率图像和超分辨率重建图像;p

data(x或y)

表示x或y数据的概率分布;表示x或y数据分布情况下,方括号内函数表达式的期望;g、d和ref分别表示生成器netg、判别器netd和特征提取参考网络net

ref

;g(y)表示生成器netg的输入为y时对应的输出;d(g(y))表示将生成器netg输出的g(y)作为判别器netd的输入时所得到的输出;ref(x)表示net

ref

的输入为x时对应的输出,d(ref(x))表示将参考网络net

ref

输出的ref(x)作为判别器netd的输入时所得到的输出;λ取值10,表示梯度;每次计算判别器损失时从[0,1]范围获取一个随机数∈进行计算。

[0023]

本发明还提供一种小目标识别方法,包括:

[0024]

采用如上所述的一种面向小目标超分辨重建图像的目标识别模型构建方法所构建的目标识别模型,基于小目标的超分辨率重建图像,识别得到所述小目标的类别。

[0025]

本发明还提供一种计算机可读存储介质,所述计算机可读存储介质包括存储的计算机程序,其中,在所述计算机程序被处理器运行时控制所述存储介质所在设备执行如上所述的一种面向小目标超分辨重建图像的目标识别模型构建方法和/或如上所述的一种小目标识别方法。

[0026]

本发明还提供一种服务器,包括:处理器、收发机,以及如上所述的计算机可读存储介质,其中,

[0027]

所述收发机,用于在所述处理器的控制下收发数据;

[0028]

所述处理器执行所述计算机可读存储介质上的计算机程序时实现如上所述的一种面向小目标超分辨重建图像的目标识别模型构建方法和/或如上所述的一种小目标识别方法。

[0029]

总体而言,通过本发明所构思的以上技术方案,能够取得以下有益效果:

[0030]

(1)针对超分辨率重建后附带模糊的小目标图像识别的改进需求,本发明提供一种针对超分辨率重建后的小目标识别方法,采用真实高分辨率图像,训练包括特征提取网络和识别分类网络的识别网络模型;并将已训练的特征提取网络的参数迁移至与该特征提取网络结构相同的生成器和特征提取参考网络,将已训练的识别分类网络的参数迁移至与该识别分类网络结构相同的分类器,生成器与分类器构成目标识别模型,特征提取参考网络和判别器构成辅助训练网络;采用辅助训练网络辅助训练已参数迁移后的目标识别模型,通过引入更具针对性的损失函数,约束生成器学习超分辨率模糊不变特征,有效提升了模型对于超分辨率重建后目标图像的识别性能,解决了现有目标识别器在超分辨率重建后的目标图像上识别性能差的技术问题。

[0031]

(2)本发明通过gan网络的对抗训练,使gan网络的生成器,能够尽可能提取出与原始高分辨率特征接近的模糊不变特征,使用超分辨率模糊不变特征,约束生成器学习从超分辨率重建后的目标图像提取到的特征图和从原始高分辨率目标图像提取到的特征图之间的共同之处,提取模糊不变特征,尽量排除超分辨率重建后的模糊对于识别性能的干扰,

提升了针对超分辨率重建后的目标图像的识别性能。

[0032]

(3)本发明通过在生成器的损失函数l

comb

中引入分类损失、对抗损失和特征匹配损失,使得生成器在学习过程中,每一次的迭代更新都受上述三种损失的约束,有利于生成器提取模糊不变特征,输出的特征图更接近参考网络输出的特征图,有利于提升后续识别分类网络输出的识别性能。

附图说明

[0033]

图1为本发明实施例提供的一种面向小目标超分辨重建图像的目标识别模型构建方法流程框图;

[0034]

图2为本发明实施例提供的一种目标识别模型的训练网络架构示意图;

[0035]

图3为本发明实施例提供的一种目标识别模型的构建方法示意图。

具体实施方式

[0036]

为了使本发明的目的、技术方案及优点更加清楚明白,以下结合附图及实施例,对本发明进行进一步详细说明。应当理解,此处所描述的具体实施例仅仅用以解释本发明,并不用于限定本发明。此外,下面所描述的本发明各个实施方式中所涉及到的技术特征只要彼此之间未构成冲突就可以相互组合。

[0037]

实施例一

[0038]

一种面向小目标超分辨重建图像的目标识别模型构建方法,包括:

[0039]

采用真实高分辨率图像hr,训练包括特征提取网络net

′

ref

和识别分类网络net

′c的识别网络模型;并将已训练的特征提取网络net

′

ref

的参数迁移至与该特征提取网络结构相同的生成器netg和特征提取参考网络net

ref

,将已训练的识别分类网络net

′c的参数迁移至与该识别分类网络结构相同的分类器netc,生成器netg与分类器netc构成目标识别模型,特征提取参考网络net

ref

和判别器netd构成辅助训练网络;

[0040]

采用辅助训练网络辅助训练已参数迁移后的目标识别模型,其中,生成器的输入为超分辨率重建图像和真实高分辨率图像,特征提取参考网络的输入为真实高分辨率图像,判别器的输入为生成器和特征提取参考网络的输出,输出为相应输入属于真实高分辨率图像的概率,分类器的输入为生成器的输出,输出为相应输入属于某一目标类别的概率;在迭代训练过程中,固定特征提取参考网络的参数,并根据损失函数交替更新生成器和分类器的参数以及判别器的参数,完成目标识别模型的构建。

[0041]

上述辅助训练网络和目标识别模型的总体结构如图2所示,共有四部分网络分别是:生成器netg,分类器netc,特征提取参考网络net

ref

和判别器netd。其中,netg和net

ref

的网络结构完全相同,netd是一个全卷积网络。net

ref

的输入是hr图像{xi},输出特征图用net

ref

(xi)表示。netg的输入是hr图像{xi}和sr图像{yi},输出的特征图用netg(yi)表示。netc的输入是netg(yi),输出是一个向量,向量中的每个元素对应属于每一类别的概率。netd的输入是netg(yi)或net

ref

(xi),输出是输入特征来源于hr图像xi的概率。

[0042]

也就是,本发明方法需要首先构建目标识别模型架构及其辅助训练网络,目标识别模型架构包括生成器和分类器;辅助训练网络包括特征提取参考网络和判别器,辅助训练网络与生成器构成gan网络,用于辅助训练生成器;生成器和特征提取参考网络的结构同

特征提取网络,分类器的结构同识别分类网络;将训练后的识别网络模型中特征提取网络的参数迁移至待训练的生成器和特征提取参考网络;将训练后的识别网络模型中识别分类网络的参数迁移至待训练的分类器;训练目标识别模型,生成器的输入为超分辨率重建图像和真实高分辨率图像,输出为相应输入图像的特征图,特征提取参考网络的输入为真实高分辨率图像,输出为相应输入图像的特征图,判别器的输入为生成器或特征提取参考网络的输出,输出为相应输入属于真实高分辨率图像的概率;在迭代训练过程中,固定特征提取参考网络的参数,并根据损失函数,交替更新生成器和分类器的参数以及判别器的参数,完成目标识别模型的构建。

[0043]

总的来说,第一步先训练包括特征提取网络和识别分类网络的识别网络模型,然后将特征提取网络作为预训练模型,参数迁移到生成器和特征提取参考网络;将识别分类网络参数迁移到第二步训练中的分类器。第二步训练生成器、判别器和分类器。

[0044]

由于低分辨率图像自带模糊,超分辨率重建后会减少部分模糊,但无法完全去除,本发明提出的目标识别模型构建方法,通过gan网络的对抗训练,使gan网络的生成器,能够尽可能提取出与原始高分辨率特征接近的模糊不变特征,有效解决现有目标识别器在超分辨率重建后的目标图像上识别性能差的技术问题。

[0045]

优选的,将resnet50网络结构划分成两部分,构建包括特征提取网络和识别分类网络的所述识别网络模型。

[0046]

net

ref

、net

′

ref

、netg、netc和net

′c的结构采用的是resnet50网络结构,net

ref

、net

′

ref

和netg对应resnet50前面的特征提取部分,netc和net

′c对应resnet50后面的全连接层分类部分。其结构如表1所示:

[0047]

表1

[0048][0049][0050]

netg、net

ref

和net

′

ref

使用resnet50中特征提取部分的网络结构,先是卷积后最大池化,然后经过多层级联的残差网络,可以充分提取出图像中包含的特征。netc和net

′c包含一个平均池化以及一个全连接层,输出识别结果所属类别。

[0051]

netd的结构采用的是patchgan的判别器结构,通常的gan网络判别器输出的是一个评价的数字,而patchgan则通过多次卷积输出一个矩阵,矩阵中的每个元素均具有一定面积的感受野,对应输入特征图中的一个局部区域,然后对矩阵求均值作为netd的输出。这样做的好处是对于图像的局部区域会更加敏感,考虑到了图像中不同区域的影响,在卷积的结果上取平均也使得判别器的输出结果更为鲁棒。

[0052]

优选的,为了让识别模型算法正确提取出模糊不变特征帮助提升sr图像识别效果,针对性地设计了损失函数,上述损失函数包括:

[0053]

用于更新生成器和分类器参数的损失函数l

comb

=10l

cls

+l

adv

+200lf,以及用于更新判别器的参数的判别器损失函数;

[0054]

其中,l

cls

表示分类损失,l

adv

表示对抗损失,l

fm

表示特征匹配损失。

[0055]

对于netd来说,损失函数使用了wgan-gp的判别器网络损失函数,加入了一个梯度约束的正则化项,其优点是对于各类gan网络结构都提升了训练过程中网络的稳定性,其数学表达式如下所示为:

[0056][0057]

式中,x,y分别表示真实高分辨率和超分辨率重建图像,p

data(x或y)

表示x或y数据的概率分布,表示x或y数据分布情况下,方括号内函数表达式的期望;g、d和ref,分别表示生成器netg、判别器netd和特征提取参考网络net

ref

;g(y)表示生成器netg的输入为y时对应的输出;d(g(y))表示,将生成器网络netg输出的超分辨率图像特征图作为判别器netd的输入时,所得到的输出;ref(x)表示net

ref

的输入为x时对应的输出,d(ref(x))表示,将参考网络net

ref

输出的真实高分辨率图像特征图作为判别器网络netd的输入时,所得到的输出;λ是10,表示梯度;每次计算判别器损失时从[0,1]范围获取一个随机数∈进行计算。

[0058]

优选的,使用生成器输出的特征图和特征提取参考网络输出的特征图计算特征匹配损失,让生成器输出的特征图尽可能靠近特征提取参考网络输出的特征图,学习超分辨率重建后目标图像和原始高分辨率图像之间的模糊不变特征,并使用特征匹配损失作为生成器损失函数的一部分,与对抗损失和分类损失一起约束更新生成器参数。

[0059]

优选的,特征匹配损失l

fm

为生成器输出的特征图和特征提取参考网络输出的特征图之间的smooth l1损失,表示为:

[0060][0061]

式中,x,y分别表示真实高分辨率和超分辨率重建后目标图像,p

data(x,y)

表示x,y数据的概率分布,表示x,y数据分布情况下,方括号内函数表达式的期望。g、d和

ref分别表示生成器netg、判别器netd和特征提取参考网络net

ref

。netg(y)表示当输入为y时,生成器netg的输出,net

ref

(x)表示当输入为x时,特征提取参考网络net

ref

的输出。

[0062]

需要说明的是,l1损失函数(l1=|x|)对x的导数为常数,在训练后期,x很小时,如果学习率不变,损失函数会在稳定值附近波动,很难收敛到更高的精度。l2损失函数(l2=x2)对x的导数在x值很大时,其导数也非常大,在训练初期不稳定。本实施例提出的smooth l1则通过分段,避开了l1和l2损失的缺点。l

fm

在训练过程中能提供较大的梯度,加速了训练过程,帮助网络参数更快收敛。

[0063]

优选的,分类损失l

cls

为交叉熵损失,其中n是总类别数量,ti是二元分类标签,pi是分类器输出的目标属于类别i的概率。在训练时给定ti的条件下,如果netc输出的概率pi和二元分类标签ti越接近,则交叉熵损失越小;如果netc输出的概率pi和二元分类标签ti相差越远,则交叉熵损失越大。通过交叉熵损失来对分类效果进行监督。

[0064]

另外,对抗损失来源于生成对抗网络结构,根据生成器和判别器的输出来定义,对抗损失l

adv

的具体定义如下所示:

[0065][0065]

其中x,y分别表示真实高分辨率和超分辨率重建图像,p

data(x,y)

表示x,y数据的概率分布,表示x,y数据分布情况下,方括号内函数表达式的期望;g、d和ref,分别表示生成器netg、判别器netd和参考网络net

ref

;ref(x)表示net

ref

的输入为x时对应的输出,g(y)表示netg的输入为y时对应的输出;d(ref(x),y)表示,将参考网络net

ref

输出的真实高分辨率图像特征图、超分辨率重建图像y作为判别器netd的输入时,所得到的输出;d(g(y),y)表示,将生成器netg输出的超分辨率图像特征图、超分辨率重建图像y作为判别器netd的输入时,所得到的输出;ming|和maxd|分别表示判别器参数固定时最小化生成器损失和生成器参数固定时最大化判别器损失。

[0066]

为了更好的说明本实施例的目标识别模型构建方法,现给出如下示例:

[0067]

首先准备好sr目标图像{yi}和hr目标图像{xi}作为训练输入。第一步是根据hr目标图像以及对应的类别标签{{xi},{li}},训练识别网络模型,使用的损失函数仅有分类过程中的交叉熵损失l

cls

,训练到网络逐渐收敛。此时net

′

ref

和net

′c的权重参数作为预训练模型,将网络权重共享到第二步中的网络,如图3中箭头所示。

[0068]

根据第一步中的预训练权重初始化第二步中netg、netc和net

ref

中的权重过后,冻结net

ref

的权重参数作为参考,然后根据gan网络的训练方式训练netg、netc和netd,此时的损失函数使用l

comb

损失函数,并交替训练更新netg、netc还有netd,先保持netg和netc的权重参数,更新netd中的权重参数,然后反过来保持netd中的权重参数,更新netg和netc的权重参数。训练流程如表2所示:

[0069]

表2

[0070][0071]

迭代训练,具体为:

[0072]

步骤11、在训练样本集上对所述特征提取网络和识别分类网络进行初始化和训练,直至收敛;

[0073]

步骤21、使用训练好的net

′

ref

的参数初始化netg中的参数,并冻结net

ref

的参数;

[0074]

步骤31、在训练样本集、损失函数l

comb

、ld、步骤11以及步骤21的基础上,进行网络的迭代训练,具体来说是交替训练生成器、分类器与判别器,其中生成器的输入为训练样本集中的超分辨率重建后的目标图像和原始高分辨率目标图像,判别器的输入为生成器输出的特征图和特征提取参考网络输出的特征图。

[0075]

为了验证本实施例方法得到的识别器对超分辨率重建后的目标的识别结果,本实施例基于海面船只数据集及其对应的双三次降采样后再超分辨率重建的数据集来构建用于超分辨率重建后的目标识别数据集。数据集共包含4类目标,数据集的详细内容如表3所示:

[0076]

表3

[0077]

类号标签定义数量0ship_clear常规船只目标(清晰可见,颜色纹理清晰的船只)95241ship_small小船只目标(失去部分纹理细节,但是可以分辨为船只)195742buoyage固定物体(浮标等在海面位置相对固定的物体,尺度较小)179193unknown未知小目标(未知的海上漂浮物,不属于以上类别)8582

[0078]

需要说明的是,根据8:1:1的大致比例划分了训练集、验证集和测试集,在数据集中每个原始高分辨率目标图像hr都具有对应的降分辨率后再超分辨率重建的图像,其中在训练集的原始高分辨率目标图像和超分辨率重建后的目标图像在后续训练过程一起训练,而在验证集和测试集,则是将原始高分辨率目标图像和超分辨率重建后的目标图像分开,各自评估识别算法的性能。

[0079]

数据集准备好之后,需要进行模型训练和测试,具体过程如下:

[0080]

训练net

ref

的预训练模型时,使用adam优化器,初始学习率为1

×

10-6

,权重衰减为1

×

10-4

,学习率衰减系数为0.9,学习率衰减轮次为1。损失函数使用了l

cls

,仅使用原始高分辨率目标图像进行训练、验证和测试,收敛后其模型权重参数作为预训练模型。

[0081]

训练好预训练模型之后进行gan网络的训练,使用sgd优化器,生成器网络netg的初始学习率为1

×

10-6

,权重衰减为1

×

10-3

,动量为0.99,学习率衰减系数为0.9。判别器netd的初始学习率为1

×

10-6

,动量为0.99,学习率衰减系数为0.9。

[0082]

使用训练好的网络对测试集分别进行测试,计算测试集上的准确率、精确率、召回率和f1值,实验结果如表4所示。

[0083]

表4

[0084]

图像类型测试模型类型准确率精确率召回率f1值hrresnet50

hr

90.38119%0.9303110.9299150.929712srresnet50

hr

46.91842%0.6843930.5948160.580507srresnet50

sr

81.18988%0.8739100.8695810.862019srresnet50

hr&sr

83.29177%0.8656000.8652120.863212hrresnet50

hr&sr

83.82615%0.8760850.8673500.867559srsrbif

hr&sr

85.87460%0.8984930.8975490.894860hrsrbif

hr&sr

89.95369%0.9300520.9286040.927248

[0085]

由表4中的实验结果可以看出,未使用模糊不变特征时,使用训练集中的sr训练的resnet50

sr

其对测试集sr的识别准确率仅有81.18988%,使用训练集中hr和sr训练的resnet50

hr&sr

其对测试集sr的识别准确率也只有83.29177%,而本实施例提出的srbif,使用训练集中hr和sr训练的srbif

hr&sr

对测试集sr的识别准确率提升到了85.87460%,对超分辨率重建后的目标图像的识别效果提升较为明显。同时,对于测试集中hr的识别准确率从resnet50

hr

的90.38119%下降到srbif

hr&sr

的89.95369%,仅有些许下降,幅度不大。对于精确率、召回率和f1值等指标均有类似的趋势。

[0086]

从以上的分析可以得出结论:在针对超分辨率重建后的小目标识别任务上,本实施例提出的srbif对于超分辨率重建后目标的识别效果相较之前的resnet50有明显的提升,同时对于原始高分辨率图像依然具有较好的识别效果。而从理论上分析,srbif同样适用于其它领域的超分辨率重建后的目标识别任务。

[0087]

需要说明的是,本发明针对的小目为像素尺寸较小的目标,例如利用卫星遥感拍摄的一些地面小目标、港口摄像头拍摄的远处驶向港口的船只,监控摄像头拍摄的车辆牌照数字等小尺寸目标。对于每一种小目标,只需要采集原始图像并对其进行超分辨率重建图像,即可采用上述识别模型的构建方法,进行相应小目标的分类识别。

[0088]

综上,针对超分辨率重建后的目标图像,由于附带一定程度模糊、携带的信息少,使得深度网络对目标的识别性能出现了明显的下降的问题,本实施例提出使用条件gan网络学习sr和hr目标图像共有的模糊不变特征,缩小从sr目标和hr目标提取出的目标特征的差别,学习sr和hr相互关联的模糊不变特征。sr目标图像虽然相比hr目标图像更加模糊,但是它们之间依然存在相互关联的模糊不变特征,可以通过网络学习到它们之间共有的模糊不变特征,通过模糊不变特征尽可能减小sr目标图像上的模糊对识别分类结果的影响。

[0089]

实施例二

[0090]

一种小目标识别方法,包括:

[0091]

采用如上实施例一所述的一种面向小目标超分辨重建图像的目标识别模型构建方法所构建的目标识别模型,基于小目标的超分辨率重建图像,识别得到所述小目标的类别。

[0092]

相关技术方案同实施例一,在此不再赘述。

[0093]

实施例三

[0094]

一种计算机可读存储介质,所述计算机可读存储介质包括存储的计算机程序,其中,在所述计算机程序被处理器运行时控制所述存储介质所在设备执行如上所述的一种面

向小目标超分辨重建图像的目标识别模型构建方法和/或如上所述的一种小目标识别方法。

[0095]

相关技术方案同实施例一,在此不再赘述。

[0096]

实施例四

[0097]

一种服务器,包括:处理器、收发机,以及如上实施例三所述的计算机可读存储介质,其中,

[0098]

所述收发机,用于在所述处理器的控制下收发数据;

[0099]

所述处理器执行所述计算机可读存储介质上的计算机程序时实现如上所述的一种面向小目标超分辨重建图像的目标识别模型构建方法和/或如上所述的一种小目标识别方法。

[0100]

相关技术方案同实施例一,在此不再赘述。

[0101]

本领域的技术人员容易理解,以上所述仅为本发明的较佳实施例而已,并不用以限制本发明,凡在本发明的精神和原则之内所作的任何修改、等同替换和改进等,均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1