基于专注力分析和微表情识别的情绪障碍辅助诊断系统的制作方法

本发明属于图像处理,具体涉及一种基于专注力分析和微表情识别的情绪障碍辅助诊断系统。

背景技术:

1、微表情(micro-expression)是在人脸上出现的一种简短的面部表情,当人们故意隐藏自己的情绪或无意识地压抑自己的情绪时,就会发生微表情。微表情中包含了一个人大量地实际情绪信息,这些情绪信息适用于医疗保健、安全和审讯等领域。当人类在高风险环境中时,个体情绪更可能通过微表情表现出来。然而由于面部肌肉所展现地细微的微表情差异,使得提取这些信息非常具有挑战性。这主要有两个技术挑战:一是使微表情特征具有可描述性,二是微表情的持续时间只有1/25到1/5秒,微表情系统必须能够实时处理和分类人类的情绪。

2、目前,情绪相关障碍(情绪障碍,包括重性抑郁障碍、双相情感障碍及焦虑障碍等)的诊断,主要依靠患者自身及知情人提供的临床病史,结合专业的精神检查,医生根据诊断标准(dsm-iv,icd-10等)做出综合判断。病人往往情绪波动性大,易产生不良情绪,如愤怒、焦虑不安、抑郁、孤独感、冲动性症状等。通常使用的筛查辅助工具(如心理评估量表)为症状严重程度评估量表,诊断结果受到患者主观表达,医生临床经验的影响,且从发病到医院就诊存在一定时间的耽搁,这期间患者所受痛苦及社会经济损失是可由及早发现避免的。微表情是情绪表达的重要部分,情绪相关障碍患者往往存在异于常人的微表情,微表情可通过面部动作编码系统进行客观量化,提取面部特征并进行进一步评估。

3、深度学习各个领域中已经有较多的应用,针对微表情或情绪的识别,一般利用标注好的数据训练神经网络模型,之后利用训练好的神经网络模型来预测患者的状态。例如,cn114333002a发明了一种基于图深度学习和人脸三维重建微表情的识别方法。然而,这些深度学习方法在情绪诊断中的应用效果并不理想,这是由于微表情的识别方法通常是对一段受试者的面部视频进行处理,而在这些视频的采集过程中,需要受试者的面部和一些关键部位(例如眼睛)维持在恰当的位置,这需要受试者维持较高的专注力才能够实现。专注力即注意力是人类认知活动的核心,在推理、问题解决及学习过程等高级认知活动中起关键的作用。专注力的损害可见于许多精神障碍,包括抑郁障碍、躁狂症、焦虑障碍、精神分裂症以及器质性精神障碍。存在情绪相关障碍的患者常出现专注力的损害。这使得情绪相关障碍的患者在视频采集过程中常常出现面部遮挡和关键部位定位不正确等情况的发生,进而导致情绪相关障碍患者的视频对于微表情识别及进一步的情绪障碍诊断存在较大的误差。

技术实现思路

1、针对现有技术的缺陷,本发明提供一种基于专注力分析和微表情识别的情绪障碍辅助诊断系统,目的在于确保视频数据可靠性的前提下,对1s至30min的视频中的表情变化进行连续性、高准确率的识别,用于辅助实现更加准确的情绪障碍诊断。

2、一种基于专注力分析和微表情识别的情绪障碍辅助诊断系统,包括:

3、数据采集模块,用于采集和/或输入视频;

4、专注力分析模块,用于根据所述视频中受试者的眨眼与脸部定位成功率情况,分析所述受试者的专注力情况,进而得到所述视频是否可用于后续诊断的判定;

5、辅助诊断模块,用于对判定为可用的视频进行微表情识别,得到用于情绪障碍辅助诊断的微表情识别结果。

6、优选的,在所述专注力分析模块中,满足如下两个条件的情况下,所述视频可用于后续辅助诊断的判定:

7、1)脸部定位成功率≥90%;

8、2)眨眼7次的时间≥15秒。

9、优选的,所述脸定位成功率的计算方法为所述视频中脸部定位成功的帧数占视频总帧数的比例。

10、优选的,所述辅助诊断模块中,进行微表情识别的方法包括如下步骤:

11、步骤1,输入视频,分离所述视频每帧,对每帧进行脸部的获取,形成脸帧序列;

12、步骤2,对所述脸帧序列中的相邻两帧做差分,得到脸帧序列的差分值序列;

13、步骤3,对所述差分值序列采用加汉宁窗的傅里叶变化方式,生成表情曲线;

14、步骤4,在所述表情曲线中,根据波峰波谷与阈值的设定,划分出多个表情区间;

15、步骤5,对所述脸帧序列采用tvl1光流算法,得到光流序列;

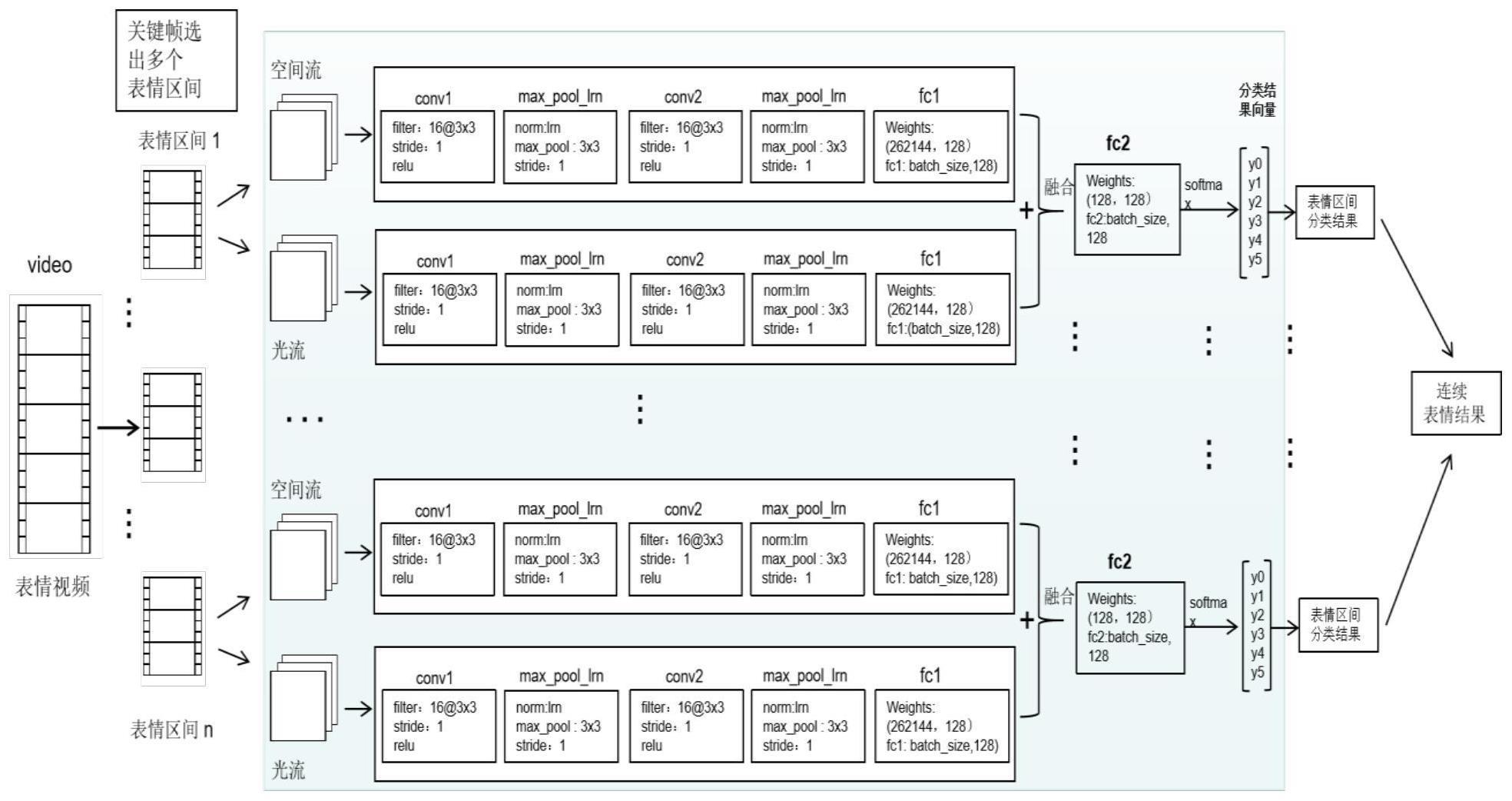

16、步骤6,迭代表情区间波谷的脸帧序列与光流序列,送入空间流与时间流的双流模型,得到该表情区间的表情结果。

17、优选的,步骤1中,将所述视频中的每帧处理成256x256的灰度图。

18、优选的,步骤1中,对所述视频中的每帧的脸部定位坐标[x,y,w,h]进行如下调整:下框坐标+10像素,左框右移10像素,右框左移10像素。

19、优选的,步骤5中,采用波谷采样方式,对空间流的3帧序列采用tvl1光流算法。

20、优选的,步骤6中,所述双流模型由空域cnn与时域cnn构成,所述空域cnn和空域cnn最后由一个全连接层进行特征融合。

21、优选的,还包括面部位移分析模块,用于根据面部68个关键点的位移分析面部具体部位的具体位移情况。

22、优选的,还包括输出模块,所述输出模块用于输出专注力分析模块的判定结果和辅助诊断模块的微表情识别结果。

23、本发明还提供一种计算机可读存储介质,其上存储有用于实现上述系统的计算机程序。

24、本发明提供了一种用于情绪障碍辅助诊断的系统,该系统首次利用专注力分析筛选具有辅助诊断价值的视频数据,并进一步对这些视频数据进行微表情识别,提供具有参考价值的情绪辅助诊断指标。本发明的优势在于提高了用于辅助诊断的视频数据的可靠性,进而提高了后续辅助诊断过程的准确性,具有很好的应用前景。

25、显然,根据本发明的上述内容,按照本领域的普通技术知识和惯用手段,在不脱离本发明上述基本技术思想前提下,还可以做出其它多种形式的修改、替换或变更。

26、以下通过实施例形式的具体实施方式,对本发明的上述内容再作进一步的详细说明。但不应将此理解为本发明上述主题的范围仅限于以下的实例。凡基于本发明上述内容所实现的技术均属于本发明的范围。

技术特征:

1.一种基于专注力分析和微表情识别的情绪障碍辅助诊断系统,其特征在于,包括:

2.按照权利要求1所述的情绪障碍辅助诊断系统,其特征在于:在所述专注力分析模块中,满足如下两个条件的情况下,所述视频可用于后续诊断的判定:

3.按照权利要求2所述的情绪障碍辅助诊断系统,其特征在于:所述脸定位成功率的计算方法为所述视频中脸部定位成功的帧数占视频总帧数的比例。

4.按照权利要求1所述的情绪障碍辅助诊断系统,其特征在于:所述辅助诊断模块中,进行微表情识别的方法包括如下步骤:

5.按照权利要求4所述的情绪障碍辅助诊断系统,其特征在于:步骤1中,将所述视频中的每帧处理成256x256的灰度图。

6.按照权利要求4所述的情绪障碍辅助诊断系统,其特征在于:步骤5中,采用波谷采样方式,对空间流的3帧序列采用tvl1光流算法。

7.按照权利要求4所述的情绪障碍辅助诊断系统,其特征在于:步骤6中,所述双流模型由空域cnn与时域cnn构成,所述空域cnn和空域cnn最后由一个全连接层进行特征融合。

8.按照权利要求1所述的情绪障碍辅助诊断系统,其特征在于:还包括面部位移分析模块,用于根据面部68个关键点的位移分析面部具体部位的具体位移情况。

9.按照权利要求1-8任一项所述的情绪障碍辅助诊断系统,其特征在于:还包括输出模块,所述输出模块用于输出专注力分析模块的判定结果和诊断模块的微表情识别结果。

10.一种计算机可读存储介质,其特征在于:其上存储有用于实现权利要求1-9任一项所述系统的计算机程序。

技术总结

本发明属于图像识别技术领域,具体涉及一种基于专注力分析和微表情识别的情绪障碍辅助诊断系统。该系统包括:数据采集模块,用于采集和/或输入视频;专注力分析模块,用于根据所述视频中受试者的眨眼与脸部定位成功率情况,分析所述受试者的专注力情况,进而得到所述视频是否可用于后续辅助诊断的判定;辅助诊断模块,用于对判定为可用的视频进行微表情识别,得到用于情绪障碍辅助诊断的微表情识别结果。本发明首次利用专注力分析筛选具有辅助诊断价值的视频数据,并进一步对这些视频数据进行微表情识别,提高了用于辅助诊断视频数据的可靠性,进而提高了后续辅助诊断过程的准确性,具有很好的应用前景。

技术研发人员:邓伟,薛芮,王德权

受保护的技术使用者:杭州市第七人民医院

技术研发日:

技术公布日:2024/1/11

- 还没有人留言评论。精彩留言会获得点赞!