一种基于多尺度语义扫描的图文互检索方法及系统

本发明涉及跨模态检索,尤其涉及一种基于多尺度语义扫描的图文互检索方法及系统。

背景技术:

1、本部分的陈述仅仅是提供了与本发明相关的背景技术信息,不必然构成在先技术。

2、跨模态检索是指查询数据和检索结果属于不同媒体类型的检索方式,但是,不同模态的特征编码方式不一致,导致无法直接度量数据间的相似度,这一问题称为“异构鸿沟”。作为跨模态检索的典型代表,图像文本检索的研究对于推动跨模态检索的发展具有重要的示范意义和积极的推动作用。早期的图文检索研究工作使用较简单的策略来挖掘语义信息,而近期的图文检索研究则更多的聚焦于局部细节语义信息的分析和挖掘,从而通过对全局语义信息的补充提高跨模态检索的准确性。

3、图文检索任务中的语义单元通常是指图像的某一局部区域或者文本中某一词语序列。发明人发现,利用目前的目标检测技术只能找到图像中的显著物体而无法体现全部的图像前景和背景中的语义单元。对于文本以句子或者词语为单元进行简单切分,也无法定位到完整的语义单元。尽管图文检索已经取得了一定的进展,但仍存在以下亟待解决的具体问题:

4、(1)对图像和文本中前景和背景语义单元的识别不够全面,现有图文检索的研究更多地聚焦于前景语义单元的识别。因此,现有研究没有充分挖掘前景语义单元与背景语义单元的互补关系,这在一定程度上使得对图像文本两种模态数据的语义分析不够全面,从而降低了图文检索的性能。

5、(2)对图像和文本中不同粒度的语义单元切分不够精准。对图像和文本进行细粒度切分后,不同粒度的图像块和词语序列蕴含的语义信息具有互补性,也就是说图像和文本中完整的语义信息广泛分布在多粒度数据中。但是,现有图文检索的研究对于图像和文本的细粒度切分方法不能实现对语义单元的精准切分,主要原因在于:1)图像和文本中的语义单元存在于多种粒度的图像块和词语序列中,仅进行单一粒度的局部区域的切分无法识别出全部的语义单元;2)现有研究常采用网格切分方法对细粒度数据进行划分,例如将一幅图片均匀分块,或者将一个句子以词语为单位进行切分。这样简单的切分策略可能将一个语义单元切碎,从而导致识别出的语义单元不够完整。

6、因此,如何通过对细粒度数据进行精准识别和划分从而定位到完整的语义单元,是一个亟待解决的问题。

技术实现思路

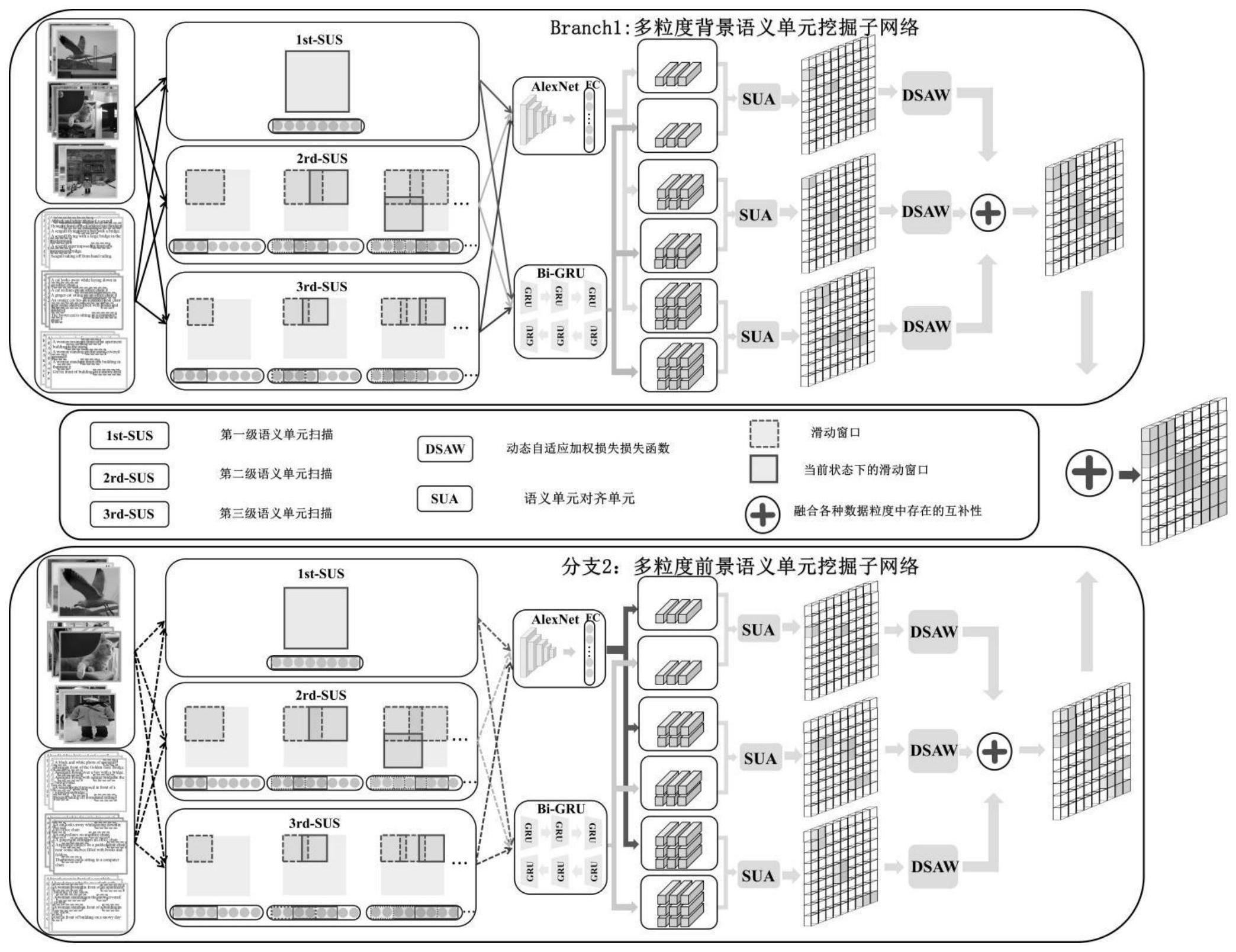

1、针对现有技术存在的不足,本发明的目的是提供一种基于多尺度语义扫描的图文互检索方法及系统,设计了基于多级滑动窗口的多尺度语义扫描策略,用于全面完整地识别出前景和背景区域的多粒度语义单元,同时提出了一种用于图文检索任务的双分支前景背景融合网络,将前景和背景区域的多粒度语义单元提取特征后输入到该双分支前景背景融合网络进行语义单元的对齐,从而计算图像-文本相似度,该方法真正实现多粒度前景语义单元与多粒度背景语义单元的互补,有效挖掘完整的语义信息进行图文检索,提高了检索的精度。

2、为了实现上述目的,本发明是通过如下的技术方案来实现:

3、本发明第一方面提供了一种基于多尺度语义扫描的图文互检索方法,包括以下步骤:

4、通过双分支前景背景融合网络利用多级滑动窗口策略对待检索的图像和文本数据进行多尺度语义扫描,分别得到多粒度前景与背景的图像语义单元和文本语义单元;

5、利用堆叠交叉注意机制对图像语义单元和文本语义单元计算图像-文本相似度;

6、利用动态自适应加权损失函数对图像-文本相似度进行优化,得到图像-文本相似度矩阵;

7、将前景与背景的多个图像-文本相似度矩阵进行线性融合,得到最终的图像-文本相似度矩阵,并利用最终融合形成的图像-文本相似度矩阵执行检索。

8、本发明第二方面提供了一种基于多尺度语义扫描的图文互检索系统,包括:

9、语义扫描模块,被配置为通过双分支前景背景融合网络利用多级滑动窗口策略对待检索的图像和文本数据进行多尺度语义扫描,分别得到多粒度前景与背景的图像语义单元和文本语义单元;

10、相似度计算模块,被配置为利用堆叠交叉注意机制对图像语义单元和文本语义单元计算图像-文本相似度;

11、相似度优化模块,被配置为利用动态自适应加权损失函数对图像-文本相似度进行优化,得到图像-文本相似度矩阵;

12、融合与检索模块,被配置为将图像-文本相似度矩阵进行线性融合,得到最终的图像-文本相似度矩阵,并利用最终的图像-文本相似度矩阵执行检索。

13、以上一个或多个技术方案存在以下有益效果:

14、本发明公开了一种基于多尺度语义扫描的图文互检索方法及系统,具体包括以下优点:

15、(1)针对图像和文本中前景和背景语义单元的识别不够全面的问题,本发明提出双分支前景背景融合网络,并将其应用于图文检索任务。该双分支网络分为:多粒度前景语义单元挖掘子网络和多粒度背景语义单元挖掘子网络。利用两个子网络通过多尺度语义扫描全面完整地识别出前景和背景区域的多粒度语义单元,在同一粒度级别进行图像和文本两种模态的语义单元对齐,在此基础上利用这两个子网络分别学习出前景图文相似度和背景图文相似度。还提出了动态自适应加权损失损失函数(简称dsaw),通过动态地为每个选定的样本分配适当的权重来优化图像-文本的相似性。并将其应用到图文检索领域。在样本对的挖掘中,动态地为每一样本对赋予不同的权重,自适应的加权过程了适应样本重要性,更新了其在监督学习中,对每一个样本对的挖掘策略。保证了语义单元识别的全面性,实现图文特征的深度挖掘。

16、(2)针对图像和文本中不同粒度的语义单元切分不够精准的问题。本发明提出多级滑动窗口策略,通过多尺度语义扫描精准切分图像和文本中的多粒度语义单元。首先,通过多级滑动窗口对图像和文本分别进行多尺度语义扫描,为了保证切分出完整的语义单元,相邻窗口彼此之间存在一定的区域重叠,使得滑动窗口在动态滑动的过程中能够保持局部区域的连续性。其次,利用堆叠交叉注意力机制进行特征加权,实现多粒度图像语义单元和文本语义单元之间的对齐,从而确保语义单元的精准切分。避免了错误切分破坏语义单元完整性的缺陷。

17、本发明附加方面的优点将在下面的描述中部分给出,部分将从下面的描述中变得明显,或通过本发明的实践了解到。

技术特征:

1.一种基于多尺度语义扫描的图文互检索方法,其特征在于,包括以下步骤:

2.如权利要求1所述的基于多尺度语义扫描的图文互检索方法,其特征在于,双分支前景背景融合网络包括f-net结构与b-net结构,其中通过f-net结构提取前景区域,通过b-net的结构提取背景区域。

3.如权利要求1所述的基于多尺度语义扫描的图文互检索方法,其特征在于,通过双分支前景背景融合网络利用多级滑动窗口策略对待检索的图像和文本数据进行多尺度语义扫描,分别得到图像语义单元和文本语义单元的具体步骤为:

4.如权利要求1所述的基于多尺度语义扫描的图文互检索方法,其特征在于,多级滑动窗口策略包括图像多级重叠滑动窗口策略和文本多级重叠滑动窗口策略;图像多级重叠滑动窗口策略中,图像的滑动窗口使用二维数据扫描模式,图像中的相邻滑动窗口彼此重叠;文本多级重叠滑动窗口策略中,文本的滑动窗口使用一维数据扫描模式。

5.如权利要求3所述的基于多尺度语义扫描的图文互检索方法,其特征在于,多粒度图像特征提取和多粒度文本特征提取;其中,多粒度图像特征提取包括图像的前景区域特征提取和图像的背景区域特征提取,多粒度文本特征提取包括文本的前景区域特征提取和图像的背景区域特征提取。

6.如权利要求1所述的基于多尺度语义扫描的图文互检索方法,其特征在于,利用堆叠交叉注意机制对图像语义单元和文本语义单元计算图像-文本相似度的具体步骤包括:使用堆叠的交叉注意力和注意力权重来计算图像-文本相似度,完成图像和文本的候选语义单元的对齐;其中,图像和文本的候选语义单元的对齐分为面向图像嵌入空间的对齐和面向文本嵌入空间的对齐两部分,将面向图像嵌入空间的对齐和面向文本嵌入空间的对齐计算得到的相似度进行整合,得到图像-文本相似度。

7.如权利要求6所述的基于多尺度语义扫描的图文互检索方法,其特征在于,面向图像嵌入空间的对齐具体步骤包括:首先,计算图像区域特征和文本区域特征的相似度;然后对相似度进行按行归一化。再利用注意力机制计算注意力权重,进行加权;然后将加权后的文本区域特征求和,作为文本上下文特征,进一步计算每个图像区域和文本上下文特征的余弦相似度;最后,将所有图像区域与文本上下文特征的余弦相似度进行合并,最终得到图像和文本的相似度矩阵。

8.如权利要求7所述的基于多尺度语义扫描的图文互检索方法,其特征在于,面向文本嵌入空间的对齐具体步骤包括:首先,计算图像区域特征和文本区域特征的相似度;然后对相似度进行按行归一化;再利用注意力机制计算注意力权重,进行加权,将加权后的图像区域特征求和,得到图像上下文特征,进一步计算每个文本区域和图像上下文特征的相似度;最后,将所有文本区域与图像上下文特征的余弦相似度进行合并,最终得到图像和文本的相似度矩阵。

9.如权利要求1所述的基于多尺度语义扫描的图文互检索方法,其特征在于,利用动态自适应加权损失函数对图像-文本相似度进行优化过程中,优化每批数据中最困难的负样本和最困难的正样本之间的样本,而不是优化所有样本。

10.一种基于多尺度语义扫描的图文互检索系统,其特征在于,包括:

技术总结

本发明公开了一种基于多尺度语义扫描的图文互检索方法及系统,涉及跨模态检索技术领域。首先,为了从图像和文本中生成多粒度语义单元,通过多级重叠滑动窗口对前景和背景区域进行多尺度语义扫描。其次,为了对齐图像和文本之间的语义单元,使用堆叠交叉注意力机制来计算初始图像‑文本相似度。再次,为了进一步自适应地优化图像文本相似度,设计了动态自适应加权损失。最后,为了执行图像文本检索,将多粒度前景和背景语义单元之间的相似度进行融合,以获得最终的图像文本相似度。本发明真正实现了多粒度前景语义单元与多粒度背景语义单元的互补,有效挖掘完整的语义信息进行图文检索,提高检索的精度。

技术研发人员:刘峥,徐君豪,高珊珊,苏宜俊

受保护的技术使用者:山东财经大学

技术研发日:

技术公布日:2024/1/14

- 还没有人留言评论。精彩留言会获得点赞!