一种基于热感图像和可见光图像特征融合的场景语义分割方法

本发明涉及基于深度学习语义分割,尤其涉及一种基于热感图像和可见光图像特征融合的场景语义分割方法。

背景技术:

1、随着计算机视觉、机器人等技术的发展,以机器人、无人车为代表的无人系统在各个领域得到了广泛应用。为了实现无人系统的自主导航,环境感知是非常重要的环节,对于机器人与外界环境的理解、交互起重要的作用。环境感知主要有目标检测和语义分割两种方法,语义分割相比目标检测实现像素级的分割,能给出更多的语义信息,更有利帮助无人系统识别和理解周围环境的目标。在现有的语义分割方法中,针对现有的rgb图像数据集,其分割的结果往往是无法达到很好的效果,其鲁棒性差,在目标之间相互遮挡、光照条件差、天气气候不佳等环境下,分割性能往往不佳。

2、为了提高现有场景语义分割方法的鲁棒性,不少研究者将热感图像引入语义分割中,利用红外热成像相机与可见光相机成像机制不同,通过物体辐射的热量获取红外信息,可以增强对光线与天气变化的鲁棒性,热红外信息对于光照条件差产生的识别模糊非常有效,因此研究人员将关注转移到了多模态语义分割领域,利用具有丰富的纹理、颜色信息的可见光和稳定的热感图像特征,来提升语义分割的鲁棒性和精确度。

3、由于可见光图像和热感图像的特征融合会产生不可预测的噪声影响,简单的利用两个模态的特征会导致其分割精度不如单模态。2017年,ha等人提出了mfnet网络和第一个rgb-t的城市街景的语义分割数据集,此网络采用了两个编码器分别提取rgb和热感图的特征和一个解码器结构,在编码器中部分上采样操作前融合两个模态的信息。2019年,sun等人设计了rtfnet,采用的主干网络是resnet,在编码器中通过相加来连接两个模态的相应阶段的特征图,解码器设计了两个模块来逐步完成特征的提取和分辨率的恢复。2020年,shivakumar等人设计了一个双路的神经网络结构,能够有效的融合rgb信息和rgb-t信息,同时提出了一种rgb-t数据集矫正的方法,通过depth信息来校正rgb和rgb-t信息对齐,通过rgb-t到rgb图像的映射关系进行校正。2021年,zhou等人提出了多级特征多标签学习网络,将编码器中提取的特征设计了相应的模块进行特征图处理,同时引入了三个标签对其网络进行监督。接着liu等人提出了cmx模型,通过结合其他模态的特征,在空间和维度上来校准当前模态的特征。

4、在目前存在的研究方法中,分割精度仍然达不到满意的效果,无法兼顾精度和模型的参数量。如何有效地利用可见光图像和热感图像的特点,挖掘它们之间的互补特征,并降低由于成像机制不同而引入的噪声,以提高模型的泛化能力,这是一个重要的挑战。

技术实现思路

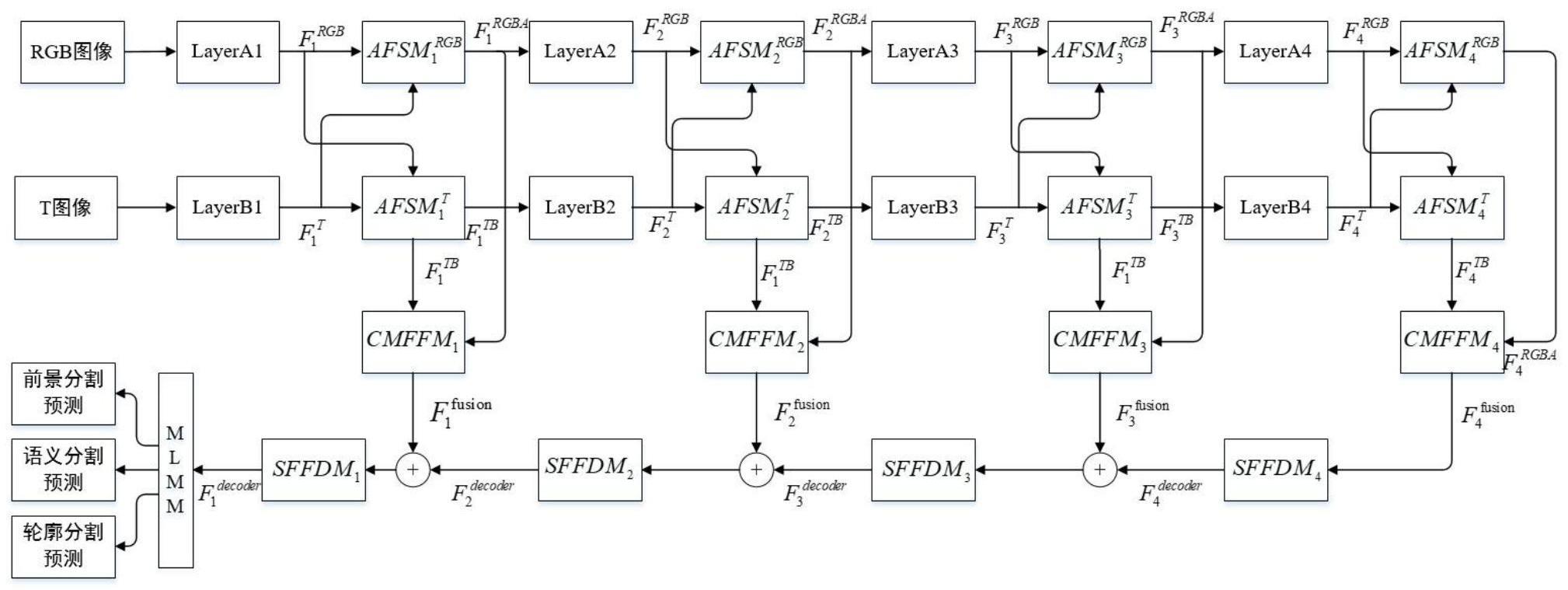

1、本发明针对上述已有方法存在的不足,发明了一种基于热感图像和可见光图像特征融合的场景语义分割方法,旨在对两个模态中进行选择性特征互补,进而充分的利用两个模态的特征优势实现模态间特征交互,结合一种跨模态特征融合方式和逐级特征融合解码器方法,同时使用多损失监督来定位、分割、细化目标边缘来提升复杂场景下语义分割精度。

2、根据上述思路,实现本发明采取的技术方案为:

3、一种基于热感图像和可见光图像特征融合的场景语义分割方法,分割模型包括:

4、主干特征提取网络,用于对输入的可见光图像和热感图像提取不同层次的特征;

5、辅助特征选择模块,用于对主干特征提取网络提取的多层级特征在两个模态之间进行相互补充特征信息,随后输入到主干网络进行进一步特征提取;

6、跨模态特征融合模块,对经过互补特征选择模块的特征进行特征的融合,得到一个富含两个模态的语义信息特征;

7、逐级特征融合解码器模块,用于融合跨模态特征密集融合模块中的特征图和上采样的特征图,实现解码器的精细化上采样;

8、多损失监督模块,得到前景分割预测、语义分割预测、轮廓分割预测用于来定位、分割、细化目标边缘。

9、可选地,所述主干特征提取网络为segformer网络,所述segformer网络的编码器是一种无位置编码的分层transfomer编码器,可以适应任意的测试分辨率,不影响分割的性能,同时分层transfomer解码器能够生成高分辨率的精细特征和低分辨率的粗特征,生成多尺度特征;

10、可选地,所述辅助特征选择模块包括拼接模块、通道注意力模块、空间注意力模块和辅助特征融合模块;所述拼接模块用于将输入特征pmain和另一个输入特征passist在通道维度上进行拼接处理,得到特征p1;特征p1并行输入到通道注意力模块和空间注意力模块分别得到两个特征输出pc和ps;将特征pmain、pc和ps输入到辅助特征融合模块得到最后的输出特征fout,fout会输入到主干网络和跨模态特征融合模块。

11、可选地,所述跨模态特征融合模块包括1×1卷积模块、分组卷积模块、密集级联语义信息模块以及残差连接。所述1×1卷积模块用于对由第1个输入特征和第2个输入特征拼接后的特征进行特征通道信息的学习,得到特征经过分组卷积模块、密集级联语义信息模块得到特征和通过残差连接将特征和采取特征元素相加的方式进行融合得到的输出特征为

12、可选地,所述分组卷积模块输入一个尺度大小为2c×h×w的特征特征会经过1×1卷积模块对通道变换学习、经过3×3的分组卷积、通过激活函数relu进行非线性学习,然后再经过1×1卷积,此时特征大小为c×h×w的特征,最后对其进行正则化处理得到特征

13、可选地,密集级联语义信息模块是一个密集特征连接结构,卷积核使用的是3×3,填充和扩张率分别为3,5,7,该模块构成特征内密集连接,输入特征为输出特征为

14、可选地,所述逐级特征融合解码器模块包含1×1卷积操作,进行一个通道的语义信息卷积,这个卷积是为后面融合相应融合跨模态特征融合模块中的特征图设置的,此时得到特征fcbr1×1,特征fcbr1×1经过3×3卷积、转置卷积得到第一个精细化上采样特征特征fcbr1×1经过转置卷积得到第二个精细化上采样特征特征和特征采取特征元素相加的方式进行融合得到输出特征

15、可选地,多损失监督模块这模块得到前景分割预测、语义分割预测、轮廓分割预测,同时使用三个交叉熵损失函数对三个分割预测计算相应的损失,将三个损失相加得到整个网络损失输出;

16、本发明具有如下优点:

17、1.本发明对复杂的场景下目标的分割精度显著提升,同时模型的参数量较小,便于在嵌入式设备上的部署。

18、2.本发明能够有效的融合两个模态特征,探究了两个模态之间特征的有效性和互补性,模型具有较强的泛化能力。

技术特征:

1.一种基于热感图像和可见光图像特征融合的场景语义分割方法,其特征在于,热感图像和可见光图像输入到训练好的语义分割模型,得到图像中每一类目标的分割结果,所述基于热感图像和可见光图像特征融合的场景语义分割方法包括:

2.根据权利要求1所述的基于热感图像和可见光图像特征融合的场景语义分割方法,其特征在于,所述辅助特征选择模块包括拼接模块、通道注意力模块、空间注意力模块和辅助特征融合模块;所述拼接模块用于将输入特征pmain和另一个输入特征passist在通道维度上进行拼接处理,得到特征p1;特征p1并行输入到通道注意力模块和空间注意力模块分别得到两个特征输出pc和ps;将特征pmain、pc和ps输入到辅助特征融合模块得到最后的输出特征fout。

3.根据权利要求1所述的基于热感图像和可见光图像特征融合的场景语义分割方法,其特征在于,所述跨模态特征融合模块包括1×1卷积模块、分组卷积模块、密集级联语义信息模块和残差连接;所述1×1卷积模块用于对由第1个输入特征和第2个输入特征拼接后的特征进行特征通道信息的学习,得到特征经过分组卷积模块、密集级联语义信息模块得到特征和通过残差连接将特征和采取特征元素相加的方式进行融合得到输出特征为

4.根据权利要求1所述的基于热感图像和可见光图像特征融合的场景语义分割方法,其特征在于,所述逐级特征融合解码器模块包含1×1卷积模块、3×3卷积模块和转置卷积模块;所述1×1卷积模块对输入特征进行一个通道的语义信息卷积,得到特征fcbr1×1;特征fcbr1×1经过3×3卷积、转置卷积得到第一个精细化上采样特征特征fcbr1×1经过转置卷积得到第二个精细化上采样特征特征和特征采取特征元素相加的方式进行融合得到输出特征

5.根据权利要求1所述的基于热感图像和可见光图像特征融合的场景语义分割方法,其特征在于,所述多损失监督模块是评估前景分割预测、语义分割预测、轮廓分割预测与它们对应的三个真实标签之间的误差,帮助网络模型进行学习,使用交叉熵损失函数lbin、lsem、lboud对其三个分割预测输出fbin、fsem、fboud进行训练监督:

技术总结

本发明公开了一种基于热感图像和可见光图像特征融合的场景语义分割方法,本发明方法将同一场景的可见光和热感图像成对输入到训练好的语义分割模型中得到图像中物体的分割结果,该分割模型包括:双分支主干特征提取网络Segfomer,用于对输入的数据进行全局特征的提取;辅助特征选择模块,用于对主干特征提取网络提取的层级特征进行两个模态之间相互补充特征信息;跨模态特征融合模块,进行模态间的特征进一步融合,得到一个丰富的语义信息特征;逐级特征融合解码器模块,实现解码器的精细化上采样;多损失监督模块,用于监督模型的学习。本发明能够有效地利用可见光图像和热感图像的特点,挖掘它们之间的互补特征,在保持模型较小参数量的同时,有效提高场景语义分割模型的分割精度和泛化能力。

技术研发人员:朱江,陈寒梅,张杰,许海霞,李赛斯,田淑娟,李艳春

受保护的技术使用者:湘潭大学

技术研发日:

技术公布日:2024/1/15

- 还没有人留言评论。精彩留言会获得点赞!