基于融合特征的活体检测方法、装置、系统及介质与流程

本发明涉及金融科技,尤其涉及基于融合特征的活体检测方法、装置、系统及介质。

背景技术:

1、随着移动互联网的发展,智能手机改变了人们的工作和生活方式,足不出户即可享受各种便捷的服务。银行业也是如此,在线服务让广大用户可以随时随地办理银行的查询、转账、理财等业务,而在业务办理时,身份认证则是用户账户安全的必要流程,其中人脸识别是身份认证常用的手段之一。

2、人脸识别的原理是通过摄像头录制视频采集人脸信息,与用户预留的照片进行比对核验是否是本人。随着攻击手法的进步,普通的人脸识别例如静默活体、随机动作活体等方式也越来越不安全,因此基于口型识别的人脸活体检测因其安全性被越来越重视。

3、目前已有方案仅是利用人脸图像来实现口型识别。由于不同用户嘴部的颜色及纹理会有所不同,以及受外界拍摄因素的影响,使得不同用户在说相同文本或者同一用户在不同环境下说相同文本,最终采集到的视频序列也会有较大的差异,从而在一定程度上会影响口型识别的性能及鲁棒性,降低了人脸活体检测的可靠性。

技术实现思路

1、鉴于上述现有技术的不足,本发明的目的在于提供可应用于金融科技或其它相关领域的基于融合特征的活体检测方法、装置、系统及介质,旨在提高基于口型识别的人脸活体检测的可靠性。

2、本发明的技术方案如下:

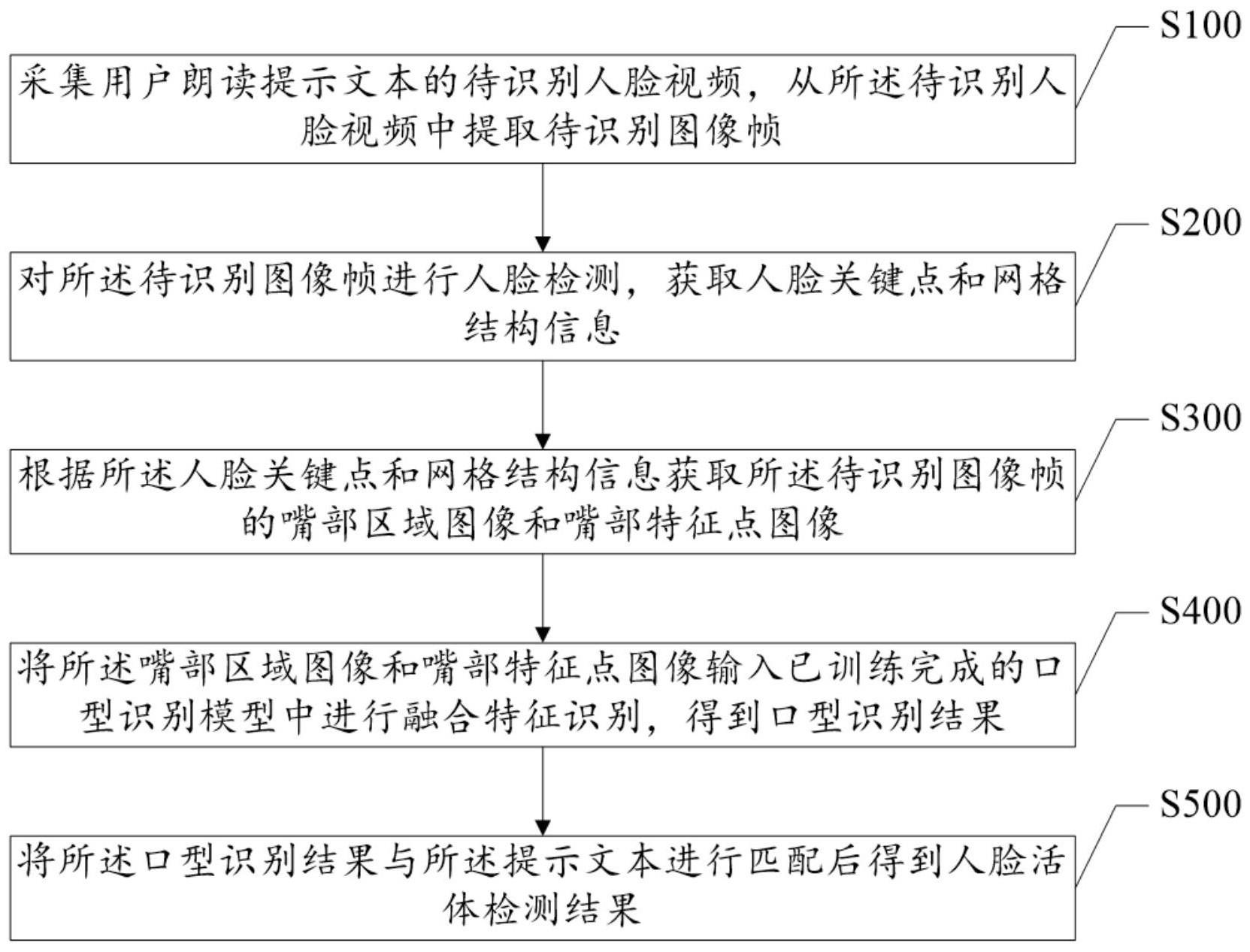

3、一种基于融合特征的活体检测方法,包括:

4、采集用户朗读提示文本的待识别人脸视频,从所述待识别人脸视频中提取待识别图像帧;

5、对所述待识别图像帧进行人脸检测,获取人脸关键点和网格结构信息;

6、根据所述人脸关键点和网格结构信息获取所述待识别图像帧的嘴部区域图像和嘴部特征点图像;

7、将所述嘴部区域图像和嘴部特征点图像输入已训练完成的口型识别模型中进行融合特征识别,得到口型识别结果;

8、将所述口型识别结果与所述提示文本进行匹配后得到人脸活体检测结果。

9、在一个实施例中,所述采集用户朗读提示文本的待识别人脸视频,从所述待识别人脸视频中提取待识别图像帧,包括:

10、采集用户朗读提示文本的待识别人脸视频;

11、提取所述待识别人脸视频中的音频数据;

12、根据所述音频数据确定所述待识别人脸视频中的朗读语音部分;

13、提取所述朗读语音部分的图像帧作为所述待识别图像帧。

14、在一个实施例中,所述根据所述音频数据确定所述待识别人脸视频中的朗读语音部分,包括:

15、确定所述音频数据中音量大于预设阈值的起始时间和终止时间;

16、根据所述起始时间和终止时间对所述待识别人脸视频进行截取,得到所述朗读语音部分。

17、在一个实施例中,所述根据所述人脸关键点和网格结构信息获取所述待识别图像帧的嘴部区域图像和嘴部特征点图像,包括:

18、根据所述待识别图像帧中人脸关键点的位置计算变换矩阵;

19、根据所述变化矩阵对所述待识别图像帧进行仿射变换后截取嘴部区域图像;

20、根据所述待识别图像帧中的网格结构信息以及预设平均正面人脸网格信息,对所述待识别图像帧进行人脸网格对齐;

21、根据对齐后的所述待识别图像帧的网格点构建输出嘴部特征点图像。

22、在一个实施例中,所述将所述嘴部区域图像和嘴部特征点图像输入已训练完成的口型识别模型中进行融合特征识别,得到口型识别结果,包括:

23、分别对所述嘴部区域图像和嘴部特征点图像进行特征提取,得到第一特征和第二特征;

24、对所述第一特征和第二特征进行拼接融合后得到融合特征;

25、根据所述融合特征进行口型分类后输出口型识别结果。

26、在一个实施例中,所述将所述嘴部区域图像和嘴部特征点图像输入已训练完成的口型识别模型中进行融合特征识别,得到口型识别结果,包括:

27、分别对所述嘴部区域图像和嘴部特征点图像进行特征提取,得到第一特征和第二特征;

28、根据所述第一特征和第二特征分别进行口型分类后得到第一分类得分和第二分类得分;

29、对所述第一分类得分和第二分类得分进行融合后确定得分最高的口型类型,输出口型识别结果。

30、在一个实施例中,所述将所述口型识别结果与所述提示文本进行匹配后得到人脸活体检测结果,包括:

31、将所述口型识别结果中的口型类型与所述提示文本对应的标准口型类型进行对比,判断是否一致;

32、若一致,则展示检测通过的人脸活体检测结果,否则展示检测不通过的人脸活体检测结果。

33、一种基于融合特征的活体检测装置,包括:

34、采集提取模块,用于采集用户朗读提示文本的待识别人脸视频,从所述待识别人脸视频中提取待识别图像帧;

35、人脸检测模块,用于对所述待识别图像帧进行人脸检测,获取人脸关键点和网格结构信息;

36、图像提取模块,用于根据所述人脸关键点和网格结构信息获取所述待识别图像帧的嘴部区域图像和嘴部特征点图像;

37、口型识别模块,用于将所述嘴部区域图像和嘴部特征点图像输入已训练完成的口型识别模型中进行融合特征识别,得到口型识别结果;

38、检测输出模块,用于将所述口型识别结果与所述提示文本进行匹配后得到人脸活体检测结果。

39、一种基于融合特征的活体检测系统,所述系统包括至少一个处理器;以及,

40、与所述至少一个处理器通信连接的存储器;其中,

41、所述存储器存储有可被所述至少一个处理器执行的指令,所述指令被所述至少一个处理器执行,以使所述至少一个处理器能够执行上述基于融合特征的活体检测方法。

42、一种非易失性计算机可读存储介质,所述非易失性计算机可读存储介质存储有计算机可执行指令,该计算机可执行指令被一个或多个处理器执行时,可使得所述一个或多个处理器执行上述的基于融合特征的活体检测方法。

43、有益效果:本发明公开了基于融合特征的活体检测方法、装置、系统及介质,相比于现有技术,本发明实施例通过嘴部区域图像和嘴部特征点图进行融合特征识别得到口型识别结果,有效避免了因嘴部颜色纹理或外界因素对口型识别的影响,增强了基于口型识别的人脸活体检测的准确性和鲁棒性。

技术特征:

1.一种基于融合特征的活体检测方法,其特征在于,包括:

2.根据权利要求1所述的基于融合特征的活体检测方法,其特征在于,所述采集用户朗读提示文本的待识别人脸视频,从所述待识别人脸视频中提取待识别图像帧,包括:

3.根据权利要求2所述的基于融合特征的活体检测方法,其特征在于,所述根据所述音频数据确定所述待识别人脸视频中的朗读语音部分,包括:

4.根据权利要求1所述的基于融合特征的活体检测方法,其特征在于,所述根据所述人脸关键点和网格结构信息获取所述待识别图像帧的嘴部区域图像和嘴部特征点图像,包括:

5.根据权利要求1所述的基于融合特征的活体检测方法,其特征在于,所述将所述嘴部区域图像和嘴部特征点图像输入已训练完成的口型识别模型中进行融合特征识别,得到口型识别结果,包括:

6.根据权利要求1所述的基于融合特征的活体检测方法,其特征在于,所述将所述嘴部区域图像和嘴部特征点图像输入已训练完成的口型识别模型中进行融合特征识别,得到口型识别结果,包括:

7.根据权利要求1所述的基于融合特征的活体检测方法,其特征在于,所述将所述口型识别结果与所述提示文本进行匹配后得到人脸活体检测结果,包括:

8.一种基于融合特征的活体检测装置,其特征在于,包括:

9.一种基于融合特征的活体检测系统,其特征在于,所述系统包括至少一个处理器;以及,

10.一种非易失性计算机可读存储介质,其特征在于,所述非易失性计算机可读存储介质存储有计算机可执行指令,该计算机可执行指令被一个或多个处理器执行时,可使得所述一个或多个处理器执行权利要求1-7任一项所述的基于融合特征的活体检测方法。

技术总结

本发明公开了基于融合特征的活体检测方法、装置、系统及介质,方法包括:采集用户朗读提示文本的待识别人脸视频,从待识别人脸视频中提取待识别图像帧;对待识别图像帧进行人脸检测,获取人脸关键点和网格结构信息;根据人脸关键点和网格结构信息获取待识别图像帧的嘴部区域图像和嘴部特征点图像;将嘴部区域图像和嘴部特征点图像输入已训练完成的口型识别模型中进行融合特征识别,得到口型识别结果;将口型识别结果与提示文本进行匹配后得到人脸活体检测结果。通过嘴部区域图像和嘴部特征点图进行融合特征识别得到口型识别结果,有效避免了因嘴部颜色纹理或外界因素对口型识别的影响,增强了基于口型识别的人脸活体检测的准确性和鲁棒性。

技术研发人员:唐有宝,林瑞嵩,黄炎鑫

受保护的技术使用者:平安银行股份有限公司

技术研发日:

技术公布日:2024/1/14

- 还没有人留言评论。精彩留言会获得点赞!