一种基于场景无关特征学习的行人重识别方法与流程

本发明涉及图像处理研究领域,具体涉及一种基于场景无关特征学习的行人重识别方法。

背景技术:

1、行人重识别的公共数据集由于光线,地域等差异,其特征分布相差巨大,在一个数据集上训练的模型在其他数据集上的性能下降使其几乎无法使用。

2、现有的行人重识别方法着眼于单个数据集上的性能提升,即使是结合了场景id以学习的特征也无法避免地域差异带来的特征分布的差异。

3、另外还有基于gan进行数据增强的行人重识别方法,但这类方法无论是成本限制还是性能提升限制都使得其很难用于实际业务。

4、目前基于跨域学习的行人重识别方法几乎集中于无监督学习或者基于单一目标场景。无监督学习相较监督学习的性能差异使其很少用于实际情形;而基于单一目标场景的跨域学习方法又注定了其通用能力不足。

技术实现思路

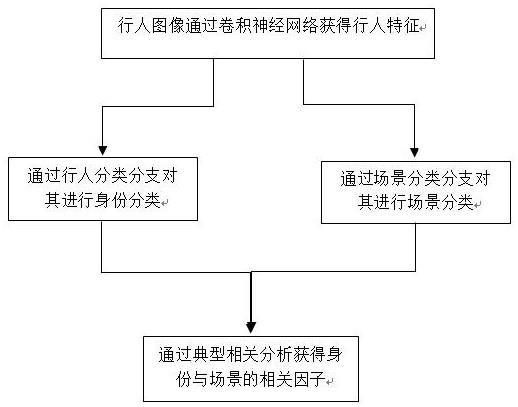

1、为了克服现有技术的不足,本发明基于源数据集和目标数据集训练一个场景分类器,通过将行人的id分类器与场景分类器的特征进行典型相关分析,获得一个行人身份特征与场景特征的相关因子,然后通过对抗学习,一方面典型相关因子的有效性,另一方面使得二者的相关因子降低,最后得到与场景无关的身份特征。具体技术方案如下:

2、一种基于场景无关特征学习的行人重识别方法,包括以下步骤:

3、步骤1,将一定数量的行人图像作为训练样本,将所有训练样本的id数量设为cid,场景数量设为cscene,从所有训练样本中任意选取一个样本集s,其中的样本数量为b,id类别标签为tid,场景类别标签为tscene。

4、步骤2,对于所述样本集s,通过卷积神经网络模型对其提取维度为d1的图像特征f。

5、步骤3,将所述样本集s输入行人分类分支,该分支包含两个全连接层,第一全连接层的维度为d1×d2,第二全连接层的维度为d2×cid,f经过第一层全连接层能够得到一个身份特征fid,身份特征fid经过第二层全连接层能够得到网络对于行人身份的id分类预测值pid。

6、步骤4,将所述样本集s输入场景分类分支,该分支包含两个全连接层,第一全连接层的维度为d1×d2,第二全连接层的维度为d2×cscene,f经过第一层全连接层能够得到一个场景特征fscene,场景特征fscene经过第二层全连接层能够得到网络对于行人图像的场景分类预测值pscene。

7、步骤5,采用典型相关分析的方法对身份特征fid和场景特征fscene提取相关因子,得到lcorr,lcorr用于优化典型相关分析部分的神经网络,梯度下降时,将梯度全部反转,从而使得相关性增大。

8、步骤6,使用ce loss分别训练身份和场景分类器,利用梯度下降法通过减小loss的方法去除特征的相关性。

9、步骤7,最终训练时,交替进行典型相关分析和分类器训练,从而形成对抗学习,最终达到一个平衡,该平衡下,典型相关分析的性能优良,可以有效评估身份和场景特征的相关性;同时通过分类器提取出的身份和场景信息的相关性达到极小化极大值。

10、与现有技术相比,本发明的有益效果为:适用范围广,通过该方法可以结合几乎所有已知用于监督学习的行人重识别公开数据集;通过提取场景无关的身份特征以实现效果,减少不同场景数据带来的消极影响;由于采用即插即用式设计,该方法对于不同任务及不同场景甚至是不同领域具有通用性,如画风无关的动漫人物识别,或者身份无关的语音识别等。

技术特征:

1.一种基于场景无关特征学习的行人重识别方法,其特征在于,包括以下步骤:

2.根据权利要求1所述的一种基于场景无关特征学习的行人重识别方法,其特征在于,步骤5典型相关分析的具体实现方法为,分别使用两个维度为d2×1的全连接层进行特征提取,得到两个维度为1的特征因子fid和fscene,然后对其计算皮尔逊系数pearson(fid,fscene),设lcorr=pearson2(fid,fscene),当lcorr趋于0时,表示二者相关性逐渐去除,趋于1时,表示相关性增强。

3.根据权利要求2所述的一种基于场景无关特征学习的行人重识别方法,其特征在于,步骤6训练分类器的具体方法为,将步骤3和步骤4得到的所述分类预测值pid和pscene分别与标签tid和tscene计算ce loss,得到lid=ce(pid,tid),lscene=ce(pscene,tscene)。

4.根据权利要求3所述的一种基于场景无关特征学习的行人重识别方法,其特征在于,最终训练时,整体loss为lsum=λ1lid+λ2lscene+λ3lcorr,其中超参数λ1+λ2+λ3=1。

技术总结

本发明公开了一种基于场景无关特征学习的行人重识别方法,该方法基于源数据集和目标数据集训练一个场景分类器,通过将行人的ID分类器与场景分类器的特征进行典型相关分析,获得一个行人身份特征与场景特征的相关因子,然后通过对抗学习,一方面典型相关因子的有效性,另一方面使得二者的相关因子降低,最后得到与场景无关的身份特征。通过该方法可以结合几乎所有已知用于监督学习的行人重识别公开数据集;通过提取场景无关的身份特征以实现效果,减少不同场景数据带来的消极影响;由于采用即插即用式设计,该方法对于不同任务及不同场景甚至是不同领域具有通用性,如画风无关的动漫人物识别,或者身份无关的语音识别等。

技术研发人员:周金明,孙良良

受保护的技术使用者:南京行者易智能交通科技有限公司

技术研发日:

技术公布日:2024/1/15

- 还没有人留言评论。精彩留言会获得点赞!