一种基于双重特征知识蒸馏的语义分割方法

本发明属于计算机视觉,更具体地,涉及一种基于双重特征知识蒸馏的语义分割方法。

背景技术:

1、语义分割是计算机视觉中一个关键且具有挑战性的任务,该任务结合了图像分类、目标检测和图像分割,通过一定的方法将图像分割成具有一定语义含义的区域块,并识别出每个区域块的语义类别,实现从底层到高层的语义推理过程,最终得到一幅具有逐像素语义标注的分割图像。语义分割可以应用在自动驾驶、虚拟现实技术和机器人领域中。目前流行的最先进的分割网络如deeplab、pspnet和ocrnet等均取得了显著的性能,但这些网络往往需要较高的计算成本,这一缺点使得大部分分割网络难以在资源有限的移动设备上部署。知识蒸馏方法的提出可以实现在大容量教师网络的指导下去提高小容量学生网络的语义分割性能。

2、语义分割任务的目标是密集像素预测,直接使用基于分类的知识蒸馏方法来处理密集的预测任务可能无法达到理想的性能。针对粗分类任务的师生网络对齐可能会导致语义分割的负约束,忽略像素之间的模块结构变化以及语义信息。用于语义分割的知识蒸馏方法通常引导学生模仿教师从中间层特征中生成的结构化信息,虽然通过中间特征层知识蒸馏获得了不错的结果,但这些方法忽略了输出层特征蒸馏包含的种类间关系信息,如果能将结构化信息的方法与种类间关系信息的方法结合,就能对图像的语义信息有更深入了解,并在很大程度上改善知识蒸馏的性能。

技术实现思路

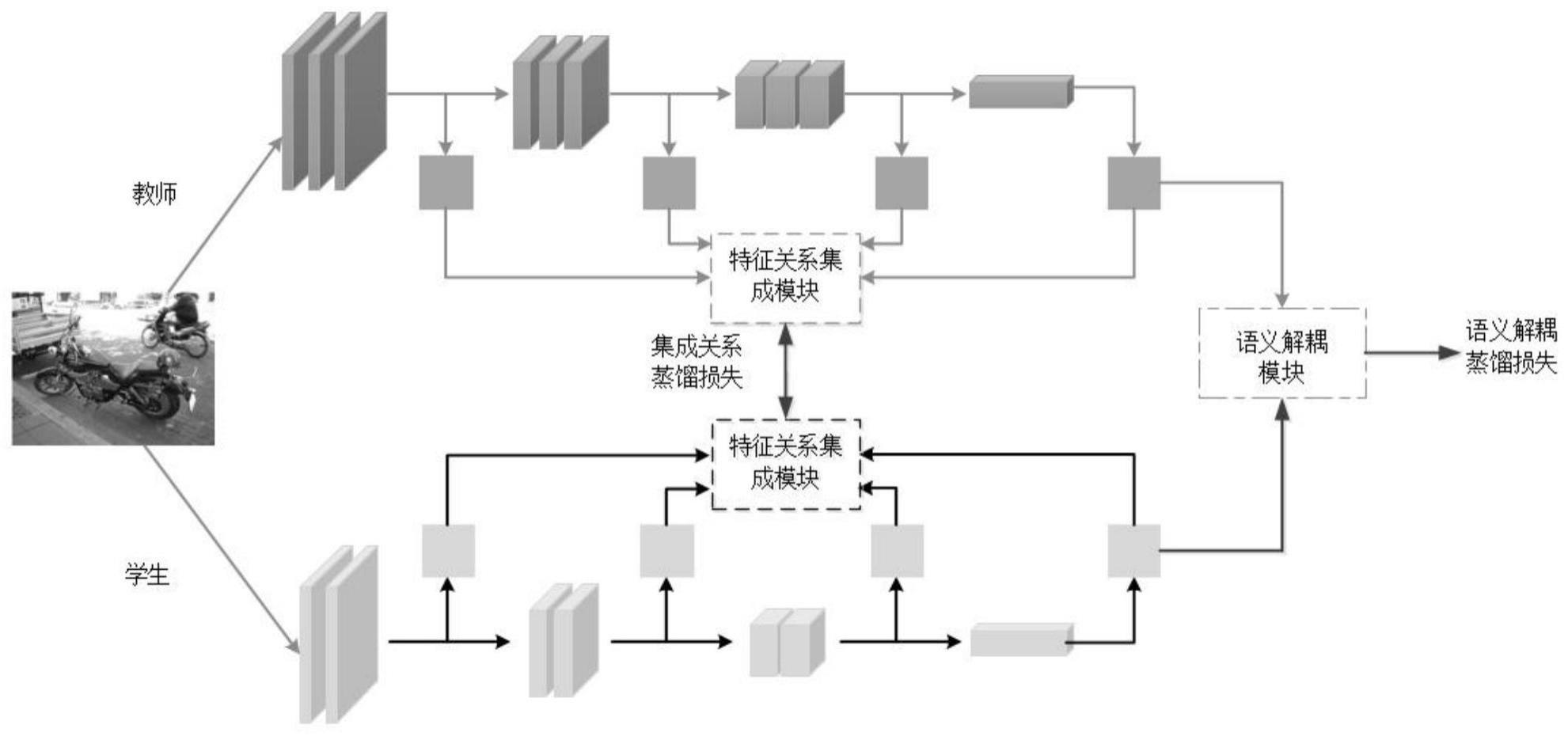

1、本发明目的在于提供一种基于双重特征知识蒸馏的语义分割方法,重点关注教师模型和学生网络特征间的集成化关系及输出特征包含的内在语义关系,解决在有限内存下大模型难以训练和推理的问题,提升语义分割网络的检测准确度。

2、实现本发明目的的技术解决方案为:一种基于双重特征知识蒸馏的语义分割方法,包括以下步骤:

3、步骤s1、下载语义分割数据集并对数据集进行数据增强,构建增强数据集,转入步骤s2。

4、步骤s2、构建教师网络和学生网络,利用增强数据集中训练集训练教师网络得到教师模型,转入步骤s3。

5、步骤s3、利用教师模型、特征关系集成模块、语义解耦模块对学生网络进行蒸馏,得到训练好的学生模型,包含以下子步骤:

6、步骤s3-1、将教师模型划分为n个子模块,并将学生网络也对应划分为n个子模块,分别提取教师模型和学生网络各自模块的特征送入特征关系集成模块,计算集成关系蒸馏损失。

7、步骤s3-2、分别提取教师模型和学生网络各自的输出层特征送入语义解耦模块,计算语义解耦蒸馏损失。

8、步骤s3-3、利用集成关系蒸馏损失和语义解耦蒸馏损失对学生网络的参数进行更新,最终获得训练好的学生模型;转入步骤s4。

9、步骤s4、将原数据集中测试集输入训练好的学生模型,输出测试集图像中每个像素点的类别,评估训练好的学生模型的准确率。

10、与现有技术相比,本发明的显著优点在于:

11、1)特征关系集成模块将上下文信息聚合并建立教师模型和学生网络模块间的特征关系,提取到更有利于提升学生网络性能的结构信息,得到一个更好的结构化特征空间,又保留学生网络自适应训练的空间,减少对学生网络的约束,进而提高语义分割模型效能。

12、2)语义解耦模块将输出层特征知识解耦,按照类别面积大小进行逐次删除,将每次未删除的类别重新归一化后作为非目标类进行学习,通过迭代法删除特征从而获取不同的非目标类,让学生网络逐次学习不同的有用信息,不断地指导学生网络模仿教师模型中非目标类的种类间相似度,显著提高学生网络的性能,在模型的训练过程中也不会引入额外的开销。

技术特征:

1.一种基于双重特征知识蒸馏的语义分割方法,其特征在于,包括以下步骤:

2.根据权利要求1所述的一种基于双重特征知识蒸馏的语义分割方法,其特征在于,步骤s3-1中,将教师模型划分为n个子模块,并将学生网络也对应划分为n个子模块,分别提取教师模型和学生网络每个模块的特征送入特征关系集成模块,计算集成关系蒸馏损失,具体流程如下:

3.根据权利要求2所述的一种基于双重特征知识蒸馏的语义分割方法,其特征在于,特征关系集成模块的构建方法具体如下:

4.根据权利要求3所述的一种基于双重特征知识蒸馏的语义分割方法,其特征在于,利用教师模型集成化特征关系矩阵和学生网络集成化特征关系矩阵计算教师模型和学生网络的集成关系蒸馏损失lfrm,计算公式为:

5.根据权利要求2所述的一种基于双重特征知识蒸馏的语义分割方法,其特征在于,教师模型和学生网络所划分的模块数量n范围为2≤n≤5。

6.根据权利要求1所述的一种基于双重特征知识蒸馏的语义分割方法,其特征在于,步骤s3-2中,分别提取教师模型和学生网络各自的输出层特征送入语义解耦模块,语义解耦模块的构建方法如下:

7.根据权利要求6所述的一种基于双重特征知识蒸馏的语义分割方法,其特征在于,步骤s3-2中,语义解耦蒸馏损失的构建如下:

8.根据权利要求1所述的一种基于双重特征知识蒸馏的语义分割方法,其特征在于,步骤s3-3中,利用集成关系蒸馏损失和语义解耦蒸馏损失对学生网络的参数进行更新,最终获得训练好的学生模型,构建的总体损失函数为:

技术总结

本发明公开了一种基于双重特征知识蒸馏的语义分割方法,利用教师模型中间层特征知识和输出层语义知识实现知识的迁移。分别获取教师模型和学生网络的多个中间层特征知识送入特征关系集成模块,聚合不同特征层上下文信息;分别获取教师模型和学生网络输出层语义知识送入语义解耦模块,删除指定目标类,求出教师模型和学生网络输出层知识差距。本发明在学习中间层特征知识时能获取一个更好的结构化特征空间,保留学生网络自适应训练的空间,同时将输出层特征解耦,更好地模仿每个元素输出特征的语义信息。通过对特征空间和输出层两重知识的学习提高语义分割模型的性能,增强模型泛化性和鲁棒性。

技术研发人员:李玉莲,李亚萌,王军

受保护的技术使用者:中国矿业大学

技术研发日:

技术公布日:2024/1/16

- 还没有人留言评论。精彩留言会获得点赞!