一种新型的基于文本-图像对的无参考图像质量评估方法

本发明属于计算机视觉,尤其是涉及一种新型的基于文本-图像对的无参考图像质量评估方法。

背景技术:

1、数字图像在医学成像、多媒体通信和计算机视觉等领域的应用日益广泛,因此准确评估图像质量变得至关重要。图像质量评估(image quality assessment,简称iqa)旨在通过模拟人类视觉感知,以客观的方式量化图像的质量。在许多应用中,特别是涉及图像传输、图像压缩和图像处理的领域,对图像质量的准确评估对于确保视觉感知的准确性和保真度至关重要。

2、多年来,已经开发和评估多种iqa方法,这些方法按照原始参考图像提供信息的多少一般分成3类:全参考(full reference-iqa,fr-iqa)、半参考(reduced reference-iqa,rr-iqa)和无参考(no reference-iqa,nr-iqa),无参考也叫盲参考(blind iqa,biqa)。全参考图像质量评估可以参考原始未失真图像,并基于失真图像和原始图像之间的差异获得失真图像的图像质量分数。半参考图像质量评估使用原始图像的部分信息作为参考来预测图像质量。然而,在实际应用中,参考图像很难获得,使得上述两种方法不适用,所以近些年的工作逐渐集中到biqa领域。

3、传统的biqa方法通常基于手工设计的特征,如自然场景统计(natural scenestatistics,简称nss)和基于码本的浅层特征学习。然而,这些方法往往难以捕捉到复杂图像的感知特征,且需要人为设计和调整特征提取器,限制了其泛化能力和适用性。

4、近年来,随着深度学习技术的发展,基于深度神经网络的方法在图像质量评估领域取得了显著的进展。这些方法利用深度神经网络的强大表达能力,能够自动学习和提取图像中的复杂感知特征,从而实现对图像质量的准确评估。通过深度学习的方法,可以克服传统方法中需要手工设计特征的限制,并能够在大规模数据集上进行端到端的训练,从而提高图像质量评估的性能和泛化能力。

5、openai提出clip模型(radford,et al.learning transferable visual modelsfrom natural language supervision.in international conference on machinelearning(pmlr),pages 8748–8763,2021.),这是一个自监督预训练框架,将图像和文本编码为一个共享的向量空间,而无需标注数据。clip展示在各种任务上强大的零样本迁移学习能力。wang等人(wang,et al.exploring clip for assessing the look and feel ofimages.arxiv preprint arxiv:2207.12396(2022))首次探索clip在挑战性图像感知评估任务中的潜力。他们提出一种使用反义词提示(例如“好照片”和“坏照片”)的提示配对策略,以减少提示的歧义性。在此基础上,zhang等人(zhang,et al.blind image qualityassessment via vision-language correspondence:a multitask learningperspective.in proceedings of the ieee/cvf conference on computer vision andpattern recognition(cvpr),pages 14071–14081,2023.)提出了多任务学习,通过将图像质量评估与失真类型分类和场景分类任务相结合来对clip进行微调。这种方法自动确定模型参数的共享和损失权重,利用来自其他任务的辅助知识。他们使用五个质量级别的likert量表,模型输出将质量级别作为逻辑加权和的得分。然而,这种多任务训练方法增加注释成本,并且质量级别的粗略划分存在性能瓶颈。

技术实现思路

1、本发明的目的是提供一种新型的基于文本-图像对的无参考图像质量评估方法,充分发挥clip模型在挑战性图像感知评估任务中的潜力。本发明提出一种细粒度的质量级别分层策略,使得学习到的特征与图像质量更密切相关。提出一个两阶段训练模型,在模型中,引入一组可学习的文本标记,以充分利用文本编码器的表征能力。同时,提出一个质量感知模块,用于从多个角度评估图像质量并提取与质量级别密切相关的深层特征。

2、本发明包括以下步骤:

3、1)根据数据集中每张图片的分数进行分级并赋予级别(或类别)标签,例如,得分在[49-50)范围内的图像被归类为级别[50],对应于类别[50]。

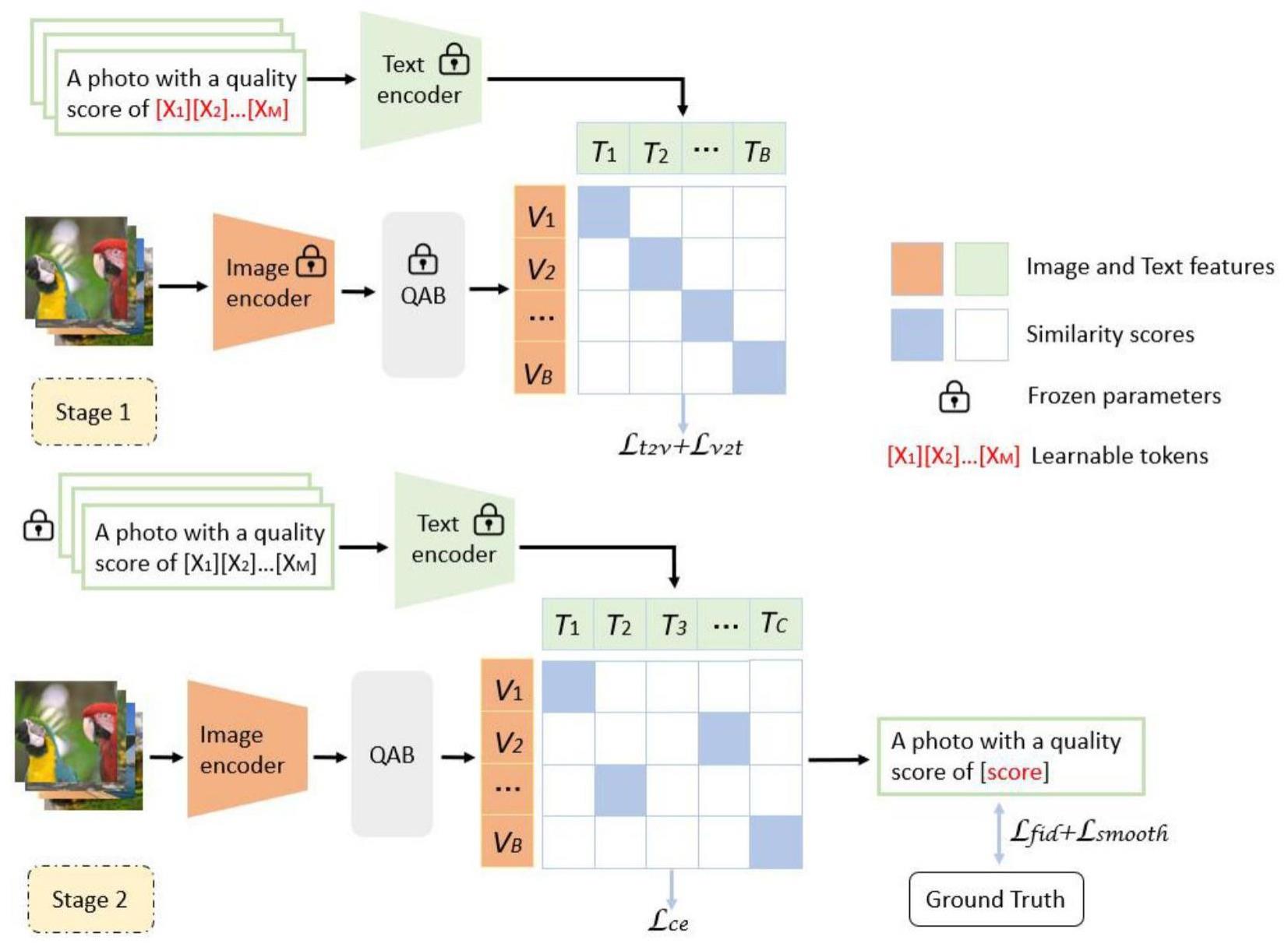

4、2)第一个模型训练阶段,引入了一组可学习的文本标记来表示细粒度的图像质量等级,以充分利用文本编码器的表征能力。在这一阶段,训练模型对质量分数文本以及图像的配对能力。

5、3)第二个模型训练阶段,引入一个质量可感知的模块,融合来自多个视角提取的图像特征。模型将根据文本编码器的输出特征以及图像编码器的输入特征计算相似度,并以加权求和的方式得到最终的质量分数。在这一阶段,训练模型准确预测图片质量分数的能力。

6、本发明的特点及效果:

7、本发明提出的新型的基于文本-图像对的无参考图像质量评估方法,解决了之前工作中存在性能瓶颈或需要其他人工标注成本等缺陷,在性能上取得较大提高。为了解决之前工作中五个质量级别的likert量表存在的性能瓶颈,提出一种细粒度的质量等级分级方法。并且,引入一组可学习的文本标记来表示图片的质量等级标签。为了提取更接近于图像质量的图像特征,在图像编码器后引入一个质量感知模块,以多视角的方法提取多个特征,并进行特征融合。

技术特征:

1.一种新型的基于文本-图像对的无参考图像质量评估方法,其特征在于包括以下步骤:

2.如权利要求1所述一种新型的基于文本-图像对的无参考图像质量评估方法,其特征在于,其特征在于所述步骤1)中,所述根据数据集中每张图片的分数进行分级并赋予级别或类别标签,若得分在[49-50)范围内的图像被归类为级别[50],对应于类别[50]。

3.如权利要求1所述一种新型的基于文本-图像对的无参考图像质量评估方法,其特征在于所述步骤2)中,所述第一个模型训练阶段,引入一组可学习的文本标记来表示细粒度的图像质量等级,以充分利用文本编码器的表征能力;具体而言,设计文本输入的形式,如下所示:“一张质量评分为[x]1[x]2[x]3...[x]m的照片”“[x]1[x]2[x]3...[x]m”用来表示质量等级,这里的m表示可学习标记的数量;在这一阶段,训练模型对质量分数文本以及图像的配对能力;使用的损失函数为:

4.如权利要求1所述一种新型的基于文本-图像对的无参考图像质量评估方法,其特征在于所述步骤3)中,所述第二个模型训练阶段,引入一个质量可感知的模块,融合来自多个视角提取的图像特征;

技术总结

一种新型的基于文本‑图像对的无参考图像质量评估方法,属于计算机视觉技术领域。无参考图像质量评估旨在模拟人类对图像失真的评估,提供一种新型的基于文本‑图像对的无参考图像质量评估方法,充分发挥CLIP模型在挑战性图像感知评估任务中的潜力。首先,提出一种细粒度的质量级别分层策略,使得学习到的特征与图像质量更密切相关。其次,提出一个两阶段训练模型。在模型中,引入一组可学习的文本标记,以充分利用文本编码器的表征能力。同时,提出一个质量感知模块,用于从多个角度评估图像质量并提取与质量级别密切相关的深层特征。

技术研发人员:纪荣嵘,高体民,潘文胜,郑侠武,张岩

受保护的技术使用者:厦门大学

技术研发日:

技术公布日:2024/1/16

- 还没有人留言评论。精彩留言会获得点赞!