基于卷积神经网络的高效遥感图像小目标检测方法

本发明涉及遥感图像目标检测,具体是基于卷积神经网络的高效遥感图像小目标检测方法。

背景技术:

1、近些年随着人工智能技术的发展,深度学习在计算机视觉、自然语言处理等领域都得到了蓬勃的发展。计算机视觉方向已经由传统图像处理迈入深度学习时代,图像分类、目标检测、语义分割、关键点检测的技术越来越成熟,其中目标检测技术在人脸识别、行人检测以及自然灾害识别等方向得到了广泛的应用。目标检测算法从传统机器学习算法的繁盛时期演变到深度学习的广泛应用阶段,然而小目标检测任务仍然存在众多需要解决的问题,当下很多先进的目标检测模型,通常都难以对小尺度目标有着卓越的检测效果。总体而言,小尺度目标相对于正常尺度目标的分辨率较低,因此可以利用的像素信息比较少,并且随着卷积神经网络的下采样,小目标对应的特征图也会不断缩小。甚至当下采样的幅度大于小目标的尺寸时,可能造成大量的位置信息丢失。此外,复杂场景中的小目标通常伴随着遮挡、分布密集等现象,诸多原因导致了在实际应用中对小目标的检测更加困难。

技术实现思路

1、本发明的目的在于克服现有技术存在遥感图像中的小目标检测伴随着密集、重叠、遮挡等干扰,而使得对小目标的检测困难的问题,提供了一种基于卷积神经网络的遥感图像小目标检测方法,其相比于目前的主流算法yolov5、yolov6、yolov7、centernet等,具有较高的检测精度和速度,能够更好的处理真实场景下的小目标检测。

2、本发明的目的主要通过以下技术方案实现:

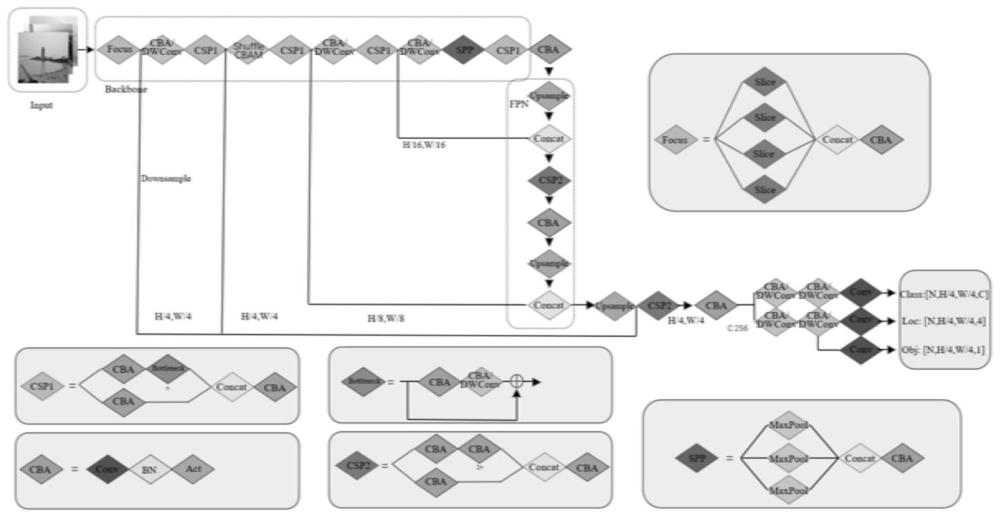

3、基于卷积神经网络的高效遥感图像小目标检测方法,包括:将已公开的小目标检测数据集作为原始数据,并对原始数据进行预处理;根据预处理后的原始数据对rst-yolox模型进行训练;将训练得到的rst-yolox模型用于遥感图像小目标检测;其中,所述rst-yolox模型基于yolox模型改进所得,包括:使用miso特征提取网络的特征提取模块对遥感图像特征进行提取;使用iou-t损失函数对rst-yolox模型进行训练;引入主干网络第一阶段和第二阶段的特征,并将其与miso输出的特征进行拼接;基于cbam注意力机制提出group-cbam注意力机制;引入spatial-shift结构。在现有技术中,由于小尺度目标相对于正常尺度目标的分辨率较低,因而可以利用的像素信息较少,且随着卷积神经网络的下采样,小目标对应的特征图也会不断缩小,而当下采样的幅度大于小目标的尺寸时,可能造成大量的位置信息丢失,此外,复杂场景中的小目标通常伴随着遮挡、分布密集等现象,诸多原因导致了在实际应用中对小目标的检测更加困难。本发明基于yolox模型进行改进得到rst-yolox模型,其采用miso(multiple-in-single-out)的特征融合结构,消除低召回率的低分辨率输出特性图,以平衡正负样本,增强遥感图像局部斑块的信息交互,同时,提出自适应iou-t损失函数,动态提升小尺度目标的损失权重并降低大尺度的目标权重,用以提升小目标检测的定位精度,在本发明中,采用group-cbam(group-convolutional blockattention module)注意力机制提高遥感图像中微小物体的感知能力,并引入spatial-shift计算,在不增加模型参数量和不引入复杂计算的前提下,提升了模型对小目标的检测能力。本发明所提出的rst-yolox模型相比于目前的主流算法yolov5、yolov6、yolov7、centernet等,具有较高的检测精度和速度,能够更好的处理真实场景下的小目标检测。

4、在一种可能的实现方式中,所述已公开的小目标检测数据集包括tiny person、visdrone2021和dota-hbb。

5、在一种可能的实现方式中,所述miso特征融合结构是基于mimo改进的多输入单输出的检测结构,所述mimo为多输入多输出的检测结构。

6、在一种可能的实现方式中,所述iou-t损失函数具体为:计算每一个真实目标框的面积;

7、根据每一个真实目标框的面积得到自适应的权重w:

8、

9、其中,k为超参数,用于控制自适应权重的曲率,mean表示均值计算,gts表示一张图像中的所有目标,gt表示一张图像中的其中一个目标。

10、根据每一个权重对损失进行对应加权:

11、

12、l=1-iou2

13、l=l×w

14、其中,iou表示a和b的交并比,取值范围为[0,1],a表示真实目标对应的框,b表示模型预测结果对应的框,l表示模型的定位损失。

15、在一种可能的实现方式中,所述group-cbam注意力机制具体为:对输入特征按通道进行分组,得到g个特征图,g表示组数;

16、将g个特征图分别计算得到的平均池化结果和最大池化结果并进行相加,结合sigmoid激活函数提取目标的置信度;

17、使用提取得到的空间注意力对输入特征进行加权,将加权后的特征图按通道维度计算最大值和平均值,对计算得到的结果进行拼接,之后对拼接所得的结果进行卷积;

18、对卷积操作后所得到的特征图使用sigmoid激活函数提取空间注意力,再对输入特征进行加权;

19、将g个分别经过通道注意力和空间注意力加权后的特征图进行合并,得到group-cbam最终的输出结果;同时,计算到空间感知结果参数量为b×h×w×g,其中,b是模型输入的批次数量,h和w分别是group-cbam输入的高和宽。

20、在一种可能的实现方式中,所述spatial shift结构具体为:将特征图的部分通道分为四个部分,分别进行上、下、左、右四个方向的偏移。

21、综上所述,本发明与现有技术相比具有以下有益效果:本发明基于yolox模型进行改进得到rst-yolox模型,其采用miso(multiple-in-single-out)的特征融合结构,消除低召回率的低分辨率输出特性图,以平衡正负样本,增强遥感图像局部斑块的信息交互,同时,提出自适应iou-t损失函数,动态提升小尺度目标的损失权重并降低大尺度的目标权重,用以提升小目标检测的定位精度,在本发明中,采用group-cbam(group-convolutionalblock attention module)注意力机制提高遥感图像中微小物体的感知能力,并引入spatial-shift计算,在不增加模型参数量和不引入复杂计算的前提下,提升了模型对小目标的检测能力;本发明所提出的rst-yolox模型相比于目前的主流算法yolov5、yolov6、yolov7、centernet等,具有较高的检测精度和速度,能够更好的处理真实场景下的小目标检测。

技术特征:

1.基于卷积神经网络的高效遥感图像小目标检测方法,其特征在于,包括:将已公开的小目标检测数据集作为原始数据,并对原始数据进行预处理;

2.根据权利要求1所述的基于卷积神经网络的高效遥感图像小目标检测方法,其特征在于,所述已公开的小目标检测数据集包括tiny person、visdrone2021和dota-hbb。

3.根据权利要求1所述的基于卷积神经网络的高效遥感图像小目标检测方法,其特征在于,所述miso特征融合结构是基于mimo改进的多输入单输出的检测结构,所述mimo为多输入多输出的检测结构。

4.根据权利要求1所述的基于卷积神经网络的高效遥感图像小目标检测方法,其特征在于,所述iou-t损失函数具体为:计算每一个真实目标框的面积;

5.根据权利要求1所述的基于卷积神经网络的高效遥感图像小目标检测方法,其特征在于,所述group-cbam注意力机制具体为:对输入特征按通道进行分组,得到g个特征图,g表示组数;

6.根据权利要求1所述的基于卷积神经网络的高效遥感图像小目标检测方法,其特征在于,所述spatial shift结构具体为:将特征图的部分通道分为四个部分,分别进行上、下、左、右四个方向的偏移。

技术总结

本发明公开了一种基于卷积神经网络的高效遥感图像小目标检测方法,其采用MiSo的特征融合结构,以平衡正负样本,增强遥感图像局部斑块的信息交互;提出自适应IoU‑T损失函数,用以提升小目标检测的定位精度;采用Group‑CBAM注意力机制提高遥感图像中微小物体的感知能力;引入Spatial‑Shift计算,在不增加模型参数量并且不引入复杂计算的前提下,提升了对小目标的检测能力。同时对比目前的主流算法YOLOv5、YOLOv6、YOLOv7、CenterNet等,实验数据表明所提出的改进模型具有较高的检测精度和速度,能够很好的处理真实场景下的小目标检测。

技术研发人员:陈喆,周仲礼,余正波,季青云,徐可,柳炳利,梁元,刘斌,常睿春,魏友华,张雪琦,邢舒雯

受保护的技术使用者:成都理工大学

技术研发日:

技术公布日:2024/3/24

- 还没有人留言评论。精彩留言会获得点赞!