一种基于CNN和Transformer的图像隐写分析方法

本发明涉及一种基于cnn和transformer的图像隐写分析方法,属于网络空间安全中的内容安全。

背景技术:

1、随着信息隐藏技术的广泛应用,隐写术变得越来越复杂。它既为人们的通信安全提供了保障,又被不法分子滥用以谋取个人利益或策划恐怖袭击。不法分子利用隐写术将秘密信息隐藏在图像中,这种隐藏在图像中的秘密信息无法被肉眼察觉。为了检测出哪些图像被嵌入了秘密信息,图像隐写分析技术应运而生。近年来兴起的基于卷积神经网络的图像隐写分析工作取得了较大的进展,基于卷积神经网络的方法大大提高了隐写分析的分类精度,减少了人为参与。然而,卷积运算擅长提取局部特征,这些卷积神经网络不能收集足够的全局信息,全局信息特征在隐写分析中同样重要。

2、transformer最初用于自然语言处理,具有很强全局归纳建模能力,2020年google团队提出的将transformer应用在图像分类的模型,验证了transformer架构在计算机视觉任务中的可行性。然而,transformer中的自注意力机制可以捕获长距离的特征依赖,对于局部信息建模能力较差。

3、目前,大多图像隐写分析方法是基于常规的卷积神经网络,虽然有较好的表现,但在捕获全局信息方面还是有一定的局限性,为了进一步改进隐写分析模型,需要探索更有效的方式来提取全局信息。

技术实现思路

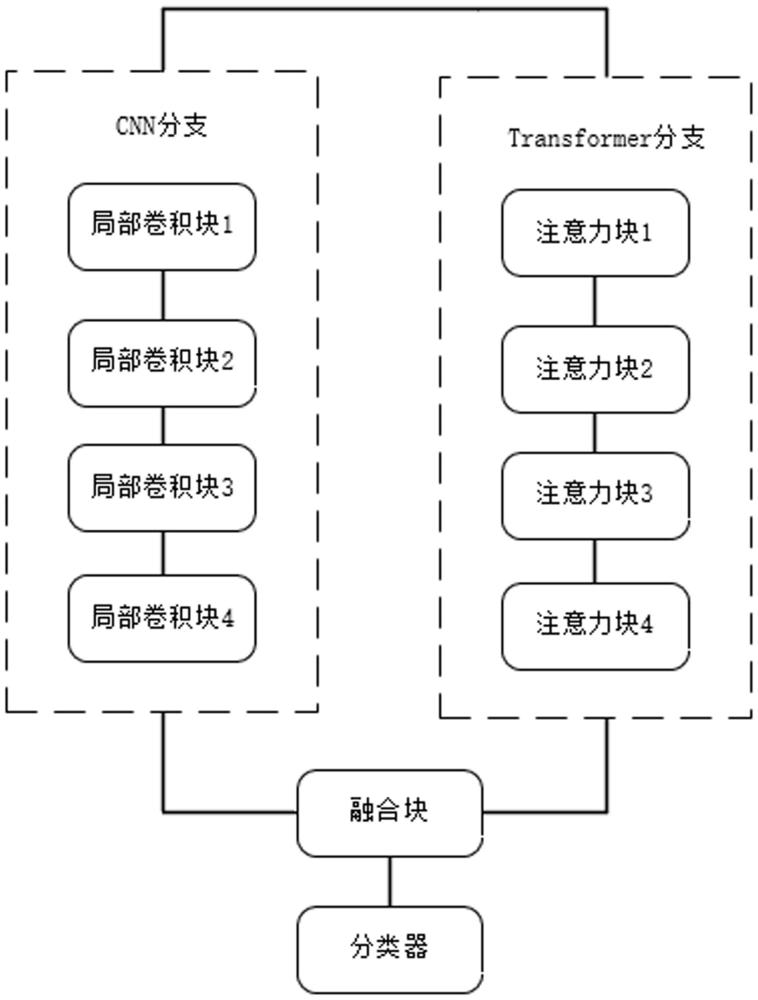

1、为解决上述技术问题,本发明提供了一种基于cnn和transformer的图像隐写分析方法,该基于cnn和transformer的图像隐写分析方法使用transformer分支提取全局信息,cnn分支提取局部信息,融合块融合局部信息和全局信息,提升隐写分析模型的检测精度。

2、本发明通过以下技术方案得以实现,一种基于cnn和transformer的图像隐写分析方法,包括以下步骤:

3、(1)下载公开的隐写数据集,并进行预处理,获得训练集、验证集和测试集;

4、(2)构建图像隐写分析模型,该模型由cnn分支、transformer分支、融合块和分类器组成;

5、(3)将隐写训练集图像输入图像隐写分析模型中进行训练,所述训练集输入cnn分支进行局部特征提取,输入transformer分支进行全局特征提取,通过融合块融合局部特征信息和全局特征信息,通过分类器输出图像分类结果,得到训练后的模型权重,保存训练模型权重;

6、(4)将隐写测试集输入训练后的图像隐写分析模型中进行测试,加载保存的参数及权重文件,得到图像检测结果。

7、进一步地,在步骤(1)中,所述公开隐写数据集为bossbase1.01,下载图像数量为10000张,尺寸为512×512;

8、所述预处理为经过matlab的“imresize”函数将原始数据库的图像大小制作为固定尺寸256×256的灰度图,分别采用载荷为0.1bpp、0.2bpp、0.3bpp和0.4bpp的wow自适应隐写算法对数据集进行隐写,生成4个由10000张原图像和10000张隐写图像组成的数据集;

9、所述训练集、验证集和测试集的图像数量比划分为7:2:1。

10、进一步地,在步骤(2)中,所述cnn分支由局部卷积块1、局部卷积块2、局部卷积块3、局部卷积块4构成;

11、所述局部卷积块1由2×2的卷积核、layernorm层、3×3的卷积核、layernorm层、linear层、gelu层构成;

12、局部卷积块2、局部卷积块3、局部卷积块4的结构与局部卷积块1的结构相同。

13、进一步地,在步骤(2)中,所述transformer分支由注意力块1、注意力块2、注意力块3、注意力块4构成;

14、所述注意力块1由patch merging层、layernorm层、multi-head attention层、linear层、gelu层构成;

15、注意力块2、注意力块3、注意力块4的结构与注意力块1的结构相同。

16、进一步地,在步骤(2)中,所述融合块由linear层、gelu层、3×3的卷积核、gelu层、linear层、layernorm层构成。

17、进一步地,在步骤(2)中,所述分类器由global avg pooling层、layernorm层、linear层构成。

18、进一步地,在步骤(3)中,将所述训练集输入cnn分支进行局部特征提取,具体是将所述训练集输入局部卷积块1,输出cnn分支特征图1;将cnn分支特征图1输入局部卷积块2,输出cnn分支特征图2;将cnn分支特征图2输入局部卷积块3,输出cnn分支特征图3;将cnn分支特征图3输入局部卷积块4,输出cnn分支特征图4。

19、进一步地,在步骤(3)中,将所述训练集输入transformer分支进行全局特征提取,具体是将训练集输入注意力块1,输出transformer分支特征图1;将transformer分支特征图1输入注意力块2,输出transformer分支特征图2;将transformer分支特征图2输入注意力块3,输出transformer分支特征图3;将transformer分支特征图3输入注意力块4,输出transformer分支特征图4;transformer分支特征图4和所述cnn分支特征图4大小一致。

20、本发明提出了一种基于cnn和transformer的图像隐写分析方法,使用cnn分支提取局部特征信息,利用transformer分支提取全局特征信息,同时利用融合块融合局部信息和全局信息,解决卷积神经网络在提取全局信息方面的局限性,从而实现对隐写图像的局部和全局信息的综合建模,该隐写分析方法可以很好的检测出绝大部分隐写图像。

技术特征:

1.一种基于cnn和transformer的图像隐写分析方法,其特征在于,包括以下步骤:

2.根据权利要求1所述的图像隐写分析方法,其特征在于:

3.根据权利要求1所述的图像隐写分析方法,其特征在于:

4.根据权利要求1所述的图像隐写分析方法,其特征在于:

5.根据权利要求1所述的图像隐写分析方法,其特征在于:

6.根据权利要求1所述的图像隐写分析方法,其特征在于:

7.根据权利要求1所述的图像隐写分析方法,其特征在于:

8.根据权利要求1所述的图像隐写分析方法,其特征在于:

技术总结

本发明公开了一种基于CNN和Transformer的图像隐写分析方法,构建了基于CNN分支和Transformer分支特征融合的隐写分析模型,用于图像隐写分析。方法包括:划分隐写图像数据集为训练集、验证集和测试集;将训练集输入模型中进行训练,其中CNN分支和Transformer分支分别提取隐写图像的局部特征和全局特征,融合块用于融合局部特征和全局特征,保存模型的训练权重;将训练后的模型用于检测测试集的隐写图像,得到检测结果。本发明采用图像隐写分析模型进行图像隐写分析,它可以在不破坏各自建模的前提下,从多尺度的层次上融合局部特征和全局特征,从而提高图像隐写分析的检测精度。

技术研发人员:蒋明,张硕,张峰,郭标,李芸

受保护的技术使用者:桂林电子科技大学

技术研发日:

技术公布日:2024/1/25

- 还没有人留言评论。精彩留言会获得点赞!