一种基于腹腔镜内窥影像的手术进程分析方法

1.本专利属于医学图像处理领域,具体涉及一种基于腹腔镜内窥影像的手术进程分析方法。

背景技术:

2.腹腔镜手术是一门新发展起来的微创方法,许多过去的开放性手术现在已被腔内手术取而代之,增加了患者的治疗机会。在腹腔镜手术中,医生采用腹腔镜作为内外部沟通的桥梁。腹腔镜手术的开展,减轻了病人开刀的痛楚,同时使病人的恢复期缩短,并且相对降低了患者的支出费用。

3.然而在应用中,医生仅借助微小创面观察内部情况,但是由于内部情况十分复杂,往往需要计算机辅助医生来提高对手术术野的理解。要增强微创手术的效果,就需要精通手术过程的医生,另一方面,可以借助于计算机辅助治疗来完成医生对内窥镜场景的理解。随着机器人辅助微创手术的发展,增强手术过程的自动情境意识对于提高外科医生的表现和患者安全变得至关重要。手术器械的检测和手术阶段识别的对于各种其他任务(包括工具姿态估计,跟踪和控制)也起着至关重要的作用。

4.针对上述问题,twinanda等人提出的endonet联合从视频中进行手术工具和阶段识别,利用神经网络和分层hmm获得时间平滑的阶段预测。随着rnn的兴起,endonet被演化为endolstm,其训练过程分为两步,包括卷积神经网络(cnn)作为特征提取器和lstm进行特征细化。lea等人初次将时间卷积引入到分层处理视频的动作分割中,与rnns相比,编码器

‑

解码器架构能够同时捕获高阶和低阶特征。后来,oord等人使tcns适应了扩张卷积,用于动作定位,并由于更大的接受域而有着更高的时间分辨率,进而实现了性能的改进。farha等人将多阶段tcns(ms

‑

tcns)引入到动作分割中,这个多阶段的网络由堆叠的预测器阶段组成,每个阶段包括一个单独的多层tcn,它逐步完善了前几个阶段的初始预测。tobias首次在工作流分析中提出了一种多阶段时间卷积网络,用于手术阶段识别的分层预测优化,一定程度上提升了在线实时识别的准确性及稳定性。总体来看,研究者们采用不同的方法对阶段识别模型进行了改进和提升,丰富了对手术阶段自动识别算法的研究。然而,较少有人考虑整个模型的鲁棒性,如模型对手术视频图片中血污、光照等造成的图片模糊情况的识别能力,以及更深层的网络对手术进程的隐含意义。

技术实现要素:

5.为了解决现有技术中存在的问题,本发明提供了一种基于腹腔镜内窥影像的手术进程分析方法,实现了整个神经网络模型的鲁棒性。

6.本发明解决技术问题所采用的技术方案如下:

7.一种基于腹腔镜内窥影像的手术进程分析方法,该方法包括如下步骤:

8.步骤一:采集腹腔镜术野视频内容,对所述视频内容划分并进行预处理;

9.步骤二:对基于cholec80数据集以及miccai2015数据集,注意力机制resnext网络

的神经网络进行学习,将注意力机制模块seblock拼接在resnext101网络的每个残差模块resblock之后;

10.步骤三:将步骤一中预处理过的视频内容输入到步骤二中已经学习好的神经网络中,提取实时腹腔镜的视频帧中的特征,与步骤二中cholec80数据集以及miccai2015数据集内的特征进行融合,参考多种特征提取及阶段识别算法,采用ohfm网络识别手术阶段位于步骤一中的类别,分析当前手术阶段。

11.优选的,所述步骤一中影像内容分为:准备、三角切割、剪切、胆囊切割、胆囊包装、清理和胆囊回收。

12.优选的,所述步骤一中的预处理为调整所述影像内容的分辨率和帧速流。

13.优选的,所述步骤二中将交叉熵损失函数作为特征提取的损失函数。

14.优选的,所述ohfm网络为多个lstm网络串联。

15.本发明的有益效果是:本发明所提算法借助标定好的阶段数据集,利用深度学习对具有难以识别的视频帧的数据集进行有效的特征提取,更好地利用具有缺陷的数据集,并提高模型的鲁棒性。同时提出一种术中场景的当前帧特征信息与之前帧识别结果联合的方式,使阶段识别精度更高,有效、准确地进行手术进程分析。

附图说明

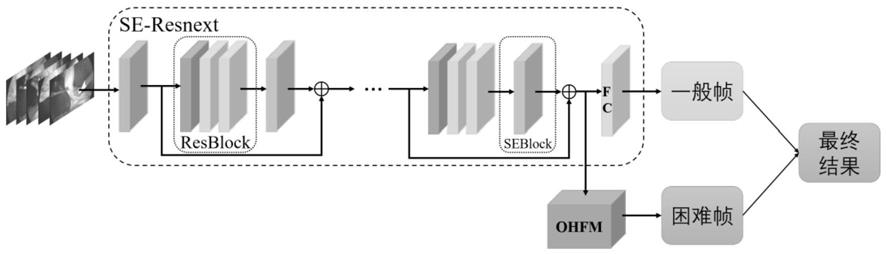

16.图1本发明一种基于腹腔镜内窥影像的手术进程分析方法的流程示意图。

17.图2用于特征提取的基于组卷积的resnext网络结构图。

18.图3改进的resnext网络结构图。

具体实施方式

19.下面结合附图和实施例对本发明做进一步详细说明。

20.如图1所示,本发明提出一种基于腹腔镜内窥影像的手术进程分析方法,是一种分析手术进程的神经网络设计方法,

21.该方法包括如下步骤:

22.步骤一:采集腹腔镜术野视频内容,对所述视频内容划分并进行预处理

23.腹腔镜的术野视频中包含多种信息,包括手术器械的种类、位置、轮廓和患者体内器官等信息,这些信息与手术进程的联系非常密切。首先探究术野视频内容中包含的可以利用的用于手术进程分析的内容,以及对手术的各个进程进行划分。

24.根据采用的手术数据集将手术进程分成preparation(准备)、calot triangle dissection(三角切割)、clipping cutting(剪切)、gallbladder dissection(胆囊切割)、gallbladder packaging(胆囊包装)、cleaning coagulation(清理)、gallbladder retraction(胆囊回收)。

25.对实时的腹腔镜视频进行预处理,输入图像大小调整为256*256像素,视频帧固定为25fps,以适应模型的处理速度。

26.步骤二:对基于cholec80数据集以及miccai2015数据集,注意力机制resnext网络的神经网络进行学习,将注意力机制模块seblock拼接在resnext101网络的每个残差模块resblock之后;将交叉熵损失函数作为特征提取的损失函数。

27.针对手术数据集中的术野特征信息不完备情况,对场景内的特征进行提取。即采用带有手术阶段的cholec80数据集以及miccai2015数据集,以上数据集包括手术视频及手术视频中每一帧的手术阶段。采用基于注意力机制的resnext网络,如图2所示,加入了注意力机制模块seblock的网络结构见图3。

28.步骤三:将步骤一中预处理过的视频内容输入到步骤二中已经学习好的神经网络中,提取实时腹腔镜的视频帧中的特征,与步骤二中cholec80数据集以及miccai2015数据集内的特征进行融合,参考多种特征提取及阶段识别算法,采用ohfm网络识别手术阶段位于步骤一中的类别,分析当前手术阶段。

29.此阶段主要对整个视频场景特征信息和检测出来的之前帧的手术阶段信息进行有效融合。步骤二中已经提取实时腹腔镜的视频帧中的特征,即当前帧此阶段在处理某一帧图片时,将resnext网络提取出的特征信息和之前帧的阶段标签联合组成网络的输入,识别现在的手术阶段。参考多种特征提取及阶段识别算法,采用ohfm网络(多个lstm网络串联)分析当前手术阶段。整体网络结构见图1。最终结果表明,带有注意力机制的、层数更深的网络对于腹腔镜的手术场景的特征提取及手术阶段识别有着良好的效果。

30.以上,仅为本发明的较佳实施例,但本发明的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本发明揭露的技术范围内,可轻易想到的变化或替换,都应该涵盖在本发明的保护范围之内。因此,本发明的保护范围应该以权利要求所界定的保护范围为准。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1