一种基于热词的会议语音识别方法与流程

1.本技术涉及音频识别技术领域,更具体地,涉及一种基于热词的会议语音识别方法。

背景技术:

2.实时会议音频识别技术,是一种通过语音识别模型将会议音频信息实时转换成文字信息的技术。在实时会议音频的识别过程中,语音识别模型会因为对热词(比如技术领域的专有名词)缺少对应的模型训练,导致无法对热词进行识别,从而导致在学术会议或者专业性较强的会议中,实时会议音频识别的效果较差。

3.针对上述问题,目前的解决方法为在会议之前,通过人工去配置需要识别的热词,工作人员需要针对不同领域的技术会议配置不同技术领域的热词,这就导致了需要花费较大的人工成本和时间成本。

技术实现要素:

4.本技术一些实施例提供一种基于热词的会议语音识别方法,该方法包括:获取第一音频的第一识别结果,第一识别结果是对第一音频进行音频识别得到的,第一识别结果包括表征第一音频的内容的词汇;获取对第一识别结果进行修正而得到的第一修正结果;将包含于第一修正结果并且不包含于第一识别结果的词汇确定为至少一个热词;基于至少一个热词,获取第二音频的第二识别结果。

5.本技术实施例提供的一种基于热词的会议语音识别方法,通过获取第一音频的第一识别结果,第一识别结果是对第一音频进行音频识别得到的,第一识别结果包括表征第一音频的内容的词汇;获取对第一识别结果进行修正而得到的第一修正结果;将包含于第一修正结果并且不包含于第一识别结果的词汇确定为至少一个热词;基于至少一个热词,获取第二音频的第二识别结果。在本方法中,在对第一识别结果进行修正得到第一修正结果时,电子设备将错误识别的词汇(也即第一修正结果中包含但第一识别结果中不包含的词汇),确定为热词。因此在后续的音频识别中,即使电子设备不能准确识别某些技术名词,也能基于修正结果提高对上述未识别到的技术名词的识别概率,增加后续音频识别的准确性。此外,该方法不需要工作人员事先对热词进行配置,降低了人工成本。

附图说明

6.为了更清楚地说明本技术实施例中的技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本技术的一些实施例,对于本领域技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

7.图1示出了本技术实施例提供的基于热词的会议语音识别方法的一种应用环境的示意图。

model,hmm)、基于人工神经网络的模型等等。人工神经网络包括反向传播(back-propagation,bp)神经网络、模糊聚类神经网络、卷积神经网络、循环神经网络等一种或多种网络的组合。上述音频识别模型可以是在控制台110处训练得到的,也可以是在服务器120处训练得到的。可选地,控制台110包括指定应用程序,上述指定应用程序通过音频识别模型来实现上述音频识别功能。上述指定应用程序可以是会议类应用程序、社交类应用程序等等。

22.在一些实施例中,控制台110还包括显示器,显示器用于显示上述音频信号转换后的文字信息,显示器可以是led显示屏、液晶(liquid crystal display,lcd)显示屏、阴极射线管(cathode ray tube,crt)显示器等等。

23.在一些实施例中,控制台110还包括麦克风。麦克风是一种拾取声音的传感器,主要用来收集音频信号,并将其转化为电信号传输至处理器进行处理。麦克风可以是和控制台110建立有线/无线连接的话筒,和控制台110建立有线/无线连接的耳机上的麦克风组件等等,也可以是设置于控制台110内部的麦克风组件,本技术实施例对麦克风的具体类型不作限定。

24.在本技术实施例中,控制台110在完成语音识别后,显示识别结果,并在用户对识别结果进行修正后,及时根据修正结果更新语音识别所需的热词,以提升后续语音识别的准确度。

25.在一些实施例中,控制台110还可以基于语音识别结果以及用户修正的结果形成语音识别模型的训练数据,以便于对语音识别模型进行迭代训练,提升语音识别模型的精度。

26.服务器120可以是一台服务器,也可以是多台服务器组成的服务器集群,还可以是一个云计算服务中心。可选地,服务器120是具有音频识别功能的指定应用程序对应的后台服务器。在本技术实施例中,服务器120可用于存储训练数据,以及基于训练数据对语音识别模型进行迭代训练,并向控制台110提供完成训练的语音识别模型。控制台110与服务器120之间通过有线方式或者无线方式建立通信连接。

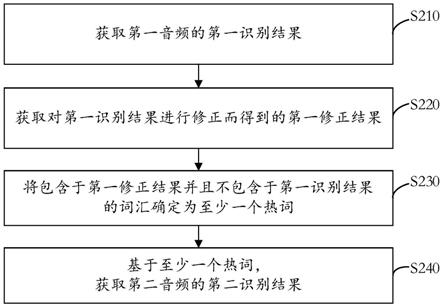

27.如图2所示,图2示意性地示出本技术第一实施例提供的一种基于热词的会议语音识别方法,该方法可以包括以下步骤s210至步骤s240。

28.步骤s210:获取第一音频的第一识别结果。

29.第一音频(audio signals)指的是带有语音、音乐或音效的有规律的声波的频率、幅度变化信息载体。第一音频可以来自于会议场景中的报告音频、电话场景中的通话音频以及日常沟通场景中的说话音频等等,在本实施例中对第一音频的获取场景不做具体限定。控制台110通过麦克风采集第一音频。具体地,当麦克风进入录音状态(例如,麦克风处于打开状态即表示处于录音状态)后,对外部的第一音频进行拾音,以实现对第一音频的采集。

30.第一识别结果是对第一音频进行语音识别得到的,第一识别结果包括表征第一音频的内容的词汇。作为一种实施方式,控制台通过音频识别模型以及预设词表对第一音频进行音频识别,基于音频识别模型的处理结果,在预设词表中将具有一定识别概率的词汇确定为至少一个候选识别结果,并在至少一个候选识别结果中,将识别概率最高的词汇确定为第一识别结果,并通过显示器显示该第一识别结果。其中,预设词表可以是对音频识别

模型进行训练的词汇的集合。作为另一种实施方式,可以通过带有转换文字功能的声音获取设备获取第一音频对应的第一识别结果。在该声音获取设备中设置有音频识别模型,可以将拾取到的第一音频转换成第一识别结果,并通过有线/无线传输的方式将该第一识别结果发送至控制台。

31.步骤s220:获取对第一识别结果进行修正而得到的第一修正结果。

32.工作人员在发现第一识别结果中出现识别错误的情况下,会主动对第一识别结果中的识别错误进行修正,得到第一修正结果。作为一种实施方式,控制台通过预设的接口获取工作人员输入的第一修正结果,例如,预设接口可以为显示屏对应的显示界面中的指定修改窗口,工作人员在发现第一识别结果中出现识别错误的情况下,通过文字修改装置,例如鼠标、带有触摸功能的显示屏等等,对指定修改窗口中第一识别结果中识别错误的文字进行选中并删除,并通过文字输入装置,例如键盘、系统中的虚拟键盘等等,在指定修改窗口中输入正确结果,控制台即可通过上述指定修改接口获得第一修正结果。

33.示例性地,以对“马尔可夫模型技术的成熟和不断完善使得该技术成为语音识别的主流方法”对应的第一音频进行音频识别为例,由于“马尔可夫模型”是较为偏僻的专业词汇,音频识别模型可能缺少对该专业词汇进行训练的过程,这就导致“马尔可夫”对应的识别概率就较低,相反的,与“马尔可夫”同音的词汇,例如“马儿”、“客服”这些常见词汇对应的识别概率就较高,音频识别模型会将识别概率最高的词汇确定为最终识别结果,因此导致存在产生识别错误的情况。在发生识别错误的情况下,上述第一音频对应的第一识别结果可能是“马儿客服模型技术的成熟和不断完善使得该技术成为语音识别的主流方法”。此时,工作人员发现了上述第一识别结果中的识别错误并通过指定修改窗口进行修正,控制台即可通过上述指定修改接口获得第一音频对应的第一修正结果“马尔可夫模型技术的成熟和不断完善使得该技术成为语音识别的主流方法”。

34.如图3所示,图3示意性地示出本技术实施例提供的显示第一识别结果和第一修正结果的界面示意图。该界面30包括第一显示区域31和第二显示区域32,在第一显示区域31中显示第一识别结果“马儿客服模型技术的成熟和不断完善使得该技术成为语音识别的主流方法”,在第二显示区域32中显示第一修正结果“马尔可夫模型技术的成熟和不断完善使得该技术成为语音识别的主流方法”。

35.步骤s230:将包含于第一修正结果并且不包含于第一识别结果的词汇确定为至少一个热词。

36.在本实施例中,将第一修正结果与第一识别结果进行比对,基于比对结果从第一修正结果中提取不包含于第一识别结果且包含于第一修正结果的词汇,作为热词。上述热词可以作为后续音频识别的依据,从而使专业词汇这一类词语也能被音频识别模型准确识别,提高后续音频识别的准确率。

37.作为一种实施方式,控制台在获取到第一修正结果后自动执行后续的热词确定步骤。作为另一种实施方式,控制台的当前显示界面包括热词提取控件,在接收到针对热词提取控件的触发信号后,执行后续的热词确定步骤。请参阅图3,在显示器的当前用户界面上设置有热词提取控件33,当控制台接收到针对该热词提取控件33的触发信号后,将包含于第一修正结果并且不包含于第一识别结果的词汇确定为至少一个热词。

38.在一些实施例中,参考图4,步骤s230包括以下步骤s231至步骤s237。

39.步骤s231:对第一识别结果进行第一分词操作,获取第一分词结果。

40.控制台通过第一分词操作,将第一识别结果分解成多个词汇的集合,即为第一分词结果。在本实施例中,第一分词操作通过分词算法来实现,分词算法包括但不限于机械分词算法、基于n元语法的分词算法、基于马尔可夫模型的分词算法和基于条件随机场的分词算法。示例性地,以对第一识别结果为“马儿客服模型技术的成熟和不断完善使得该技术成为语音识别的主流方法”进行第一分词操作为例,对应的第一分词结果为“马儿、客服、模型、技术、的、成熟、和、不断、完善、使得、该、技术、成为、语音、识别、的、主流、方法”。

41.步骤s234:对第一修正结果进行第二分词操作,获取第二分词结果。

42.控制台通过第二分词操作,将第一修正结果分解成多个词汇的集合,即为第二分词结果。在本实施例中,第二分词操作同样通过分词算法来实现。具体地,第二分词操作对应的分词算法和第一分词操作对应的分词算法可以相同,也可以不相同。示例性地,以对第一修正结果为“马尔可夫模型技术的成熟和不断完善使得该技术成为语音识别的主流方法”进行第二分词操作为例,对应的第二分词结果为“马尔可夫、模型、技术、的、成熟、和、不断、完善、使得、该、技术、成为、语音、识别、的、主流、方法”。

43.步骤s237:将包含于第二分词结果并且不包含于第一分词结果的词汇确定为至少一个热词。

44.在本实施例中,控制台通过集合运算的方式来确定包含于第二分词结果并且不包含于第一分词结果的词汇。具体地,计算第二分词结果与第一分词结果之间的差集得到上述词汇,第二分词结果与第一分词结果之间的差集表征包含于第二分词结果并且不包含于第一分词结果的词汇。同样以上述第一分词结果和第二分词结果为例,对应的差集为“马尔可夫”,因此,可以将至少一个热词确定为“马尔可夫”。

45.在一些实施例中,步骤s237之前还包括步骤s235和步骤s236。

46.步骤s235:获取第一识别结果对应的第一文本向量和第一修正结果对应的第二文本向量。

47.第一文本向量用于表征第一识别结果的文本特征,第二文本向量用于表征第一修正结果的文本特征。对第一识别结果以及第一修正结果进行向量化处理的算法包括神经网络语言模型、词袋(bag of words,bow)模型以及连续词汇模型等等。本技术实施例中,仅以通过词袋模型对第一识别结果以及第一修正结果进行向量化处理为例进行说明。在本实施例中,通过词袋模型对第一识别结果对应的第一分词结果进行处理,得到第一文本向量;通过词袋模型对第一修正结果对应的第二分词结果进行处理,得到第二文本向量。具体地,步骤s235可以包括步骤s2351至步骤s2355。

48.步骤s2351:计算第一识别结果对应的第一分词结果和第一修正结果对应的第二分词结果的并集。

49.第一分词结果和第二分词结果的并集表征在第一分词结果或者在第二分词结果中出现过的词汇,同样以上述第一分词结果和第二分词结果为例,对应的并集为“马儿、客服、模型、技术、的、成熟、和、不断、完善、使得、该、成为、语音、识别、主流、方法、马尔可夫”。

50.步骤s2353:统计第一分词结果中的每个词汇在并集中出现的次数,得到第一文本向量。

51.示例性的,并集中的第一个词汇“马儿”在第一分词结果中出现的次数为1,因此第

一文本向量中对应的第一个元素值为1。又如,并集中的第四个词汇“技术”在第一分词结果中出现的次数为2,因此第一文本向量中对应的第四个元素值为2。依次类推,第一文本向量为[1,1,1,2,2,1,1,1,1,1,1,1,1,1,1,1,0]。

[0052]

步骤s2355:统计第二分词结果中的每个词汇在并集中出现的次数,得到第二文本向量。

[0053]

示例性的,并集中的第一个词汇“马儿”在第二分词结果中出现的次数为0,因此第二文本向量中对应的第一个元素值为0。又如,并集中的第四个词汇“技术”在第二分词结果中出现的次数为2,因此第二文本向量中对应的第四个元素值为2。依次类推,第二文本向量为[0,0,1,2,2,1,1,1,1,1,1,1,1,1,1,1,1]。

[0054]

步骤s236:若第一文本向量和第二文本向量之间的相似度大于或等于预设相似度,则执行步骤s237;若否,则结束。

[0055]

第一文本向量和第二文本向量之间的相似度为向量相似度,向量相似度可以通过余弦相似度、欧氏距离、汉明距离、皮尔逊相关系数等方式进行计算。在本实施例中,通过计算第一文本向量和第二文本向量之间的汉明距离来计算相似度,汉明距离用于表征两个等长的向量中对应相同位置的不同元素的个数。具体地,相似度的计算公式为:

[0056][0057]

以步骤s2353中的第一文本向量和第二文本向量为例,向量元素总个数为17,对应相同位置的不同元素的个数为3,即汉明距离为3。因此基于上述公式,第一文本向量和第二文本向量之间的相似度为82.4%。

[0058]

若上述相似度大于或等于预设相似度,则执行步骤s237;反之,则结束。具体地,预设相似度的取值可以是大于或等于70%且小于100%的任意值。在本实施例中,预设相似度的取值为80%,预设相似度可以由算法默认设定,也可以根据实时音频的识别情况,进行动态调整。

[0059]

这里需要说明的是,在第一文本向量和第二文本向量之间相似度大于或等于预设相似度的情况下,对热词进行提取。这样可以保证第一识别信息和第一修正信息之间存在着较高的相似度,说明音频识别模型可以从第一音频中正确识别出较多的内容,由此可以推断出出现识别错误的原因是音频识别模型的词库中未存储相应的专有名词,而并非第一音频的音质较差,通过第一文本向量和第二文本向量之间的相似度进行筛选,在第一音频的音质较好的情况下执行后续的热词提取步骤,从而保证提取热词的准确性。

[0060]

步骤s240:基于至少一个热词,获取第二音频的第二识别结果。

[0061]

第二音频是待音频识别的音频。在一些实施例中,第二音频和第一音频均为目标音频中的音频片段。示例性地,目标音频可以是学术会议中的报告音频,具体地,第二音频在目标音频中的时间节点在第一音频在目标音频中的时间节点之后。在另一些实施例中,第二音频和第一音频可以是来自于不同目标音频中的音频片段,在本方案中对第一音频和第二音频的具体来源不做具体进一步限定。

[0062]

在控制台获取第一修正结果中的至少一个热词之后,基于该至少一个热词,采用音频识别模型对第二音频进行音频识别,获取第二音频的第二识别结果。通过上述方式,对第二音频进行识别时不会出现由于不能识别专有名词所导致的识别错误的情况发生,提高

对第二音频进行识别的准确率。具体地,步骤s240可以包括步骤s242至步骤s244。

[0063]

s242:基于预设词表对第二音频进行音频识别,得到第二音频的至少一个候选识别结果。

[0064]

步骤s242的具体实施可以参考步骤s210的具体阐述,在此不再一一详述。示例性地,在第二音频中存在热词“马尔可夫”的情况下,对应的至少一个候选识别结果可能为“马尔可夫”和“马儿客服”。具体地,“马尔可夫”对应的识别概率为20%,而“马儿客服”对应的识别概率为60%。

[0065]

s244:基于至少一个热词,在至少一个候选识别结果中确定第二音频的第二识别结果。

[0066]

在本实施例中,控制台在确定至少一个热词的情况下,基于第一映射操作,提升该热词对应的候选识别结果的识别概率,和/或,基于第二映射操作,降低非热词对应的候选识别结果的识别概率。作为一种实施方式,控制台设有第一比例因子,第一映射操作用于表征将热词对应的候选识别结果的识别概率和第一比例因子进行相乘的过程。第一比例因子由控制台默认设定,或者,由技术人员自定义设定。可选地,第一比例因子大于1。具体的,以“马尔可夫”对应的识别概率为20%,并且第一比例因子为4为例,进行第一映射操作后,“马尔可夫”对应的识别概率提升至80%。

[0067]

同样地,控制台设有第二比例因子,第二映射操作用于表征将非热词对应的候选识别结果的识别概率和第二比例因子进行相乘的过程。第二比例因子由控制台默认设定,或者,由技术人员自定义设定。可选地,第二比例因子小于1。具体的,以“马儿客服”对应的识别概率为60%,并且第二比例因子为0.25为例,进行第二映射操作后“马儿客服”对应的识别概率降低至15%。

[0068]

控制台基于至少一个热词,对第二音频的各个候选识别结果进行概率调整后,基于调整后的识别概率,将调整后的识别概率最高的词汇确定为最终识别结果。在上述示例中,最终识别结果为“马尔可夫”,实现了对专业词汇的正确识别。

[0069]

可选地,对于第二音频,若控制台也接收到针对第二识别结果的修正操作,得到第二修正结果,则将第二音频确定为第一音频,并从步骤210重新开始执行。

[0070]

本技术实施例提供的一种基于热词的会议语音识别方法,通过获取第一音频的第一识别结果,第一识别结果是对第一音频进行音频识别得到的,第一识别结果包括表征第一音频的内容的词汇;获取对第一识别结果进行修正而得到的第一修正结果;将包含于第一修正结果并且不包含于第一识别结果的词汇确定为至少一个热词;基于至少一个热词,获取第二音频的第二识别结果。在本方法中,在对第一识别结果进行修正得到第一修正结果时,电子设备将错误识别的词汇(也即第一修正结果中包含但第一识别结果中不包含的词汇),确定为热词。因此在后续的音频识别中,即使电子设备不能准确识别某些技术名词,也能基于修正结果提高对上述未识别到的技术名词的识别概率,增加后续音频识别的准确性。此外,该方法不需要工作人员事先对热词进行配置,降低了人工成本。

[0071]

如图5所示,图5示意性地示出本技术第二实施例提供的一种基于热词的会议语音识别方法,该方法可以包括以下步骤s510至步骤s570。

[0072]

步骤s510:获取第一音频的第一识别结果。

[0073]

步骤s520:获取对第一识别结果进行修正而得到的第一修正结果。

[0074]

步骤s530:将包含于第一修正结果并且不包含于第一识别结果的词汇确定为至少一个热词。

[0075]

步骤s540:基于至少一个热词,获取第二音频的第二识别结果。

[0076]

步骤s510至步骤s540的具体实施,请参考步骤s210至步骤s240的具体阐述,在此不再一一详述。

[0077]

步骤s550:基于热词,确定热词对应的第一修正结果。

[0078]

在本实施例中,控制台在确定至少一个热词的情况下,基于音频识别模型对应的历史数据,确定至少一个热词对应的第一修正结果。上述历史数据包括第一识别结果、第一修正结果以及热词三者之间的对应关系。

[0079]

步骤s560:基于第一修正结果,确定第一音频。

[0080]

作为一种实施方式,步骤s560可以包括步骤s562至步骤s564。

[0081]

步骤s562:基于第一修正结果,确定第一修正结果对应的第一识别结果。

[0082]

在本实施例中,控制台在确定第一修正结果的情况下,同样基于音频识别模型对应的历史数据,确定第一修正结果对应的第一识别结果。

[0083]

步骤s564:基于第一识别结果的时间信息,确定第一音频。

[0084]

在使用音频识别模型对音频进行识别的过程中,控制台可以获取第一识别结果对应的时间信息,该时间信息包括第一音频对应的起始时刻数据,结束时刻数据以及时长数据。基于上述时间信息,控制台可以在长音频中确定出第一识别结果对应的第一音频。

[0085]

步骤s570:将第一音频作为训练音频,将第一修正结果作为训练音频对应的标注数据。

[0086]

训练音频和训练音频对应的标注数据用于对音频识别模型进行参数优化,音频识别模型用于表征将音频信息识别成文本信息的模型。通过训练音频和标注数据对音频识别模型进行参数优化的训练过程在下面的实施例中进行介绍。

[0087]

可选地,对于第二音频,若控制台也接收到针对第二识别结果的修正操作,得到第二修正结果,则将第二音频确定为第一音频,并从步骤s510开始执行。

[0088]

本技术实施例提供的一种基于热词的会议语音识别方法,在确定热词的基础上,进一步确定热词对应的第一音频和第一修正结果,并将该第一音频和第一修正结果分别作为训练音频和训练音频对应的标注数据,以训练音频识别模型,一方面,进一步提高音频识别模型的识别准确率;另一方面,通过上述方式可以更为便捷地获取音频识别模型的训练数据。

[0089]

本实施例对音频识别模型的训练过程进行介绍,如图6所示,图6示意性地示出本技术实施例提供的一种音频识别模型训练的方法,该方法可以包括以下步骤s610至步骤s640。

[0090]

步骤s610:通过音频识别模型对训练音频进行音频识别,得到训练音频对应的第三识别结果。

[0091]

音频识别模型的训练过程可以由服务器完成,也可以由控制台完成。在本技术实施例中,仅以控制台训练音频识别模型为例进行说明。控制台将训练音频作为音频识别模型的输入,由音频识别模型输出第三识别结果。

[0092]

步骤s620:获取第三识别结果和训练音频对应的标注数据之间的误差信息。

[0093]

控制台将第三识别结果和训练音频对应的标注数据进行比对,得到二者之间的误差信息。

[0094]

步骤s630:若误差信息不符合预设条件,则基于误差信息、优化函数对音频识别模型进行参数优化,并从通过音频识别模型对训练音频进行音频识别,得到训练音频对应的第三识别结果的步骤重新开始执行。

[0095]

预设条件用于表征是否完成参数优化训练的条件,若误差信息不符合预设条件,则说明通过音频识别模型得到的第三识别结果和标注数据之间的误差较大,需要对音频识别模型中的参数进行优化调整。在一些实施例中,预设条件是指第三识别结果和训练音频对应的标注数据之间的误差信息小于预设值。上述预设值根据语音识别模型的精度要求实际确定。若语音识别模型的精度要求较高,则预设值较小,若语音识别模型的精度要求较低,则预设值较大。

[0096]

优化函数表征对语音识别模型的模型参数进行优化调整的函数,优化函数包括但不限于批量梯度下降函数、随机梯度下降函数、自适应优化函数。优化函数以误差信息为输入,对语音识别模型中的参数进行优化调整,以使得通过优化调整后的语音识别模型输出的语音识别结果可以更加接近于标注数据。

[0097]

步骤s640:若误差信息符合预设条件,则获取完成参数优化训练的音频识别模型。

[0098]

若误差信息符合预设条件,则说明通过音频识别模型得到的第三识别结果和标注数据之间的误差较小,此时语音识别模型完成模型优化训练。

[0099]

本技术实施例提供的一种音频识别模型训练的方法,基于该方法可以对音频识别模型进行优化训练,使得训练后的音频识别模型对专业词汇有更高的识别准确率。

[0100]

请参阅图7,其示出了本技术实施例提供的一种基于热词的会议语音识别装置700,该装置700包括第一识别结果获取模块710、第一修正结果获取模块720、热词获取模块730和第二识别结果获取模块740。第一识别结果获取模块710用于获取第一音频的第一识别结果,第一识别结果是对第一音频进行音频识别得到的,第一识别结果包括表征第一音频的内容的词汇。第一修正结果获取模块720用于获取对第一识别结果进行修正而得到的第一修正结果。热词获取模块730用于将包含于第一修正结果并且不包含于第一识别结果的词汇确定为至少一个热词。第二识别结果获取模块740用于基于至少一个热词,获取第二音频的第二识别结果。

[0101]

在一些实施例中,热词获取模块730用于对第一识别结果进行第一分词操作,获取第一分词结果;对第一修正结果进行第二分词操作,获取第二分词结果;将包含于第二分词结果并且不包含于第一分词结果的词汇确定为至少一个热词。

[0102]

在一些实施例中,热词获取模块730用于获取第一识别结果对应的第一文本向量和第一修正结果对应的第二文本向量;若第一文本向量和第二文本向量之间的相似度大于或等于预设相似度,则执行将包含于第二分词结果并且不包含于第一分词结果的词汇确定为至少一个热词的步骤。

[0103]

在一些实施例中,第二识别结果获取模块740用于基于预设词表对第二音频进行音频识别,得到第二音频的至少一个候选识别结果;基于至少一个热词,在至少一个候选识别结果中确定第二音频的第二识别结果。

[0104]

在一些实施例中,装置700还包括训练数据获取模块(图中未示出)。训练数据获取

logic array,pla)中的至少一种硬件形式来实现。处理器810、可集成中央处理器810(central processing unit,cpu)、图像处理器810(graphics processing unit,gpu)和调制解调器等中的一种或几种的组合。其中,cpu主要处理操作系统、用户界面和应用程序等;gpu用于负责显示内容的渲染和绘制;调制解调器用于处理无线通信。可以理解的是,上述调制解调器也可以不集成到处理器810中,其可以单独通过一块通信芯片进行实现。

[0113]

存储器820可以包括随机存储器820(random access memory,ram),也可以包括只读存储器820(read-only memory)。存储器820可用于存储指令、程序、代码、代码集或指令集。存储器820可包括存储程序区和存储数据区,其中,存储程序区可存储用于实现操作系统的指令、用于实现至少一个功能的指令(比如触控功能、声音播放功能、图像播放功能等)、用于实现下述各种方法实施例的指令等。存储数据区还可以存储电子设备图在使用中所创建的数据(比如电话本、音视频数据、聊天记录数据)等。

[0114]

请参阅图9,其示出了本技术实施例还提供一种计算机可读存储介质900,该计算机可读存储介质900中存储有计算机程序代码910,计算机程序代码910可被处理器调用以执行上述实施例中所描述的方法。

[0115]

计算机可读存储介质可以是诸如闪存、eeprom(电可擦除可编程只读存储器)、eprom、硬盘或者rom之类的电子存储器。可选地,计算机可读存储介质900包括非易失性计算机可读存储介质(non-transitory computer-readable storage medium)。计算机可读存储介质900具有执行上述方法中的任何方法步骤的程序代码的存储空间。这些程序代码可以从一个或者多个计算机程序产品中读出或者写入到这一个或者多个计算机程序产品中。程序代码可以例如以适当形式进行压缩。

[0116]

以上,仅是本技术的较佳实施例而已,并非对本技术作任何形式上的限制,虽然本技术已以较佳实施例揭示如上,然而并非用以限定本技术,任何本领域技术人员,在不脱离本技术技术方案范围内,当可利用上述揭示的技术内容做出些许更动或修饰为等同变化的等效实施例,但凡是未脱离本技术技术方案内容,依据本技术的技术实质对以上实施例所作的任何简介修改、等同变化与修饰,均仍属于本技术技术方案的范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1