一种基于视频合成孔径雷达的干涉测量方法

1.本发明属于雷达干涉测量技术领域,具体涉及一种基于视频合成孔径雷达的干涉测量方法。

背景技术:

2.合成孔径雷达干涉测量(interferometric synthetic aperture radar,insar)技术得益于合成孔径雷达(synthetic aperture radar,sar)技术的成熟和发展而簇生的一种高精度的对地观测技术。insar技术是空间对地观测技术,是将传统的sar遥感技术与干涉技术结合的产物。通过对两幅同一地区的相干图像进行干涉处理,获取目标地区三维信息,insar技术将微波探测技术由二维平面提升到三维空间。insar的发展是基于sar技术之上,它兼顾了sar全天时、全天候、高精度、大区域的突出优势,在地表观测、地面形变监测、冰川移动、灾害预警、工程体(桥梁、大坝)变形等方面都具有独特优势。insar技术逐渐成为对地观测最主要的手段。

3.随着视频sar的出现和发展,利用视频sar进行干涉测量的研究吸引许多的学者的注意。将太赫兹技术应用于视频sar系统,使视频sar在某些场景下可以对目标区域实时观测。视频sar通过对目标区域的持续照射,得到了高帧率、高分辨率的连续帧图像,正好克服了传统insar中成像效率低的缺点,将干涉测量技术与视频sar的独特优势结合起来是探索视频sar应用前景的前瞻性课题之一。利用insar技术快速获取高精度数字高程模型(digital elevation model,dem)是目前insar技术的主要应用之一。传统insar技术是基于条带sar的基础之上,但是视频sar的成像模式为聚束模式,传统insar技术无法与视频sar相兼容,所以传统的insar技术无法用于视频sar干涉测量,所以迫切需要一种适用于聚束sar的干涉测量方法。且传统insar技术无法处理目标成像时会出现叠掩、遮挡等因素导致相位缺失,会使得测量结果精度降低。

技术实现要素:

4.针对上述问题,本发明提供了一种适用于聚束模式的视频sar干涉测量方法。该方法的基本思想是结合视频sar的成像模式,提出视频sar干涉测量模型,并推导目标高程反演公式,提出适用于视频sar的干涉测量流程。同时该方法利用视频合成孔径雷达连续成像的优势,可以降低目标高程反演的误差。首先建立聚束模式干涉测量模型,根据干涉测量模型推导目标高程反演公式。然后根据聚束模式的成像特点,提出一种主、辅图像配准方法,随后对配准后的图像进行共轭相乘、去平地、滤波、解缠,得到每个子孔径的高度信息。其次,利用相邻子孔径的主、辅图像进行交叉配准,再进行后续步骤,干涉得到的高度信息以主图像所在子孔径为准,最后对多次生成的高度信息进行数据筛选、平均,最后得到较为精确的结果。

5.本发明的技术方案为:一种基于视频合成孔径雷达的干涉测量方法,用于机载双天线干涉sar系统,其特征在于,包括以下步骤:

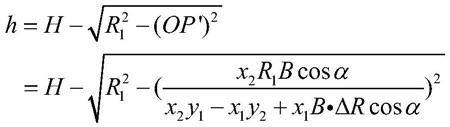

6.s1、根据视频sar的成像模型,以主、副天线所在垂直平面建立坐标系,建立视频sar聚束模式下目标的干涉测量模型,得到目标的高程信息的反演公式:

[0007][0008]

其中,h为主天线的高度,o是坐标系原点,p'为目标p在地面上的投影,r1为主天线斜距,α为基线与水平面的夹角,b为主天线和副天线间的距离,目标在主辅图像中的实际成像位置分别为p1和p2,p1(x1,y1,0),p2(x2,y2,0);

[0009]

s2、采用机载双天线方式进行干涉测量,每个子孔径内获得两幅sar图像,利用sift算法对子孔径中的主、辅sar图像进行配准;

[0010]

s3、对配准后生成的主辅复图像进行共轭相乘,得到该子孔径下目标的干涉图,干涉图中的相位表示的是不同视角下天线与相同目标的距离不同导致的相位误差,得到高程信息h与相位差

△

φ之间的关系:

[0011][0012]

其中,θ是主天线与目标间的夹角,λ表示视频合成孔径雷达波长;

[0013]

s4、对获得的干涉图,采用基于误差方程的最小二乘相位解缠法进行相位解缠,得到解缠后的干涉相位;

[0014]

s5、高程反演:以φ0表示干涉相位偏置,φ

′

表示解缠后的干涉相位,则斜距差

△

r为

[0015][0016]

相应地面目标的高程值h为:

[0017][0018]

即可通过相位信息得到目标的高度信息,实现视频合成孔径雷达干涉测量。

[0019]

进一步的,还包括:

[0020]

s6、多孔径数据融合:假设视频sar系统得到目标区域的n组样本数据为d1,d2,d3,

…

,d

n

‑1,d

n

,对于目标区域中任意坐标(x,y)都有n组高程样本数据h1,h2,h3,

…

,h

n

‑1,h

n

,对这n组高程样本数据进行筛选,剔除不可信数据,以提高测量精度;假设这n组样本数据服从正态分布,即h~n(μ,σ2),给定置信水平为0.9,显著性水平为α=0.1,需要先求得高程样本数据的均值e(h)为:

[0021][0022]

上式中,代表样本数据的均值,使用s2表示高程样本数据的方差d(h),即:

[0023][0024]

在假设高程样本数据服从正态分布的前提下,得到关于h的置信度为0.9的置信区间为:

[0025][0026]

得到置信区间之后,根据置信区间对高程样本数据进行筛选,处于置信区间之内的样本数据保留,否则就将其舍弃,假设筛选之后得到的m组高程样本数据为h1,h2,h3,

…

,h

m

‑1,h

m

,计算这m组数据的均值

[0027][0028]

将得到的数据均值作为场景坐标(x,y)处的高程值,然后计算场景中其余坐标处的高程值,最终得到成像场景中所有坐标对应的三维信息。

[0029]

本发明的有益效果为,本方法提出了聚束模式的视频sar干涉测量模型及高程反演公式,并针对相关步骤给出了具体方法。

附图说明

[0030]

图1是视频sar干涉测量的模型。

[0031]

图2是适用于视频sar干涉测量的sift配准步骤。

[0032]

图3是视频sar的干涉测量流程。

[0033]

图4是视频sar多孔径数据融合方法。

具体实施方式

[0034]

下面结合附图和对本发明进行详细的描述。

[0035]

本发明的适用于机载双天线干涉sar系统,主要包括:

[0036]

根据视频sar的成像特点,建立聚束模式干涉测量模型,推导目标的高程反演公式。

[0037]

建立视频sar干涉测量模型,如附图1所示。在附图1中,a1和a2是第k个子孔径中主、副天线的位置,a2'为副天线a2在地面上的投影,b为两天线间的距离,即基线长度,h为天线1的高度。α为基线与水平面的夹角,r1和r2分别是两天线到目标的斜距,p为目标点的实际位置,其高度为h,p'为目标p在地面上的投影,p1'和p2'分别是目标p在主辅图像中的实际成像位置。利用上述位置的已知信息,计算主天线a1与目标间的夹角θ,从而求得目标的实际高度h。

[0038]

天线a1的相位表示为:

[0039][0040]

天线a2的相位表示为:

[0041][0042]

其中f

c

为工作载频,c为光速,r1为主天线斜距,r2为副天线斜距,根据上面两个式子可得主辅图像之间的相位差

△

φ可以表示为:

[0043][0044]

以主天线a1与副天线a2所在垂直于地面的平面为yoz面,建立空间直角坐标系,则两雷达的空间坐标分别为:

[0045]

a1(0,0,h)

[0046]

a2(0,bcosα,h+bsinα)

[0047]

目标p及其在参考平面上的投影p'的空间坐标可以设为:

[0048]

p(x,y,h)

[0049]

p'(x,y,0)

[0050]

上式中,x,y和h均未知,下面将通过几何关系求解目标高程信息h。根据成像基本理论可知,目标在主辅图像中的实际成像位置分别为p1和p2,其空间坐标分别为:

[0051]

p1(x1,y1,0)

[0052]

p1(x1,y1,0)

[0053]

上述坐标在实际成像结果中可以得到。天线a2在xoy面上的投影点为

[0054]

a'2(0,bcosα,0)

[0055]

于是可得op'与a'2p'的空间直线方程分别为:

[0056][0057][0058]

将式上面两式联立,求得:

[0059][0060]

则p'的空间坐标可表示为:

[0061][0062]

此时可求得op'的长度:

[0063][0064]

由勾股定理及几何关系可得,目标的高度h为:

[0065][0066]

上式表示的即是聚束模式下目标的高程信息的反演公式。如此,便可以根据视频sar的干涉测量模型和相位解缠结果反演出目标的真实高程信息。

[0067]

对于每一个视频合成孔径雷达子孔径的成像结果进行以下处理:

[0068]

采用机载双天线方式进行干涉测量,每个子孔径内可以获得两幅sar图像。需要先对子孔径中的主、辅sar图像进行配准。图像配准是为精确生成子孔径的干涉图,获取可靠地干涉相位。视频sar得到的主、辅图像不仅存在几何位置的偏移,同时还存在旋转或者映射变换,需要选择一种可以检测图像视角变化的配准算法。

[0069]

选用基于特征信息匹配的sift配准算法进行复图像匹配,sift配准算法可用于处理两幅图像之间发生平移、旋转、仿射变换情况下的匹配问题。sift(scale

‑

invariant feature transform)是一种基于特征点匹配的算法,该算法又称尺度不变特征变换匹配算法,sift配准算法对于旋转和尺度变换均满足不变性,并且对于噪声以及视角变化都具有良好的鲁棒性。sift配准算法的主要流程如下:

[0070]

第一步,提取特征点。特征点是不会因为尺度变换、视角变化而消失的点,比如暗区域的亮点、亮区域的暗点、边缘点等。在这个步骤中主要是搜索图像中所有满足的特征点的像素位置,并通过高斯微分函数识别可能的旋转和尺度不变的特征点。

[0071]

第二步,定位特征点并判定特征方向。对所有候选的特征点都使用一个拟合模型确定特征点的尺度和位置。然后基于局部图像的梯度方向为每一个特征点确定一个或者多个特征方向。特征点的位置、方向和尺度是所有非特征点图像进行变换的主要依据。

[0072]

第三步,映射关系的建立。通过所有特征点特征向量的两两对比,找到相互匹配的多对特征点,通过匹配的特征点拟合映射多项式,最后建立映射关系。sift配准算法的具体处理流程如附图2所示。

[0073]

在特征点匹配完成后,根据最小二乘原理进行匹配多项式的拟合,本文选用四元二次多项式如下:

[0074][0075]

上式中,x和y分别是主图像中某个特征点的方位向和距离向坐标,

△

x和

△

y分别是辅图像相对于主图像在方位向和距离向需要平移的距离。将匹配的特征点带入式中,可以求出a0,b0,c0,d0,a1,b1,c1,d1这8个参数,也就得到了主、辅图像之间像素点的映射关系,然后就可以进行辅图像重采样,获得匹配后的辅图像结果,完成匹配过程。

[0076]

干涉图生成。干涉测量技术是通过主辅图像的相位差值反演高程信息。在上述步

骤中,对生成的主辅图像进行配准和重采样,然后将主辅复图像进行共轭相乘,得到该子孔径下目标的干涉图。干涉图中的相位表示的是不同视角下天线与相同目标的距离不同导致的相位误差,视频sar干涉测量即是根据干涉测量模型及干涉相位推导目标的高程信息。

[0077]

根据附图1所示的干涉测量模型,由于固定的视频sar系统的成像夹角固定,当成像场景的范围确定时,机载雷达平台距离场景中心的距离也随之确定,所以雷达与场景区域的距离远大于雷达基线的长度,所以可以得到水平基线b

||

为:

[0078][0079]

则垂直基线b

⊥

的长度可以表示为:

[0080][0081]

干涉相位是雷达主、副天线到达测量目标的斜距不同,而由于斜距的不同产生的相位差

△

φ可表示为:

[0082][0083]

测量目标的高程信息h可以表示为:

[0084]

h=h

‑

r

1 cosθ

[0085]

为方便使用相位差

△

φ表示高程信息h,分别将

△

φ和h对θ求导,可得:

[0086][0087][0088]

则可以得到高程信息h与相位差

△

φ之间的关系:

[0089][0090][0091]

根据上式可得高程反演精度与干涉图的干涉条纹密集程度的关系。

[0092]

相位解缠。视频sar干涉测量系统得到的主、辅图像进行相位共轭相乘后,得到的干涉图中的相位值是干涉相位中的主值,范围在[0,2π)或[

‑

π,π)中。干涉图的干涉条纹边缘处,相位值会发生阶跃性跳变,相位值会在0和2π来回变化,变化前后的干涉相位会相差一个或者多个整数周期。相位解缠的目的就是为了得到整副干涉图中各个干涉相位之间相差的完整的周期数,以得到实际的相位值,才能根据干涉测量模型反演地面目标的真实高程信息。

[0093]

子孔径干涉图相位解缠。为通过干涉相位计算出地面目标的高程值,必须确定整幅干涉图中各个干涉相位之间相差的整周期数,即对干涉图进行相位解缠处理。基于机载平台测量范围较小的特点,本方法采用基于误差方程的最小二乘相位解缠法,解缠结果可以表示为:

[0094]

φ=(a

t

a)

‑1a

t

l

[0095]

高程反演。若以φ0表示干涉相位偏置,φ

′

表示解缠后的干涉相位,λ表示视频合成孔径雷达波长,则斜距差

△

r为

[0096][0097]

相应地面目标的高程值h为

[0098][0099]

根据上式即可通过相位信息得到目标的高度信息,实现视频合成孔径雷达干涉测量。

[0100]

视频sar干涉测量流程方法。根据上述关键流程,得到视频sar干涉测量与传统insar的区别所在,首先是在成像模式上,视频sar使用的是聚束模式成像,而传统insar使用条带式成像,这便导致需要重新建立干涉测量模型,并根据干涉测量模型中的几何关系推导高程反演公式,其次是主辅图像的视角偏移问题,需要对产生视角变换的图像进行配准的算法。然后需要对干涉测量步骤中的干涉图生成、相位解缠等步骤进行验证。最后,是生成的dem需要根据主天线进行dem矫正,得到目标区域的真实地形。视频sar干涉测量的结果如附图3所示。

[0101]

多孔径数据融合方法。

[0102]

视频sar作为一种成像帧率高、波长短的新型合成孔径雷达,能够围绕场景区域中心以圆周聚束模式对成像区域进行持续照射,不仅可以在短时间内获得多组测量数据,还可以围绕成像区域获得多个视角的测量数据。所以同传统条带式insar相比较,基于视频sar的干涉测量可以获得不同视角下的测量结果,每个子孔径得到的测量结果进行干涉测量都可以得到该视角下成像测区域的高程信息,将多个子孔径的高程反演结果进行数据融合,可以剔除由于阴影或掩叠现象导致反演结果中出现的不可信数据,利用视频sar干涉测量的大量样本数据提高高程反演的精度。

[0103]

由于视频sar系统工作在太赫兹频段,所以视频sar系统的合成孔径积累角很小,所以在短时间内可以得到多个子孔径的成像结果,这样就可以快速扩充数据样本。而且视频sar系统工作在圆周聚束模式下,可以对同一目标区域进行持续照射,获得目标区域在不同视角下的高程反演结果,将所有高程信息数据进行数据融合,就可以得到更加精确的反演结果。

[0104]

假设视频sar系统得到目标区域的n组样本数据为d1,d2,d3,

…

,d

n

‑1,d

n

,对于目标区域中任意坐标(x,y)都有n组高程样本数据h1,h2,h3,

…

,h

n

‑1,h

n

,需要对这n组高程样本数据进行筛选,剔除不可信数据,以提高测量精度。假设这n组样本数据服从正态分布,即h~n(μ,σ2),给定置信水平为0.9,那么显著性水平为α=0.1,需要先求得高程样本数据的均值e(h)为:

[0105]

[0106]

上式中,代表样本数据的均值,使用s2表示高程样本数据的方差d(h),即:

[0107][0108]

在假设高程样本数据服从正态分布的前提下,可以得到关于h的置信度为0.9的置信区间为:

[0109][0110]

得到置信区间之后,需要根据置信区间对高程样本数据进行筛选,处于置信区间之内的样本数据保留,否则就将其舍弃,这样可以筛除与平均高程值相差较大的数据。假设筛选之后得到的m组高程样本数据为h1,h2,h3,

…

,h

m

‑1,h

m

,计算这m组数据的均值

[0111][0112]

将得到的数据均值作为场景坐标(x,y)处的高程值,然后计算场景中其余坐标处的高程值,最终得到成像场景中所有坐标对应的三维信息。从数学统计学的角度来看,置信区间可以粗略筛选样本数据,剔除不可信数据,然后将可信数据均值化,能够极大程度上保留可信数据,得到坐标点的高程信息。而且在实际的测量过程中,得到的数据难免会产生偏差,使用本节介绍的处理方法可以最大化降低误差数据的影响,从而提高最终得到的高程反演数据的精度。视频sar干涉测量系统的多样本数据融合的具体处理流程如附图4所示。

[0113]

本发明方法的具体流程如图1、图2、图3和图4所示。设定视频合成孔径雷达系统中心频率为220ghz,带宽为2ghz,设置雷达高度为1200m,以地面为参考平面,主、辅天线垂直放置,基线长度5m,机载雷达平台在预定轨道上做近似直线运动。将目标设置为一个山丘模型。根据系统参数建立如图1所示的干涉测量模型,根据不同位置的目标可以得到目标的高程反演公式。然后对接收到的子孔径数据进行成像,每个子孔径内将得到主、辅两幅图像,按照图2所示步骤进行配准,将每组主辅图像进行共轭相乘,得到干涉图,然后对干涉图进行相位解缠,然后对目标进行高程反演,可得到每个子孔径内目标的高程信息。最后,根据上述流程建立如图3所示的视频sar干涉测量流程,并利用视频sar高帧率的优势,使用图4所示方法,提高干涉测量精度。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1