一种戴墨镜情况下的人脸识别方法与流程

1.本发明涉及人脸识别领域,特别涉及一种戴墨镜情况下的人脸识别方法。

背景技术:

2.现有技术中,人脸识别系统主要包括四个组分:人脸图像采集及检测、人脸图像预处理、人脸图像特征提取以及人脸比对与识别等,如图1所示。

3.(1)人脸图像采集:不同的人脸图像都能通过摄像镜头采集下来;

4.(2)人脸图像检测:对人脸图像进行检测得到人脸位置坐标的过程;

5.(3)人脸图像预处理:对检测后的人脸框进行后处理工作以用于特征提取,例如裁剪、对齐、颜色转换、缩放等;

6.(4)人脸图像特征提取:处理之后的标准人脸图输入神经网络得到n维特征向量的过程;

7.(5)人脸图像匹配与识别:提取的人脸图像的特征数据与数据库中存储的特征模板进行搜索匹配,通过设定一个阈值,当相似度超过这一阈值,则把匹配得到的结果输出。

8.然而,注册集如果是正常未遮挡人脸,而用一个带了墨镜的遮挡人脸提取特征后进行比对,相似度往往达不到设定的阈值,即匹配不成功,因为二者还是有一定的区别的(如图2所示),有时并不能很好地完成识别。

9.此外,本领域常见的技术术语包括:

10.1.人脸识别:人脸识别技术是基于人的脸部特征,对输入的人脸图像或者视频流,首先判断其是否存在人脸,如果存在人脸,则进一步的给出每个脸的位置、大小和各个主要面部器官的位置信息,并依据这些信息,进一步提取每个人脸中所蕴涵的身份特征,并将其与已知的人脸进行对比,从而识别每个人脸的身份。人脸识别系统主要包括四个组成部分,分别为:人脸图像采集及检测、人脸图像预处理、人脸图像特征提取以及匹配与识别。

11.2.误识率:误识率有时被称为认假率,英文简称far(false acceptrate),指把他人误认为标准中某人而通过的概率,误识举例来说就是a拿b的手机人脸解锁通过。

12.3.通过率:通过率指正确认出而通过的概率,反过来讲叫做拒真率(拒真率=1-通过率),英文简称frr(false reject rate),拒真率指在标准库存在但未识别出的概率,拒真举例来说就是a拿自己手机人脸解锁未通过。

13.4.人脸相似度:在人脸识别中,我们通常采用欧氏距离和余弦距离来衡量人脸特征的相似度,判别是否为同一个人。欧氏距离:欧氏距离比较简单,采用欧氏公式直接计算两个点之间的距离,如下:

[0014][0015]

欧氏距离计算的是空间中两个点的绝对距离,距离dist越小,特征越相似。

[0016]

5.ar人脸库:公开的面部数据库,由aleix martinez和robert benavente在uab的

计算机视觉中心(cvc)创建的,图像具有正面视图面,具有不同的面部表情、照明条件和遮挡(太阳眼镜和围巾)等。

技术实现要素:

[0017]

为了解决上述现有技术中存在的问题,本发明的目的在于:本发明主要针对戴墨镜(或眼镜)情况下,人脸识别通过率降低的情况,提出了一种有效的改进方法。

[0018]

具体地,本发明提供一种戴墨镜情况下的人脸识别方法,所述方法包括以下步骤:

[0019]

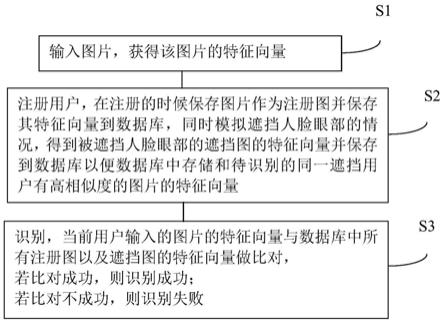

s1,输入图片,获得该图片的特征向量;

[0020]

s2,注册用户,在注册的时候保存图片作为注册图并保存其特征向量到数据库,同时模拟遮挡人脸眼部的情况,得到被遮挡人脸眼部的遮挡图的特征向量并保存到数据库以便数据库中存储和待识别的同一遮挡用户有高相似度的图片的特征向量;

[0021]

s3,识别,当前用户输入的图片的特征向量与数据库中所有注册图以及遮挡图的特征向量做比对,

[0022]

若比对成功,则识别成功;

[0023]

若比对不成功,则识别失败。

[0024]

所述步骤s1进一步包括:

[0025]

对一张输入图片,经过检测、预处理后的第i张图片img-i经神经网络求得图片的特征向量:

[0026]

f-i1=network(img-i)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(1)

[0027]

这里的network表示深度学习的神经网络。

[0028]

所述步骤s2进一步包括:

[0029]

s2.1,判断输入图片是否是第一张图片,

[0030]

步骤a,若是第一张,则完成该用户的注册,保留注册图的特征向量并计算得到遮挡图的特征向量f-i2;

[0031]

步骤b,若不是第一张,则与数据库中第j张注册图的特征向量f-j1进行比对,若比对失败即认为当前用户之前未注册,重复步骤a,否则注册失败;

[0032]

s2.2,将当前用户对应的识别号id-i、注册图的特征向量f-i1、遮挡图的特征向量f-i2保存到数据库中。

[0033]

所述步骤s2中的计算具体包括:

[0034]

s2.1,注册模式下,

[0035]

步骤a,若i=0,即第一张检测注册图,

[0036]

a.1,按以下公式处理,即:

[0037]

img'-i=img-i

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(2)

[0038]

img'-i[img'-i.shape[0]//5:img'-i.shape[0]*2//5,:]*=0.3

ꢀꢀꢀ

(3)

[0039]

公式(3)表示将原始图高度方向五分之一到五分之二位置的值乘上0.3,以弱化这部分特征;

[0040]

此时,得到一张新图iimg'-i,这里的shape[0]对应图像的高;

[0041]

a.2,同样按公式(4)计算特征,得到f-i2,

[0042]

f-i2=network(img-i)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(4);

[0043]

s2.2将当前用户对应的id-i、f-i1、f-i2,即一个注册图对应两个特征向量加入数据库中;

[0044]

步骤b,若i≠0,即已有人脸注册,

[0045]

b.1,先将f-i1与数据库中的f-j1进行比对:

[0046]

ret=compare(f-i1,f-j1)

ꢀꢀꢀꢀ

j∈(0,i-1)

ꢀꢀꢀꢀꢀꢀꢀ

(5)

[0047]

这里只比对原始图的特征即f-j1,f-j1指的是已注册图的第一个特征向量,若比对失败即认为当前用户之前未注册,可进行下一步,否则注册失败;

[0048]

b.2,重复s2.1的步骤a完成该用户的注册;

[0049]

b.3,先对数据库中的不同用户之间的距离进行统计,不同用户之间的距离指的是不同用户的特征向量之间的欧式距离也即人脸相似度,记录最小的距离min-dist:

[0050]

min-dist=min(d(f-i1,f-j1))

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(6)

[0051]

并将min-dist在一个范围[th1,th2]之内,以防过大或过小造成的计算不准确,即:

[0052]

if(min-dist《th1)min-dist=th1

ꢀꢀꢀꢀꢀꢀꢀꢀ

(7)

[0053]

if(min-dist》th2)min-dist=th2

ꢀꢀꢀꢀꢀꢀꢀꢀ

(8)

[0054]

用得到的min-dist用如下公式(8)进行阈值计算:

[0055]

adapttthreshold=2.667*min-dist*min-dist

–

4.567*min-dist+2.8

ꢀꢀꢀ

(9)。

[0056]

所述th1=0.8,th2=1.2。

[0057]

所述步骤s3进一步包括:

[0058]

识别模式下,

[0059]

当前用户的f-i1与数据库中所有的f-*1,f-*2做比对,假设数据库中有n个注册用户:

[0060]

ret=compare(f-i1,f-j1)

ꢀꢀꢀꢀ

j∈(0,n)

ꢀꢀꢀꢀꢀꢀꢀꢀ

(10)

[0061]

ret=compare(f-i1,f-j2)

ꢀꢀꢀꢀ

j∈(0,n)

ꢀꢀꢀꢀꢀꢀꢀꢀ

(11)

[0062]

其中ret是比对后的返回值,因为f-j1、f-j2均来自注册用户j,即f-j1、f-j2分别表示第j个注册用户的第一个和第二个特征向量,第一个特征向量是遮挡前的,第二个特征向量是遮挡后的,对于待识别用户并不知道其是否为遮挡的,因此只要待识别用户和用户j的任意一个特征向量的人脸相似度达到阈值要求,均认为识别为该用户j。

[0063]

所述步骤s1中所述的深度学习的神经网络,为训练好的vggnet、resnet、mobilenet人脸识别的网络模型。

[0064]

所述戴墨镜情况是遮挡人脸眼部,位于人脸上半部的1/5-2/5的位置,且原始图的像素值为原来的1/3。

[0065]

已注册用户虽然有2个特征向量,但都对应一个id,其中一张图像为原始注册图,匹配成功的话显示原始注册图,而非处理过的遮挡图。

[0066]

所述方法步骤s2还可以进一步结合下半部遮挡的情况,在注册过程中,共保存三张图,分别是注册图,遮挡眼睛的遮挡图,遮挡下半部的遮挡图;本方法对各种不同光照下的识别也适用。

[0067]

综上,应用本技术的优势在于:反向思维,在注册的时候弱化眼部,以便于和待识别的戴墨镜用户有较高相似度从而完成识别;这里的遮挡经统计最终取得1/5-2/5的位置,

且值为原来的1/3,经测试基本够用;另外,该方法还能很好地结合下半部遮挡,加上原图三张结合在一起基本已经涵盖了各种遮挡或未遮挡的情况,这样无需使用多模型就能很好地完成各种情况地人脸识别,提高鲁棒性。

附图说明

[0068]

此处所说明的附图用来提供对本发明的进一步理解,构成本技术的一部分,并不构成对本发明的限定。

[0069]

图1是现有技术中人脸识别的流程示意图。

[0070]

图2是正常未遮挡人脸和带眼镜的遮挡人脸的图片对比示意图。

[0071]

图3是本发明方法的具体流程图。

[0072]

图4是经过本发明方法后的显示效果图示,图中左侧是待识别的遮挡人脸图,右侧是原始人脸注册图,中间是右侧图经眼部处理后的图的示意图。

[0073]

图5是本发明的方法主要部分的流程示意图。

具体实施方式

[0074]

如图3所示,本发明涉及一种戴墨镜情况下的人脸识别方法,所述方法包括以下步骤:

[0075]

s1,输入图片,获得该图片的特征向量;

[0076]

s2,注册用户,在注册的时候保存图片作为注册图并保存其特征向量到数据库,同时模拟遮挡人脸眼部的情况,得到被遮挡人脸眼部的遮挡图的特征向量并保存到数据库以便数据库中存储和待识别的同一遮挡用户有高相似度的图片的特征向量;

[0077]

s3,识别,当前用户输入的图片的特征向量与数据库中所有注册图以及遮挡图的特征向量做比对,

[0078]

若比对成功,则识别成功;

[0079]

若比对不成功,则识别失败。

[0080]

步骤s2进一步包括:

[0081]

s2.1,判断输入图片是否是第一张图片,

[0082]

步骤a,若是第一张,则完成该用户的注册,保留注册图的特征向量并计算得到遮挡图的特征向量f-i2;

[0083]

步骤b,若不是第一张,则与数据库中第j张注册图的特征向量f-j1进行比对,若比对失败即认为当前用户之前未注册,重复步骤a,否则注册失败;

[0084]

s2.2,将当前用户对应的识别号id-i、注册图的特征向量f-i1、遮挡图的特征向量f-i2保存到数据库中。

[0085]

具体地,技术方案的实施例,也可以如下所述:

[0086]

(一)方案描述:

[0087]

如图5所示,本发明主要部分流程图。

[0088]

1.对一张输入图片,经过检测、预处理后的img-i求得经神经网络求得特征向量:

[0089]

f-i1=network(img-i)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(1)

[0090]

这里的network表示深度学习的神经网络,可以是vggnet、resnet、mobilenet等训

好的人脸识别的网络模型,不再赘述;

[0091]

2.注册模式下,

[0092]

(1)若i=0,即第一张检测注册图,

[0093]

a.按以下公式处理,即:

[0094]

img'-i=img-i

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(2)

[0095]

img'-i[img'-i.shape[0]//5:img'-i.shape[0]*2//5,:]*=0.3

ꢀꢀꢀ

(3)

[0096]

公式(3)表示将原始图高度方向五分之一到五分之二位置的值乘上0.3,以弱化这部分特征;

[0097]

此时,得到一张新图iimg'-i,这里的shape[0]对应图像的高;

[0098]

b.同样按公式(4)计算特征,得到f-i2,

[0099]

f-i2=network(img-i)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(4),

[0100]

和公式(1)一样,这里的network表示深度学习的神经网络,可以是vggnet、resnet、mobilenet等训好的人脸识别的网络模型,不再赘述;

[0101]

c.将当前用户对应的id-i、f-i1、f-i2加入数据库中,即一个注册图对应两个特征向量加入数据库中;

[0102]

(2)若i≠0,即已有人脸注册,

[0103]

a.先将f-i1与数据库中的f-j1进行比对:

[0104]

ret=compare(f-i1,f-j1)j∈(0,i-1)

ꢀꢀꢀꢀꢀ

(5)

[0105]

注意这里只比对原始图的特征即f-j1,f-j1指的是已注册图的第一个特征向量,若比对失败即认为当前用户之前未注册,可进行下一步,否则注册失败;

[0106]

b.重复(1)中的步骤完成该用户的注册;

[0107]

c.先对注册集不同用户之间的距离进行统计,记录最小的距离min-dist:

[0108]

min-dist=min(d(f-i1,f-j1))

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(6)

[0109]

并将min-dist在一个范围[th1,th2]之内,以防过大或过小造成的计算不准确,即:

[0110]

if(min-dist《th1)min-dist=th1

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(7)

[0111]

if(min-dist》th2)min-dist=th2

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(8)

[0112]

用得到的min-dist用如下公式进行阈值计算:

[0113]

adapttthreshold=2.667*min-dist*min-dist

–

4.567*min-dist+2.8

ꢀꢀꢀ

(9)

[0114]

该阈值计算需要用到所有数据库中的特征向量,得到的阈值即用于后续识别模式的比对过程;

[0115]

3.识别模式下,

[0116]

当前用户的f-i1与数据库中所有的f-*1,f-*2做比对,假设数据中中有n个注册用户:

[0117]

ret=compare(f-i1,f-j1)

ꢀꢀꢀꢀ

j∈(0,n)

ꢀꢀꢀꢀꢀꢀꢀꢀ

(10)

[0118]

ret=compare(f-i1,f-j2)

ꢀꢀꢀꢀ

j∈(0,n)

ꢀꢀꢀꢀꢀꢀꢀꢀ

(11)

[0119]

因为f-j1、f-j2均来自注册用户j,所有无论与哪一个f匹配通过均表示识别为用户j,再做后续处理。

[0120]

(一)结果展示:

[0121]

1.测试ar数据集结果:

[0122]

本发明在ar数据集中的戴墨镜的图专门做了实际测试,测试结果如下表1:

[0123]

表1

[0124]

method原始自适应阈值自适应+遮档处理acc38.3%51.5%83.1%

[0125]

可见,提升效果还很明显的。

[0126]

2.图4中左侧是待识别的遮挡人脸图,右侧是原始人脸注册图,中间是右侧图经眼部处理后的图,未处理前,左侧不能完成识别,采用本发明中的方案后,左侧与中间的图正确匹配,从而完成与右侧原图的识别;这里,需注意在实际系统应用中,已注册用户虽然有2个特征向量,但都对应一个id,一张图像(即图4右侧原始注册图),匹配成功的话显示原图,而非图中处理过的遮挡图(这里只是为了更好地展示识别过程)。

[0127]

3.从图4的各种不同光照下的识别通过情况来看该方法对不同光照也能较好地适应。

[0128]

以上所述仅为本发明的优选实施例而已,并不用于限制本发明,对于本领域的技术人员来说,本发明实施例可以有各种更改和变化。凡在本发明的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1