一种声光融合数据交互方法与流程

1.本发明涉及声光融合的技术领域,尤其涉及一种声光融合数据交互方法。

背景技术:

2.随着目前智能技术的进一步发展,不同智能交互设备相继涌出。例如隐藏式的拾音麦克风设备,将麦克风隐藏至周围不易察觉的设备上,一方面形成良好的装配视觉效果,另一方面不同设备也能够与拾音麦克风设备形成相互融合的不同创造性运用。

3.以现有将麦克风隐藏至吸顶灯上为例,虽然起到了良好的装配视觉效果,但也仅限于纯粹的安装,未实现两者之间的数据交互运用,智能化方向没有得到进一步的创造性运用。

技术实现要素:

4.本部分的目的在于概述本发明的实施例的一些方面以及简要介绍一些较佳实施例。在本部分以及本技术的说明书摘要和发明名称中可能会做些简化或省略以避免使本部分、说明书摘要和发明名称的目的模糊,而这种简化或省略不能用于限制本发明的范围。

5.鉴于上述现有麦克风与吸顶灯结合呈现方式存在的问题,提出了本发明。

6.因此,本发明解决的技术问题是:解决现有将麦克风隐藏至吸顶灯上仅限于纯粹的安装,未实现两者之间数据交互的问题。

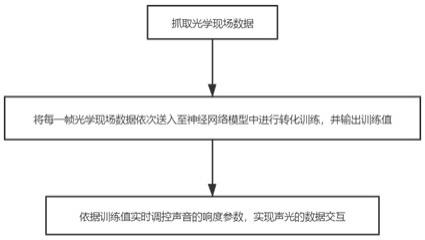

7.为解决上述技术问题,本发明提供如下技术方案:一种声光融合数据交互方法,包括抓取光学现场数据;将每一帧所述光学现场数据依次送入至神经网络模型中进行转化训练,并输出训练值;依据所述训练值实时调控声音的响度参数,实现声光的数据交互。

8.作为本发明所述的声光融合数据交互方法的一种优选方案,其中:抓取所述光学现场数据包括获取既定控制光照度α;获取每一节点浮动检测光照度β,并对应依据相应的即时浮动误差阈值对所述浮动检测光照度β进行筛选。

9.作为本发明所述的声光融合数据交互方法的一种优选方案,其中:所述即时浮动误差阈值设置为

10.作为本发明所述的声光融合数据交互方法的一种优选方案,其中:所述神经网络模型具体为,

[0011][0012]

式中,d(t)为所述训练值,α为既定控制光照度,β为浮动检测光照度,t为每一帧所选取的时间,p为转化因子。

[0013]

作为本发明所述的声光融合数据交互方法的一种优选方案,其中:调控完所述响度参数后还包括将所述训练值输入至所述神经网络模型中进行存储,并依据以下公式实时优化所述转化因子,

[0014][0015]

式中,p(2)为下一帧的所述转化因子,p(1)为即时转化因子,d(t)为所述训练值。

[0016]

作为本发明所述的声光融合数据交互方法的一种优选方案,其中:所述每一帧设置为0.5s,所述每一节点设置为0.1s。

[0017]

作为本发明所述的声光融合数据交互方法的一种优选方案,其中:当所述每一帧中出现三组及以上所述光学现场数据时,通过调整降低所述每一帧的设置时间,使所述每一帧中仅出现三组以下所述光学现场数据。

[0018]

本发明的有益效果:本发明提供的声光融合数据交互方法,首先将抓取处理后的光学现场数据输入至特定的神经网络模型中进行转化训练,利用训练后输出的训练值进行声音的调控,实现声光的数据交互,解决了现有将麦克风隐藏至吸顶灯上仅限于纯粹的安装,未实现两者之间数据交互的问题。

附图说明

[0019]

为了更清楚地说明本发明实施例的技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动性的前提下,还可以根据这些附图获得其它的附图。其中:

[0020]

图1为本发明提供的声光融合数据交互方法的方法流程图;

[0021]

图2为运用本发明的实际产品图及实验场景;

[0022]

图3为运用本发明的另一实际产品图及实验场景;

[0023]

图4为运用本发明实际产品内部用于抓取光学现场数据的传感器产品图;

[0024]

图5为本发明提供的声光融合数据交互方法中所生成的其中一张光学现场曲线图。

具体实施方式

[0025]

为使本发明的上述目的、特征和优点能够更加明显易懂,下面结合说明书附图对本发明的具体实施方式做详细的说明,显然所描述的实施例是本发明的一部分实施例,而不是全部实施例。基于本发明中的实施例,本领域普通人员在没有做出创造性劳动前提下所获得的所有其他实施例,都应当属于本发明的保护的范围。

[0026]

实施例1

[0027]

现有将麦克风隐藏至吸顶灯上虽然起到了良好的装配视觉效果,但也仅限于纯粹的安装,未实现两者之间的数据交互运用,智能化方向没有得到进一步的创造性运用。

[0028]

故此,请参阅图1~5,本发明提供一种声光融合数据交互方法,包括:

[0029]

s1:抓取光学现场数据,具体包括:

[0030]

获取既定控制光照度α;

[0031]

获取每一节点浮动检测光照度β,并对应依据相应的即时浮动误差阈值对浮动检测光照度β进行筛选。

[0032]

进一步的,即时浮动误差阈值设置为

[0033]

需要说明的是:

[0034]

①

如图2~4所示,本发明通过图中所示中央控制器中的传感器所抓取的光学现场数据包括既定控制光照度α和浮动检测光照度β。本发明中既定控制光照度α是用作后续模型计划生成的光学现场曲线的参照线,所生成的光学现场曲线之一如图5所示。同时考虑到融合会议室中的实时检测光照度是变化的,例如人员的不断进入及走动等均会影响传感器检测出的光照度,故此本发明创造性引入浮动检测光照度β,两相结合生成光学现场曲线。

[0035]

②

既定控制光照度α是预先通过人为选择控制的,本发明中既定控制光照度α设置有3档可选择进行调控,分别为低档:60lux、中档:100lux、高档:140lux;一般当外界灯光强度大,且所需要的会议氛围无需过强光照渲染时选择,一般选择中档作为常规的既定控制光强度,而当需要较强的照明条件时,选择高档。

[0036]

③

节点的时间设置是预先设定的,本发明中将每一节点的时间设置为0.1s,即每隔0.1s获取一次浮动检测光照度β,同时由上述公式计算出即时浮动误差阈值,并对应依据相应的即时浮动误差阈值对浮动检测光照度β进行筛选,剔除掉超过即时浮动误差阈值的节点。

[0037]

s2:将每一帧光学现场数据依次送入至神经网络模型中进行转化训练,并输出训练值;

[0038]

需要说明的是,所输入至神经网络模型中的光学现场数据都是经过筛选过得,每一帧即对于其内每一符合要求的节点,均将其内含有的光学现场数据送至模型中进行转化训练,输出训练值,当每一帧中存在多个符合要求的节点时,将其内各节点对应的浮动检测光照度β取均值。

[0039]

进一步的,神经网络模型具体为:

[0040][0041]

式中,d(t)为训练值,α为既定控制光照度,β为浮动检测光照度,t为每一帧所选取的时间,p为转化因子。

[0042]

针对上述模型,考虑到浮动检测光照度β受到每一帧所选取的时间的影响(具体体现在:当每一帧中存在多个符合要求的节点时,将其内各节点对应的浮动检测光照度β取均值、当每一帧中出现三组及以上光学现场数据时,通过调整降低每一帧的设置时间,使每一帧中仅出现三组以下光学现场数据),故此,模型中引入t作为变量,依据上述模型公式引出训练值。

[0043]

需要注意的是,p作为转化因子可以直接选取常态值1.984,为了精准度,同样可以参阅下表1中的对应:

[0044]

表1:p取值对应表

[0045]

α+β值(lux)p值<1501.570150~1801.382180~2001.789200~2451.920~1.924

>2451.91

[0046]

s3:依据训练值实时调控声音的响度参数,实现声光的数据交互。

[0047]

更进一步的,调控完响度参数后还包括将训练值输入至神经网络模型中进行存储,并依据以下公式实时优化转化因子:

[0048][0049]

式中,p(2)为下一帧的转化因子,p(1)为即时转化因子,d(t)为训练值。

[0050]

如下表2所示,为matlab运行转化因子是否优化得出的效果对比表:

[0051]

表2:转化因子是否优化效果对比表

[0052][0053]

由上表2可看出,相较于p(1),采用p(2)在声音控制线性程度及与现场的融合度上均得到较大的提升,其中,声音控制线性程度的多少体现了声音的渐变的大小,当渐变较小时,声音不会出现较大的波动,更易营造良好的声学范围,与现场的融合度的大小体现了声音转化控制后与现场的契合度,检测标准为相邻两段时间的声音最大值与最小值的偏移度,当偏移度较小时,说明与现场的契合度较好,本轮测试中,采用p(1)的偏移度达到了1.92,而采用p(2)的偏移度为0.74。

[0054]

具体的,每一帧设置为0.5s。

[0055]

额外的,当每一帧中出现三组及以上光学现场数据时,通过调整降低每一帧的设置时间,使每一帧中仅出现三组以下光学现场数据。

[0056]

本发明提供的声光融合数据交互方法,首先将抓取处理后的光学现场数据输入至特定的神经网络模型中进行转化训练,利用训练后输出的训练值进行声音的调控,实现声光的数据交互,解决了现有将麦克风隐藏至吸顶灯上仅限于纯粹的安装,未实现两者之间数据交互的问题。

[0057]

应说明的是,以上实施例仅用以说明本发明的技术方案而非限制,尽管参照较佳实施例对本发明进行了详细说明,本领域的普通技术人员应当理解,可以对本发明的技术方案进行修改或者等同替换,而不脱离本发明技术方案的精神和范围,其均应涵盖在本发明的权利要求范围当中。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1