一种基于深度卷积神经网络的CT图像肝脏自动分割方法

一种基于深度卷积神经网络的ct图像肝脏自动分割方法

技术领域

1.本发明是一种基于深度卷积神经网络的ct图像肝脏自动分割方法,涉及医学影像计算机辅助诊断领域。

技术背景

2.肝脏是人体以代谢功能为主的器官,但同时肝脏也是继肺部之后第二大肿瘤病变器官,据世界卫生组织国际癌症研究机构(who iarc)发布的2020年最新全球癌症数据,在2020年,中国肝癌发病病例高达41.13万人,占全球肝癌发病病例的45.3%,位居世界榜首。在全球肝癌死亡病例中,中国死亡病例更是高达39万例,仅次于肺癌的死亡病例数。由于肝脏代偿功能强大(只要30%~50%肝脏未受到损伤,肝功能便不会受到影响),肝脏周围缺少痛觉神经,且其病症容易被其他背景疾病所掩盖,所以肝癌很难在早期临床诊断时被发现,即使是在发达国家目前也只有不到30%的肝癌患者可以在早期发现并进行手术治疗。因此,对于具有高风险患病的人群,定期对其肝脏部位进行针对性检查,在肝脏出现病变时及早发现并治疗,可以有效降低肝癌等肝脏疾病的死亡率,提高患病人群的生存几率和生活品质。

3.随着计算机视觉技术的发展和应用,利用计算机辅助医生进行影像学的分析已经成为一支主流的研究方向。辅助医生诊断肝脏ct的核心是帮助医生对肝脏区域有明确的划分和识别效果,而利用计算机技术辅助医生进行肝脏类的疾病(如肝癌)首先也是最重要的一步就是将肝脏区域从整个腹腔ct中识别并分割出来,而后在进行针对性的分析、诊断。传统的分割算法已经大规模应用于计算机辅助诊断系统中,然而其无论是在流程上还是技术上都存在一些难以解决的问题,因为传统分割算法一般都是基于低层次信息设计的,比如区域生长、水平集法、超像素法以及svm等机器学习方法,没有充分利用到高层次的语义信息,对于边界模糊和器官粘连部分分割效果较差,且肝脏ct图像包含大量人体器官以及骨骼等其他干扰检测的因素,基于传统方法和机器学习方法的医学影像分割依赖于手工提取、设计特征的方式,对于肝脏的分割精度较低且设计过程较为复杂。

4.近些年随着深度学习技术的快速发展,其相关技术也逐渐被应用到医学领域中来,相对于传统方法,基于深度学习的分割方法更加关注高层次语义信息,对图像的语义表征表达得更精确,而且其省去了人工设计特征的繁琐步骤,网络搭建过程相对传统方法简洁明了,为设计全自动地腹部ct图像的检测分割算法提供了技术可能。虽然现有的基于卷积神经网络的肝脏分割算法在精确度上已经取得较大进展,但仍旧存在以下不足:

5.(1)基于深度卷积神经网络的分割算法框架来源于自然图像任务,现有肝脏分割算法多移植于自然图像分割算法,结果导致移植过来的分割网络框架结构过于冗余,参数量庞大且实用性不佳。

6.(2)现有医学分割网络都是泛用型网络,着重强调其网络针对各种医学影像的泛化性,而并未针对肝脏实际的影像特点对分割框架进行调整与优化,因此专用性较差。

7.(3)现有的轻量化模块在设计上没有针对医学影像特点进行优化,导致其分割识

别精度低下,难以用于临床应用。

技术实现要素:

8.本发明的目的是提供一种基于深度卷积神经网络的ct图像肝脏自动分割方法,利用训练模型对肝脏区域实施快速分割,为进一步诊断肝脏类疾病提供精确的肝脏区域信息。本发明在大大减少了网络所需的参数量情况下也保证了较高的肝脏分割精度,为后续肝脏疾病的辅助诊断提供实用参考信息,具有相当的实用价值。

9.为实现本发明的目的所采用的技术方案是:

10.步骤1:建立训练样本集,包括读取肝脏ct数据集原始文件,制作肝脏分割数据集,将数据集尺寸统一为固定尺寸并划分为测试集和训练集;

11.步骤2:构建深度注意力反残差模块,包括设计特征层注意力机制和构建可选扩展率深度反残差模块;

12.步骤3:建立深度注意力反残差网络,包括整合深度注意力反残差模块,构建下采样网络层和上采样网络层,设计横连接融合上下采样层信息;

13.步骤4:使用训练集训练网络,得到效果良好的训练模型;

14.步骤5:在测试集中验证模型可用性。

15.本发明的有益效果是:针对技术背景中阐述的现有基于卷积神经网络的肝脏算法研究中的三点不足,本发明的创新点为:

16.1、采用轻量级模块来简化肝脏的分割网络,并借鉴高维特征映射思想,构建了可选扩展率反残差模块,保证了轻量化后网络模块依然保持较好的特征提取能力,并且其可以针对网络深度调节扩展率,控制网络整体参数规模不至过大,以此解决了现有分割网络无法兼顾性能和参数规模的弊端,提高了模型的实用性。

17.2、基于伪彩色化原理设计了特征层注意力机制,对只具有灰度特征的肝脏特征图进行线性增强,使各级网络层更加关注特征图层级之间的信息关联,补充了网络层之间的特征信息流,解决了现有肝脏分割网络参数利用率低、欠拟合等的缺点。

18.3、摒弃现阶段轻量化网络普遍采用的卷积下采样方式,在下采样过程中采用无参的最大池化方法,进一步减少网络参数量,使网络具有高实用性。

附图说明

19.为了使本发明的技术方案更加清晰,下面结合附图对本发明进行详细阐述,其中:

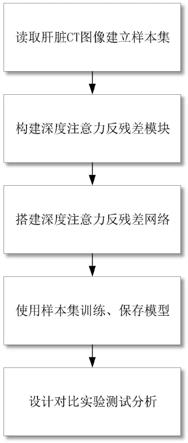

20.图1为肝脏分割模型设计整体流程图。

21.图2为肝脏训练测试集制作样张示意图。

22.图3为特征层注意力机制示意图。

23.图4为可选扩展率反残差结构示意图。

24.图5为深度注意力反残差模块示意图。

25.图6a为深度注意力反残差网络整体结构示意图一。

26.图6b为深度注意力反残差模块整体结构示意图二。

27.图7为深度注意力反残差网络结构细节参数表。

28.图8为不同扩展率对网络性能影响示意图。

29.图9为不同扩展率对网络参数量的影响示意图。

30.图10a为不同分割模型平均交并比指数与网络参数量对比示意图。

31.图10b为不同分割模型戴斯指数与网络参数量对比示意图。

32.图10c为不同分割模型杰卡德指数与网络参数量对比示意图。

33.图11为测试集分割样张对比图。

具体实施方式

34.为了更加明确的阐述本发明的目的、技术方法及优点,下面结合及具体实施方式对本发明做进一步的详细说明。此处描述的具体实施方式仅用来解释本发明,并限定于本发明。本发明亦可通过其他具体实施方法进行应用。可根据相似需求背景,在不背离本发明思路下进行修饰或修改。

35.本发明提出一种基于深度卷积神经网络的ct图像肝脏自动分割方法,其整体流程图如附图1所示,具体包括以下步骤:

36.步骤1:建立训练样本集。具体包括以下步骤:

37.步骤1.1:由于肝脏数据集来自list(isbi 2017肝脏肿瘤分割挑战)挑战赛的子集,包含130个病人ct切片。数据集的具体数据信息采用.nii格式进行存储,可用mricron软件来对.nii文件进行读取,读取过程中,肝脏原图的窗口值设置为(0,200),肝脏和肿瘤标签窗口值设置为(0,1)和(0,2),最后根据窗口值分别制作原始数据集;

38.步骤1.2:制作通用图片格式(.png)数据集。对mricron软件截取后包含肝脏信息的腹腔图像进行裁剪,保证原图和标签的像素值一一对应,并且保存为通用图像格式(.png);

39.步骤1.3:将肝脏分割原始数据集按照约8:2比例划分为测试图片集和训练图片集,其中训练集涵盖约110名患者的ct切片,测试集则涵盖约20名患者ct切片;

40.步骤1.4:制作肝脏分割标签,具体为通过二值化操作对原标签进行处理,制作出精确的肝脏区域分割标签;

41.步骤1.5:制作最终数据集,具体为将上述步骤制作好的原图及标签进行统一尺寸缩放,缩放尺寸可设为256

×

256;

42.步骤2:构建深度注意力反残差模块,包括特征层注意力机制和可选扩展率深度反残差模块两部分,每个深度注意力反残差模块后配以一个上、下采样结构。具体包括以下步骤:

43.步骤2.1:设计特征层注意力机制,如附图3,具体为,首先对来自上层卷积网络的输入特征x(高:h,宽:w,通道数:c)按通道分配常数项,并根据所需的输出通道维度数n设置n项常数项,每项常数项与x进行加权点乘并利用concat(

·

)操作将结果进行拼接,最后加入bn(批标准)层确保输出后的特征图特征分布均匀,最终输出的通道维度为n。其具体定义如式(1):

[0044][0045]

其中h

o

(

·

)代表注意力增强机制,x代表输入特征,可根据通道数c表示为x={x0,

x1,...,x

c

‑1},代表线性变换,concat(

·

)代表按通道拼接操作。

[0046]

步骤2.2:设计可选扩展率深度反残差结构,此处假设经过特征层注意力机制后输出的特征图通道为n=2,具体步骤如下,首先采用1

×

1卷积对特征层注意力机制输出的特征图按照通道进行升维扩展,高维情况下可保证采用轻量化结构后也可以充分提取到肝脏区域的有用特征;而后设计可选扩展率结构,如附图3中三种开关结构分别对应深浅网络层设计的三种不同扩展率,在具体设计时三种扩展率可分别设置为2、4、6,则通过三种扩展率得到的特征图通道分别为4、8、12,特征图升维后,再分别加入bn层和relu激活函数对特征进行批标准化和激活操作;然后采用3

×

3深度可分离卷积对升维后的特征图进行特征提取,同样加入bn层和激活层进行归一化和激活操作;最后继续采用1

×

1卷积将特征图维度降至与输入一致并加入bn层进行特征批标准化,即最后输出特征图通道数n=2。可选扩展率深度反残差结构的整体架构如附图4。

[0047]

步骤2.3:设计上、下采样结构,使用无参的最大池化方式进行下采样,并使用3

×

3转置卷积进行上采样。构建好的深度注意力反残差模块如附图5所示,其中可选扩展率深度反残差模块的数量可以通过设置进行增减,如可设置多个模块,模块之间可用跳跃连接进行级联,本例中模块数设置为2,含有两个跳跃连接结构。

[0048]

步骤3:建立深度注意力反残差网络,包括下采样网络层和上采样网络层两部分,具体包括以下步骤:

[0049]

步骤3.1:构建下采样网络层,包含有三种扩展率的深度注意力反残差模块,模块之间的扩展率随网络深度呈梯度减少,分别为6、4、2,如图7中参数细节所示,三种扩展率对应特征图通道数分别为32/64、128、256,即对深层网络采用较小扩展率,浅层网络则采用较大扩展率,以此防止深度网络层结构过于冗余。如图7,网络整体从浅到深一共包含五个深度注意力反残差模块,每个模块中可选扩展率深度反残差块的数量分别为2、2、3、3、3。

[0050]

步骤3.2:构建上采样网络层,同样包括三种扩展率深度注意力反残差模块,与下采样网络层相反,模块之间的扩展率随网络深度呈梯度增加,分别为2、4、6,分别对应特征图通道数为256、128、64/32,即靠近输出层的网络层采用较大扩展率,反之采用较小扩展率,防止深层网络因可获得的特征信息过少而导致的欠拟合现象。网络层整体也包含五个深度注意力反残差模块,每个模块中深度反残差块的数量分别设置为3、3、3、2、1。下采样网络层和上采样网络层整体趋于对称设计,构成u字形网络结构,如附图6a。

[0051]

步骤3.3:在上下采样层结构中加入横向连接结构(附图6a中的位加操作),将上下采样层得到的输出特征图进行按位相加,对深浅层网络提取到的特征信息进行融合,避免浅层网络中的细节信息丢失,融合后的通道仍与上、下采样层输出通道保持一致,如下采样层输出特征图通道为128,上采层输出也为128,则上下采样层特征按位融合后的特征图通道仍为128。搭建好的深度注意力反残差网络整体框架如图6a所示,图6b展示了可选扩展率深度反残差模块在整体网络中的具体应用位置,网络结构的其他具体细节信息如附图7表中所示。

[0052]

步骤4:使用数据集训练网络得到训练模型,具体包括以下步骤:

[0053]

步骤4.1:调整训练过程的各个超参数,如学习率,训练轮数,衰减因子,网络优化器等。

[0054]

步骤4.2:将分好的训练数据集送入网络,并随机抽取一定比例数据集作为验证集

使用,开始训练模型。

[0055]

步骤4.3:训练过程中,记录各个轮次模型在验证集上的表现,筛选最优模型进行保存。

[0056]

步骤5:使用测试集验证模型可用性,具体包括以下步骤:

[0057]

步骤5.1:选择平均交并比(miou)、戴斯(dice)指数和杰卡德(jaccard)三种指数作为测试集评价指标,与现有经典网络以及轻量化进行比较分析。

[0058]

步骤5.2:记录网络参数量与内存占用情况,与经典网络进行分析比较。

[0059]

步骤5.3:在测试集上进行分割测试,验证模型实际分割效果。

[0060]

实验结果与分析

[0061]

1、分割评价指标与实验结果与分析

[0062]

(1)分割评价指标

[0063]

本专利采用戴斯(dice)指数、平均交并比(miou)指数以及杰卡德(jaccard)指数对分割算法进行性能评估,其中dice指数为最主要的性能指标。dice指数也是一种用来比较两个样本集之间相似性的统计方法,该指数数值越高,代表算法的分割结果与真实的分割结果越接近,分割性能也就越好,其相应的计算公式如式(2)所示:

[0064][0065]

其中,a和b分别代表分割的真实结果与本文算法的分割结果。

[0066]

杰卡德(jaccard)指数与dice指数类似,也是来比较两个集合的相似程度,jaccard指数越高,代表分割算法性能越好,其公式如下所示:

[0067][0068]

其中,a和b分别代表分割的真实结果与本文算法的分割结果。设p

i,j

代表肝脏分割网络最后输出图像(i,j)处像素的预测值,t

i,j

代表真实值,则dice指数和jaccard指数还可表示如下:

[0069][0070][0071]

下面介绍平均交并比即miou指数。首先需要了解语义分割其实是像素级分类,在此基础上会有灵敏度和特异度的判定指标。在机器学习中,对分类算法性能进行评估常用到以下4个指标:

[0072]

(1)真阳性(tp),代表模型将正样本判为正样本的数量,也即被正确判断的正样本数量。

[0073]

(2)假阳性(fp),代表模型将负样本判为正样本的数量,也即被错误判断的负样本数量。

[0074]

(3)真阴性(tn),代表模型将负样本判为负样本的数量,也即被正确判断的负样本数量。

[0075]

(4)假阴性(fn),代表模型将正样本判为负样本的数量,也即被错误判断的正样本数量。

[0076]

平均交并比,即miou指数的实际定义为:计算真实值和预测值两个集合的交集和并集之比,这在实际意义上与杰卡德指数相同,但其具体实现细节不同。miou可以视为tp(交集)比上tp、fp、fn之和(并集)。即:

[0077][0078]

若分割类别数量为k类,n

ij

代表真实值为i被预测为j的数量,则平均交并比指数还可表示如下:

[0079][0080]

(2)分割实验结果

[0081]

本实验在包含约20名病患腹腔切片的测试数据集上进行,评价指标分别为平均交并比(miou)指数、戴斯(dice)指数和杰卡德(jaccard)指数。经多次测试,本文分割模模型在三种指标上分别达到了96.71%、93.76%和96.22%,性能优于其他经典分割网络模型,并且其参数量仅需5.8m,仅仅为经典分割网络fc

‑

densenet的50%。

[0082]

(3)消融实验结果分析

[0083]

表1展示了特征注意力机制对于网络性能的影响。通过实验结果可以看出,加入特征注意力机制后,网络整体性能更加优异,最高接近提升了1个百分点。

[0084]

表1特征注意力机制对实验结果的影响

[0085][0086]

表2使用卷积下采样和最大池化策略对网络性能的影响

[0087][0088]

表2和表3分别展示了采用最大池化策略进行下采样和采用流行的卷积下采样策略进行下采样对网络性能以及参数量内存等的影响。从实验结果看出,采用最大池化策略相比卷积下采样对网络的增益更多,而且其参数量和内存占用都更加小。

[0089]

表3使用卷积下采样和最大池化策略对网络参数量以及占用内存的影响

[0090][0091]

另外本文专门设计了梯度变化的扩展率来适应不同深度的特征提取层,在网络性能和参数之间做了有益平衡,具体参数对网络性能及对网络参数量的影响见附图8。

[0092]

(4)与其它深度学习算法对比分析

[0093]

表4和表5分别给出了本文算法与经典分割算法以及和目前比较主流的轻量化算法的实验对比结果。由总体实验数据可知,在所有的肝分割算法中,本文算法具有最高的miou指数、dice指数和jaccard指数,具有十分优异的分割性能。

[0094]

表4与经典分割算法对比结果

[0095][0096]

表5与轻量化模块对比实验结果

[0097][0098]

另外本文还比较了各个算法在性能和网络所需参数量之间的权衡情况,如图9所示。从图9中各个算法参数量和性能指标可以看出,本文分割模型在保证了较高性能的同时,所需参数量在众多算法里也是较少的,这证明本文算法实用价值远大于其他模型。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1