5G+工业互联网的机器视觉检测系统及方法与流程

5g+工业互联网的机器视觉检测系统及方法

技术领域

1.本发明涉及计算机视觉技术领域,具体涉及一种5g+工业互联网的机器视觉检测系统。

背景技术:

2.在单向的人车混流区域,例如监控区域的入口处或出口处,传统的人群监控全部靠安保干警进行人眼识别和个人经验来区分行人和车辆,工作压力较大,随着机器视觉技术和5g+工业互联网通信技术的发展,越来越多的企业采用智能无人检测系统来完成上述工作;

3.但现有的技术在对单向的人车混流区域进行行人和车辆识别的过程中,两者通常是独立进行识别的,无法很好地相互配合,导致行人的计数与实际相差较大,无法达到很好的识别效果,例如将车辆内的驾驶员和乘客也计入行人的数量中,无法很好的区别行人和车辆。

技术实现要素:

4.(一)解决的技术问题

5.针对现有技术的不足,本发明提供了一种5g+工业互联网的机器视觉检测系统,解决了现有的技术在对单向的人车混流区域进行行人和车辆识别时准确度较差的问题。

6.(二)技术方案

7.为实现以上目的,本发明通过以下技术方案予以实现:

8.第一方面,提供了一种5g+工业互联网的机器视觉检测系统,包括:

9.影像采集模块,用于获取单向人车混行区域的监控影像,并通过5g网络进行影像传输;

10.面部检测模块,用于对所述监控影像中的面部进行识别并追踪,得到面部检测结果;

11.人体检测模块,用于对所述监控影像中的人体进行识别并追踪,得到人体检测结果;

12.车辆检测模块,用于对所述监控影像中的车辆进行识别并追踪,得到车辆检测结果;

13.流量分析模块,用于基于所述面部检测结果、人体检测结果以及车辆检测结果分析得到监控影像中的行人数量和车辆数量。

14.进一步的,所述对所述监控影像中的面部进行识别并追踪,得到面部检测结果,包括:

15.将通过5g网络获取的所述监控影像输入基于神经网络的面部检测模型对监控影像中的面部区域进行识别,得到面部检测结果;

16.且所述面部检测结果表示为:

17.f={face

i

},i=1,2,...,i

18.face

i

={position

i,n

},n=1,2,...,n

19.或

20.其中,i表示监控影像中共检测到i个面部;n表示监控影像共有n帧画面;face

i

表示识别到的第i个面部在监控影像中检测结果;position

i,n

表示第i个面部在第n帧画面中的面部矩形识别框的位置;所述面部矩形识别框的对角线两端点的坐标,表示画面中没有识别到第i个面部。

21.进一步的,所述对所述监控影像中的人体进行识别并追踪,得到人体检测结果,包括:

22.将通过5g网络获取的所述监控影像输入基于神经网络的人体检测模型对监控影像中的人体区域进行识别,得到人体检测结果;

23.且所述人体检测结果表示为:

24.b={body

j

},j=1,2,...,j

25.body

j

={position

j,n

},n=1,2,...,n

26.或

27.其中,j表示监控影像中共检测到j个人体;body

i

表示识别到的第j个人体在监控影像中检测结果;position

j,n

表示第j个人体在第n帧画面中的人体矩形识别框的位置;表示所述人体矩形识别框的对角线两端点的坐标,表示画面中没有识别到第j个人体。

28.进一步的,所述对所述监控影像中的车辆进行识别并追踪,得到车辆检测结果,包括:

29.将通过5g网络获取的所述监控影像输入基于神经网络的车辆检测模型对监控影像中的车辆区域进行识别,得到车辆检测结果;

30.且所述车辆检测结果表示为:

31.c={car

k

},k=1,2,...,k

32.car

k

={position

k,n

},n=1,2,...,n

33.或

34.其中,k表示监控影像中共检测到k个车辆;car

k

表示识别到的第k个车辆在监控影像中检测结果;position

k,n

表示第k个车辆在第n帧画面中的车辆矩形识别框的位置;表示所述车辆矩形识别框的对角线两端点的坐标,表示画面中没有识别到第k个车辆。

35.进一步的,所述基于所述面部检测结果、人体检测结果以及车辆检测结果分析得到监控影像中的行人数量和车辆数量,包括:

36.q1、令n=1;

37.q2、获取第n帧画面中的所有面部检测结果、所有人体检测结果以及所有车辆检测

结果,构建第n帧画面的综合检测结果;

38.q3、将第n帧画面中的人体矩形识别框position

j,n

与面部矩形识别框position

i,n

进行映射匹配,构建面部检测结果与人体检测结果的对应关系;

39.q4、遍历所有车辆矩形识别框position

k,n

,基于第k个车辆的车辆矩形识别框position

k,n

,筛选出位于position

k,n

内的所有面部矩形识别框,得到第k个车辆的备选误差面部集合f'={face

i'

},i'=1,2,...,i';

40.q5、剔除备选面部集合f’中存在对应的人体矩形识别框的面部,得到误差面部集合f”={face

i”},i”=1,2,...,i”;

41.q6、将误差面部集合f”中的面部从面部检测结果f中剔除;

42.q7、令n=n+1,若n>n,则输出面部检测结果f和车辆检测结果c;否则,返回q2。

43.第二方面,提供了一种基于5g+工业互联网的机器视觉检测方法,该方法包括:

44.采集单向人车混行区域的监控影像,并通过5g网络传输采集的监控影像;

45.基于所述监控影像对所述监控影像中的面部、人体和车辆进行识别并追踪,得到面部检测结果、人体检测结果以及车辆检测结果;

46.基于所述面部检测结果、人体检测结果以及车辆检测结果,分析得到监控影像中的行人数量和车辆数量。

47.进一步的,对所述监控影像中的面部进行识别并追踪,得到面部检测结果,包括:

48.将通过5g网络获取的所述监控影像输入基于神经网络的面部检测模型对监控影像中的面部区域进行识别,得到面部检测结果;

49.且所述面部检测结果表示为:

50.f={face

i

},i=1,2,...,i

51.face

i

={position

i,n

},n=1,2,...,n

52.或

53.其中,i表示监控影像中共检测到i个面部;n表示监控影像共有n帧画面;face

i

表示识别到的第i个面部在监控影像中检测结果;position

i,n

表示第i个面部在第n帧画面中的面部矩形识别框的位置;所述面部矩形识别框的对角线两端点的坐标,表示画面中没有识别到第i个面部。

54.进一步的,对所述监控影像中的人体进行识别并追踪,得到人体检测结果,包括:

55.将通过5g网络获取的所述监控影像输入基于神经网络的人体检测模型对监控影像中的人体区域进行识别,得到人体检测结果;

56.且所述人体检测结果表示为:

57.b={body

j

},j=1,2,...,j

58.body

j

={position

j,n

},n=1,2,...,n

59.或

60.其中,j表示监控影像中共检测到j个人体;body

i

表示识别到的第j个人体在监控影像中检测结果;position

j,n

表示第j个人体在第n帧画面中的人体矩形识别框的位置;表示所述人体矩形识别框的对角线两端点的坐标,表示画面中没有

识别到第j个人体。

61.进一步的,对所述监控影像中的车辆进行识别并追踪,得到车辆检测结果,包括:

62.将通过5g网络获取的所述监控影像输入基于神经网络的车辆检测模型对监控影像中的车辆区域进行识别,得到车辆检测结果;

63.且所述车辆检测结果表示为:

64.c={car

k

},k=1,2,...,k

65.car

k

={position

k,n

},n=1,2,...,n

66.或

67.其中,k表示监控影像中共检测到k个车辆;car

k

表示识别到的第k个车辆在监控影像中检测结果;position

k,n

表示第k个车辆在第n帧画面中的车辆矩形识别框的位置;表示所述车辆矩形识别框的对角线两端点的坐标,表示画面中没有识别到第k个车辆。

68.进一步的,基于所述面部检测结果、人体检测结果以及车辆检测结果,分析得到监控影像中的行人数量和车辆数量,包括:

69.q1、令n=1;

70.q2、获取第n帧画面中的所有面部检测结果、所有人体检测结果以及所有车辆检测结果,构建第n帧画面的综合检测结果;

71.q3、将第n帧画面中的人体矩形识别框position

j,n

与面部矩形识别框position

i,n

进行映射匹配,构建面部检测结果与人体检测结果的对应关系;

72.q4、遍历所有车辆矩形识别框position

k,n

,基于第k个车辆的车辆矩形识别框position

k,n

,筛选出位于position

k,n

内的所有面部矩形识别框,得到第k个车辆的备选误差面部集合f'={face

i'

},i'=1,2,

…

,i';

73.q5、剔除备选面部集合f’中存在对应的人体矩形识别框的面部,得到误差面部集合f”={face

i”},i”=1,2,

…

,i”;

74.q6、将误差面部集合f”中的面部从面部检测结果f中剔除;

75.q7、令n=n+1,若n>n,则输出面部检测结果f和车辆检测结果c;否则,返回q2。

76.(三)有益效果

77.本发明是通过将采集的单向人车混行区域的监控影像,并通过5g网络传输采集的监控影像;再基于所述监控影像对所述监控影像中的面部、人体和车辆进行识别并追踪,得到面部检测结果、人体检测结果以及车辆检测结果;最终基于所述面部检测结果、人体检测结果以及车辆检测结果,分析得到监控影像中的行人数量和车辆数量。能够将基于所述面部检测结果、人体检测结果以及车辆检测结果进行综合分析,避免了行人检测中存在的将车辆内的驾驶员和乘客重复计数,导致行人数量误差较大的问题。

附图说明

78.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单的介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以

根据这些附图获得其他的附图。

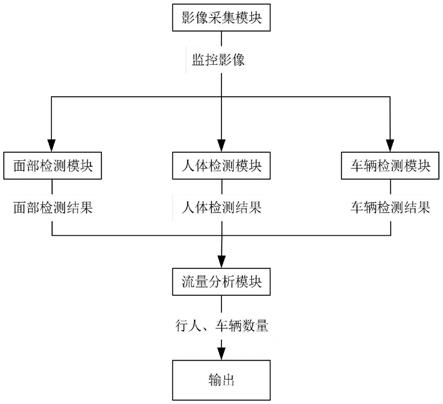

79.图1为本发明实施例的原理图;

80.图2为本发明实施例的流量分析的流程图。

具体实施方式

81.为使本发明实施例的目的、技术方案和优点更加清楚,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

82.本技术实施例通过提供一种5g+工业互联网的机器视觉检测系统,解决了现有的技术在对单向的人车混流区域进行行人和车辆识别时准确度较差的问题。

83.本技术实施例中的技术方案为解决上述技术问题,总体思路如下:

84.本发明是通过将采集的单向人车混行区域的监控影像,并通过5g网络传输采集的监控影像;再基于所述监控影像对所述监控影像中的面部、人体和车辆进行识别并追踪,得到面部检测结果、人体检测结果以及车辆检测结果;最终基于所述面部检测结果、人体检测结果以及车辆检测结果,分析得到监控影像中的行人数量和车辆数量。能够将基于所述面部检测结果、人体检测结果以及车辆检测结果进行综合分析,避免了行人检测中存在的将车辆内的驾驶员和乘客重复计数,导致行人数量误差较大的问题。

85.为了更好地理解上述技术方案,下面将结合说明书附图以及具体的实施方式对上述技术方案进行详细的说明。

86.实施例1:

87.本发明实施例提出了一种5g+工业互联网的机器视觉检测系统,参见图1,包括:

88.影像采集模块,用于获取单向人车混行区域的监控影像,并通过5g网络进行影像传输;

89.面部检测模块,用于对所述监控影像中的面部进行识别并追踪,得到面部检测结果;

90.人体检测模块,用于对所述监控影像中的人体进行识别并追踪,得到人体检测结果;

91.车辆检测模块,用于对所述监控影像中的车辆进行识别并追踪,得到车辆检测结果;

92.流量分析模块,用于基于所述面部检测结果、人体检测结果以及车辆检测结果分析得到监控影像中的行人数量和车辆数量。

93.与现有技术相比,本实施例的有益效果为:

94.本发明实施例通过将采集的单向人车混行区域的监控影像,并通过5g网络传输采集的监控影像;再基于所述监控影像对所述监控影像中的面部、人体和车辆进行识别并追踪,得到面部检测结果、人体检测结果以及车辆检测结果;最终基于所述面部检测结果、人体检测结果以及车辆检测结果,分析得到监控影像中的行人数量和车辆数量。能够将基于所述面部检测结果、人体检测结果以及车辆检测结果进行综合分析,避免了行人检测中存在的将车辆内的驾驶员和乘客重复计数,导致行人数量误差较大的问题。

95.下面对本发明实施例的实现过程进行详细说明:

96.s1、影像采集模块采集单向人车混行区域的监控影像,并通过5g网络传输采集的监控影像。

97.具体的:

98.采集可通过设置在监控区域入口或出口的高清监控摄像机进行采集,通过5g网络实现高带宽、低延迟的数据传输,保证结果的时效性。

99.s2、基于所述监控影像对所述监控影像中的面部、人体和车辆进行识别并追踪,得到面部检测结果、人体检测结果以及车辆检测结果。

100.具体的,主要分为以下三个部分:

101.(1)面部检测模块对所述监控影像中的面部进行识别并追踪,得到面部检测结果。

102.具体方法如下:

103.将通过5g网络获取的所述监控影像输入现有的面部检测模型,例如基于神经网络的面部检测模型,对监控影像中的面部区域进行识别,得到面部检测结果;

104.且所述面部检测结果表示为:

105.f={face

i

},i=1,2,

…

,i

106.face

i

={position

i,n

},n=1,2,...,n

107.或

108.其中,i表示监控影像中共检测到i个面部;n表示监控影像共有n帧画面;face

i

表示识别到的第i个面部在监控影像中检测结果;position

i,n

表示第i个面部在第n帧画面中的面部矩形识别框的位置;所述面部矩形识别框的对角线两端点的坐标,表示画面中没有识别到第i个面部。

109.举例说明:一段监控影像包含10帧图像,即n=10,最终识别到监控影像中共有3个面部,即i=3,以第1个面部为例,可得到10个面部矩形识别框position

1,n

的位置,且每个面部矩形识别框位置通过左下角的角点和右上角的角点的坐标表示,即若只有第3~6帧图像中识别到面部,则其他帧中position

1,n

为其他面部以此类推,即可得到监控影像中的各个面部的定位。

110.(2)人体检测模块对所述监控影像中的人体进行识别并追踪,得到人体检测结果。

111.具体的,将通过5g网络获取的所述监控影像输入现有的人体检测模型,例如基于神经网络的人体检测模型,对监控影像中的人体区域进行识别,得到人体检测结果;

112.且所述人体检测结果表示为:

113.b={body

j

},j=1,2,...,j

114.body

j

={position

j,n

},n=1,2,...,n

115.或

116.其中,j表示监控影像中共检测到j个人体;body

i

表示识别到的第j个人体在监控影像中检测结果;position

j,n

表示第j个人体在第n帧画面中的人体矩形识别框的位置;表示所述人体矩形识别框的对角线两端点的坐标,表示画面中没有

识别到第j个人体。

117.(3)车辆检测模块对所述监控影像中的车辆进行识别并追踪,得到车辆检测结果。

118.具体的,将通过5g网络获取的所述监控影像输入现有的车辆检测模型,例如基于神经网络的车辆检测模型,对监控影像中的车辆区域进行识别,得到车辆检测结果;

119.且所述车辆检测结果表示为:

120.c={car

k

},k=1,2,...,k

121.car

k

={position

k,n

},n=1,2,...,n

122.或

123.其中,k表示监控影像中共检测到k个车辆;car

k

表示识别到的第k个车辆在监控影像中检测结果;position

k,n

表示第k个车辆在第n帧画面中的车辆矩形识别框的位置;表示所述车辆矩形识别框的对角线两端点的坐标,表示画面中没有识别到第k个车辆。

124.人体和车辆的检测结果与面部检测结果类似,都是对识别到的目标进行追踪,得到检测结果,具体可参加面部检测结果的说明内容,在此不再赘述。

125.s3、流量分析模块基于所述面部检测结果、人体检测结果以及车辆检测结果,分析得到监控影像中的行人数量和车辆数量。

126.考虑到监控影像中,面部检测模块可能会把车辆内的驾驶员和乘客计入行人计数中,因此,需要将该部分数据从f中剔除,才能够得到较为准确的行人数量,但在剔除时,还需要考虑到行人站在监控摄像机与车辆之间的情形对剔除过程的影响,因此,如图2所示,分析步骤包括:

127.q1、令n=1;即初始化使算法从第1帧图像开始分析;

128.q2、获取第n帧画面中的所有面部检测结果、所有人体检测结果以及所有车辆检测结果,构建第n帧画面的综合检测结果;

129.举例说明:以第1帧为例,若此时从图像中识别到3个面部,2个车辆,以及2个人体,则此时将7个矩形识别框以及其标识符构成第1帧图像的综合检测结果。

130.q3、将第n帧画面中的人体矩形识别框position

j,n

与面部矩形识别框position

i,n

进行映射匹配,构建面部检测结果与人体检测结果的对应关系;

131.具体的,在进行映射匹配时,可通过面部矩形识别框与人体矩形识别框的相对位置关系进行判断,例如,若面部矩形识别框完全位于人体矩形识别框内部时,则将该面部与该人体进行映射匹配,表示该面部与该人体对应同一个行人。

132.当然,还可进一步将人体识别框进行分区,例如分为上下两个区域或是上中下三个区域,当计算面部矩形框位于上方区域时,则将该面部与该人体进行映射匹配,若处于其他区域,则不进行映射匹配。

133.除了上述方法,也可以进一步将人体矩形框内的图像进行分辨率增强,通过比较两个矩形框中面部部分的相似度来确定该面部与该人体是否对应同一个行人。

134.q4、遍历所有车辆矩形识别框position

k,n

,基于第k个车辆的车辆矩形识别框position

k,n

,筛选出位于position

k,n

内的所有面部矩形识别框,得到第k个车辆的备选误差面部集合f'={face

i'

},i'=1,2,

…

,i';备选误差面部集合表示其面部可能是车内乘客或

驾驶员的面部,也可能是处于监控摄像机和车辆之间的行人,因此需要执行下面的步骤以进一步区分。

135.q5、剔除备选面部集合f’中存在对应的人体矩形识别框的面部,得到误差面部集合f”={face

i”},i”=1,2,...,i”;误差面部集合即表示车内乘客或驾驶员的面部,需要从面部检测结果f中剔除。

136.q6、将误差面部集合f”中的面部从面部检测结果f中剔除;

137.q7、令n=n+1,若n>n,说明所有帧都完成了筛选,则输出面部检测结果f和车辆检测结果c;否则,返回q2。

138.实施例2:

139.第二方面,提供了一种基于5g+工业互联网的机器视觉检测方法,该方法包括:

140.采集单向人车混行区域的监控影像,并通过5g网络传输采集的监控影像;

141.基于所述监控影像对所述监控影像中的面部、人体和车辆进行识别并追踪,得到面部检测结果、人体检测结果以及车辆检测结果;

142.基于所述面部检测结果、人体检测结果以及车辆检测结果,分析得到监控影像中的行人数量和车辆数量。

143.可理解的是,本发明实施例提供的基于5g+工业互联网的机器视觉检测方法与上述基于5g+工业互联网的机器视觉检测系统相对应,其有关内容的解释、举例、有益效果等部分可以参考基于5g+工业互联网的机器视觉检测系统中的相应内容,此处不再赘述。

144.综上所述,与现有技术相比,具备以下有益效果:

145.本发明实施例通过将采集的单向人车混行区域的监控影像,并通过5g网络传输采集的监控影像;再基于所述监控影像对所述监控影像中的面部、人体和车辆进行识别并追踪,得到面部检测结果、人体检测结果以及车辆检测结果;最终基于所述面部检测结果、人体检测结果以及车辆检测结果,分析得到监控影像中的行人数量和车辆数量。能够将基于所述面部检测结果、人体检测结果以及车辆检测结果进行综合分析,避免了行人检测中存在的将车辆内的驾驶员和乘客重复计数,导致行人数量误差较大的问题。

146.需要说明的是,在本文中,诸如第一和第二等之类的关系术语仅仅用来将一个实体或者操作与另一个实体或操作区分开来,而不一定要求或者暗示这些实体或操作之间存在任何这种实际的关系或者顺序。而且,术语“包括”、“包含”或者其他任何其他变体意在涵盖非排他性地包含,从而使得包括一系列要素的过程、方法、物品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括所述要素的过程、方法、物品或者设备中还存在另外的相同要素。

147.以上实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的精神和范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1