一种图像检测方法与流程

1.本技术涉及深度学习技术领域,特别涉及一种图像检测方法。

背景技术:

2.人脸识别技术是基于人的脸部特征信息进行身份识别的一种生物识别技术。近年来人脸识别技术越来越多的应用到智能化设备上,比如闸机门禁、上班考勤机和手机刷脸支付等。但是人脸识别系统有被使用伪装用户人脸进行攻击的风险,一旦用户人脸图像被窃取,系统非常容易受到攻击。

3.活体检测技术是在一些身份验证场景确定对象真实生理特征的方法,在人脸检测应用中,活体检测能通过眨眼、张嘴、摇头和点头等组合动作,使用人脸关键点定位和人脸追踪等技术,验证用户是否为真实活体本人操作。可有效抵御照片、换脸、面具、遮挡以及屏幕翻拍等常见的攻击手段,从而帮助用户甄别欺诈行为,保障用户的利益。因此针对活体检测的研究逐渐成为人脸检测中的重要研究任务。

技术实现要素:

4.本技术实施例提供了一种图像检测方法、装置和电子设备,用以提高活体检测的准确率。

5.第一方面,本技术实施例提供了一种图像检测方法,包括:获取待检测图像;通过训练好的活体检测网络对所述待检测图像进行检测,得到所述待检测图像的输出结果;所述输出结果表示所述待检测图像是否为活体人脸图像;所述训练好的活体检测网络是通过以下方法进行n次训练得到的;所述n是预设的,且n是正整数;其中,将已知数据集中的第一图像和所述第一图像的第一标签作为所述活体检测网络的第一输入,将所述第一图像为活体人脸图像的概率作为所述活体检测网络的第一输出;所述第一标签用于表示所述第一图像为活体人脸图像;以及,将生成器根据随机生成的高斯分布数据源生成的第二图像作为所述活体检测网络的第二输入,将所述第二图像为活体人脸图像的概率作为所述活体检测网络的第二输出;根据所述第一输出的损失和所述第二输出的损失,对所述活体检测网络进行第n次训练,得到所述训练好的活体检测网络;n是小于或等于n,且大于或等于0的整数。

6.基于上述方案,提出的一种对活体检测网络的训练方法,可以有效应用人脸防假任务中的未知攻击类型图像,可以增强活体检测网络的效果。相对目前技术,可以在网络规模有限情况下提升活体检测网络,相对于领域自适应类方法而言,该方法需要的数据量更少,需要的数据类别少,不需要对训练数据进行领域划分,该方法生成的未知攻击类型图像覆盖面更广。

7.在一种可能的实现方式中,所述第一输出的损失为所述第一输出与所述第一图像的第一标签的分类交叉熵损失;所述第一输出的损失l

cls

满足以下公式:

c代表第一图像数量, 是活体检测网络预测第j个第一图像为活体人脸图像的概率, 是第j个第一图像的第一标签;所述第二输出的损失为所述第二输出与预设的类别均匀概率分布之间的相对熵损失;所述第二输出的损失满足以下公式:n为输入的所述第二图像的数量,表示预测输入的第i个第二图像为活体人脸图像的概率, y

uniform

为预设类别均匀概率分布。

8.基于上述方案,通过分类交叉熵损失函数可以表示在活体检测网络中实际输出的结果与输入图像的预设标签之间的差异,以此对活体检测网络对活体人脸检测的准确性进行约束,使用相对熵损失可以度量输出分布与类别均匀分布的差异性。

9.在一种可能的实现方式中,根据所述第一输出的损失和所述第二输出的损失,对所述活体检测网络进行n次训练,得到所述训练好的活体检测网络,包括:确定所述第一图像的中心损失;所述中心损失是通过中心损失函数确定的;所述中心损失l

center

满足以下公式:m为已知数据集中第一图像的数量, 表示已知数据集中的第i个第一图像,为预设的类中心;根据所述中心损失、所述第一输出的损失和所述第二输出的损失对所述活体检测网络进行n次训练,得到所述训练好的活体检测网络。

10.基于上述方案,针对活体检测提出了一种新的损失计算方法,该方法的提出考虑到活体人脸图像分布的类中心概念,保证了活体人脸图像的类内紧凑。此外将中心损失、第一输出的损失和第二输出的损失相结合,有效的提高了网络的鲁棒性,相对现有技术而言考虑更加全面。

11.在一种可能的实现方式中,所述生成器是预先训练好的生成器;所述生成器是根据以下方法训练n次得到的;将所述生成器根据随机生成的高斯分布数据源生成的第三图像和所述第三图像的第二标签作为鉴别器的输入;所述第二标签用于表示所述第三图像为已知图像;将所述第三图像为已知图像的概率作为所述鉴别器的输出;将所述第三图像作为n

‑

1次训练得到的活体检测网络的输入,将所述第三图像为活体人脸图像的概率作为所

述n

‑

1次训练得到的活体检测网络的输出;根据所述鉴别器的输出的损失和所述n

‑

1次训练得到的活体检测网络的输出的损失,对所述生成器进行第n次训练。

12.基于上述方案,通过训练生成器,加强其实时生成未知图像对活体检测网络,从而提高其鲁棒性,而且增强其对未知类型图像的检测能力。

13.在一种可能的实现方式中,所述鉴别器的输出的损失是所述鉴别器的输出与所述第二标签的交叉熵分类损失;所述鉴别器的输出的损失l

eerrg

满足以下公式:c代表第三图像数量,是鉴别器预测第j个第三图像为已知图像的概率,是第j个第三图像的第二标签;所述n

‑

1次训练时的活体检测网络的输出的损失所述n

‑

1次训练时的活体检测网络的输出与预设的类别均匀概率分布之间的相对熵损失;所述第n

‑

1次训练时的活体检测网络的输出的损失满足以下公式:n为第三图像的数量, 表示输入的第i个第三图像为活体人脸图像的概率, 为预设类别均匀概率分布。

14.基于上述方案,通过分类交叉熵损失函数可以表示在鉴别器中实际输出的结果与输入图像的预设标签之间的差异,以此对鉴别器对是否为已知图像的判断的准确性进行约束,使用相对熵损失可以度量输出分布与类别均匀分布的差异性。

15.在一种可能的实现方式中,所述鉴别器是预先训练好的鉴别器;所述鉴别器是根据以下方法训练n次得到的;将所述第一图像和所述第一标签作为所述鉴别器的第三输入,将所述第一图像为已知图像的概率作为所述鉴别器的第三输出;以及,将第n

‑

1次训练得到的生成器根据随机生成的高斯分布数据源生成的第四图像和所述第四图像的第三标签作为所述鉴别器的第四输入,将所述第四图像为已知图像的概率为所述生成器的第四输出;所述第三标签表示所述第四图像为未知图像;根据所述第三输出的损失和所述第四输出的损失,对所述鉴别器进行第n次训练。

16.基于上述方案,对鉴别器进行训练可以使鉴别器对已知图像和未知攻击类型图像的判断更为准确,从而更好地训练活体检测网络,增强活体检测网络的准确性和鲁棒性。

17.在一种可能的实现方式中,所述第三输出的损失为所述第三输出的判别损失;所述第三输出的损失l

in

满足以下公式:

c代表第一图像数量,是鉴别器预测第j个第一图像为已知图像的概率, 是第j个第一图像的第二标签;所述第四输出的损失为所述第四输出与所述第三标签的分类交叉熵损失;所述第四输出的损失l

out

满足以下公式:c代表第三图像数量,y

ju_out 是鉴别器预测第j个第三图像为已知图像的概率,y

ju

是第j个第三图像的第三标签。

18.基于上述方案,使用分类交叉熵损失可以对鉴别器对是否为已知图像的判断的准确性进行约束。

19.第二方面,本技术实施例提供了一种图像检测装置,包括:获取单元,用于获取待检测图像;处理单元,用于通过训练好的活体检测网络对所述待检测图像进行检测,得到所述待检测图像的输出结果;所述输出结果表示所述待检测图像是否为活体人脸图像;所述训练好的活体检测网络是通过以下方法进行n次训练得到的;所述n是预设的,且n是正整数;其中,将已知数据集中的第一图像和所述第一图像的第一标签作为所述活体检测网络的第一输入,将所述第一图像为活体人脸图像的概率作为所述活体检测网络的第一输出;所述第一标签表示输入的图像为活体人脸图像;以及,将生成器根据随机生成的高斯分布数据源生成的第二图像作为所述活体检测网络的第二输入,将所述第二图像为活体人脸图像的概率作为所述活体检测网络的第二输出;根据所述第一输出的损失和所述第二输出的损失,对所述活体检测网络进行第n次训练,得到所述训练好的活体检测网络;n是小于或等于n,且大于0的整数。

20.在一种可能的实现方式中, 所述第一输出的损失l

cls

满足以下公式:c代表第一图像数量, 是活体检测网络预测第j个第一图像为活体人脸图像的概率, 是第j个第一图像的第一标签;所述第二输出的损失满足以下公式:

n为输入的所述第二图像的数量,表示预测输入的第i个第二图像为活体人脸图像的概率, y

uniform

为预设类别均匀概率分布。

21.在一种可能的实现方式中,所述处理单元402还用于根据所述第一输出的损失和所述第二输出的损失,对所述活体检测网络进行n次训练,得到所述训练好的活体检测网络,包括:确定所述第一图像的中心损失;所述中心损失l

center

满足以下公式:m为已知数据集中第一图像的数量,表示已知数据集中的第i个第一图像,为预设的类中心;根据所述中心损失、所述第一输出的损失和所述第二输出的损失对所述活体检测网络进行n次训练,得到所述训练好的活体检测网络。

22.在一种可能的实现方式中,所述生成器是预先训练好的生成器;所述生成器是根据以下方法训练n次得到的;将所述生成器根据随机生成的高斯分布数据源 生成的第三图像和所述第三图像的第二标签作为鉴别器的输入;所述第二标签表示输入的图像为已知图像;将所述第三图像为已知图像的概率作为所述鉴别器的输出;将所述第三图像作为第n

‑

1次训练得到的活体检测网络的输入,将所述第三图像为活体人脸图像的概率作为所述第n

‑

1次训练得到的活体检测网络的输出;根据所述鉴别器的输出的损失和所述第n

‑

1次训练得到的活体检测网络的输出的损失,对所述生成器进行第n次训练。

23.在一种可能的实现方式中,所述鉴别器的输出的损失l

eerrg

满足以下公式:c代表第三图像数量,是鉴别器预测第j个第三图像为已知图像的概率,是第j个第三图像的第二标签;所述第n

‑

1次训练时的活体检测网络的输出的损失满足以下公式:

n为第三图像的数量, 表示输入的第i个第三图像为活体人脸图像的概率, 为预设类别均匀概率分布。

24.在一种可能的实现方式中,所述鉴别器是预先训练好的鉴别器;所述鉴别器是根据以下方法训练n次得到的;将所述第一图像和所述第二标签作为所述鉴别器的第三输入,将所述第一图像为已知图像的概率作为所述鉴别器的第三输出;以及,将第n

‑

1次训练得到的生成器根据随机生成的高斯分布数据源生成的第三图像和所述第三图像的第三标签作为所述鉴别器的第四输入,将所述第三图像为已知图像的概率为所述鉴别器的第四输出;所述第三标签表示输入的图像为未知图像;根据所述第三输出的损失和所述第四输出的损失,对所述鉴别器进行第n次训练。

25.在一种可能的实现方式中,所述第三输出的损失l

in

满足以下公式:c代表第一图像数量, 是鉴别器预测第j个第一图像为已知图像的概率, 是第j个第一图像的第二标签;所述第四输出的损失满足以下公式:c代表第三图像数量, 是鉴别器预测第j个第三图像为已知图像的概率, 是第j个第三图像的第三标签。

26.第三方面,本技术实施例提供了一种电子设备,包括:存储器,用于存储计算机指令;处理器,与所述存储器连接,用于执行所述存储器中的计算机指令,且在执行所述计算机指令时实现如第一方面或第二方面中所述的方法。

27.第四方面,本技术实施例提供了一种计算机可读存储介质,所述计算机可读存储介质存储有计算机指令,当所述计算机指令在计算机上运行时,使得计算机执行如第一方面或第二方面中任一项所述的方法。

28.上述第二方面至第四方面中的各个方面以及各个方面可能达到的技术效果请参

照上述针对第一方面或第一方面中的各种可能方案可以达到的技术效果说明,这里不再重复赘述。

附图说明

29.为了更清楚地说明本技术实施例或现有技术中的技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本技术的一些实施例。

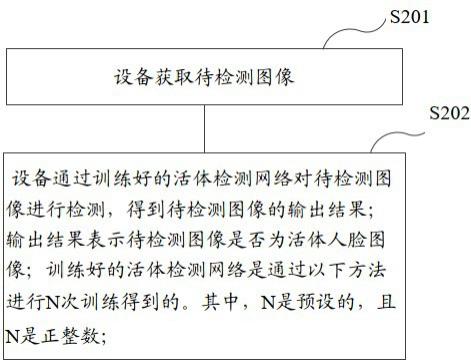

30.图1为本技术实施例提供的活体人脸图像和非活体图像示意图;图2为本技术实施例提供的一种图像检测方法示例性流程图之一;图3为本技术实施例提供的一种图像检测方法示例性流程图之一;图4为本技术实施例提供的一种图像检测装置示意图;图5为本技术实施例提供的一种电子设备的结构示意图。

具体实施方式

31.为使本技术实施例的目的、技术方案和优点更加清楚,下面将结合本技术实施例中的附图,对本技术的技术方案进行清楚、完整地描述,显然,所描述的实施例是本技术技术方案的一部分实施例,而不是全部的实施例。基于本技术文件中记载的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本技术技术方案保护的范围。

32.本技术实施例中的术语“第一”和“第二”是用于区别不同对象,而非用于描述特定顺序。此外,术语“包括”以及它们任何变形,意图在于覆盖不排他的保护。例如包含了一系列步骤或单元的过程、方法、系统、产品或设备没有限定于已列出的步骤或单元,而是可选地还包括没有列出的步骤或单元,或可选地还包括对于这些过程、方法、产品或设备固有的其它步骤或单元。本技术中的“多个”可以表示至少两个,例如可以是两个、三个或者更多个,本技术实施例不做限制。

33.另外,本文中术语“和/或”,仅仅是一种描述关联对象的关联关系,表示可以存在三种关系,例如,a和/或b,可以表示:单独存在a,同时存在a和b,单独存在b这三种情况。另外,本文中字符“/”,在不做特别说明的情况下,一般表示前后关联对象是一种“或”的关系。

34.人脸识别技术是基于人的脸部特征信息进行身份识别的一种生物识别技术。但是人脸识别系统有被使用伪装用户人脸进行攻击的风险,一旦用户人脸图像被窃取,系统非常容易受到攻击。由于非活体图像的类型越来越多,比如使用黑白打印照片,彩色图像套袋,使用不同材质制作的3d头模,因此活体检测系统除了需要针对常见的非活体图像进行检测,还需要针对没有见过的未知攻击类型图像进行检测。而目前相关技术中,在网络训练过程中仅仅使用现有的图像,很难实现让活体检测网络学习到共同的泛化特征。如何对活体检测网络进行加强,增强其对未知类型图像的检测能力亟待解决。

35.参见图1,为活体人脸图像和非活体图像示意图。其中,活体人脸图像可以认为是有生命的用户的面部构成的图像。非活体图像可以认为是无生命的图像数据。需要说明的是,非活体图像中可以包含人脸,也可以不包含人脸。如图1所示,可以是海报上的人脸,或者也可以是通过手机拍摄的图像,或者也可以是其他不包含人脸的图像数据。

36.本技术实施例中,已知数据集为进行活体检测网络训练前人为获取的包含活体人脸图像和非活体图像的一组数据集。其中,活体人脸图像类型比较单一,可以通过摄像头获取。本技术实施例提及的未知数据集是除上述已知数据集以外的其他数据构成的集合。例如,可以是生成器随机生成的图像,或者可以是生成器通过随机生成的高斯分布数据源生成的图像等,或者还可以是在人脸检测过程中受到攻击时的非活体图像。

37.因为活体检测技术对人脸质量有特定要求,可以用来验证用户是否为真实本人操作,因此在实际应用中活体人脸的图像可以覆盖到很多应用场景。然而非活体攻击类型无法穷尽,未知攻击类型图像几乎均为各种各样非活体图像,包括3d攻击和特殊材质的海报打印纸张攻击。因此可以在活体检测网络训练过程中,通过训练生成器实时生成未知攻击类型图像对活体检测网络进行加强,从而提高其鲁棒性,而且增强其对未知攻击类型图像的检测能力。

38.有鉴于此,本技术实施例提供了一种图像检测方法,该方法包括:获取待检测图像。然后通过训练好的活体检测网络对待检测图像进行检测,得到待检测图像是否为活体人脸的输出结果。其中,训练好的活体检测网络可以是通过前述已知数据集中的图像以及生成器生成的未知攻击类型图像训练得到的。因此,可以增强活体检测网络的效果。

39.参阅图2为本技术实施例提供的一种图像检测方法的示例性流程图之一,可包括以下流程:s201,设备获取待检测图像。

40.其中,上述设备可以是具有人脸检测功能的设备。例如,可以是手机、平板电脑或者电脑等,本技术不做具体限定。设备可以通过摄像装置过去待检测图像,如可以通过摄像头获取待检测图像。

41.s202,设备通过训练好的活体检测网络对待检测图像进行检测,得到待检测图像的输出结果;输出结果表示待检测图像是否为活体人脸图像;训练好的活体检测网络是通过n次训练得到的。其中,n是预设的,且n是正整数;具体地,训练活体检测网络的步骤如下:首先,初始化活体检测网络的网络参数,然后将已知数据集中的第一图像及其第一标签作为活体检测网络的第一输入,然后在活体检测网络中通过前向传播计算得到第一输出,并计算第一输出的损失。其中,第一标签表示该第一图像是否为活体人脸图像,第一输出表示预测第一图像为活体人脸图像的概率,第一输出的损失为第一输出与第一图像的第一标签的分类交叉熵损失,计算公式如下公式1所示:(公式1)如上式所示,是第一输出的损失,c代表样本数量,是活体检测网络预测第j个样本为活体人脸图像的概率,是第j个样本的第一标签,如果第j个样本为活体人脸图像,则取值为1,否则取值为0。通过分类交叉熵损失函数可以表示在活体检测网络

中实际输出的检测结果与第一图像的预设的第一标签之间的差异。

42.接着将生成器根据随机生成的高斯分布数据源生成的第二图像作为活体检测网络的第二输入,得到第二输出,并计算第二输出的损失。其中,第二图像为未知攻击类型图像,第二输出为预测第二图像为活体人脸图像的概率,第二输出的损失表示第二输出和预设的类别均匀概率分布之间的相对熵损失,计算公式如下公式2所示:

ꢀꢀꢀꢀꢀ

(公式2)如上式所示,表示第二输出的损失,n为输入的未知攻击类型图像样本的数量,表示预测输入的第i个样本为活体人脸图像的概率,为预设类别均匀概率分布。

43.在得到上述第一输出的损失和第二输出的损失之后,可以根据第一输出的损失和第二输出的损失对活体检测网络进行训练。

44.基于上述方案,使用分类交叉熵损失可以对活体检测网络对活体人脸检测的准确性进行约束,使用相对熵损失可以度量输出分布与类别均匀分布的差异性。

45.另外,为了保证活体人脸图像间类内紧凑,可以对已知数据集内的活体人脸图像计算中心损失,计算公式如下公式3所示:

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(公式3)如上式所示,为第一图像的中心损失,m为已知数据集中第一图像的数量,表示已知数据集中的第i个第一图像,为预设的类中心;。

46.基于上述方案,本技术针对活体检测提出了一种新的损失计算方法,该方法的提出考虑到活体人脸图像分布的类中心概念,保证了活体人脸图像的类内紧凑。

47.联合上述三个损失函数,根据实际情况设置合适的权重对活体检测网络的网络参数进行训练,可提高活体检测网络的鲁棒性,计算公式如下公式4所示:

ꢀꢀꢀꢀꢀꢀꢀꢀ

(公式4)如上式所示,为活体检测网络的损失,为第一输出的损失的权重,为中心损失的权重,为第二输出的损失的权重。应了解,、和应根据实际情况取值,本技术实施例对此不作要求。

48.通过公式4对活体检测网络进行n次训练,得到训练好的活体检测网络,其中,训练过程为根据第一输出的损失、第二输出的损失和中心损失调整活体检测网络中的参数,然后判断训练次数是否大于n,若不是,则再次进行训练过程,直至第n次训练完成,结束训练。其中,n为预设的最大迭代次数。可选地,n的值可以为10、20或30等,本技术实施例不做限

制。

49.基于上述方案,本技术提出的一种对活体检测网络的训练方法,可以有效应用人脸防假任务中的未知攻击类型图像,可以增强活体检测网络的效果。相对目前技术,可以在网络规模有限情况下提升活体检测网络,相对于领域自适应类方法而言,该方法需要的数据量更少,需要的数据类别少,不需要对训练数据进行领域划分,该方法生成的分布外数据覆盖面更广。

50.生成器采用上采样反卷积网络,用于将随机生成的高斯分布数据源经过上采样生成未知攻击类型的图像。另外,在训练活体检测网络时采用的生成器可以是训练好的生成器,生成器训练过程中使用生成对抗训练,其训练步骤如下:首先将生成器根据随机生成的高斯分布数据源生成的第三图像输入鉴别器,并将第三图像的标签设为第二标签,然后得到鉴别器的输出,并计算鉴别器的输出的损失。其中,第二标签用于表示第三图像为已知图像,鉴别器的输出表示鉴别器预测第三图像为已知图像的概率,鉴别器的输出的损失表示鉴别器的输出与第二标签的分类交叉熵损失,计算公式如下公式5所示:(公式5)如上式所示,表示鉴别器的输出的损失,c代表样本数量,是鉴别器预测第j个样本为已知图像的概率,是第j个样本的第二标签。鉴别器的输出的损失可以表示在鉴别器中实际输出的检测结果与已知图像的预设标签之间的差异。

51.接着再将生成器生成的第三图像输入活体检测网络,得到活体检测网络的输出,并计算活体检测网络的输出的损失,输出表示预测第三图像为活体人脸图像的概率,活体检测网络的输出的损失表示该输出和类别均匀概率分布之间的相对熵损失,计算公式如下公式6所示:

ꢀꢀꢀꢀ

(公式6)如上式所示,表示活体检测网络的输出的损失,n为样本的数量,表示输入的第i个未知攻击类型图像样本为活体人脸图像的概率,为预设类别均匀概率分布。通过相对熵损失来度量生成器生成的未知攻击类型图像为活体人脸图像的概率和类别均匀概率分布之间的差异。

52.联合鉴别器的输出的损失和活体检测网络的输出的损失,并根据实际情况设置合适的权重对生成器的网络参数进行训练,其中,训练过程为根据鉴别器的输出的损失和活体检测网络的输出的损失调整活体检测网络中的参数,然后判断训练次数是否大于n,若不是,则再次进行训练过程,直至第n次训练完成,结束训练。计算公式如下公式7所示:

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(公式7)如上式所示,为生成器的网络损失函数,为鉴别器的输出与标签的交叉熵分类损失的权重,表示活体检测网络输出和类别均匀概率分布之间的相对熵损失的权重。应了解,和应根据实际情况取值,本技术实施例对此不作要求。

53.基于上述方案,对生成器进行训练可以增加未知攻击类型图像的类型和数量,从而更好地训练活体检测网络,增强活体检测网络的准确性和鲁棒性。

54.鉴别器用于判断输入图像是否为已知数据集中的已知图像,在生成器训练中使用的鉴别器为训练好的鉴别器,其训练步骤如下:首先初始化鉴别器网络参数,然后将已知数据集中的第一图像及其第二标签作为鉴别器的第三输入,通过前向传播计算得到第三输出,并计算第三输出的损失,其中,第二标签表示第一图像为已知图像,第三输出表示预测第一图像为已知图像的概率,第三输出的损失表示第三输出与第二标签的分类交叉熵损失。计算公式如下公式8所示:

ꢀꢀ

(公式8)如上式所示,表示第三输出的损失,c代表样本数量,是鉴别器预测第j个样本为已知图像的概率,是第j个样本的第二标签,如果第j个样本为已知数据,取值为1,否则取值为0。通过分类交叉熵损失函数可以表示在鉴别器中实际输出的检测结果与已知图像的预设标签之间的差异。

55.然后将生成器生成的第三图像及其第三标签作为鉴别器的第四输入,得到第四输出,然后计算第四输出的损失。其中,第三标签表示第三图像为未知图像,第四输出表示预测第三图像为已知图像的概率,第四输出的损失表示第四输出与第三标签的分类交叉熵损失,计算公式如下公式9所示:(公式9)如上式所示,表示第四输出的损失,c代表样本数量,是鉴别器预测第j个样本为已知图像的概率,是第j个样本的第三标签。通过分类交叉熵损失函数可以表示在鉴别器中实际输出的结果与输入数据的预设标签之间的差异。

56.联合第三输出的损失和第四输出的损失,根据实际情况设置合适的权重对鉴别器的网络参数进行训练,其中,训练过程为根据第三输出的损失和第四输出的损失调整活体检测网络中的参数,然后判断训练次数是否大于n,若不是,则再次进行训练过程,直至第n次训练完成,结束训练。计算公式如下公式10所示:

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(公式10)如上式所示,为鉴别器的损失,为第三输出的损失的权重,表示第四输出的损失的权重。应了解,和应根据实际情况取值,本技术实施例对此不作要求。

57.应理解,本技术实施例对生成器、鉴别器和活体检测网络的网络结构不加以限制,只需保证生成器输出图像的尺寸与鉴别器和活体检测网络输入图像的尺寸相同即可。

58.基于上述方案,对鉴别器进行训练可以使鉴别器对已知图像和未知攻击类型图像的判断更为准确,从而更好地训练活体检测网络,增强活体检测网络的准确性和鲁棒性。

59.下面,为了能够更加清晰地理解本技术实施例提出的方案,将结合具体地实施例对本技术提供的一种图像检测方法进行介绍。

60.参阅图3,为本技术实施例提供的一种图像检测方法的示例性流程图之一,具体包括:s301,设备设置训练次数n。

61.其中,设备可以设置训练的最大次数n,并另n=1,n可以表示第n次训练。需要说明的是,当n=1时,第n

‑

1次训练时的网络代表此时的网络为未被训练的初始网络。

62.应理解,n也可以等于0,同样的第n

‑

1次训练时的网络代表此时的网络为未被训练的初始网络。

63.s302,设备判断n是否小于或等于n。

64.如果n小于或等于n,则继续执行s303;如果n大于n,则执行s315。

65.s303,设备初始化鉴别器、生成器和人脸检测网络的网络参数。

66.s304,设备读取已知数据集中的第一图像,输入鉴别器并计算第三输出的损失。

67.将已知数据集中的第一图像及其第二标签作为鉴别器的第三输入,得到第三输出,计算第三输出的损失,其中第三输出的损失的计算方法可以参见如图2所示的方法实施例中的相关说明,此处不再赘述。

68.s305,设备将生成器生成的第三图像输入鉴别器,计算第四输出的损失。

69.将生成器根据高斯分布生成的第三图像及其对应的第三标签作为鉴别器的第四输入输入,得到鉴别器的第四输出,并计算第四输出的损失,其中第四输出的损失计算方法可以参见如图2所示的方法实施例中的相关说明,此处不再赘述。

70.s306,设备通过鉴别器网络的损失优化鉴别器的网络参数。

71.鉴别器网络的损失计算方法可以参见如图2所示的方法实施例中的相关说明,此处不再赘述。

72.s307,设备将第三图像输入鉴别器,计算鉴别器的输出的损失。

73.将s305生成器生成的第三图像再次输入鉴别器,并将其标签设为第二标签,得到鉴别器的输出,并计算鉴别器的输出的损失。鉴别器的输出的损失计算方法可以参见如图2所示的方法实施例中的相关说明,此处不再赘述。

74.s308,设备将第三图像输入活体检测网络,计算活体检测网络的输出的损失。

75.将s305生成器生成的第三图像输入活体检测网络,得到活体检测网络的输出,并计算活体检测网络的输出的损失。活体检测网络的输出的损失计算方法可以参见如图2所示的方法实施例中的相关说明,此处不再赘述。

76.s309,设备通过生成器网络的损失优化生成器网络参数。

77.生成器网络的损失计算方法可以参见如图2所示的方法实施例中的相关说明,此处不再赘述。

78.s310,设备将第一图像输入活体检测网络,计算第一输出的损失。

79.将已知数据集中的第一图像及其第一标签作为活体检测网络的第一输入,然后在活体检测网络中通过前向传播计算得到第一输出,并计算第一输出的损失。第一输出的损失计算方法可以参见如图2所示的方法实施例中的相关说明,此处不再赘述。

80.s311,设备对已知数据集内的活体人脸图像计算中心损失。

81.为了保证活体人脸图像间类内紧凑,对已知数据集内已知图像中的活体人脸图像计算中心损失。中心损失的计算方法可以参见如图2所示的方法实施例中的相关说明,此处不再赘述。

82.s312,设备将生成器重新生成的第三图像输入活体检测网络,计算第二输出的损失。

83.将生成器重新根据随机生成的高斯分布数据源生成的第二图像作为活体检测网络的第二输入,得到第二输出,并计算第二输出的损失。第二输出的损失的计算方法可以参见如图2所示的方法实施例中的相关说明,此处不再赘述。

84.s313,设备通过活体检测网络的损失优化图像检测网络的网络参数。

85.活体检测网络的损失计算方法可以参见如图2所示的方法实施例中的相关说明,此处不再赘述。

86.s314,n=n+1。

87.每次活体检测网络完成训练后都将训练次数加1,并返回s302。

88.s315,结束训练。

89.基于上述方法的同一构思,参见图4,为本技术实施例提供的一种图像检测装置400,装置400能够执行上述方法中的各个步骤,为了避免重复,此处不再详述。该装置400包括获取单元401和处理单元402。

90.在一种场景下:获取单元401用于获取待检测图像;处理单元402,用于执行下述处理:通过训练好的活体检测网络对所述待检测图像进行检测,得到所述待检测图像的输出结果;所述输出结果表示所述待检测图像是否为活体人脸图像;所述训练好的活体检测网络是通过以下方法进行n次训练得到的;所述n是预设的,且n是正整数;其中,将已知数据集中的第一图像和所述第一图像的第一标签作为所述活体检测网络的第一输入,将所述第一图像为活体人脸图像的概率作为所述活体检测网络的第一输出;所述第一标签表示输入的图像为活体人脸图像;以及,将生成器根据随机生成的高斯分布数据源生成的第二图像作为所述活体检测网络的第二输入,将所述第二图像为活体人脸图像的概率作为所述活体检测网络的第二输出;根据所述第一输出的损失和所述第二输出的损失,对所述活体检测网络进行第n次训练,得到所述训练好的活体检测网络;n是小于或等于n,且大于0的整数。

91.在一种可能的实现方式中, 所述第一输出的损失l

cls

满足以下公式:

c代表第一图像数量, 是活体检测网络预测第j个第一图像为活体人脸图像的概率, 是第j个第一图像的第一标签;所述第二输出的损失满足以下公式:n为输入的所述第二图像的数量,表示预测输入的第i个第二图像为活体人脸图像的概率, y

uniform

为预设类别均匀概率分布。

92.在一种可能的实现方式中,所述处理单元402还用于根据所述第一输出的损失和所述第二输出的损失,对所述活体检测网络进行n次训练,得到所述训练好的活体检测网络,包括:确定所述第一图像的中心损失;所述中心损失l

center

满足以下公式:m为已知数据集中第一图像的数量,表示已知数据集中的第i个第一图像,为预设的类中心;根据所述中心损失、所述第一输出的损失和所述第二输出的损失对所述活体检测网络进行n次训练,得到所述训练好的活体检测网络。

93.在一种可能的实现方式中,所述生成器是预先训练好的生成器;所述生成器是根据以下方法训练n次得到的;将所述生成器根据随机生成的高斯分布数据源 生成的第三图像和所述第三图像的第二标签作为鉴别器的输入;所述第二标签表示输入的图像为已知图像;将所述第三图像为已知图像的概率作为所述鉴别器的输出;将所述第三图像作为第n

‑

1次训练得到的活体检测网络的输入,将所述第三图像为活体人脸图像的概率作为所述第n

‑

1次训练得到的活体检测网络的输出;根据所述鉴别器的输出的损失和所述第n

‑

1次训练得到的活体检测网络的输出的损失,对所述生成器进行第n次训练。

94.在一种可能的实现方式中,所述鉴别器的输出的损失l

eerrg

满足以下公式:

是第j个第三图像的第三标签。

97.基于上述方法的同一构思,参见图5,为本技术实施例提供电子设备,该电子设备包括处理器501和存储器502。存储器502,用于存储计算机指令,处理器501,与所述存储器连接,用于执行所述存储器中的计算机指令,且在执行所述计算机指令时实现上述任一方法的步骤。

98.本技术实施例还提供了一种计算机可读存储介质,其上存储有计算机指令,当所述计算机指令在计算机上运行时,使得计算机执行上述任一方法的步骤。

99.本领域普通技术人员可以理解:实现上述各方法实施例的全部或部分步骤可以通过程序指令相关的硬件来完成。前述的程序可以存储于一计算机可读取存储介质中。该程序在执行时,执行包括上述各方法实施例的步骤;而前述的存储介质包括:rom、ram、磁碟或者光盘等各种可以存储程序代码的介质。

100.虽然以上描述了本技术的具体实施方式,但是本领域的技术人员应当理解,这些仅是举例说明,本技术的保护范围是由所附权利要求书限定的。本领域的技术人员在不背离本技术的原理和实质的前提下,可以对这些实施方式做出多种变更或修改,但这些变更和修改均落入本技术的保护范围。尽管已描述了本技术的优选实施例,但本领域内的技术人员一旦得知了基本创造性概念,则可对这些实施例做出另外的变更和修改。所以,所附权利要求意欲解释为包括优选实施例以及落入本技术范围的所有变更和修改。

101.显然,本领域的技术人员可以对本技术进行各种改动和变型而不脱离本技术的范围。这样,倘若本技术的这些修改和变型属于本技术权利要求及其等同技术的范围之内,则本技术也意图包含这些改动和变型在内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1