一种基于轻量型IRN的图像超分辨率重建方法

一种基于轻量型irn的图像超分辨率重建方法

技术领域

1.本发明属于图像处理技术领域,具体地涉及一种基于轻量型irn 的图像超分辨率重建方法。

背景技术:

2.单幅图像超分辨率重建(sisr)是对缩小的单幅低分辨率(lr)图 像获取放大或者原尺寸的高分辨率(hr)图像。由于lr图像缺失许多 图像细节,在重建超分辨率(sr)图像时产生不适定性。因此改善不 适定性问题是sisr的研究重点及挑战。

3.2014年,dong等人首次应用卷积神经网络在图像超分辨率任务 上,提出srcnn算法,该算法通过对图像块特征提取、非线性映射 和重构三步骤重建图像,奠定了卷积神经网络应用于图像超分辨率 的基础。

4.自srcnn提出后,很多学者聚焦基于深度学习的超分辨率任 务,不断提出新的优化算法提高重建图像性能。肖进胜等人调整卷 积核大小和加入池化层改进srcnn算法,降低了算法的参数量和计 算复杂度。龚兰兰等人在srcnn的基础上,增加特征提取层数,采 用adadelta和sgd方法优化网络参数,加快了模型的训练速度。kim 等人先后引入残差结构和递归神经网络,分别提出了vdsr和drcn算 法,进一步加深了网络结构,扩展网络感受野,缓解深层网络梯度 消失或爆炸问题。受到生成对抗网络的启发,ledig等人在超分辨率 重建问题引入生成对抗网络提出了srgan,提出损失函数对抗损失和 内容损失,得到重建纹理更逼真的重建图像。受可逆网络的启发, xiao等人提出irn算法,该算法统一建模图像缩小和放大任务,捕 捉并嵌入丢失的高频信息,兼容了图像降尺度操作,获取重建视觉 质量好的图像。

5.但是,在实验中发现irn模型的潜在变量无法保存lr图像的高 频信息,导致嵌入的高频信息效果一般,影响模型重建sr图像的性 能。

6.经本文对irn模型的组件研究,从两个部分改进irn,首先,用 小波域高频子带插值改进模型的潜在变量,能保存并处理lr图像边 缘值,增强嵌入高频信息能力。其次,本文使用注意力机制和扩展 卷积设计特征提取块,降低模型的参数量并且提高训练时对图像细 节的注意力。

技术实现要素:

7.本发明的目的是针对目前irn模型的潜在变量无法保存lr图像 的高频信息,导致嵌入的高频信息效果一般,影响模型重建sr图像 的性能的问题,提供一种基于轻量型irn的图像超分辨率重建方法, 从两个部分改进irn,首先,用小波域高频子带插值改进模型的潜在 变量,能保存并处理lr图像边缘值,增强嵌入高频信息能力。其次, 本发明使用注意力机制和扩展卷积设计特征提取块,降低模型的参数 量并且提高了训练时对图像细节的注意力。

8.为了实现上述目的,本发明所采用的技术方案如下:

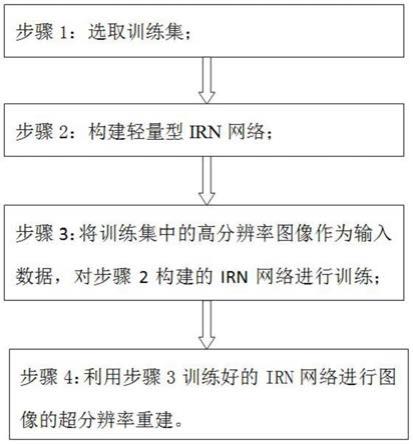

9.一种基于轻量型irn的图像超分辨率重建方法,包括以下步骤:

10.步骤1:选取训练集;

11.步骤2:构建轻量型irn网络;

12.步骤3:将训练集中的高分辨率图像作为输入数据,对步骤2构 建的irn网络进行训练;

13.步骤4:利用步骤3训练好的irn网络进行图像的超分辨率重建。

14.优选地,所述步骤1中,选取训练集的具体操作为:使用div2k 数据集作训练集,div2k数据集一共有800张高分辨率图像和对应 的双三次插值采样的低分辨率图像,对div2k训练集图像进行随机 平移、翻转、裁剪操作,扩充训练集至32593张,并且统一为480

×

480 像素的图像,作为最终的训练集,训练集中的高分辨率图像样本 {p

h1

,p

h2

,

…

p

hi

,

…

,p

hn

}作为网络的前向过程输入数据,将低分辨率图 像样本{p

l1

,p

l2

,

…

p

li

,

…

,p

ln

}作为网络计算前向误差函数的数据。

15.优选地,所述步骤2构建irn网络的具体操包括:

16.步骤2.1:一个小波变换和8个相同的可逆构建块堆叠组成一个 降尺度模块;

17.步骤2.2:步骤2.1中的两个降尺度模块组成轻量型irn网络, 训练集中的高分辨率图像样本{p

h1

,p

h2

,

…

p

hi

,

…

p

hn

}作为第一个降尺 度模块的输入,第一个降尺度模块输出的降尺度低分辨率特征图像集 作为第二个降尺度模块的输入,第二个降尺度模块输出低分辨率图像 集{y

o1

,y

o2

,

…

,y

on

}。

18.优选地,所述步骤2.1的具体操作包括:

19.步骤2.1.1:小波变换作为降尺度模块第一层,将训练集的高分 辨率图像样本p

hi

进行分解:

[0020][0021]

其中,ll:低频分量,hh:水平低频垂直高频分量,hl:水平 高频垂直低频hl,hh:对角方向高频分量;h和g分别为一维尺 度函数和一维小波函数对应的滤波器系数矩阵,且hh*+gg*=i,上 标符号*表示矩阵的共轭转置,将分量ll、lh、hl、hh按公式(2) 拼接成一个张量x:

[0022]

x=f

cat

((ll,lh,hl,hh),1)

ꢀꢀ

(2)

[0023]

其中,f

cat

表示拼接函数,函数中的1代表在1维进行拼接;

[0024]

步骤2.1.2:将张量x输入第一个可逆构建块,可逆构建块的操 作公式由(3)和(4)表示:

[0025]

[0026][0027]

其中,公式(3)是可逆构建块的前向计算过程,公式(4)是可逆构 建块的逆向计算过程;k1和k2代表可逆构建块内部耦合计算公式,k 表示可逆构建块输出,exp代表以自然常数e为底的指数函数,x[:,:3] 表示张量x的前3维数据,x[:,3:]表示张量x的后3维数据,

⊙

表示 张量间的乘,表示张量间的除,φ、η表示特征提取网络,且φ、 η是相同的;

[0028]

步骤2.1.3:将第一个可逆构建块的输出作为第二个构建块的输 入,依此类推,堆叠8个可逆构建块,进而组成一个降尺度模块。

[0029]

优选地,所述步骤2.1.2的特征提取网络具体操作包括:

[0030]

步骤2.1.2.1:将输入的张量x经过3个密集连接的卷积层,密集 连接的每一层都接受前面所有层的特征作为输入,卷积层的操作由公 式(5)和(6)表示:

[0031]

f1=σ(w

c(1)

*x+b1)

ꢀꢀ

(5)

[0032]fi

=σ(w

c(i)

*f

i-1

+bi)

ꢀꢀ

(6)

[0033]

f1表示第一个卷积层的输出,fi表示第i个卷积层的输出,f

i-1

表示第i-1个卷积层的输出,上一层的输出作为下一层的输入,w

c(1)

代表第一个卷积层的权重,w

c(i)

代表第i个卷积层的权重,卷积权重 对应的是一个数量为n,大小为3

×

3的滤波器组,*代表卷积操作, b1代表第一层的偏置,bi代表第i层的偏置,σ代表leakyrelu激活 函数;

[0034]

步骤2.1.2.2:将步骤2.1.2.1的输出数据输入注意力机制,操作 为:数据fi分别输入一个平均池化层和最大池化层,平均池化层和 最大池化层的操作与卷积层操作一样,池化层的参数不进行更新,如 公式(5)操作,平均池化层和最大池化层的输入再经过2个卷积层和 激活层,操作如公式(5)(6)所示,上一层的输出作为下一层的输入;

[0035]

步骤2.1.2.3:将平均池化层和最大池化层两边通道的输出由公式 (2)拼接成一个张量,张量再与步骤2.1.2.1的输入数据相加,作为特 征提取网络的输出。

[0036]

优选地,所述步骤3具体操作包括:

[0037]

步骤3.1:前向训练:步骤2得到低分辨率图像yo和训练集中的 低分辨率图像p

l

由公式(7)计算前向误差l

forw

:

[0038][0039]

其中:l

forw

代表前向误差,h和w分别代表图像的高和宽,i、j 分别代表图像的像素点坐标;

[0040]

步骤3.2:低分辨率图像yo由双线性插值上采样2倍得到图像y

′o, 双线性插值上采样操作由公式(8)表示:

[0041]

[0042]

f(x,y)代表未知点在(x,y)坐标的值,q

11

(x1,y1)、q

12

(x1,y2)、q

21

(x2,y1)、 q

22

(x2,y2)代表图像yo已知的四个像素坐标,x和y表示未知像素点坐 标,f(q

11

)、f(q

12

)、f(q

21

)、f(q

22

)代表像素坐标的像素值;

[0043]

图像y

′o由公式(1)分解成低频分量ll、水平低频垂直高频分量 hh、水平高频垂直低频hl和对角方向高频分量hh,低频分量ll 和图像y

′o由公式计算修正系数α:

[0044]

α=yo′

/ll

ꢀꢀ

(9)

[0045]

利用修正系数α和公式(10)修正lh、hl、hh分量:

[0046][0047]

将修正后的lh

′

、hl

′

、hh

′

分量和ll分量小波逆变换得到低分 辨率图像y

″o,操作如公式(11)所示:

[0048]y″o=h

*

(ll)h+g

*

(lh

′

)g+g

*

(hl

′

)g+g

*

(hh

′

)g

ꢀꢀꢀ

(11)

[0049]

步骤3.3:逆向训练:将低分辨率图像y

″o逆向输入轻量型irn 网络,得到高分辨率图像x

sr

,高分辨率图像x

sr

和步骤3.1前向训练 的输入图像ph由公式(12)计算逆向误差l

recon

:

[0050][0051]

l

recon

代表逆向误差,h和w分别代表图像的高和宽,i、j分别代 表图像的像素点坐标;

[0052]

步骤3.4:根据步骤3.1计算的前向误差l

forw

和步骤3.3计算的逆 向误差l

recon

,计算总误差l

total

:

[0053]

l

total

=l

forw

+l

recon

,

[0054]

再利用adam梯度下降法和网络的反向传播来最小化总误差 l

total

,调整网络权重,网络权重的更新过程为:

[0055][0056][0057]

δk代表上一次的权重更新值,l代表层数,k代表网络的迭代次 数,β代表学习率,代表第l层的第k次迭代时的权重,代表 对误差函数中相应的权重求偏导。

[0058]

优选地,所述步骤4具体操作包括:将需要超分辨率重建的图像 p

l

,作为输入图像,输入轻量型irn网络,逆向输出得到超分辨率图 像ps。

[0059]

与现有技术相比,本发明的有益效果是:

[0060]

(1)本发明用小波域高频子带插值改进模型的潜在变量,能保 存并处理lr图像边缘值,增强嵌入高频信息能力。

[0061]

(2)本发明使用注意力机制和扩展卷积设计特征提取块,降低 模型的参数量并且提高了训练时对图像细节的注意力。

附图说明

[0062]

附图用来提供对本发明的进一步理解,并且构成说明书的一部 分,与本发明的实施例一起用于解释本发明,并不构成对本发明的限 制。

[0063]

在附图中:

[0064]

图1为本发明的方法流程图;

[0065]

图2为轻量型irn模型的框图;

[0066]

图3为特征提取网络结构图;

[0067]

图4为模型潜在变量图;

[0068]

图5为鲣鸟对比结果图:(a)srcnn方法,(b)srgan方法, (c)edsr方法,(d)irn方法,(e)本发明方法,(f)真实图像;

[0069]

图6为建筑对比结果图:(a)srcnn方法,(b)srgan方法, (c)edsr方法,(d)irn方法,(e)本发明方法,(f)真实图像;

[0070]

图7为人脸对比结果图:(a)srcnn方法,(b)srgan方法, (c)edsr方法,(d)irn方法,(e)本发明方法,(f)真实图像。

具体实施方式

[0071]

以下结合附图对本发明的优选实施例进行说明,应当理解,此处 所描述的优选实施例仅用于说明和解释本发明,并不用于限定本发 明。

[0072]

实施例:

[0073]

参照附图1-7所示,一种基于轻量型irn的图像超分辨率重建方 法,其特征在于:包括以下步骤:

[0074]

步骤1:选取训练集,具体操作为:使用div2k数据集作训练集, div2k数据集一共有800张高分辨率图像和对应的双三次插值采样的 低分辨率图像,对div2k训练集图像进行随机平移、翻转、裁剪操作, 扩充训练集至32593张,并且统一为480

×

480像素的图像,作为最终的 训练集,训练集中的高分辨率图像样本{p

h1

,p

h2

,

…

p

hi

,

…

,p

hn

}作为网络 的前向过程输入数据,将低分辨率图像样本{p

l1

,p

l2

,

…

p

li

,

…

,p

ln

}作为 网络计算前向误差函数的数据。

[0075]

步骤2:构建轻量型irn网络;

[0076]

步骤2.1:一个小波变换和8个相同的可逆构建块堆叠组成一个 降尺度模块;

[0077]

步骤2.1.1:小波变换作为降尺度模块第一层,将训练集的高分辨 率图像样本p

hi

进行分解:

[0078]

[0079]

其中,ll:低频分量,hh:水平低频垂直高频分量,hl:水平 高频垂直低频hl,hh:对角方向高频分量;h和g分别为一维尺 度函数和一维小波函数对应的滤波器系数矩阵,且hh*+gg*=i,上 标符号*表示矩阵的共轭转置,将分量ll、lh、hl、hh按公式(2) 拼接成一个张量x:

[0080]

x=f

cat

((ll,lh,hl,hh),1)

ꢀꢀꢀꢀꢀ

(2)

[0081]

其中,f

cat

表示拼接函数,函数中的1代表在1维进行拼接;

[0082]

步骤2.1.2:将张量x输入第一个可逆构建块,可逆构建块的操 作公式由(3)和(4)表示:

[0083][0084][0085]

其中,公式(3)是可逆构建块的前向计算过程,公式(4)是可逆构 建块的逆向计算过程;k1和k2代表可逆构建块内部耦合计算公式,k 表示可逆构建块输出,exp代表以自然常数e为底的指数函数,x[:,:3] 表示张量x的前3维数据,x[:,3:]表示张量x的后3维数据,

⊙

表示 张量间的乘,表示张量间的除,φ、η表示特征提取网络,且φ、 η是相同的;

[0086]

如图3特征提取网络结构图所示,所述步骤2.1.2的特征提取网 络具体操作包括:

[0087]

步骤2.1.2.1:将输入的张量x经过3个密集连接的卷积层,密集 连接的每一层都接受前面所有层的特征作为输入,卷积层的操作由公 式(5)和(6)表示:

[0088]

f1=σ(w

c(1)

*x+b1)

ꢀꢀ

(5)

[0089]fi

=σ(w

c(i)

*f

i-1

+bi)

ꢀꢀ

(6)

[0090]

f1表示第一个卷积层的输出,fi表示第i个卷积层的输出,f

i-1

表示第i-1个卷积层的输出,上一层的输出作为下一层的输入,w

c(1)

代表第一个卷积层的权重,w

c(i)

代表第i个卷积层的权重,卷积权重 对应的是一个数量为n,大小为3

×

3的滤波器组,*代表卷积操作, b1代表第一层的偏置,bi代表第i层的偏置,σ代表leakyrelu激活 函数,σ(y)=max(0,a)+leak*min(0,a),leak是一个很小的常数。

[0091]

步骤2.1.2.2:将步骤2.1.2.1的输出数据输入注意力机制,操作 为:数据fi分别输入一个平均池化层和最大池化层,平均池化层和 最大池化层的操作与卷积层操作一样,池化层的参数不进行更新,如 公式(5)操作,平均池化层和最大池化层的输入再经过2个卷积层和 激活层,操作如公式(5)(6)所示,上一层的输出作为下一层的输入;

[0092]

步骤2.1.2.3:将平均池化层和最大池化层两边通道的输出由公式 (2)拼接成一个张量,张量再与步骤2.1.2.1的输入数据相加,作为特 征提取网络的输出。

[0093]

步骤2.1.3:将第一个可逆构建块的输出作为第二个构建块的输 入,依此类推,堆叠8个可逆构建块,进而组成一个降尺度模块。

[0094]

步骤2.2:步骤2.1中的两个降尺度模块组成轻量型irn网络, 训练集中的高分辨

率图像样本{p

h1

,p

h2

,

…

p

hi

,

…

p

hn

}作为第一个降尺度 模块的输入,第一个降尺度模块输出的降尺度低分辨率特征图像集作 为第二个降尺度模块的输入,第二个降尺度模块输出低分辨率图像集 {y

o1

,y

o2

,

…

,y

on

}。

[0095]

步骤3:将训练集中的高分辨率图像作为输入数据,对步骤2构 建的irn网络进行训练;

[0096]

步骤3.1:前向训练:步骤2得到低分辨率图像yo和训练集中的 低分辨率图像p

l

由公式(7)计算前向误差l

forw

:

[0097][0098]

其中:l

forw

代表前向误差,h和w分别代表图像的高和宽,i、j 分别代表图像的像素点坐标;

[0099]

步骤3.2:低分辨率图像yo由双线性插值上采样2倍得到图像y

′o, 双线性插值上采样操作由公式(8)表示:

[0100][0101]

f(x,y)代表未知点在(x,y)坐标的值,q

11

(x1,y1)、q

12

(x1,y2)、q

21

(x2,y1)、 q

22

(x2,y2)代表图像yo已知的四个像素坐标,x和y表示未知像素点坐 标,f(q

11

)、f(q

12

)、f(q

21

)、f(q

22

)代表像素坐标的像素值;

[0102]

图像y

′o由公式(1)分解成低频分量ll、水平低频垂直高频分量 hh、水平高频垂直低频hl和对角方向高频分量hh,低频分量ll 和图像y

′o由公式计算修正系数α:

[0103]

α=y

′o/ll

ꢀꢀ

(9)

[0104]

利用修正系数α和公式(10)修正lh、hl、hh分量:

[0105][0106]

将修正后的lh

′

、hl

′

、hh

′

分量和ll分量小波逆变换得到低分 辨率图像y

″o,操作如公式(11)所示:

[0107]y″o=h

*

(ll)h+g

*

(lh

′

)g+g

*

(hl

′

)g+g

*

(hh

′

)g

ꢀꢀ

(11)

[0108]

步骤3.3:逆向训练:将低分辨率图像y

″o逆向输入轻量型irn 网络,得到高分辨率图像x

sr

,高分辨率图像x

sr

和步骤3.1前向训练 的输入图像ph由公式(12)计算逆向误差l

recon

:

[0109][0110]

l

recon

代表逆向误差,h和w分别代表图像的高和宽,i、j分别代 表图像的像素点坐

标;

[0111]

步骤3.4:根据步骤3.1计算的前向误差l

forw

和步骤3.3计算的逆 向误差l

recon

,计算总误差l

total

:

[0112]

l

total

=l

forw

+l

recon

,

[0113]

再利用adam梯度下降法和网络的反向传播来最小化总误差 l

total

,调整网络权重,网络权重的更新过程为:

[0114][0115][0116]

δk代表上一次的权重更新值,l代表层数,k代表网络的迭代次 数,β代表学习率,代表第l层的第k次迭代时的权重,代表 对误差函数中相应的权重求偏导。

[0117]

步骤4:利用步骤3训练好的irn网络进行图像的超分辨率重建, 将需要超分辨率重建的图像p

l

,作为输入图像,输入轻量型irn网 络,逆向输出得到超分辨率图像ps。

[0118]

仿真实验:

[0119]

实验参数设置:

[0120]

实验平台硬件配置为处理器intel i5 10600kf,运行内存8gb, 显卡nvidia geforce rtx2060。实验运行环境为ubuntu18.04,深 度学习框架为pytorch,cuda加速版本cuda toolkit 7.6.5。训练 模型的正向损失函数和反向损失函数分别使用l2、l1,模型总迭代 次数5

×

105,初始学习率2

×

10-4

,迭代次数至[10k、20k,30k,40k] 学习率衰减,衰减率γ=0.5,使用优化器adam更新网络参数至模型 收敛。

[0121]

训练过程:

[0122]

本发明使用div2k数据集作训练集,div2k数据集一共有800 张高分辨率图像。由于div2k训练集过少,并需要保持所有实验训 练数据的一致性,所以本文对div2k训练集图像进行随机平移、翻 转、裁剪操作,扩充训练集至32593张,并且统一为480

×

480像素的 图像,满足训练数据量的需求。本文用广泛使用的基准数据集set5, set14,bsd100,urban100作测试集,用rgb通道上的峰值信噪比 psnr和结构相似性ssim定性评估模型。

[0123]

实验结果及分析:

[0124]

改进的算法与srcnn、srgan、edsr、irn方法作对比实验, 评价本发明算法效果。从主观人眼感受和客观数据评价两方面来评价 重建图像质量。主观人眼感受评价是通过人的视觉观察图像给出评 价,客观数据评价就是通过目前主流图像质量评价指标峰值信噪比 psnr和结构相似性ssim对图像进行评价。本发明还计算了各方法 的模型复杂度,比较模型的性能。

[0125]

各算法的客观评价结果如表1、2所示。从表1和表2的psnr、 ssim对比结果可知,本发明方法与irn方法在各测试集的psnr和 ssim都高于其余方法,本发明方法与irn方法相比,psnr高 0.005db,ssim高0.005。说明本文方法重建图像的失真度最小。

[0126]

表1重建图像psnr对比结果

[0127]

方法set5set14bsd100urban100srcnn28.4325.5125.4322.76srgan30.2324.7524.2122.76edsr30.2226.7626.2324.51irn33.1130.0429.7628.60本文方法32.9930.1229.7728.71

[0128]

表2重建图像ssim对比结果

[0129][0130][0131]

本发明选取部分重建图像做主观观感评价对比,选取都是场 景不同的图像,避免偶然性,如图5,6,7所示。从图5(a)、图 6(a)和图7(a)展示看出srcnn方法的重建图像最模糊,图像边缘信 息少。图5(b)(c)、图6(b)(c)和图7(b)(c)展示看出edsr、srgan 方法有更多的图像纹理细节,其中srgan的视觉效果较好,清晰度 更高。从图5(d)(e)(f)、图6(d)(e)(f)和图7(d)(e)(f)展示 看出,本文方法和irn方法的图像视觉效果最好,效果一样。

[0132]

表3展示了各算法模型的复杂度对比结果,其中本发明方法的模 型的复杂度是最小的,与irn相比,参数量减少1.65k,flops减少 393.19m,模型运行时间减少3ms。

[0133]

表3模型复杂度对比结果

[0134]

方法参数量运行时间flopssrcnn0.810.710.67srgan0.780.670.61edsr0.850.750.70irn0.910.860.86本文方法0.910.870.86

[0135]

以上显示和描述了本发明的基本原理、主要特征和本发明的优 点。本行业的技术人员应该了解,本发明不受上述实施例的限制,上 述实施例和说明书中描述的只是说明本发明的原理,在不脱离本发明 精神和范围的前提下,本发明还会有各种变化和改进,这些变化和改 进都落入要求保护的本发明范围内。本发明要求保护范围由所附的权 利要求书及其等效物界定。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1