一种道路场景车辆和行人的目标检测算法

1.本发明属于目标检测的技术领域,尤其涉及一种道路场景车辆和行人 的目标检测算法。

背景技术:

2.传统的目标检测方法主要分为区域选择、特征提取、分类器三个部分, 这些传统方法是基于底层视觉特征进行检测,因此很难获取复杂图像中的 语义信息。为了更好的提取目标特征信息,hinton在2006年提出了深度学 习,深度学习是人工智能领域的研究重心和最新热点,它被广泛的应用在 目标检测、语义分割、物理分类等方面;近年来,随着深度学习的发展, 神经网络在计算机视觉领域取得突破性进展,卷积神经网络是神经网络的 一种,包括输入层、卷积层、池化层、全连接层和分类器,主要通过权值 共享将网络的层次不断加深,使网络具有更强的解析能力。人工智能和新 一代汽车技术发展已经加快了汽车同互联网之间的紧密联系,自动驾驶和 辅助系统已经成为了目前各大汽车公司研究的研究方向和重要课题,因此, 将卷积神经网络应用到道路场景,对车辆和行人进行目标检测,可以做到 实时性和准确性检测,为解决道路场景中车辆行驶安全问题、发展道路图 像监控系统以及自动驾驶、辅助驾驶等提供了现实指导意义。

3.目标检测由图像处理发展而来,是计算机视觉研究的重点和热点之一。 传统目标检测方法主要分为预处理、窗口滑动、特征提取、特征选择、特 征分类和后处理六个步骤。

4.传统目标检测方法的研究重点是在特征提取(提高目标的表征能力) 和特征分类(提高分类器的精度和速度)上。由此,研究人员提出了多种 形式的特征描述子和分类器:1999年由david lowe提出的sitf是一种局 部特征描述子,其对旋转、尺度缩放、对视角变化、噪声等具有一定的稳 定性;2005由navneet dalal和bill triggs在cvpr上提出的梯度方向直 方图(hog),通过计算和统计图像局部的梯度方向来构成特征;1995年 freund and schapire提出adaboost算法是机器学习方法的一种,通过不断 的对训练集训练不同的弱分类器,再将其集合起来构成一个强分类器筛选 特征;1964年,vapnik和alexey y.chervonenkis提出并建立了支持向量机 (svm),是一种二分类模型,通过使用监督学习的方式对数据进行分类 的线性分类器;2010年由felzenszwalb提出的dpm算法是一种基于部件 的检测方法,对目标的形变具有很强的鲁棒性,它结合了改进后的hog 特征描述子和svm分类器,采用了基于图结构的部件模型策略进行特征 融合和分类。

5.但是,由于传统目标检测方法使用设计的特征,即使运用最好的非线 性分类器进行特征分类,目标检测的准确度也达不到实际需求。2014年, girshick等人提出的r-cnn算法在psacal voc检测数据集上以绝对优 势击败了传统的dpm算法,为目标检测开启了一个新的里程碑。自此, 深度学习算法在目标检测的研究领域里占据了绝对的主导地位,并一直持 续至今。由r-cnn网络改进的fast r-cnn及faster r-cnn开始的二阶段 算法虽然已经实现了端到端训练的完整流程,但是与真正满足实时性需求 仍有相当大的差距。因此,以yolo算法为代表的一阶段检测器便登上了 舞台。这一类算法不再单独设计生成候选区

域的初始阶段,而是在整张图像上一次性完成所有目标的定位与分类。sermanent等人于2013年提出的overfeat是最早的一阶段检测器。虽然它的精度不如同期r-cnn,但其思想很有前瞻性;(1)采用卷积层替代全连接层实现全卷积神经网络,适应不同分辨率的图像作为输入,相当于用卷积来快速实现滑动窗口算法;(2)采用同一个卷积神经网络作为共享的骨架网络,通过更改网络头部分别实现分类、定位和检测任务,这使得overfeat比r-cnn的检测速度快了9倍。2015年,redmon等人提出的yolo算法则真正地实现了实时性目标检测,yolo是一种端到端的算法,没有候选框这一概念,输入一张图片,在检测到前景的同时就回归得到了需要的属性。从实验结果来看,yolo的检测速度能够达到45fps,fastyolo甚至能到155fps,比二阶段检测器快了一个数量级。除此以外,yolo在检测时考虑了更多的背景信息,因此将背景误判为前景的概率比fastr-cnn要低很多。

6.2014年rossb.girshick等人在cnn的基础上设计了r-cnn模型,r-cnn(摒弃了传统的滑动窗口(通过多尺度滑动窗口确定所有可能的目标区域)和人工选取特征的方法如将候选区域算法和卷积神经网络相结合,使得检测速度和精度明显提升。

7.(1)区域推荐(regionproposal)即候选区域:给定一张图片,通过选择性搜索算法产生1000~2000个候选边框,但形状和大小是不相同的,这些框之间是可以互相重叠互相包含的;利用图像中的纹理、边缘、颜色等信息,可以保证在选取较少窗口的情况下保持较高的召回率;

8.(2)特征提取:利用卷积神经网络(cnn)对每一个候选边框提取深层特征;

9.(3)分类:利用线性支持向量机(svm)对卷积神经网络提取的深层特征进行分类;

10.(4)去除重叠:将非极大值抑制方法应用于重叠的候选边框,挑选出支持向量机得分较高的边框(boundingbox)。

11.上述方案的缺点在于:

12.(1)重复计算:重复为每个候选框提取特征是非常耗时的。selectivesearch为每张图像产生大约2000个候选框,那么每张图像需要经过2000次的完整的cnn前向传播得到特征,而且这2000个候选框有很多重叠的部分,造成很多计算都是重复的,这将导致计算量大幅上升,相当耗时;

13.(2)训练占用内存大:对于每一类分类器和回归器,都需要大量的特征作为训练样本;

14.(3)训练过程是多阶段的:首先对卷积神经网络微调训练;然后提取全连接层特征作为svm的输入,训练得到目标检测器;最后训练边框回归器;

15.(4)目标检测速度慢;

16.(5)输入cnn网络的图像大小固定为227*227,在输入网络前需要对候选区域图像进行归一化,容易使物体产生截断或拉伸,会导致输入cnn的信息丢失。

17.fasterr-cnn是在fastr-cnn和r-cnn的基础上进行了改进之后,由shaoqingren在2016年发表。fasterr-cnn将特征提取、候选区域生成、边界框回归、目标分类整合到一个网络模型当中,不仅是网络模型的性能有了进一步提高,还在检测精度和速度方面有一定的提升:

18.(1)特征提取。fasterr-cnn网络首先一组基础的卷积+激活函数+池化层,提取输入图像数据的特征图,该特征图后被用于rpn网络和全连接层。

19.(2)生成选取框。通过rpn网络来生成区域候选框,被卷积后得到 的特征图分别进入两个输出层,其中一层通过softmax函数判断anchor是 否属于某个类别,不属于则被判定为背景;另一层通过bounding bos计算 边界框回归的偏移量,修正anchor的位置获得精确的候选框。

20.(3)目标区域池化。该层收集特征图和候选框的信息,综合这些信息 后提取目标区域的特征,在输入进全连接层判定目标类别。

21.(4)目标分类。该部分利用全连接层对目标区域的特征图进行分类, 同时再利用边界回归框确定最检测框的精确位置。

22.但上述方案的速度慢,计算量复杂,无法达到实时检测目标。

技术实现要素:

23.基于以上现有技术的不足,本发明所解决的技术问题在于提供一种道 路场景车辆和行人的目标检测算法,将卷积神经网络应用到道路场景,对 车辆和行人进行目标检测,可以做到实时性和准确性检测,为解决道路场 景中车辆行驶安全问题、发展道路图像监控系统以及自动驾驶、辅助驾驶 等提供了现实指导意义。

24.为了解决上述技术问题,本发明通过以下技术方案来实现:

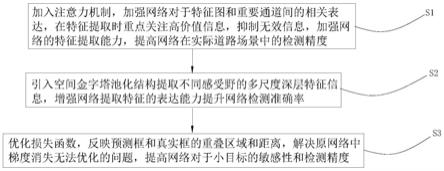

25.本发明提供一种道路场景车辆和行人的目标检测算法,包括以下步骤:

26.步骤1:加入注意力机制,加强网络对于特征图和重要通道间的相关 表达,在特征提取时重点关注高价值信息,抑制无效信息,加强网络的特 征提取能力,提高网络在实际道路场景中的检测精度;

27.步骤2:引入空间金字塔池化结构提取不同感受野的多尺度深层特征 信息,增强网络提取特征的表达能力提升网络检测准确率;

28.步骤3:优化损失函数,反映预测框和真实框的重叠区域和距离,解 决原网络中梯度消失无法优化的问题,提高网络对于小目标的敏感性和检 测精度。

29.进一步的,所述步骤1中的注意力机制为软性注意力。

30.可选的,在步骤2中,所述空间金字塔池化结构用于实现在三种不同的 尺度上对大物体、中物体、小物体分别进行边界框预测。

31.进一步的,步骤3中的损失函数采用giou损失函数。

32.由上,本发明的道路场景车辆和行人的目标检测算法可以实时性的对道 路场景中的车辆和行人进行目标检测,减少计算量,提升检测速度和准确 度,为解决道路场景中车辆行驶安全问题、发展道路图像监控系统以及自 动驾驶、辅助驾驶等提供了现实指导意义。

33.上述说明仅是本发明技术方案的概述,为了能够更清楚了解本发明的 技术手段,而可依照说明书的内容予以实施,并且为了让本发明的上述和 其他目的、特征和优点能够更明显易懂,以下结合优选实施例,并配合附 图,详细说明如下。

附图说明

34.为了更清楚地说明本发明实施例的技术方案,下面将对实施例的附图 作简单地介绍。

35.图1为本发明的道路场景车辆和行人的目标检测算法的流程图。

具体实施方式

36.下面结合附图详细说明本发明的具体实施方式,其作为本说明书的一 部分,通过实施例来说明本发明的原理,本发明的其他方面、特征及其优 点通过该详细说明将会变得一目了然。在所参照的附图中,不同的图中相 同或相似的部件使用相同的附图标号来表示。

37.如图1所示,由于道路场景物体密集复杂信息众多、车辆和行人之间 遮挡严重或重叠等问题导致算法检测精度不高,针对目前存在的检测算法 缺陷,本发明在yolo v3算法的基础上,提出了一种道路场景车辆和行人 的目标检测算法。

38.首先,针对道路场景中物体数量众多信息量大等原因影响网络检测精 度这一问题,本发明在yolo v3网络的基础上加入注意力机制,加强了网 络对于特征图和重要通道间的相关表达,在特征提取时重点关注高价值信 息,抑制无效信息,加强网络的特征提取能力,提高网络在实际道路场景 中的检测精度。

39.其次,由于大部分卷积神经网络在输入图像时要求统一尺寸,导致图 像数据被缩放或剪裁,使图像失真或丢失空间信息;针对此类问题,本发 明引入空间金字塔池化结构提取不同感受野的多尺度深层特征信息,做到 多尺度特征融合、提高尺度不变性,通过增强网络提取特征的表达能力提 升网络检测准确率。

40.本发明优化了损失函数,使用giou损失函数反映预测框和真实框的 重叠区域和距离,解决了原网络中iou=0时梯度消失无法优化的问题,提 高了网络对于小目标的敏感性和检测精度。

41.引入注意力机制

42.卷积神经网络具有强大的拟合数据能力,但是在处理大规模输入数据 的复杂任务时,数据众多会导致计算能力不足,虽然网络中的卷积结构、 池化结构等模块可以简化数据,但是仍然需要进一步操作,使网络模型在 处理复杂任务时也能有良好的表征能力。神经网络类似人脑结构,都存在 相同的问题:当接收的数据量过于庞大时,人脑不会过载处理信息,而是 通过视觉的注意力机制进行处理。注意力机制是指在众多的信息中选择更 为关键的信息而忽略其他信息,深度学习中的注意力机制与人类视觉注意 力机制的原理相同,核心也是利用有效资源从众多信息中筛选出对网络任 务更加有用的高价值信息,抑制其他无用信息。

43.注意力机制分为两种,一种是硬性注意力,这种注意力表现为离散的 位置信息,更加关注输入特征的某一个点,这就导致硬性注意力不能成为 可导的函数,难以在神经网络中进行训练;另一种是软性注意力,这种注 意力表现为作用在相应特征上的通道的权重信息,软性注意力是可导的, 它可以通过神经网络的前向传播和后向反馈来学习通道权重。因此在神经 网络中引入注意力机制时,软性注意力更为合适。

44.空间金字塔池化(spatial pyramid pooling,spp)概念出自sppne主 要用来解决输入图像尺寸不一致的问题。在大部分的目标检测网络中,一 般都会将全连接层作为最后输出层,而全连接层要求输入数据的维度是固 定的,因此卷积神经网络对于输入图片需要固定尺寸,这就要对输入数据 通过剪裁缩放等预处理操作,而这些操作将会导致图像中心

目标被剪裁不 全以及图像失真、几何变形等问题影响网络性能。空间金字塔池化网络结 构从底部到顶部是一个传统的网络架构模型,最底层是输入层,输入任意 尺寸的图像后经过卷积层进行特征提取,在最后一个卷积层输出后得到任 意尺寸的特征图,将提取的特征输入进空间金字塔池化层,spp层会将得 到的特征图分成21(16+4+1)个尺寸统一的特征图,在对21个特征图进 行最大池化操作,通过spp层,特征图被转化成了 16*256+4*265+1*256=21*265的矩阵,最后扩展成一维矩阵1*10752被送 输入进全连接层。

45.yolo v3的算法中包含特征金字塔网络,这种结构实现了在三种不同 的尺度上对大物体、中物体、小物体分别进行边界框预测。每一个网络分 支都会建立一个检测头,用来检测不同尺寸的物体。检测头中的每个网格 都有6个参数,分别是预测4个边界框偏移值,1个目标置信度值和一个 目标类别。本发明在yolo v3网络结构中引入了空间金字塔池化模块,能 够提取不同感受野的多尺度深层特征,并把他们在特征图的通道维度中融 合。本发明在每个分支网络的第五层和第六层之间嵌入spp模块,spp由 3个并行的最大池化层构成,内核大分别为5*5,9*9,13*13。

46.在深度学习目标检测任务中,一般采用损失函数评估网络模型中的预 测值和实际值的误差,损失函数越大表明预测值于实际值相差越远,网络 效果越差,反之损失函数越小,表示模型效果能好,鲁棒性更好。损失函 数决定着网络模型中参数优化的好坏,一般分为分类损失函数和回归损失 函数,前者表示分类的准确性,常见的函数有交叉熵损失函数例如softamx 函数;后者表示对预测框进行回归,缩小预测框和真实框的差别使其更接 近真实框,对于回归损失的优化是改进目标检测任务中误检的有效策略之 一,常见的损失函数为平均绝对误差(mean absolute error,mae)和均 方误差损失函数(mean squared error,mse)。

47.iou作为目标检测最关键的指标之一,可以直接反映预测框 的检测效果,但如果预测框和真实框没有相交,则iou=0,无法 反映两个框的相似程度,并且损失函数没有梯度,网络无法进行 学习训练;并且iou无法精确地反映预测框和真实框重合的角度。

48.本发明在yolo v3的基础上改进回归任务的损失函数,采用giou损 失函数。giou的原理是增加一个能包含主真实框和预测框的最小矩形框, 在两框不相交时,giou的值也不会为0,避免了梯度消失的问题。

49.giou损失函数主要解决了原yolo v3网络在进行边框回归任务时, 损失函数可化程度低的问题。将giou和iou两种损失函数对比发现,当 预测框和真实框不相交时,giou的边界损失值明显大于iou,在[1,2]范围 内会有明显变化,因此采用giou损失函数替代iou,导数梯度变化更大, 优化效果更佳,准确率更高。

[0050]

本发明在yolo v3网络结构的基础上,继续沿用yolo v3的特征提 取网络,在原网络的基础上加入空间金字塔池化模块(spp)和注意力机 制(cbam)。

[0051]

以上所述是本发明的优选实施方式而已,当然不能以此来限定本发明 之权利范围,应当指出,对于本技术领域的普通技术人员来说,在不脱离 本发明原理的前提下,还可以做出若干改进和变动,这些改进和变动也视 为本发明的保护范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1