一种基于多注意力模块的用于密集人群运动追踪的方法与流程

1.本发明属于计算机视觉领域,更具体地涉及一种基于多注意力模块的用于密集人群运动追踪的方法。

背景技术:

2.作为在计算机视觉领域的重要研究方向,密集人群场景下的目标运动追踪问题不仅在学术界是一个很大的挑战,在工业界也是一个具有重要应用价值的方向。针对密集人群运动追踪问题,主要的解决思路是先把一张包含密集人群场景的视频帧输入到用于特征提取的算法模型中,该算法模型也会根据提取到的行人特征,把每个目标个体的位置都检测出来,最后从一段连续的视频序列中识别出每个目标个体的运动轨迹。

3.在过去,很多不同类型的方法都被用于解决密集人群运动追踪问题。其中,一部分模型被用于从视频帧中提取颜色和边界等低级特征,用这样的方法确定目标个体的位置;此外,也有一部分模型被创造出来去获取视频帧中目标个体的语义信息和时序信息等高级特征,进而更好地追踪到目标个体在视频中的运动轨迹。然而,随着实际生活中很多场所的人群密度不断增加,传统的特征提取模型已经不足以在高密度人群中准确追踪目标个体。在这种情况下,深度学习(deep learning)模型由于具有强大的特征提取能力而被使用到密集人群运动追踪的挑战中。但是深度学习模型不仅需要配置高的设备去运行,其运算处理时间也很长。而在实际应用中,用于数据处理的模型都是需要实时对数据进行处理,所以即使深度学习模型在物体检测等任务中能达到很高精度,但它并不适用于密集人群运动追踪的实际应用。

4.现阶段,注意力机制(attention mechanism)由于其有效的特征提取能力而被广泛应用于计算机视觉领域,以此去获取目标特征。

5.在原来用于密集人群运动追踪的模型中,其流程是先使用特征模板作为卷积核与被输入的视频帧进行一次卷积操作,从而生成特征图。接着,该特征图中的某个特定区域会被提取出来与高斯混合模型中的高斯核进行运算,以此计算出目标个体所在的位置。当所有目标个体的位置都被预测后,运动趋势算法则根据连续帧中目标个体的位置去预测其运动轨迹。

6.但是,现阶段主要存在的问题及解决问题的难度是:在特征提取步骤中,仅仅使用特征模板与被输入视频帧进行一次卷积操作不足以获取高质量特征。这种做法很容易出现错误识别的情况,例如某个目标个体的特征没有被提取而这个目标被错误地当成是背景。

7.因此,需要一种具有较高检测准确率的适用于密集人群运动追踪的方法。

技术实现要素:

8.本发明提供了一种基于多注意力模块的用于密集人群运动追踪的方法,可以获得目标个体的精确位置,提高了检测目标个体位置的准确率。

9.本发明的技术方案如下:

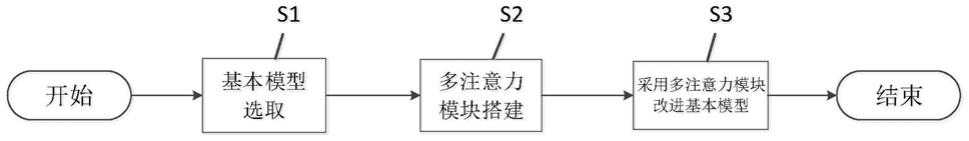

10.一种基于多注意力模块的用于密集人群运动追踪的方法,包括以下步骤:s1.选取基本模型:基本模型包括特征模板和高斯混合模型;s2.搭建多注意力模块;s3.采用多注意力模块改进基本模型。

11.优选的,在上述基于多注意力模块的用于密集人群运动追踪的方法中,在步骤s2中,在多注意力模块中设置两次注意力机制操作:第一次注意力机制操作用于进一步提取目标个体的特征;第二次注意力机制操作用于把输入到多注意力模块的特征图与经优化后的第一次注意力机制操作的特征图相融合。

12.优选的,在上述基于多注意力模块的用于密集人群运动追踪的方法中,在步骤s3中,还包括将已搭建的多注意力模块加入到基本模型的特征提取部分中。

13.优选的,在上述基于多注意力模块的用于密集人群运动追踪的方法中,在步骤s3中,特征模板从被输入的视频帧中获取特征并生成特征图,特征图被输入到上述多注意力模块中进一步完成特征提取及优化任务生成已优化的特征图;多注意力模块所输出的已优化特征图输入到人群运动轨迹预测部分中进行算法处理,输出包含目标个体运动轨迹的结果图。

14.优选的,在上述基于多注意力模块的用于密集人群运动追踪的方法中,多注意力模块所输出的已优化特征图,则被输入到至高斯混合模型中,从而获取包含目标个体位置的高斯分布特征图,该特征图会作为已优化的输出结果从特征提取部分输出并传送至人群运动轨迹预测部分。

15.根据本发明的技术方案,产生的有益效果是:

16.与现有的依赖提取低级特征如颜色或轮廓的传统算法相比较,本发明通过加入多注意力模块去优化经特征模板所提取到的特征,从而产生高质量的注意力特征。该注意力特征能让高斯混合模型更好地检测出目标个体的位置,让运动趋势预测算法更准确预测目标个体的运动轨迹。

17.与现有的通过深度学习模型所搭建成的框架相比较,本发明能以更高速度获取视频帧特征并输出结果。由于深度学习的运算量较大,尽管它在很多识别和检测的任务中能输出高准确度的结果,但其处理数据所花费的时间比较长,不适用于实际场景的应用。然而,本发明处理数据所需的时间较短,因此其更适合应用到实际场景中

18.为了更好地理解和说明本发明的构思、工作原理和发明效果,下面结合附图,通过具体实施例,对本发明进行详细说明如下:

附图说明

19.为了更清楚地说明本发明具体实施方式或现有技术中的技术方案,下面将对具体实施方式或现有技术描述中所需要使用的附图作简单地介绍。

20.图1是本发明的基于多注意力模块的用于密集人群运动追踪的方法的流程图;

21.图2是本发明方法涉及的算法流程图;

22.图3是包含多注意力模块的特征提取部分的流程图;

23.图4是本发明方法涉及的多注意力模块的两次注意力机制操作的示意图。

具体实施方式

24.为使本发明的目的、技术方法及优点更加清晰,下面结合附图及具体实例做进一步的详细说明。这些实例仅仅是说明性的,而并非对本发明的限制。

25.为了把该多注意力模块应用于密集人群运动追踪任务中,本发明在一个结合特征模板、高斯混合模型和运动趋势预测算法的框架模型基础上,在特征提取部分中加入多注意力模块去提高特征模板所提取的特征质量,从而产生高质量特征图。通过把这些高质量特征图输入到高斯混合模型,可以得到密集人群中目标个体的准确位置,而这些准确位置有助于提高运动趋势预测的准确率。通过使用包含多个注意力机制的模块在视频帧中提取更可靠的行人特征。通过这种策略,可以改善特征模板和高斯混合模型等传统方法只能提取低质量特征这个缺点,从而更好地识别密集人群中每个目标的位置,进而完成运动追踪任务。

26.图1是本发明的基于多注意力模块的用于密集人群运动追踪的方法的流程图,如图1所示,包括以下步骤:

27.s1.选取基本模型:基本模型包括特征模板和高斯混合模型。为了能把本发明应用于密集人群的实际场景中,本发明选取了通过特征模板和高斯混合模型完成特征提取任务的密集人群追踪框架为基本模型。此外,选取该模型的另一个原因是其运算量较小,在实际场景中处理数据的响应效率比较高,能达到低延时的效果。

28.s2.搭建多注意力模块。由于注意力机制能在处理视觉数据的过程中提取语义信息等高级特征,所以通过搭建一个能使用注意力机制的多注意力模块,能更有效率地从视觉数据中提取更多高质量的注意力特征。此外,在该多注意力模块中,通过把注意力机制提取的高质量注意力特征与特征模板提取的特征图相结合,能很好保留视觉数据的重要细节信息,更有利于检测目标个体在密集人群中的位置。

29.具体地,在该多注意力模块中,会设置两次注意力机制操作以用于优化特征:第一次注意力机制操作则是用于进一步提取目标个体的特征;第二次注意力机制操作则是把输入到多注意力模块的特征图与经优化后的第一次注意力机制操作的特征图相融合,从而防止原特征图中的重要信息丢失。

30.s3.采用多注意力模块改进基本模型。为了提取高质量特征,已搭建的多注意力模块被加入到基本模型的特征提取部分中。当特征模板从被输入的视频帧中获取特征并生成特征图,该特征图就被输入到多注意力模块中进一步完成特征提取及优化任务。多注意力模块所输出的已优化特征图,则被输入到高斯混合模型去识别目标个体的位置。

31.本发明方法的实现步骤如图2所示。首先,一张包含密集人群场景的视频帧会被输入至本发明框架中的特征提取部分(t1)并生成已优化的特征图;接着,该特征图会被输入到人群运动轨迹预测部分(t2)中追踪目标个体的运动轨迹。在人群运动轨迹预测部分中,所采用的是邻近运动并发算法。经过该算法处理,包含目标个体运动轨迹的结果图就会从框架中输出。在目标个体运动轨迹预测的任务中,目标个体在每一帧被检测出来的位置是否准确非常关键;而目标个体的位置检测准确与否,还是由被提取的特征质量好坏决定。因此,为了能获取更可靠的密集人群特征图,本发明在特征提取部分加入了一个专门用于获取高质量特征图的多注意力模块。

32.图3是包含多注意力模块的特征提取部分的流程图。

33.在特征提取部分中,首先会采用预先设置好的特征模板对被输入的视频帧进行特征提取操作。该部分中的特征模板是从被输入视频帧中提取的区域,然后该区域会作为卷积核与视频帧进行卷积操作,从而把视频帧的特征提取出来。当视频帧的特征被提取后,包含视频帧特征的特征图则被输入到多注意力模块中进行进一步的特征提取。经多注意力模块处理后,包含高质量特征的特征图则会被输入至高斯混合模型中,从而获取包含目标个体位置的高斯分布特征图,该特征图会作为已优化的输出结果从特征提取部分输出并传送至人群运动轨迹预测部分。

34.为了得到已优化的高质量特征图,本发明的多注意力模块采用了两次注意力机制操作,其具体细节如图4中所示。首先特征模板所提取的特征图会被输入至多注意力模块中的第一次注意力机制操作中,该输入特征图定义为f1。在f1中,选出特定区域的特征(选中区域特征)r1;然后r1会作为卷积核与f1进行一次卷积操作(conv),获取更多语义信息和密集人群的共同信息。卷积操作所输出的结果会进行归一化处理,从而生成注意力特征图。该注意力特征图会与特征图f1进行一次特征融合操作从而把f1中的细节特征加入至注意力特征图中。其中,表示加权平均运算。在第一次注意力机制结束后用于特征融合操作的加权平均运算公式可表示为:

35.f2=f1*α1+f

a1

*β136.其中f

a1

表示第一次注意力机制操作输出的注意力特征图,f2表示特征融合操作输出的特征图,α1与β1表示该加权平均运算公式中的系数。

37.经特征融合后得到的特征图f2会与特征图f1在通道维度上进行拼接(concate)操作。其中,原来特征图f1与特征图f2各自的通道数为1,当进行拼接操作后,其拼接后的特征图通道数为2。经拼接操作后得到的特征图会被输入至第二次注意力机制操作中,进一步进行特征提取操作。

38.在第二次注意力机制操作中,首先从特征图f2中选中特定区域的特征(选中区域特征)r2,r2的长和宽跟r1的一样,而且r2在f2中的位置与r1在f1中的位置也是一样的;然后把r1与r2作为卷积核,与f1跟f2拼接后得到的特征图进行卷积操作。其中,f1跟f2与r1跟r2进行的卷积操作公式如下:

39.f

a2

=f1⊙

r1+f2⊙

r240.其中,f

a2

表示从卷积层输出的特征图,

⊙

表示卷积运算。接着,f

a2

则会被进行归一化操作,得到f

a2

′

。f

a2

′

则会作为第二次注意力机制操作所产生的注意力特征图被输出。最后,为了能有效结合注意力特征图的高质量特征与视频帧特征中的细节信息,对f

a2

′

与特征图f1再进行一次特征融合,其公式如下:

41.f3=f1*α2+f

a2

′

*β242.其中f3表示经特征融合后的特征图,α2与β2表示该运算公式中的系数。最后,f3作为已优化的特征图从多注意力模块输出,并传输至高斯混合模型进行目标个体的位置识别。

43.为了能通过注意力机制在密集人群运动追踪问题上高效提取目标个体的特征,本发明将多注意力模块去增强特征提取的效果用于优化从视频帧获取到的特征图,从而让模型从特征图中提取更多语义信息和目标个体的共同信息等高级特征,从而提高检测目标个体位置的准确率,进而获取高质量的目标个体特征,从而更好地检测目标个体的位置、更准

确更高效去预测目标的运动轨迹。在该多注意力模块中,除了提取高级特征,还有效地通过注意力机制把包含高级特征的特征图与最初通过特征模板所提取的特征图融合起来。采用这种策略,既能使特征图包含高级特征,也能保留原特征图中的细节信息。从多注意力模块中输出的优化后的高质量特征图,经高斯混合模型进行运算操作处理后,能更准确识别目标个体在视频帧中的位置。本发明使用的多注意力模块在密集人群数据集的测试中表现出很好的性能,其得到的准确率高于没有增加多注意力模块的框架得到的准确率。

44.为了验证本发明的性能,本发明在广场密集人群场景中的数据集进行测试,加入多注意力模块的框架(本发明框架)得到的结果准确率比没有加入多注意力模块的框架得到的结果准确率高(如表1所示)。

45.表1:消融实验数据:加入多注意力模块的框架(本发明框架)与没有加入多注意力模块的框架进行消融实验得到的数据

[0046] 准确率(%)没有加入多注意力模块的模型77.66加入多注意力模块的模型(本发明模型)79.69

[0047]

以上说明是依据发明的构思和工作原理的最佳实施例。上述实施例不应理解为对本权利要求保护范围的限制,依照本发明构思的其他实施方式和实现方式的组合均属于本发明的保护范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1