一种基于深度学习的零件分拣识别系统和方法

1.本发明涉及计算机视觉和零件分拣领域,尤其涉及一种基于深度学习的零件分拣识别系统和方法。

背景技术:

2.近年来,随着对生产能力需求的大幅提升,工业智能化的进程逐步加快,工业分拣设备的使用也逐渐进入以物流行业为首的各大领域。最传统的分拣采用流水线加人工分拣的方式,该方法是对人力资源极大的消耗,而且难以保证分拣质量的持续性。目前,大部分的分拣设备采用的是基于传感器的分拣方式,通过红外传感器判断物件大小,通过加速度传感器判断物体重量等。该方法往往在识别的对象上有一定局限性,只能识别比较一般的物体。

3.随着人工智能的发展,深度学习的方法也开始被运用到零件分拣的领域中。基于深度学习的零件分拣方法能够处理更加复杂的场景,对零件本身的形状样式没有特殊的需求。

4.在中国发明专利申请“基于fd-densenet网络的工业零件识别分拣方法、介质及系统”(公开号为cn112347863)中,安康等人使用基于fd-densenet的目标检测网络对待分拣零件进行识别。本发明实现了零件识别与生产线分拣一体化,提高了分拣效率,同时是一种轻量化模型,更便于工业设备的配置使用,但是在网络训练过程中需要对体积大小不同的零件进行一个预先的裁剪:放大或者缩小有效区域,图像采集的过程相对复杂。

5.在中国发明专利申请“基于深度学习的小型零件分拣方法及其分拣系统”(公开号为cn112170233a)中,张立国等人使用yolov4目标检测网络对零件对象进行训练识别,能够实现对小型零件的分拣,提升了生产线上可识别的零件类别与样式范围,主要针对不规则的复杂零件实现了一定准确率和速度的分拣,但是该发明针对固定的样本数据进行训练和测试,所满足的识别对象仅限于选取的零件类别,若要针对其他零件进行训练,需要重新制作标注数据集,过程过于繁复。

6.因此,本领域的技术人员致力于开发一种基于深度学习的零件分拣识别系统和方法,解决现有技术方案中存在的数据集获取困难和应用受场景限制的问题。

技术实现要素:

7.有鉴于现有技术的上述缺陷,本发明所要解决的技术问题是如何克服现有技术中存在的深度学习网络模型在实际应用过程中的数据集获取困难、应用受场景限制等缺陷问题。

8.为实现上述目的,本发明提供了一种基于深度学习的零件分拣识别系统与方法,来提高零件分拣目标识别网络的泛化性,其中,深度学习特指无监督域自适应的学习。

9.本发明提供的一种基于深度学习的零件分拣识别系统,包括:

10.训练模块和应用模块,在所述训练模块中建立模型,并将所述模型应用到所述应

用模块中获得识别结果并将所述识别结果输出;

11.其中,所述训练模块包括:

12.合成图像制作模块,所述合成图像制作模块绘制识别目标的三维合成图像,所述三维合成图像包含若干角度;

13.实际图像采集模块,所述实际图像采集模块获取所述识别目标的二维真实场景图像,并将所述二维真实场景图像作为训练集的一部分以及测试集;

14.数据集生成模块,所述数据集生成模块分别与所述合成图像制作模块和所述实际图像采集模块连接,通过机器学习方法对所述三维合成图像进行真值框和类别的标注,再将已标注的所述三维合成图像作为源域,将未标注的真实图像作为目标域,并按设定的比例生成训练集和验证集;

15.深度学习模块,所述深度学习模块与所述数据集生成模块连接,接收所述训练集和所述验证集,并构建深度学习模型,包括目标识别网络和域自适应网络,所述目标识别网络用于特征的提取、对象的分类以及候选框的生成;所述域自适应网络用于对齐所述源域和所述目标域中图像的特征。

16.进一步地,所述应用模块也包括:

17.所述实际图像采集模块和所述深度学习模块,所述实际图像采集模块将重新采集所述识别目标的二维真实场景图像并作为所述深度学习模块中所建立模型的输入,在所述深度学习模块中生成所述识别结果;

18.所述应用模块还包括结果输出模块,所述结果输出模块连接所述深度学习模块,获取所述识别结果以及所述候选框的坐标,并将所述候选框的坐标转换为零件分拣工作台的世界坐标,并输出所述识别目标的类别和位置。

19.进一步地,在构建深度学习模型的过程中,包括构建网络的正向传播和反向传播过程:将输入的所述训练集和所述验证集先通过特征提取层进行特征提取,而后进入分支,一部分继续目标识别网络的训练,另一部分进入域分类器;通过损失函数的反向传播和优化器对权重的更新寻找最优的特征提取器使得在所述域分类器的效果最差的同时所述深度学习模型的自身目标识别的预测结果最优。

20.进一步地,所述按设定的比例生成训练集和验证集的比例为8:2。

21.本发明提供的一种基于深度学习的零件分拣识别方法,所述方法包括以下步骤:

22.步骤1、生成训练数据集;

23.步骤2、训练深度学习模型;

24.步骤3、测试所述步骤2中建立的所述深度学习模型;

25.步骤4、将实际场景获取的识别对象的实时图像输入所述深度学习模型获得识别结果,将所述识别对象基于像素的位置信息转换为基于分拣工作台的世界坐标,并输出最终的分类结果及位置信息。

26.进一步地,所述步骤1包括以下子步骤:

27.步骤1.1、获取图像,包括获取所述识别对象的三维模型并截取多个角度的二维单目标图像,通过单目相机捕获不少于一千张零件分拣图像;

28.步骤1.2、图像标注,包括对所述零件分拣图像进行候选框标注,使用canny算子进行轮廓提取,并通过最小外接矩形框定对象位置,再按照pascal voc的数据集标注格式输

出为xml标签文件,获得带标签的合成图像;

29.步骤1.3、将所述带标签的合成图像作为源域部分,未标记的所述零件分拣图像作为目标域部分,各自按照8:2的比例分为训练集和验证集并随机打乱顺序,生成所述训练数据集。

30.进一步地,所述步骤2包括以下子步骤:

31.步骤2.1、将在imagenet上预训练的resnet50权重作为所述深度学习模型的初始权重,并设置超参数初始值;

32.步骤2.2、构建整体网络架构,以faster-rcnn作为目标识别网络,其中,resnet50为骨干网络,包括特征提取部分以及分类及候选框回归部分;以基于对抗思想的梯度反转层作为域自适应实现模块,包括域分类器部分;

33.步骤2.3、构建正向传播过程,将所述训练数据集送入所述深度学习模型,通过特征提取器获取一副特征图,将获取的所述特征图送入所述分类及候选框回归部分进行目标识别,同时送入所述域分类器部分判断所述特征图是来自所述源域部分还是来自所述目标域部分;

34.步骤2.4、构建反向传播过程,计算所述目标识别网络的误差损失,并调用优化器更新权重参数,寻找到一个最优的所述特征提取器以及所述域分类器部分使得所述深度学习模型的误差最小,同时,计算所述域分类器部分的误差损失并调用所述优化器更新权重参数,寻找一个所述域分类器部分使得所述域分类器部分的分类误差越小越好,同时将损失通过所述梯度反转层取相反数送入所述特征提取器,寻找一个所述特征提取器使得所述域分类器的误差越大越好;

35.步骤2.5、将整个训练过程进行不少于200次的迭代,获取损失函数最小的所述识别结果,完成所述深度学习模型的训练。

36.进一步地,所述步骤3包括以下子步骤:

37.步骤3.1、加载训练完成的所述深度学习模型的权重及各参数;

38.步骤3.2、使用相机获取零件分拣工作台的实时图像;

39.步骤3.3、对所述实时图像进行预处理,使得所述实时图像满足网络输入需求并将送入所述深度学习模型中进行测试;

40.步骤3.4、获取所述识别结果,包括所述识别对象的所述分类结果和所述位置信息。

41.进一步地,在所述步骤1.1中,通过单目相机捕获的所述零件分拣图像的张数为2000张;所述零件分拣图像是单目标或者多目标。

42.进一步地,在所述步骤2.5中,将整个训练过程进行300次迭代。

43.本发明提供的一种基于深度学习的零件分拣识别系统与方法至少具有以下技术效果:

44.1、现有的基于深度学习的零件分拣技术都是对某一应用场景采集数据集,在特定场景下进行训练和测试,缺乏机动性,而零件本身样式众多,分拣需求多种多样,针对每一种需求和场景都专门制作一个数据集进行训练不切实际。在本发明实施例所提供的技术方案中,直接通过合成图像进行训练,避免了一个网络在不同场景下效果参差不齐的问题;

45.2、本发明实施例所提供的技术方案为无监督学习方法,只需送入现场拍摄的图像

作为测试图像和域对齐的参考图像即可,无需进行二次处理,大大减轻了数据集制作的工作量。

46.以下将结合附图对本发明的构思、具体结构及产生的技术效果作进一步说明,以充分地了解本发明的目的、特征和效果。

附图说明

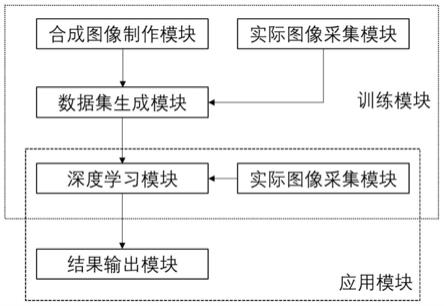

47.图1是本发明的一个较佳实施例的零件分拣识别系统结构图;

48.图2是图1所示实施例中的零件分拣识别方法网络训练流程图。

具体实施方式

49.以下参考说明书附图介绍本发明的多个优选实施例,使其技术内容更加清楚和便于理解。本发明可以通过许多不同形式的实施例来得以体现,本发明的保护范围并非仅限于文中提到的实施例。

50.本发明实施例所要解决的技术问题是如何克服现有技术中存在的深度学习网络模型在实际应用过程中的数据集获取困难、应用受场景限制等缺陷问题。

51.本发明实施例提供的一种基于深度学习的零件分拣识别系统提出使用域自适应的迁移学习方法,将零件的建模图像或其他网络合成图像与实际分拣工作台获取的图像进行特征对齐,使得在合成图像上的训练结果能够应用到实际场景中去。其中,合成图像均为单目标对象,使用机器学习方法进行标注,实际场景测试图像不需要标注,整个训练过程为无监督学习,解决了数据集获取困难的问题,通过输入不同场景的测试图像即可轻松地获取训练完成的网络模型。

52.如图1所示,为本发明提供的一种基于深度学习的零件分拣识别系统,包括:

53.训练模块和应用模块,在训练模块中建立模型,并将模型应用到应用模块中获得识别结果并将识别结果输出;

54.其中,训练模块包括:

55.合成图像制作模块,合成图像制作模块绘制识别目标的三维合成图像,三维合成图像包含若干角度。使用cad等建模软件绘制所需识别零件的三维图像,往往在零件生产前已经实现,获取所需识别零件各个角度的二维合成图像作为训练数据的一部分。

56.实际图像采集模块,实际图像采集模块获取识别目标的二维真实场景图像,并将二维真实场景图像作为训练集的一部分以及测试集。该模块由一个单目相机组成,设置在实际零件分拣工作台位置,获取零件的二维真实场景图像作为训练数据的一部分以及测试数据。

57.数据集生成模块,数据集生成模块分别与合成图像制作模块和实际图像采集模块连接,通过机器学习方法对三维合成图像进行真值框和类别的标注,再将已标注的三维合成图像作为源域,将未标注的真实图像作为目标域,并按设定的比例生成训练集和验证集。按设定的比例生成训练集和验证集的比例为8:2。

58.深度学习模块,深度学习模块与数据集生成模块连接,接收训练集和验证集,并构建深度学习模型,包括目标识别网络和域自适应网络,目标识别网络用于特征的提取、对象的分类以及候选框的生成;域自适应网络用于对齐源域和目标域中图像的特征。

59.其中,应用模块也包括:

60.实际图像采集模块和深度学习模块,实际图像采集模块将重新采集识别目标的二维真实场景图像并作为深度学习模块中所建立模型的输入,在深度学习模块中生成识别结果;

61.应用模块还包括结果输出模块,结果输出模块连接深度学习模块,获取识别结果以及候选框的坐标,并将候选框的坐标转换为零件分拣工作台的世界坐标,并输出识别目标的类别和位置。

62.其中,在构建深度学习模型的过程中,包括构建网络的正向传播和反向传播过程:将输入的训练集和验证集先通过特征提取层进行特征提取,而后进入分支,一部分继续目标识别网络的训练,另一部分进入域分类器;通过损失函数的反向传播和优化器对权重的更新寻找最优的特征提取器使得在域分类器的效果最差的同时深度学习模型的自身目标识别的预测结果最优。

63.如图2所示,为本发明提供的一种基于深度学习的零件分拣识别方法的训练流程图,具体方案为:

64.首先,获取识别对象零件的合成图像以及真实图像并制作成为数据集,随后设计构建整体网络架构,由目标识别网络以及域自适应模块构成,构建网络的正向传播以及反向传播过程,输入数据将先通过特征提取层进行特征提取;而后进入分支,一部分继续目标识别网络的训练,另一部分进入域分类器。通过损失函数的反向传播和优化器对权重的更新;最后,寻找到一个最优的特征提取器使得在域分类器的效果最差的同时自身目标识别的预测结果最优。

65.完成训练之后对实际场景获取的实时图像进行测试预测,获得识别结果之后将候选框像素位置信息转化为分拣工作台世界坐标后输出最终的分类结果及位置信息。

66.具体来说,本发明提供的一种基于深度学习的零件分拣识别方法包括以下步骤:

67.步骤1、生成训练数据集;

68.步骤2、训练深度学习模型;

69.步骤3、测试步骤2中建立的深度学习模型;

70.步骤4、将实际场景获取的识别对象的实时图像输入深度学习模型获得识别结果,将识别对象基于像素的位置信息转换为基于分拣工作台的世界坐标,并输出最终的分类结果及位置信息。

71.其中,步骤1包括以下子步骤:

72.步骤1.1、获取图像,包括获取识别对象的三维模型并截取多个角度的二维单目标图像,通过单目相机捕获不少于一千张零件分拣图像;特别的,通过单目相机捕获的零件分拣图像的张数为2000张;零件分拣图像是单目标或者多目标;

73.步骤1.2、图像标注,包括对零件分拣图像进行候选框标注,使用canny算子进行轮廓提取,并通过最小外接矩形框定对象位置,再按照pascal voc的数据集标注格式输出为xml标签文件,获得带标签的合成图像;

74.步骤1.3、将带标签的合成图像作为源域部分,未标记的零件分拣图像作为目标域部分,各自按照8:2的比例分为训练集和验证集并随机打乱顺序,生成训练数据集。

75.步骤2包括以下子步骤:

76.步骤2.1、将在imagenet上预训练的resnet50权重作为深度学习模型的初始权重,并设置超参数初始值;

77.步骤2.2、构建整体网络架构,以faster-rcnn作为目标识别网络,其中,resnet50为骨干网络,包括特征提取部分以及分类及候选框回归部分;以基于对抗思想的梯度反转层作为域自适应实现模块,包括域分类器部分;

78.步骤2.3、构建正向传播过程,将训练数据集送入深度学习模型,通过特征提取器获取一副特征图,将获取的特征图送入分类及候选框回归部分进行目标识别,同时送入域分类器部分判断特征图是来自源域部分还是来自目标域部分;

79.步骤2.4、构建反向传播过程,计算目标识别网络的误差损失,并调用优化器更新权重参数,寻找到一个最优的特征提取器以及域分类器部分使得深度学习模型的误差最小,同时,计算域分类器部分的误差损失并调用优化器更新权重参数,寻找一个域分类器部分使得域分类器部分的分类误差越小越好,同时将损失通过梯度反转层取相反数送入特征提取器,寻找一个特征提取器使得域分类器的误差越大越好;

80.步骤2.5、将整个训练过程进行不少于200次的迭代,获取损失函数最小的识别结果,完成深度学习模型的训练。特别的,将整个训练过程进行300次迭代。

81.步骤3包括以下子步骤:

82.步骤3.1、加载训练完成的深度学习模型的权重及各参数;

83.步骤3.2、使用相机获取零件分拣工作台的实时图像;

84.步骤3.3、对实时图像进行预处理,使得实时图像满足网络输入需求并将送入深度学习模型中进行测试;

85.步骤3.4、获取识别结果,包括识别对象的分类结果和位置信息。

86.以上详细描述了本发明的较佳具体实施例。应当理解,本领域的普通技术无需创造性劳动就可以根据本发明的构思作出诸多修改和变化。因此,凡本技术领域中技术人员依本发明的构思在现有技术的基础上通过逻辑分析、推理或者有限的实验可以得到的技术方案,皆应在由权利要求书所确定的保护范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1