手势识别装置、移动体、手势识别方法及存储介质与流程

1.本发明涉及手势识别装置、移动体、手势识别方法及存储介质。

背景技术:

2.以往,已知有将用户向期望的场所引导、或输送货物的机器人。例如,公开了在提供上述那样的服务时将与人的距离保持为规定距离而移动的移动机器人(日本专利第5617562号公报)。

技术实现要素:

3.然而,在上述的技术中,存在用户的便利性不充分的情况。

4.本发明是考虑这种情况而完成的,其目的之一在于,提供能够提高用户的便利性的手势识别装置、移动体、手势识别方法及存储介质。

5.用于解决课题的方案

6.本发明的手势识别装置、移动体、手势识别方法及存储介质采用了以下的结构。

7.(1):手势识别装置具备:取得部,其取得用户所拍摄到的图像;以及识别部,其识别在拍摄到所述图像时的所述用户所存在的区域,在拍摄到所述图像时所述用户存在于第一区域的情况下,基于所述图像和用于识别所述用户的手势的第一信息,来识别所述用户的手势,在拍摄到所述图像时所述用户存在于第二区域的情况下,基于所述图像和用于识别所述用户的手势的第二信息,来识别所述用户的手势。

8.(2):在上述(1)的方案中,所述第一区域是距拍摄所述图像的摄像装置规定距离的范围内的区域,所述第二区域是设定在距所述摄像装置比所述规定距离远的位置的区域。

9.(3):在上述(1)或(2)的方案中,所述第一信息是用于识别不包括手臂的运动而基于手或手指的运动的手势的信息。

10.(4):在上述(1)至(3)的任一方案中,所述第二信息是用于识别包括手臂的运动的手势的信息。

11.(5):在上述(4)的方案中,所述第一区域是所述识别部不能从存在于所述第一区域的用户所拍摄到的图像识别所述用户的手臂的运动、或难以识别所述用户的手臂的运动的区域。

12.(6):在上述(1)至(5)的任一方案中,所述识别部在拍摄到所述图像时所述用户存在于跨所述第一区域和所述第一区域外侧的与所述第一区域相邻的第二区域的第三区域、或存在于所述第一区域与比所述第一区域远的第二区域之间的第三区域的情况下,基于所述图像、所述第一信息以及所述第二信息来识别所述用户的手势。

13.(7):在上述(6)的方案中,所述识别部在基于所述图像、所述第一信息以及所述第二信息来识别所述用户的手势的情况下,使基于所述图像和所述第一信息的识别结果优先于基于所述图像和所述第二信息的识别结果,来识别所述用户的手势。

14.(8):移动体具备上述(1)至(7)的任一方案的手势识别装置。

15.(9):在上述(8)的方案中,移动体还具备:存储装置,其存储有将所述用户的手势与所述移动体的动作建立了关联的参照信息;以及控制部,其参照所述参照信息,基于与由所述识别部识别出的所述用户的手势建立了关联的所述移动体的动作,来控制所述移动体。

16.(10):在上述(9)的方案中,移动体具备:第一摄像部,其拍摄移动体的周边;以及第二摄像部,其对以远程的方式操作所述移动体的用户进行拍摄,所述识别部基于由所述第一摄像部拍摄到的第一图像及由所述第二摄像部拍摄到的第二图像来试行对所述用户的手势进行识别的处理,与基于所述第一图像的识别结果相比,优先采用基于所述第二图像的识别结果,所述控制部基于从由所述第一摄像部拍摄到的图像获得的周边的状况和与由所述识别部识别出的手势建立了关联的动作来控制所述移动体。

17.(11):在上述(8)至(10)的任一方案中,移动体具备:第一摄像部,其拍摄移动体的周边;以及第二摄像部,其对以远程的方式操作所述移动体的用户进行拍摄,所述识别部在所述用户存在于第一区域且基于由所述第一摄像部拍摄到的第一图像不能识别所述用户的手势的情况下,参照所述第一信息而基于由所述第二摄像部拍摄到的第二图像来识别所述用户的手势,所述移动体具备根据所述识别部识别出的手势而基于由所述第一摄像部拍摄到的图像来控制所述移动体的控制部。

18.(12):在上述(8)至(11)的任一方案中,所述识别部基于所拍摄到的图像来追踪对象的用户,识别正在追踪的用户的手势,不进行识别未追踪的人物的手势的处理,所述移动体具备基于所述正在追踪的用户的手势来控制所述移动体的控制部。

19.(13):本发明的一方案的手势识别方法使计算机执行如下处理:取得用户所拍摄到的图像;识别在拍摄到所述图像时的所述用户所存在的区域;在拍摄到所述图像时所述用户存在于第一区域的情况下,基于所述图像和用于识别所述用户的手势的第一信息来识别所述用户的手势;以及在拍摄到所述图像时所述用户存在于第二区域的情况下,基于所述图像和用于识别所述用户的手势的第二信息来识别所述用户的手势。

20.(14):本发明的一方案的存储于存储介质的程序使计算机执行如下处理:取得用户所拍摄到的图像;识别在拍摄到所述图像时的所述用户所存在的区域;在拍摄到所述图像时所述用户存在于第一区域的情况下,基于多个所述图像和用于识别所述用户的手势的第一信息来识别所述用户的手势;以及在拍摄到所述图像时所述用户存在于第二区域的情况下,基于所述图像和用于识别所述用户的手势的第二信息来识别所述用户的手势。

21.发明效果

22.根据(1)-(14),识别部根据用户的位置使用第一信息或第二信息来识别手势,由此能够提高用户的便利性。

23.根据(6),手势识别装置通过使用第一信息及第二信息来识别手势,能够更精度良好地识别手势。

24.根据(8)-(11),移动体能够进行反映了用户的意图的动作。例如,用户能够通过简单的指示容易地使移动体动作。

25.根据(10)或(11),由于移动体基于取得用于识别周边的图像的相机和远程操作用的相机所取得的图像来进行与所识别的手势相应的动作,因此能够更精度良好地识别手

势,并且能够进一步地进行与用户的意图相应的动作。

26.根据(12),移动体追踪提供服务的用户,着眼于追踪对象的用户的手势来进行处理,由此能够降低处理负荷,并且能够提高用户的便利性。

附图说明

27.图1是表示具备实施方式的控制装置的移动体的一例的图。

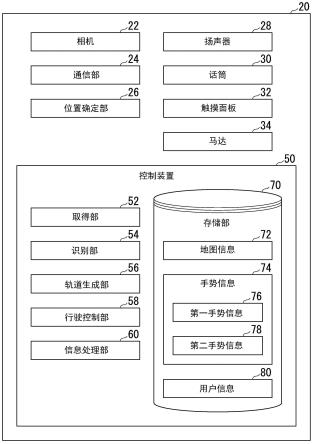

28.图2是表示移动体的主体所包含的功能结构的一例的图。

29.图3是表示轨道的一例的图。

30.图4是表示追踪处理的流程的一例的流程图。

31.图5是用于说明提取用户的特征量的处理及登录特征量的处理的图。

32.图6是用于说明识别部追踪用户的处理的图。

33.图7是用于说明使用了特征量的追踪处理的图。

34.图8是用于说明确定追踪对象的用户的处理的图。

35.图9是用于说明识别部追踪用户的处理的另一例的图。

36.图10是用于说明确定为追踪对象的用户的处理的图。

37.图11是表示行动控制处理的流程的一例的流程图。

38.图12是用于说明识别手势处理的图。

39.图13是表示存在于第一区域的用户的图。

40.图14是表示存在于第二区域的用户的图。

41.图15是用于说明第二手势a的图。

42.图16是用于说明第二手势b的图。

43.图17是用于说明第二手势c的图。

44.图18是用于说明第二手势d的图。

45.图19是用于说明第二手势e的图。

46.图20是用于说明第二手势f的图。

47.图21是用于说明第二手势g的图。

48.图22是用于说明第二手势h的图。

49.图23是用于说明第一手势a的图。

50.图24是用于说明第一手势b的图。

51.图25是用于说明第一手势c的图。

52.图26是用于说明第一手势d的图。

53.图27是用于说明第一手势e的图。

54.图28是用于说明第一手势f的图。

55.图29是用于说明第一手势g的图。

56.图30是表示控制装置识别手势的处理的一例的流程图。

57.图31是表示第三区域的图(其1)。

58.图32是表示第三区域的图(其2)。

59.图33是用于说明第二实施方式的移动体的主体的功能结构的一例的图。

60.图34是表示由第二实施方式的控制装置执行的处理的流程的一例的流程图。

61.图35是用于说明第二手势g的变形例的图。

62.图36是用于说明第二手势h的变形例的图。

63.图37是用于说明第二手势f的变形例的图。

64.图38是用于说明第二手势fr的图。

65.图39是用于说明第二手势fl的图。

具体实施方式

66.以下,参照附图对本发明的实施方式的手势识别装置、移动体、手势识别方法及存储介质进行说明。

67.《第一实施方式》

68.[整体结构]

[0069]

图1是表示具备实施方式的控制装置的移动体10的一例的图。移动体10是自主移动型的机器人。移动体10支援用户的行动。例如,移动体10根据店铺的店员、顾客、设施的职员(以下将这些人物称为“用户”)等的指示,支援顾客的购物或接待,或支援职员的作业。

[0070]

移动体10具备主体20、收容器92、一个以上的车轮94(图中为车轮94a、94b)。移动体10根据基于用户的手势、声音、对移动体10的输入部(后述的触摸面板)的操作、对终端装置(例如智能手机)的操作进行的指示而移动。移动体10例如基于由设置于主体20的相机22所拍摄到的图像来识别手势。

[0071]

例如,移动体10驱动车轮94,配合用户的移动而以跟随顾客的方式进行移动,或以在先引导顾客的方式进行移动。此时,移动体10对用户进行商品、作业的说明,或引导用户所寻找的商品、对象物。用户能够将预定购入的商品、货物收纳在收容它们的收容器92中。

[0072]

在本实施方式中,对移动体10具备收容器92的情况进行了说明,但也可以取而代之(或在此基础上),移动体10为了使用户与移动体10一起移动而设置供就座的就座部、用户乘坐的框体、用户放脚的踏板等。

[0073]

图2是表示移动体10的主体20所包括的功能结构的一例的图。主体20具备相机22、通信部24、位置确定部26、扬声器28、话筒30、触摸面板32、马达34、控制装置50。

[0074]

相机22拍摄移动体10的周边。相机22例如是能够以广角(例如360度)拍摄移动体10的周边的鱼眼相机。相机22例如安装于移动体10的上部,在水平方向上以广角拍摄移动体10的周边。相机22也可以组合多个相机(在水平方向上拍摄120度的范围、60度的范围的多个相机)来实现。相机221不局限于一台,也可以设置于多台移动体10上。

[0075]

通信部24例如是利用蜂窝网、wi-fi网、bluetooth(注册商标)、dsrc(dedicated short range communication)等来与其他装置通信的通信接口。

[0076]

位置确定部26确定移动体10的位置。位置确定部26利用内置于移动体10的gps(global positioning system)装置(未图示)来取得移动体10的位置信息。所谓位置信息,例如可以是二维的地图坐标,也可以是经纬度信息。

[0077]

扬声器28输出例如规定的声音。话筒30接受例如用户发出的声音的输入。

[0078]

触摸面板32由lcd(liquid crystal display)、有机el(electroluminescence)等显示部、以及能够通过坐标检测机构检测操作者的触摸位置的输入部重叠而构成。显示部显示操作用的gui(graphical user interface)开关。输入部在检测到对gui开关的触摸操

作、轻弹操作、滑动操作等时,生成表示进行了对gui开关的触摸操作的操作信号,向控制装置50输出。控制装置50根据操作使扬声器28输出声音,或使触摸面板32显示图像。控制装置50也可以根据操作使移动体10移动。

[0079]

马达34驱动车轮94,使移动体10移动。车轮94例如包括由马达34沿旋转方向驱动的驱动轮、以及沿横摆方向驱动的非驱动轮即转向轮。通过调整转向轮的角度,移动体10能够变更行进路线或自转。

[0080]

在本实施方式中,移动体10具备作为用于实现移动的机构的车轮94,但本实施方式并不限定于该结构。例如,移动体10也可以是多脚行走型的机器人。

[0081]

控制装置50例如具备取得部52、识别部54、轨道生成部56、行驶控制部58、信息处理部60、存储部70。取得部52、识别部54、轨道生成部56、行驶控制部58、信息处理部60的一部分或全部例如通过cpu(central processing unit)等硬件处理器执行程序(软件)来实现。这些功能部的一部分或全部也可以通过lsi(large scale integration)、asic(application specific integrated circuit)、fpga(field-programmable gate array)、gpu(graphics processing unit)等硬件(包括电路部;circuitry)来实现,也可以通过软件与硬件的协同配合来实现。程序可以预先保存于hdd(hard disk drive)、闪存等存储部70(具备非暂时性的存储介质的存储装置),也可以保存于dvd、cd-rom等能够装卸的存储介质(非暂时性的存储介质),通过存储介质装配于驱动器装置而安装。取得部52、识别部54、轨道生成部56、行驶控制部58、或者信息处理部60也可以设置于与控制装置50(移动体10)不同的装置。例如,识别部54也可以设置于其他装置,控制装置50基于其他装置的处理结果来控制移动体10。存储于存储部70的信息的一部分或全部也可以保存于其他装置。取得部52、识别部54、轨道生成部56、行驶控制部58、或信息处理部60中的、包括一个以上的功能部的结构也可以构成为系统。

[0082]

存储部70存储地图信息72、手势信息74、用户信息80。地图信息72例如是通过表示道路、设施内的通路的线路和由线路连接的节点来表现道路、通路的形状的信息。地图信息72也可以包括道路的曲率、poi(point ofinterest)信息等。

[0083]

手势信息74是和手势相关的信息(模板的特征量)与移动体10的动作相互建立了对应关系的信息。手势信息74包括第一手势信息76(第一信息、参照信息)及第二手势信息78(第二信息、参照信息)。用户信息80是表示用户的特征量的信息。关于手势信息74及用户信息80的详细情况,见后述。

[0084]

取得部52取得由相机22拍摄到的图像(以下称为“周边图像”)。取得部52将所取得的周边图像作为鱼眼相机坐标系中的像素数据进行保持。

[0085]

识别部54基于一个以上的周边图像,来识别用户u的身体动作(以下称为“手势”)。识别部54通过将从周边图像提取的用户的手势的特征量与模板的特征量(表示手势的特征量)进行对照,从而识别手势。特征量例如是表示人的手指、手指的关节、手腕、手臂、骨骼等特征部位、连接该特征部位的线路、线路的倾斜或位置等的数据。

[0086]

轨道生成部56基于用户的手势、由用户设定的目的地、周边的物体、用户的位置、地图信息72等来生成移动体10将来应行驶的轨道。轨道生成部56组合多个圆弧,生成移动体10能够顺畅地移动到目标地点的轨道。图3是表示轨道的一例的图。例如,轨道由三个圆弧结合而生成。各个圆弧具有不同的曲率半径r

m1

、r

m2

、r

m3

,分别相对于预测期间t

m1

、t

m2

、t

m3

的终点的位置被定义为z

m1

、z

m2

、z

m3

。相对于预测期间t

m1

的轨道(第一预测期间轨道)例如被三等分,其位置分别是z

m11

、z

m12

、z

m13

。将移动体10在基准地点的行进方向定义为x方向,将与x方向直角地相交的方向定义为y方向。第一切线是相对于z

m1

的切线。在第一切线上,目标地点方向为x’方向,与x’方向直角地相交的方向为y’方向。第一切线与沿x方向延伸的线段所成的角为θ

m1

。沿y方向延伸的线段与沿y’方向延伸的线段的所成的角为θ

m1

。沿y方向延伸的线段与沿y’方向延伸的线段相交的点为第一预测期间轨道的圆弧的中心。第二切线是相对于z

m2

的切线。在第二切线上,目标地点方向为x”方向,与x”方向直角地相交的方向为y”方向。第二切线与沿x方向延伸的线段所成的角为θ

m1

+θ

m2

。沿y方向延伸的线段与沿y”方向延伸的线段所成的角为θ

m2

。沿y方向延伸的线段与沿y”方向延伸的线段相交的点为第二预测期间轨道的圆弧的中心。第三预测期间轨道的圆弧是通过z

m2

和z

m3

的圆弧。该圆弧的中心角为θ3。轨道生成部56例如也可以通过对贝济埃曲线等几何模型拟合状态来计算。轨道例如实际上作为有限个轨道点的集合而生成。

[0087]

轨道生成部56在正交坐标系与鱼眼相机坐标系之间进行坐标变换。在正交坐标系与鱼眼相机坐标系之间,在坐标间成立一对一的关系,该关系作为对应信息而存储于存储部70中。轨道生成部56生成正交坐标系中的轨道(正交坐标系轨道),将该轨道坐标变换为鱼眼相机坐标系中的轨道(鱼眼相机坐标系轨道)。轨道生成部56计算鱼眼相机坐标系轨道的风险。风险是表示移动体10接近障碍物的可能性的大小的指标值。风险具有相对于轨道(轨道的轨道点)与障碍物的距离越小则风险越高,相对于轨道(轨道点)与障碍物的距离越大则风险越低的趋势。

[0088]

轨道生成部56在风险的合计值、各轨道点的风险满足预先设定的基准的情况下(例如合计值为阈值th1以下,且各轨道点的风险为阈值th2以下的情况下),采用满足基准的轨道作为移动体移动的轨道。

[0089]

在上述的轨道不满足预先设定的基准的情况下,也可以进行以下的处理。轨道生成部56在鱼眼相机坐标系中检测能够行驶空间,将检测出的鱼眼相机坐标系中的能够行驶空间坐标变换为正交坐标系中的能够行驶空间。能够行驶空间是指在移动体10移动方向的区域中除去了障碍物及该障碍物的周边的区域(设定了风险的区域或风险为阈值以上的区域)而得到的空间。轨道生成部56以使轨道收纳在坐标变换为正交坐标系的能够行驶空间内的方式修正轨道。轨道生成部56将正交坐标系轨道坐标变换为鱼眼相机坐标系轨道,基于周边图像和鱼眼相机坐标系轨道,计算鱼眼相机坐标系轨道的风险。反复进行该处理,搜索满足上述的预先设定的基准的轨道。

[0090]

行驶控制部58使移动体10沿着满足预先设定的基准的轨道行驶。行驶控制部58向马达34输出用于使移动体10沿着轨道行驶的指令值。马达34根据指令值使车轮94旋转,使移动体10沿着轨道移动。

[0091]

信息处理部60控制主体20所包含的各种装置、设备。信息处理部60例如控制扬声器28、话筒30、触摸面板32。信息处理部60识别输入到话筒30的声音、对触摸面板32进行的操作。信息处理部60基于识别结果使移动体10动作。

[0092]

在上述的例子中,虽然已经说明了识别部54基于由设置于移动体10的相机22拍摄到的图像来识别用户的身体动作,但是识别部54可以基于由未设置于移动体10的相机(设置于与移动体10不同的位置处的相机)所拍摄到的图像来识别用户的身体动作。在该情况

下,由相机拍摄到的图像经由通信向控制装置50发送,控制装置50取得所发送的图像,基于所取得的图像来识别用户的身体动作。识别部54也可以基于多个图像来识别用户的身体动作。例如,识别部54可以基于由相机22拍摄到的图像、由设置于与移动体10不同的位置的相机拍摄到的多个图像来识别用户的身体动作。例如,识别部54也可以从各图像识别用户的身体动作,将识别的结果应用于规定的基准,识别用户的身体动作,或对多个图像进行图像处理而生成一个以上的图像,从生成的图像识别用户意图的身体动作。

[0093]

[支援处理]

[0094]

移动体10执行支援用户的购物的支援处理。支援处理包括与追踪相关的处理和与行动控制相关的处理。

[0095]

[与追踪相关的处理(其1)]

[0096]

图4是表示追踪处理的流程的一例的流程图。首先,移动体10的控制装置50受理用户的登录(步骤s100)。接下来,控制装置50对在步骤s100中登录的用户进行追踪(步骤s102)。接下来,控制装置50判定追踪是否成功(步骤s104)。在追踪成功的情况下,进入后述的图11的步骤s200的处理。在追踪不成功的情况下,控制装置50确定用户(步骤s106)。

[0097]

(登录用户的处理)

[0098]

对步骤s100的用户进行登录的处理进行说明。移动体10的控制装置50基于用户(例如,来到店铺的顾客)的特定的手势、声音、对触摸面板32的操作来确认用户的登录的意愿。在能够确认用户的登录的意愿的情况下,控制装置50的识别部54提取用户的特征量,并登录提取出的特征。

[0099]

图5是用于说明提取用户的特征量的处理及登录特征量的处理的图。控制装置50的识别部54从用户所拍摄到的图像im1确定用户,识别所确定的用户的关节点(执行骨架处理)。例如,识别部54从图像im1中推定用户的面部、面部的部位、颈部、肩部、肘部、手腕、腰、脚踝等,并且基于所推定的各部位的位置,执行骨架处理。例如,识别部54使用公知的方法(例如人体姿态识别等方法)来执行骨架处理,该公知的方法是通过使用深度学习来推定用户的关节点、推定的方法。接下来,识别部54基于骨架处理的结果,来确定用户的面部、上半身、下半身等,并且提取每个所确定的面部、上半身、下半身的特征量,将所提取的特征量作为用户的特征量登录在存储部70中。面部的特征量例如是男性、女性、发型、面部的特征量。上半身的特征量例如是上半身部的颜色。下半身的特征量例如是下半身部的颜色。

[0100]

(追踪用户的处理)

[0101]

对步骤s102的追踪用户的处理进行说明。图6是用于说明识别部54追踪用户的处理(图4的步骤s104的处理)的图。识别部54从在时刻t拍摄到的图像im2检测用户。识别部54从在时刻t+1拍摄到的图像im3中检测该检测到的人物。识别部54基于时刻t及时刻t以前的用户的位置和移动方向,来推定时刻t+1中的用户的位置,并且将存在于所推定的位置附近的用户确定为要追踪的对象(追踪对象)的用户。在能够确定用户的情况下,视为追踪成功。

[0102]

识别部54在追踪处理中,除了如上述那样在时刻t+1中的用户的位置之外,还可以使用用户的特征量来追踪用户。图7是用于说明使用了特征量的追踪处理的图。例如,识别部54推定时刻t+1中的用户的位置,确定存在于所推定的位置附近的用户,并且进一步提取该用户的特征量。控制装置50在所提取的特征量与所登录的特征量在阈值以上吻合的情况下,将所确定的用户推定为追踪对象的用户,判定为追踪成功。

[0103]

例如,即使在追踪对象的用户与其他人物重叠、或交叉的情况下,也如上述那样基于用户的位置的变化和用户的特征量,更精度良好地追踪用户。

[0104]

(确定用户的处理)

[0105]

对确定步骤s106的用户的处理进行说明。识别部54在用户的追踪不成功的情况下,如图8所示,将位于周边的人物的特征量与所登录的用户的特征量进行对照,确定追踪对象的用户。识别部54例如提取图像所包含的各人物的特征量。识别部54将各人物的特征量与所登录的用户的特征量进行对照,确定与所登录的用户的特征量在阈值以上吻合的人物。识别部54将所确定的用户作为追踪对象的用户。

[0106]

通过上述的处理,控制装置50的识别部54能够更精度良好地追踪用户。

[0107]

[与追踪相关的处理(其2)]

[0108]

在上述的例子中,说明了用户是来到店铺的顾客的情况,但在用户是店铺的店员、设施的职员(例如在设施内从事医疗的人等)的情况下,也可以进行以下的处理。

[0109]

(登录用户的处理)

[0110]

步骤s102的登录用户的处理也可以如以下那样进行。图9是用于说明识别部54追踪用户的处理(图4的步骤s102的处理)的另一例的图。识别部54从拍摄到的图像中提取人物的面部部分的特征量。识别部54将所提取的面部部分的特征量与预先登录在用户信息80中的追踪对象的用户的面部部分的特征量进行对照,在它们吻合的情况下,判定为图像所包含的人物是追踪对象的用户。

[0111]

(确定用户的处理)

[0112]

确定步骤s106的用户的处理也可以如以下那样进行。识别部54在用户的追踪不成功的情况下,如图10所示,将位于周边的人物的面部的特征量与所登录的用户的特征量进行对照,将具有特征量在阈值以上吻合的特征量的人物确定为追踪对象的用户。

[0113]

如上述那样,控制装置50的识别部54能够更精度良好地追踪用户。

[0114]

[与行动控制相关的处理]

[0115]

图11是表示行动控制处理的流程的一例的流程图。本处理是在图4的步骤s104的处理后执行的处理。控制装置50识别用户的手势(步骤s200),基于识别出的手势来控制移动体10的行动(步骤s202)。接下来,控制装置50判定是否结束服务(步骤s204)。在未结束服务的情况下,返回图4的步骤s102的处理,继续追踪。在结束服务的情况下,控制装置50消除用户的特征量等与用户相关的所登录的登录信息(步骤s206)。由此,本流程图的一个例程结束。

[0116]

对步骤s200的处理进行说明。图12是用于说明识别手势处理的图。控制装置50从骨架处理而得的结果中提取包括手臂与手中的一方或双方的区域(以下称为对象区域),对所提取的对象区域中的表示手臂与手中的一方或双方的状态的特征量进行提取。控制装置50从手势信息74所包含的特征量确定与表示上述的状态的特征量匹配的特征量。控制装置50使移动体10执行与手势信息74中所确定的特征量建立了关联的移动体10的动作。

[0117]

(识别手势处理)

[0118]

控制装置50基于移动体10与用户之间的相对位置,来决定是参照手势信息74的第一手势信息76,还是参照第二手势信息78。如图13所示,在用户没有与移动体分开规定距离的情况下,换言之,在用户存在于以移动体10为基准设定的第一区域ar1内的情况下,控制

装置50判定用户是否正在进行与第一手势信息76所包含的手势相同的手势。如图14所示,在用户与移动体分开规定距离的情况下,换言之,在用户存在于以移动体10为基准设定的第二区域的情况下(在不存在于第一区域ar1内的情况下),控制装置50判定用户是否正在进行与第二手势信息78所包含的手势相同的手势。

[0119]

第一手势信息76所包含的第一手势是未使用手臂而使用了手的手势,并且第二手势信息78所包含的第二手势是使用了手臂(肘部与手之间的手臂)和手的手势。第一手势是比第二手势小的身体振动、小的手部动作等身体动作即可。小的身体动作是在使移动体10进行某个动作(与直行等相同的动作)的情况下,第一手势的身体动作比第二手势的身体动作小。例如,第一动作也可以是使用了手、手指的手势,第二手势也可以是使用了手臂的手势。例如,第一动作也可以是使用了膝盖以下的腿的手势,第二手势也可以是使用了下半身的手势。例如,第一动作也可以是使用了手、脚等的手势,第二手势也可以是使用了跳跃等整个身体的手势。

[0120]

在移动体10的相机22对存在于第一区域ar1的用户进行拍摄时,如图13所示手臂部分难以收纳于图像中,手、手指收纳于图像中。第一区域ar1是识别部54从存在于第一区域ar1的用户所拍摄到的图像无法识别用户的手臂、或者难以识别用户的手臂的区域。在移动体10的相机22拍摄存在于第二区域ar2的用户时,如图14所示,手臂部分收纳于图像。因此,如上述那样,在用户存在于第一区域ar1的情况下,识别部54通过使用第一手势信息76来识别手势,并且在用户存在于第二区域ar2的情况下,识别部54通过使用第二手势信息78来识别手势,从而能够更精度良好地识别用户的手势。以下,依次对第二手势、第一手势进行说明。

[0121]

[第二手势信息所包含的手势与行动]

[0122]

以下,将用户的正面方向(前方方向)称为x方向,将与正面方向相交的方向称为y方向,将与x方向及y方向相交且与铅垂方向相反的方向称为z方向。以下,使用右臂及右手说明使移动体10运动的手势,但在使用左臂及左手的情况下,同等的运动也是使移动体10运动的手势。

[0123]

(第二手势a)

[0124]

图15是用于说明第二手势a的图。图15的左侧表示手势,图15的右侧表示与手势对应的移动体10的行动(这同样适用于以后的图)。手势例如是由用户p1(店员)做出的,以下进行说明(这同样适用于以后的图)。在图中,p2是顾客。

[0125]

手势a是如下手势:用户将手臂和手从身体附近推出到身体之前,以使位于用户之后的移动体10移动到用户之前。以使手臂和手大致与负y方向平行且拇指朝向正z轴方向的方式使手旋转(图中的a1),在该状态下使肩部或肘部的关节运动而使手向正x方向移动(图中的a2),进而使指尖与正x方向大致平行(图中的a3)。在该状态下,手掌朝向正z方向。然后,在指尖与x方向大致平行的状态下,以手掌朝向负z方向的方式使手及手臂旋转(图中的a4、a5)。在进行了第二手势a的情况下,位于用户p之后的移动体10移动到用户p1之前。

[0126]

(第二手势b)

[0127]

图16是用于说明第二手势b的图。第二手势b是向前方突出手臂和手以使移动体10前进的手势。以在使手掌朝向负z方向伸展手臂和手的状态下与使移动体10移动的方向(例如正x方向)平行的方式使手臂和手突出(图中的b1至b3)。在进行了第二手势b的情况下,移

动体10在由指尖指示的方向上移动。

[0128]

(第二手势c)

[0129]

图17是用于说明第二手势c的图。第二手势c是使向前方突出的手臂和手中,手掌在x方向上正对以使前进的移动体10停止的手势(图中的c1、c2)。在进行了第二手势c的情况下,移动体10从正在前进的状态变为停止状态。

[0130]

(第二手势d)

[0131]

图18是用于说明第二手势d的图。第二手势d是使手臂和手向左方向运动以使移动体10向左方向移动的动作。从使手臂和手向前方突出的状态(图中的d1)开始使手掌向顺时针旋转大致90度,使拇指朝向正z方向(图中的d2),以该状态为起点,反复进行使手臂和手向正y方向摆动,使手臂和手返回起点的动作(图中的d3、d4)。在进行了第二手势d的情况下,移动体10向左方向移动。在手臂和手返回到前述的图中的d1的状态时,移动体10不朝左方向移动而前进。

[0132]

(第二手势e)

[0133]

图19是用于说明第二手势e的图。第二手势e是使手臂和手向右方向运动以使移动体10向右方向移动的动作。从使手臂和手向前方突出的状态(图中的e1)开始,使手掌向逆时针方向旋转,使拇指朝向地面方向(图中的e2),以该状态为起点,反复进行使手臂和手向负y方向摆动,使手臂和手返回起点的动作(图中的e3、e4)。在进行了第二手势e的情况下,移动体10向右方向移动。在手臂和手返回到前述的图中的e1的状态时,移动体10不朝右方向移动而前进。

[0134]

(第二手势f)

[0135]

图20是用于说明第二手势f的图。第二手势f是以使移动体10后退的方式进行招手的动作。反复进行使手掌朝向正z方向(图中的f1),并使手臂或手腕运动以使指尖朝向用户的方向的动作(图中的f2至f5)。在进行了第二手势f的情况下,移动体10后退。

[0136]

(第二手势g)

[0137]

图21是用于说明第二手势g的图。第二手势g是通过使食指(或规定的手指)突出并使向左方向突出的手指旋转以使移动体10向左方向自转的动作。使手掌朝向负z方向(图中的g1),突出食指,使其他手指处于轻轻握住的状态(折弯的状态)(图中的g2),使手腕或手臂运动,使指尖朝向正y方向之后,使手臂和手返回图中g1的状态(图中的g3、g4)。在进行了第二手势g的情况下,移动体10向左方向自转。

[0138]

(第二手势h)

[0139]

图22是用于说明第二手势h的图。第二手势h是用于使食指(或规定的手指)突出并使向右方向突出的手指旋转以使移动体10向右方向自转的动作。使手掌朝向负z方向(图中的h1),突出食指,使其他手指处于轻轻握住的状态(折弯的状态)(图中的h2),使手腕或手臂运动,使指尖朝向负y方向之后,使手臂和手返回图中的h1的状态(图中的h3、h4)。在进行了第二手势h的情况下,移动体10向右方向自转。

[0140]

[第一手势信息所包含的手势]

[0141]

(第一手势a)

[0142]

图23是用于说明第一手势a的图。第一手势a是手向前方突出以使移动体10前进的手势。使拇指朝向正z方向,手背与z方向平行(图中的a)。在进行了第一手势a的情况下,移

动体10在由指尖指示的方向上移动。

[0143]

(第一手势b)

[0144]

图24是用于说明第一手势b的图。第一手势b是用于使手掌在x方向上正对以使正在前进的移动体10停止的手势(图中的b)。在进行了第一手势b的情况下,移动体10从正在前进的状态变为停止状态。

[0145]

(第一手势c)

[0146]

图25是用于说明第一手势c的图。第一手势c是以使移动体10向左方向移动的方式使手向左方向运动的动作。如图23、a所示,以手向前方突出的状态(图中的c1)为起点,反复进行使指尖朝向正y并返回起点的动作(图中的c2、c3)。在进行了第一手势c的情况下,移动体10向左方向移动。

[0147]

(第一手势d)

[0148]

图26是用于说明第一手势d的图。第一手势d是以使移动体10向右方向移动的方式使手向右方向运动的动作。如图23、a所示以手向前方突出的状态(图中的d1)为起点,反复进行使指尖朝向负y,返回起点的动作(图中的d2、d3)。在执行第一手势d的情况下,移动体10向右方向移动。

[0149]

(第一手势e)

[0150]

图27是用于说明第一手势e的图。第一手势e是用指尖进行招手以使移动体10后退的动作。反复使手掌朝向正z方向(图中的e1)并使指尖运动以使指尖朝向用户的方向(使指尖接近手掌)的动作(图中的e2、e3)。在执行第一手势e的情况下,移动体10后退。

[0151]

(第一手势f)

[0152]

图28是用于说明第一手势f的图。第一手势f是如下动作,使食指及拇指(或规定的手指)突出并使向左方向突出的手指旋转,以使移动体10向左方向自转。以使手掌朝向正x方向、食指和拇指突出、其他手指处于轻轻握住的状态(折弯的状态)(图中的f1)、手掌朝向负x方向、且手背朝向正x方向的方式使手旋转(图中的f2)。然后,使旋转的手返回到原来的状态(图中的f3)。在进行了第一手势f的情况下,移动体10向左方向自转。

[0153]

(第一手势g)

[0154]

图29是用于说明第一手势g的图。第一手势g是如下动作,使食指及拇指(或规定的手指)突出并向右方向突出的手指旋转,以使移动体10向右方向自转。使食指和拇指突出,其他手指处于轻轻握住的状态(折弯的状态),使食指朝向正x方向、或正x方向和正y方向的中间方向(图中的g1)。在该状态下,使食指向正z方向、或正z方向与负y方向的中间方向旋转(图中的g2)。然后,将旋转的手返回到原来的状态(图中的g3)。在进行了第一手势g的情况下,移动体10向右方向自转。

[0155]

[流程图]

[0156]

图30是表示控制装置50识别手势处理的一例的流程图。首先,控制装置50判定用户是否存在于第一区域(步骤s300)。在用户存在于第一区域的情况下,控制装置50基于所取得的图像来识别用户的行为(步骤s302)。行为例如是从在时间上连续取得的图像中识别出的用户的运动。

[0157]

接下来,控制装置50通过参照第一手势信息76,确定与在步骤s302中识别出的行为吻合的手势(步骤s304)。当与在步骤s302中识别出的行为吻合的手势未被包括在第一手

势信息76中时,判定为用于控制移动体10的运动的手势未被执行。接下来,控制装置50进行与所确定的手势对应的行动(步骤s306)。

[0158]

在用户不存在于第一区域中的情况下(在存在于第二区域的情况下),控制装置50基于所取得的图像来识别用户的行为(步骤s308),参照第二手势信息78来确定与在步骤s308中识别出的行为吻合的手势(步骤s310)。接下来,控制装置50进行与所确定的手势对应的行动(步骤s312)。由此,本流程图的一个例程的处理结束。

[0159]

例如,在上述处理中,识别部54可以识别正在追踪的用户的手势并且不执行识别未追踪的人物的手势处理。由此,控制装置50能够降低处理负荷地进行基于正在追踪的用户的手势来控制移动体的情况。

[0160]

如上述那样,控制装置50基于用户所存在的区域来切换要识别的手势,从而能够更精度良好地识别用户的手势,并且能够根据用户的意愿来使移动体10工作。其结果为,用户的便利性提高。

[0161]

控制装置50如图31所示可以在第三区域ar3中参照第一手势信息76和第二手势信息78来识别手势。在图31中,第三区域ar3是第一区域ar1的外缘与距第一区域ar1的外侧即外缘规定距离的位置之间的区域。第二区域ar2是第三区域ar3的外侧的区域。

[0162]

在用户存在于第一区域ar1的情况下,识别部54参照第一手势信息76来识别手势。在用户存在于第二区域ar2的情况下,识别部54参照第一手势信息76及第二手势信息78来识别手势。即,识别部54判定用户是否正在进行第一手势信息76所包含的第一手势或第二手势信息78所包含的第二手势。当第三区域ar3中用户正在进行第一手势或第二手势时,控制装置50基于用户与第一手势或第二手势建立了关联的动作来控制移动体10。在用户存在于第二区域ar2的情况下,识别部54参照第二手势信息78来识别手势。

[0163]

第三区域ar3如图32所示也可以是第一区域ar1的外缘与距第一区域ar1的内侧即外缘规定距离的位置之间的区域。第三区域ar3也可以是由从第一区域ar1的外缘距内侧即外缘规定距离的边界和从第一区域ar1的外缘距外侧即外缘规定距离的边界划分的区域(将图31的第三区域ar3与图32的第三区域ar3的组合向成的区域可以是第三区域)。

[0164]

例如,在第三区域ar3中,在识别出第一手势和第二手势这两方的情况下,也可以优先于第二手势采用第一手势。优先是指,例如在第一手势所示的移动体10的动作与第二手势所示的移动体10的动作不同的情况下,优先第一手势的动作、或不考虑第二手势的情况。在用户无意图地使手臂正在运动的情况下,被识别为第二手势,但这是因为利用了手、手指的小的手势是用户无意图地执行的可能性低,而具有进行手势的意图而使手、手指正在运动的可能性高。这样,通过优先第一手势,从而更精度良好地识别用户的意愿。

[0165]

在上述的例子中,说明了识别部54基于连续拍摄到的多个图像(以规定间隔拍摄到的多个图像或动画),来识别用户的身体动作的情况,但也可以取而代之(在此基础上),识别部54基于一个图像,来识别用户的身体动作。在该情况下,识别部54例如将表示一个图像所包含的用户的身体动作的特征量与第一手势信息76或第二手势信息78所包含的特征量进行比较,并且识别出用户正在进行吻合程度高或规定程度以上的特征量的手势。

[0166]

在上述的例子中,在识别部54使用由设置在与移动体10不同的位置的相机(摄像装置)拍摄到的图像来识别用户的身体动作的情况下,第一区域是距拍摄图像的摄像装置规定距离的范围内的区域,第二区域是设定在比距摄像装置规定距离远的位置的区域。

[0167]

在上述的例子中,说明了第二区域是存在于比第一区域远的位置的区域,但也可以取而代之,是设定在与第一区域和第二区域不同的位置的区域。例如,第一区域也可以是设定于第一方向的区域,第二区域也可以是设定在与第一方向不同的方向的区域。

[0168]

根据以上说明的第一实施方式,控制装置50根据用户相对于移动体的位置来切换要识别的手势,从而能够更精度良好地识别用户的手势并使移动体10适当地工作。其结果为,提高了用户的便利性。

[0169]

《第二实施方式》

[0170]

以下,对第二实施方式进行说明。第二实施方式的移动体10的主体20具备第一相机(第一摄像部)和第二相机(第二摄像部),使用由这些的相机拍摄到的图像来识别手势。以下,以与第一实施方式的不同点为中心进行说明。

[0171]

图33是用于说明第二实施方式的移动体10的主体20a的功能结构的一例的图。主体20a具备第一相机21和第二相机23来代替相机22。第一相机21是与相机22相同的相机。第二相机23是对以远程的方式操作移动体10的用户进行拍摄的相机。第二相机23是拍摄用于识别用户的手势的图像的相机。远程操作通过手势进行。第二相机23例如能够通过机械式的机构控制拍摄方向。第二相机23拍摄以追踪对象的用户为中心的图像。信息处理部60例如以使第二相机23的拍摄方向朝向追踪对象的用户的方式控制机械式的机构。

[0172]

识别部54试行基于由第一相机21拍摄到的第一图像及由第二相机23拍摄到的第二图像来识别用户的手势的处理。识别部54使基于第二图像的识别结果(第二识别结果)优先于基于第一图像的识别结果(第一识别结果)。轨道生成部56基于从第一图像获得的周边的状况和与识别出的手势建立了关联的动作来生成轨道。行驶控制部58根据由轨道生成部56生成的轨道来控制移动体10。

[0173]

[流程图]

[0174]

图34是表示由第二实施方式的控制装置50执行的处理流程的一例的流程图。首先,控制装置50的取得部52取得第一图像及第二图像(步骤s400)。接下来,识别部54试行在第一图像及第二图像的每一个中识别手势的处理,并且判定是否能够从两方的图像中识别手势(步骤s402)。在本处理中,在用户存在于第一区域的情况下,参照第一手势信息76,而在用户存在于第一区域外的情况下,参照第二手势信息78。

[0175]

在能够从两方的图像中识别出手势的情况下,识别部54判定识别出的手势是否相同(步骤s404)。在识别出的手势为相同的情况下,识别部54采用识别出的手势(步骤s406)。在识别出的手势不相同的情况下,识别部54采用从第二图像中识别出的手势(步骤s408)。由此,第二识别结果优先于第一识别结果。

[0176]

当在步骤s402的处理中不能从两方的图像中识别手势时,识别部54采用能够识别出的手势(能够从第一图像中识别出的手势或能够从第二图像中识别出的手势)(步骤s406)。例如,在用户存在于第一区域且不能基于由第一相机21拍摄到的第一图像来识别用户的手势的情况下,识别部54参照第一手势信息76并且基于由第二相机23拍摄到的第二图像来识别用户的手势。然后,以进行与采用的手势相应的行动的方式控制移动体10。由此,本流程图的一个例程的处理结束。

[0177]

根据上述的处理,控制装置50能够更精度良好地识别用户的手势。

[0178]

在第二实施方式中,无论用户的位置如何,都可以参照第一手势信息76或第二手

势信息78,或者可以参考不同于第一手势信息76或第二手势信息78(例如不考虑用户的位置)的手势信息(手势的特征量与移动体10的行动建立了关联的信息)。

[0179]

根据以上说明的第二实施方式,控制装置50能够通过使用由两个以上的相机拍摄到的图像来识别手势,从而能够更精度良好地识别手势,并且基于识别出的结果来控制移动体10。其结果为,能够提高用户的便利性。

[0180]

[第二手势的变形例]

[0181]

代替上述的第二手势,第二手势也可以是以下的方式。例如,第二手势例如可以是上臂的手势,而不考虑手掌的运动。由此,即使在远距离执行第二手势,控制装置50也能够精度良好地识别。以下,进行例示,但也可以是与这些不同的方式。

[0182]

(第二手势g)

[0183]

图35是用于说明第二手势g的变形例的图。第二手势g是如下动作,弯曲肘部,将手掌朝向上方向,向左方向旋转上臂,以使移动体10向左方向自转(图中的g#)。在进行了第二手势g的情况下,移动体10向左方向自转。

[0184]

(第二手势h)

[0185]

图36是用于说明第二手势h的变形例的图。第二手势h是如下动作,弯曲肘部,将手掌朝向上方向,向右方向旋转上臂,以使移动体10向右方向自转(图中的h#)。在进行了第二手势h的情况下,移动体10向右方向自转。

[0186]

(第二手势f)

[0187]

图37是用于说明第二手势f的变形例的图。第二手势f是如下动作,弯曲肘部,将手掌朝向上方,以使移动体10后退(图中的f#)。在进行了第二手势f的情况下,移动体10后退。

[0188]

(第二手势fr)

[0189]

图38是用于说明第二手势fr的图。第二手势fr是如下动作,弯曲肘部,将手掌朝向上方,以上臂的右方向的倾斜程度来决定移动体10向右方向移动的移动量,以使移动体10一边向右方向移动一边后退(图中的fr)。在进行了第二手势fr的情况下,移动体10根据上臂的右方向的倾斜程度一边向右方向移动一边后退。

[0190]

图39是用于说明第二手势fl的图。第二手势fl是如下动作,弯曲肘部,将手掌朝向上方,以上臂的左方向的倾斜程度来决定移动体10向左方向移动移动量以使移动体10一边向左方向移动一边后退的动作(图中的fr)。在进行了第二手势fl的情况下,移动体10根据上臂的左方向的倾斜程度一边向左方向移动一边后退。

[0191]

如上述那样,控制装置50基于上臂的第二手势来控制移动体10。例如,即使在存在于远处的人物执行第二手势的情况下,控制装置50也能够更精度良好地识别第二手势,并且能够配合人物的意图来控制移动体10。

[0192]

上述说明的实施方式能够如以下这样表现。

[0193]

一种手势识别装置构成为,具备:

[0194]

存储装置,其存储有程序;以及

[0195]

硬件处理器,

[0196]

通过所述硬件处理器执行存储于所述存储装置的程序而进行如下处理,

[0197]

取得用户所拍摄到的图像;

[0198]

识别在拍摄到所述图像时的所述用户所存在的区域;

[0199]

在拍摄到所述图像时所述用户存在于第一区域的情况下,基于所述图像和用于识别所述用户的手势的第一信息,来识别所述用户的手势,

[0200]

在拍摄到所述图像时所述用户存在于第二区域的情况下,基于在时间上连续拍摄到的多个所述图像和用于识别所述用户的手势的第二信息,来识别所述用户的手势。

[0201]

上述说明的实施方式能够如以下这样表现。

[0202]

所述手势识别装置具备:

[0203]

第一摄像部,其拍摄移动体的周边;

[0204]

第二摄像部,其对以远程的方式操作所述移动体的用户进行拍摄;

[0205]

存储有程序的存储装置;以及

[0206]

硬件处理器,

[0207]

所述硬件处理器通过执行存储于所述存储装置的程序,

[0208]

基于由所述第一摄像部拍摄到的第一图像及由所述第二摄像部拍摄到的第二图像来试行对所述用户的手势进行识别的处理,与基于所述第一图像的识别结果相比,优先采用基于所述第二图像的识别结果,

[0209]

基于从由所述第一摄像部拍摄到的图像获得的周边的状况和与所述识别部识别出的手势建立了关联的动作来控制所述移动体。

[0210]

上述说明的实施方式能够如以下这样表现。

[0211]

手势识别装置具备:

[0212]

第一摄像部,其拍摄移动体的周边;

[0213]

第二摄像部,其对以远程的方式操作所述移动体的用户进行拍摄;

[0214]

存储有程序的存储装置;以及

[0215]

硬件处理器,

[0216]

所述硬件处理器通过执行存储于所述存储装置的程序,

[0217]

基于所述用户存在于第一区域且由所述第一摄像部拍摄到的第一图像而不能识别所述用户的手势的情况下,参照所述第一信息而基于由所述第二摄像部拍摄到的第二图像来识别所述用户的手势,

[0218]

根据识别出的手势而基于由所述第一摄像部拍摄到的图像来控制所述移动体。

[0219]

以上使用实施方式说明了本发明的具体实施方式,但本发明丝毫不被这样的实施方式限定,在不脱离本发明的主旨的范围内能够施加各种变形及替换。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1