数据获取方法、装置、存储介质以及电子设备与流程

1.本公开涉及计算机技术领域,具体地,涉及一种数据获取方法、装置、存储介质以及电子设备。

背景技术:

2.目前gpu(graphics processing unit,图形处理器)资源有限,成本高,直接使用本地安装gpu的设备完成gpu任务,大部分时间gpu都是空闲的,会造成严重的资源浪费,并且为每一台设备本地安装gpu也不太现实。

3.相关技术中,存在将本地gpu任务发送到远程设备的gpu执行,从而通过远程的设备的gpu完成gpu任务的方案,如此,便能够实现在没有gpu的本地设备也完成gpu任务的功能,然而,相关技术中的方案通常需要在编写gpu任务时对代码进行修改。

技术实现要素:

4.提供该发明内容部分以便以简要的形式介绍构思,这些构思将在后面的具体实施方式部分被详细描述。该发明内容部分并不旨在标识要求保护的技术方案的关键特征或必要特征,也不旨在用于限制所要求的保护的技术方案的范围。

5.第一方面,本公开提供一种数据获取方法,应用于第一终端,该方法包括:

6.获取调用所述第一终端自身安装的虚拟gpu的第一调用请求,所述第一调用请求携带第一函数对应的标识;

7.通过所述第一函数对所述第一调用请求进行处理,得到第二调用请求,并通过所述第一函数将所述第二调用请求发送到第二终端,以使所述第二终端根据所述第二调用请求,调用物理gpu的原生函数库中的第二函数,并根据所述第二函数调用自身安装的物理gpu进行处理,得到所述第二调用请求对应的目标数据,所述第一函数为所述第一终端的函数库中与所述第二函数同名的函数;

8.接收所述第二终端返回的所述目标数据。

9.第二方面,本公开提供一种数据获取装置,应用于第一终端,该装置包括:

10.第一调用请求获取模块,用于获取调用所述第一终端自身安装的虚拟gpu的第一调用请求,所述第一调用请求携带第一函数对应的标识;

11.第二调用请求生成模块,用于通过所述第一函数对所述第一调用请求进行处理,得到第二调用请求,并通过所述第一函数将所述第二调用请求发送到第二终端,以使所述第二终端根据所述第二调用请求,调用物理gpu的原生函数库中的第二函数,并根据所述第二函数调用自身安装的物理gpu进行处理,得到所述第二调用请求对应的目标数据,所述第一函数为所述第一终端的函数库中与所述第二函数同名的函数;

12.目标数据接收模块,用于接收所述第二终端返回的所述目标数据。

13.第三方面,本公开提供一种计算机可读存储介质,其上存储有计算机程序,该程序被处理装置执行时实现第一方面所述方法的步骤。

14.第四方面,本公开提供一种电子设备,包括:

15.存储装置,其上存储有至少一个计算机程序;

16.至少一个处理装置,用于执行所述存储装置中的所述至少一个计算机程序,以实现第一方面所述方法的步骤。

17.基于上述技术方案,由于在未安装物理gpu的第一终端获取到第一调用请求时,可以对第一调用请求进行处理得到第二调用请求,然后再通过远程第二终端的物理gpu来对第二调用请求进行处理,并将处理后的目标数据返回给第一终端,实现了在第一终端没有gpu的情况下也能够完成gpu任务的功能,此外,由于在第一终端安装有虚拟gpu,并且虚拟gpu对应的第一终端的函数库中的第一函数与物理gpu的原生函数库中的第二函数同名,使得用户在对gpu任务进行编程时,可以按照第一终端存在物理gpu一样的编程习惯进行编程,避免用户在编写gpu任务时对代码进行修改,使得对用户程序更加透明,也降低用户编程出错的可能性。

18.本公开的其他特征和优点将在随后的具体实施方式部分予以详细说明。

附图说明

19.结合附图并参考以下具体实施方式,本公开各实施例的上述和其他特征、优点及方面将变得更加明显。贯穿附图中,相同或相似的附图标记表示相同或相似的元素。应当理解附图是示意性的,原件和元素不一定按照比例绘制。在附图中:

20.图1是根据一示例性实施例提供的一种应用环境的示意图;

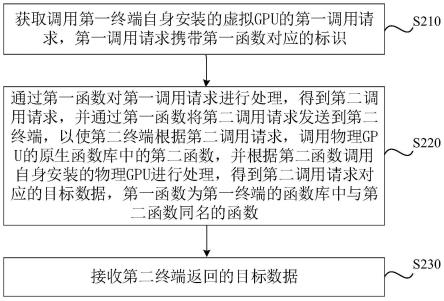

21.图2是根据一示例性实施例提供的一种数据获取方法的流程示意图;

22.图3是根据一示例性实施例提供的另一种应用环境的示意图;

23.图4是根据一示例性实施例提供的一种数据获取装置的模块连接示意图;

24.图5是根据一示例性实施例提供的一种电子设备的结构示意图。

具体实施方式

25.下面将参照附图更详细地描述本公开的实施例。虽然附图中显示了本公开的某些实施例,然而应当理解的是,本公开可以通过各种形式来实现,而且不应该被解释为限于这里阐述的实施例,相反提供这些实施例是为了更加透彻和完整地理解本公开。应当理解的是,本公开的附图及实施例仅用于示例性作用,并非用于限制本公开的保护范围。

26.应当理解,本公开的方法实施方式中记载的各个步骤可以按照不同的顺序执行,和/或并行执行。此外,方法实施方式可以包括附加的步骤和/或省略执行示出的步骤。本公开的范围在此方面不受限制。

27.本文使用的术语“包括”及其变形是开放性包括,即“包括但不限于”。术语“基于”是“至少部分地基于”。术语“一个实施例”表示“至少一个实施例”;术语“另一实施例”表示“至少一个另外的实施例”;术语“一些实施例”表示“至少一些实施例”。其他术语的相关定义将在下文描述中给出。

28.需要注意,本公开中提及的“第一”、“第二”等概念仅用于对不同的装置、模块或单元进行区分,并非用于限定这些装置、模块或单元所执行的功能的顺序或者相互依存关系。

29.需要注意,本公开中提及的“一个”、“多个”的修饰是示意性而非限制性的,本领域

技术人员应当理解,除非在上下文另有明确指出,否则应该理解为“一个或多个”。

30.本公开实施方式中的多个装置之间所交互的消息或者信息的名称仅用于说明性的目的,而并不是用于对这些消息或信息的范围进行限制。

31.相关技术中,存在一些框架,例如tensorflow、pytorch等可以把gpu任务提交到远程机器上执行,然而,这些框架在使用时,用户意识到自己使用的是远程机器上的gpu,在gpu任务编程时需要在gpu任务的代码的基础上额外增加一些代码。其中,gpu任务可以包括开发、调试以及运行gpu程序等,且在执行gpu任务时,调用gpu进行处理。

32.例如,tf需要显示调用tf.config.experimental_connect_to_cluster方法,又例如,torch通常需要用xla编译,并且需要在原本单机能跑通的代码上添加一些代码。比如xm.mark_step()等。

33.由于需要额外增加一些代码,导致整个gpu任务编程过程变得复杂,对用户程序不透明,并且由于不同于传统的在本地安装gpu的设备编程时的编程习惯,因此,增加了用户编程出错的可能性。

34.针对上述技术问题,本公开实施例提供了一种数据获取方法、装置、存储介质以及电子设备。通过在未安装物理gpu的第一终端获取到第一调用请求时,对第一调用请求进行处理得到第二调用请求,然后再通过远程第二终端的物理gpu来对第二调用请求进行处理,并将处理后的目标数据返回给第一终端,实现了在第一终端没有gpu的情况下也能够完成gpu任务的功能,此外,通过在第一终端安装虚拟gpu,并且虚拟gpu对应的第一终端的函数库中的第一函数与物理gpu的原生函数库中的第二函数同名,使得用户在对gpu任务进行编程时,可以按照第一终端存在物理gpu一样的编程习惯进行编程,避免用户在编写gpu任务时对代码进行修改,使得对用户程序更加透明,也降低用户编程出错的可能性。

35.为了便于详细说明本技术方案,下面先结合附图对本技术实施例中的一种应用环境进行介绍。

36.在一些实施方式中,请参阅图1,图1所示为本公开实施例所提供的一种应用环境的示意图。其中,包括有第一终端和第二终端,其中,第一终端和第二终端通过网络连接。第一终端可以将本地的gpu程序对虚拟gpu的调用请求通过虚拟函数库中的第一函数发送到第二终端,以使第二终端调用自身物理gpu的原生函数库中的与第一函数同名的第二函数,并根据第二函数调用自身安装的物理gpu进行处理,从而支持用户在没有gpu设备的机器上开发、调试和运行gpu程序,并且整个过程对用户程序透明,就像gpu设备是在第一终端本地一样。

37.下面将结合附图对本公开实施例提出的一种数据获取方法、装置、存储介质以及电子设备进行详细说明。

38.图2是根据一示例性实施例提供的一种数据获取方法的流程示意图。本公开实施例提供的数据获取方法可以通过图1所示的第一终端执行,具体可以通过数据获取装置来执行,该装置可以有软件和/或硬件的方式实现,配置于图1所示的第一终端中。请参考图2,本公开实施例提供的数据获取方法可以包括以下步骤:

39.s210,获取调用第一终端自身安装的虚拟gpu的第一调用请求,第一调用请求携带第一函数对应的标识。

40.其中,虚拟gpu可以理解为在第一终端本地虚拟出的gpu,与真实的物理gpu不同,

虚拟gpu不能够进行计算。

41.在一些实施方式中,可以创建驱动设备,将驱动设备挂载在/dev/remotegpu路径,该驱动设备可以是linux驱动设备。该驱动设备可以在proc文件系统中创建远程物理gpu的配置信息,比如/proc/driver/bytedance/remotegpu0,/proc/driver/bytedance/remotegpu1。每个文件内保存了远程真实的物理gpu的信息。示例性地,该虚拟gpu设备指向了ip地址是192.0.0.1的远程第二终端上,uuid是gpu-5a0622d3-66c6-4f39-30fd-d31ab6401071的gpu设备,该过程便完成了虚拟gpu的创建,后续第一终端可以通过以太网访问第二终端。

42.可以理解的是,由于调用gpu进行计算是通过调用对应的函数实现的,因此,第一调用请求携带有第一函数对应的标识。

43.其中,第一调用请求可以是第一终端的任一个gpu程序发起的,示例性地,可以是某一个需要调用gpu进行处理的游戏、绘图软件等。

44.s220,通过第一函数对第一调用请求进行处理,得到第二调用请求,并通过第一函数将第二调用请求发送到第二终端,以使第二终端根据第二调用请求,调用物理gpu的原生函数库中的第二函数,并根据第二函数调用自身安装的物理gpu进行处理,得到第二调用请求对应的目标数据,第一函数为第一终端的函数库中与第二函数同名的函数。

45.本公开实施例中,第一终端在获取到第一调用请求之后,可以对第一调用请求进行解析,得到其中包括的第一函数对应的标识,然后便可以根据该标识调用对应的第一函数进行处理,由于第一终端的gpu为虚拟gpu,不能够进行计算,因此,第一函数不会调用虚拟gpu对第一调用请求进行计算,而是对第一调用请求进行重新封装处理,得到第二调用请求,并将第二调用请求发送到第二终端。

46.在一些实施方式中,第一函数执行的功能主要包括两个部分,这两个部分的功能分别可以由对应的子函数完成,例如,第一子函数和第二子函数,其中第一子函数完成对第一调用请求进行重新封装处理的功能,得到第二调用请求,第二子函数完成将第二调用请求发送到第二终端的功能。

47.在将第二调用请求发送到第二终端之后,第二终端便能够根据第二调用请求调用物理gpu的原生函数库中与第一函数同名的第二函数,并根据第二函数调用自身安装的物理gpu进行处理,得到第二调用请求对应的目标数据。

48.可以理解的是,物理gpu的原生函数库可以包括原生cuda函数库以及原生nvidia函数库,本公开实施例中,第一函数所在的函数库可以是自定义的cuda函数库以及自定义nvidia函数库,在调用自定义的cuda函数库以及自定义nvidia函数库之后,不会直接操作物理gpu进行计算。

49.s230,接收第二终端返回的目标数据。

50.本公开实施例中,第二终端在调用自身安装的物理gpu对第二调用请求进行处理,得到目标数据之后,便可以将目标数据返回给第一终端,从而第一终端便能够接收到第二终端返回的目标数据。

51.在一些实施方式中,第一终端在接收到第二终端返回的目标数据之后,可以将目标数据返回给对应的上层应用程序。

52.采用上述方法,由于在未安装物理gpu的第一终端获取到第一调用请求时,可以对

第一调用请求进行处理得到第二调用请求,然后再通过远程第二终端的物理gpu来对第二调用请求进行处理,并将处理后的目标数据返回给第一终端,实现了在第一终端没有gpu的情况下也能够完成gpu任务的功能,此外,由于在第一终端安装有虚拟gpu,并且虚拟gpu对应的第一终端的函数库中的第一函数与物理gpu的原生函数库中的第二函数同名,使得用户在对gpu任务进行编程时,可以按照第一终端存在物理gpu一样的编程习惯进行编程,以避免用户在编写gpu任务时对代码进行修改,对用户程序更加透明,也降低用户编程出错的可能性。

53.可以理解的是,物理gpu在第二终端中对应有显存地址,此外,为了尽可能的减少对编程代码的更改,对用户程序透明,虚拟gpu在第一终端中也可以对应有显存地址,其中,虚拟gpu在第一终端中的显存地址可以是虚拟的。

54.本公开实施例中,相当于是把在第一终端本地执行的gpu任务发送到远程的第二终端进行执行,因此,在第一终端与第二终端中对应的gpu任务是不变的,也就是说,调用请求包括的请求类型是不变的,在一些实施方式中,第一调用请求与第二调用请求均为调用gpu进行计算的计算子请求,此时,第二调用请求具体可以包括用于调用物理gpu进行计算的计算子请求,这种情况下,通过第一函数对第一调用请求进行处理,得到第二调用请求,包括以下步骤:

55.在第二调用请求包括用于调用物理gpu进行计算的计算子请求的情况下,通过第一函数获取第一函数对应的标识、物理gpu的配置信息、计算参数以及目标显存地址;通过第一函数基于第一函数对应的标识、物理gpu的配置信息、计算参数以及目标显存地址,生成计算子请求。

56.由于在第一终端与第二终端中对应完成的gpu功能不变,因此,在生成第二调用请求时,调用的函数是相同的,计算参数也是相同的,此外,由于虚拟gpu的配置信息指向的是真实物理gpu的配置信息,因此,虚拟gpu的配置信息与物理gpu的配置信息是相同的,然而考虑到第一终端中的显存地址与第二终端中的显存地址可能并不是对应的,因此,在生成第二调用请求时,还需要获取到第二终端中的物理gpu进行计算时实际对应的显存地址,即目标显存地址。

57.从而,在本公开实施例中,可以先通过第一函数获取第一函数对应的标识、物理gpu的配置信息、计算参数以及目标显存地址,然后再通过第一函数基于第一函数对应的标识、物理gpu的配置信息、计算参数以及目标显存地址,生成计算子请求。

58.示例性地,第一调用请求与第二调用请求均为调用gpu进行计算的计算子请求时,第一函数可以是culaunchkernel函数。

59.在一些实施方式中,获取目标显存地址,可以包括以下步骤:

60.获取虚拟gpu进行计算时使用的第一终端的原始显存地址;基于第一终端中的显存地址与第二终端中的显存地址之间的映射关系,确定与原始显存地址对应的第二终端中的目标显存地址。

61.本公开实施例中,在第一终端中,可以通过第一函数对第一调用请求进行解析,从而获得第一函数对应的标识、物理gpu的配置信息、计算参数以及虚拟gpu使用的第一终端的原始显存地址,在获取到虚拟gpu进行计算时使用的第一终端的原始显存地址之后,可以基于第一终端中的显存地址与第二终端中的显存地址之间的映射关系,确定与原始显存地

址对应的第二终端中的目标显存地址。

62.此外,在一些实施方式中,第一终端在获取到第一调用请求之后,也可以通过第一函数将第一调用请求直接转发到第二终端,由第二终端对第一调用请求进行解析,得到第一函数对应的标识、物理gpu的配置信息、计算参数以及目标显存地址,并基于第一函数对应的标识、物理gpu的配置信息、计算参数以及目标显存地址,生成计算子请求。这种情况下,上述第一终端中的显存地址与第二终端中的显存地址之间的映射关系还可以存储在第二终端中。

63.在另一些实施方式中,第一调用请求与第二调用请求均为调用gpu对显存进行变更的变更子请求,此时,第二调用请求具体可以包括用于调用物理gpu对显存进行变更的变更子请求,目标数据包括物理gpu对显存进行变更后的第一变更显存地址,这种情况下,获取目标数据之后,本公开实施例的数据获取方法还包括以下步骤:

64.获取虚拟gpu对显存进行变更后的第二变更显存地址,以及第一变更显存地址;基于第一变更显存地址以及第二变更显存地址,对映射关系进行更新。

65.结合前述内容可知,物理gpu在第二终端中对应有显存地址,虚拟gpu在第一终端中对应有显存地址,那么当第一终端获取到第一调用请求之后,虚拟gpu也可以对第一终端中的显存地址进行变更,得到变更后的第二变更显存地址,进而,为了保证后续gpu任务的准确完成,在获取到目标数据之后,可以将第一变更显存地址与变更后的第二变更显存地址进行对应,以对映射关系进行更新。

66.在一些实施方式中,对显存进行变更的变更子请求可以包括显存申请子请求与显存释放子请求两种。示例性地,第一调用请求与第二调用请求均为调用gpu对显存进行变更的变更子请求时,第一函数可以是cumemalloc函数。

67.此外,考虑到第一函数所在的函数库并不是物理gpu的原生函数库,因此,不能够直接安装部署在物理gpu的原生函数库的部署位置,例如不能直接部署在/usr/lib/x86_64-linux-gnu/libnvidia-ml.so.1路径或者/usr/lib/x86_64-linux-gnu/libcuda.so.1路径,这种情况下,为了进一步减少用户在编写gpu任务时对代码进行修改,对用户程序更加透明,在一些实施方式中,本公开实施例的数据获取方法还可以包括以下步骤:

68.获取第一终端的函数库的实际安装位置;将实际安装位置软连接到物理gpu的原生函数库在第一终端上的通用安装位置。

69.软链接又叫符号链接,可以将其视为文件的别名,这个文件包含了另一个文件的路径名。可以是任意文件或目录,可以链接不同文件系统的文件。软链接使的我们需要在不同的目录用到相同的文件时,不需要在每一个需要的目录下都放一个必须相同的文件,只要在某个固定的目录放上该文件,然后在其它的目录下链接(link)它就可以。

70.示例性地,假设将第一函数对应的函数库安装部署在/usr/lib/x86_64-linux-gnu/libcuda.so路径,则可以将其软连接到/usr/lib/x86_64-linux-gnu/libcuda.so.1路径,又或者假设将第一函数对应的函数库安装部署在/usr/lib/x86_64-linux-gnu/libnvidia.so路径,则可以将其软连接到/usr/lib/x86_64-linux-gnu/libnvidia.so.1路径。

71.通过将第一终端的函数库的实际安装位置软连接到物理gpu的原生函数库在第一终端上的通用安装位置,可以使得在不便于在原生函数库的通用安装位置安装第一函数库

的情况下,依然能够减少用户在编写gpu任务时对代码进行修改,对用户程序更加透明。

72.在一些实施方式中,第一终端与第二终端之间可以通过远程调用协议进行通信,示例性地,可以在第二终端部署远程调用服务器,在第一终端部署远程调用客户端(即第一函数),从而客户端与服务器之间可以通过远程调用协议通信。这种情况下,可以通过第一函数基于远程调用协议将第二调用请求发送到第二终端,以及通过远程调用协议接收第二终端返回的目标数据。

73.此外,考虑到一些终端上安装有远程直接数据存取网卡,这种情况下,可以通过远程直接数据存取技术实现网络加速,因此,在另一些实施方式中,第一终端与第二终端之间可以通过远程调用协议以及远程直接数据存取网络进行通信,从而,可以将第二调用请求对应的数据包类型细分为控制传输数据包以及数据传输数据包,以及将目标数据对应的数据包类型细分为控制传输数据包以及数据传输数据包,这种情况下,通过第一函数将第二调用请求发送到第二终端,可以包括以下步骤:

74.通过第一函数基于远程调用协议将第二调用请求对应的控制传输数据包发送到第二终端;和/或通过第一函数基于远程直接数据存取网络将第二调用请求对应的数据传输数据包发送到第二终端。

75.同样地,接收第二终端返回的目标数据可以包括以下步骤:

76.通过远程调用协议接收目标数据对应的控制传输数据包;和/或通过远程直接数据存取网络接收目标数据对应的数据传输数据包。

77.其中,远程调用协议简称为rpc(remote procedure call protocol)协议。远程直接数据存取简称为rdma(remote direct memory access)。

78.也就是说,本公开实施例中,当第二调用请求包括控制传输数据包时,可以将基于远程调用协议将第二调用请求对应的控制传输数据包发送到第二终端,而当第二调用请求包括数据传输数据包时,可以基于远程直接数据存取网络将第二调用请求对应的数据传输数据包发送到第二终端,当目标数据包括控制传输数据包时,可以通过远程调用协议接收目标数据对应的控制传输数据包,当目标数据包括数据传输数据包时,可以通过远程直接数据存取网络接收目标数据对应的数据传输数据包。

79.此外,在一些实施方式中,第一函数包括mpi_send函数以及mpi_recv函数,这种情况下,通过第一函数基于远程直接数据存取网络将第二调用请求对应的数据传输数据包发送到第二终端,包括:调用mpi_send函数基于远程直接数据存取网络将第二调用请求对应的数据传输数据包发送到第二终端。

80.通过远程直接数据存取网络接收目标数据对应的数据传输数据包,包括:调用mpi_recv函数通过远程直接数据存取网络拷贝目标数据对应的数据传输数据包

81.本公开实施例中,当第一终端向第二终端发送数据传输数据包时,比如调用cumemcpyhtod函数发送数据包时,可以调用mpi_send函数通过远程直接数据存取网络发送数据传输数据包到第二终端,以实现第一终端向第二终端发送数据时的网络加速。

82.当第一终端从第二终端拷贝数据时,比如调用cumemcpydtoh函数拷贝数据包时,可以调用mpi_recv函数通过远程直接数据存取网络从第二终端拷贝数据传输数据包,例如,从第二终端拷贝gpu的显存数据,以实现第一终端从第二终端拷贝数据时的网络加速。

83.请参阅图3,图3所示为本公开实施例所涉及的另一种应用环境的示意图。其中,包

括有第一终端和第二终端。其中,第一终端和第二终端可以通过rpc协议以及rdma网络连接,第一终端可以通过虚拟函数库中的第一函数,将本地的控制传输数据包基于rpc协议发送到第二终端的rpc服务器,以及通过rpc协议从rpc服务器接收控制传输数据包,还可以通过虚拟函数库中的第一函数,将本地的数据传输数据包基于rdma网络发送到第二终端,以及通过rdma网络从第二终端接收数据传输数据包。

84.图4是根据一示例性实施例提供的一种数据获取装置的模块连接示意图。如图4所示,本公开实施例提供了一种数据获取装置,应用于第一终端杆,该装置400可以包括:

85.第一调用请求获取模块410,用于获取调用所述第一终端自身安装的虚拟gpu的第一调用请求,所述第一调用请求携带第一函数对应的标识;

86.第二调用请求生成模块420,用于通过所述第一函数对所述第一调用请求进行处理,得到第二调用请求,并通过所述第一函数将所述第二调用请求发送到第二终端,以使所述第二终端根据所述第二调用请求,调用物理gpu的原生函数库中的第二函数,并根据所述第二函数调用自身安装的物理gpu进行处理,得到所述第二调用请求对应的目标数据,所述第一函数为所述第一终端的函数库中与所述第二函数同名的函数;

87.目标数据接收模块430,用于接收所述第二终端返回的所述目标数据。

88.可选地,第二调用请求生成模块420,包括:

89.获取子模块,用于在所述第二调用请求包括用于调用所述物理gpu进行计算的计算子请求的情况下,通过所述第一函数获取所述第一函数对应的标识、物理gpu的配置信息、计算参数以及目标显存地址;

90.计算子请求生成子模块,用于通过所述第一函数基于所述第一函数对应的标识、所述物理gpu的配置信息、所述计算参数以及所述目标显存地址,生成所述计算子请求。

91.可选地,获取子模块还用于获取所述虚拟gpu进行计算时使用的第一终端的原始显存地址;基于第一终端中的显存地址与第二终端中的显存地址之间的映射关系,确定与所述原始显存地址对应的第二终端中的目标显存地址。

92.可选地,在所述第二调用请求为用于调用所述物理gpu对显存进行变更的变更子请求的情况下,所述目标数据包括所述物理gpu对显存进行变更后的第一变更显存地址,这种情况下,装置400还包括:

93.变更显存地址获取模块,用于获取所述虚拟gpu对显存进行变更后的第二变更显存地址,以及所述第一变更显存地址;

94.映射关系更新模块,用于基于所述第一变更显存地址以及所述第二变更显存地址,对所述映射关系进行更新。

95.可选地,装置400还包括:

96.实际安装位置获取模块,用于获取所述第一终端的所述函数库的实际安装位置;

97.软连接模块,用于将所述实际安装位置软连接到物理gpu的原生函数库在所述第一终端上的通用安装位置。

98.可选地,所述第二调用请求对应的数据包类型包括控制传输数据包以及数据传输数据包,所述目标数据对应的数据包类型包括控制传输数据包以及数据传输数据包,第二调用请求生成模块420,包括:

99.第一发送子模块,用于通过所述第一函数基于远程调用协议将所述第二调用请求

对应的控制传输数据包发送到所述第二终端;

100.第二发送子模块,用于通过所述第一函数基于远程直接数据存取网络将所述第二调用请求对应的数据传输数据包发送到所述第二终端。

101.所述目标数据接收模块430,包括:

102.第一接收子模块,用于通过远程调用协议接收所述目标数据对应的控制传输数据包;

103.第二接收子模块,用于通过远程直接数据存取网络接收所述目标数据对应的数据传输数据包。

104.可选地,所述第一函数包括mpi_send函数以及mpi_recv函数,所述第二发送子模块,还用于调用所述mpi_send函数基于远程直接数据存取网络将所述第二调用请求对应的数据传输数据包发送到所述第二终端。第二接收子模块,还用于调用所述mpi_recv函数通过远程直接数据存取网络拷贝所述目标数据对应的数据传输数据包。

105.关于上述实施例中的装置的各个功能模块的具体实施方式,已在关于方法的部分进行了详细说明,在此不再赘述。

106.下面参考图5,其示出了适于用来实现本公开实施例的电子设备500的结构示意图。本公开实施例中的终端设备可以包括但不限于诸如移动电话、笔记本电脑、数字广播接收器、pda(个人数字助理)、pad(平板电脑)、pmp(便携式多媒体播放器)、车载终端(例如车载导航终端)等等的移动终端以及诸如数字tv、台式计算机等等的固定终端。图5示出的电子设备仅仅是一个示例,不应对本公开实施例的功能和使用范围带来任何限制。

107.如图5所示,电子设备500可以包括处理装置(例如中央处理器、图形处理器等)501,其可以根据存储在只读存储器(rom)502中的程序或者从存储装置508加载到随机访问存储器(ram)503中的程序而执行各种适当的动作和处理。在ram 503中,还存储有电子设备500操作所需的各种程序和数据。处理装置501、rom 502以及ram 503通过总线504彼此相连。输入/输出(i/o)接口505也连接至总线504。

108.通常,以下装置可以连接至i/o接口505:包括例如触摸屏、触摸板、键盘、鼠标、摄像头、麦克风、加速度计、陀螺仪等的输入装置506;包括例如液晶显示器(lcd)、扬声器、振动器等的输出装置507;包括例如磁带、硬盘等的存储装置508;以及通信装置509。通信装置509可以允许电子设备500与其他设备进行无线或有线通信以交换数据。虽然图5示出了具有各种装置的电子设备500,但是应理解的是,并不要求实施或具备所有示出的装置。可以替代地实施或具备更多或更少的装置。

109.特别地,根据本公开的实施例,上文参考流程图描述的过程可以被实现为计算机软件程序。例如,本公开的实施例包括一种计算机程序产品,其包括承载在非暂态计算机可读介质上的计算机程序,该计算机程序包含用于执行流程图所示的方法的程序代码。在这样的实施例中,该计算机程序可以通过通信装置509从网络上被下载和安装,或者从存储装置508被安装,或者从rom 502被安装。在该计算机程序被处理装置501执行时,执行本公开实施例的方法中限定的上述功能。

110.需要说明的是,本公开上述的计算机可读介质可以是计算机可读信号介质或者计算机可读存储介质或者是上述两者的任意组合。计算机可读存储介质例如可以是——但不限于——电、磁、光、电磁、红外线、或半导体的系统、装置或器件,或者任意以上的组合。计

算机可读存储介质的更具体的例子可以包括但不限于:具有一个或多个导线的电连接、便携式计算机磁盘、硬盘、随机访问存储器(ram)、只读存储器(rom)、可擦式可编程只读存储器(eprom或闪存)、光纤、便携式紧凑磁盘只读存储器(cd-rom)、光存储器件、磁存储器件、或者上述的任意合适的组合。在本公开中,计算机可读存储介质可以是任何包含或存储程序的有形介质,该程序可以被指令执行系统、装置或者器件使用或者与其结合使用。而在本公开中,计算机可读信号介质可以包括在基带中或者作为载波一部分传播的数据信号,其中承载了计算机可读的程序代码。这种传播的数据信号可以采用多种形式,包括但不限于电磁信号、光信号或上述的任意合适的组合。计算机可读信号介质还可以是计算机可读存储介质以外的任何计算机可读介质,该计算机可读信号介质可以发送、传播或者传输用于由指令执行系统、装置或者器件使用或者与其结合使用的程序。计算机可读介质上包含的程序代码可以用任何适当的介质传输,包括但不限于:电线、光缆、rf(射频)等等,或者上述的任意合适的组合。

111.在一些实施方式中,电子设备可以利用诸如http(hypertext transfer protocol,超文本传输协议)之类的任何当前已知或未来研发的网络协议进行通信,并且可以与任意形式或介质的数字数据通信(例如,通信网络)互连。通信网络的示例包括局域网(“lan”),广域网(“wan”),网际网(例如,互联网)以及端对端网络(例如,ad hoc端对端网络),以及任何当前已知或未来研发的网络。

112.上述计算机可读介质可以是上述电子设备中所包含的;也可以是单独存在,而未装配入该电子设备中。

113.上述计算机可读介质承载有一个或者多个程序,当上述一个或者多个程序被该电子设备执行时,使得该电子设备:获取寄宿应用的当前进程优先级;将所述寄宿应用对应的宿主应用的目标进程的进程优先级调整为与所述当前进程优先级一致,所述目标进程为所述宿主应用创建用于运行所述寄宿应用的虚拟运行环境所必须的进程;其中,所述寄宿应用的进程优先级与所述目标进程的进程优先级之间存在依赖关系,所述依赖关系用于使得所述目标进程的进程优先级跟随所述寄宿应用的进程优先级的变化而变化。

114.可以以一种或多种程序设计语言或其组合来编写用于执行本公开的操作的计算机程序代码,上述程序设计语言包括但不限于面向对象的程序设计语言—诸如java、smalltalk、c++,还包括常规的过程式程序设计语言——诸如“c”语言或类似的程序设计语言。程序代码可以完全地在用户计算机上执行、部分地在用户计算机上执行、作为一个独立的软件包执行、部分在用户计算机上部分在远程计算机上执行、或者完全在远程计算机或服务器上执行。在涉及远程计算机的情形中,远程计算机可以通过任意种类的网络——包括局域网(lan)或广域网(wan)——连接到用户计算机,或者,可以连接到外部计算机(例如利用因特网服务提供商来通过因特网连接)。

115.附图中的流程图和框图,图示了按照本公开各种实施例的系统、方法和计算机程序产品的可能实现的体系架构、功能和操作。在这点上,流程图或框图中的每个方框可以代表一个模块、程序段、或代码的一部分,该模块、程序段、或代码的一部分包含一个或多个用于实现规定的逻辑功能的可执行指令。也应当注意,在有些作为替换的实现中,方框中所标注的功能也可以以不同于附图中所标注的顺序发生。例如,两个接连地表示的方框实际上可以基本并行地执行,它们有时也可以按相反的顺序执行,这依所涉及的功能而定。也要注

意的是,框图和/或流程图中的每个方框、以及框图和/或流程图中的方框的组合,可以用执行规定的功能或操作的专用的基于硬件的系统来实现,或者可以用专用硬件与计算机指令的组合来实现。

116.描述于本公开实施例中所涉及到的模块可以通过软件的方式实现,也可以通过硬件的方式来实现。其中,模块的名称在某种情况下并不构成对该模块本身的限定。

117.本文中以上描述的功能可以至少部分地由一个或多个硬件逻辑部件来执行。例如,非限制性地,可以使用的示范类型的硬件逻辑部件包括:现场可编程门阵列(fpga)、专用集成电路(asic)、专用标准产品(assp)、片上系统(soc)、复杂可编程逻辑设备(cpld)等等。

118.在本公开的上下文中,机器可读介质可以是有形的介质,其可以包含或存储以供指令执行系统、装置或设备使用或与指令执行系统、装置或设备结合地使用的程序。机器可读介质可以是机器可读信号介质或机器可读储存介质。机器可读介质可以包括但不限于电子的、磁性的、光学的、电磁的、红外的、或半导体系统、装置或设备,或者上述内容的任何合适组合。机器可读存储介质的更具体示例会包括基于一个或多个线的电气连接、便携式计算机盘、硬盘、随机存取存储器(ram)、只读存储器(rom)、可擦除可编程只读存储器(eprom或快闪存储器)、光纤、便捷式紧凑盘只读存储器(cd-rom)、光学储存设备、磁储存设备、或上述内容的任何合适组合。

119.根据本公开的一个或多个实施例,示例1提供了一种数据获取方法,应用于第一终端,所述方法包括:

120.获取调用所述第一终端自身安装的虚拟gpu的第一调用请求,所述第一调用请求携带第一函数对应的标识;

121.通过所述第一函数对所述第一调用请求进行处理,得到第二调用请求,并通过所述第一函数将所述第二调用请求发送到第二终端,以使所述第二终端根据所述第二调用请求,调用物理gpu的原生函数库中的第二函数,并根据所述第二函数调用自身安装的物理gpu进行处理,得到所述第二调用请求对应的目标数据,所述第一函数为所述第一终端的函数库中与所述第二函数同名的函数;

122.接收所述第二终端返回的所述目标数据。

123.根据本公开的一个或多个实施例,示例2提供了示例1的方法,所述通过所述第一函数对所述第一调用请求进行处理,得到第二调用请求,包括:

124.在所述第二调用请求包括用于调用所述物理gpu进行计算的计算子请求的情况下,通过所述第一函数获取所述第一函数对应的标识、物理gpu的配置信息、计算参数以及目标显存地址;

125.通过所述第一函数基于所述第一函数对应的标识、所述物理gpu的配置信息、所述计算参数以及所述目标显存地址,生成所述计算子请求。

126.根据本公开的一个或多个实施例,示例3提供了示例2的方法,获取所述目标显存地址,包括:

127.获取所述虚拟gpu进行计算时使用的第一终端的原始显存地址;

128.基于第一终端中的显存地址与第二终端中的显存地址之间的映射关系,确定与所述原始显存地址对应的第二终端中的目标显存地址。

129.根据本公开的一个或多个实施例,示例4提供了示例3的方法,在所述第二调用请求为用于调用所述物理gpu对显存进行变更的变更子请求的情况下,所述目标数据包括所述物理gpu对显存进行变更后的第一变更显存地址,获取所述目标数据之后,所述方法还包括:

130.获取所述虚拟gpu对显存进行变更后的第二变更显存地址,以及所述第一变更显存地址;

131.基于所述第一变更显存地址以及所述第二变更显存地址,对所述映射关系进行更新。

132.根据本公开的一个或多个实施例,示例5提供了示例1的方法,所述方法还包括:

133.获取所述第一终端的所述函数库的实际安装位置;

134.将所述实际安装位置软连接到物理gpu的原生函数库在所述第一终端上的通用安装位置。

135.根据本公开的一个或多个实施例,示例6提供了示例1-5任一项的方法,所述第二调用请求对应的数据包类型包括控制传输数据包以及数据传输数据包,所述目标数据对应的数据包类型包括控制传输数据包以及数据传输数据包,通过所述第一函数将所述第二调用请求发送到第二终端,包括:

136.通过所述第一函数基于远程调用协议将所述第二调用请求对应的控制传输数据包发送到所述第二终端;和/或

137.通过所述第一函数基于远程直接数据存取网络将所述第二调用请求对应的数据传输数据包发送到所述第二终端;

138.所述接收所述第二终端返回的所述目标数据,包括:

139.通过远程调用协议接收所述目标数据对应的控制传输数据包;和/或

140.通过远程直接数据存取网络接收所述目标数据对应的数据传输数据包。

141.根据本公开的一个或多个实施例,示例7提供了示例6的方法,所述第一函数包括mpi_send函数以及mpi_recv函数,所述通过所述第一函数基于远程直接数据存取网络将所述第二调用请求对应的数据传输数据包发送到所述第二终端,包括:

142.调用所述mpi_send函数基于远程直接数据存取网络将所述第二调用请求对应的数据传输数据包发送到所述第二终端;

143.所述通过远程直接数据存取网络接收所述目标数据对应的数据传输数据包,包括:

144.调用所述mpi_recv函数通过远程直接数据存取网络拷贝所述目标数据对应的数据传输数据包。

145.根据本公开的一个或多个实施例,示例8提供了一种数据获取装置,应用于第一终端,所述装置包括:

146.第一调用请求获取模块,用于获取调用所述第一终端自身安装的虚拟gpu的第一调用请求,所述第一调用请求携带第一函数对应的标识;

147.第二调用请求生成模块,用于通过所述第一函数对所述第一调用请求进行处理,得到第二调用请求,并通过所述第一函数将所述第二调用请求发送到第二终端,以使所述第二终端根据所述第二调用请求,调用物理gpu的原生函数库中的第二函数,并根据所述第

二函数调用自身安装的物理gpu进行处理,得到所述第二调用请求对应的目标数据,所述第一函数为所述第一终端的函数库中与所述第二函数同名的函数;

148.目标数据接收模块,用于接收所述第二终端返回的所述目标数据。

149.根据本公开的一个或多个实施例,示例9提供了示例8的装置,所述第二调用请求生成模块,包括:

150.获取子模块,用于在所述第二调用请求包括用于调用所述物理gpu进行计算的计算子请求的情况下,通过所述第一函数获取所述第一函数对应的标识、物理gpu的配置信息、计算参数以及目标显存地址;

151.计算子请求生成子模块,用于通过所述第一函数基于所述第一函数对应的标识、所述物理gpu的配置信息、所述计算参数以及所述目标显存地址,生成所述计算子请求。

152.根据本公开的一个或多个实施例,示例10提供了示例9的装置,获取子模块还用于获取所述虚拟gpu进行计算时使用的第一终端的原始显存地址;基于第一终端中的显存地址与第二终端中的显存地址之间的映射关系,确定与所述原始显存地址对应的第二终端中的目标显存地址。

153.根据本公开的一个或多个实施例,示例11提供了示例10的装置,在所述第二调用请求为用于调用所述物理gpu对显存进行变更的变更子请求的情况下,所述目标数据包括所述物理gpu对显存进行变更后的第一变更显存地址,这种情况下,装置还包括:

154.变更显存地址获取模块,用于获取所述虚拟gpu对显存进行变更后的第二变更显存地址,以及所述第一变更显存地址;

155.映射关系更新模块,用于基于所述第一变更显存地址以及所述第二变更显存地址,对所述映射关系进行更新。

156.根据本公开的一个或多个实施例,示例12提供了示例8的装置,装置还包括:

157.实际安装位置获取模块,用于获取所述第一终端的所述函数库的实际安装位置;

158.软连接模块,用于将所述实际安装位置软连接到物理gpu的原生函数库在所述第一终端上的通用安装位置。

159.根据本公开的一个或多个实施例,示例13提供了示例8-12任一项的装置,所述第二调用请求对应的数据包类型包括控制传输数据包以及数据传输数据包,所述目标数据对应的数据包类型包括控制传输数据包以及数据传输数据包,第二调用请求生成模块,包括:

160.第一发送子模块,用于通过所述第一函数基于远程调用协议将所述第二调用请求对应的控制传输数据包发送到所述第二终端;

161.第二发送子模块,用于通过所述第一函数基于远程直接数据存取网络将所述第二调用请求对应的数据传输数据包发送到所述第二终端;

162.所述目标数据接收模块,包括:

163.第一接收子模块,用于通过远程调用协议接收所述目标数据对应的控制传输数据包;

164.第二接收子模块,用于通过远程直接数据存取网络接收所述目标数据对应的数据传输数据包。

165.根据本公开的一个或多个实施例,示例14提供了示例13的装置,所述第一函数包括mpi_send函数以及mpi_recv函数,所述第二发送子模块,还用于调用所述mpi_send函数

基于远程直接数据存取网络将所述第二调用请求对应的数据传输数据包发送到所述第二终端。第二接收子模块,还用于调用所述mpi_recv函数通过远程直接数据存取网络拷贝所述目标数据对应的数据传输数据包。

166.根据本公开的一个或多个实施例,示例15提供了一种计算机可读介质,其上存储有计算机程序,该程序被处理装置执行时实现示例1-7中任一项所述方法的步骤。

167.根据本公开的一个或多个实施例,示例16提供了一种电子设备,包括:

168.存储装置,其上存储有计算机程序;

169.处理装置,用于执行所述存储装置中的所述计算机程序,以实现示例1-7中任一项所述方法的步骤。

170.以上描述仅为本公开的较佳实施例以及对所运用技术原理的说明。本领域技术人员应当理解,本公开中所涉及的公开范围,并不限于上述技术特征的特定组合而成的技术方案,同时也应涵盖在不脱离上述公开构思的情况下,由上述技术特征或其等同特征进行任意组合而形成的其它技术方案。例如上述特征与本公开中公开的(但不限于)具有类似功能的技术特征进行互相替换而形成的技术方案。

171.此外,虽然采用特定次序描绘了各操作,但是这不应当理解为要求这些操作以所示出的特定次序或以顺序次序执行来执行。在一定环境下,多任务和并行处理可能是有利的。同样地,虽然在上面论述中包含了若干具体实现细节,但是这些不应当被解释为对本公开的范围的限制。在单独的实施例的上下文中描述的某些特征还可以组合地实现在单个实施例中。相反地,在单个实施例的上下文中描述的各种特征也可以单独地或以任何合适的子组合的方式实现在多个实施例中。

172.尽管已经采用特定于结构特征和/或方法逻辑动作的语言描述了本主题,但是应当理解所附权利要求书中所限定的主题未必局限于上面描述的特定特征或动作。相反,上面所描述的特定特征和动作仅仅是实现权利要求书的示例形式。关于上述实施例中的装置,其中各个模块执行操作的具体方式已经在有关该方法的实施例中进行了详细描述,此处将不做详细阐述说明。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1