基于深度学习和机器视觉的矿用电铲铲斗健康监测方法与流程

1.本发明属于露天矿电铲铲斗健康监测技术领域,具体基于深度学习和机器视觉的矿用电铲铲斗健康监测方法。

背景技术:

2.露天矿生产作业中矿用电铲是重要的采掘装备,电铲铲斗和矿石相互作用,需要承受冲击载荷以及剪切和挤压作用力,铲斗上固定在一起的各部件容易断裂、松动或脱落。这些由高锰钢或合金钢材料制成的铲斗部件如果随着矿石一起进入下游破碎环节,很容易引起破碎机损坏,造成生产线停机维修,导致巨大的经济损失。而电铲操作人员不可能实时肉眼观察铲斗状态,使得铲斗部件脱落事故时有发生。

3.在电铲铲斗健康监测方面,国内外学者和企业做了大量的工作,包括利用红外热成像仪对电铲斗齿进行热成像来实现斗齿缺失监测、基于深度学习卷积神经网络的电铲斗齿脱落检测、基于图像识别的斗齿监控等。这些方法只能对电铲斗齿脱落进行监测,而电铲铲斗是由若干个部件固定在一起的,不仅是斗齿,其他部件也有概率会脱落。而且电铲在采掘生产中,铲斗不可避免的会被泥土等污渍覆盖,增加了识别难度,同时夜间也会进行生产作业,加上光照不足,使得误报警比较频繁。

技术实现要素:

4.为解决上述技术问题,本发明的目的是提供基于深度学习和机器视觉的矿用电铲铲斗健康监测方法,通过深度学习进行电铲铲斗各部位识别模型的训练,再结合机器视觉技术对铲斗各部位是否脱落进行监测和报警,可以提升电铲工作效率,保护后续生产工艺设备。

5.本发明为实现上述目的所采用的技术方案是:基于深度学习和机器视觉的矿用电铲铲斗健康监测方法,包括以下步骤:

6.获取铲斗图像;对于每个铲斗图像,对铲斗各部位进行标记得到带有标记信息的文件,构成数据集;

7.根据数据集对神经网络模型进行训练,得到训练好的神经网络模型作为铲斗识别模型;

8.将实时采集的铲斗图像通过铲斗识别模型识别出铲斗各部位,再对各部位进行实时的铲斗健康监测。

9.所述对铲斗各部位进行标记得到带有标记信息的文件,包括以下步骤:

10.对铲斗图像的各部位进行标记,得到每个铲斗图像带有标记信息的xml文件;

11.所述标记信息用于表示铲斗各部位,包括斗齿、钩铁、异形、a形、铲斗。

12.所述根据数据集对神经网络模型进行训练前,对数据集进行预处理,包括以下步骤:

13.在数据集中,分别将训练集和验证集中带标记信息的文件转为csv文件;

14.分别将训练集和验证集中的csv文件转为tfrecord格式文件;

15.依据待识别各对象作成pbtxt文件,所述pbtxt文件包括需要识别的铲斗各部位。

16.所述根据数据集对神经网络模型进行训练,包括以下步骤:

17.将tfrecord格式文件、pbtxt文件导入神经网络模型,进行训练,得到训练结果文件;

18.根据训练结果文件生成固化好的用于表达神经网络模型的冻结推理图文件,完成训练。

19.所述对各部位进行实时的铲斗健康监测,包括斗齿脱落识别,执行以下步骤:

20.5-1、初始化铲斗识别率为h,斗齿识别率为k1,斗齿1至斗齿n检查次数为n;识别率用于表示机器视觉结合冻结推理图文件对于识别对象的匹配程度,最大值是1,代表识别对象完全匹配;最小值是0;当识别到铲斗并且识别到斗齿1-n时,将对应斗齿的检查次数重置为n;当识别到铲斗并且没有识别到某个斗齿时,将对应斗齿的检查次数减1,检查次数为0时触发报警;

21.5-2、对于识别出有铲斗出现的实时铲斗图像,判断识别率是否大于等于h,若是则进行下一步,否则返回步骤5-2;

22.5-3、识别出有斗齿出现并且识别率大于等于k1,若是则进行下一步,否则返回步骤5-2;

23.5-4、获取识别出的铲斗坐标及宽度,在x坐标方向把铲斗平均分为n等份,计算每等份中心位置,从左到右分别是1-n等份中心位置;

24.5-5、遍历所有斗齿,识别出斗齿坐标,计算每个斗齿中心x坐标,判断是否在铲斗1-n等份中心偏差设定范围内;如果是则进行下一步,否则开始步骤5-7;

25.5-6、设置步骤5-5识别到的斗齿检查次数为n;

26.5-7、所有斗齿1-斗齿n检查次数减1;

27.5-8、判断斗齿1-斗齿n检查次数是否为0,如果是则进行下一步,否则返回5-2;

28.5-9、触发检查次数为0的斗齿报警,返回步骤5-2。

29.所述对各部位进行实时的铲斗健康监测,包括钩铁脱落的识别,执行以下步骤:

30.6-1、初始化铲斗识别率为h,钩铁识别率为k2,钩铁1-钩铁m检查次数为n;当识别到铲斗并且识别到钩铁1-钩铁m时,会将对应钩铁的检查次数重置为n;当识别到铲斗并且没有识别到某个钩铁时,会将对应钩铁的检查次数减1,检查次数为0时会触发报警;

31.6-2、对于识别出有铲斗出现的实时铲斗图像,判断识别率是否大于等于h,若是则进行下一步,否则返回步骤6-2;

32.6-3、识别出有钩铁出现并且识别率大于等于k2,若是则进行下一步,否则返回步骤6-2;

33.6-4、获取识别出的铲斗坐标及宽度,在x坐标方向把铲斗平均分为p等份,从左到右第2到第p-1份的p-2等份分别对应钩铁1-m位置;

34.6-5、遍历所有钩铁,识别出钩铁坐标,判断是否在铲斗p-2等份范围内,如果是则进行下一步,否则开始步骤6-7;

35.6-6、设置步骤6-5识别到的钩铁检查次数为n;

36.6-7、所有钩铁1-钩铁m检查次数减1;

37.6-8、判断钩铁1-钩铁m检查次数是否为0,如果是则进行下一步,否则返回6-2;

38.6-9、触发检查次数为0的钩铁报警,返回步骤6-2。

39.所述对各部位进行实时的铲斗健康监测,包括异形、a形脱落识别,执行以下步骤:

40.7-1、初始化铲斗识别率为h,异形、a形识别率为k3,异形左、异形右、a形左、a形右检查次数为n;当识别到铲斗并且识别到异形左、异形右、a形左、a形右其中一个或多个时,会将对应异形、a形的检查次数重置为n;当识别到铲斗并且没有识别到某个异形或a形时,会将对应异形或a形的检查次数减1,检查次数为0时会触发报警;其中,异形为异形左和异形右的至少一种,a形为a形左和a形右的至少一种;

41.7-2、对于识别出有铲斗出现的实时铲斗图像,判断识别率是否大于等于h,若是则进行下一步,否则返回步骤7-2;

42.7-3、识别是否有任意一个异形或a形出现并且识别率大于等于k3,若是则进行下一步,否则返回步骤7-2;

43.7-4、获取铲斗坐标及宽度,在x坐标方向把铲斗最小值和最大值分别对应异形或a形左右位置;

44.7-5、遍历所有异形和a形,获取异形和a形坐标,判断是否在铲斗最小值和最大值的设定像素范围内,如果是则进行下一步,否则开始步骤7-7;

45.7-6、设置步骤7-5识别到的异形、a形检查次数为n;

46.7-7、所有异形和a形检查次数减1;

47.7-8、判断异形或a形检查次数是否为0,如果是则进行下一步,否则返回步骤7-2;

48.7-9、触发相应异形或a形检查次数为0的报警,返回步骤7-2。

49.基于深度学习和机器视觉的矿用电铲铲斗健康监测系统,包括:

50.图像预处理模块,用于获取铲斗图像;对于每个铲斗图像,对铲斗各部位进行标记得到带有标记信息的文件,构成数据集;

51.模型构建模块,用于根据数据集对神经网络模型进行训练,得到训练好的神经网络模型作为铲斗识别模型;

52.健康监测模块,用于将实时采集的铲斗图像通过铲斗识别模型识别出铲斗各部位,再对各部位进行实时的铲斗健康监测。

53.基于深度学习和机器视觉的矿用电铲铲斗健康监测装置,包括存储器和处理器;所述存储器,用于存储计算机程序;所述处理器,用于当执行所述计算机程序时,实现基于深度学习和机器视觉的矿用电铲铲斗健康监测方法。

54.一种计算机可读存储介质,所述存储介质上存储有计算机程序,当所述计算机程序被处理器执行时,实现基于深度学习和机器视觉的矿用电铲铲斗健康监测方法。

55.本发明具有以下有益效果及优点:

56.1.本发明解决了传统方法只能监测铲斗斗齿的问题,能够监测电铲铲斗各部位是否脱落;

57.2.本发明采用高清红外摄像头,能够满足露天矿每天24小时生产视频采集需要;

58.3.本发明基于深度学习训练模型,满足各种天气条件下的识别需要;

59.4.本发明基于机器视觉进行铲斗健康监测,解放人眼,使操作人员将精力集中于铲装作业,有助于提高生产效率。

附图说明

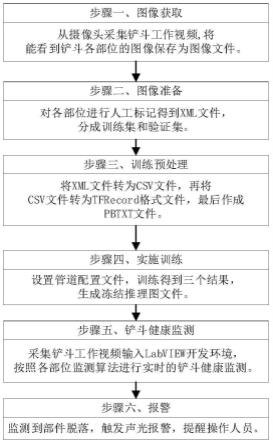

60.图1为本发明实施例的基于深度学习和机器视觉的矿用电铲铲斗健康监测方法流程图;

61.图2为本发明实施例的正常状态下电铲铲斗识别结果;

62.图3为本发明实施例的斗齿6脱落后电铲铲斗识别结果;

63.图4为本发明实施例的斗齿脱落识别算法流程图;

64.图5为本发明实施例的钩铁脱落识别算法流程图;

65.图6为本发明实施例的异形、a形脱落识别算法流程图。

具体实施方式

66.下面结合附图对本发明进行详细说明。

67.本发明属于露天矿电铲铲斗健康监测技术领域,具体基于深度学习和机器视觉的矿用电铲铲斗健康监测方法。包括以下步骤:一、图像获取,从摄像头采集铲斗工作视频,将能看到铲斗各部位的图像保存为图像文件;二、图像准备,对各部位进行人工标记得到xml文件,分成训练集和验证集;三、训练预处理,将xml文件转为tfrecord格式文件,最后作成pbtxt文件;四、实施训练,设置管道配置文件,训练得到三个结果,生成冻结推理图文件;五、铲斗健康监测,采集铲斗工作视频输入labview开发环境,按照各部位监测算法进行实时的铲斗健康监测;六、报警,监测到部件脱落,触发声光报警。本发明解决了传统方法只能识别铲斗斗齿脱落的问题,能够监测电铲铲斗各部位是否脱落。

68.本发明包括以下步骤:

69.1)图像获取;

70.1-1)从安装在电铲铲斗上方的高清红外摄像头采集铲斗工作视频,包括晴天、阴天、雨天、雪天等不同天气状况下的视频,一天24小时不同时间段的视频;

71.1-2)将采集的视频中,能看到铲斗各部位包括斗齿、钩铁、异形、a形、铲斗的图像保存为jpg图像文件;

72.2)图像准备

73.2-1)使用labelimg工具将保存的图像文件对各部位进行人工标记得到每个jpg文件带有标记信息的xml文件;

74.2-2)将得到的jpg文件和xml文件分成训练集和验证集两个部分。训练集为所有文件2/3左右,用来训练电铲铲斗识别模型。验证集为所有文件1/3左右,用来验证电铲铲斗训练效果;

75.3)训练预处理

76.3-1)编写python程序,分别将训练集和验证集中带标记信息的xml文件转为csv文件;

77.3-2)编写python程序,分别将训练集和验证集中带标记信息的csv文件转为tensorflow专用的tfrecord格式;

78.3-3)作成pbtxt文件,内容包含需要识别的五个部位,分别是斗齿、钩铁、异形、a形、铲斗;

79.4)实施训练

80.4-1)使用tensorflow的object detection api来训练自己的数据集,采用基于深度学习的目标检测算法ssd(singleshotmultiboxdetector)实施训练,设置管道配置文件“ssd_mobilenet_v1_coco.config”,修改分类数目num_classes为5,每个批次的训练样本数batch_size为16,训练总步数num_steps为2000000,训练用和验证用的tfrecord格式数据集的路径设置为步骤3-2)生成的tfrecord格式的文件,label_map_path设置为步骤3-3)生成的pbtxt文件;

81.4-2)编写python深度学习训练程序,设置管道配置文件为步骤4-1)修改的文件,开始训练,得到三个训练结果文件分别是“model.ckpt-2000000.data-00000-of-00001”,“model.ckpt-2000000.index”,“model.ckpt-2000000.meta”;

82.第一个文件model.ckpt-2000000.data-00000-of-00001,保存了每一个weights、biases、gradients等变量的取值。

83.第二个文件model.ckpt-2000000.index,索引,用于将data中数据与meta的结构匹配,即值是图上哪个部分的值。

84.第三个文件model.ckpt-2000000.meta,它保存了tensorflow计算图的结构,即神经网络的网络结构。

85.4-3)利用步骤4-2)得到的三个训练结果文件生成冻结推理图“frozen_inference_graph.pb”文件;

86.文件frozen_inference_graph.pb,为固化好的最终神经网络模型,里面包含graph定义和训练参数。

87.5)铲斗健康监测

88.5-1)从安装在电铲铲斗上方的高清红外摄像头采集铲斗工作视频输入labview开发环境;

89.5-2)基于labview开发环境,结合机器视觉-》机器学习-》深度学习函数,将步骤4-3)得到的冻结推理图文件作为输入,按照各部位监测算法进行实时的铲斗健康监测;

90.6)报警

91.6-1)根据监测结果触发声光报警,提醒操作人员进行确认。

92.其中,步骤5-2)各部位监测算法具体为:

93.(1)斗齿脱落识别:

94.步骤一、初始化铲斗识别率为0.5,斗齿识别率为0.1,齿1-齿6检查次数为n。识别率指的是labview机器视觉结合冻结推理图文件对于识别对象的匹配程度,最大值是1,代表识别对象完全匹配。最小值是0。当识别到铲斗并且识别到斗齿1-6时,会将对应斗齿的检查次数重置为n。当识别到铲斗并且没有识别到某个斗齿时,会将对应斗齿的检查次数减1,检查次数为0时会触发报警;

95.步骤二、从安装在电铲铲斗上方的高清红外摄像头获取图像;

96.步骤三、基于获取的图像识别是否有铲斗出现并且识别率大于等于0.5,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

97.步骤四、基于获取的图像识别是否有斗齿出现并且识别率大于等于0.1,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

98.步骤五、获取识别出的铲斗坐标及宽度,在x坐标方向把铲斗平均分为6等份,计算

每等份中心位置,从左到右分别是1-6等份中心位置;

99.步骤六、基于获取的图像识别出斗齿坐标,计算每个斗齿中心x坐标,判断是否在铲斗1-6等份中心偏差150像素范围内,如果判断结果为“是”则进行下一步,如果为“否”则开始步骤八;

100.步骤七、重置对应斗齿检查次数为n;

101.步骤八、所有斗齿齿1-齿6检查次数减1;

102.步骤九、判断齿1-齿6检查次数是否为0,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

103.步骤十、触发相应斗齿检查次数为0的报警,返回步骤二。

104.(2)钩铁脱落识别:

105.步骤一、初始化铲斗识别率为0.5,钩铁识别率为0.1,钩铁1-钩铁5检查次数为n。当识别到铲斗并且识别到钩铁1-5时,会将对应钩铁的检查次数重置为n。当识别到铲斗并且没有识别到某个钩铁时,会将对应钩铁的检查次数减1,检查次数为0时会触发报警;

106.步骤二、从安装在电铲铲斗上方的高清红外摄像头获取图像;

107.步骤三、基于获取的图像识别是否有铲斗出现并且识别率大于等于0.5,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

108.步骤四、基于获取的图像识别是否有钩铁出现并且识别率大于等于0.1,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

109.步骤五、获取识别出的铲斗坐标及宽度,在x坐标方向把铲斗平均分为7等份,从左到右第2到第6份的5等份分别对应钩铁1-5位置;

110.步骤六、基于获取的图像识别出钩铁坐标,判断是否在铲斗5等份范围内,如果判断结果为“是”则进行下一步,如果为“否”则开始步骤八;

111.步骤七、重置对应钩铁检查次数为n;

112.步骤八、所有钩铁1-钩铁5检查次数减1;

113.步骤九、判断钩铁1-钩铁5检查次数是否为0,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

114.步骤十、触发相应钩铁检查次数为0的报警,返回步骤二。

115.(3)异形、a形脱落识别:

116.步骤一、初始化铲斗识别率为0.5,异形、a形识别率为0.1,异形左、异形右、a形左、a形右检查次数为n。当识别到铲斗并且识别到异形左、异形右、a形左、a形右时,会将对应异形、a形的检查次数重置为n。当识别到铲斗并且没有识别到某个异形、a形时,会将对应异形、a形的检查次数减1,检查次数为0时会触发报警;

117.步骤二、从安装在电铲铲斗上方的高清红外摄像头获取图像;

118.步骤三、基于获取的图像识别是否有铲斗出现并且识别率大于等于0.5,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

119.步骤四、基于获取的图像识别是否有异形、a形出现并且识别率大于等于0.1,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

120.步骤五、获取铲斗坐标及宽度,在x坐标方向把铲斗最小值和最大值分别对应异形、a形左右位置。;

121.步骤六、获取异形、a形坐标,判断是否在铲斗最小值和最大值100像素范围内,如果判断结果为“是”则进行下一步,如果为“否”则开始步骤八;

122.步骤七、重置对应异形、a形检查次数为n;

123.步骤八、所有异形、a形检查次数减1;

124.步骤九、判断异形、a形检查次数是否为0,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

125.步骤十、触发相应异形、a形检查次数为0的报警,返回步骤二。

126.如图1所示,本发明的基于深度学习和机器视觉的矿用电铲铲斗健康监测方法包括以下步骤:

127.1)图像获取;

128.1-1)从安装在电铲铲斗上方的高清红外摄像头采集铲斗工作视频,包括晴天、阴天、雨天、雪天等不同天气状况下的视频,一天24小时不同时间段的视频;

129.1-2)将采集的视频中,能看到铲斗各部位包括斗齿、钩铁、异形、a形、铲斗的图像保存为jpg图像文件,一共是9010个jpg文件;

130.2)图像准备

131.2-1)使用labelimg工具将保存的图像文件对各部位进行人工标记得到每个jpg文件带有标记信息的xml文件,共得到9010个xml文件;

132.2-2)将得到的jpg文件和xml文件分成训练集和验证集两个部分。训练集为所有文件2/3左右,共12772个,用来训练电铲铲斗识别模型。验证集为所有文件1/3左右,共5248个,用来验证电铲铲斗训练效果;

133.3)训练预处理

134.3-1)编写python程序,分别将训练集和验证集中带标记信息的xml文件转为csv文件,格式如表1所示;

135.表1带标记信息的csv文件格式

136.filenamewidthheightclassxminyminxmaxymaximage00033.jpg25921944tooth213386513717image00033.jpg25921944tooth611302886623image00033.jpg25921944tooth10072451274582image00033.jpg25921944tooth14171761656570image00033.jpg25921944tooth18152412017631image00033.jpg25921944tooth21763022403682image00033.jpg25921944bucket5918825921123image00033.jpg25921944hook583672755982image00033.jpg25921944hook9256041095932image00033.jpg25921944hook12835601439904image00033.jpg25921944hook16315561781936image00033.jpg25921944hook19536202127992image00033.jpg25921944shape575763651082image00033.jpg25921944shape231948625921070

image00033.jpg25921944ashape9910083931670image00033.jpg25921944ashape231595425791662

137.3-2)编写python程序,分别将训练集和验证集中带标记信息的csv文件转为tensorflow专用的tfrecord格式;

138.3-3)作成pbtxt文件,内容包含需要识别的五个部位,分别是斗齿、钩铁、异形、a形、铲斗,格式如下:

139.item{id:1name:'tooth'}

140.item{id:2name:'bucket'}

141.item{id:3name:'hook'}

142.item{id:4name:'shape'}

143.item{id:5name:'ashape'};

144.4)实施训练

145.4-1)使用tensorflow的object detection api来训练自己的数据集,采用基于深度学习的目标检测算法ssd(singleshotmultiboxdetector)实施训练,设置管道配置文件“ssd_mobilenet_v1_coco.config”,修改分类数目num_classes为5,每个批次的训练样本数batch_size为16,训练总步数num_steps为2000000,训练用和验证用的tfrecord格式数据集的路径设置为步骤3-2)生成的tfrecord格式的文件,label_map_path设置为步骤3-3)生成的pbtxt文件;

146.4-2)编写python深度学习训练程序,设置管道配置文件为步骤4-1)修改的文件,开始训练,得到三个训练结果文件分别是“model.ckpt-2000000.data-00000-of-00001”,“model.ckpt-2000000.index”,“model.ckpt-2000000.meta”;

147.4-3)利用步骤4-2)得到的三个训练结果文件生成冻结推理图“frozen_inference_graph.pb”文件;

148.5)铲斗健康监测

149.5-1)从安装在电铲铲斗上方的高清红外摄像头采集铲斗工作视频输入labview开发环境;

150.5-2)基于labview开发环境,结合机器视觉-》机器学习-》深度学习函数,将步骤4-3)得到的冻结推理图文件作为输入,按照各部位监测算法进行实时的铲斗健康监测;

151.6)报警

152.6-1)根据监测结果触发声光报警,提醒操作人员进行确认。

153.其中,步骤5-2)各部位监测算法具体为:

154.(1)如图2所示,斗齿脱落识别算法:

155.步骤一、初始化铲斗识别率为0.5,斗齿识别率为0.1,齿1-齿6检查次数为n,此处取n为5。识别率指的是labview机器视觉结合冻结推理图文件对于识别对象的匹配程度,最大值是1,代表识别对象完全匹配。最小值是0。当识别到铲斗并且识别到斗齿1-6时,会将对应斗齿的检查次数重置为5。当识别到铲斗并且没有识别到某个斗齿时,会将对应斗齿的检查次数减1,检查次数为0时会触发报警;

156.步骤二、从安装在电铲铲斗上方的高清红外摄像头获取图像;

157.步骤三、基于获取的图像识别是否有铲斗出现并且识别率大于等于0.5,如果判断

结果为“是”则进行下一步,如果为“否”则返回步骤二;

158.步骤四、基于获取的图像识别是否有斗齿出现并且识别率大于等于0.1,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二,识别出图像如图3和图4所示;

159.步骤五、获取识别出的铲斗坐标及宽度,在x坐标方向把铲斗平均分为6等份,计算每等份中心位置,从左到右分别是1-6等份中心位置,图3识别铲斗数据如表2所示,图4识别铲斗数据如表3所示;

160.表2基于图3识别出的铲斗及6等份数据

[0161][0162]

表3基于图4识别出的铲斗及6等份数据

[0163][0164]

步骤六、基于获取的图像识别出斗齿坐标,计算每个斗齿中心x坐标,判断是否在铲斗1-6等份中心偏差150像素范围内,如果判断结果为“是”则进行下一步,如果为“否”则开始步骤八。基于图3识别出的斗齿数据如表3所示,可以看出6个斗齿被正常识别出。基于图4识别出的斗齿数据如表4所示,可以看出只有5个斗齿被正常识别出,第6个斗齿未识别出;

[0165]

表3基于图3识别出的斗齿数据

[0166]

斗齿识别率x左x右齿中心x与铲斗偏差11.0004797216001221.0007851012899530.999108913001195040.9881397160415011450.9531693190017971960.77119862208209727

[0167]

表4基于图4识别出的斗齿数据

[0168]

斗齿识别率x左x右齿中心x与铲斗偏差11.000265575420520.9896509077793630.943993124811215140.92613831625150410750.916173019641847123

[0169]

步骤七、重置对应斗齿检查次数为5;

[0170]

步骤八、所有斗齿齿1-齿6检查次数减1,对于图4的情况,连续5次就会触发报警;

[0171]

步骤九、判断齿1-齿6检查次数是否为0,如果判断结果为“是”则进行下一步,如果

为“否”则返回步骤二;

[0172]

步骤十、触发相应斗齿检查次数为0的报警,返回步骤二。

[0173]

(2)如图5所示,钩铁脱落算法:

[0174]

步骤一、初始化铲斗识别率为0.5,钩铁识别率为0.1,钩铁1-钩铁5检查次数为n,此处取n为5。当识别到铲斗并且识别到钩铁1-5时,会将对应钩铁的检查次数重置为5。当识别到铲斗并且没有识别到某个钩铁时,会将对应钩铁的检查次数减1,检查次数为0时会触发报警;

[0175]

步骤二、从安装在电铲铲斗上方的高清红外摄像头获取图像;

[0176]

步骤三、基于获取的图像识别是否有铲斗出现并且识别率大于等于0.5,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

[0177]

步骤四、基于获取的图像识别是否有钩铁出现并且识别率大于等于0.1,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

[0178]

步骤五、获取识别出的铲斗坐标及宽度,在x坐标方向把铲斗平均分为7等份,从左到右第2到第6份的5等份分别对应钩铁1-5位置;

[0179]

步骤五、获取识别出的铲斗坐标及宽度,在x坐标方向把铲斗平均分为7等份,计算每等份中心位置,从左到右第2到第6份的5等份分别对应钩铁1-5位置,图3识别铲斗数据如表5所示;

[0180]

表5基于图3识别出的铲斗及7等份数据

[0181][0182]

步骤六、基于获取的图像识别出钩铁坐标,计算每个钩铁中心x坐标,判断是否在铲斗2-6等份中心偏差100像素范围内,如果判断结果为“是”则进行下一步,如果为“否”则开始步骤八。基于图3识别出的钩铁数据如表6所示,可以看出5个钩铁被正常识别出;

[0183]

表6基于图3识别出的钩铁数据

[0184]

钩铁识别率x左x右钩铁中心x与铲斗偏差10.993763915839820.9571036117711072130.9481311144213773640.7991586171316505450.95918441963190453

[0185]

步骤七、重置对应钩铁检查次数为5;

[0186]

步骤八、所有钩铁1-钩铁5检查次数减1;

[0187]

步骤九、判断钩铁1-钩铁5检查次数是否为0,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

[0188]

步骤十、触发相应钩铁检查次数为0的报警,返回步骤二。

[0189]

(3)如图6所示,异形、a形脱落识别:

[0190]

步骤一、初始化铲斗识别率为0.5,异形、a形识别率为0.1,异形左、异形右、a形左、a形右检查次数为n,此处取n为5。当识别到铲斗并且识别到异形左、异形右、a形左、a形右时,会将对应异形、a形的检查次数重置为5。当识别到铲斗并且没有识别到某个异形、a形时,会将对应异形、a形的检查次数减1,检查次数为0时会触发报警;

[0191]

步骤二、从安装在电铲铲斗上方的高清红外摄像头获取图像;

[0192]

步骤三、基于获取的图像识别是否有铲斗出现并且识别率大于等于0.5,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

[0193]

步骤四、基于获取的图像识别是否有异形、a形出现并且识别率大于等于0.1,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

[0194]

步骤五、获取铲斗坐标及宽度,在x坐标方向把铲斗最小值和最大值分别对应异形、a形左右位置;

[0195]

步骤五、获取识别出的铲斗坐标及宽度,在x坐标方向把铲斗最小值和最大值分别对应异形、a形左右位置;

[0196]

表7基于图3识别出的铲斗最小值和最大值数据

[0197][0198]

步骤六、基于获取的图像识别出异形、a形坐标,对于左侧异形、a形取其x坐标最小值,对于右侧异形、a形取其x坐标最大值,判断是否在铲斗最小值和最大值100像素范围内,如果判断结果为“是”则进行下一步,如果为“否”则开始步骤八。基于图3识别出的钩铁数据如表8所示,可以看出2个异形和2个a形被正常识别出;

[0199]

表8基于图3识别出的异形、a形数据

[0200]

对象识别率x与铲斗偏差异形左0.98736746异形右0.68523565a形左0.99635837a形右0.99233724

[0201]

步骤七、重置对应异形、a形检查次数为5;

[0202]

步骤八、所有异形、a形检查次数减1;

[0203]

步骤九、判断异形、a形检查次数是否为0,如果判断结果为“是”则进行下一步,如果为“否”则返回步骤二;

[0204]

步骤十、触发相应异形、a形检查次数为0的报警,返回步骤二。

[0205]

以上所述仅为本发明的较佳实施例,并不用以限制本发明的思想,凡在本发明的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1