基于双流编码和交互解码的显著性检测网络系统

1.本发明涉及计算机视觉和图像处理领域,特别是涉及一种基于双流编码和交互解码的显著性检测网络。

背景技术:

2.随着图像数据急剧增长,如何准确、高效地分析并处理图像信息是现如今计算机视觉领域要解决的首要问题,图像的显著性检测正是为解决该问题而产生的一个重点研究方向。

3.目前,基于卷积神经网络的大部分显著性检测方法依据cnn(卷积神经网路)构建编码-解码结构的网络,在编码阶段使用预训练的深度神经网络(vgg)或resnet(残差网络)提取图像特征,在解码阶段通过侧向连接对特征图进行传递、融合,得到显著图(显示每个像素独特性的图像)。编码-解码结构和侧向连接在一定程度上降低了信息的丢失,提升了检测的精度,但现有方法中特征提取网络往往采用共享的编码器,导致边界信息丢失;同时,主体检测网络和边界检测网络之间特征传递易形成误差闭环,导致网络误差累积及显著性区域缺失。另外,检测网络中多次使用卷积和采样运算,易破坏显著目标的边界结构和局部纹理。

技术实现要素:

4.针对现有技术中存在的特征提取不充分且没有检测显著目标边界因而导致检测结果部分显著区域缺失、显著目标边界误差等问题,本发明提出一种基于双流编码和交互解码的显著性检测网络系统,构建双流编码器分别用于区域特征和边界特征提取以消除域间差异和误差闭环;所构建的交互解码网络将区域特征和边界特征进行互补融合,并设计位置指导模块和边界补偿模块进行细化,以恢复缺失的位置和边界信息;融合阶段将多尺度区域特征相融合得到显著性检测结果。

5.本发明利用以下的技术方案来实现:

6.一种基于双流编码和交互解码的显著性检测网络系统,该系统包括依序连接的总数据集合、双流编码模块、交互解码模块和融合模块;其中:

7.所述总数据集合包括训练集、测试集;

8.所述双流编码模块和所述交互解码模块区域-边界互补融合网络,所述编码模块由主体区域特征提取网络和边界特征提取网络构成;实现原始图像特征的特征提取,进而实现原始图像的边界提取;

9.所述交互解码模块由边界检测网络和主体检测网络组成,利用边界检测网络与主体检测网络共同实现了针对不同的任务进行网络训练;

10.融合模块,从解码得到的多尺度主体特征图上采样到原图像的尺度,对主体区域特征图进行通道堆叠、卷积映射操作,以得到最终的显著性检测结果。

11.不同于现有参数共享编码方式,本发明能够达成以下技术效果:

12.1)能够消除域间差异和误差闭环,恢复缺失的位置和边界信息,将多尺度区域特征相融合得到显著性检测结果;

13.2)对多目标和复杂场景的检测结果更加出色,相比其它大部分方法的检测结果更加完整,减少了部分显著区域缺失;

14.3)降低了显著性检测技术的平均绝对误差。

附图说明

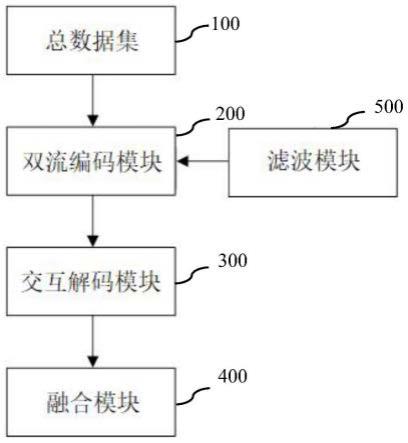

15.图1为本发明的基于双流编码和交互解码的显著性检测系统的检测方法整体流程示意图;

16.图2为双流编码模块和交互解码模块所构成的区域-边界互补融合网络结构;

17.图3为第二级的交互结构;

18.图4为融合输出网络;

19.图5为特征滤波模块结构图,(a)空间滤波,(b)通道滤波;

20.图6为本发明与主流检测方法的主观对比示意图。

具体实施方式

21.以下结合附图和具体实施例对本发明的技术方案进行详细说明。

22.如图1、图2所示,为本发明的基于双流编码和交互解码的显著性检测网络系统整体流程示意图。该系统包括总数据集合100、双流编码模块200、交互解码模块300、融合模块400。其中:

23.总数据集合100包括训练集、测试集:使用了公共数据集duts,duts是最大的、场景复杂、内容丰富的显著性检测数据集,有10553张训练图像(duts-tr)和5019张测试图像(duts-te),其中所有的训练图像来自imagenet的训练集和验证集,而测试图像来自imagenet的测试集和sun数据集;

24.如图2所示,为本发明的双流编码模块和交互解码模块所构成的区域-边界互补融合网络结构示意图。编码模块200由主体区域特征提取网络和边界特征提取网络构成。主体区域特征提取网络将原始图像作为输入,记为i。边界特征提取网络根据原始图像像素值及空间距离进行聚类,实现原始图像的边界提取,聚类结果(提取到的原始图像的边界)作为边界特征提取网络的输入,记为e。所述编码模块采用独立双流编码器,可以有效避免现有方法采用共享编码器带来的误差累积和显著性区域缺失等。所述主体特征提取网络由五个串联的残差卷积块组成,使用经imagenet数据集预训练的resnet进行图像特征的提取,得到五阶初始主体特征{ri},i=1,2,3,4,5;所述边界特征提取网络由五阶最大化采样层构成,得到初始边界特征{bi},i=1,2,3,4,5,表达式如下:

[0025][0026]

其中,h

fe,i

(

·

)表示第i个特征的提取函数,h

pooling,i

(

·

)表示第i个特征的最大化采样函数,i表示主体区域特征提取网络的输入,e表示边界特征提取网络的输入;

[0027]

交互解码模块300由边界检测网络和主体检测网络组成。边界检测网络与主体检

测网络采用相同的结构,利用边界检测网络与主体检测网络共同实现了针对不同的任务进行网络训练,但参数不共享。如图3所示,为边界检测网络与主体检测网络的交互示意图。边界检测网络将初始边界特征bi和初始主体特征作ri为输入,以逐元素相加的融合方式消除显著目标内部的边界,并通过多组核为3

×

3大小的卷积层逐渐消除显著目标外部的边界,得到修正的边界特征b

′i。主体检测网络再使用边界特征补偿主体特征,将初始主体特征ri和修正的边界特征b

′i作为输入,以通道堆叠的融合方式弥补部分主体特征缺失导致检测不完整的缺陷,得到修正的主体特征r

′i,该过程表示为:

[0028][0029][0030]

其中,表示特征图逐像素相加,

⊙

表示特征图通道堆叠,f3×3(

·

)表示经过3

×

3大小的卷积层;

[0031]

另外,在交互解码模块300中还设计了位置指导(利用边界检测网络来实现)和边界补偿(利用主体检测网络来实现)以实现边界和主体信息优势互补,可优化显著目标的边界并约束显著目标的主体,有效解决检测结果边界模糊、部分显著区域缺失问题;上述过程表明,通过解码模块300能够获得多尺度主体特征图。

[0032]

融合模块400,从解码得到的多尺度主体特征图上采样到原图像的尺度,对主体区域特征图进行通道堆叠、卷积映射等操作,以得到最终的显著性检测结果。如图4所示,为融合模块结构示意图。融合模块400由融合输出网络构成,融合输出网络包括一个3

×3×

c卷积层(conv)、一个1

×1×

c卷积层(conv)和一个1

×

1卷积层(conv),其中c代表输出通道数。

[0033]

本发明的基于双流编码和交互解码的显著性检测网络系统还设置有滤波模块500,对作为双流编码模块200输入的主体区域特征图所进一步包括的深层特征和浅层特征分别设计了两种滤波网络模型,分别为空间滤波网络和通道滤波网络。其中,(a)空间滤波网络,包含两支卷积网络,一支由核为1

×

3,输出通道为c/2,和核为3

×

1,输出通道为1的两个卷积层构成;另一支由核为1

×

3,输出通道为c/2,和核为1

×

3,输出通道为1的两个卷积层构成。输入的主体区域特征图经空间滤波网络提取出空间特征u1

sa

和u2

sa

,空间特征对输入的特征图进行调整、融合。该过程表示为:

[0034][0035]ri

=f

sigmoid

(u1

sari

+u2

sari

)

ꢀꢀꢀꢀꢀ

(5)

[0036]

其中,f

sigmoid

表示激活函数。

[0037]

(b)通道滤波网络由三部分组成:首先由核为1

×

1、3

×

3和5

×

5的卷积运算完成多种感受野下的特征感知;然后提取多种感受野下特征图的全局信息u

ca

,该过程表示为:

[0038][0039][0040]

其中,f

gp

(

·

)表示全局平均池化。最后,通过两层全连接层和softmax函数选择多种感受野下的最优特征权重,实现特征图的自适应加权,该过程表示为:

[0041]

{w

i,1

,w

i,3

,w

i,5

}=f

softmax

(f

fc

(f

fc

(u

ca

)))

ꢀꢀꢀꢀꢀꢀ

(8)

[0042][0043]

其中,f

softmax

表示softmax激活函数,f

fc

(

·

)表示全连接层;

[0044]

本发明中,交互解码模块300的边界检测网络和主体检测网络两支解码网络使用两种不同的损失函数,其中,对于边界检测网络b,使用标准的二元交叉熵,损失函数如式(10)所示:

[0045][0046]

其中,表示预测的第i个特征边界图中点k的像素值,表示真实的第i个特征边界图中点k的像素值,真实的边界图来自真实显著图的膨胀腐蚀之差。

[0047]

对于主体检测网络r,使用增强的二元交叉熵,如式(11)所示:

[0048][0049]

其中,max(

·

)表示最大化函数,表示预测的第i个特征显著图中点k的像素值,表示真实的第i个特征显著图中点k的像素值。

[0050]

最终,对于边界检测网络b和主体检测网络r构成的网络整体,损失函数表示为:

[0051][0052]

其中,λi和δi为两支解码网络中损失函数的调节因子。

[0053]

下面将本发明提出的显著性检测模型与14种最先进的显著性检测方法进行比较,对比算法包括pagr、pican、icnet、basnet、afnet、page、itsd[、pfanet、cpd、mlms、dfi、egnet、scrn和banet。

[0054]

如表1所示,为五种数据集上不同显著性检测方法的最大f值和平均绝对误差,最好的三种结果使用“_”、绿标注。

[0055]

表1

[0056][0057]

由此可见,本发明提出的显著性检测系统取得了不错的性能,尤其是在平均绝对误差上,本发明在duts-te数据集中取得了最优,相比主流方法在平均绝对误差方面平均降低了0.0093,在ecssd、hku-is和pascal-s数据集中也达到了先进的水平。

[0058]

为了直观、全面的评价本发明算法的性能,本发明与部分显著性检测算法的检测结果进行比较。如图6所示,为本发明与主流检测方法的主观对比分析示意图。从图6看出,本发明方法取得了不错的检测结果,尤其对多目标和复杂场景的检测,本发明的检测结果更加出色,相比其它大部分方法的检测结果更加完整,减少了部分显著区域缺失。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1