实体识别模型训练方法、实体识别的方法及系统与流程

1.本发明涉及人工智能技术领域,尤其涉及一种实体识别模型训练方法、实体识别的方法及系统。

背景技术:

2.自然语言处理(nlp,natural language processing)是研究人与计算机交互的语言问题的一门学科。按照技术实现难度的不同,这类系统可以分成简单匹配式、模糊匹配式和段落理解式三种类型。

3.构成nlp的重要技术之一为知识抽取,知识抽取中主要包括三个核心子任务:实体识别、关系抽取以及事件抽取。

4.实体识别是信息提取、问答系统、句法分析、机器翻译、数据标注等应用领域的重要基础工具,在自然语言处理技术走向实用化的过程中占有重要地位。

5.目前针对实体识别的解决方案中,都是构建复杂的实体识别模型来实现,需要大量的gpu显卡资源,当构建的实体识别模型过于复杂的时候,势必会消耗大量的硬件成本。

技术实现要素:

6.本发明为解决现有技术中存在的技术问题,提出一种实体识别模型训练方法,包括步骤:

7.s1:构建实体识别模型,所述实体识别模型包括第一神经网路和第二神经网路;

8.s2:对第一神经网络进行离线预测:将训练数据输入第一神经网路,得到第一神经网络的输出层的特征,并保存预测的每个样本的logits:

9.s3:加载第一神经网络的预测结果和第二神经网络;

10.s4:对第二神经网络进行压缩处理;

11.s5:计算第一神经网络离线预测的logits的损失和第二神经网络在线预测的logits的损失;

12.s6:计算第二神经网络的总损失,根据总损失更新第二神经网络参数。

13.进一步地,第二神经网络的总损失为将第一神经网络离线预测的logits的损失、第二神经网络在线预测的logits的损失和交叉熵损失进行加权求和。

14.进一步地,第一神经网络的模型采用12层transformer的bert构建。

15.进一步地,第二神经网络的模型采用2层transformer作为特征提取器。

16.本发明还提供一种实体识别的方法,包括步骤:

17.接收输入的句子;

18.实体识别模型对输入的句子进行处理;

19.返回输出结果,

20.所述神经网络为实体识别模型训练方法得到的实体识别模型。

21.进一步地,返回输出结果包括:

22.若所述实体识别模型的得到实体,则输出所得到的实体作为所识别的实体;

23.如果所述实体识别模型没有识别出实体,则输出所述实体识别模型的实体匹配预测结果。

24.本发明还提供一种用于实体识别的系统,包括获取模块、处理模块以及输出模块,其中:

25.获取模块用以接收输入的句子;

26.处理模块对输入的句子进行处理并识别得到实体;

27.输出模块用以返回输出结果,

28.所述处理模块为实体识别模型训练方法得到的实体识别模型。

29.进一步地,所述输出模块包括检索单元,用以当处理模块没有识别出实体时,从实体向量库中输出与预测相匹配的实体。

30.本发明还提供一种计算机可读存储介质,所述存储介质中存储有指令或者程序,所述指令或者程序由处理器加载并执行所述的实体识别的方法。

31.本发明还提供一种电子设备,包括:处理器、存储介质和总线,所述存储介质存储有所述处理器可执行的机器可读指令,当电子设备运行时,所述处理器与所述存储介质之间通过总线通信,所述处理器执行所述机器可读指令,以所述的实体识别的方法。

32.本发明公开的方法和系统中所述模块,在实际应用中,即可以在一台目标服务器上部署多个模块,也可以每一模块独立部署在不同的目标服务器上,特别的,根据需要,为了提供更强大的计算处理能力,也可以根据需要将模块部署到集群目标服务器上。

33.由此可见,本发明先以离线的方式对第一神经网络进行预测,保留特征,再训练第二神经网络,大大减少了硬件的计算成本。

34.为了对本发明有更清楚全面的了解,下面结合附图,对本发明的具体实施方式进行详细描述。

附图说明

35.为了更清楚地说明本技术实施例中的技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍。显而易见地,下面描述中的附图仅仅是本技术的一些实施例,对于本领域技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

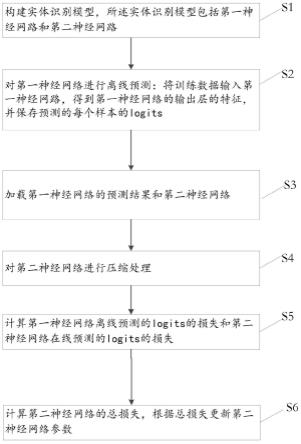

36.图1为本技术实施例的实体识别模型训练方法流程示意图。

具体实施方式

37.请参阅图1,本发明为解决现有技术中存在的技术问题,提出一种实体识别模型训练方法,包括步骤:

38.s1:构建实体识别模型,所述实体识别模型包括第一神经网路和第二神经网路;

39.s2:对第一神经网络进行离线预测:将训练数据输入第一神经网路,得到第一神经网络的输出层的特征,并保存预测的每个样本的logits:

40.s3:加载第一神经网络的预测结果和第二神经网络;

41.s4:对第二神经网络进行压缩处理;

42.s5:计算第一神经网络离线预测的logits的损失和第二神经网络在线预测的logits的损失;

43.s6:计算第二神经网络的总损失,根据总损失更新第二神经网络参数。

44.下面结合各种优选的实施方式说明本技术的技术方案。

45.本技术实施例中,构建实体识别模型包括第一神经网络和第二神经网络,为了进一步优化,本技术设置第一神经网络的复杂会比第二神经网络要复杂。其中,第一神经网络的模型采用12层transformer的bert构建。第二神经网络的模型采用2层transformer作为特征提取器。当然作为变化的实施方式,也可以使用其他适合用于抽取句子特征的神经网络模型或者结构。

46.在上述步骤s5中,本技术实施例采用mse损失函数计算第一神经网络离线预测的logits和第二神经网络在线预测的logits的损失。

47.为了进一步优化网络的训练成本,本技术还对第二神经网络进行压缩处理,具体压缩方法可以使用现有技术来进行压缩,从而进一步减少了第二神经网络的模型复杂度,大大减少了硬件上的计算成本。

48.在采取压缩之后,为了进一步优化第二神经网络,还需要考虑设置合适的损失函数来进行计算。为此,本技术提出一种优选的实施方式,第二神经网络的总损失为将第一神经网络离线预测的logits的损失、第二神经网络在线预测的logits的损失和交叉熵损失进行加权求和。

49.由此可见,本技术先以离线的方式对第一神经网络进行预测,保留特征,再训练第二神经网络,大大减少了硬件的计算成本。

50.基于上述实施例,本发明还提供一种实体识别的方法,包括步骤:

51.接收输入的句子;

52.实体识别模型对输入的句子进行处理;

53.返回输出结果,

54.所述神经网络为实体识别模型训练方法得到的实体识别模型。

55.进一步地,返回输出结果包括:

56.若所述实体识别模型的得到实体,则输出所得到的实体作为所识别的实体;

57.如果所述实体识别模型没有识别出实体,则输出所述实体识别模型的实体匹配预测结果。具体的预测方法为,在实体向量库中执行检索,检索出与所述实体匹配预测输出相匹配的实体向量,进而将与所检索出的实体向量相对应的实体作为所识别的实体。

58.本发明还提供一种用于实体识别的系统,包括获取模块、处理模块以及输出模块,其中:

59.获取模块用以接收输入的句子;

60.处理模块对输入的句子进行处理并识别得到实体;

61.输出模块用以返回输出结果,

62.所述处理模块为实体识别模型训练方法得到的实体识别模型。

63.进一步地,所述输出模块包括检索单元,用以当处理模块没有识别出实体时,从实体向量库中输出与预测相匹配的实体。

64.本技术实施例还提供一种计算机可读存储介质,所述存储介质中存储有指令或者

程序,所述指令或者程序由处理器加载并执行如上述的实体识别的方法。

65.本技术实施例还提供一种电子设备,包括:处理器、存储介质和总线,所述存储介质存储有所述处理器可执行的机器可读指令,当电子设备运行时,所述处理器与所述存储介质之间通过总线通信,所述处理器执行所述机器可读指令,以执行如上述任一所述的实体识别的方法。

66.需要说明的是,本领域普通技术人员可以理解上述实施例的各种方法中的全部或部分步骤是可以通过计算机程序来指令相关的硬件来完成,所述计算机程序可以存储于计算机可读存储介质中,所述存储介质可以包括但不限于:只读存储器(rom,read only memory)、随机存取存储器(ram,random access memory)、磁盘或光盘等。

67.对所公开的实施例的上述说明,使本领域专业技术人员能够实现或使用本发明。对这些实施例的多种修改对本领域的专业技术人员来说将是显而易见的,本文中所定义的一般原理可以在不脱离本发明的精神或范围的情况下,在其它实施例中实现。因此,本发明将不会被限制于本文所示的这些实施例,而是要符合与本文所公开的原理和新颖特点相一致的最宽的范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1