一种基于多传感融合的检测缺陷图像融合方法

1.本发明属于激光增材制造缺陷检测技术领域,具体涉及一种基于多传感融合的检测缺陷图像融合方法。

背景技术:

2.激光增材制造技术是一种成熟的加工技术,其加工过程主要包括材料供应、准备、加工和后处理。在激光增材制造过程中,零件的三维模型被切割成薄层,粉末层通过重涂机制被铺展到粉末床和粉末储存器内,加工系统利用高功率密度激光进行逐层扫描来选择性地熔化金属粉末,可加工复杂三维结构,并有效地进行原位合金化处理。具有高斯能量分布的激光光斑与粉末相互作用,粉末颗粒瞬时熔融和凝固,产生了许多复杂的非平衡化学与物理冶金过程,涉及到流体流动、动量、质量和传热等。迄今为止,利用激光增材制造技术成功实现了各类合金与金属的加工,主要包括铝合金、不锈钢、镍基高温合金和钛合金等。在激光增材制造工艺过程中,影响零件质量的因素有很多,包括粉末尺寸、激光功率、扫描速度等,参数控制不当将导致缺陷产生并严重恶化零件的物理和机械性能。然而,增材制造在生产加工的过程中仍存在较大的局限性,其原因主要有两个:质量和可重复性,这可能受到增材制造工艺中某些缺陷(如裂纹、球化)的严重影响。

3.为了解决这个问题,国内外学者对增材制造缺陷检测技术进行了大量研究,以提高零件的加工质量,其中出现了一系列由多个传感器组成的检测系统,即多传感检测系统,基于多传感监测光、声、热等信号,可为激光增材制造工艺过程中的缺陷检测和表征提供更全面、可靠、准确的信息。然而,在利用多传感视觉检测系统对激光增材制造工件缺陷进行实际检测和表征的过程中,由于检测环境的变化等不确定性因素,容易导致图像传感器采集到的检测图像质量不佳,难以分辨缺陷细节特征。但是,仅通过提升硬件的方法来实现图像质量的提高不仅难度大、周期长,而且成本高。

技术实现要素:

4.为了克服现有技术的缺点与不足,本发明的目的在于提供一种基于多传感融合的检测缺陷图像融合方法,其能够有效提升缺陷检测图像对比度和信息丰富性,改善图像边缘缺陷轮廓和纹理信息,有效地保留并融合源图像中的主要信息,为缺陷特征提取与表征分析提供技术保障。

5.本发明提供的一种基于多传感融合的检测缺陷图像融合方法,所述缺陷检测图像融合方法主要应用于激光增材制造领域的工件缺陷检测,包括以下步骤:

6.(一)采用有限离散剪切波变换(fdst)将缺陷检测图像a和图像b分别分解为低频子带系数和高频子带系数;

7.(二)在所述fdst变换域,采用多尺度形态学翻转算子(mssto)分别提取图像a和图像b低频子带系数中的图像细节亮信息和暗信息;

8.(三)将经多尺度形态学翻转算子mssto提取的图像亮信息和暗信息并入图像a和

图像b的低频子代系数进行融合,得到低频融合系数;

9.将经所述mssto提取的图像亮信息和暗信息并入融合后的低频系数中,得到低频融合系数;

10.(四)在所述fdst变换域,采用改进的空间频率(msf)提取图像在垂直、水平和对角方向的梯度能量,计算所述高频子带系数的msf值,并作为脉冲耦合神经网络(pcnn)的外部激励;

11.(五)利用所述pcnn方法获取高频融合系数;

12.(六)利用有限离散剪切波变换fdst的逆变换,从低频融合系数和高频融合系数中重构出最终的融合图像。

13.利用所述fdst的逆变换,从融合后的所述低频子带融合系数和高频子带融合系数中重构出最终的融合图像。

14.本发明中,步骤(三)中,所述缺陷检测图像的低频子代系数融合策略表示为:

[0015][0016]

其中,为图像a在位置(i,j)处的低频子带融合系数,为图像b在位置(i,j)处的低频子带融合系数,为融合图像在位置(i,j)处的低频子带融合系数,γ和ε是用于提升融合缺陷检测图像对比度的低频子带融合权值系数,其取值范围是[0,4];mbf(i,j)是亮融合信息,mdf(i,j)是暗融合信息。

[0017]

本发明中,步骤(四)中,所述高频子带系数融合策略是计算所述高频子带系数的msf值,作为所述pcnn的外部激励。所述msf值表示为:

[0018][0019]

其中,cf为缺陷检测图像垂直方向的梯度能量,rf为水平方向的梯度能量,h和j为对角线方向的梯度能量。;

[0020]

本发明中,提取检测图像msf值的方法相比于传统的空间频率方法多计算了两个图像对角线方向的梯度能量,能够提取出更为丰富的图像信息,更适用于缺陷检测。

[0021]

本发明中,图像a、图像b独立的选自可见光图像、红外图像或偏振图像中的任一种。图像a和图像b融合处理后可再与另一种独立的检测图像进行融合。

[0022]

本发明中,利用平均梯度(ag)、信息熵(e)、空间频率(sf)、边缘强度(ei)、标准差(sd)、峰值信噪比(psnr)和结构相似度(ssim)来评价所述缺陷检测融合图像的性能。

[0023]

与现有技术相比,本发明具有以下优点和有益效果:

[0024]

(1)本发明方法主要应用于激光增材制造领域的工件缺陷检测,利用有限离散剪切波变换(fdst)对检测图像进行多尺度分解,相比于传统的方法可获取更多的方向选择性以及更快的计算速度;利用多尺度形态学翻转算子(mssto)提取缺陷检测图像的亮、暗特征,然后和检测源图像融合,能够有效提升检测图像缺陷区域对比度。

[0025]

(2)本发明方法中脉冲耦合神经网络(pcnn)能够充分利用缺陷检测图像的局部像素信息,能够克服传统高频系数融合方法的不足,便于设计融合规则和确定融合系数;提取检测图像msf值的方法相比于传统的空间频率方法能够提取出更为丰富的图像信息,更适用于缺陷检测。

[0026]

(3)本发明方法能够有效提升缺陷检测图像对比度和信息丰富性,改善检测图像缺陷边缘轮廓和纹理信息,有效地保留并融合源图像中的主要信息,对于激光增材制造多传感视觉检测系统中的缺陷信息融合与表征分析具有重要意义。

附图说明

[0027]

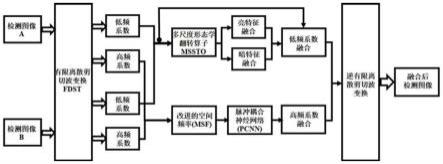

图1为本发明的一种基于多传感融合的检测缺陷图像融合方法示意图。

[0028]

图2为本发明实施例中的不同图像融合算法下的融合对比结果的示意图。

[0029]

图3为本发明实施例中的不同图像融合算法下客观评价指标对比的示意图。

具体实施方式

[0030]

下面结合实施例及附图,对本发明作进一步地详细说明,但本发明的实施方式不限于此。

[0031]

实施例,如图1所示,一种基于多传感融合的检测缺陷图像融合方法,主要应用于激光增材制造领域的工件缺陷检测,包括六个基本步骤:

[0032]

(一)采用有限离散剪切波变换(fdst)将缺陷检测图像a和图像b分别分解为低频子带系数和高频子带系数;

[0033]

(二)在fdst变换域,采用多尺度形态学翻转算子(mssto)分别提取图像a和图像b低频子带系数中的图像细节亮信息和暗信息;

[0034]

(三)将经多尺度形态学翻转算子mssto提取的图像亮信息和暗信息并入图像a和图像b的低频子代系数进行融合,得到低频融合系数;

[0035]

将经mssto提取的图像亮信息和暗信息并入融合后的低频系数中,得到低频融合系数;

[0036]

(四)在fdst变换域,采用改进的空间频率(msf)提取图像在垂直、水平和对角方向的梯度能量,计算高频子带系数的msf值,并作为脉冲耦合神经网络(pcnn)的外部激励;

[0037]

(五)利用pcnn方法获取高频融合系数;

[0038]

(六)利用有限离散剪切波变换fdst的逆变换,从低频融合系数和高频融合系数中重构出最终的融合图像。

[0039]

利用fdst的逆变换,从融合后的低频子带融合系数和高频子带融合系数中重构出最终的融合图像。

[0040]

进一步地,缺陷检测图像的低频子代系数融合策略表示为:

[0041][0042]

其中,为图像a在位置(i,j)处的低频子带融合系数,为图像b在位置(i,j)处的低频子带融合系数,为融合图像在位置(i,j)处的低频子带融合系数,γ和ε是用于提升融合缺陷检测图像对比度的低频子带融合权值系数,其取值范围是[0,4];mbf(i,j)是亮融合信息,mdf(i,j)是暗融合信息。

[0043]

进一步地,高频子带系数融合策略是计算高频子带系数的msf值,作为pcnn的外部激励。所述msf值表示为:

[0044][0045]

其中,cf为缺陷检测图像垂直方向的梯度能量,rf为水平方向的梯度能量,h和j为对角线方向的梯度能量。

[0046]

进一步地,图像a、图像b独立的选自可见光图像、红外图像或偏振图像中的任一种。图像a和图像b融合处理后可再与另一种独立的检测图像进行融合。

[0047]

进一步地,提取检测图像msf值的方法相比于传统的空间频率方法多计算了两个图像对角线方向的梯度能量,能够提取出更为丰富的图像信息,更适用于缺陷检测。

[0048]

进一步地,如图2所示,选取了梯度金字塔(gp)[1]、拉普拉斯金字塔(lp)[2]、低通比率金字塔(rp)[3]、pca[4]、双数复小波变换(dt-cwt)[5]和pcnn[6]这6种不同的融合算法与本发明方法进行缺陷检测图像融合效果对比。在融合结果中用红色框框选图像局部内容进行放大处理,并放置在图像的右下角。从结果中可以看出这几种不同的算法在不同程度上均能融合图像a和图像b中的主要信息,视觉效果相比于单幅图像有所改善,其中图像a和图像b分别是红外传感器和可见光传感器所采集到的缺陷检测图像。gp、pca、dt-cwt和pcnn算法处理后的图像整体效果较为模糊,框选区域的对比度较低,易造成关键目标信息的丢失。lp和rp算法的图像对比度有所提高,但是lp处理后图像整体较为昏暗,且两种算法处理后的图像目标区域边缘保持性较差,轮廓纹理特征不够清晰突出。进一步地,本发明方法处理后的图像在目标区域无论是对比度还是轮廓边缘细节的保持和清晰度方面都优于其他对比算法,使得图像缺陷区域细节丰富,更加便于视觉观测。

[0049]

进一步地,如图3所示,利用平均梯度(ag)、信息熵(e)、空间频率(sf)、边缘强度(ei)、标准差(sd)、峰值信噪比(psnr)和结构相似度(ssim)来客观评价所述缺陷检测融合图像的性能。从图中可以看出本发明方法在各项指标上均占有明显优势。本发明方法处理的融合图像的平均梯度为0.0338,信息熵为7.983,空间频率为24.450,边缘强度为123.327,标准差为75.225,峰值信噪比为19.325,结构相似度为0.745。从平均梯度指标来看,本发明相对于gp算法的平均提升率是43.91%,相对于lp算法的平均提升率是1.31%,相对于rp算法的平均提升率是36.57%,相对于pca算法的平均提升率是51.31%,相对于dt-cwt算法的平均提升率是0.62%,而相对于pcnn算法的平均提升率是23.50%,因此,本发明方法融合的图像具有更为丰富的梯度信息,对图像细节纹理信息反差的表达能力更强。

[0050]

进一步地,从信息熵指标来看,本发明方法相对于gp算法的平均提升率是2.84%,相对于lp算法的平均提升率是8.72%,相对于rp算法的平均提升率是4.89%,相对于pca算法的平均提升率是0.45%,相对于dt-cwt算法的平均提升率是10.66%,而相对于pcnn算法的平均提升率是1.21%,显见,本发明方法融合的图像对比度更大,信息量更为丰富。进一步地,从空间频率sf指标来看,本发明方法相对于gp算法的平均提升率是46.31%,相对于lp算法的平均提升率是10.47%,相对于rp算法的平均提升率是31.56%,相对于pca算法的平均提升率是56.23%,相对于dt-cwt算法的平均提升率是7.49%,而相对于pcnn算法的平均提升率是28.81%,显见,本发明方法融合的图像效果更佳。

[0051]

进一步地,相对于gp、lp、rp、pca、dt-cwt和pcnn算法,本发明方法在边缘强度指标上的平均提升率分别为37.40%、7.47%、25.93%、35.69%、3.13%和24.09%,表明其处理的缺陷检测图像边缘效果更为明显,有利于实现视觉检测系统中的缺陷识别与特征提取。

进一步地,在标准差指标上的平均提升率分别为43.09%、18.66%、45.09%、7.25%、6.63%和40.92%,在峰值信噪比指标上的平均提升率分别是13.10%、44.52%、41.31%、5.99%、19.94%和26.09%。进一步地,在结构相似度指标上,相对于lp、rp、pca、dt-cwt和pcnn算法,本发明方法的平均提升率分别为3.94%、8.54%、2.01%、1.74%和13.27%,相比于gp算法,ssim指标下降了4.42%,但是在可接收范围内,缺陷检测图像融合处理后的整体质量得到了有效提升。

[0052]

上述实施例仅为本发明的一种实施方式,但本发明的实施方式并不受上述实施例的限制,其他任何未背离本发明的精神实质与原理下所作的改变、修饰、替代、组合、简化均应为等效的置换方式,都包含在本发明的保护范围之内。

[0053]

参考文献

[0054]

[1]li m j,yu b d,xiao l w.image fusion algorithm based on wavelet transform and laplacian pyramid[j].advanced materials research,2013:2846-2849

[0055]

[2]toet a.image fusion by a ratio of low pass pyramid pattern recogn[j].pattern recognition letters,1989,9(4):245-253

[0056]

[3]lewis j j,o’callaghan r j,nikolov s g,et al.pixel-and region-based image fusion with complex wavelets[j].information fusion,2007,8(2):119-130.

[0057]

[4]shahdoosti h r.combining the spectral pca and spatial pca fusion methods by an optimal filter[j].information fusion,2016,27(c):150-160.

[0058]

[5]h.multivariate regression techniques and tools[m].social compass,2001.

[0059]

[6]shu z b.pcnn model automatic linking strength determination based on geometric moments in image fusion[j].journal of algorithms&computational technology,2014,8(1):17-26。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1