一种基于三维人体建模点云特征编码的步态识别方法与流程

1.涉及人体三维建模和步态识别领域,具体为一种基于三维人体建模点云特征编码的步态识别方法。

背景技术:

2.以往的步态识别方法主要可分为两类,即基于模型的方法和基于外观的方法。基于外观的方法侧重于外观轮廓信息或通过前景提取算法获得的剪影表示,这类方法对于协变量(如视角、携带状态和服装)的变化相对敏感。基于模型的方法试图通过利用动态骨架关节点的信息来提取步态特征,骨架信息对于视角变化、衣服和携带等条件具有鲁棒性。然而,由于对骨架关节点估计准确性不足以及骨架输出空间的高自由度和低信息维度,基于模型的步态识别方法在识别准确率上很难超越基于外观的识别方法,尤其在跨视角步态识别问题上,仅通过有限的骨架关节点坐标信息表征复杂的步态特征,无法捕获细微的动态变化以及容易忽略关节点局部信息。这种粗糙的人体建模方法是制约基于模型的方法取得超过基于轮廓的方法识别性能的主要原因。多人蒙皮线性模型(skinned multi-person linear model,smpl)是一种精细化的人体建模方法,其主要思想是将人体形状特征和姿态特征进行解耦,用参数化的方式描述人体外表面的三维信息。它可以生成一个由6980个顶点组成的人体三维网格,非常适合步态模式的学习。人体三维网格比骨架关节点和剪影序列特征涵盖了更多的表面几何信息。传统的基于网格的深度学习网络模型很难直接对原始网格序列数据进行建模,因为其中的点坐标是不规则和无序的。基于点云数据人体建模方法固有的旋转不变性和尺度不变性使其适合于人体表面几何关系的挖掘,同时对于摄像头的角度以及距离的变化具有很强的适应性,可以有效解决跨视角下步态识别的问题。为了更好地捕捉局部表面几何信息和动态特征,我们提出了一种基于点云的步态识别方法,通过smpl模型网格数据中获得的点云信息提取步态鉴别特征进行身份识别和情绪识别。

技术实现要素:

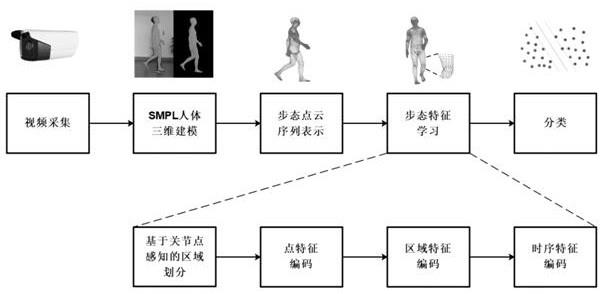

3.本发明针对基于模型的步态识别方法由于骨架输出空间的高自由度和低信息维度导致识别性能不佳的问题,提出了一种基于点云特征编码的步态识别的方法,融合了点特征编码、区域特征编码以及时序特征编码,从高维度的时序点云数据中捕捉具有鉴别性的局部空间依赖和全局动态特征,对现有步态识别方法进行了创新性的补充和实质性的改进。

4.本发明提供的一种基于点云特征编码的步态识别的方法,具体包括以下步骤:步骤1)步态时序点云数据获取由于骨架输出空间的高自由度和低信息维度,基于模型的步态识别方法在识别准确率上很难超越基于外观的识别方法,仅通过有限的骨架关节点坐标信息表征复杂的步态特征,无法捕获细微的动态变化以及容易忽略关节点局部信息。本发明采用参数化人体模型smpl来获取人体三维模型化参数,包括:形态参数,姿态参数和相机参数,然后通过

添加时序平滑约束和时序一致性约束从预测的参数中获取6890个三维人体表面网格顶点坐标序列以及25个关节点三维坐标序列。

5.步骤2)基于关节点感知的区域划分由于骨架关节点表示的低维度和模糊性以及网格参数表示的高维度、无序性的特点,均不利于步态时空特征的学习。因此,本发明将骨架感知融入到三维人体网格数据的学习中,提出了一个基于关节点感知的点划分模块,以25个关节点的位置为中心,将点云数据划分为25个子区域,通过更好地将无序的点特征映射到有序的骨架关节上来聚合局部信息,以便提取更具鉴别性的时空特征。

6.步骤3)空间点云特征学习借鉴了cnn的多层感受野的思想,对步骤2)划分出的子区域分别采用分层堆叠的点特征编码层(point-wise encoding)和区域特征编码层(region-wise encoding)进行特征提取,以捕捉每一帧步态点云数据中的局部和全局的空间几何特征,并将各区域空间点云特征聚合到邻近的骨架关节点上。

7.步骤4)时序点云特征学习为了获取帧间的步态动态特征,设计了基于transformer的时序特征编码器(frame-wise encoding)将步态身份和情绪特征映射到同一个共享空间进行分类,通过多任务学习策略,从编码向量中提取出辨别特征,用于步态身份识别和情绪识别。

8.优选地,所述步骤1)中的步态时序点云数据获取,包括以下步骤:1-1)在实际应用环境下,步态视频数据通过摄像头采集,标注信息为被测对象的身份id号及情绪状态(例如:沮丧、快乐、愤怒、中性等)。采集的视频数据要求画质清晰、无卡顿,被测对象处于镜头中间区域内,训练集和测试集需要保持分辨率和采样帧率参数的一致。

9.1-2)通过预训练网络模型(类似于hmr、vibe等)回归出smpl模型形态参数,姿态参数和相机参数,通过构建时序平滑约束和时序一致性约束对训练网络模型进行微调,假设第帧,网络估计出的参数为,引入姿态时间平滑约束和相机时间平滑约束,对应的损失函数为:其中,为姿态时间平滑约束损失函数,为相机时间平滑约束损失函数, 为视频序列的帧数;形态参数一致性约束的损失函数为:

其中代表序列中的平均形状参数;经过优化后的smpl参数能获得更准确的三维人体表面网格坐标和三维关节点位置坐标。

10.1-3)根据相机参数旋转坐标系,将三维网格坐标和关节点坐标统一到侧面视角下,并将6890个网格坐标位置作为步态点云数据进行后续处理。

11.优选地,所述步骤2)中的步态时序点云数据获取,包括以下步骤:以步骤1)获得的25个关节点的位置为中心,采用是k近邻(knn)范围查询的方式找到固定的数量为256的相邻点,将相邻点的集合作为一个关节点感知分区域,表示划分为25个子区域的每一帧的点云数据,表示$v$子区域内的点集,由此将6980个点划分为25个子区域。

12.优选地,所述步骤3)中的步态时序点云数据获取,包括以下步骤:3-1)对步骤2)划分出的各子区域进行区域中心点采样和领域分组,使用最远点采样fps对点集进行降采样,将输入点集从规模降到更小的规模;先随机选择一个点作为已选择采样点集中的初始点,然后在未选择的点集中再选择离这个点距离最远的点加入到已选择采样点集中,再继续迭代,直到选出目标数量采样点个数为止;再以这些采样点为中心采用球查询(query ball point)的方式找到周围找到k个邻近点,与邻近点共同组成局部区域,该步骤输出维度为。

13.3-2)对步骤3-1)获得的局部区域进行特征聚合,使用pointnet 作为局部特征学习的基本模块,将局部区域中k个点坐标转换成以相对于局部区域中心点的的相对坐标:,其中,, 是中心坐标;通过mlp和pooling的操作,该层的输出维度为,通过shared mlp将特征维度从提升到。

14.3-3)通过点特征编码提取了关节点邻域精细的几何特征,还需要对多区域特征进行聚合来获取全局的空间几何依赖关系,这里使用基于图卷积神经网络gcn进行逐层聚合提取全局特征;gcn聚合方法本质上是加权求和的过程,将邻居点通过度矩阵及其邻接矩阵,计算出各边的权重,根据权值对节点特征求加权平均,计算过程由以下公式表示:其中a为图结构的邻接矩阵,d为图结构的度矩阵,为图卷积层上的卷积核,这里使用图划分策略,将划分为三个子图,分别表达向心运动、离心运动和静止的动作特征;三个卷积核的卷积结果分别表达了不同尺度的动作特征;最后对各卷积核的卷积结果进行加和来表征单帧步态点云数据的全局空间特征。

15.优选地,所述步骤4)中的步态时序点云数据获取,包括以下步骤:

4-1)通过步骤3)中的点特征编码和区域特征编码模块捕捉了每一帧步态点云数据中的局部和全局的空间几何特征,将提取的空间特征向量进一步送入到时序特征编码器进行动态特征提取;时序特征编码器由l层transformer encoder组成,具有多层级的多头自注意力模块和前馈模块;将点云空间几何特征嵌入向量输入到时序特征编码器层,并在输入的特征向量中预置一个可学习的token作为类标记[cls],其最后一个transformer编码器层的状态作为全局动态特征表示,最终的类标记;此外,位置嵌入被添加到输入向量中,通过一个可学习的位置嵌入矩阵来保留位置信息;这个类标记[cls]通过自注意力机制在输入序列之间传播信息,并将它们的信息汇聚成对不同任务具有辨别力的动态特征表示,最后通过一个线性分类头(mlp head)来进行分类。

[0016]

4-2)采用多任务学习策略,从编码向量中提取出辨别特征,用于步态身份识别和情绪识别;这两个识别任务在转换层后共享相同的类标记嵌入向量;为了预测输出类别,使用一个两层多层感知器mlp,通过高斯误差线性激活单位gelu,最后送入softmax分类器,得到预测的类别标签;步态身份识别和情绪识别的目标函数采用交叉熵损失函数:其中和分别是样本真实的身份标签和情绪标签,和为模型的输出,超参数和是正则化权重。

[0017]

相对于现有技术,本发明的优点如下:本发明提供了一种基于点云特征编码的步态识别的方法,首先设计时序一致性约束和时序平滑约束对smpl模型进行优化以获得更加准确的三维网格参数和三维姿态参数,缓解了三维姿态估计中的深度模糊、自遮挡、2d转3d固有的歧义等问题;此外,所提出的基于点云的步态识别方法融合了点特征编码、区域特征编码、时序特征编码从高维度的时序点云数据中捕捉具有鉴别性的局部空间依赖和全局动态特征,突破了现有基于骨架的方法和基于轮廓的方法(如图3所示)的约束,进行了创新性的补充和实质性的改进;进一步地,该方法通过多任务学习架构在步态子任务间共享信息,学习统一的步态特征空间,实现步态身份和情绪的联合识别。本发明提供的方法步骤简单,易于实现,并且可以达到很好的步态多任务识别效果。

附图说明

[0018]

图1为本发明一种基于三维人体建模点云特征编码的步态识别方法流程图。

[0019]

图2为本发明一种基于三维人体建模点云特征编码的步态识别方法网络结构图。

[0020]

图3为本发明与现有主流步态识别方法对比示意图。

[0021]

图4为本发明提取的步态特征通过pca降维在三维空间中的分布示意图。

具体实施方式

[0022]

下面将结合附图和实施例对本发明进行进一步的详细说明:首先,为了帮助理解本发明的技术方案,对本发明涉及的部分名词进行解释说明。

[0023]

mlp:多层感知机(multilayer perceptron),具有输入层、隐含层和输出层的多层神经网络结构,其中隐含层可以有多层。

[0024]

cnn:卷积神经网络(convolutional neural networks)。

[0025]

gcn:图卷积神经网络(graph convolutional networks)。

[0026]

pointnet:点云神经网络。

[0027]

transformer:本质上由一个encoder和一个decoder构成的神经网络结构,它可以提升计算机视觉方向用于捕捉图像上的感受野,或者nlp中用于定位关键token或者特征。

[0028]

smpl模型:一个可以根据一些输入参数创建人体三维姿态的模型。它可以表现出不同的身形(高矮胖瘦),可以随着不同的姿势自然变形,并且模型渲染快速,部署简单。它的输入参数为一个10维的形态参数和一个3

×

24维的姿态参数,输出为6890个网格顶点以及13776个三角面的网格。

[0029]

损失函数:衡量神经网络预测值和真实值差异多少的函数,损失函数的输出值越小,神经网络模型的预测效果越好。

[0030]

一种基于三维人体建模点云特征编码的步态识别方法,其流程图如图1所示,深度神经网络结构图如图2所示,该方法具体步骤包括:步骤1)步态时序点云数据获取由于骨架输出空间的高自由度和低信息维度,基于模型的步态识别方法在识别准确率上很难超越基于外观的识别方法,仅通过有限的骨架关节点坐标信息表征复杂的步态特征,无法捕获细微的动态变化以及容易忽略关节点局部信息。本发明采用参数化人体模型smpl来获取人体三维模型化参数,包括:形态参数,姿态参数和相机参数,然后通过添加时序平滑约束和时序一致性约束从预测的参数中获取6890个三维人体表面网格顶点坐标序列以及25个关节点三维坐标序列。

[0031]

步骤2)基于关节点感知的区域划分由于骨架关节点表示的低维度和模糊性以及网格参数表示的高维度、无序性的特点,均不利于步态时空特征的学习。因此,本发明将骨架感知融入到三维人体网格数据的学习中,提出了一个基于关节点感知的点划分模块,以25个关节点的位置为中心,将点云数据划分为25个子区域,通过更好地将无序的点特征映射到有序的骨架关节上来聚合局部信息,以便提取更具鉴别性的时空特征。

[0032]

步骤3)空间点云特征学习借鉴了cnn的多层感受野的思想,对步骤2)划分出的子区域分别采用分层堆叠的点特征编码层(point-wise encoding)和区域特征编码层(region-wise encoding)进行特征提取,以捕捉每一帧步态点云数据中的局部和全局的空间几何特征,并将各区域空间点云特征聚合到邻近的骨架关节点上。

[0033]

步骤4)时序点云特征学习为了获取帧间的步态动态特征,设计了基于transformer的时序特征编码器(frame-wise encoding)将步态身份和情绪特征映射到同一个共享空间进行分类,通过多

任务学习策略,从编码向量中提取出辨别特征,用于步态身份识别和情绪识别。

[0034]

优选地,所述步骤1)中的步态时序点云数据获取,包括以下步骤:1-1)在实际应用环境下,步态视频数据通过摄像头采集,标注信息为被测对象的身份id号及情绪状态(例如:沮丧、快乐、愤怒、中性等)。采集的视频数据要求画质清晰、无卡顿,被测对象处于镜头中间区域内,训练集和测试集需要保持分辨率和采样帧率参数的一致。

[0035]

1-2)通过预训练网络模型(类似于hmr、vibe等)回归出smpl模型形态参数,姿态参数和相机参数,通过构建时序平滑约束和时序一致性约束对训练网络模型进行微调,假设第帧,网络估计出的参数为,引入姿态时间平滑约束和相机时间平滑约束,对应的损失函数为:其中,为姿态时间平滑约束损失函数,为相机时间平滑约束损失函数, 为视频序列的帧数;形态参数一致性约束的损失函数为:其中代表序列中的平均形状参数;经过优化后的smpl参数能获得更准确的三维人体表面网格坐标和三维关节点位置坐标。

[0036]

1-3)根据相机参数旋转坐标系,将三维网格坐标和关节点坐标统一到侧面视角下,并将6890个网格坐标位置作为步态点云数据进行后续处理。

[0037]

优选地,所述步骤2)中的步态时序点云数据获取,包括以下步骤:以步骤1)获得的25个关节点的位置为中心,采用是k近邻(knn)范围查询的方式找到固定的数量为256的相邻点,将相邻点的集合作为一个关节点感知分区域,表示划分为25个子区域的每一帧的点云数据,表示$v$子区域内的点集,由此将6980个点划分为25个子区域。

[0038]

优选地,所述步骤3)中的步态时序点云数据获取,包括以下步骤:3-1)对步骤2)划分出的各子区域进行区域中心点采样和领域分组,使用最远点采样(fps)对点集进行降采样,将输入点集从规模降到更小的规模;先随机选择一个点作为已选择采样点集中的初始点,然后在未选择的点集中再选择离这个点距离最远的点加入到已选择采样点集中,再继续迭代,直到选出目标数量采样点个数为止;再以这些采样点为

中心采用球查询的方式找到周围找到k个邻近点,与邻近点共同组成局部区域,该步骤输出维度为。

[0039]

3-2)对步骤3-1)获得的局部区域进行特征聚合,使用pointnet 作为局部特征学习的基本模块,将局部区域中k个点坐标转换成以相对于局部区域中心点的的相对坐标:,其中,, 是中心坐标;通过mlp和pooling的操作,该层的输出维度为,通过shared mlp将特征维度从提升到。

[0040]

3-3)通过点特征编码提取了关节点邻域精细的几何特征,还需要对多区域特征进行聚合来获取全局的空间几何依赖关系,这里使用基于图卷积神经网络gcn进行逐层聚合提取全局特征;gcn聚合方法本质上是加权求和的过程,将邻居点通过度矩阵及其邻接矩阵,计算出各边的权重,根据权值对节点特征求加权平均,计算过程由以下公式表示:其中a为图结构的邻接矩阵,d为图结构的度矩阵,为图卷积层上的卷积核,这里使用图划分策略,将划分为三个子图,分别表达向心运动、离心运动和静止的动作特征;三个卷积核的卷积结果分别表达了不同尺度的动作特征;最后对各卷积核的卷积结果进行加和来表征单帧步态点云数据的全局空间特征。

[0041]

优选地,所述步骤4)中的步态时序点云数据获取,包括以下步骤:4-1)通过步骤3)中的点特征编码和区域特征编码模块捕捉了每一帧步态点云数据中的局部和全局的空间几何特征,将提取的空间特征向量进一步送入到时序特征编码器进行动态特征提取。时序特征编码器由l层transformer encoder组成,具有多层级的多头自注意力模块和前馈模块;将点云空间几何特征嵌入向量输入到时序特征编码器层,并在输入的特征向量中预置一个可学习的token作为类标记[cls],其最后一个transformer编码器层的状态作为全局动态特征表示,最终的类标记;此外,位置嵌入被添加到输入向量中,通过一个可学习的位置嵌入矩阵来保留位置信息;这个类标记[cls]通过自注意力机制在输入序列之间传播信息,并将它们的信息汇聚成对不同任务具有辨别力的动态特征表示,最后通过一个线性分类头(mlp head)来进行分类。

[0042]

4-2)采用多任务学习策略,从编码向量中提取出辨别特征,用于步态身份识别和情绪识别。这两个识别任务在转换层后共享相同的类标记嵌入向量。为了预测输出类别,我们使用一个两层多层感知器(mlp),通过高斯误差线性激活单位(gelu),最后送入softmax分类器,得到预测的类别标签;步态身份识别和情绪识别的目标函数采用交叉熵损失函数:

其中和分别是样本真实的身份标签和情绪标签,和为模型的输出,超参数和是正则化权重。

[0043]

通过所发明的方法提取15个不同身份属性的样本的步态特征进行pca降维,降维后的特征在3维空间的分布如图4所示,不同的颜色对应于数据集中不同身份的样本,三种形状的点分别代表积极、消极和中性的情绪嵌入向量。可以观察到,具有相同身份的样本在降维后的3维空间中呈现明显的“聚集”现象,此外具有相同情绪的样本在空间中也被很好地嵌入,正性样本趋向于分布在三维空间中的上方,负性样本则分布于空间的下方,中性样本则分布在中间。很明显,相同标签的样本在空间分布中是相互靠近的,这表明模型所提取的特征在身份分类和情绪分类任务上具有较强的鉴别特性。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1