一种基于人工智能的视频通讯数据高效压缩方法和系统与流程

1.本技术涉及视频通讯及人工智能领域,具体涉及一种基于人工智能的视频通讯数据高效压缩方法和系统。

背景技术:

2.随着互联网行业的快速发展,视频通讯作为主流的一种通讯方法不论在生活或者工作中都显得更加重要,相比于只有文字信息或者语音信息,视频通讯能给我们带来更直观,信息内容更丰富的通信体验。而视频通讯过程中主要使用到的技术有视频、音频压缩技术和端到端或者端到多端通信技术等,在这些技术的组合下,带来的是可以随时随地的使用pc、手机、其他带有视频通话功能的终端进行视频通讯。在这些技术中,视频压缩是很重要的一项技术,视频压缩方法的优劣决定了通话过程中视频数据传输码率的大小,也就是其所占用通信资源的多少,而高效的视频压缩方法能够有效的降低通信过程中所占用的带宽,使通信更加流畅,现有的视频压缩方法主要有jpeg、jvt、mpeg、h.261等,这些压缩方法已经能够获得很好的压缩比,但对于一般网络的带宽而言,所传输的视频流仍然较大,这时视频流传输会变的十分拥堵,从而导致视频通讯出现卡顿,画质模糊等情况。

3.为了解决视频通讯中视频压缩的问题,有人提出了可以通过分析视频中的运动情况来判断当前视频帧是否需要进行压缩传输,从而控制视频通话过程中视频帧的压缩,例如cn100459711c,提出了一种基于头部运动分析及面部动作分析来控制视频压缩方法,当检测到当前帧图像有大幅度运动时,就对当前帧进行压缩传输,否则不进行压缩传输。

4.现有技术存在以下缺陷:仅对大幅运动的视频帧进行压缩传输,视频质量低,不能满足特殊人群(例如听说障碍的特殊人群)的视频通讯要求。

5.此外,现有运动检测通常是基于图像信息,如灰度、光流等信息进行运动检测,例如使用帧差法提取运动信息并进行识别,对光照的变化干扰不敏感,但是对目标的检测不准确,对于缓慢运动的目标甚至可能无法提取出目标边界,对于快速运动的目标提取出的目标区域又过大,无法准确分辨小目标是否运动。

技术实现要素:

6.针对上述问题,本发明提出了一种基于人工智能的视频通讯数据高效压缩方法,所采用的技术方案如下:

7.通过唇部对称线以及过口角点唇部对称线的平行线将视频帧中唇部感兴趣区域划分为第一区域、第二区域;

8.根据第一区域与第二区域中唇部轮廓对称度确定网格划分参数并对第一区域、第二区域进行网格划分;

9.根据第一区域、第二区域对应网格的唇部轮相似度生成第一矩阵;

10.根据第一视频帧、第二视频帧对应第一矩阵的元素差异生成差异矩阵,根据差异矩阵对第一视频帧、第二视频帧分别赋值生成第一遮罩图像、第二遮罩图像;

11.利用第一遮罩图像对第一视频帧进行遮罩处理,得到第一唇部运动感知图像,利用第二遮罩图像对第二视频帧进行遮罩处理,得到第二唇部运动感知图像;

12.将第一、第二唇部运动感知图像输入唇部运动分析模型,得到唇部是否运动的输出,根据输出的变化选择待压缩视频帧。

13.优选地,根据第一区域、第二区域中对称唇部轮廓像素的坐标差异之和得到唇部轮廓对称度。

14.优选地,从第一区域、第二区域中分别选取相同数目的切分点,根据切分点将第一区域、第二区域分别划分为若干第一子区域、若干第二子区域,对称的第一子区域、第二子区域为子区域组;根据对称的第一子区域、第二子区域内唇部轮廓像素的坐标差异生成第二子矩阵;在第二子矩阵上寻找一条从主对角线起点到主对角线终点的路径,所述路径上元素之和最小;获取所述路径元素之和与主对角线元素之和的差异δl;获取各子区域组对应δl的方差;

15.遍历满足切分约束条件的各种切分点的选取方式,根据δl方差最小对应的切分点选取方式将第一区域、第二区域划分为若干第一子区域、第二子区域。

16.优选地,根据子区域组对应第二子矩阵主对角线元素之和确定唇部轮廓对称度;根据唇部轮廓对称度确定第一区域与第二区域中子区域组的网格划分参数。

17.优选地,对子区域组进行插值处理,使各子区域组网格数相同。

18.优选地,根据口角点邻域中边缘像素点的个数生成对应数量的子集合:将口角点邻域中的边缘像素点分别加入对应子集合,对新加入的像素点进行邻域搜索并将新加入像素点邻域中边缘像素点加入对应子集合,重复邻域搜索直至子集合内包含两个口角点;

19.根据子集合的像素点进行直线拟合,计算子集合内各点到所拟合直线的距离均值,根据直线趋势从距离均值最大的两个子集合中选取大m线集合,根据大m线确定唇部对称线。

20.优选地,根据待压缩视频帧的对应音频信息,提取有效音素对应音频帧;构建数据库,所述数据库储存包括唇部不运动情况下的有效音频;将采集到的音频信息与数据库中储存的音频进行匹配,确认要压缩的视频帧。

21.本技术还提供了一种基于人工智能的视频通讯数据高效压缩系统,该系统主要包括:

22.唇部区域网格化模块,用于根据第一区域与第二区域中唇部轮廓对称度确定网格划分参数并对第一区域、第二区域进行网格划分;

23.第一矩阵生成模块,用于根据第一区域、第二区域对应网格的唇部轮相似度生成第一矩阵;

24.遮罩图像生成模块,用于根据第一视频帧、第二视频帧对应第一矩阵的元素差异生成差异矩阵,根据差异矩阵对第一视频帧、第二视频帧分别赋值生成第一遮罩图像、第二遮罩图像;

25.运动感知图像获取模块,用于利用第一遮罩图像对第一视频帧进行遮罩处理,得到第一唇部运动感知图像,利用第二遮罩图像对第二视频帧进行遮罩处理,得到第二唇部运动感知图像;

26.待压缩视频帧选择模块,用于将第一、第二唇部运动感知图像输入唇部运动分析

模型,得到唇部是否运动的输出,根据输出的变化选择待压缩视频帧。

27.本发明技术方案有如下有益效果:

28.本发明提出基于唇部特性的视频分析方法,利用唇部轮廓对称度,将唇部轮廓区域网格化,进一步分析两视频帧之间唇部的差异,根据差异得到的遮罩图像生成唇部感知图像,从而判断唇部是否运动。相较于现有运动检测的方法,本技术的唇部运动检测方法,不仅能够消除当人脸由正视变为侧视或者相反情况下对识别唇部运动的影响,而且在唇部出现特殊运动情况时很大程度提高了唇部运动分析的精度和准确率。本发明还提出基于音/视频分析的方法选择与音频信息相匹配的视频帧压缩,相较于现有视频压缩方法及优化方法,进一步地提高了视频通讯过程中视频压缩的压缩效率,由于添加了相应的有实际语义但在现有技术中并不进行压缩传输的视频帧,使视频通讯中视频信息更加完整。

附图说明

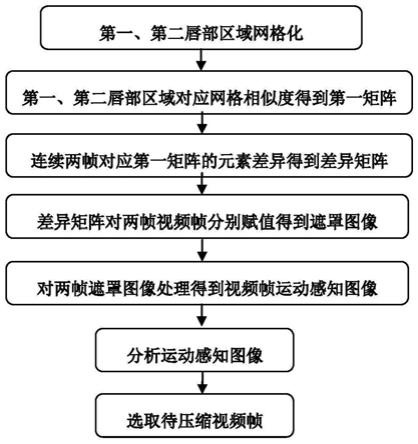

29.图1为本发明的方法流程图。

具体实施方式

30.为了更进一步阐述本发明为达成预定发明目的所采取的技术手段及功效,以下结合附图及较佳实施例,对依据本发明提出的一种基于人工智能的视频通讯数据高效压缩方法和系统,其具体实施方式、结构、特征及其功效,详细说明如下。在下述说明中,不同的“一个实施例”或“另一个实施例”指的不一定是同一实施例。此外,一或多个实施例中的特定特征、结构、或特点可由任何合适形式组合。

31.除非另有定义,本文所使用的所有的技术和科学术语与属于本发明的技术领域的技术人员通常理解的含义相同。

32.实施例1:

33.本发明所针对的具体场景为:视频通讯领域,主要场景为视频会议和视频通话,即主要场景中的视频图像内容主要为人体头部或人体上半身信息。

34.现有的运动检测技术对于唇部运动信息的检测准确率较低,从而导致唇部运动幅度小或不运动的视频帧被忽略而不进行压缩传输,造成画面丢帧或者含有关键信息的视频帧丢失的情况;另一方面,现有技术中针对视频通讯数据通常对视频和音频分离开进行处理,忽略了视频通讯数据中音频数据与视频数据存在较强的相关性,在确认压缩视频帧时会出现较大的误差。本发明的主要目的是:通过对视频通讯过程中音/视频数据的分析筛选出唇部不存在运动但却有实际语义视频帧进行压缩传输,达到视频通讯过程中对音视频数据高效压缩的目的。本发明方法流程图如图1所示。

35.首先,通过唇部对称线以及过口角点唇部对称线将视频帧中唇部感兴趣区域划分为第一区域、第二区域。

36.在具体实施过程中都需要对采集到的视频和音频数据进行预处理后在进行数据分析,避免后续对数据分析时受到噪声的影响,所使用预处理方法为常规降噪算法。输入为:视频数据和音频数据,进行去噪处理,输出为:去噪后的视频数据和音频数据。所述视频数据和音频数据需包括时间戳信息,以便于后续进行音/视频分析结果的关联,其采集设备不作限制;所述去噪处理通过常规降噪算法即可,例如对于音频数据,采用lms自适应滤波、

维纳滤波等;对于视频数据,采用自适应阈值法、频域分析法等,在此不作具体限制,实施者自行选择效果较好的去噪算法即可。

37.唇部对称线的获取方法包括:根据口角点邻域中边缘像素点的个数生成对应数量的子集合:将口角点邻域中的边缘像素点分别加入对应子集合,对新加入的像素点进行邻域搜索并将新加入像素点邻域中边缘像素点加入对应子集合,重复邻域搜索直至子集合内包含两个口角点;根据子集合的像素点进行直线拟合,计算子集合内各点到所拟合直线的距离均值,根据直线趋势从距离均值最大的两个子集合中选取大m线集合,根据大m线确定唇部对称线。

38.具体为:获取第一roi区域a1,首先基于开源的人脸landmark检测工具如dlib进行嘴外轮廓关键点的提取,一般有13个点,获取嘴外轮廓关键点的最小外接矩形作为第一roi区域a1,以便于后续处理过程计算简便;

39.对于第一roi区域,基于sobel算子进行边缘检测,获取边缘像素点集合,选择其中i

max

和i

min

对应的像素点,为口角点,选择任一个口角点,获取其八邻域像素点,根据口角点八邻域像素点中边缘像素点的个数生成对应数量的子集合:将口角点邻域中的边缘像素点分别加入对应子集合,对新加入的像素点进行邻域搜索并将新加入像素点邻域中边缘像素点加入对应子集合,重复邻域搜索直至子集合内包含两个口角点。对每个子集合基于最小二乘法进行直线拟合,并计算子集合内各点到所拟合直线的距离均值,按大小进行排列,选择距离均值最大的两个子集合,基于斜率符号变化进行像素点提取,若子集合存在三个斜率符号变化的像素点,该子集合为大m线集合;获取大m线集合中三个斜率符号变化的像素点,其中j坐标大小位于中间的点,为对称中心点,根据对称中心点以及其他唇部边缘点的位置确定唇部对称线。过口角点作对称线的平行线,则平行线、对称线及第一roi区域构成两个矩形区域,设为第一区域和第二区域。

40.然后,根据第一区域与第二区域中唇部轮廓对称度确定网格划分参数并对第一区域、第二区域进行网格划分。唇部轮廓对称度的获取方法包括:根据第一区域、第二区域中对称唇部轮廓像素的坐标差异之和得到唇部轮廓对称度。

41.以对称线作为y轴直线,直线两个方向中与对称中心点指向另外两点向量之间夹角小于90

°

的方向为y轴正方向,y轴顺时针旋转90

°

以获取x轴,至此建立唇部坐标系;另坐标系内x值小于0的大m线集合内的点,x值取反,基于取反后获取的点与x值大于0的点可获取第一区域和第二区域大m线两点之间的距离,用形如m*m的距离矩阵表示,矩阵内元素为第一区域大m线点与第二区域大m线点的y坐标距离,通过寻优算法寻找一条从矩阵左上角到右下角的路径,使得路径上的元素和最小,该路径中不存在从元素向上走的方向,该最小的元素和设为d1,则唇部轮廓相似度矩阵对角线元素和为d2,则唇部轮廓对称度需要说明的是,建议将d1和d2标准化至[0,2],以确保评价指标不会过小,另外,为评价指标中的指数项赋予调整系数也可实现该目的。然后根据唇部轮廓对称度α2设定网格划分参数。一种实施方式是,网格划分参数为64α2。然后,根据唇部轮廓相似度确定预设差异阈值,将第一区域、第二区域对应网格的相似度与预设差异阈值进行比较得到差异矩阵。

[0042]

为了提高对唇部运动检测准确率,本实施例提供另一种实施方式对第一区域、第二区域进行进一步划分,分别划分为若干第一子区域、若干第二子区域,该切分操作的目的

在于,确保后续进行帧内动态网格切分时根据实际情况调整各区域网格大小,进而提高头部转动检测的鲁棒性。切分方法:从第一区域、第二区域中分别选取相同数目的切分点,根据切分点将第一区域、第二区域分别划分为若干第一子区域、若干第二子区域,对称的第一子区域、第二子区域为子区域组;根据对称的第一子区域、第二子区域内唇部轮廓像素的坐标差异生成第二子矩阵;第二子矩阵的生成方法与距离矩阵相同;在第二子矩阵上寻找一条从主对角线起点到主对角线终点的路径,所述路径上元素之和最小;获取所述路径元素之和与主对角线元素之和的差异δl;获取各子区域组对应δl的方差;遍历满足切分约束条件的各种切分点的选取方式,根据δl方差最小对应的切分点选取方式将第一区域、第二区域划分为若干第一子区域、第二子区域。切分约束条件包括:根据切分点生成的各第二子矩阵的δl在预设取值范围内,根据预设取值范围内的数值,能够将第一区域、第二区域划分为预设数量的子区域。本实施例中预设数量为k。需要说明的是,寻找路径时,主对角线上各元素之间是连通的。

[0043]

具体的,切分操作具体为:基于距离矩阵进行处理,以左上角点为起始点,沿主对角线逐点进行移动,对于主对角线上的一个点,到达该点所在列的动态路径元素之和与对角线路径之和差值的绝对值δl,需要说明的是,此处计算路径时同样采用上述计算唇部轮廓相似度时的标准化步骤,若该值随着逐点移动的过程中由小于预设阈值m

γ

变为大于预设阈值m

γ

,则根据该小于预设阈值m

γ

对应的动态路径的终点确定第一区域和第二区域的切分点,当确定切分点后以切分点的后一个点为起始点继续逐点移动,直至移动至右下角点。

[0044]

在本发明中m

γ

为动态阈值,具体获取方式为:实施者基于实际情况设置所需子区域个数2k,则m

γ

需要满足以m

γ

切分后存在k

‑

1个切分点,此时m

γ

的取值范围为设置约束条件以获取唯一m

γ

值,约束条件为:所划分的k个切分段,每段对应的δl

k

的均方差最小,至此,可确定唯一m

γ

值,令切分点个数为k

‑

1个;对于上述切分方法,其目的在于,动态确定切分点位置有利于得到合理的对称区域进行分析,进而凸显出存在关键差异的区域,而不会被额外信息干扰。

[0045]

过口角点及切分点作对称线的平行线,则平行线、对称线及第一roi区域构成2k个矩形区域,分别为第一子区域、第二子区域,基于对称线将2k个子区域形成k个对应子区域组。

[0046]

根据子区域组对应第二子矩阵主对角线元素之和确定唇部轮廓对称度;根据唇部轮廓对称度确定第一区域与第二区域中子区域组的网格划分参数。对每个子区域组进行网格划分,每个子区域组均对应一个网格划分参数c

k

,网格划分参数基于该子区域组的唇部轮廓对称度确定,优选地,[

·

]表示向下取最近的奇数,表示第k个子区域组对应的唇部轮廓对称度,对应的唇部轮廓对称度,为子区域组对应的第二子矩阵的主对角线元素之和。对子区域组动态划分网格的目的在于,对于对称性低的对应区域,基于先验可知,较为可能存在侧视情况,此时采用较大的切分参数,相当于扩大侧视区域感受野以获取更多空域特征,从而更鲁棒的感知差异信息;切分参数c

k

作为指导矩形区域组进行网格划分,即设某矩形区域组长宽分别为l,w,则单个网格的长宽为

[0047]

进一步地,根据第一区域、第二区域对应网格的唇部轮相似度生成第一矩阵。

[0048]

具体为:切分后,整个第一区域、第二区域的差异评价用矩阵表示,设为第一矩阵,而一个子区域组的差异评价为第一矩阵的子矩阵,第一矩阵由k个子矩阵组成。子矩阵尺寸为c

k

*c

k

,矩阵中元素值为二值,即0和1,元素值根据该元素对应区域之间的差异评价值与预设差异阈值比较后获取,其中差异评价值通过余弦相似度获取,若差异评价值大于等于预设差异阈值,则为1,表示存在差异,否则为0,表示不存在差异;其中,预设差异阈值根据相似性评价指标给出,在本技术中将该关系设置为ω为调节值,取值范围为(0,1],优选地,本发明中差异阈值设为0.6,1],优选地,本发明中差异阈值设为0.6,为子区域组对应的动态路径元素之和。该阈值含义为:若对应区域相似度低,则更可能由于真实差异(唇部特殊情况)导致差异评价值大,而非侧头状态导致差异评价值大,因此采用较低的阈值确保提取出差异信息,而对应区域相似度高时,则更可能由于侧头状态导致差异评价值大,因此采用较高的阈值确保不出现因侧头状态误判唇部存在差异;获取差异矩阵的目的在于,用于后续准确判断两帧之间运动情况,即避免被检测对象特殊的唇部情况或转头动作影响出现误判,提高运动判断的准确率。

[0049]

接着,根据第一视频帧、第二视频帧对应第一矩阵的元素差异生成差异矩阵,根据差异矩阵对第一视频帧、第二视频帧分别赋值生成第一遮罩图像、第二遮罩图像。

[0050]

具体为:对于视频通讯数据所采集的连续多帧图像,各单帧内k个子区域组所对应的差异矩阵构成单帧差异矩阵序列,由于单帧内各相邻子区域网格个数不一致且帧间单个划分区域的网格个数不一致,因此需要进行标准化,具体地,单帧内各相邻子区域网格个数标准化方式采用最大池化方式,确保各子区域的网格个数一致,又不丢失重要运动信息;帧间单个划分区域的网格个数的标准化基于前后帧网格位置进行插值,具体地,首先确定目标插值尺寸,将某一子区域组的网格结果矩阵插值为大小,t为单帧所对应帧数,即取某帧对应的子区域的最大尺寸作为插值目标,即插值方法:若某一子区域通过插值以达到目标插值尺寸,则插值后子区域内各网格的元素值:先将子区域划分为目标插值尺寸,则划分后的新网格的元素值为所覆盖的旧网格对应元素值加权求和,权值为覆盖旧网格面积占新网格的比值。旧网格对应元素值通过该网格所包含像素值均值赋予。对于序列的每个项,项对应的差异矩阵尺寸均变更至根据连续两帧对应的第一矩阵的元素差异计算任两帧之间的差异矩阵,即逐点取异或,获取的差异矩阵i1;获取差异矩阵的目的在于,其可表征出现唇部特殊动作时特殊唇部动作覆盖区域,便于在后续进行帧差对比时忽略此区域信息,避免对因发音而造成的唇部运动检测出现误检情况,提高检测的准确率。

[0051]

根据差异矩阵对第一视频帧、第二视频帧分别赋值生成第一遮罩图像、第二遮罩图像:遮罩图像与原图等大,差异矩阵中值为1的元素对应的第一视频帧、第二视频帧像素点赋值为第一数值,第一roi区域中其他像素点赋值为第二数值,其他区域中像素点赋值为第一数值。具体地,差异矩阵内元素值为1的元素对应网格覆盖的像素点像素值置0,第一roi区域其他像素值置1,其他区域像素值同样置0。

[0052]

之后,利用第一遮罩图像对第一视频帧进行遮罩处理,得到第一唇部运动感知图像,利用第二遮罩图像对第二视频帧进行遮罩处理,得到第二唇部运动感知图像;将第一、

第二唇部运动感知图像输入唇部运动分析模型,得到唇部是否运动的输出,根据输出的变化选择待压缩视频帧。

[0053]

具体为:每帧图像均有其对应的遮罩图像,将该帧原图像灰度化后与对应的遮罩图像点乘,得到该帧的唇部运动感知图像,分别为第一唇部运动感知图像、第二唇部运动感知图像。

[0054]

将第一、第二唇部运动感知图像送入唇部运动分析模型中,本实施例采用孪生网络,通过对比损失进行网络的监督,输出结果为相邻两帧视频帧是否为同一类别,即是否存在唇部运动,根据输出的变化选择出待压缩视频帧。

[0055]

最后,根据待压缩视频帧的对应音频信息,提取有效音素对应音频帧;构建数据库,所述数据库为唇部不运动情况下的有效音频数据库;仅用采集到的音频信息与数据库中储存的音频进行匹配,确认要压缩的视频帧。

[0056]

具体为:进行音频数据分析,包括音频分析模型,用于对音频数据分析并与视频数据分析结果关联;输入待压缩的视频帧对应的时间戳及音频数据,通过音频分析模型进行处理,输出有效音频数据库。

[0057]

所述音频分析模型具体为:

[0058]

通过待压缩的视频帧对应的时间戳截取音频数据,具体地,设视频帧率为f,在本技术中帧率f=30,即一秒采集30帧图像,则音频分帧设置为2f,即一秒音频分为60帧,该处理目的为避免遗漏音频中的间隔信息,具体语音识别方法采用现有端到端的声学模型即可,如encoder

‑

decoder、transformer等;

[0059]

上述方法所输出的为音素,现有语音识别通常将声学模型与词典或语言模型相结合以提高识别的准确率,在本技术中,仅提取出音素以判断是否为同音而不对音的语义作处理,因此,仅需提取音素即可,耗时较少;

[0060]

由于音频信号有分帧处理,在此将两帧图像对应的音频帧设为f1,f2,f3,f4,选取其中f1和f3作为对应帧,则f2为中间帧,若f1和f3音素为有效音素而f2非有效音素,待压缩视频帧进行压缩,对应的音频存储对象为f1帧之前最近的非有效音素到f1帧和由f3帧到f3帧之后最近的非有效音素之间的音素;其他情况不进行音频存储。

[0061]

该分析模型的目的为确定音频信息与视频信息的对应关系,构建唇部不运动情况下的有效音频数据库,基于该数据库,在压缩具体实施过程中,可仅通过音频信息确定压缩的视频帧,又由于不同发声者的音频信息存在一定差异,因此本技术采用dtw算法进行实时采集的音频与有效音频数据库中存储的音频进行匹配,确认待压缩的视频帧进行压缩。

[0062]

由于本技术针对的视频帧对象为不存在明显头部运动的视频帧,即默认图像中仅存在唇部动作变化,其他部分存在动作变化的判断可以通过所获取的第一roi区域a1之外的区域判断,具体判断方法可采用光流法等,并按照现有的方法判断进行压缩,在此不作赘述。

[0063]

由于在发出某些词语的声音时,虽然存在音频信息的变化但实际唇部动作一致,在此以中文词语举例,如“实施”“意义”等,因此仅基于不同音频信息进行视频压缩帧确定存在一定误差,本技术构建有效音频数据库以优化该方法,提高该方法的准确性,进而实现通过音频信息进行部分压缩帧的选取,提高了视频通讯数据的压缩效率。

[0064]

具体实施过程中,在视频信息不存在大幅运动的情况下,所获取音频信息可在有

效音频数据库进行匹配,无需进行上述步骤的唇部运动分析,仅通过音频信息确认压缩帧,简化计算过程,提高压缩效率的同时保证了视频信息和音频信息的完整性。

[0065]

实施例2:

[0066]

本实施例提供了一种系统实施例。一种基于人工智能的视频通讯数据高效压缩系统,包括唇部区域划分模块、唇部区域网格化模块、第一矩阵生成模块、遮罩图像生成模块、运动感知图像获取模块、待压缩视频帧选择模块,具体为:

[0067]

唇部区域划分模块,用于根据第一区域与第二区域中唇部轮廓对称度确定网格划分参数并对第一区域、第二区域进行网格划分;

[0068]

第一矩阵生成模块,用于根据第一区域、第二区域对应网格的唇部轮相似度生成第一矩阵;

[0069]

遮罩图像生成模块,用于根据第一视频帧、第二视频帧对应第一矩阵的元素差异生成差异矩阵,根据差异矩阵对第一视频帧、第二视频帧分别赋值生成第一遮罩图像、第二遮罩图像;

[0070]

运动感知图像获取模块,用于利用第一遮罩图像对第一视频帧进行遮罩处理,得到第一唇部运动感知图像,利用第二遮罩图像对第二视频帧进行遮罩处理,得到第二唇部运动感知图像;

[0071]

待压缩视频帧选择模块,用于将第一、第二唇部运动感知图像输入唇部运动分析模型,得到唇部是否运动的输出,根据输出的变化选择待压缩视频帧。

[0072]

以上所述仅为本发明的较佳实施例,并不用于限制本发明的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1