一种混合双语语音识别方法及系统与流程

1.本发明涉及一种混合双语语音识别方法及系统,属于语音识别技术领域。

背景技术:

2.随着深度学习技术,尤其是端到端技术在语音识别领域的发展和突破,连续语音识别技术被广泛应用于教育、医疗、智慧城市、娱乐、军事等领域,并在各领域应用的实际效果得到了业界的普遍认可。但是在实际业务工作中,前端接收到的语音数据并不是全单一语种,其中可能混杂2个及2个以上语种,如广东地区的语言,前端接收到的语音数据可能是普通话、粤语或英语的混合情况,这种混合了多语种的语音仅使用单一语种引擎进行连续语音识别,最终识别效果达不到实际使用的要求。所以多语种混合连续语音识别技术的研究成为语音识别领域的热点。

3.混合双语语音识别是混合多语种识别场景中最普遍且最重要的一种,也是当前语音识别技术面临的重要挑战之一。混合双语语音数据流通常包含两种情况,一种是目标语音流中同时包含a语种和b语种双语数据且两者占比相当;另一种是目标a语种的语音流中包含少量语种b的单词和短语。针对这两种双语混合语音流,当前主流的解决方案有两种,一种是先对语音进行语种分类再进行语音识别的方法,通过短时语种识别模型进行语种切分然后将语种分类后的音频送入对应的语音识别系统进行识别;另一种是在目标语种a的语音识别系统中加入语种b的单词,b语种的单词发音采用a语种的音素体系进行仿真。

4.当前的混合双语语音识别方案在双语语音识别上取得了一定的效果,但是仍然存在一些问题。针对双语混合的语音流识别方案,系统需要集成语种分类和多个语音识别模块,模型较多导致系统计算量增大,系统的整体复杂度较高;并且语音识别模块依赖于语种分类结果,语种分类错误会导致识别结果完全错误,在实际场景中,语音长度和质量都会影响语种分类效果,进而影响系统整体的识别效果。针对双语混杂的语音流识别方案,一方面采用a语种的音素体系并不能很好的表征b语种的单词,导致识别效果较差;另一方面由于a语种的语音识别系统主要是通过a语种的语音进行训练,b语种语音占比相对较少,导致该语音识别系统倾向于识别出a语种的单词,导致b语种的正确单词无法正确识别。

5.混合双语语音识别现有的技术方案主要根据双语语音流的混合方式分为基于双语混合语音流的语音识别方案和基于双语混杂语音流的语音识别方案。

6.针对双语混合语音流,现有的技术方案通常是联合语种识别和语音识别构建混合语种语音识别系统,在系统前端构建语种识别器,先判断输入数据的语种类别,再将音频特征送入到对应语种的语音识别器中获取语音识别结果。这种方法强依赖于语种识别器的效果,为了克服语种识别引入的错误,一种使用多个单语语音识别器并联的混合多语种语音识别方案被提出,系统中的各个语音识别器是相互独立的且单独训练。识别时,将音频特征送入到混合系统中所有的语音识别器中,选择所有语音识别结果中似然概率最大的一个作为最终的识别结果,具有更好的鲁棒性和扩展性。

7.针对双语混杂语音流,现有的技术方案主要有两种:一种方案是将混杂语音按照

词段自动切分成包含完整词边界的小片段,语种识别器判断每一个小片段的语种类别,然后将相邻的同种语言的片段重新整合到一起送入对应的识别器中进行识别,最后将识别结果拼接就得到了最终的结果。另一种方案是在主体语种的语音识别系统中加入非主体语种的单词,非主体语种的单词发音采用主体语种的音素体系进行仿真,然后以主体语种单语语音识别方案训练混杂双语语音识别系统。

8.将混合双语和混杂双语语音识别两种方案结合就能解决混合双语连续语音识别,而无需在切换语言的时候停止。随着神经网络的发展,目前已经涌现出一些性能不错的语种识别和语音识别方法,根据不同的数据和应用场景选择合适的语种识别和语音识别方法构建合理的混合双语连续语音识别方案,以达到识别语种和语音的目的,并在一定程度上取得了可观的效果。

技术实现要素:

9.前述方案一定程度上能够解决混合双语语音识别的问题,但是仍然存在一些缺点。采用语种识别和多个单语语种语音识别器级联的方式构建混合语种双语识别系统,这类系统整体复杂度较高,计算量较大;并且系统的整体识别性能依赖于语种识别的结果,语种识别出错会直接导致语音识别结果完全出错,实际场景中语音长度和质量都会影响语种识别效果,进而影响系统的识别效果。采用多个语音识别器并联的方式虽然能解决语种识别造成的误差,但是系统的计算量较大。基于语种片段切分的识别器并联系统同样存在系统整体计算量较大的问题。另一种采用主体语种的音素体系仿真混杂的另一种语言,然后联合主体语种统一建模方案中,如果混杂的两种语言之间的发音特点相差较大,使用主体语种的音素体系并不能很好的表征混杂的另一语种的单词,会导致识别效果较差;同时混杂语种语音识别模型训练的数据中主体语种数据占比较高,非主体语种的数据占比较低,如果采用强制划分将对非主体语种非常不利,导致语音识别模型更倾向于识别主体语种的单词,造成非主体语种的单词无法有效识别。

10.总的来说,现有的混合双语语音识别方案存在以下几个缺点:一是联合语种识别,整体系统识别效果依赖于语种识别的准确性;二是混合语种数据的不均衡;三是混合双语数据稀缺。本方案针对现有混合双语语音识别方案存在的一些问题,提出了一种基于bpe(byte-pair encoding)分词的端到端连续语音识别统一建模方案。采用bpe分词构建混合双语统一建模单元,直接训练端到端混合双语语音识别模型,摆脱了对语种识别的依赖,同时避免了整词建模oov(out of vocabulary)问题和字符建模造成的语义信息丢失及训练难收敛问题。

11.本发明的目的在于,克服现有技术存在的技术缺陷,解决上述技术问题,提出一种混合双语语音识别方法及系统,采基于encoder-decoder框架的多语种联合建模方法,基于bpe分词构建多语种统一建模单元,不区分语种,通过数据驱动以及单词所在的上下文自动决策数输出单词,基于数据驱动使得网络能够基于上下文信息预测文本内容。采用多语种数据联合训练的方式,不用单独训练多个模型,同时可以实现多语种训练数据的复用,模型可以从语料丰富型语种的语音数据中学到大部分特征抽取能力并应用在低资源语种上提高识别效果。为了避免混杂语种中非主体语种的信息被海量主体语种数据淹没而导致非主体语种识别效果不佳的问题,本方案通过在encoder端添加对混杂非主体语种的attention

机制,使得decoder在解码过程中可以同时依据上下文信息和attention模块学习到的非主体语种的发音信息来对输入语音进行预测。为了解决混合双语语音数据稀缺的问题,本方案还采用了语音合成、加噪、变速扰动等语音增广方法。

12.本发明具体采用如下技术方案:一种混合双语语音识别方法,包括如下步骤:

13.数据处理步骤,包括:对一定量的目标双语音频数据和目标双语文本语料执行bpe共享词典制作、数据增广和特征提取操作,为后端网络训练提供有效数据输入;

14.encoder-decoder训练步骤,包括:对所述数据处理步骤获得的有效数据采用transformer结构训练语音识别器。

15.作为一种较佳的实施例,所述bpe共享词典制作具体包括:对目标双语文本语料采用bpe字节对编码算法构建目标双语的共享分词词典。

16.作为一种较佳的实施例,所述数据增广具体包括:对目标双语文本语料采用实体翻译、插入、替换操作构建双语混合文本语料,然后利用合成器将所述双语混合文本语料与所述目标双语音频数据合成混合双语语音数据;对所述混合双语语音数据进行加噪、变速操作进行数据增广生成增广数据。

17.作为一种较佳的实施例,所述特征提取包括:将原始的目标双语音频数据和目标双语文本语料、合成的混合双语语音数据、加噪变速后的增广数据合并一起作为训练数据提取特征,生成输入音频特征序列x={x1,x2,

…

,x

t

}。

18.作为一种较佳的实施例,所述encoder-decoder训练步骤具体包括:

19.encoder编码器编码步骤:通过self-attention自注意力机制操作、layernorm求均值方差操作和feedforward正反馈操作把输入音频特征序列x={x1,x2,

…

,x

t

}转为高层的特征表示序列

20.decoder解码器解码步骤:基于上一个输出y

u-1

、上一个隐藏状态和上一个上下文向量c

u-1

,计算当前的隐藏状态然后通过softmax逻辑回归层计算输出符号基于之前预测标签和输入特征序列的概率分布

21.encoder编码器和decoder解码器中的attention注意力机制层都有residual残差连接,直接将前一层的信息传递到下一层;encoder编码器和decoder解码器中的self-attention自注意力机制层都是计算前一层所有向量的注意力权重,输出上下文向量,进而建立输入序列与输出序列之间的对齐关系;不同于encoder编码器,decoder解码器还包含encoder-decoder attention编码-解码注意力机制层,其输入信息包含将前一层的输出和encoder解码器的输出结果。

22.本发明还提出一种混合双语语音识别系统,包括:

23.数据处理模块,具体执行:对一定量的目标双语音频数据和目标双语文本语料执行bpe共享词典制作、数据增广和特征提取操作,为后端网络训练提供有效数据输入;

24.encoder-decoder训练模块,具体执行:对所述数据处理步骤获得的有效数据采用transformer结构训练语音识别器。

25.作为一种较佳的实施例,所述bpe共享词典制作具体包括:对目标双语文本语料采用bpe字节对编码算法构建目标双语的共享分词词典。

26.作为一种较佳的实施例,所述数据增广具体包括:对目标双语文本语料采用实体翻译、插入、替换操作构建双语混合文本语料,然后利用合成器将所述双语混合文本语料与所述目标双语音频数据合成混合双语语音数据;对所述混合双语语音数据进行加噪、变速操作进行数据增广生成增广数据。

27.作为一种较佳的实施例,所述特征提取包括:将原始的目标双语音频数据和目标双语文本语料、合成的混合双语语音数据、加噪变速后的增广数据合并一起作为训练数据提取特征,生成输入音频特征序列x={x1,x2,

…

,x

t

}。

28.作为一种较佳的实施例,所述encoder-decoder训练模块具体包括:

29.encoder编码器编码步骤:通过self-attention自注意力机制操作、layernorm求均值方差操作和feedforward正反馈操作把输入音频特征序列x={x1,x2,

…

,x

t

}转为高层的特征表示序列

30.decoder解码器解码步骤:基于上一个输出y

u-1

、上一个隐藏状态和上一个上下文向量c

u-1

,计算当前的隐藏状态然后通过softmax逻辑回归层计算输出符号基于之前预测标签和输入特征序列的概率分布

31.encoder编码器和decoder解码器中的attention注意力机制层都有residual残差连接,直接将前一层的信息传递到下一层;encoder编码器和decoder解码器中的self-attention自注意力机制层都是计算前一层所有向量的注意力权重,输出上下文向量,进而建立输入序列与输出序列之间的对齐关系;不同于encoder编码器,decoder解码器还包含encoder-decoder attention编码-解码注意力机制层,其输入信息包含将前一层的输出和encoder解码器的输出结果。

32.本发明所达到的有益效果:本发明采用bpe分词方法构建混合语种统一建模单语,避免了整词建模oov问题和字符建模造成的语义信息丢失及训练难收敛问题;采用端到端混合双语统一建模方案,不需要构建语种识别模块就能实现混合双语的语音识别,训练更方便快捷;采用实体翻译、音频拼接、语音合成、变速、加噪等多种方法增广混合双语模型的训练数据,提高模型的泛化能力。

附图说明

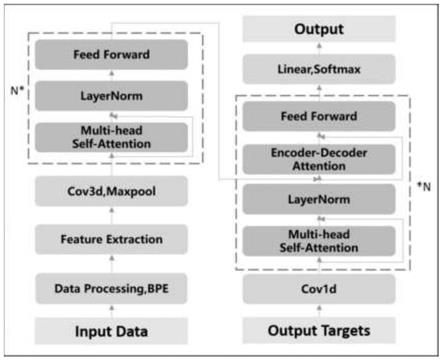

33.图1是本发明的一种混合双语语音识别方法的流程图。

具体实施方式

34.下面结合附图对本发明作进一步描述。以下实施例仅用于更加清楚地说明本发明的技术方案,而不能以此来限制本发明的保护范围。

35.实施例1:如图1所示,本发明提出一种混合双语语音识别方法,包括如下步骤:

36.数据处理步骤,包括:对一定量的目标双语音频数据和目标双语文本语料执行bpe共享词典制作、数据增广和特征提取操作,为后端网络训练提供有效数据输入;

37.encoder-decoder训练步骤,包括:对所述数据处理步骤获得的有效数据采用transformer结构训练语音识别器。

38.作为一种较佳的实施例,所述bpe共享词典制作具体包括:对目标双语文本语料采用bpe字节对编码算法构建目标双语的共享分词词典。

39.作为一种较佳的实施例,所述数据增广具体包括:对目标双语文本语料采用实体翻译、插入、替换操作构建双语混合文本语料,然后利用合成器将所述双语混合文本语料与所述目标双语音频数据合成混合双语语音数据;对所述混合双语语音数据进行加噪、变速操作进行数据增广生成增广数据。

40.作为一种较佳的实施例,所述特征提取包括:将原始的目标双语音频数据和目标双语文本语料、合成的混合双语语音数据、加噪变速后的增广数据合并一起作为训练数据提取特征,生成输入音频特征序列x={x1,x2,

…

,x

t

}。

41.作为一种较佳的实施例,所述encoder-decoder训练步骤具体包括:

42.encoder编码器编码步骤:通过self-attention自注意力机制操作、layernorm求均值方差操作和feedforward正反馈操作把输入音频特征序列x={x1,x2,

…

,x

t

}转为高层的特征表示序列

43.decoder解码器解码步骤:基于上一个输出y

u-1

、上一个隐藏状态和上一个上下文向量c

u-1

,计算当前的隐藏状态然后通过softmax逻辑回归层计算输出符号基于之前预测标签和输入特征序列的概率分布

44.encoder编码器和decoder解码器中的attention注意力机制层都有residual残差连接,直接将前一层的信息传递到下一层;encoder编码器和decoder解码器中的self-attention自注意力机制层都是计算前一层所有向量的注意力权重,输出上下文向量,进而建立输入序列与输出序列之间的对齐关系;不同于encoder编码器,decoder解码器还包含encoder-decoder attention编码-解码注意力机制层,其输入信息包含将前一层的输出和encoder解码器的输出结果。

45.实施例2:本发明还提出一种混合双语语音识别系统,包括:

46.数据处理模块,具体执行:对一定量的目标双语音频数据和目标双语文本语料执行bpe共享词典制作、数据增广和特征提取操作,为后端网络训练提供有效数据输入;

47.encoder-decoder训练模块,具体执行:对所述数据处理步骤获得的有效数据采用transformer结构训练语音识别器。

48.作为一种较佳的实施例,所述bpe共享词典制作具体包括:对目标双语文本语料采用bpe字节对编码算法构建目标双语的共享分词词典。

49.作为一种较佳的实施例,所述数据增广具体包括:对目标双语文本语料采用实体翻译、插入、替换操作构建双语混合文本语料,然后利用合成器将所述双语混合文本语料与所述目标双语音频数据合成混合双语语音数据;对所述混合双语语音数据进行加噪、变速操作进行数据增广生成增广数据。

50.作为一种较佳的实施例,所述特征提取包括:将原始的目标双语音频数据和目标双语文本语料、合成的混合双语语音数据、加噪变速后的增广数据合并一起作为训练数据提取特征,生成输入音频特征序列x={x1,x2,

…

,x

t

}。

51.作为一种较佳的实施例,所述encoder-decoder训练模块具体包括:

52.encoder编码器编码步骤:通过self-attention自注意力机制操作、layernorm求均值方差操作和feedforward正反馈操作把输入音频特征序列x={x1,x2,

…

,x

t

}转为高层的特征表示序列

53.decoder解码器解码步骤:基于上一个输出y

u-1

、上一个隐藏状态和上一个上下文向量c

u-1

,计算当前的隐藏状态然后通过softmax逻辑回归层计算输出符号基于之前预测标签和输入特征序列的概率分布

54.encoder编码器和decoder解码器中的attention注意力机制层都有residual残差连接,直接将前一层的信息传递到下一层;encoder编码器和decoder解码器中的self-attention自注意力机制层都是计算前一层所有向量的注意力权重,输出上下文向量,进而建立输入序列与输出序列之间的对齐关系;不同于encoder编码器,decoder解码器还包含encoder-decoder attention编码-解码注意力机制层,其输入信息包含将前一层的输出和encoder解码器的输出结果。

55.encoder-decoder训练模块主要采用transformer的编解码结构,采用高度并行化的self-attention自注意力机制、multihead-attention多头注意力机制实现语音识别中必不可少的编码、解码和对齐等模块。由于attention模型的对齐关系没有先后顺序限制,为避免对应关系的过于随机,在decoder部分引入ctc方法,并采用ctc损失函数解决输入序列和输出序列难以一一对应的问题,进一步提升encoder-decoder模型的识别效果。

56.本领域内的技术人员应明白,本技术的实施例可提供为方法、系统、或计算机程序产品。因此,本技术可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本技术可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、cd-rom、光学存储器等)上实施的计算机程序产品的形式。

57.本技术是参照根据本技术实施例的方法、设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。这些计算机程序指令也可装载到计算机或其他可编程数据处理设备上,使得在计算机或其他可编程设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。

58.最后应当说明的是:以上实施例仅用以说明本发明的技术方案而非对其限制,尽管参照上述实施例对本发明进行了详细的说明,所属领域的普通技术人员应当理解:依然

可以对本发明的具体实施方式进行修改或者等同替换,而未脱离本发明精神和范围的任何修改或者等同替换,其均应涵盖在本发明的权利要求保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1