一种联邦学习系统

1.本发明涉及人工智能技术领域,尤其涉及一种联邦学习系统。

背景技术:

2.伴随着金融科技,尤其是互联网金融科技的快速发展,已经有越来越多的技术应用于金融领域,其中,联邦学习技术基于对用户隐私和数据的安全保障,正逐渐受到越来越多的重视。

3.联邦学习(federated learning)是指,通过联合不同的参与者(participant,或者party,也称为数据拥有者(data owner)、或者客户(client))进行机器学习建模的方法。在联邦学习中,参与者不需要向其它参与者和协调者(coordinator,也称为服务器(server),参数服务器(parameter server),或者聚合服务器(aggregation server))暴露自己所拥有的数据,因而联邦学习可以很好的保护用户隐私和保障数据安全,并可以解决数据孤岛问题。

4.然而,在现有的联邦学习中,无法满足高安全性业务需求,联邦学习的性能不强,会影响到各联邦学习参与方的各自训练过程,影响训练结果。

技术实现要素:

5.基于背景技术存在的技术问题,本发明提出了一种联邦学习系统。

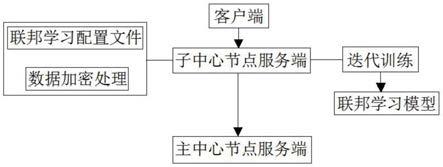

6.本发明提出的一种联邦学习系统,包括主中心节点服务端、子中心节点服务端以及客户端,所述客户端与子中心节点服务端相连接,所述子中心节点服务端通过专用网络通信与主中心节点服务端相连接,所述子中心节点服务端和客户端均为多个,所述子中心节点服务端经过至少一次迭代训练过程联合训练联邦学习模型,直至迭代终止条件到达时,得到已联合训练完成的联邦学习模型,所述子中心节点服务端存储有联邦学习配置文件,子中心节点服务端根据各自需要的联邦学习配置文件进行联合训练,多个子中心节点服务端上数据均进行加密。

7.优选的,所述子中心节点服务端数据加密的方法为:

8.s1根据第一随机数及密钥对中的第一密钥信息对第一子中心节点服务端进行加密,得到第一加密数据;

9.s2获取关联第二子中心节点服务端采用第二随机数及所述密钥对中的第二密钥信息对所述第一加密数据加密得到的第二加密数据;

10.s3依次得到第n加密数据,确定所述相邻两个加密数据的交集,得到所述相邻数据之间的共有数据。

11.优选的,所述第一密钥信息包括预设数和第一密钥,所述第二密钥信息包括所述预设数和第二密钥,所述第二密钥为所述第一密钥对于所述预设数的欧拉函数的模反元素。

12.优选的,所述联邦学习模型训练获得联邦模型,采用预设训练数据集和所述联邦

模型训练得到本地模型和全模型,对联邦模型、本地模型和全模型进行性能测试,基于性能测试结果选择最终使用的模型。

13.优选的,所述提取联邦模型的目标函数,所述联邦模型包括至少两类模型参数集,每个模型参数集对应匹配的训练数据集和/或训练数据标签集,对目标函数中包括的各数据项进行逐层解析,得到逻辑计划执行树,逻辑计划执行树中的各树节点对应于计算表达式,且上层树节点依赖于下层树节点的计算结果。

14.优选的,所述主中心节点服务端、子中心节点服务端以及客户端获取各自的地理位置信息,基于所述地理位置信息,控制各所述客户端与各所述子中心节点服务端建立连接,或者,控制各所述客户端直接与所述主中心节点服务端建立连接。

15.优选的,所述主中心节点服务端中包括编译节点,所述编译节点通过所述专用网络分别通信连接各个子中心节点服务端专用子网络,所述编译节点用于获取各个子中心节点服务端在所有迭代训练过程中需要的联邦学习依赖包,并根据各计算节点在所有迭代训练过程中需要的联邦学习依赖包编译各计算节点的联邦学习配置文件,以及通过所述专用网络分别将各计算节点的联邦学习配置文件存储到各计算节点的专用子网络中。

16.本发明中,所述一种联邦学习系统,通过对各个子中心节点服务端进行交互加密处理,提高数据碰撞的安全性,同时,能够不会受到网络安全、网络速度、网络服务范围的限制,提高了各计算节点的训练效率以及训练效果。

附图说明

17.图1为一种联邦学习系统的系统框图;

18.图2为一种联邦学习系统的子中心节点服务端数据加密的方法图。

具体实施方式

19.下面将对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。

20.实施例一

21.参照图1

‑

2所示,一种联邦学习系统,包括主中心节点服务端、子中心节点服务端以及客户端,客户端与子中心节点服务端相连接,子中心节点服务端通过专用网络通信与主中心节点服务端相连接,子中心节点服务端和客户端均为多个,子中心节点服务端经过至少一次迭代训练过程联合训练联邦学习模型,直至迭代终止条件到达时,得到已联合训练完成的联邦学习模型,子中心节点服务端存储有联邦学习配置文件,子中心节点服务端根据各自需要的联邦学习配置文件进行联合训练,多个子中心节点服务端上数据均进行加密。

22.本发明中,子中心节点服务端数据加密的方法为:

23.s1根据第一随机数及密钥对中的第一密钥信息对第一子中心节点服务端进行加密,得到第一加密数据;

24.s2获取关联第二子中心节点服务端采用第二随机数及密钥对中的第二密钥信息对第一加密数据加密得到的第二加密数据;

25.s3依次得到第n加密数据,确定相邻两个加密数据的交集,得到相邻数据之间的共

有数据。

26.实施例二

27.本发明中,第一密钥信息包括预设数和第一密钥,第二密钥信息包括预设数和第二密钥,第二密钥为第一密钥对于预设数的欧拉函数的模反元素,联邦学习模型训练获得联邦模型,采用预设训练数据集和联邦模型训练得到本地模型和全模型,对联邦模型、本地模型和全模型进行性能测试,基于性能测试结果选择最终使用的模型,提取联邦模型的目标函数,联邦模型包括至少两类模型参数集,每个模型参数集对应匹配的训练数据集和/或训练数据标签集,对目标函数中包括的各数据项进行逐层解析,得到逻辑计划执行树,逻辑计划执行树中的各树节点对应于计算表达式,且上层树节点依赖于下层树节点的计算结果,主中心节点服务端、子中心节点服务端以及客户端获取各自的地理位置信息,基于地理位置信息,控制各客户端与各子中心节点服务端建立连接,或者,控制各客户端直接与主中心节点服务端建立连接,主中心节点服务端中包括编译节点,编译节点通过专用网络分别通信连接各个子中心节点服务端专用子网络,编译节点用于获取各个子中心节点服务端在所有迭代训练过程中需要的联邦学习依赖包,并根据各计算节点在所有迭代训练过程中需要的联邦学习依赖包编译各计算节点的联邦学习配置文件,以及通过专用网络分别将各计算节点的联邦学习配置文件存储到各计算节点的专用子网络中。

28.实施例三

29.存在多个计算节点,即存在多个联邦学习参与方。多个计算节点通过专用网络实现互相通信,且每个计算节点运行在各自的专用子网络中,并且每个专用子网络中存储有联邦学习配置文件,各计算节点在自己的专用子网络中存储了在联邦学习训练过程中需要使用的联邦学习配置文件,这些联邦学习配置文件不需要各个计算节点通过网络安全不稳定的公用网络获取,而是存储在了各专用子网络中,可以适用于各种计算节点所处的环境,例如各专用子网络是运行在受限或者保密网络中,这些计算节点仍可以进行联邦学习训练。

30.本发明:子中心节点服务端经过至少一次迭代训练过程联合训练联邦学习模型,直至迭代终止条件到达时,得到已联合训练完成的联邦学习模型,联邦学习模型训练获得联邦模型,采用预设训练数据集和联邦模型训练得到本地模型和全模型,对联邦模型、本地模型和全模型进行性能测试,基于性能测试结果选择最终使用的模型,子中心节点服务端存储有联邦学习配置文件,子中心节点服务端根据各自需要的联邦学习配置文件进行联合训练,多个子中心节点服务端上数据均进行加密,子中心节点服务端数据加密的方法为:根据第一随机数及密钥对中的第一密钥信息对第一子中心节点服务端进行加密,得到第一加密数据;获取关联第二子中心节点服务端采用第二随机数及密钥对中的第二密钥信息对第一加密数据加密得到的第二加密数据;依次得到第n加密数据,确定相邻两个加密数据的交集,得到相邻数据之间的共有数据。

31.以上所述,仅为本发明较佳的具体实施方式,但本发明的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本发明揭露的技术范围内,根据本发明的技术方案及其发明构思加以等同替换或改变,都应涵盖在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1