一种图像处理方法及装置与流程

1.本技术涉及视频技术领域,尤其涉及一种图像处理方法及装置。

背景技术:

2.目前在电视屏或会议屏的视频场景下,包括视频通话、视频会议、视频教学、视频互动娱乐等,用户希望从视频中抠取出自己或他人等目标人物,并将背景模糊化或者替换为其他图像或视频背景。

3.然而,由于视频是连续的,且背景环境往往不可控,经常会出现背景中其他人物的干扰或者由于目标人物自身的运动等导致抠图效果不稳定、人像误抠取或漏抠取。

技术实现要素:

4.本技术实施例提供了一种图像处理方法及装置,用以在视频场景下,实现对视频中的目标人物的实时跟踪锁定,有效解决视频背景中的多人干扰或目标人物运动等造成的目标丢失导致的漏抠取或者目标错误导致的误抠取等问题。

5.本技术实施例提供的一种图像处理方法,包括:

6.通过对视频图像中的用户的实时跟踪锁定,确定用户的人像锁定结果序列;

7.基于已有用户的人像锁定结果序列,进行人像抠图,确定人像抠图结果序列;

8.利用所述人像抠图结果序列,以及预设场景图像,得到合成图像。

9.通过该方法,对视频图像中的用户的实时跟踪锁定,确定用户的人像锁定结果序列;基于已有用户的人像锁定结果序列,进行人像抠图,确定人像抠图结果序列;利用所述人像抠图结果序列,以及预设场景图像,得到合成图像,从而在视频场景下,实现了对视频中的目标人物的实时跟踪锁定,有效解决了视频背景中的多人干扰或目标人物运动等造成的目标丢失导致的漏抠取或者目标错误导致的误抠取等问题。

10.可选地,该方法还包括:

11.当有新用户加入合成图像请求时,在原图的全图像区域内进行人像抠图,获得全图的人像抠图结果;

12.从所述全图的人像抠图结果中确认目标新用户的人像抠图结果;

13.将所述新用户的人像抠图结果添加到已有用户的人像锁定结果序列中。

14.可选地,该方法还包括:

15.当有已有用户退出合成图像请求时,从已有用户的人像锁定结果序列中去除该用户的人像锁定结果。

16.可选地,从所述全图的人像抠图结果中确认目标新用户的人像抠图结果,具体包括:

17.在当前帧的全图人像抠图结果中去除已有用户的人像抠图结果,得到新增的人像抠图结果;

18.从新增的人像抠图结果中确认目标新用户的人像抠图结果。

19.可选地,通过对视频图像中的用户的实时跟踪锁定,确定用户的人像锁定结果序列,具体包括:

20.利用已有用户的人像锁定结果序列,针对当前帧图像进行目标跟踪,确定当前帧图像的目标人像跟踪结果;

21.针对所述当前帧图像的目标人像跟踪结果,进行人像识别,以确认所述当前帧图像的目标人像跟踪结果是目标用户的人像锁定结果,并更新已有用户的人像锁定结果序列。

22.可选地,针对所述当前帧图像的目标人像跟踪结果,进行人像识别,以确认所述当前帧图像的目标人像跟踪结果是目标用户的人像锁定结果,并更新已有用户的人像锁定结果序列,具体包括:

23.对当前帧图像的人像跟踪结果进行人脸检测,判断是否有人脸;

24.如果有,则对当前帧图像的人像跟踪结果中的人像区域进行人脸识别,判断是否有目标用户的人脸;

25.否则,对当前帧图像的人像跟踪结果中的人像区域进行行人重识别,判断是否有目标用户;

26.当确定有目标用户的人脸或者有目标用户,则确定当前帧图像的人像跟踪结果是人像锁定结果,并更新已有用户的人像锁定结果序列。

27.可选地,利用所述人像抠图结果序列,以及预设场景图像,得到合成图像,具体包括:

28.针对人像抠图结果序列中的任一用户的人像抠图结果,采用如下公式将该用户的人像与预设场景图像融合,得到合成图像:

29.c

i,j

=b

i,j

*(1-m

i,j

)+a

i,j

*m

i,j

,i∈{0,1,

…

,w},j∈{0,1,

…

,h}

30.其中,a

i,j

为人像抠图的原始图像,m

i,j

为人像抠图的alpha值,b

i,j

为预设场景图像,c

i,j

为合成图像,i和j分别表示图像的行和列的像素的位置,w、h分别为对该用户的人像锁定结果按照预设场景图像中roi区域的尺寸进行缩放后的人像锁定矩形框的宽度和高度。

31.本技术实施例提供的一种图像处理装置,包括:

32.第一单元,用于通过对视频图像中的用户的实时跟踪锁定,确定用户的人像锁定结果序列;

33.第二单元,用于基于已有用户的人像锁定结果序列,进行人像抠图,确定人像抠图结果序列;

34.第三单元,用于利用所述人像抠图结果序列,以及预设场景图像,得到合成图像。

35.本技术另一实施例提供了一种计算设备,其包括存储器和处理器,其中,所述存储器用于存储程序指令,所述处理器用于调用所述存储器中存储的程序指令,按照获得的程序执行上述任一种方法。

36.本技术另一实施例提供了一种计算机存储介质,所述计算机存储介质存储有计算机可执行指令,所述计算机可执行指令用于使所述计算机执行上述任一种方法。

附图说明

37.为了更清楚地说明本技术实施例中的技术方案,下面将对实施例描述中所需要使用的附图作简要介绍,显而易见地,下面描述中的附图仅是本技术的一些实施例,对于本领域的普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

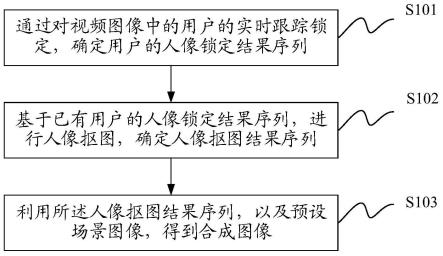

38.图1为本技术实施例提供的基于人像抠图与人像锁定技术的虚拟场景合成方法示意图;

39.图2为本技术实施例提供的人像锁定流程示意图;

40.图3a为本技术实施例提供的人像锁定及人像抠图结果示意图;

41.图3b为本技术实施例提供的人像抠图的alpha图的示意图;

42.图4为本技术实施例提供的基于人脸识别和行人重识别的人像识别流程示意图;

43.图5为本技术实施例提供的全局与局部相结合的人像抠图示意图;

44.图6为本技术实施例提供的确认新用户的人像抠图结果示意图;

45.图7为本技术实施例提供的场景融合流程示意图;

46.图8为本技术实施例提供的场景融合结果示意图;

47.图9为本技术实施例提供的一种图像处理方法的流程示意图;

48.图10为本技术实施例提供的一种图像处理装置的结构示意图;

49.图11为本技术实施例提供的另一种图像处理装置的结构示意图。

具体实施方式

50.下面将结合本技术实施例中的附图,对本技术实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本技术一部分实施例,并不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本技术保护的范围。

51.近几年,社交媒体逐渐成为蓬勃发展的多面社区,在人们生活中发挥着越来越重要的作用。据社交媒体报道,到2020年,视频将占所有互联网流量的82%,视频作为真实可见的社交媒介,仍然是社交媒体领域内最重要的趋势之一。而伴随着人们物质生活的丰富与快节奏的生活方式,加之疫情常态化的影响,线下的面对面社交正在被线上的视频社交所取代,同时,基于单一视频通话的视频社交也已无法满足用户需求,用户渴望更具有场景沉浸感和模拟现实体验的虚拟视频社交。

52.虚拟视频社交最典型的应用是虚拟聊天室,将目标人物进行三维建模,并投射到三维场景中,实现佩带眼镜情况下的vr社交,进一步的,利用全息投影技术,还可以将重建的目标人物的三维模型,投射到真实场景中,实现裸眼的ar社交。然而,以上方案都面临着设备高昂、难以在家庭中部署等问题。

53.本技术实施例提供的技术方案提出一种基于人像抠图与人像锁定技术的虚拟场景合成方法,无需昂贵的采集和投影设备,仅需要利用普通的彩色相机或者深度相机,基于采集的视频图像,利用基于人像抠图与人像锁定技术的虚拟场景合成方法,即可在电视屏或会议屏等终端上呈现具有沉浸感的虚拟视频社交体验。

54.本技术实施例旨在提出一种基于人像抠图与人像锁定技术的虚拟场景合成方案,

首先获取人像抠图的分割结果,然后利用目标检测与跟踪等方法,对目标人物进行识别锁定并实时跟踪,最后,将锁定的人物实时的与替换后的背景相融合。本技术实施例利用人像锁定技术,能够有效区分目标人物与非目标人物并准确跟踪,有效避免了多人场景下非目标人物对融合结果的干扰,同时,针对目标运动场景,利用人像锁定技术,可为下一帧的人像分割提供候选目标区域,避免全图范围的人像抠取,大大减少了计算量并提高了抠图准确率,进一步的,综合利用人像抠图与人像锁定技术,在多人场景下,可实现目标人物的随时添加与删除,方便新目标人物的随时加入与原有目标人物的快速退出。

55.本技术实施例提供的方法和装置是基于同一申请构思的,由于方法和装置解决问题的原理相似,因此装置和方法的实施可以相互参见,重复之处不再赘述。

56.下面结合说明书附图对本技术各个实施例进行详细描述。需要说明的是,本技术实施例的展示顺序仅代表实施例的先后顺序,并不代表实施例所提供的技术方案的优劣。

57.本技术实施例提出的基于人像抠图与人像锁定技术的虚拟场景合成方法,其实现步骤如图1所示,包括:获取视频图像、人像锁定、人像抠图、场景合成、合成视频图像等步骤。其中,人像锁定是本方案的核心。下面给出具体说明。

58.一、人像锁定:

59.本技术实施例方案的一个典型特点是基于人像识别与人像跟踪相结合的人像锁定方法,具体流程见图2所示,获取视频图像之后,进行人像跟踪,并基于已有用户的人像锁定结果序列,进行人像识别,然后更新已有用户的人像锁定结果序列。

60.人像锁定及人像抠图结果如图3a所示,人像锁定结果包括:人像的索引id(例如图3a所示的id:1)、人像区域的外接矩形框(图3a中人像周围的矩形框),当然还可以包括其他信息,例如人像的身份、运动方向、运动速度等其他信息。

61.人像抠图结果包括:人像的索引id、人像抠图区域、人像抠图得到的alpha图(也称为trimap图,即三值图,alpha图的数值都是0~1,存储的是权重alpha),当然还可以包括其他信息,例如人像的身份、运动方向、运动速度等其他信息,其中,人像抠图区域是一个图像连通域,如图3a中人像所示,人像抠图得到的alpha图如图3b所示。

62.首先,利用已有用户的人像锁定结果序列(每一帧的图像都会得到一个人像锁定结果,若干连续帧的结果就构成了一个序列,序列内有连续多帧的人像锁定结果,每个结果都包含有id、矩形框、运动信息等,可以用来做目标跟踪、轨迹预测等),基于目标跟踪算法对输入的当前帧图像进行人像跟踪,具体地,可以采用传统的跟踪算法,包括但不限于kcf(kernel correlation filter,核相关滤波算法)/tld(tracking-learning-detection,跟踪学习检测)等算法。

63.一种典型的基于传统方法的人像跟踪算法可以是利用已有用户的人像锁定结果序列作为样本,训练一个判别分类器(可以采用现有技术训练得到该判别分类器,比如基于tld的方法,就是将现有的结果(或者上一帧的结果)作为样本,提取特征,包括sift特征、surf特征、hog特征、dpm特征、orb特征等,所述特征就是离线的多维向量,用这些特征去训练分类器,比如svm分类器、贝叶斯分类器、多层神经网络分类器等),并根据已有用户前几帧的人像锁定结果序列预测当前帧的人像位置,然后判断预测到的结果(当前帧的人像位置)是否是目标人像,并且,根据当前帧的人像锁定结果进行在线学习,不断更新判别分类器的模型参数。

64.另一种是基于深度学习的跟踪算法,包括但不限于siamesefc/siamrpn等算法,一种典型的基于深度学习的人像跟踪方法可以是利用已有用户的人像锁定结果序列作为模板帧,而当前帧作为检测帧,将模板帧和当前帧输入深度学习网络(深度学习网络是现有技术,包括卷积神经网络cnn,循环神经网络rnn等),输出跟踪到的目标人像跟踪结果(包括索引id、人像区域的外接矩形框,以及其他信息等)。

65.然后,根据跟踪到的人像跟踪结果,进行细粒度的人像识别,以确认当前帧的跟踪结果的确是目标用户的人像锁定结果。本方案的另一个特点是采用基于人脸识别和行人重识别(reid,person re-identification,也叫行人再识别)相结合的人像识别技术,如流程图4所示。其中,基于行人重识别的人像识别就是粗粒度的,这是因为基于行人重识别的人像识别往往是利用人体的穿着、头部发型等进行辨识当前人是否是目标人,辨识度不高,穿着相似、高矮胖瘦发型相似的人都会误识别为同一个人,而基于人脸的识别则是细粒度的人像识别,辨识度更高,也就是识别率更准确。具体的,首先对当前帧的人像跟踪结果进行人脸检测,判定是否有人脸,如果有,则基于人脸识别技术对当前帧的人像跟踪结果区域进行人脸识别,判断是否有目标用户的人脸,反之,则基于行人重识别技术对当前帧的人像跟踪结果区域进行行人重识别(就是利用人的衣服穿着打扮、高矮胖瘦、发型等辨识这个人是否是目标),包括但不限于alignedreid等算法,判断是否有目标用户,有则输出相应id,反之,则输出未识别。然后,如果有目标用户的人脸或者目标用户,则当前帧的人像跟踪结果是人像锁定结果,并更新已有用户的人像锁定结果序列,反之,则当前帧的人像跟踪结果不是人像锁定结果,需要重新进行人像跟踪。

66.二、人像抠图:

67.从算法实现上,人像抠图的方法大致可分为两类:一种是绿幕抠图方法,一类是图像分割方法。前者的一般流程是首先将红绿蓝(rgb)图像转为hsv(hue,saturation,value,色度、饱和度、明度)图像,然后对颜色进行二值化处理,最后获得去除绿幕背景的人像前景。后者的一般流程是从输入图像中估计alpha图,也称为三分图(trimap)。所述alpha图中取值范围是0~1之间,其中1是前景,0是背景,0~1之间表示该像素是前背景色的比例,从而将抠图问题转化为求解每一个图像像素估计alpha值的问题。事实上,不论采用哪种人像抠图方法,都不影响本方案的实质。

68.从抠图范围上,人像抠图可分为全图抠图和局部抠图,本方案的另一个特点是采用全局与局部相结合的人像抠图方法,具体流程见图5所示。

69.具体的,当有新用户加入请求时,则在原图的全图像区域内进行人像抠图,获得全图的人像抠图结果,由于图像中可能存在非目标人物的干扰,因此,需要对全图的人像抠图结果进行确认,以获得目标新用户的抠图结果,并将新用户的人像抠图结果添加到已有用户的人像锁定结果序列中;反之,当无新用户加入但有已有用户退出请求时,则从已有用户的人像锁定结果序列中去除该用户;进一步的,当无新用户加入且无已有用户退出时,则根据人像锁定结果序列对应的局部区域内进行人像抠图,获得局部的人像抠图结果,最后更新已有用户的人像抠图结果序列。

70.其中,确认新用户的人像抠图结果的具体流程见图6所示。

71.具体的,首先,将全图区域内人像抠图结果和已有用户的人像抠图序列结果进行比较,获得全图区域内新增的人像抠图结果,也就是在当前帧的全图人像抠图结果中去除

已有用户的人像抠图结果,只保留新增的人像抠图结果。可采用基于人像抠图结果或基于人像锁定结果两大类方法,其中一种典型的基于人像抠图结果的方法可以为:根据当前帧的全图人像抠图结果,获得人像索引id和对应的人像抠图区域,然后将当前帧的人像抠图结果与已有的人像抠图结果进行逐一比较,如果当前人像抠图区域与已有的人像抠图区域存在区域交集并且大于一定阈值,则认为该人像抠图区域为已有的人像抠图结果,反之,则认为该人像抠图区域为新增的人像抠图结果。一种典型的基于人像锁定结果的方法可以为:根据当前帧的全图人像抠图结果,获得全图人像锁定结果,得到人像锁定索引id和对应的人像区域的矩形框,然后将当前帧的人像锁定结果与已有的人像锁定结果进行逐一比较,如果当前人像区域的矩形框与已有的人像区域的矩形框存在区域交集并且大于一定阈值,则认为该人像锁定结果为已有的人像锁定结果,反之,则认为该人像锁定结果为新增的人像锁定结果,对应的人像抠图结果为新增的人像抠图结果。采用何种方法并不影响本方案的实质。

72.然后,从新增的人像抠图结果中确认目标用户的人像抠图结果,可以采用人工确认和自动确认两大类方法,其中一种典型的人工确认方法可以是通过遥控器、键盘、鼠标等输入设备触控、语音交互等方式进行选择确认,一种典型的自动确认方法可以是目标人物做出挥手等特定姿态或手势动作,利用动作识别自动确认目标用户,采用何种方法并不影响本方案的实现;最后获得新用户的人像抠图结果。

73.三、场景合成:

74.根据获取的人像抠图结果序列以及人像锁定结果序列,将人像与场景图像进行融合,具体流程如图7所示。

75.首先,在场景中确认人像位置与尺寸,这是由于人像在图像中的比例受相机参数、人像与相机距离等因素影响,为了使得场景合成后的图像中人像位置与尺寸更具真实感,因此需要确认场景中人像位置与尺寸,即场景roi(region of interest,感兴趣区域)区域序列(每一用户对应一roi区域),如图8中两个用户的矩形框所示,包括索引id、区域中心位置、区域宽度和高度;针对每一用户,根据确认的人像宽度和高度对人像抠图与人像锁定结果进行缩放,然后将缩放后的人像抠图结果与场景中的相应的roi区域进行融合,融合公式如下所示:

76.c

i,j

=b

i,j

*(1-m

i,j

)+a

i,j

*m

i,j

,i∈{0,1,

…

,w},j∈{0,1,

…

,h}

77.其中,a

i,j

为人像抠图的原始图像,m

i,j

为人像抠图的alpha值,b

i,j

为背景roi区域的原始图像(即预设场景图像),c

i,j

为人像与场景融合后的图像,i和j是图像像素的位置,分别表示第i行第j列,w、h为缩放后的人像锁定矩形框的宽度和高度。

78.综上所述,参见图9,本技术实施例提供的一种图像处理方法,包括:

79.s101、通过对视频图像中的用户的实时跟踪锁定,确定用户的人像锁定结果序列;

80.s102、基于已有用户的人像锁定结果序列,进行人像抠图,确定人像抠图结果序列;

81.s103、利用所述人像抠图结果序列,以及预设场景图像,得到合成图像。

82.通过该方法,对视频图像中的用户的实时跟踪锁定,确定用户的人像锁定结果序列;基于已有用户的人像锁定结果序列,进行人像抠图,确定人像抠图结果序列;利用所述人像抠图结果序列,以及预设场景图像,得到合成图像,从而在视频场景下,实现了对视频

中的目标人物的实时跟踪锁定,有效解决了视频背景中的多人干扰或目标人物运动等造成的目标丢失导致的漏抠取或者目标错误导致的误抠取等问题。

83.可选地,该方法还包括:

84.当有新用户加入合成图像请求时,在原图的全图像区域内进行人像抠图,获得全图的人像抠图结果;其中,所述新用户加入合成图像请求,例如有新的用户通过遥控器等操作请求加入合成视频;

85.从所述全图的人像抠图结果中确认目标新用户的人像抠图结果;

86.将所述新用户的人像抠图结果添加到已有用户的人像锁定结果序列中。

87.可选地,该方法还包括:

88.当有已有用户退出合成图像请求时,从已有用户的人像锁定结果序列中去除该用户的人像锁定结果。

89.可选地,从所述全图的人像抠图结果中确认目标新用户的人像抠图结果,具体包括:

90.在当前帧的全图人像抠图结果中去除已有用户的人像抠图结果,得到新增的人像抠图结果;

91.从新增的人像抠图结果中确认目标新用户的人像抠图结果。

92.可选地,通过对视频图像中的用户的实时跟踪锁定,确定用户的人像锁定结果序列,具体包括:

93.利用已有用户的人像锁定结果序列,针对当前帧图像进行目标跟踪,确定当前帧图像的目标人像跟踪结果;

94.针对所述当前帧图像的目标人像跟踪结果,进行人像识别,以确认所述当前帧图像的目标人像跟踪结果是目标用户的人像锁定结果,并更新已有用户的人像锁定结果序列。

95.可选地,针对所述当前帧图像的目标人像跟踪结果,进行人像识别,以确认所述当前帧图像的目标人像跟踪结果是目标用户的人像锁定结果,并更新已有用户的人像锁定结果序列,具体包括:

96.对当前帧图像的人像跟踪结果进行人脸检测,判断是否有人脸;

97.如果有,则对当前帧图像的人像跟踪结果中的人像区域进行人脸识别,判断是否有目标用户的人脸;

98.否则,对当前帧图像的人像跟踪结果中的人像区域进行行人重识别,判断是否有目标用户;

99.当确定有目标用户的人脸或者有目标用户,则确定当前帧图像的人像跟踪结果是人像锁定结果,并更新已有用户的人像锁定结果序列。

100.可选地,利用所述人像抠图结果序列,以及预设场景图像,得到合成图像,具体包括:

101.针对人像抠图结果序列中的任一用户的人像抠图结果,采用如下公式将该用户的人像与预设场景图像融合,得到合成图像:

102.c

i,j

=b

i,j

*(1-m

i,j

)+a

i,j

*m

i,j

,i∈{0,1,

…

,w},j∈{0,1,

…

,h}

103.其中,a

i,j

为人像抠图的原始图像,m

i,j

为人像抠图的alpha值,b

i,j

为预设场景图

像,c

i,j

为合成图像,i和j分别表示图像的行和列的像素的位置,w、h分别为对该用户的人像锁定结果按照预设场景图像中roi区域的尺寸进行缩放后的人像锁定矩形框的宽度和高度。

104.需要说明的是,当有多个用户需要添加到同一场景时,同理利用上述公式即可,在公式中多加相应用户的a

i,j

和m

i,j

即可,此处不再赘述。

105.与上述方法相对应的,参见图10,本技术实施例提供的一种图像处理装置,包括:

106.第一单元11,用于通过对视频图像中的用户的实时跟踪锁定,确定用户的人像锁定结果序列;

107.第二单元12,用于基于已有用户的人像锁定结果序列,进行人像抠图,确定人像抠图结果序列;

108.第三单元13,用于利用所述人像抠图结果序列,以及预设场景图像,得到合成图像。

109.可选地,第一单元11还用于:

110.当有新用户加入合成图像请求时,在原图的全图像区域内进行人像抠图,获得全图的人像抠图结果;

111.从所述全图的人像抠图结果中确认目标新用户的人像抠图结果;

112.将所述新用户的人像抠图结果添加到已有用户的人像锁定结果序列中。

113.可选地,第一单元11还用于:

114.当有已有用户退出合成图像请求时,从已有用户的人像锁定结果序列中去除该用户的人像锁定结果。

115.可选地,从所述全图的人像抠图结果中确认目标新用户的人像抠图结果,具体包括:

116.在当前帧的全图人像抠图结果中去除已有用户的人像抠图结果,得到新增的人像抠图结果;

117.从新增的人像抠图结果中确认目标新用户的人像抠图结果。

118.可选地,通过对视频图像中的用户的实时跟踪锁定,确定用户的人像锁定结果序列,具体包括:

119.利用已有用户的人像锁定结果序列,针对当前帧图像进行目标跟踪,确定当前帧图像的目标人像跟踪结果;

120.针对所述当前帧图像的目标人像跟踪结果,进行人像识别,以确认所述当前帧图像的目标人像跟踪结果是目标用户的人像锁定结果,并更新已有用户的人像锁定结果序列。

121.可选地,针对所述当前帧图像的目标人像跟踪结果,进行人像识别,以确认所述当前帧图像的目标人像跟踪结果是目标用户的人像锁定结果,并更新已有用户的人像锁定结果序列,具体包括:

122.对当前帧图像的人像跟踪结果进行人脸检测,判断是否有人脸;

123.如果有,则对当前帧图像的人像跟踪结果中的人像区域进行人脸识别,判断是否有目标用户的人脸;

124.否则,对当前帧图像的人像跟踪结果中的人像区域进行行人重识别,判断是否有

目标用户;

125.当确定有目标用户的人脸或者有目标用户,则确定当前帧图像的人像跟踪结果是人像锁定结果,并更新已有用户的人像锁定结果序列。

126.可选地,利用所述人像抠图结果序列,以及预设场景图像,得到合成图像,具体包括:

127.针对人像抠图结果序列中的任一用户的人像抠图结果,采用如下公式将该用户的人像与预设场景图像融合,得到合成图像:

128.c

i,j

=b

i,j

*(1-m

i,j

)+a

i,j

*m

i,j

,i∈{0,1,

…

,w},j∈{0,1,

…

,h}

129.其中,a

i,j

为人像抠图的原始图像,m

i,j

为人像抠图的alpha值,b

i,j

为预设场景图像,c

i,j

为合成图像,i和j分别表示图像的行和列的像素的位置,w、h分别为对该用户的人像锁定结果按照预设场景图像中roi区域的尺寸进行缩放后的人像锁定矩形框的宽度和高度。

130.需要说明的是,本技术实施例中对单元的划分是示意性的,仅仅为一种逻辑功能划分,实际实现时可以有另外的划分方式。另外,在本技术各个实施例中的各功能单元可以集成在一个处理单元中,也可以是各个单元单独物理存在,也可以两个或两个以上单元集成在一个单元中。上述集成的单元既可以采用硬件的形式实现,也可以采用软件功能单元的形式实现。

131.所述集成的单元如果以软件功能单元的形式实现并作为独立的产品销售或使用时,可以存储在一个计算机可读取存储介质中。基于这样的理解,本技术的技术方案本质上或者说对现有技术做出贡献的部分或者该技术方案的全部或部分可以以软件产品的形式体现出来,该计算机软件产品存储在一个存储介质中,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)或处理器(processor)执行本技术各个实施例所述方法的全部或部分步骤。而前述的存储介质包括:u盘、移动硬盘、只读存储器(read-only memory,rom)、随机存取存储器(random access memory,ram)、磁碟或者光盘等各种可以存储程序代码的介质。

132.参见图11,本技术实施例提供了一种计算设备,该计算设备具体可以为桌面计算机、便携式计算机、智能手机、平板电脑、个人数字助理(personal digital assistant,pda)、电视机等智能家电。该计算设备可以包括中央处理器(center processing unit,cpu)22、存储器21、输入/输出设备(图中未示出)等,输入设备可以包括键盘、鼠标、触摸屏等,输出设备可以包括显示设备,如液晶显示器(liquid crystal display,lcd)、阴极射线管(cathode ray tube,crt)等。

133.存储器可以包括只读存储器(rom)和随机存取存储器(ram),并向处理器提供存储器中存储的程序指令和数据。在本技术实施例中,存储器可以用于存储本技术实施例提供的任一所述方法的程序。

134.处理器通过调用存储器存储的程序指令,处理器用于按照获得的程序指令执行本技术实施例提供的任一所述方法。

135.本技术实施例提供了一种计算机存储介质,用于储存为上述本技术实施例提供的装置所用的计算机程序指令,其包含用于执行上述本技术实施例提供的任一方法的程序。

136.所述计算机存储介质可以是计算机能够存取的任何可用介质或数据存储设备,包

括但不限于磁性存储器(例如软盘、硬盘、磁带、磁光盘(mo)等)、光学存储器(例如cd、dvd、bd、hvd等)、以及半导体存储器(例如rom、eprom、eeprom、非易失性存储器(nand flash)、固态硬盘(ssd))等。

137.本技术实施例提供的方法可以应用于终端设备,也可以应用于网络设备。

138.上述方法处理流程可以用软件程序实现,该软件程序可以存储在存储介质中,当存储的软件程序被调用时,执行上述方法步骤。

139.本领域内的技术人员应明白,本技术的实施例可提供为方法、系统、或计算机程序产品。因此,本技术可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本技术可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器和光学存储器等)上实施的计算机程序产品的形式。

140.本技术是参照根据本技术实施例的方法、设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。

141.这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。

142.这些计算机程序指令也可装载到计算机或其他可编程数据处理设备上,使得在计算机或其他可编程设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。

143.显然,本领域的技术人员可以对本技术进行各种改动和变型而不脱离本技术的精神和范围。这样,倘若本技术的这些修改和变型属于本技术权利要求及其等同技术的范围之内,则本技术也意图包含这些改动和变型在内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1