基于代表性和特异性得分的非监督监控视频摘要生成方法及生成器

1.本发明涉及视频技术领域,特别涉及一种基于代表性和特异性得分的非 监督监控视频摘要生成方法。

背景技术:

2.监控视频,通常摄像机固定、背景不变、某些时段内容长时间不变,某 些时段内容变化频繁。对其进行摘要是一种在保留相对完整的、有变化内容的前 提下,创建短片快速了解视频内容浏览的技术。基于短片生成的视频摘要任务一 般分为片段分割、帧权重评估和片段选择几项基本环节组成。由于对视觉兴趣点、 紧凑性(即冗余度较小)、以及内容全面多样性的不同要求,不同的观众在不同的 时间会产生不同的视频摘要标准及结果。但无论何种摘要生成标准,考虑视频所 有帧之间的语义关系以及它们是如何相互关联的,才是生成满意摘要结果的关 键。

3.近年来受深度学习巨大成功的启发,目前的方法通常将视频摘要用 rnn/lstm/gru等网络模型来解决帧序列评分问题。该类模型能够长期捕获帧间 的依赖关系,但由于其模型需要大量数据进行监督学习,建立时序依赖关系,计 算复杂度及模型迁移性不佳。对于成千上万内容复杂,数据分布广泛的数据,也 难以较好把握视频全局语义信息。

技术实现要素:

4.本发明解决的技术问题是:提供一种用于生成监控视频摘要的方法,使 得模型无需使用大量数据进行监督学习,并从全局范围学习视频的视觉特征,加 之以时序相关的得分影响从而获得最终的视频摘要。

5.根据本发明的所述,提供一种用于生成监控视频摘要的方法,包括:筛 选部分视频帧进行摘要生成,剔除冗余;使用卷积神经网络提取筛选后视频帧的 特征;使用聚类方法将视频帧分为不同聚群;根据代表性和特异性得分选择较为 优秀的视频帧作为视频摘要。

6.在发明中,计算视频帧的代表性得分步骤包括:以靠近聚群中心的视频 帧为起点,通过找到这些帧在原视频时间轴的位置,以其被卷积神经网络提取后 的特征向量为输入,比较其与相邻帧的平均相似度,作为代表性得分。

7.在发明中,计算聚群的特异性得分步骤包括:将聚心所在帧特征向量与 其他聚心所在帧特征计算不相似度平均值,作为聚群特异性得分。

8.在发明中,最终的视频摘要将选择特异性得分靠前的聚群中代表性得分 较高的帧作为最终的视频摘要,这些视频帧将按照视频原本的时序进行排列。有益效果

9.在上述方法中,聚类方法配合卷积神经网络的视觉特征提取为视频摘要 的生成考虑的足够的空间性,而在选择视频帧时又通过回归视频时间轴的方式考 虑了一定的时

间性。同时由于使用非监督方式,本发明所应用的监控视频无任何 特殊要求。

10.通过以下参照附图对本公开的发明的详细描述,本公开的其它特征及其 优点将会变得清楚。

附图说明

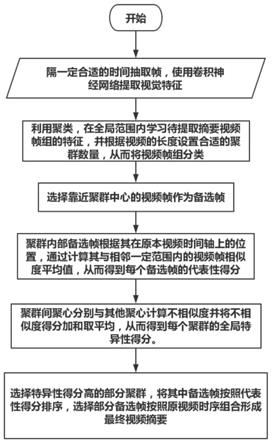

11.图1是本发明的用于生成视频摘要的方法的流程图;

12.图2是本发明的计算视频帧的代表性得分的方法的流程图;

13.图3是本发明的计算聚群的特异性得分的方法的流程图;

14.图4是基于代表性和特异性得分的非监督监控视频摘要生成器的系统框 图;

具体实施方式

15.现在将参照附图来详细描述本公开发明。应注意到:除非另外具体说明, 否则在下述中的数字表达式和数值不限制本公开的范围。

16.对于相关领域普通技术人员已知的技术和方法可能不作详细讨论,但在 适当情况下,所述技术和方法应当被视为说明书的一部分。

17.在这里示出和讨论的所有示例中,任何具体值应被解释为仅仅是示例性 的,而不是作为限制。

18.下面结合图1至图3详细描述根据本公开发明的用于生成视频摘要的方 法。如图1所示,该方法包括六个步骤。

19.如图1所示,步骤1中将视频进行了抽取筛选,剔除冗余。

20.例如一个视频,如果每秒存在30帧,这30帧的内容往往十分相似,如 果不进行适当的筛选,则会给视频摘要的计算带来大量的负担。

21.由于时间上间隔较短的帧之间相似度往往极高,为减少后续生成摘要时 间,需根据视频每秒包含帧数进行适当的视频帧筛选操作。

22.在步骤1中使用卷积神经网络提取筛选后的视频帧组的视觉特征。

23.卷积神经网络输入的图片尺寸要视神经网络框架,比如 vgg,alexnet,resnet...而定。抽取后的视频帧集合为f={f

t

|t=1,2......,t},其通过 卷积神经网络提取后的特征向量列为x={x

t

|t=1,2......,t},其中t为视频帧组包 含视频帧个数,x由视频每帧视觉特征决定。

24.如图1所示,在本发明中使用了k

‑

means聚类方法,还可以采用别的聚 类方法,步骤2具体如下:

25.监控视频有时在前景变化不大时帧率设置教低,前景变化大时帧率较高。 视频通常通过rgb颜色空间记录图像颜色。rgb色彩符合人类视觉习惯,但三个 通道均匀性较低,且颜色通道的色差区分度不够。相对于rgb颜色空间,hsv空 间能够非常直观地表达色彩的色相(hue)、饱和度(saturation)、亮度(value), 方便进行颜色之间对的对比。本发明将视频图像转换为hsv色彩空间,提取视 频帧组f在三个通道线性叠加的图像直方图为h={h

t

|t=1,2......,t},比较相邻两 帧直方图h

t

、h

t+1

的不相似度his(h

t,

h

t+1

),若两张直方图不相似度超过一定阈值β(一 般设为0.75),则记此处为抽取后视频帧组的一个断点,最终聚群数量将设置为 断点数量+1,用k表示。his(h

t,

h

t+1

)的计算方法如下:

26.其中i指的是图像直方图同一横坐标所对 应的纵坐标值,在本发明中表现为视频帧rgb图像所对应的色相空间h的图像。

27.将获得的特征向量序列x作为聚类方法的输入,选择初始化的k个样本 作为初始聚类中心a=a1,a2,...a

k

;

28.针对x中每个样本计算它到k个聚类中心的距离并将其分到距离最小的 聚类中心所对应的类中;针对每个类别a

j

重新计算它的聚类中心,计算方法如下:

[0029][0030]

c

i

为该聚群中的所有样本,x为样本所对应的特征向量。

[0031]

重复[0028],直到达到既定迭代次数。

[0032]

如图1所示,步骤3中,由于视频摘要长度l(一般为f的10%~15%)有限, 对于每一个视频帧组,选择距离聚群中心最近的(1+α)l个视频帧作为备选帧,共 得到k个备选帧组,k={k t

|t=1,2......,t}。α取值在(0.5~1),用于控制备选帧数量 的参数,与k的数量成反比。

[0033]

结合图1与图2,步骤4每个聚群对应的备选帧组内的所有备选帧的代 表性得分。根据备选帧组内的所有备选帧在原视频时间轴上的位置,通过计算每 个备选帧与相邻一定时间范围内的备选视频帧相似度平均值,来考虑除了视觉特 征以外的时间关系,从而得到每个备选帧的代表性得分。代表性得分高的帧被认 为是能够代表该视频帧组的更优选择。

[0034]

如图2所示,以第一聚群为例,第一聚群对应的备选帧组中包含一定备 选帧,其中对每个备选帧按时间轴找到其在原视频的位置,本实施例中邻帧的选 取范围为前后5帧,共10帧,例如对于第100个备选帧,有分别计算第100个 备选帧与其前后5视频帧的余弦相似度,并求平均值该平均值作为第100个 备选帧的代表性得分r。其中,余弦相似度计算方法如下所示:

[0035]

其中x

i

,x

i'

代表被选中比较的两备选帧所对应 的特征向量,i=100,i’=95,

…

,99,101,

…

,105。x

t

为转置,分母部分为向量 的第二范式。i的取值编号为原时间轴上抽取视频帧的编号,而非备选帧的编号。

[0036]

结合图1与图3,步骤5计算特异性得分。聚群间聚心分别与其他聚心 计算不相似度,并加和取平均,以第一聚群为例,第一聚群对应的聚心特征为 x

c

,x

c

是卷积神经网络提取得到的视觉特征,x

c

分别与其余所有聚心的视觉特征 x

c’进行不相似度比较,并求得不相似度平均值该平均值作为第一个聚群的特 异性得分p。其中不相似度计算方法如下:

[0037]

不相似度同样使用余弦相似度计算方法,用1减去所得余弦相似度即为 该备选帧的特异性得分。

[0038]

如图1所示,步骤6将所有聚群按照特异性得分p从大到小排序,舍弃 分数小的聚群,本实施例中舍弃掉总聚群数量的40%,具体可根据实际情况进行 调整,而后在剩余聚

群中选择最终视频摘要,对于剩余聚群内的备选帧组,其中 将备选帧按s从大到小排序,选择前j个备选帧为最终组成视频摘要的选定帧, 总选定帧个数应在l取值的范围内。

[0039]

最终的视频摘要为将获得的选定帧按照原视频时间顺序整合为摘要视 频。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1