一种基于无人机视角的应急车道视觉检测方法和系统与流程

1.本发明涉及的是图像处理领域,特别涉及一种基于无人机视角的应急车道视觉检测方法和系统。

背景技术:

2.在计算机视觉中,车道线检测是一个基础性的问题,在自动驾驶方面具有广泛的应用。从上世纪九十年代开始,以美国、日本、欧洲为中心的发达国家与地区对车道偏离预警技术进行了比较集中的研究,并取得了许多有价值的成果。目前,世界上有些国家已经成果研制出一些各具特色的车道偏离预警系统,如:mobileye_aws系统、autovue系统、ralph系统、aurora系统等。这些系统通过预先给驾驶员以警告信息,提醒驾驶员采取正确的操作措施,达到防止这类事故或者降低这类事故的伤害程度的目的。

3.由于经济发展原因,我国在这一领域起步较晚,但总体来说发展速度较快。例如,清华大学智能技术与系统国家重点实验室研制的智能车thmr系列,其车道线自动跟踪时平均速度可达100km/h,最高速度可达150km/h,在速度上已经接近国际上的先进水平,在图像处理、控制算法等方面也取得了一定技术突破。

4.车道线检测技术能够使车辆正确地定位在车道内,遵守车道规定的交通规则。一般的车道线检测算法多基于单目图像。早期的车道线检测算法采用传统方法,通常采用基于视觉信息的车道检测方法,主要思想是利用视觉线索,通过图像处理,如his,颜色模型,和边缘提取算法等,人为选择特征,根据亮度、宽度等筛选出连通区域,通过图像预处理、特征提取等方式并与霍夫变换或卡尔曼滤波器等算法结合,在识别出车道线后采用后处理的方式形成最终的车道。通常,基于传统算法车道线模型由于道路场景变化而导致鲁棒性问题。现阶段,车道线检测算法得益于卷积神经网络强大的特征提取能力,性能也不断提升,近年来,随着深度学习的发展,一些基于深度神经网络的方法因其良好的表示和学习能力在车道检测方面显示出了优越性。车道检测算法作为自动驾驶的一个基本组成部分而被大量使用,这要求它具有非常低的计算成本。在这种情况下,对于车道线检测方法的提速是非常重要的。采用卷积神经网络(convolutional neuralnetwork,cnn)可以通过不同视角情况下的样本图片进行训练,自适应地提取路面上车道线的关键特征,后续通过全连接层来进行分类。车道线的完整检出和特殊区域的分割是该系统最为关键的两个步骤,由于目前主流的车道线检测系统均是基于驾驶员视角,cnn分割网络的计算量大速度较慢,而且在无人机视角中往往存在车道线尺寸变化、被车辆遮挡、相机曝光等复杂问题,因此车道线检测系统必须在受到这些因素干扰的情况下正常工作,具有极大的技术挑战。

技术实现要素:

5.鉴于上述问题,提出了本发明以便提供一种克服上述问题或者至少部分地解决上述问题的一种基于无人机视角的应急车道视觉检测方法和系统。

6.为了解决上述技术问题,本技术实施例公开了如下技术方案:

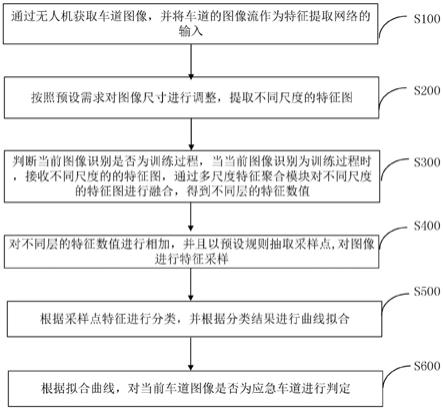

7.一种基于无人机视角的应急车道视觉检测方法,包括:

8.s100.通过无人机获取车道图像,并将车道的图像流作为特征提取网络的输入;

9.s200.按照预设需求对图像尺寸进行调整,提取不同尺度的特征图;

10.s300.判断当前图像识别是否为训练过程,当当前图像识别为训练过程时,接收不同尺度的的特征图,通过多尺度特征聚合模块对不同尺度的的特征图进行融合,得到不同层的特征数值;

11.s400.对不同层的特征数值进行相加,并且以预设规则抽取采样点,对图像进行特征采样;

12.s500.根据采样点特征进行分类,并根据分类结果进行曲线拟合;

13.s600.根据拟合曲线,对当前车道图像是否为应急车道进行判定。

14.进一步地,s200中,通过resnet

‑

34网络结构提取不同尺度的特征图。

15.进一步地,s200中,按照预设需求对图像尺寸进行调整,图片调整的宽高比为324

×

780。

16.进一步地,s300中,多尺度特征聚合模块与resnet

‑

34网络结构的后三个阶段的输出连接,其中,输出的前两个阶段用来预测尺度较小的目标,第三个阶段用来预测尺度较大的目标。

17.进一步地,s400中,对图像进行特征采样的预设规则为:将车道表示为预定义行上的一系列水平位置,并进行网格划分,将水平位置划分为多个单元格,按固定间隔抽取采样点并送入到全连接层中。

18.进一步地,s500中,根据采样点特征进行分类的方法包括:对其中每个行设置分类器,将行中每个位置对应的像素进行分类,分类器的个数与行锚数相同,并且,每个分类器根据输入的一行特征将原图像中对应位置的像素点进行分类,分类的数目在包含背景的情况下比最大车道数个数多一个。

19.进一步地,s500中,根据采样点特征进行分类的方法还包括:在标注过程中,将应急车道左侧线标注类别号设置为偶数,右侧线标记号设置为奇数,通过分类结果号的奇偶性对车道线上点的左右侧进行判断。

20.进一步地,s500中,当场景较为简单时,通过霍夫变换对车道线进行直接拟合,将图片中同一类检测结果的坐标进行统计并总体拟合,寻找出贯穿这些点周围的拟合程度最高的直线。

21.进一步地,s500中,当场景较为复杂时,对预设个数的检测结果进行霍夫变换拟合一小段直线,最终将拟合出的所有小段直线首尾相连合并为一条完整曲线,将同一条车道线上采样点进行排序,保证程序遍历结果时按照自上而下或者自下而上的顺序遍历完这条车道线上所有的采样点。

22.进一步地,s600中,对当前车道图像是否为应急车道进行判定的方法为:拟合出车道线后,从网络分类的结果中可以得知当前车道线的类别代号,其奇偶性可以表示自身处于应急车道的左侧还是右侧;从左至右遍历所有检测出的车道线,若类别代号出现偶数

‑

奇数的组合,就判别它们之间组成的部分就是应急车道,自上而下扫描两条线间的每一行进行标记,从而输出最终的应急车道检测结果图。

23.本发明还公开了一种基于无人机视角的应急车道视觉检测系统,包括:车道图像

获取模块、特征图提取模块、多尺度特征聚合模块、采样点特征分类模块、应急车道判定模块;其中:车道图像获取模块,用于通过无人机获取车道图像,并将车道的图像流作为特征提取网络的输入;

24.特征图提取模块,用于按照预设需求对图像尺寸进行调整,通过resnet

‑

34网络结构提取不同尺度的特征图;

25.多尺度特征聚合模块,用于接收不同尺度的的特征图,对不同尺度的的特征图进行融合,得到不同层的特征数值;

26.采样点特征分类模块,用于对不同层的特征数值进行相加,并且以预设规则抽取采样点,对图像进行特征采样;根据采样点特征进行分类,并根据分类结果进行曲线拟合;

27.应急车道判定模块,用于根据拟合曲线,对当前车道图像是否为应急车道进行判定。

28.本发明实施例提供的上述技术方案的有益效果至少包括:

29.本发明通过在原始图像上设计许多固定位置的采样行,通过深度残差网络模型resnet来提取全局特征,并通过最后的全连接层分类来判断出其中可能存在于车道线上的点。将检出的点拟合成曲线,来进行道路上特殊区域的分割。本发明解决了现有技术中,主流的车道线检测系统均是基于驾驶员视角,cnn分割网络的计算量大速度较慢,而且在无人机视角中往往存在车道线尺寸变化、被车辆遮挡、相机曝光等复杂问题。

30.下面通过附图和实施例,对本发明的技术方案做进一步的详细描述。

附图说明

31.附图用来提供对本发明的进一步理解,并且构成说明书的一部分,与本发明的实施例一起用于解释本发明,并不构成对本发明的限制。在附图中:

32.图1为本发明实施例1中,一种基于无人机视角的应急车道视觉检测方法的流程图。

具体实施方式

33.下面将参照附图更详细地描述本公开的示例性实施例。虽然附图中显示了本公开的示例性实施例,然而应当理解,可以以各种形式实现本公开而不应被这里阐述的实施例所限制。相反,提供这些实施例是为了能够更透彻地理解本公开,并且能够将本公开的范围完整的传达给本领域的技术人员。

34.为了解决现有技术中存在的问题,本发明实施例提供一种基于无人机视角的应急车道视觉检测方法。

35.实施例1

36.随着车道线检测任务所面临的场景越来越复杂,车道线可能是模糊的、被光照影响的、甚至是完全被遮挡的,传统车道线检测算法几乎无法实现检测,这种情况下,车道线检测需要寻求更高层次的语义分析。深度分割方法自然具有比传统图像处理方法更强的语义表示能力,并成为主流。虽然深度分割方法效果强于传统方法,但仍存在速度慢,局部感受野这两个关键问题。因为分割是逐像素分类,为了分割车道线要进行非常密集的计算,导致的结果就是速度比较慢。基于深度分割的方法另一个问题是感受野问题,因为分割一般

是全卷积得到分割结果,而卷积基本上是比较局部的,所以每个像素的感受野有限。在车道线检测中由于我们关注的问题大多是对于语义线的检测,需要对全局有很好的感知才能实现良好的定位。

37.基于此,本实施例公开了一种基于无人机视角的应急车道视觉检测方法,包括:

38.s100.通过无人机获取车道图像,并将车道的图像流作为特征提取网络的输入;本发明以无人机俯视的视角对车道图像进行采集,与现有技术中,以驾驶员视角进行采集有很大区别。

39.s200.按照预设需求对图像尺寸进行调整,提取不同尺度的特征图;具体的,在图片输入的预处理阶段,我们首先将输入图片尺寸统一改变为324

×

780的宽高比,目的是使最后用于分类的特征尺寸大小一致,然后使用resnet

‑

34作为体征提取的主干网来提取输入图片的特征,这种主干网具有相对少的参数量来提升检测速度并且特征提取具有较高的精度。

40.s300.判断当前图像识别是否为训练过程,当当前图像识别为训练过程时,接收不同尺度的的特征图,通过多尺度特征聚合模块对不同尺度的的特征图进行融合,得到不同层的特征数值;。

41.具体的,单纯的resnet

‑

34网络在面对复杂的立交桥道路场景时取得的效果较差,原因是立交桥不同高度道路上的车道线在无人机拍摄时具有不同的尺度,网络统一进行采样时难以对其进行分辨,于是我们在网络的训练过程中添加了多尺度特征聚合模块。特征图提取阶段,resnet

‑

34输出的几层结果中,越靠后的具有越高的感受野,在检测更大目标时表达更加重要的语义。多尺度特征聚合模块与resnet

‑

34网络结构的后三个阶段的输出连接,其中,输出的前两个阶段用来预测尺度较小的目标,即较远的车道线;第三个阶段用来预测尺度较大的目标,即较近的车道线。

42.将预测大小目标的阶段输出结果在通道维度上直接相连,从而构造新的多尺度特征,后续进行新的卷积操作,在这条cnn分支上进行完整的实例分割训练。此方法只在训练阶段使用了辅助分割任务,在测试阶段会将其删除。这样,即使我们增加了额外的分段任务,我们的方法的运行速度也不会受到影响,在前向过程中这与没有辅助分割任务的网络是一样的。在添加多尺度特征聚合模块之前,复杂道路场景下会出现训练数据难以收敛从而导致检测结果很差的情况,并且对于无人机视角不同高度的图像,网络对于多尺度的适应性也会出现问题,而添加模块之后可以利用多尺度信息来对参数更新产生更多约束,可以有效提升网络对多尺度图像的检测效果,并且使训练时收敛更加稳定。

43.s400.对不同层的特征数值进行相加,并且以预设规则抽取采样点,对图像进行特征采样;具体的,s400中,对图像进行特征采样的预设规则为:将车道表示为预定义行上的一系列水平位置,并进行网格划分,将水平位置划分为多个单元格,按固定间隔抽取采样点并送入到全连接层中。

44.具体的,用于采样的特征图是将resnet

‑

34几个阶段的输出结果在对应元素数值上相加所得。若以实例分割的思路去进行车道线检测需要将所有像素进行分类,因此需要将所,有特征输入到全连接层进行分类,计算量太大无法保证实时性,于是本文设计了全局特征行采样的方式来减少需要分类的像素点数量。抽样通常的图像分割网络中,在分类层进行的分类任务数是原图像素点的数目,所以导致网络速度较慢,难以满足在实际应用中

的需求。为了解决上述问题,我们提出将车道检测定义为基于全局图像特征的抽样行选择方法。换句话说,我们的方法是使用全局特征在每个预定义行上选择正确的车道位置。在我们的方案中,车道被表示为预定义行(即行锚)上的一系列水平位置,从而选取固定数目的行送入到全连接层中。

45.s500.根据采样点特征进行分类,并根据分类结果进行曲线拟合;具体的,本实施例s500中,根据采样点特征进行分类的方法包括:对其中每个行设置分类器,将行中每个位置对应的像素进行分类,分类器的个数与行锚数相同,并且,每个分类器根据输入的一行特征将原图像中对应位置的像素点进行分类,分类的数目在包含背景的情况下比最大车道数个数多一个。

46.在一些优选实施例中,根据采样点特征进行分类的方法还包括:在标注过程中,将应急车道左侧线标注类别号设置为偶数,右侧线标记号设置为奇数,通过分类结果号的奇偶性对车道线上点的左右侧进行判断。

47.s600.根据拟合曲线,对当前车道图像是否为应急车道进行判定。具体的,在本实施例的s600中,对当前车道图像是否为应急车道进行判定的方法为:拟合出车道线后,从网络分类的结果中可以得知当前车道线的类别代号,其奇偶性可以表示自身处于应急车道的左侧还是右侧;从左至右遍历所有检测出的车道线,若类别代号出现偶数

‑

奇数的组合,就判别它们之间组成的部分就是应急车道,自上而下扫描两条线间的每一行进行标记,从而输出最终的应急车道检测结果图。

48.本实施例还公开了一种基于无人机视角的应急车道视觉检测系统,包括:车道图像获取模块、特征图提取模块、多尺度特征聚合模块、采样点特征分类模块、应急车道判定模块;其中:车道图像获取模块,用于通过无人机获取车道图像,并将车道的图像流作为特征提取网络的输入;

49.特征图提取模块,用于按照预设需求对图像尺寸进行调整,通过resnet

‑

34网络结构提取不同尺度的特征图;

50.多尺度特征聚合模块,用于接收不同尺度的的特征图,对不同尺度的的特征图进行融合,得到不同层的特征数值;

51.采样点特征分类模块,用于对不同层的特征数值进行相加,并且以预设规则抽取采样点,对图像进行特征采样;根据采样点特征进行分类,并根据分类结果进行曲线拟合;

52.应急车道判定模块,用于根据拟合曲线,对当前车道图像是否为应急车道进行判定。

53.本实施例公开的一种基于无人机视角的应急车道视觉检测方法和系统,通过无人机获取车道图像,并将车道的图像流作为特征提取网络的输入;按照预设需求对图像尺寸进行调整,提取不同尺度的特征图;判断当前图像识别是否为训练过程,当当前图像识别为训练过程时,接收不同尺度的的特征图,通过多尺度特征聚合模块对不同尺度的的特征图进行融合,得到不同层的特征数值;对不同层的特征数值进行相加,并且以预设规则抽取采样点,对图像进行特征采样;根据采样点特征进行分类,并根据分类结果进行曲线拟合;根据拟合曲线,对当前车道图像是否为应急车道进行判定。解决了现有技术中,主流的车道线检测系统均是基于驾驶员视角,cnn分割网络的计算量大速度较慢,而且在无人机视角中往往存在车道线尺寸变化、被车辆遮挡、相机曝光等复杂问题。

54.应该明白,公开的过程中的步骤的特定顺序或层次是示例性方法的实例。基于设计偏好,应该理解,过程中的步骤的特定顺序或层次可以在不脱离本公开的保护范围的情况下得到重新安排。所附的方法权利要求以示例性的顺序给出了各种步骤的要素,并且不是要限于所述的特定顺序或层次。

55.在上述的详细描述中,各种特征一起组合在单个的实施方案中,以简化本公开。不应该将这种公开方法解释为反映了这样的意图,即,所要求保护的主题的实施方案需要清楚地在每个权利要求中所陈述的特征更多的特征。相反,如所附的权利要求书所反映的那样,本发明处于比所公开的单个实施方案的全部特征少的状态。因此,所附的权利要求书特此清楚地被并入详细描述中,其中每项权利要求独自作为本发明单独的优选实施方案。

56.本领域技术人员还应当理解,结合本文的实施例描述的各种说明性的逻辑框、模块、电路和算法步骤均可以实现成电子硬件、计算机软件或其组合。为了清楚地说明硬件和软件之间的可交换性,上面对各种说明性的部件、框、模块、电路和步骤均围绕其功能进行了一般地描述。至于这种功能是实现成硬件还是实现成软件,取决于特定的应用和对整个系统所施加的设计约束条件。熟练的技术人员可以针对每个特定应用,以变通的方式实现所描述的功能,但是,这种实现决策不应解释为背离本公开的保护范围。

57.结合本文的实施例所描述的方法或者算法的步骤可直接体现为硬件、由处理器执行的软件模块或其组合。软件模块可以位于ram存储器、闪存、rom存储器、eprom存储器、eeprom存储器、寄存器、硬盘、移动磁盘、cd

‑

rom或者本领域熟知的任何其它形式的存储介质中。一种示例性的存储介质连接至处理器,从而使处理器能够从该存储介质读取信息,且可向该存储介质写入信息。当然,存储介质也可以是处理器的组成部分。处理器和存储介质可以位于asic中。该asic可以位于用户终端中。当然,处理器和存储介质也可以作为分立组件存在于用户终端中。

58.对于软件实现,本技术中描述的技术可用执行本技术所述功能的模块(例如,过程、函数等)来实现。这些软件代码可以存储在存储器单元并由处理器执行。存储器单元可以实现在处理器内,也可以实现在处理器外,在后一种情况下,它经由各种手段以通信方式耦合到处理器,这些都是本领域中所公知的。

59.上文的描述包括一个或多个实施例的举例。当然,为了描述上述实施例而描述部件或方法的所有可能的结合是不可能的,但是本领域普通技术人员应该认识到,各个实施例可以做进一步的组合和排列。因此,本文中描述的实施例旨在涵盖落入所附权利要求书的保护范围内的所有这样的改变、修改和变型。此外,就说明书或权利要求书中使用的术语“包含”,该词的涵盖方式类似于术语“包括”,就如同“包括,”在权利要求中用作衔接词所解释的那样。此外,使用在权利要求书的说明书中的任何一个术语“或者”是要表示“非排它性的或者”。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1