电力基建知识图谱构建方法

1.本发明涉及电力基建与知识图谱领域,具体是电力基建知识图谱构建方法。

背景技术:

2.现代电力网络能够迅速发展的一个重要原因即是电力基建的发展。随着电力网络规模的不断扩大,越来越多的物联网、人工智能等技术被引入电力基建中,电力基建包含大量的人机料法环信息,基建过程中的新设备、新方法也让电力基建过程变得更加复杂。在这种情况下,电力基建的业务将面临越来越大的挑战。电力基建过程中存在大量的多源异构数据,管理类别众多且繁杂,管理效率低下。

3.知识图谱是一种语义网,它以结构化的形式表示事物以及事物之间的关系,可以有效利用大量的结构化、半结构化和非结构化数据。知识图谱的构建包括知识抽取、知识融合与知识表示等。知识图谱分为通用知识图谱和领域知识图谱。通用知识图谱主要应用于搜索引擎;领域知识图谱主要应用于特定的领域,专业化程度更高,已在医疗、法律、金融、电商等领域有应用。

4.领域知识图谱构建的一个关键挑战是缺乏领域内的数据集且专业术语和概念较多。传统的基于规则或基于模板的知识抽取需要人工构建大量的规则模板,适用范围有限,难以适应复杂的需求。

5.因此,构建知识图谱,减少人工的精力消耗,实现自动化地从原始数据中获取知识,并以neo4j图数据库进行可视化存储是十分有必要的。

技术实现要素:

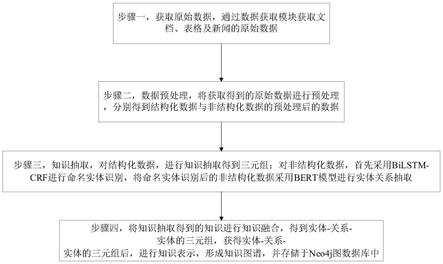

6.本发明的目的在于克服现有技术的不足,提供电力基建知识图谱构建方法,包括如下步骤:

7.步骤一,获取原始数据,通过数据获取模块获取文档、表格及新闻的原始数据;

8.步骤二,数据预处理,将获取得到的原始数据进行预处理,分别得到结构化数据与非结构化数据的预处理后的数据;

9.步骤三,知识抽取,对结构化数据,进行知识抽取得到三元组;对非结构化数据,首先采用bilstm-crf进行命名实体识别,将命名实体识别后的非结构化数据采用bert模型进行实体关系抽取;

10.步骤四,将知识抽取得到的知识进行知识融合,得到实体-关系-实体的三元组,获得实体-关系-实体的三元组后,进行知识表示,形成知识图谱,并存储于neo4j图数据库中。

11.进一步的,所述的将获取得到的原始数据进行预处理,分别得到结构化数据与非结构化数据的预处理后的数据,包括如下过程,对非结构化数据,将不同格式的数据转化为txt文本格式,并进行分词处理;对存储于传统关系型数据库中的结构化数据,把对应字段映射为知识图谱中的实体与关系。

12.进一步的,所述的对非结构化数据,首先采用bilstm-crf进行命名实体识别,将命

名实体识别后的非结构化数据采用bert模型进行关系抽取,包括如下过程:

13.通过词嵌入算法将单词序列转化为向量形式,得到词向量v

word

=(v1,v2,v3,

…

,vn),其中n为向量维度;将文本进行编码,然后解码获得每个词的序列标签,使用双向长短期记忆神经网络进行命名实体识别,再结合条件随机场对双向长短期记忆神经网络的输出进行约束,从样本中识别出实体。

14.进一步的,所述的知识融合包括共指消解,利用word2vec算法进行共指消解,两个词的词向量分别为x

word

=(x1,x2,x3,

…

,xn)和y

word

=(y1,y2,y3,

…

,yn),计算余弦值),计算余弦值若余弦值越大则两个词相似度越高,当余弦值超过设定的阈值时,则两个词可以看作是指代的同一含义,即实现共指消解。

15.进一步的,所述的使用bert模型进行实体间关系抽取,包括定义相对于主语实体的位置序列为

[0016][0017]

式中,s1和s2分别为主语实体的开始和结束位置,表示了和主语实体的相关位置;

[0018]

定于宾语实体的位置序列为将位置序列转换为位置向量,和bert的表示向量进行拼接,然后将向量序列输入给双向长短期记忆神经网络,获取每个方向上的最后一个隐含层状态,进行关系抽取。

[0019]

本发明的有益效果是:本发明基于bilstm-crf结合bert模型构建知识图谱,实现基于知识图谱的电力基建人机料法环信息管理系统,以neo4j为存储介质的可视化系统,能够针对电力基建过程进行综合信息管理。通过neo4j图数据库,将电力基建人机料法环相关信息通过图的形式存储起来,更有利于信息的利用。通过构建该系统,可以有利于辅助基建施工部门对基建过程进行管理,提高管理水平和管理效率。

附图说明

[0020]

图1为电力基建知识图谱构建方法的流程图;

[0021]

图2为利用bert模型进行关系抽取的示意图;

[0022]

图3为单个lstm单元总体框架图;

[0023]

图4为bilstm-crf模型的示意图;

[0024]

图5为用bilstm-crf结合bert模型的知识图谱构建方法及可视化系统示意图。

具体实施方式

[0025]

下面结合附图进一步详细描述本发明的技术方案,但本发明的保护范围不局限于以下所述。

[0026]

如图1所示,电力基建知识图谱构建方法,包括如下步骤:

[0027]

步骤一,获取原始数据,通过数据获取模块获取文档、表格及新闻的原始数据;

[0028]

步骤二,数据预处理,将获取得到的原始数据进行预处理,分别得到结构化数据与

非结构化数据的预处理后的数据;

[0029]

步骤三,知识抽取,对结构化数据,进行知识抽取得到三元组;对非结构化数据,首先采用bilstm-crf进行命名实体识别,将命名实体识别后的非结构化数据采用bert模型进行实体关系抽取;

[0030]

步骤四,将知识抽取得到的知识进行知识融合,得到实体-关系-实体的三元组,获得实体-关系-实体的三元组后,进行知识表示,形成知识图谱,并存储于neo4j图数据库中。

[0031]

所述的将获取得到的原始数据进行预处理,分别得到结构化数据与非结构化数据的预处理后的数据,包括如下过程,对非结构化数据,将不同格式的数据转化为txt文本格式,并进行分词处理;对存储于传统关系型数据库中的结构化数据,把对应字段映射为知识图谱中的实体与关系。

[0032]

所述的对非结构化数据,首先采用bilstm-crf进行命名实体识别,将命名实体识别后的非结构化数据采用bert模型进行关系抽取,包括如下过程:

[0033]

通过词嵌入算法将单词序列转化为向量形式,得到词向量v

word

=(v1,v2,v3,

…

,vn),其中n为向量维度;将文本进行编码,然后解码获得每个词的序列标签,使用双向长短期记忆神经网络进行命名实体识别,再结合条件随机场对双向长短期记忆神经网络的输出进行约束,从样本中识别出实体。

[0034]

所述的知识融合包括共指消解,利用word2vec算法进行共指消解,两个词的词向量分别为x

word

=(x1,x2,x3,

…

,xn)和y

word

=(y1,y2,y3,

…

,yn),计算余弦值),计算余弦值若余弦值越大则两个词相似度越高,当余弦值超过设定的阈值时,则两个词可以看作是指代的同一含义,即实现共指消解。

[0035]

所述的使用bert模型进行实体间关系抽取,包括定义相对于主语实体的位置序列为

[0036][0037]

式中,s1和s2分别为主语实体的开始和结束位置,表示了和主语实体的相关位置;

[0038]

定于宾语实体的位置序列为将位置序列转换为位置向量,和bert的表示向量进行拼接,然后将向量序列输入给双向长短期记忆神经网络,获取每个方向上的最后一个隐含层状态,进行关系抽取。

[0039]

具体的,步骤1,原始数据获取,主要通过网络爬虫技术合法获取并下载各电网公司或建筑单位公开发布的文档以及电力基建过程的表格。

[0040]

步骤2,对原始数据进行预处理,针对非结构化数据,需将各种格式的数据转化为txt文本格式,并进行分词处理,以便进行下一步工作。

[0041]

步骤3,针对存储于传统关系型数据库中的结构化数据,只需要把对应字段映射为知识图谱中的节点(实体)与边(关系)。

[0042]

步骤4,针对占所有数据中大部分的非结构化数据,首先利用词嵌入算法将单词序列转化为向量形式,得到词向量v

word

=(v1,v2,v3,

…

,vn),其中n为向量维度。

[0043]

步骤5,将文本进行编码,然后解码获得每个词的序列标签。

[0044]

步骤6,输入为上一步骤的序列标签,使用双向长短期记忆(bilstm)神经网络进行命名实体识别,再结合条件随机场(crf)对bilstm的输出进行约束,从较少样本中识别出实体。bilstm-crf模型如图2所示。

[0045]

单个lstm单元的总体框架如图3所示。输入为前一时刻的隐层状态h

t-1

,当前时刻的输入词为x

t

。由公式f

t

=σ(wf·

[h

t-1

,x

t

]+bf)计算遗忘门σ的值f

t

,选择要遗忘的信息;然后由公式i

t

=σ(wi·

[h

t-1

,x

t

]+bi)与计算记忆门的值i

t

和临时细胞状态由公式计算当前时刻的细胞状态;由公式o

t

=σ(wo[h

t-1

,x

t

]+bo)与h

t

=o

t

*tanh(c

t

)计算输出门的值o

t

和隐层状态h

t

;将所有时刻的隐层状态结合起来,便得到了隐层状态序列(h0,h1,h2,

…

,h

n-1

)。

[0046]

bilstm的具体原理为,将前向的lstm与后向的lstm相结合,前向lstm得到前向隐层状态序列,后向lstm得到后向隐层状态序列,将前向和后向隐层状态序列拼接,输出每个字的序列标签。

[0047]

由于bilstm输出可能会出现难以避免的误差,因此加入crf对输出序列进行约束,提高输出准确率。

[0048]

步骤7,进行知识融合,包括实体消歧和共指消解。由于电力基建属于专业领域,专业名词较多,基本不存在一词对应多个含义的情况,因此不需要进行实体消歧,但需要利用word2vec算法进行共指消解。如两个词的词向量分别为x

word

=(x1,x2,x3,

…

,xn)和y

word

=(y1,y2,y3,

…

,yn),计算其余弦值若余弦值越大则两个词相似度越高。相似度高的两个词可以看作是指代的同一含义,即实现了共指消解。

[0049]

步骤8,使用bert模型进行实体间关系抽取。如图2所示,[cls]为起始位,$与#为分隔不同实体的分隔符,即输入的结构为:[cls]句子[分隔符]主语实体[分隔符]宾语实体[分隔符]。由h=[h0,h1,

…

,hn,h

n+1

]表示[cls]句子[分隔符]之间词汇经bert得到的向量表示;hs=[h

s1

,h

s1+1

,

…

,h

s2

]表示主语实体;ho=[h

o1

,h

o1+1

,

…

,h

o2

]表示宾语实体;定义相对于主语实体的位置序列为

[0050][0051]

式中,s1和s2分别为主语实体的开始和结束位置,表示了和主语实体的相关位置。

[0052]

同样地,定于宾语实体的位置序列为

[0053]

将位置序列转换为位置向量,和bert的表示向量进行拼接,如图2中的a所示。

[0054]

然后将向量序列输入给bilstm,获取每个方向上的最后一个隐含层状态,进行关系抽取。

[0055]

步骤9,将以上步骤得到的[实体-关系-实体]对存储于neo4j图数据库中。2

[0056]

本技术提出了一种针对结构化数据如关系型数据库中的数据,完成从结构化数据

到知识图谱到映射,实现从数据库向知识图谱的转化;针对非结构化数据,主要采用深度学习的方法,对电力基建过程产生的文本和网页信息进行知识抽取,完成实体识别与关系抽取,并将知识融合后的数据以rdf文件的形式存入到neo4j中,通过neo4j图数据库实现知识图谱的可视化展示并可以使用neo4j自带的cypher查询语言进行语义查询.

[0057]

以上所述仅是本发明的优选实施方式,应当理解本发明并非局限于本文所披露的形式,不应看作是对其他实施例的排除,而可用于各种其他组合、修改和环境,并能够在本文所述构想范围内,通过上述教导或相关领域的技术或知识进行改动。而本领域人员所进行的改动和变化不脱离本发明的精神和范围,则都应在本发明所附权利要求的保护范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1