一种文本意图分类方法、系统及计算机可读存储介质与流程

1.本发明涉及人工智能领域,特别是一种文本意图分类方法、系统及计算机可读存储介质。

背景技术:

2.由于人工智能在自然语言处理领域的最主要的应用就是对话系统。其中,最重要的就是意图识别任务,因此许多研究人员都致力于文本分类的研究,并提出了许多成效优异的方法,现有技术中的文本意图分类主要可以分为以下两种:

3.1.传统方法:先对文本进行预处理,再进行特征提取和特征工程,最后利用分类器模型进行意图分类。

4.2.深度学习的方法:先用词向量作为文本表示,再通过深度神经网络来进行意图分类。现有技术中应用深度学习的方法进行文本意图分类的主流的又分两种,一种是在cnn的基础上进行卷积网络的搭建,另一种基于rnn的基础上来进行的。

5.对于现有技术中的算法,其都忽视将文本的结构化信息加入到注意力机制中,现有技术最多是将词级别的注意力和句子级别的注意力结合起来理解文本。但是,由于句子长度不一致,词之间的相对位置的区别对于两个相似的句子的意图类别影响很大。在这一情况下,现有技术中的文本意图分类方法就无法达到准确的意图识别。

技术实现要素:

6.本发明的主要目的在于提供了一种文本意图分类方法及计算机可读存储介质,旨在解决现有技术中由于句子长度不一致,词之间的相对位置的区别对于两个相似的句子的意图类别影响很大的情况下,文本意图识别的准确性较低的技术问题。

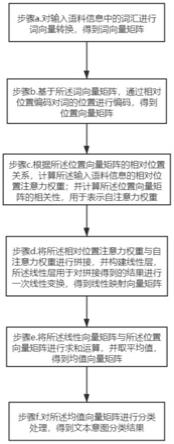

7.为实现上述目的,本发明提供了一种文本意图分类方法,其包括以下步骤:步骤a.对输入语料信息中的词汇进行词向量转换,得到词向量矩阵;步骤b.基于所述词向量矩阵,通过相对位置编码对词的位置进行编码,得到位置向量矩阵;步骤c.根据所述位置向量矩阵的相对位置关系,计算所述输入语料信息的相对位置注意力权重;并计算所述位置向量矩阵的相关性,用于表示自注意力权重;步骤d.将所述相对位置注意力权重与自注意力权重进行拼接,并构建线性层,所述线性层用于对拼接得到的结果进行一次线性变换,得到线性映射向量矩阵;步骤e.将所述线性向量矩阵与所述位置向量矩阵进行求和运算,并取平均值,得到均值向量矩阵;步骤f.对所述均值向量矩阵进行分类处理,得到文本意图分类结果。

8.可选的,所述输入语料信息是通过收集对话数据作为原始语料信息,并对所述原始语料信息进行数据处理后得到的。

9.可选的,所述数据处理,包括如下步骤:步骤一:对所述原始语料信息进行预处理,并构建字表,所述字表为所述原始语料信息中包含的所有汉字所组成的列表;基于所述字表对所述原始语料信息中的每个字进行数字化,得到数字化原始语料信息;步骤二:对数字

化原始语料信息的句子文本进行文本意图分类,得到每个句子文本的所属意图类别,分批读取句子文本以及其对应的所属类别;并将所述句子文本进行分词得到对应的标注标签;步骤三:将所述标注标签与句子文本长度、文本掩码进行拼接,形成所述输入语料信息。

10.可选的,所述步骤一中的预处理还包括去除特殊字符、停用词和表情符号。

11.可选的,所述步骤a通过bert预训练模型、skip-gram模型或cbow模型中的一种来实现。

12.可选的,所述步骤a中,将所述输入语料信息中的句子最大长度设置为n,词向量维度设置为k,所述词向量矩阵为n*k的矩阵;所述句子最大长度n设置为32或64,所述词向量维度k设置为128或256

13.可选的,所述步骤c,包括如下步骤:

14.c1.根据如下公式,计算q与k的相对位置关系,

15.pos(q),pos(k)=cosine(q

·

q),cosine(k),

16.其中,q表示词向量矩阵,k表示第一权重序列向量;

17.c2.根据所述相对位置关系计算相对位置注意力权重,所述相对位置注意力权重的计算公式如下:

[0018][0019]

其中,attention(q,k,v)表示相对位置的注意力权重,d表示向量的维度,v是在k的基础上取余弦值得到的,表示第二权重序列向量,k表示开根号的维度;

[0020]

c3.将q与k进行点乘运算,得到所述位置向量矩阵的相关性。

[0021]

可选的,所述步骤f是通过全连接层对所述均值向量矩阵进行特征综合,再通过softmax层进行分类处理,最后输出所述输入语料信息对应的文本意图分类结果。

[0022]

与上述文本意图分类方法,本发明还提供一种文本意图分类系统,包括:文本表示模块:将输入语料信息输入至文本表示模块,得到词向量矩阵;位置注意力模块:基于所述词向量矩阵,通过相对位置编码对词的位置进行编码,得到位置向量矩阵;根据所述位置向量矩阵的相对位置关系,计算所述语料信息的相对位置注意力权重;自注意力模块:基于所述位置向量矩阵,计算所述位置向量矩阵的相关性,用于表示自注意力权重;线性变换模块:将所述相对位置注意力权重与注意力权重进行拼接,并构建线性层,所述线性层用于对拼接得到的结果进行一次线性变换,得到线性映射向量矩阵;文本意图分类模块:对所述均值向量矩阵进行分类处理,得到文本意图分类结果。

[0023]

此外,为实现上述目的,本发明还提供一种计算机可读存储介质,所述计算机可读存储介质上存储有文本意图分类程序,所述文本意图分类程序被处理器执行时实现所述的文本意图分类的步骤。

[0024]

本发明的有益效果是:

[0025]

(1)本发明通过相对位置注意力权重,能够更好地在文本字符位置之间没有约束的情况下学习并整合文本字符之间的位置相对关系,无论字符处于文本的何处位置,本发明都能够将上下文与当前注意力机制中比较关键的字符的联系学习到,进行更为准确的文本意图分类;

[0026]

(2)通过位置编码与词向量矩阵的叠加,相当于进一步提取了位置特征,有效提高

了文本意图分类的准确性;并且,将相对位置注意力权重与注意力权重进行合并后构建线性层,一方面学习监督信息,另一方面实际上是对两个注意力的投票或者加权求和,更好地增大了注意力的作用,对语义的学习产生明显的优化效果;

[0027]

(3)对原始语料信息进行数据处理得到输入语料信息,能够有效提高后续文本意图分类的效率;

[0028]

(4)通过设置句子最大长度n和词向量维度k,能够避免句子长度不统一所导致的分批输入效率低下的问题。

附图说明

[0029]

此处所说明的附图用来提供对本发明的进一步理解,构成本发明的一部分,本发明的示意性实施例及其说明用于解释本发明,并不构成对本发明的不当限定。在附图中:

[0030]

图1为本发明文本意图分类方法的流程简图。

具体实施方式

[0031]

为使本发明实施例的目的、技术方案和优点更加清楚,下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本发明一部分实施例,而不是全部的实施例。应当理解,此处所描述的具体实施例仅用以解释本发明,并不用于限定本发明。基于本发明中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

[0032]

如图1所示,本发明的一种文本分类方法,其包括以下步骤:

[0033]

一种文本意图分类方法,包括如下步骤:步骤a.对输入语料信息中的词汇进行词向量转换,得到词向量矩阵;步骤b.基于词向量矩阵,通过相对位置编码对词的位置进行编码,得到位置向量矩阵;步骤c.根据位置向量矩阵的相对位置关系,计算输入语料信息的相对位置注意力权重;并计算位置向量矩阵的相关性,用于表示自注意力权重;步骤d.将相对位置注意力权重与自注意力权重进行拼接,并构建线性层,线性层用于对拼接得到的结果进行一次线性变换,得到线性映射向量矩阵;步骤e.将线性向量矩阵与位置向量矩阵进行求和运算,并取平均值,得到均值向量矩阵;步骤f.对均值向量矩阵进行分类处理,得到文本意图分类结果。

[0034]

本发明通过相对位置注意力权重,能够更好地在文本字符位置之间没有约束的情况下学习并整合文本字符之间的位置相对关系,无论字符处于文本的何处位置,本发明都能够将上下文与当前注意力机制中比较关键的字符的联系学习到,进行更为准确的文本意图分类。

[0035]

本发明在医疗垂直领域的标注数据样本上平均都可以获得3%以上的提升,效果显著。

[0036]

在本实施例中,步骤a通过bert预训练模型、skip-gram模型或cbow模型中的一种来实现,具体采用何种方式来实现可以根据实际需要选择。

[0037]

在本实施例中,将输入语料信息中的句子最大长度设置为n,词向量维度设置为k,词向量矩阵为n*k的矩阵;句子最大长度n设置为32或64,词向量维度k设置为128或256。

[0038]

通过设置句子最大长度n和词向量维度k,能够避免句子长度不统一所导致的分批

输入效率低下的问题。

[0039]

在本实施例中,输入语料信息是通过收集对话数据作为原始语料信息,并对原始语料信息进行数据处理后得到的;对原始语料信息进行数据处理得到输入语料信息,能够有效提高后续文本意图分类的效率。

[0040]

具体而言,数据处理包括如下步骤:步骤一:对原始语料信息进行预处理,并构建字表,字表为原始语料信息中包含的所有汉字所组成的列表;基于字表对原始语料信息中的每个字进行数字化,得到数字化原始语料信息;步骤二:对数字化原始语料信息的句子文本进行文本意图分类,得到每个句子文本的所属意图类别,分批读取句子文本以及其对应的所属类别;并将句子文本进行分词得到对应的标注标签;步骤三:将标注标签与句子文本长度、文本掩码进行拼接,形成输入语料信息。

[0041]

在本实施例中,步骤一中的预处理还包括去除特殊字符、停用词和表情符号。

[0042]

本实施例中,以医院不孕不育科室行业语料为例,对输入语料信息中的数字化、向量化进行示例说明,请参照表1中的对输入语料信息的数字化、向量化处理结果。

[0043][0044]

表1

[0045]

在完成对输入语料信息的数字化、向量化等处理后,进行步骤c.根据位置向量矩阵的相对位置关系,计算输入语料信息的相对位置注意力权重;并计算位置向量矩阵的相关性,用于表示自注意力权重;

[0046]

在本实施例中,步骤c,包括如下步骤:

[0047]

c1.根据如下公式,计算q与k的相对位置关系,

[0048]

pos(q),pos(k)=cosine(q

·

q),cosine(k),

[0049]

其中,q表示词向量矩阵,k表示第一权重序列向量;

[0050]

c2.根据相对位置关系计算相对位置注意力权重,相对位置注意力权重的计算公式如下:

[0051][0052]

其中,attention(q,k,v)表示相对位置的注意力权重,d表示向量的维度,v是在k的基础上取余弦值得到的,表示第二权重序列向量,k表示开根号的维度;

[0053]

c3.将q与k进行点乘运算,得到位置向量矩阵的相关性。

[0054]

本发明通过位置编码与词向量矩阵的叠加,相当于进一步提取了位置特征,有效提高了文本意图分类的准确性;并且,将相对位置注意力权重与注意力权重进行合并后构建线性层,一方面学习监督信息,另一方面实际上是对两个注意力的投票或者加权求和,更好地增大了注意力的作用,对语义的学习产生明显的优化效果。

[0055]

本实施例中,步骤d的拼接步骤,实际是将相对位置注意力权重与自注意力权重进行点乘运算。

[0056]

在本实施例中,步骤f是通过全连接层对均值向量矩阵进行特征综合,再通过softmax层进行分类处理,最后输出输入语料信息对应的文本意图分类结果。

[0057]

本发明提出一种文本分类方法,能够更好地在文本字符位置之间没有约束的情况下学习并整合文本字符之间的位置相对关系。因此,文本意图分类系统能够解决无论字符是在整个文本的哪个位置,都能够将上下文与当前注意力机制中比较关键的字符的联系学习到,进行更为准确的意图识别。

[0058]

在本实施例中,还提供一种文本意图分类系统,包括:文本表示模块:将输入语料信息输入至文本表示模块,得到词向量矩阵;

[0059]

位置注意力模块:基于词向量矩阵,通过相对位置编码对词的位置进行编码,得到位置向量矩阵;根据位置向量矩阵的相对位置关系,计算语料信息的相对位置注意力权重;

[0060]

自注意力模块:基于位置向量矩阵,计算位置向量矩阵的相关性,用于表示自注意力权重;

[0061]

线性变换模块:将相对位置注意力权重与注意力权重进行拼接,并构建线性层,线性层用于对拼接得到的结果进行一次线性变换,得到线性映射向量矩阵;

[0062]

文本意图分类模块:对均值向量矩阵进行分类处理,得到文本意图分类结果。

[0063]

本发明中,通过投影注意力模块能够对文本关键语义信息的相对位置进行学习和对齐。在本实施例中,步骤a将输入语料信息输入至文本表示模块时,是将所述输入语料信息以及其对应的所属意图类别一一对应地输入,提升了意图识别的准确性。

[0064]

以及,一种计算机可读存储介质,计算机可读存储介质上存储有文本意图分类程序,文本意图分类程序被处理器执行时实现文本意图分类的步骤。

[0065]

在本文中,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括所述要素的过程、方法、物品或者设备中还存在另外的相同要素。

[0066]

上述说明示出并描述了本发明的优选实施例,应当理解本发明并非局限于本文所披露的形式,不应看作是对其他实施例的排除,而可用于各种其他组合、修改和环境,并能够在本文发明构想范围内,通过上述教导或相关领域的技术或知识进行改动。而本领域人

员所进行的改动和变化不脱离本发明的精神和范围,则都应在本发明所附权利要求的保护范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1