信息处理方法、装置、电子设备、存储介质及程序产品与流程

1.本技术涉及人工智能技术,尤其涉及一种基于人工智能的信息处理方法、装置、电子设备、计算机可读存储介质及计算机程序产品。

背景技术:

2.人工智能(ai,artificial intelligence)是利用数字计算机或者数字计算机控制的机器模拟、延伸和扩展人的智能,感知环境、获取知识并使用知识获得最佳结果的理论、方法和技术及应用系统。

3.互联网时代下的视频产品为用户提供了丰富的内容服务,为了提升用户观看视频的参与感,相关技术中为用户提供了针对视频进行公开评论的功能,例如,评论会在视频下方以列表形式显示,或者评论会在直播频道的视频界面中从上至下顺序显示,或者评论还会在视频中从左至右进行滑动显示,即以弹幕的形式进行显示。

4.但是评论具有多种类别,包括高质量评论以及低质量评论,其中,具有低质量内容的评论既浪费了显示资源又降低了用户的观看体验,相关技术中尚无有效解决办法。

技术实现要素:

5.本技术实施例提供一种基于人工智能的信息处理方法、装置、电子设备、计算机可读存储介质及计算机程序产品,能够提高目标信息的识别准确度。

6.本技术实施例的技术方案是这样实现的:

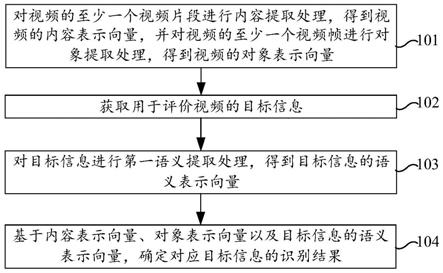

7.本技术实施例提供一种基于人工智能的信息处理方法,包括:

8.对视频的至少一个视频片段进行内容提取处理,得到所述视频的内容表示向量,并对所述视频的至少一个视频帧进行对象提取处理,得到所述视频的对象表示向量;

9.获取用于评价所述视频的目标信息;

10.对所述目标信息进行第一语义提取处理,得到所述目标信息的语义表示向量;

11.基于所述视频的内容表示向量、所述视频的对象表示向量以及所述目标信息的语义表示向量,确定对应所述目标信息的识别结果,其中,对应所述目标信息的识别结果用于表征所述目标信息的类别。

12.本技术实施例提供一种基于人工智能的信息处理装置,包括:

13.视频模块,用于对视频的至少一个视频片段进行内容提取处理,得到所述视频的内容表示向量,并对所述视频的至少一个视频帧进行对象提取处理,得到所述视频的对象表示向量;

14.获取模块,用于获取用于评价所述视频的目标信息;

15.语义模块,用于对所述目标信息进行第一语义提取处理,得到所述目标信息的语义表示向量;

16.过滤模块,用于基于所述视频的内容表示向量、所述视频的对象表示向量以及所述目标信息的语义表示向量,确定对应所述目标信息的识别结果,其中,对应所述目标信息

的识别结果用于表征所述目标信息的类别。

17.在上述方案中,所述内容提取处理是通过调用第一视频模型实现的,所述第一视频模型包括第一卷积神经网络以及第一全连接网络,所述视频模块,还用于:针对每个所述视频片段执行以下处理:通过所述第一卷积神经网络对所述视频片段进行第一特征提取处理,得到所述视频片段的内容卷积特征向量;通过所述第一全连接网络对所述视频片段的内容卷积特征向量进行第一线性变换处理,得到所述视频片段的内容表示向量。

18.在上述方案中,所述第一卷积神经网络包括第一卷积层、第一池化层以及第一全连接层,所述视频模块,还用于:通过所述第一卷积层提取所述视频片段的时间特征向量以及空间特征向量;通过所述第一池化层对所述时间特征向量以及所述空间特征向量进行第一池化处理,得到所述视频片段的池化特征向量;通过所述第一全连接层对所述视频片段的池化特征向量进行第二线性变换处理,得到所述视频片段的内容卷积特征向量。

19.在上述方案中,所述视频模块,还用于:对所述视频的至少一个视频帧进行对象识别处理,得到所述视频包括的至少一个目标对象;当所述目标对象的数目为多个时,对多个所述目标对象进行对象融合处理,得到所述视频的对象表示向量。

20.在上述方案中,所述对象识别处理是通过调用第二视频模型实现的,所述第二视频模型包括第二卷积神经网络、第一分类网络、第三卷积神经网络以及第二分类网络,所述视频模块,还用于:针对每个所述视频帧执行以下处理:通过所述第二卷积神经网络对所述视频帧进行第二特征提取处理,得到所述视频帧的视频帧分类特征;通过所述第一分类网络对所述视频帧的每个像素点进行基于所述视频帧分类特征的分类处理,得到每个所述像素点的分类结果;当所述分类结果表征所述像素点属于对象像素点时,基于多个所述对象像素点,确定所述视频帧的目标区域;针对每个所述目标区域执行以下处理:通过所述第三卷积神经网络对所述目标区域进行第三特征提取处理,得到所述目标区域的区域分类特征;通过所述第二分类网络对所述目标区域的目标图像进行基于所述区域分类特征的分类处理,得到每个所述目标区域的目标对象。

21.在上述方案中,所述对象融合处理是通过调用第三视频模型实现的,所述第三视频模型包括第四卷积神经网络以及第一循环神经网络,所述视频模块,还用于:获取对应每个所述目标对象的目标图像;针对每个所述目标图像执行以下处理:通过所述第四卷积神经网络对所述目标图像进行第四特征提取处理,得到所述目标图像的图像特征向量;通过所述第一循环神经网络对多个所述目标图像的图像特征向量进行图像特征融合处理,得到所述视频的对象表示向量。

22.在上述方案中,第一循环神经网络包括与多个所述目标图像一一对应的多个隐藏层,所述视频模块,还用于:当多个所述目标图像处于不同视频帧时,按照多个所述目标图像所在的视频帧在所述视频中的出现先后顺序,依次针对每个所述目标图像执行以下处理:当所述目标图像排序在首位时,通过对应所述目标图像的隐藏层对所述目标图像进行第三线性变换处理,得到对应所述目标图像的隐层向量;当所述目标图像排序在非首位时,通过对应所述目标图像的隐藏层对所述目标图像以及前一个目标图像的隐层向量进行第三线性变换处理,得到对应所述目标图像的隐层向量;将与所述出现先后顺序中最后一个目标图像对应的隐层向量作为所述视频的对象表示向量。

23.在上述方案中,所述获取模块,还用于:执行以下处理至少之一:获取用于评价所

述视频的图像目标信息;获取用于评价所述视频的文本目标信息;获取用于评价所述视频的表情目标信息。

24.在上述方案中,所述第一语义提取处理是通过第一文本模型实现的,所述第一文本模型包括第二循环神经网络、第二全连接网络以及第五卷积神经网络,所述第五卷积神经网络包括第二卷积层与第二池化层,当所述目标信息为文本目标信息时,所述语义模块,还用于:通过所述第二循环神经网络对所述目标信息进行循环语义特征提取处理,得到对应所述目标信息中每个词语的词向量;通过所述第二全连接网络对每个所述词语的词向量进行词向量融合处理,得到词向量融合处理结果;通过所述第二卷积层对所述词向量融合处理结果进行第五特征提取处理,得到所述词向量融合处理结果的词卷积特征向量;通过所述第二池化层对所述词卷积特征向量进行第二池化处理,得到所述目标信息的语义表示向量。

25.在上述方案中,对所述目标信息进行分类处理是通过分类模型实现的,所述分类模型包括第二全连接层、第三卷积层、第三池化层以及第三全连接层,所述过滤模块,还用于:通过所述第二全连接层对所述视频的内容表示向量、所述视频的对象表示向量以及所述目标信息的语义表示向量进行多模态融合处理,得到多模态融合处理结果;通过所述第三卷积层对所述多模态融合处理结果进行第六特征提取处理,得到所述多模态融合处理结果的多模态卷积特征向量;通过所述第三池化层对所述多模态卷积特征向量进行第三池化处理,得到所述目标信息的分类向量;通过所述第三全连接层对所述目标信息进行基于分类向量的第一类别预测处理,得到所述目标信息属于所述无效类别的第一预测分类概率;当所述第一预测分类概率大于无效概率阈值时,将所述目标信息的识别结果确定为无效类别。

26.在上述方案中,所述过滤模块,还用于在确定对应所述目标信息的识别结果之后,当对应所述目标信息的识别结果表征所述目标信息的类别为无效类别时,对所述目标信息进行过滤处理。

27.在上述方案中,所述内容提取处理是通过调用第一视频模型实现的,所述对象提取处理是通过调用第二视频模型实现的,所述第一语义提取处理是通过第一文本模型实现的,对所述目标信息进行分类处理是通过分类模型实现的,所述第一视频模型、所述第二视频模型、所述第一文本模型以及所述分类模型构成目标信息分类模型,所述装置还包括:训练模块,用于:获取视频样本以及用于评价所述视频样本且具有第一真实类别标注的目标信息样本,其中,所述第一真实类别标注为有效类别标注或者无效类别标注;通过所述第一视频模型对所述视频样本进行内容提取处理,得到所述视频样本的内容表示向量,并通过所述第二视频模型对所述视频样本进行对象提取处理,得到所述视频样本的对象表示向量;通过所述第一文本模型对所述目标信息样本进行第一语义提取处理,得到所述目标信息样本的语义表示向量;通过所述分类模型对所述目标信息样本进行基于所述视频样本的内容表示向量、所述视频样本的对象表示向量以及所述目标信息的语义表示向量的分类处理,得到所述目标信息样本属于所述第一真实类别标注的第二预测分类概率;将所述第二预测分类概率以及所述第一真实类别标注代入对应所述目标信息分类模型的第一损失函数;根据所述第一损失函数更新所述目标信息分类模型的参数。

28.在上述方案中,在通过所述第一文本模型对所述目标信息样本进行第一语义提取

处理,得到所述目标信息样本的语义表示向量之前,所述训练模块,还用于:获取文本分类任务的待分类样本,其中,所述待分类样本具有第二真实类别标注,所述第二真实类别标注对应所述文本分类任务的真实任务类别标注;通过第二文本网络对所述待分类样本进行第二语义提取处理,得到所述待分类样本的语义表示向量;通过第三全连接网络对所述待分类样本进行基于所述待分类样本的语义表示向量的第二类别预测处理,得到所述待分类样本属于真实任务类别标注的第三预测分类概率;将所述第三预测分类概率以及所述第二真实类别标注代入对应所述第二文本网络以及所述第三全连接网络的第二损失函数;根据所述第二损失函数更新所述第二文本网络以及所述第三全连接网络的参数,并将所述第二文本网络作为将对所述目标信息样本进行第一语义提取处理的第一文本模型。

29.本技术实施例提供一种电子设备,包括:

30.存储器,用于存储可执行指令;

31.处理器,用于执行所述存储器中存储的可执行指令时,实现本技术实施例提供的基于人工智能的信息处理方法。

32.本技术实施例提供一种计算机可读存储介质,存储有可执行指令,用于被处理器执行时,实现本技术实施例提供的基于人工智能的信息处理方法。

33.本技术实施例提供一种计算机程序产品,包括计算机程序或指令,所述计算机程序或指令被处理器执行时实现本技术实施例提供的基于人工智能的信息处理方法。

34.本技术实施例具有以下有益效果:

35.对视频的至少一个视频片段进行内容提取处理,得到视频的内容表示向量,并对视频的至少一个视频帧进行对象提取处理,得到视频的对象表示向量,从而实现对视频内容以及具体对象的学习,对用于评价视频的目标信息进行第一语义提取处理,得到目标信息的语义表示向量,从而实现对目标信息的语义理解,结合内容表示向量、对象表示向量以及目标信息的语义表示向量,对目标信息进行识别,可以提升目标信息的类别识别准确度。

附图说明

36.图1是本技术实施例提供的基于人工智能的信息处理系统的结构示意图;

37.图2是本技术实施例提供的电子设备的结构示意图;

38.图3a-3c是本技术实施例提供的基于人工智能的信息处理方法的流程示意图;

39.图4是本技术实施例提供的第一视频模型的架构示意图;

40.图5是本技术实施例提供的第二视频模型的架构示意图;

41.图6是本技术实施例提供的第二视频模型的输出示意图;

42.图7是本技术实施例提供的第三视频模型的架构示意图;

43.图8是本技术实施例提供的第一文本模型的架构示意图;

44.图9是本技术实施例提供的第二文本网络以及第三全连接网络的架构示意图;

45.图10是本技术实施例提供的分类模型的架构示意图;

46.图11是本技术实施例提供的目标信息分类模型的架构示意图。

具体实施方式

47.为了使本技术的目的、技术方案和优点更加清楚,下面将结合附图对本技术作进

一步地详细描述,所描述的实施例不应视为对本技术的限制,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其它实施例,都属于本技术保护的范围。

48.在以下的描述中,涉及到“一些实施例”,其描述了所有可能实施例的子集,但是可以理解,“一些实施例”可以是所有可能实施例的相同子集或不同子集,并且可以在不冲突的情况下相互结合。

49.在以下的描述中,所涉及的术语“第一\第二\第三”仅仅是是区别类似的对象,不代表针对对象的特定排序,可以理解地,“第一\第二\第三”在允许的情况下可以互换特定的顺序或先后次序,以使这里描述的本技术实施例能够以除了在这里图示或描述的以外的顺序实施。

50.除非另有定义,本文所使用的所有的技术和科学术语与属于本技术的技术领域的技术人员通常理解的含义相同。本文中所使用的术语只是为了描述本技术实施例的目的,不是旨在限制本技术。

51.对本技术实施例进行进一步详细说明之前,对本技术实施例中涉及的名词和术语进行说明,本技术实施例中涉及的名词和术语适用于如下的解释。

52.1)无效类别的弹幕,无效类别的弹幕指低质量弹幕,例如,弹幕中包括不合适的内容,即与视频的内容相关度较低的内容,或者弹幕中包括不雅的内容,或者弹幕中包括枯燥无味的内容,或者弹幕中包括冒犯用户的内容等等。

53.2)预训练,在神经网络模型正式训练之前,对神经网络模型的参数进行预先训练,从而提高正式训练的效果,预训练部分做的任务称为预训练任务。

54.3)迁移学习是一种机器学习的方法,指的是一个预训练的模型被重新用在下游任务中,深度学习中在计算机视觉任务和自然语言处理任务中将预训练的模型作为新模型的起点,通常这些预训练的模型在开发神经网络的时候已经消耗了巨大的时间资源和计算资源,迁移学习可以将已习得的强大技能迁移到相关的问题上。

55.4)模态:文本和图像各自称为某种模态,例如,文本模态、图像模态等等,若任务的输入同时包含文本和图像两种信息,则任务的输入是多模态的。

56.5)目标信息:用于评价视频的信息,例如用户发布的评论信息,例如,评论会在视频下方以列表形式显示,或者评论会在直视频界面中从上至下顺序显示,或者评论还会在视频中从左至右进行滑动显示,即以弹幕的形式进行显示。

57.6)对象表示向量:对象表示向量用于表征视频的局部对象信息,局部对象信息包括视频中物体图像的信息。

58.7)内容表示向量:当视频片段的总时长占据视频时长的比例超过比例阈值时,通过内容表示向量表征视频的全局内容信息,当视频片段的总时长占据视频时长的比例不超过比例阈值时,通过内容表示向量表征视频的局部内容信息,局部内容信息包括视频的情节发展信息。

59.8)语义表示向量:语义表示向量用于表征目标信息的语义信息,例如,目标信息的情感信息、目标信息的关键词信息等等。

60.互联网时代下的视频产品为用户提供了丰富的内容服务,为了提升用户观看视频的参与感,相关技术中为用户提供了针对视频进行公开评论(目标信息)的功能,例如,评论会在视频下方以列表形式显示,或者评论会在直播频道界面中从上至下顺序显示,或者评

论还会在视频中从左至右进行滑动显示,即以弹幕的形式进行显示,以弹幕为例,为了提升用户的观看体验,相关技术中会采取相应方案a-b对弹幕进行过滤,即过滤无效弹幕,例如,内容乏味的弹幕、内容不雅的弹幕等等,并保留内容合适的弹幕、用户喜欢的弹幕、有信息量的弹幕。

61.在方案a中,可以基于语义相似度匹配和非法词表进行弹幕过滤,通过数据挖掘或者专家标注的方式,制作敏感词表,然后把待处理的弹幕文本中的每个词跟词表做语义相似度计算,如果文本中某个词与敏感词表中词的语义相似度高于相似度阈值,那么这个词会作为敏感词,对应的文本会被过滤掉。

62.基于语义相似度匹配和非法词表进行弹幕过滤时,需要人工构建非法词表,并不断实时补充非法词表,否则不能适应互联网上非法词不断发展进化的趋势,浪费人力和时间,基于语义相似度的匹配不可能做到完全准确,容易造成误伤,很多相似度高的两个词语表征的意思不同,从而会将本应该保留的弹幕过滤掉。

63.在方案b中,基于文本分类任务对弹幕进行过滤,使用文本分类模型以弹幕文本作为输入以文本类别作为输出,在有监督的数据上进行训练,训好的文本分类模型可以对文本形式的弹幕进行分类。

64.基于文本分类任务对弹幕进行过滤时,由于相同的文本针对不同的评价对象具有不同的评价效果,例如,a文本用于评价视频1时属于有效弹幕,a文本用于评价视频2时属于无效弹幕,因此仅基于文本分类任务对弹幕进行过滤会降低弹幕过滤的准确度。

65.本技术实施例提供基于人工智能的信息处理方法、装置、电子设备、计算机可读存储介质及计算机程序产品,能够利用视频中视觉信号以及目标信息本身,对目标信息的质量进行判断,最终确定出每条目标信息是否为无效类别,是否应该被过滤掉,提高过滤无效类别的目标信息的准确度,并且本技术实施例对用户没有区别性的针对,对于普通用户、合法用户偶尔发布的不合适的目标信息也可以过滤,不再需要人工标注匹配或者挖掘出的非法词表。

66.本技术实施例提供的信息处理方法可以由各种电子设备实施,例如可以由终端设备或服务器单独实施,也可以由终端和服务器协同实施。

67.下面说明电子设备实施为信息处理系统中的服务器时示例性应用,参见图1,图1是本技术实施例提供的基于人工智能的信息处理系统的结构示意图,终端400-1和终端400-2通过网络300连接服务器200,网络300可以是广域网或者局域网,又或者是二者的组合。

68.在一些实施例中,基于人工智能的信息处理系统的功能是基于服务器200实现的,用户a可以为游戏直播的观看者,在用户a使用终端400-1的过程中,终端400-1接收用户a针对直播视频的弹幕评论作为目标信息,终端400-1将目标信息发送至服务器200,服务器200对直播视频进行内容提取处理,得到直播视频的内容表示向量,并对直播视频的至少一个视频帧进行对象提取处理,得到直播视频的对象表示向量,服务器200对目标信息进行第一语义提取处理,得到目标信息的语义表示向量,服务器200基于内容表示向量、对象表示向量以及目标信息的语义表示向量,确定对应目标信息的识别结果,当目标信息的识别结果表征目标信息属于无效类别的弹幕评论时,对目标信息进行过滤,当目标信息不属于无效类别的弹幕评论时,对将目标信息返回至用户a的终端400-1以及其他用户b的终端400-2,

并在直播视频中以弹幕评论的方式进行显示。

69.在另一些实施例中,当本技术实施例提供的信息处理方法由终端单独实施时,在上文所描述的各种应用场景中,服务器200可以不执行针对目标信息的分类以及过滤处理,将所有的目标信息均反馈至各个终端,各个终端分别针对目标信息进行分类以及过滤处理,当目标信息属于无效类别的弹幕评论时,对目标信息进行过滤并不予显示,当目标信息不属于无效类别的弹幕评论时,在直播视频中以弹幕评论的方式进行显示。

70.在一些实施例中,服务器200可以是独立的物理服务器,也可以是多个物理服务器构成的服务器集群或者分布式系统,还可以是提供云服务、云数据库、云计算、云函数、云存储、网络服务、云通信、中间件服务、域名服务、安全服务、cdn、以及大数据和人工智能平台等基础云计算服务的云服务器。终端400可以包括但不限于手机、电脑、智能语音交互设备、智能家电、车载终端等。终端以及服务器可以通过有线或无线通信方式进行直接或间接地连接,本技术实施例中不做限制。

71.接下来,说明本技术实施例提供的用于实施基于人工智能的信息处理方法的电子设备的结构,如前,本技术实施例提供的电子设备可以是图3中的服务器200。参见图2,图2是本技术实施例提供的电子设备的结构示意图,图2所示的服务器200包括:至少一个处理器210、存储器250、至少一个网络接口220。服务器200中的各个组件通过总线系统240耦合在一起。可理解,总线系统240用于实现这些组件之间的连接通信。总线系统240除包括数据总线之外,还包括电源总线、控制总线和状态信号总线。但是为了清楚说明起见,在图2中将各种总线都标为总线系统240。

72.处理器210可以是一种集成电路芯片,具有信号的处理能力,例如通用处理器、数字信号处理器(dsp,digital signal processor),或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件等,其中,通用处理器可以是微处理器或者任何常规的处理器等。

73.存储器250可以是可移除的,不可移除的或其组合。示例性的硬件设备包括固态存储器,硬盘驱动器,光盘驱动器等。存储器250可选地包括在物理位置上远离处理器210的一个或多个存储设备。

74.存储器250包括易失性存储器或非易失性存储器,也可包括易失性和非易失性存储器两者。非易失性存储器可以是只读存储器(rom,read only me mory),易失性存储器可以是随机存取存储器(ram,random access memor y)。本技术实施例描述的存储器250旨在包括任意适合类别的存储器。

75.在一些实施例中,存储器250能够存储数据以支持各种操作,这些数据的示例包括程序、模块和数据结构或者其子集或超集,下面示例性说明。

76.操作系统251,包括用于处理各种基本系统服务和执行硬件相关任务的系统程序,例如框架层、核心库层、驱动层等,用于实现各种基础业务以及处理基于硬件的任务;网络通信模块252,用于经由一个或多个(有线或无线)网络接口220到达其他电子设备,示例性的网络接口220包括:蓝牙、无线相容性认证(wifi)、和通用串行总线(usb,universal serial bus)等。

77.在一些实施例中,本技术实施例提供的基于人工智能的信息处理装置可以采用软件方式实现,图2示出了存储在存储器250中的基于人工智能的信息处理装置255,其可以是

程序和插件等形式的软件,包括以下软件模块:视频模块2551、获取模块2552、文本模块2553、过滤模块2554以及训练模块2555,这些模块是逻辑上的,因此根据所实现的功能可以进行任意的组合或进一步拆分,将在下文中说明各个模块的功能。

78.在一些实施例中,终端或服务器可以通过运行计算机程序来实现本技术实施例提供的基于人工智能的信息处理方法。举例来说,计算机程序可以是操作系统中的原生程序或软件模块;可以是本地(native)应用程序(app,applic ation),即需要在操作系统中安装才能运行的程序,如游戏app;也可以是小程序,即只需要下载到浏览器环境中就可以运行的程序;还可以是能够嵌入至任意app中的小程序。总而言之,上述计算机程序可以是任意形式的应用程序、模块或插件。

79.下面结合附图说明本技术实施例提供的基于人工智能的信息处理方法中所涉及到的模型结构。

80.参见图4,图4是本技术实施例提供的第一视频模型的架构示意图,通过调用第一视频模型对视频的多个视频片段进行内容提取处理,第一视频模型包括第一卷积神经网络以及第一全连接网络,第一卷积神经网络包括第一卷积层、第一池化层以及第一全连接层,第一卷积神经网络是三维卷积神经网络,第一卷积神经网络用用于提取时间维度以及空间维度的信息,第一全连接网络用于进行维度转换。

81.参见图5,图5是本技术实施例提供的第二视频模型的架构示意图,通过调用第二视频模型可以针对视频的视频帧进行对象识别处理,第二视频模型包括第二卷积神经网络、第一分类网络、第三卷积神经网络以及第二分类网络,第二视频模型的处理对象是对视频采样得到的视频帧,通过第二视频模型可以识别出视频帧中包括某个目标对象的目标区域以及每个目标区域内的目标对象,参见图6,图6中示出了每个物体(目标对象)的边界框,边界框上还显示出目标区域内的目标对象具体是什么,例如,目标区域内的目标对象是卡车。

82.参见图7,图7是本技术实施例提供的第三视频模型的架构示意图,对象融合处理是通过调用第三视频模型实现的,第三视频模型包括第四卷积神经网络以及第一循环神经网络,获取对应每个目标对象的目标图像,针对每个目标图像执行以下处理:通过第四卷积神经网络对目标图像进行第四特征提取处理,得到目标图像的图像特征向量,通过第一循环神经网络对多个目标图像的图像特征向量进行图像特征融合处理,得到视频的对象表示向量。

83.参见图8,图8是本技术实施例提供的第一文本模型的架构示意图,第一语义提取处理是通过第一文本模型实现的,第一文本模型包括第二循环神经网络、第二全连接网络以及第五卷积神经网络,第五卷积神经网络包括第二卷积层与第二池化层,当目标信息为文本目标信息时,第一文本模型输出目标信息的语义表示向量。参见图9,图9是本技术实施例提供的第二文本网络以及第三全连接网络的架构示意图,第二文本网络与第一文本模型具有相同的结构,并且在第二文本网络的基础上添加了第三全连接网络,从而通过第二文本网络以及第三全连接网络进行通用文本分类任务的预训练,将预训练得到的第二文本网络作为参与整体训练的第一文本模型的初始化模型。

84.参见图10,图10是本技术实施例提供的分类模型的架构示意图,对目标信息进行分类处理是通过分类模型实现的,分类模型包括第二全连接层、第三卷积层、第三池化层以

及第三全连接层,第三全连接层输出目标信息属于无效类别的第一预测概率,当第一预测概率大于无效概率阈值时,确定目标信息属于无效类别。

85.参见图11,图11是本技术实施例提供的目标信息分类模型的架构示意图,内容提取处理是通过调用第一视频模型实现的,对象提取处理是通过调用第二视频模型实现的,第一语义提取处理是通过第一文本模型实现的,对目标信息进行分类处理是通过分类模型实现的,第一视频模型、第二视频模型、第一文本模型以及分类模型构成目标信息分类模型。

86.至此对本技术实施例中所使用到的模型结构以及模型训练过程介绍完毕,下面结合上述模型介绍本技术实施例提供的基于人工智能的信息处理方法。在以下的描述中,所涉及到“至少一个”,其描述表征一个或者多个,所涉及到“多个”表征至少两个。

87.参见图3a,图3a是本技术实施例提供的基于人工智能的信息处理方法的流程示意图,将结合图3a示出的步骤101至步骤104进行说明,并且除了上述执行顺序之外,步骤101还可以在步骤102之后或者在步骤103之后执行,步骤101在步骤104之前执行即可。

88.在步骤101中,对视频的至少一个视频片段进行内容提取处理,得到视频的内容表示向量,并对视频的至少一个视频帧进行对象提取处理,得到视频的对象表示向量。

89.作为示例,视频可以为游戏直播视频、游戏录播视频,视频还可以为各种文艺作品的视频,视频还可以为用户发布的短视频等等。

90.在本技术实施例提供的信息处理方法中所涉及的数据可以保存于区块链上。

91.在一些实施例中,内容提取处理是通过调用第一视频模型实现的,第一视频模型包括第一卷积神经网络以及第一全连接网络,步骤101中对视频的至少一个视频片段进行内容提取处理,得到视频的内容表示向量,可以通过以下技术方案实现:针对每个视频片段执行以下处理:通过第一卷积神经网络对视频片段进行第一特征提取处理,得到视频片段的内容卷积特征向量;通过第一全连接网络对视频片段的内容卷积特征向量进行第一线性变换处理,得到视频片段的内容表示向量。

92.在一些实施例中,第一卷积神经网络包括第一卷积层、第一池化层以及第一全连接层,上述通过第一卷积神经网络对视频片段进行第一特征提取处理,得到视频片段的内容卷积特征向量,可以通过以下技术方案实现:通过第一卷积层提取视频片段的时间特征向量以及空间特征向量;通过第一池化层对时间特征向量以及空间特征向量进行第一池化处理,得到视频片段的池化特征向量;通过第一全连接层对视频片段的池化特征向量进行第二线性变换处理,得到视频片段的内容卷积特征向量,通过第一视频模型可以有效获取视频的内容表示向量,以学习到视频的全局内容信息,从而有效提高过滤准确度。

93.作为示例,参见图4,视频片段是对视频进行分割得到的,视频可以包含很多个视频片段,例如20秒的视频中每5秒算作是一个视频片段,对分割好的4个视频片段进行内容分析,将每个视频片段转化为一个内容表示向量,作为视频内容的表示,通过调用第一视频模型对视频的多个视频片段进行内容提取处理,第一视频模型包括第一卷积神经网络以及第一全连接网络,第一卷积神经网络包括第一卷积层、第一池化层以及第一全连接层,第一卷积神经网络是三维卷积神经网络,采用三维卷积神经网络对视频片段进行建模,第一卷积层是三维卷积层,通过三维卷积层对视频信号进行处理,一维对应着视频的时间信息、另外两维对应视频的空间信息,即视频帧的横坐标以及纵坐标的二维空间,通过第一卷积层

提取视频片段的时间特征向量以及空间特征向量,通过第一池化层对时间特征向量以及空间特征向量进行第一池化处理,得到视频片段的池化特征向量,通过第一全连接层对视频片段的池化特征向量进行第二线性变换处理,得到视频片段的内容卷积特征向量,通过第一全连接网络对视频片段的内容卷积特征向量进行第一线性变换处理,得到视频片段的内容表示向量,第一全连接网络包括两个全连接层,这两个全连接层的作用均是对内容卷积特征向量进行线性变换,即改变内容卷积特征向量的维度,输入第一全连接网络的内容卷积特征向量的维度为x,输出第一全连接网络的内容卷积特征向量的维度为y。

94.在一些实施例中,步骤101中对视频的至少一个视频帧进行对象提取处理,得到视频的对象表示向量,可以通过以下技术方案实现:对视频的至少一个视频帧进行对象识别处理,得到视频包括的至少一个目标对象;当目标对象的数目为多个时,对多个目标对象进行对象融合处理,得到视频的对象表示向量。

95.在一些实施例中,对象识别处理是通过调用第二视频模型实现的,第二视频模型包括第二卷积神经网络、第一分类网络、第三卷积神经网络以及第二分类网络,上述对视频的至少一个视频帧进行对象识别处理,得到视频包括的至少一个目标对象,可以通过以下技术方案实现:针对每个视频帧执行以下处理:通过第二卷积神经网络对视频帧进行第二特征提取处理,得到视频帧的视频帧分类特征;通过第一分类网络对视频帧的每个像素点进行基于视频帧分类特征的分类处理,得到每个像素点的分类结果;当分类结果表征像素点属于对象像素点时,基于多个对象像素点,确定视频帧的目标区域;针对每个目标区域执行以下处理:通过第三卷积神经网络对目标区域进行第三特征提取处理,得到目标区域的区域分类特征;通过第二分类网络对目标区域的目标图像进行基于区域分类特征的分类处理,得到每个目标区域的目标对象,通过第二视频模型可以有效识别出视频中的目标对象,以学习视频的局部信息,从而有效提高过滤准确度。

96.作为示例,参见图5,第二视频模型是与第一视频模型并列的模型。通过第二视频模型会将视频中出现过的物体(目标对象)逐一识别出来,通过第二视频模型理解视频内容,基于视频内容更容易看出来目标信息是否与视频无关,目标信息是否为低质量内容,第二视频模型的输入是视频帧,整段视频可以每隔几秒采样出一张视频帧,把这个视频帧作为第二视频模型的输入,整个视频中所有的视频帧可以依次作为第二视频模型的输入,或者将整个视频中的部分视频帧作为第二视频模型的输入,或者将某个视频帧作为第二视频模型的输入,第二视频模型会依次生成目标对象识别结果,第二视频模型的输出为视频帧中包括某个物体的目标区域以及每个目标区域内的目标对象,通过生成物体边界的方式框定包括物体的图像,参见图6,图6中示出了每个物体的边界框,边界框上还显示出目标区域内的目标对象,例如,卡车。

97.作为示例,第二视频模型包括第二卷积神经网络、第一分类网络、第三卷积神经网络以及第二分类网络,针对每个视频帧执行以下处理:通过第二卷积神经网络对视频帧进行第二特征提取处理,得到视频帧的视频帧分类特征,第二卷积神经网络对视频帧进行特征提取,提取的特征是向量形式的,例如:(0.1,0.3,0.4,0.31,0.55)是一个五维的向量,第二卷积神经网络会提取n维向量,n通常大于100,通过第一分类网络对视频帧的每个像素点进行基于视频帧分类特征的分类处理,得到每个像素点的分类结果,第一分类网络可以为支持向量机,支持向量机可以基于输入的视频帧分类特征对每个像素点执行一次分类任

务,分类结果表征像素点属于某个对象还是属于背景,当分类结果表征像素点属于对象像素点时,基于多个对象像素点,确定视频帧的目标区域,输出多个有对象像素点组成的目标区域,目标区域为长方形,具体描述为:目标区域左顶点坐标、目标区域的长以及目标区域的宽,针对每个目标区域执行以下处理:通过第三卷积神经网络对目标区域进行第三特征提取处理,得到目标区域的区域分类特征,再使用卷积神经网络对所有得到的目标区域进行特征抽取,再次提取特征可以提高特征提取的抽象程度,神经网络模型越深、抽象程度越高,学习效果越好,通过第二分类网络对目标区域的目标图像进行基于区域分类特征的分类处理,得到每个目标区域的目标对象,第二分类网络可以为不同于第一分类网络的支持向量机,将对应每个目标区域获取的区域分类特征再次送入新支持向量机中,使其对目标区域中的图像进行分类识别,确定出目标区域中的目标对象,相当于对检测出的目标区域的目标图像进行目标识别,识别过程不仅可以识别出目标对象具体是什么,还可以二次确认目标区域内是否的确具有目标对象,只有确定是目标对象,才会在后续针对对应目标对象的目标图像进行处理,由此,视频帧内的所有目标对象均被提取出来。

98.在一些实施例中,对象融合处理是通过调用第三视频模型实现的,第三视频模型包括第四卷积神经网络以及第一循环神经网络,上述对多个目标对象进行对象融合处理,得到视频的对象表示向量,可以通过以下技术方案实现:获取对应每个目标对象的目标图像;针对每个目标图像执行以下处理:通过第四卷积神经网络对目标图像进行第四特征提取处理,得到目标图像的图像特征向量;通过第一循环神经网络对多个目标图像的图像特征向量进行图像特征融合处理,得到视频的对象表示向量。

99.在一些实施例中,当目标对象的数目为一个时,基于目标对象,确定视频的对象表示向量,获取对应目标对象的目标图像,针对目标图像执行以下处理:通过第四卷积神经网络对目标图像进行第四特征提取处理,得到目标图像的图像特征向量,将目标图像的图像特征向量确定为视频的对象表示向量。

100.在一些实施例中,第一循环神经网络包括与多个目标图像一一对应的多个隐藏层,上述通过第一循环神经网络对多个目标图像的图像特征向量进行图像特征融合处理,得到视频的对象表示向量,可以通过以下技术方案实现:当多个目标图像处于不同视频帧时,按照多个目标图像在视频中的出现先后顺序,依次针对每个目标图像执行以下处理:当目标图像排序在首位时,通过对应目标图像的隐藏层对目标图像进行第三线性变换处理,得到对应目标图像的隐层向量;当目标图像排序在非首位时,通过对应目标图像的隐藏层对目标图像以及前一个目标图像的隐层向量进行第三线性变换处理,得到对应目标图像的隐层向量;将与出现先后顺序中最后一个目标图像对应的隐层向量作为视频的对象表示向量,通过第一循环神经网络可以有效获取所有目标对象的表示信息,从而学习视频的局部信息,从而有效提高过滤准确度。

101.作为示例,参见图7,通过第二视频模型对视频中所有的视频帧或者部分视频帧识别出目标对象,按照视频中视频帧出现的先后顺序对目标对象进行排列,把识别出的所有目标对象都排列出来,然后利用第三视频模型去融合,当存在部分目标对象处于相同视频帧时,处于相同视频帧的多个目标对象之间可以按照随机顺序排列,第三视频模型包括第四卷积神经网络以及第一循环神经网络,用第四卷积神经网络把物体图像表示成图像特征向量,然后利用第一循环神经网络把所有的物体图像对应的图像特征向量都融合起来,合

并成一个向量,即视频的对象表示向量,第一循环神经网络的最后一个隐层向量就是最终输出的对象表示向量,由于第一循环神经网络的特性,最后一个隐层向量包括所有的物体图像的信息。

102.在一些实施例中,当多个目标图像均处于相同视频帧时,按照多个目标图像的随机顺序,依次针对每个目标图像执行以下处理:当目标图像排序在首位时,通过对应目标图像的隐藏层对目标图像进行第三线性变换处理,得到对应目标图像的隐层向量;当目标图像排序在非首位时,通过对应目标图像的隐藏层对目标图像以及前一个目标图像的隐层向量进行第三线性变换处理,得到对应目标图像的隐层向量;将与出现先后顺序中最后一个目标图像对应的隐层向量作为视频的对象表示向量,通过第一循环神经网络可以有效获取所有目标对象的表示信息,从而学习视频的局部信息,从而有效提高过滤准确度。

103.在步骤102中,获取用于评价视频的目标信息。

104.在一些实施例中,步骤102中获取用于评价视频的目标信息,可以通过以下技术方案实现:执行以下处理至少之一:获取用于评价视频的图像目标信息;获取用于评价视频的文本目标信息;获取用于评价视频的表情目标信息。

105.作为示例,目标信息是视频的评价信息,例如,评论信息会在视频下方以列表形式显示,或者评论信息会在直播频道界面中从上至下顺序显示,或者评论信息还会在视频中从左至右进行滑动显示,即以弹幕的形式进行显示,目标信息的模态可以是多种多样的,例如,可以利用文本评价视频,还可以利用图像评价视频,还可以利用表情评价视频。

106.在步骤103中,对目标信息进行第一语义提取处理,得到目标信息的语义表示向量。

107.参见图3b,图3b是本技术实施例提供的基于人工智能的信息处理方法的流程示意图,当目标信息为文本目标信息时,步骤103中对目标信息进行第一语义提取处理,得到目标信息的语义表示向量可以通过图3b示出的步骤1031至步骤1034实现。

108.在步骤1031中,通过第二循环神经网络对目标信息进行循环语义特征提取处理,得到对应目标信息中每个词语的词向量。

109.在步骤1032中,通过第二全连接网络对每个词语的词向量进行词向量融合处理,得到词向量融合处理结果。

110.在步骤1033中,通过第二卷积层对词向量融合处理结果进行第五特征提取处理,得到词向量融合处理结果的词卷积特征向量。

111.在步骤1034中,通过第二池化层对词卷积特征向量进行第二池化处理,得到目标信息的语义表示向量。

112.作为示例,第一语义提取处理是通过第一文本模型实现的,第一文本模型包括第二循环神经网络、第二全连接网络以及第五卷积神经网络,第五卷积神经网络包括第二卷积层与第二池化层,通过第一文本模型可以有效提取文本目标信息的语义信息,从而提高过滤准确度。

113.作为示例,参见图8,首先目标信息的文本会输入给第二循环神经网络,第二循环神经网络可以为长短期记忆人工神经网络或者门控循环单元,第二循环神经网络的具体结构可以根据不同的使用场景确定,通过第二循环神经网络对目标信息中每个词语生成一个词向量,词向量是词级别的向量,然后第二循环神经网络输出的每个词向量都会输入至第

二全连接网络(包括两个全连接层),第二全连接网络对每个词语的词向量进行词向量融合处理,得到词向量融合处理结果,再通过第五卷积网络的第二卷积层对词向量融合处理结果进行特征提取处理,得到词卷积特征向量,通过第五卷积网络的第二池化层对词卷积特征向量进行池化处理,得到语料样本的语义表示向量。

114.在步骤104中,基于视频的内容表示向量、视频的对象表示向量以及目标信息的语义表示向量,确定对应目标信息的识别结果。

115.作为示例,对应目标信息的识别结果用于表征目标信息的类别。

116.参见图3c,图3c是本技术实施例提供的基于人工智能的信息处理方法的流程示意图,步骤104中基于视频的内容表示向量、视频的对象表示向量以及目标信息的语义表示向量,确定对应目标信息的识别结果,可以通过图3c示出的步骤1041至步骤1045实现。

117.在步骤1041中,通过第二全连接层对视频的内容表示向量、视频的对象表示向量以及目标信息的语义表示向量进行多模态融合处理,得到多模态融合处理结果。

118.在步骤1042中,通过第三卷积层对多模态融合处理结果进行第六特征提取处理,得到多模态融合处理结果的多模态卷积特征向量。

119.在步骤1043中,通过第三池化层对多模态卷积特征向量进行第三池化处理,得到目标信息的分类向量。

120.在步骤1044中,通过第三全连接层对目标信息进行基于分类向量的第一类别预测处理,得到目标信息属于无效类别的第一预测分类概率。

121.在步骤1045中,当第一预测分类概率大于无效概率阈值时,将目标信息的识别结果确定为无效类别。

122.在一些实施例中,在确定对应目标信息的识别结果之后,当对应目标信息的识别结果表征目标信息的类别为无效类别时,对目标信息进行过滤处理。

123.作为示例,对目标信息进行分类处理是通过分类模型实现的,分类模型包括第二全连接层、第三卷积层、第三池化层以及第三全连接层,分类模型的结构参见图10,分类模型包括第二全连接层、第三卷积层、第三池化层以及第三全连接层,通过分类模型对目标信息进行基于内容表示向量、对象表示向量以及目标信息的语义表示向量的分类处理,得到目标信息的第一预测分类概率,第一预测概率值高于无效概率阈值的目标信息会被认为是无效类别,即该目标信息属于低质量文本,从而会被过滤掉。

124.在一些实施例中,获取视频样本以及用于评价视频样本且具有第一真实类别标注的目标信息样本,其中,第一真实类别标注为有效类别标注或者无效类别标注;通过第一视频模型对视频样本进行内容提取处理,得到视频样本的内容表示向量,并通过第二视频模型对视频样本进行对象提取处理,得到视频样本的对象表示向量;通过第一文本模型对目标信息样本进行第一语义提取处理,得到目标信息样本的语义表示向量;通过分类模型对目标信息样本进行基于视频样本的内容表示向量、视频样本的对象表示向量以及目标信息的语义表示向量的分类处理,得到目标信息样本属于第一真实类别标注的第二预测分类概率;将第二预测分类概率以及第一真实类别标注代入对应目标信息分类模型的第一损失函数;根据第一损失函数更新目标信息分类模型的参数,通过多个模型的联合整体训练,可以有效提高训练效率,提升目标信息分类模型的准确度。

125.作为示例,内容提取处理是通过调用第一视频模型实现的,对象提取处理是通过

调用第二视频模型实现的,第一语义提取处理是通过第一文本模型实现的,对目标信息进行分类处理是通过分类模型实现的,第一视频模型、第二视频模型、第一文本模型以及分类模型构成目标信息分类模型。

126.作为示例,参见图11,目标信息分类模型包括第一视频模型、第二视频模型、第一文本模型以及分类模型,分类模型的结构参见图10,分类模型包括第二全连接层、第三卷积层、第三池化层以及第三全连接层,通过第一视频模型对视频样本进行内容提取处理,得到视频样本的内容表示向量,并通过第二视频模型对视频样本进行对象提取处理,得到视频样本的对象表示向量,通过第一文本模型对目标信息样本进行第一语义提取处理,得到目标信息样本的语义表示向量,通过分类模型对目标信息样本进行基于视频样本的内容表示向量、视频样本的对象表示向量以及目标信息的语义表示向量的分类处理,得到目标信息样本属于第一真实类别标注的第二预测分类概率,将第二预测分类概率以及第一真实类别标注代入对应目标信息分类模型的第一损失函数,根据第一损失函数更新目标信息分类模型的参数,目标信息样本是经过人工标注的,目标信息样本包括低质量文本数据以及高质量文本数据,将第二文本网络作为第一文本模型的初始模型,目标信息分类模型会预测结果表征目标信息样本是否为低质量文本,然后跟目标信息样本的标注进行对比,根据预测值和真实标注的差距更新目标信息分类模型。

127.在一些实施例中,在通过第一文本模型对目标信息样本进行第一语义提取处理,得到目标信息样本的语义表示向量之前,获取文本分类任务的待分类样本,其中,待分类样本具有第二真实类别标注,第二真实类别标注对应文本分类任务的真实任务类别标注;通过第二文本网络对待分类样本进行第二语义提取处理,得到待分类样本的语义表示向量;通过第三全连接网络对待分类样本进行基于待分类样本的语义表示向量的第二类别预测处理,得到待分类样本属于真实任务类别标注的第三预测分类概率;将第三预测分类概率以及第二真实类别标注代入对应第二文本网络以及第三全连接网络的第二损失函数;根据第二损失函数更新第二文本网络以及第三全连接网络的参数,并将第二文本网络作为将对目标信息样本进行第一语义提取处理的第一文本模型。在进行正式训练之前进行基于通用分类任务的预训练,将预训练得到的第二文本网络作为参与整体训练的第一文本模型的初始化模型,可以有效提高整体训练的训练效率。

128.作为示例,文本预训练部分是通过第二文本网络以及第三全连接网络实现的,在进行文本预训练时需要利用通用语料执行文本分类任务,具体的模型结构参见图9,首先目标信息的文本会输入给循环神经网络,循环神经网络可以为长短期记忆人工神经网络或者门控循环单元,循环神经网络的具体结构可以根据不同的使用场景确定,通过循环神经网络对每个词语生成一个词向量,词向量是词级别的向量,然后循环神经网络输出的每个词向量都会输入至全连接网络(包括两个全连接层),全连接网络对每个词语的词向量进行词向量融合处理,得到词向量融合处理结果,再通过卷积层对词向量融合处理结果进行特征提取处理,得到词卷积特征向量,通过池化层对词卷积特征向量进行池化处理,得到语料样本的语义表示向量,最终通过全连接层(第三全连接网络)对语料样本的语义表示向量进行基于文本分类任务的分类处理,输出该语料样本属于真实任务类别标注的预测分类概率。使用通用的文本分类数据作为语料样本进行训练,例如进行情感分类的语料样本、进行主题分类的语料样本,文本分类任务与弹幕过滤技术在功能上没有关系,但是弹幕过滤的核

心也是基于文本分类实现的,由于经过训练得到的第二文本网络以及第三全连接网络可以较好地完成这些文本分类任务,因此第二文本网络也会对弹幕的文本分类有帮助,这些文本分类任务都具有监督数据,监督数据来自于学术界公开的数据集,将经过训练的第二文本网络的参数拷贝给第一文本模型,即保留第二本文模型所有结构以及参数,作为后续进行语义处理的第一文本模型的初始化模型。

129.下面,将说明本技术实施例在一个实际的应用场景中的示例性应用。

130.在一些实施例中,基于人工智能的信息处理系统的功能是基于服务器实现的,用户a可以为游戏直播的观看者,在用户a使用终端的过程中,终端接收用户a针对直播视频的弹幕评论作为目标信息,终端将目标信息发送至服务器,服务器对直播视频进行内容提取处理,得到直播视频的内容表示向量,并对直播视频的多个视频帧进行对象提取处理,得到直播视频的对象表示向量,服务器对目标信息进行第一语义提取处理,得到目标信息的语义表示向量,服务器基于内容表示向量、对象表示向量以及目标信息的语义表示向量,对目标信息进行分类处理,当目标信息属于无效类别的弹幕评论时,对目标信息进行过滤,当目标信息不属于无效类别的弹幕评论时,对将目标信息返回至用户a的终端以及其他用户b的终端,并在直播视频中以弹幕评论的方式进行显示。

131.在一些实施例中,文本预训练部分是通过级联的第二文本网络与第三全连接网络实现的,在进行文本预训练时需要利用通用语料执行文本分类任务,具体的模型结构参见图9,首先目标信息的文本会输入给循环神经网络,循环神经网络可以为长短期记忆人工神经网络或者门控循环单元,循环神经网络的具体结构可以根据不同的使用场景确定,通过循环神经网络对每个词语生成一个词向量,词向量是词级别的向量,然后循环神经网络输出的每个词向量都会输入至全连接网络(包括两个全连接层),全连接网络对每个词语的词向量进行词向量融合处理,得到词向量融合处理结果,再通过卷积层对词向量融合处理结果进行特征提取处理,得到词卷积特征向量,通过池化层对词卷积特征向量进行池化处理,得到语料样本的语义表示向量,最终通过全连接层对语料样本的语义表示向量进行基于文本分类任务的分类处理,输出该语料样本属于真实任务类别标注的预测分类概率。使用通用的文本分类数据作为语料样本进行训练,例如进行情感分类的语料样本、进行主题分类的语料样本弹幕过滤可以基于文本分类实现的,由于经过训练得到的级联的第二文本网络与第三全连接网络可以较好地完成这些文本分类任务,因此第二文本网络也会对弹幕的文本分类有帮助,这些文本分类任务都具有监督数据,监督数据来自于学术界公开的数据集,将经过训练的第二文本网络的参数拷贝给第一文本模型,以进行迁移学习,即保留第二本文模型所有结构以及参数,作为后续进行语义处理的第一文本模型的初始化模型,后续会在此基础上继续参与整体训练。

132.在一些实施例中,上述第二本文模型所有结构以及参数,作为后续进行语义处理的第一文本模型的初始化模型,由于第一文本模型仅用于得到目标信息的文本表示,而不是做分类任务,所以将第三全连接网络去掉了,这里会把目标信息的文本表示成文本表示向量。

133.在一些实施例中,参见图4,通过调用第一视频模型对视频的多个视频片段进行内容提取处理,第一视频模型包括第一卷积神经网络以及第一全连接网络,第一卷积神经网络包括第一卷积层、第一池化层以及第一全连接层,第一卷积神经网络是三维卷积神经网

络,采用三维卷积神经网络对视频片段进行建模,第一卷积层是三维卷积层,通过三维卷积层对视频信号进行处理,一维对应着视频的时间信息、另外两维对应视频的空间信息,即视频帧的横坐标以及纵坐标的二维空间,完整视频包含很多个视频片段,例如每5秒算作是一个视频片段,对分割好的视频片段进行内容分析,将每个视频片段转化为一个内容表示向量,作为视频内容的表示,通过第一卷积层提取视频片段的时间特征向量以及空间特征向量,通过第一池化层对时间特征向量以及空间特征向量进行第一池化处理,得到视频片段的池化特征向量,通过第一全连接层对视频片段的池化特征向量进行第二线性变换处理,得到视频片段的内容卷积特征向量,通过第一全连接网络对视频片段的内容卷积特征向量进行第一线性变换处理,得到视频片段的内容表示向量,第一全连接网络包括两个全连接层,这两个全连接层的作用均是对内容卷积特征向量进行线性变换,即改变内容卷积特征向量的维度,输入全连接层的内容卷积特征向量的维度为x,输出全连接层的内容卷积特征向量的维度为y。

134.在一些实施例中,参见图5,第二视频模型是与第一视频模型并列的模型。通过第二视频模型会将视频中出现过的物体(目标对象)逐一识别出来,通过第二视频模型理解视频内容,基于视频内容更容易看出来目标信息是否与视频无关,目标信息是否为低质量内容,第二视频模型的输入是一张视频帧,整段视频可以每隔几秒采样出一张视频帧,把这个视频帧作为第二视频模型的输入,整个视频中所有的视频帧可以依次作为第二视频模型的输入,第二视频模型会依次生成目标对象识别结果,第二视频模型的输出为视频帧中包括某个物体的目标区域以及每个目标区域内的目标对象,通过生成物体边界的方式框定包括物体的图像,参见图6,图6中示出了每个物体的边界框,边界框上还显示出目标区域内的目标对象,例如,卡车。

135.在一些实施例中,第二视频模型包括第二卷积神经网络、第一分类网络、第三卷积神经网络以及第二分类网络,针对每个视频帧执行以下处理:通过第二卷积神经网络对视频帧进行第二特征提取处理,得到视频帧的视频帧分类特征,第二卷积神经网络对视频帧进行特征提取,提取的特征是向量形式的,例如:(0.1,0.3,0.4,0.31,0.55)是一个五维的向量,第二卷积神经网络会提取n维向量,n通常大于100,通过第一分类网络对视频帧的每个像素点进行基于视频帧分类特征的分类处理,得到每个像素点的分类结果,第一分类网络可以为支持向量机,支持向量机可以基于输入的视频帧分类特征对每个像素点执行一次分类任务,分类结果表征像素点属于某个对象还是属于背景,当分类结果表征像素点属于对象像素点时,基于多个对象像素点,确定视频帧的目标区域,输出多个有对象像素点组成的目标区域,目标区域为长方形,具体描述为:目标区域左顶点坐标、目标区域的长以及目标区域的宽,针对每个目标区域执行以下处理:通过第三卷积神经网络对目标区域进行第三特征提取处理,得到目标区域的区域分类特征,再使用卷积神经网络对所有得到的目标区域进行特征抽取,再次提取特征可以提高特征提取的抽象程度,神经网络模型越深、抽象程度越高,学习效果越好,通过第二分类网络对目标区域的目标图像进行基于区域分类特征的分类处理,得到每个目标区域的目标对象,第二分类网络可以为不同于第一分类网络的支持向量机,将对应每个目标区域获取的区域分类特征再次送入新支持向量机中,使其对目标区域中的图像进行分类识别,确定出目标区域中的目标对象,由此,视频帧内的所有目标对象均被提取出来。

136.在一些实施例中,通过第二视频模型对视频中所有的视频帧识别出该视频帧中所有的目标对象,按照视频中视频帧出现的先后顺序对目标对象进行排列,把识别出的所有目标对象都排列出来,然后利用第三视频模型去融合,参见图7,第三视频模型包括第四卷积神经网络以及第一循环神经网络,用第四卷积神经网络把物体图像表示成图像特征向量,然后利用第一循环神经网络把所有的物体图像对应的图像特征向量都融合起来,合并成一个向量,即视频的对象表示向量,第一循环神经网络的最后一个隐层向量就是最终输出的对象表示向量,由于第一循环神经网络的特性,最后一个隐层向量包括所有的物体图像的信息。

137.在一些实施例中,参见图11,目标信息分类模型包括第一视频模型、第二视频模型、第一文本模型以及分类模型,分类模型的结构参见图10,分类模型包括第二全连接层、第三卷积层、第三池化层以及第三全连接层,通过第一视频模型对视频样本进行内容提取处理,得到视频样本的内容表示向量,并通过第二视频模型对视频样本进行对象提取处理,得到视频样本的对象表示向量;通过第一文本模型对目标信息样本进行第一语义提取处理,得到目标信息样本的语义表示向量;通过分类模型对目标信息样本进行基于视频样本的内容表示向量、视频样本的对象表示向量以及目标信息的语义表示向量的分类处理,得到目标信息样本属于第一真实类别标注的第二预测分类概率;将第二预测分类概率以及第一真实类别标注代入对应目标信息分类模型的第一损失函数;根据第一损失函数更新目标信息分类模型的参数,目标信息样本是经过人工标注的,目标信息样本包括低质量文本数据以及高质量文本数据,将第二文本网络作为第一文本模型的初始模型,目标信息分类模型会预测结果表征目标信息样本是否为低质量文本,然后跟目标信息样本的标注进行对比,根据预测值和真实标注的差距更新目标信息分类模型,训练完成之后,在使用目标信息分类模型时,目标信息分类模型会对每个目标信息进行预测,预测结果是概率值,预测概率值高于无效概率阈值的目标信息会被认为是低质量文本,从而会被过滤掉。

138.本技术实施例提供的目标信息分类模型可以适用于各种应用的视频播放服务中,用于对其中包括弹幕的评论进行过滤,进而减少评论中不合适的内容、枯燥无味的内容、用户不喜欢的内容等等,从而有效提高用户的观看体验。

139.下面继续说明本技术实施例提供的基于人工智能的信息处理装置255的实施为软件模块的示例性结构,在一些实施例中,如图2所示,存储在存储器250的基于人工智能的信息处理装置255中的软件模块可以包括:视频模块2551,用于对视频的至少一个视频片段进行内容提取处理,得到视频的内容表示向量,并对视频的至少一个视频帧进行对象提取处理,得到视频的对象表示向量;获取模块2552,用于获取用于评价视频的目标信息;语义模块,用于对目标信息进行第一语义提取处理,得到目标信息的语义表示向量;过滤模块2554,用于基于视频的内容表示向量、视频的对象表示向量以及目标信息的语义表示向量,确定对应所述目标信息的识别结果,其中,对应所述目标信息的识别结果用于表征所述目标信息的类别。

140.在一些实施例中,内容提取处理是通过调用第一视频模型实现的,第一视频模型包括第一卷积神经网络以及第一全连接网络,视频模块2551,还用于:针对每个视频片段执行以下处理:通过第一卷积神经网络对视频片段进行第一特征提取处理,得到视频片段的内容卷积特征向量;通过第一全连接网络对视频片段的内容卷积特征向量进行第一线性变

换处理,得到视频片段的内容表示向量。

141.在一些实施例中,第一卷积神经网络包括第一卷积层、第一池化层以及第一全连接层,视频模块2551,还用于:通过第一卷积层提取视频片段的时间特征向量以及空间特征向量;通过第一池化层对时间特征向量以及空间特征向量进行第一池化处理,得到视频片段的池化特征向量;通过第一全连接层对视频片段的池化特征向量进行第二线性变换处理,得到视频片段的内容卷积特征向量。

142.在一些实施例中,视频模块2551,还用于:对视频的至少一个视频帧进行对象识别处理,得到视频包括的至少一个目标对象;当目标对象的数目为多个时,对多个目标对象进行对象融合处理,得到视频的对象表示向量。

143.在一些实施例中,对象识别处理是通过调用第二视频模型实现的,第二视频模型包括第二卷积神经网络、第一分类网络、第三卷积神经网络以及第二分类网络,视频模块2551,还用于:针对每个视频帧执行以下处理:通过第二卷积神经网络对视频帧进行第二特征提取处理,得到视频帧的视频帧分类特征;通过第一分类网络对视频帧的每个像素点进行基于视频帧分类特征的分类处理,得到每个像素点的分类结果;当分类结果表征像素点属于对象像素点时,基于多个对象像素点,确定视频帧的目标区域;针对每个目标区域执行以下处理:通过第三卷积神经网络对目标区域进行第三特征提取处理,得到目标区域的区域分类特征;通过第二分类网络对目标区域的目标图像进行基于区域分类特征的分类处理,得到每个目标区域的目标对象。

144.在一些实施例中,对象融合处理是通过调用第三视频模型实现的,第三视频模型包括第四卷积神经网络以及第一循环神经网络,视频模块2551,还用于:获取包括每个目标对象的目标图像;针对每个目标图像执行以下处理:通过第四卷积神经网络对目标图像进行第四特征提取处理,得到目标图像的图像特征向量;通过第一循环神经网络对多个目标图像的图像特征向量进行图像特征融合处理,得到视频的对象表示向量。

145.在一些实施例中,第一循环神经网络包括与多个目标图像一一对应的多个隐藏层,视频模块2551,还用于:当多个目标对象处于不同视频帧时,按照多个目标图像所在的视频帧在视频中的出现先后顺序,依次针对每个目标图像执行以下处理:当目标图像排序在首位时,通过对应目标图像的隐藏层对目标图像进行第三线性变换处理,得到对应目标图像的隐层向量;当目标图像排序在非首位时,通过对应目标图像的隐藏层对目标图像以及前一个目标图像的隐层向量进行第三线性变换处理,得到对应目标图像的隐层向量;将与出现先后顺序中最后一个目标图像对应的隐层向量作为视频的对象表示向量。

146.在一些实施例中,获取模块2552,还用于:执行以下处理至少之一:获取用于评价视频的图像目标信息;获取用于评价视频的文本目标信息;获取用于评价视频的表情目标信息。

147.在一些实施例中,第一语义提取处理是通过第一文本模型实现的,第一文本模型包括第二循环神经网络、第二全连接网络以及第五卷积神经网络,第五卷积神经网络包括第二卷积层与第二池化层,当目标信息为文本目标信息时,语义模块,还用于:通过第二循环神经网络对目标信息进行循环语义特征提取处理,得到对应目标信息中每个词语的词向量;通过第二全连接网络对每个词语的词向量进行词向量融合处理,得到词向量融合处理结果;通过第二卷积层对词向量融合处理结果进行第五特征提取处理,得到词向量融合处

理结果的词卷积特征向量;通过第二池化层对词卷积特征向量进行第二池化处理,得到目标信息的语义表示向量。

148.在一些实施例中,对目标信息进行分类处理是通过分类模型实现的,分类模型包括第二全连接层、第三卷积层、第三池化层以及第三全连接层,过滤模块2554,还用于:通过第二全连接层对视频的内容表示向量、视频的对象表示向量以及目标信息的语义表示向量进行多模态融合处理,得到多模态融合处理结果;通过第三卷积层对多模态融合处理结果进行第六特征提取处理,得到多模态融合处理结果的多模态卷积特征向量;通过第三池化层对多模态卷积特征向量进行第三池化处理,得到目标信息的分类向量;通过第三全连接层对目标信息进行基于分类向量的第一类别预测处理,得到目标信息属于无效类别的第一预测分类概率;当第一预测分类概率大于无效概率阈值时,将目标信息的识别结果确定为无效类别。

149.在一些实施例中,在确定对应目标信息的识别结果之后,过滤模块2554,还用于:当对应目标信息的识别结果表征目标信息的类别为无效类别时,对目标信息进行过滤处理。

150.在一些实施例中,内容提取处理是通过调用第一视频模型实现的,对象提取处理是通过调用第二视频模型实现的,第一语义提取处理是通过第一文本模型实现的,对目标信息进行分类处理是通过分类模型实现的,第一视频模型、第二视频模型、第一文本模型以及分类模型构成目标信息分类模型,装置还包括:训练模块2555,用于:获取视频样本以及用于评价视频样本且具有第一真实类别标注的目标信息样本,其中,第一真实类别标注为有效类别标注或者无效类别标注;通过第一视频模型对视频样本进行内容提取处理,得到视频样本的内容表示向量,并通过第二视频模型对视频样本进行对象提取处理,得到视频样本的对象表示向量;通过第一文本模型对目标信息样本进行第一语义提取处理,得到目标信息样本的语义表示向量;通过分类模型对目标信息样本进行基于视频样本的内容表示向量、视频样本的对象表示向量以及目标信息的语义表示向量的分类处理,得到目标信息样本属于第一真实类别标注的第二预测分类概率;将第二预测分类概率以及第一真实类别标注代入对应目标信息分类模型的第一损失函数;根据第一损失函数更新目标信息分类模型的参数。

151.在一些实施例中,在通过第一文本模型对目标信息样本进行第一语义提取处理,得到目标信息样本的语义表示向量之前,训练模块2555,还用于:获取文本分类任务的待分类样本,其中,待分类样本具有第二真实类别标注,第二真实类别标注对应文本分类任务的真实任务类别标注;通过第二文本网络对待分类样本进行第二语义提取处理,得到待分类样本的语义表示向量;通过第三全连接网络对待分类样本进行基于待分类样本的语义表示向量的第二类别预测处理,得到待分类样本属于真实任务类别标注的第三预测分类概率;将第三预测分类概率以及第二真实类别标注代入对应第二文本网络以及第三全连接网络的第二损失函数;根据第二损失函数更新第二文本网络以及第三全连接网络的参数,并将第二文本网络作为将对目标信息样本进行第一语义提取处理的第一文本模型。

152.本技术实施例提供了一种计算机程序产品或计算机程序,该计算机程序产品或计算机程序包括计算机指令,该计算机指令存储在计算机可读存储介质中。计算机设备的处理器从计算机可读存储介质读取该计算机指令,处理器执行该计算机指令,使得该计算机

设备执行本技术实施例上述的基于人工智能的信息处理方法。

153.本技术实施例提供一种存储有可执行指令的计算机可读存储介质,其中存储有可执行指令,当可执行指令被处理器执行时,将被处理器执行本技术实施例提供的基于人工智能的信息处理方法,例如,如图3a-3c示出的基于人工智能的信息处理方法。

154.在一些实施例中,计算机可读存储介质可以是fram、rom、prom、ep rom、eeprom、闪存、磁表面存储器、光盘、或cd-rom等存储器;也可以是包括上述存储器之一或任意组合的各种设备。

155.在一些实施例中,可执行指令可以采用程序、软件、软件模块、脚本或代码的形式,按任意形式的编程语言(包括编译或解释语言,或者声明性或过程性语言)来编写,并且其可按任意形式部署,包括被部署为独立的程序或者被部署为模块、组件、子例程或者适合在计算环境中使用的其它单元。

156.作为示例,可执行指令可以但不一定对应于文件系统中的文件,可以可被存储在保存其它程序或数据的文件的一部分,例如,存储在超文本标记语言(html,hyper text markup language)文档中的一个或多个脚本中,存储在专用于所讨论的程序的单个文件中,或者,存储在多个协同文件(例如,存储一个或多个模块、子程序或代码部分的文件)中。

157.作为示例,可执行指令可被部署为在一个计算设备上执行,或者在位于一个地点的多个计算设备上执行,又或者,在分布在多个地点且通过通信网络互连的多个计算设备上执行。

158.综上,通过本技术实施例,对视频的至少一个视频片段进行内容提取处理,得到视频的内容表示向量,并对视频的至少一个视频帧进行对象提取处理,得到视频的对象表示向量,从而实现对视频内容以及具体对象的学习,对用于评价视频的目标信息进行第一语义提取处理,得到目标信息的语义表示向量,从而实现对目标信息的语义理解,结合内容表示向量、对象表示向量以及目标信息的语义表示向量,对目标信息进行分类处理,可以提升目标信息的分类准确度,从而有效提升过滤处理的效果。

159.以上,仅为本技术的实施例而已,并非用于限定本技术的保护范围。凡在本技术的精神和范围之内所作的任何修改、等同替换和改进等,均包含在本技术的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1