数据分类方法及相关设备与流程

本发明属于量子计算,特别是涉及一种数据分类方法及相关设备。

背景技术:

1、对于相互关联的序列数据,部分神经网络如长短时记忆网络(long short termmemory,lstm)能记忆前文的信息,进而根据关联信息对数据进行分类,以改善分类效果。例如对于“我吃饭”这样的句子,动词“吃”后一般跟名词而不是动词,长短时记忆网络可以利用这样的规则,提高分类预测的准确性。

2、相关技术中,部分类型的神经网络包括多个隐藏层,在隐藏层数量较多时,前文的信息难以被记忆,进而不能有效利用间隔较远的前文信息,使得其分类的准确性降低,基于此,提出一种数据分类方法及相关设备。

技术实现思路

1、本发明的目的是提供一种数据分类方法及相关设备,旨在对相互关联的序列数据分类预测时,能有效利用间隔较远的前文信息,提高分类预测的准确性。

2、为了实现上述目的,本发明实施例的第一方面,提供一种数据分类方法,所述方法包括:

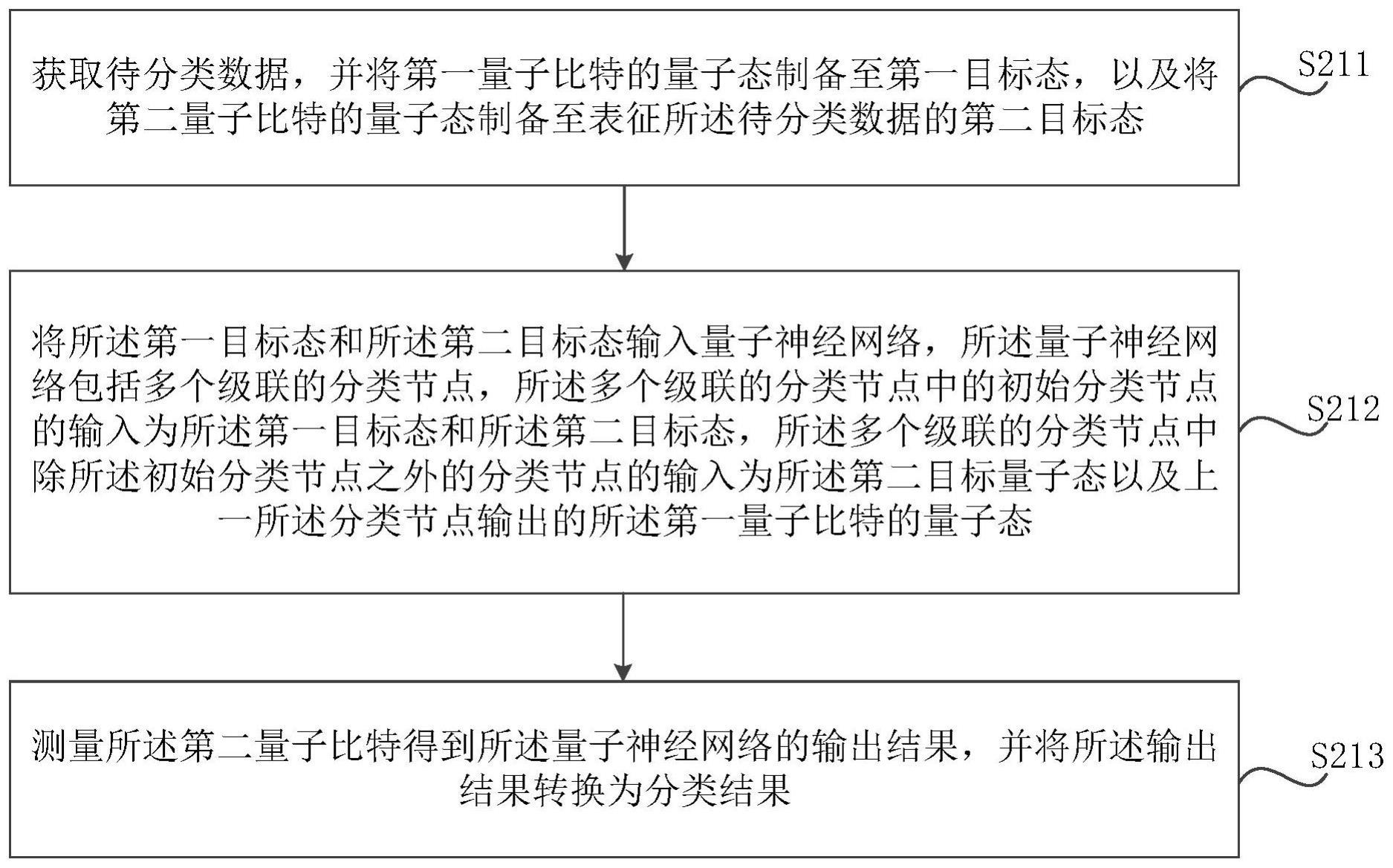

3、获取待分类数据,并将第一量子比特的量子态制备至第一目标态,以及将第二量子比特的量子态制备至表征所述待分类数据的第二目标态;

4、将所述第一目标态和所述第二目标态输入量子神经网络,所述量子神经网络包括多个级联的分类节点,所述多个级联的分类节点中的初始分类节点的输入为所述第一目标态和所述第二目标态,所述多个级联的分类节点中除所述初始分类节点之外的分类节点的输入为所述第二目标量子态以及上一所述分类节点输出的所述第一量子比特的量子态;

5、测量所述第二量子比特得到所述量子神经网络的输出结果,并将所述输出结果转换为分类结果。

6、可选地,所述分类节点包括优化层,所述优化层包括第一含参单量子逻辑门。

7、可选地,所述第一含参单量子逻辑门包括依次级联的第一rx旋转门、第一rz旋转门以及第二rx旋转门。

8、可选地,所述分类节点还包括交替层,所述交替层用于使所述第一量子比特和所述第二量子比特的量子态基于时间演化算符演化,其中,i为虚数,hint为包括多个泡利门的张量积的哈密顿量,t为时间。

9、可选地,所述交替层包括校验模块、相移模块以及还原模块,其中:

10、所述校验模块包括多个第一cnot门,所述第一cnot门的控制比特为所述第一量子比特或所述第二量子比特,所述第一cnot门的目标比特为辅助量子比特;

11、所述相移模块包括依次级联且用于作用于所述辅助量子比特的第二rz旋转门、第一泡利x门、第三rz旋转门以及第二泡利x门,所述第二rz旋转门及所述第三rz旋转门的参数分别为所述时间以及所述时间的负数;

12、所述还原模块包括多个第二cnot门,所述第二cnot门的控制比特为所述第一量子比特或所述第二量子比特,所述第二cnot门的目标比特为所述辅助量子比特。

13、可选地,所述将第二量子比特的量子态制备至表征所述待分类数据的第二目标态,包括:

14、获取以所述待分类数据为参数的第二含参单量子逻辑门;

15、将第二量子比特的量子态制备至预备量子态;

16、将所述第二含参单量子逻辑门作用于所述第二量子比特,使得所述预备量子态演化至表征所述待分类数据的第二目标态。

17、可选地,所述第二含参单量子逻辑门包括ry旋转门。

18、可选地,所述待分类数据为多模态数据,所述将第二量子比特的量子态制备至表征所述待分类数据的第二目标态,包括:

19、将不同模态的所述待分类数据转化为同一数据向量;

20、针对同一所述数据向量的每一元素,将对应所述元素的第二量子比特的量子态制备至表征所述元素的第二目标态。

21、可选地,所述测量所述第二量子比特得到所述量子神经网络的输出结果,并将所述输出结果转换为分类结果,包括:

22、测量所述第二量子比特得到一个或多个所述分类节点的输出结果,并将所述输出结果输入变换函数,得到分类结果。

23、可选地,所述变换函数为所述输出结果的线性函数。

24、可选地,所述方法还包括:

25、基于同步扰动随机近似算法训练待优化的量子神经网络,得到所述待优化的量子神经网络包括的第一含参单量子逻辑门的参数的优化值;

26、将所述优化值应用于所述待优化的量子神经网络,得到已训练的量子神经网络,以用于对所述待分类数据进行分类。

27、可选地,所述基于同步扰动随机近似算法训练待优化的量子神经网络,得到所述待优化的量子神经网络包括的第一含参单量子逻辑门的参数的优化值,包括:

28、获取训练数据,并构建待优化的量子神经网络的损失函数;

29、将所述待优化的量子神经网络的第一含参单量子逻辑门的参数的初始值减去第一偏置量,并将所述训练数据输入该量子神经网络,得到第一结果;

30、将所述待优化的量子神经网络的第一含参单量子逻辑门的参数的初始值加上第二偏置量,并将所述训练数据输入该量子神经网络,得到第二结果;

31、基于所述第一结果与所述第二结果计算所述待优化的量子神经网络的参数的下降梯度;

32、基于梯度下降算法及所述下降梯度更新所述参数;

33、在确定更新所述参数后的所述量子神经网络的损失函数的值小于阈值时,将所述参数更新后的值作为所述参数的优化值。

34、本发明实施例的第二方面,提供一种数据分类装置,所述装置包括:

35、获取制备模块,用于获取待分类数据,并将第一量子比特的量子态制备至第一目标态,以及将第二量子比特的量子态制备至表征所述待分类数据的第二目标态;

36、输入模块,用于将所述第一目标态和所述第二目标态输入量子神经网络,所述量子神经网络包括多个级联的分类节点,所述多个级联的分类节点中的初始分类节点的输入为所述第一目标态和所述第二目标态,所述多个级联的分类节点中除所述初始分类节点之外的分类节点的输入为所述第二目标量子态以及上一所述分类节点输出的所述第一量子比特的量子态;

37、测量转换模块,用于测量所述第二量子比特得到所述量子神经网络的输出结果,并将所述输出结果转换为分类结果。

38、可选地,所述分类节点包括优化层,所述优化层包括第一含参单量子逻辑门。

39、可选地,所述第一含参单量子逻辑门包括依次级联的第一rx旋转门、第一rz旋转门以及第二rx旋转门。

40、可选地,所述分类节点还包括交替层,所述交替层用于使所述第一量子比特和所述第二量子比特的量子态基于时间演化算符演化,其中,i为虚数,hint为包括多个泡利门的张量积的哈密顿量,t为时间。

41、可选地,所述交替层包括校验模块、相移模块以及还原模块,其中:

42、所述校验模块包括多个第一cnot门,所述第一cnot门的控制比特为所述第一量子比特或所述第二量子比特,所述第一cnot门的目标比特为辅助量子比特;

43、所述相移模块包括依次级联且用于作用于所述辅助量子比特的第二rz旋转门、第一泡利x门、第三rz旋转门以及第二泡利x门,所述第二rz旋转门及所述第三rz旋转门的参数分别为所述时间以及所述时间的负数;

44、所述还原模块包括多个第二cnot门,所述第二cnot门的控制比特为所述第一量子比特或所述第二量子比特,所述第二cnot门的目标比特为所述辅助量子比特。

45、可选地,所述获取制备模块还用于:

46、获取以所述待分类数据为参数的第二含参单量子逻辑门;

47、将第二量子比特的量子态制备至预备量子态;

48、将所述第二含参单量子逻辑门作用于所述第二量子比特,使得所述预备量子态演化至表征所述待分类数据的第二目标态。

49、可选地,所述第二含参单量子逻辑门包括ry旋转门。

50、可选地,所述待分类数据为多模态数据,所述获取制备模块还用于:

51、将不同模态的所述待分类数据转化为同一数据向量;

52、针对同一所述数据向量的每一元素,将对应所述元素的第二量子比特的量子态制备至表征所述元素的第二目标态。

53、可选地,所述测量转换模块还用于:

54、测量所述第二量子比特得到一个或多个所述分类节点的输出结果,并将所述输出结果输入变换函数,得到分类结果。

55、可选地,所述变换函数为所述输出结果的线性函数。

56、可选地,所述装置还包括:

57、训练模块,用于基于同步扰动随机近似算法训练待优化的量子神经网络,得到所述待优化的量子神经网络包括的第一含参单量子逻辑门的参数的优化值;

58、应用模块,用于将所述优化值应用于所述待优化的量子神经网络,得到已训练的量子神经网络,以用于对所述待分类数据进行分类。

59、可选地,所述训练模块还用于:

60、获取训练数据,并构建待优化的量子神经网络的损失函数;

61、将所述待优化的量子神经网络的第一含参单量子逻辑门的参数的初始值减去第一偏置量,并将所述训练数据输入该量子神经网络,得到第一结果;

62、将所述待优化的量子神经网络的第一含参单量子逻辑门的参数的初始值加上第二偏置量,并将所述训练数据输入该量子神经网络,得到第二结果;

63、基于所述第一结果与所述第二结果计算所述待优化的量子神经网络的参数的下降梯度;

64、基于梯度下降算法及所述下降梯度更新所述参数;

65、在确定更新所述参数后的所述量子神经网络的损失函数的值小于阈值时,将所述参数更新后的值作为所述参数的优化值。

66、本发明实施例的第三方面,提供一种存储介质,所述存储介质中存储有计算机程序,其中,所述计算机程序被设置为运行时执行上述第一方面中任一项所述方法的步骤。

67、本发明实施例的第四方面,提供一种电子装置,包括存储器和处理器,所述存储器中存储有计算机程序,所述处理器被设置为运行所述计算机程序以执行上述第一方面中任一项所述方法的步骤。

68、基于上述技术方案,在对待分类数据的处理过程中,准备第二量子比特用于制备表征待分类数据的第二目标态参与计算分类结果的量子计算过程,并准备第一量子比特用于记忆第二目标态的特征数据,且在不同的分类节点间传递,使得每一分类节点都可以根据接收的上一分类节点输出的第一量子比特的量子态,以及当前输入的第二目标态进行量子计算,并将计算结果也即分类结果存储于第二量子比特的量子态输出,由于第一量子比特在整个过程中不被测量,故其存储的特征数据可以不断传递以被每个分类节点利用,进而对于间隔较远的分类节点,输入其中的待分类数据也可以被后续的分类节点有效利用,提高了分类的准确性。

- 还没有人留言评论。精彩留言会获得点赞!