信息处理方法及信息处理系统与流程

1.本发明涉及信息处理方法及信息处理系统。

背景技术:

2.有基于从设备取得的数据执行推论处理的技术(参照专利文献1)。在该文献中,公开了基于设备被置于的环境或条件来执行推论处理的推论模型。

3.现有技术文献

4.专利文献

5.专利文献1:国际公开第2018/173121号

技术实现要素:

6.发明要解决的课题

7.但是,在上述文献的技术中,由于对于从设备取得的数据基于间接性的信息来选择推论模型,所以有未选择适合于推论处理对象的数据(换言之,推论模型的输入数据)的推论模型。

8.所以,本发明的目的是提供一种能够使适合于推论处理对象的数据的推论模型被选择的可能性提高的信息处理方法等。

9.用来解决课题的手段

10.有关本发明的一技术方案的信息处理方法,是处理器使用存储器执行的信息处理方法,通过将感测数据输入到第1推论模型中,从上述第1推论模型取得对于上述感测数据的第1推论结果;通过将上述第1推论结果输入到第3推论模型中,从上述第3推论模型取得表示从多个第2推论模型中选择的至少1个第2推论模型的模型选择信息;通过将上述第1推论结果输入到上述模型选择信息表示的上述至少1个第2推论模型中,从上述第2推论模型取得对于上述第1推论结果的至少1个第2推论结果;将上述至少1个第2推论结果输出。

11.另外,这些包含性或具体的技术方案也可以由系统、方法、集成电路、计算机程序或计算机可读取的cd-rom等的记录介质实现,也可以由系统、方法、集成电路、计算机程序及记录介质的任意的组合来实现。

12.发明效果

13.本发明的信息处理方法能够使适合于推论处理对象的数据的推论模型被选择的可能性提高。

附图说明

14.图1是表示实施方式1的学习系统的功能结构的框图。

15.图2是表示被输入到实施方式1的学习系统中的图像的一例的说明图。

16.图3是表示实施方式1的任务评价信息的一例的说明图。

17.图4是表示实施方式1的训练数据的例子的说明图。

18.图5是表示实施方式1的学习系统执行的处理的流程图。

19.图6是表示实施方式1的推论系统的功能结构的框图。

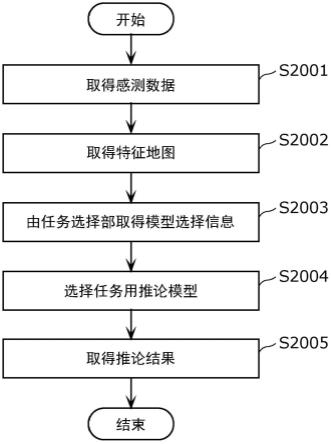

20.图7是表示实施方式1的推论系统执行的处理的流程图。

21.图8是表示实施方式2的训练系统的功能结构的框图。

22.图9是表示实施方式2的训练数据的例子的说明图。

23.图10是表示实施方式2的训练系统执行的处理的流程图。

24.图11是表示实施方式2的推论系统的功能结构的框图。

25.图12是表示实施方式2的推论系统执行的处理的流程图。

26.图13是表示实施方式3的训练系统的功能结构的框图。

27.图14是表示实施方式3的训练系统执行的处理的流程图。

28.图15是表示实施方式3的推论系统的功能结构的框图。

29.图16是表示实施方式3的推论系统执行的处理的流程图。

30.图17是表示实施方式4的训练系统的功能结构的框图。

31.图18是表示实施方式4的训练系统执行的处理的流程图。

32.图19是表示实施方式4的推论系统的功能结构的框图。

33.图20是表示实施方式4的推论系统执行的处理的流程图。

具体实施方式

34.(作为本发明的基础的认识)

35.近年来,随着使用机器学习等的推论处理技术的进步,应用推论处理的场合正在扩大。例如,在住宅内的人的行动识别中使用推论处理。另一方面,在行动识别中,各种各样的种类或识别难度的物体或场景作为识别对象存在。此外,为了住宅内的行动识别而要求进行识别处理的装置的小型化、低成本化,装置的计算资源受限。因此,在住宅内的行动识别中,对于各种各样的识别对象,要求在受限的计算资源(例如,处理器、存储器)下识别。另外,这并不限于行动识别,推测在其他的推论处理中也是同样的。

36.但是,为了对应于各种各样的种类的识别对象,使用多种行动识别模型执行识别处理,所以计算成本变得庞大。此外,为了与各种各样的识别难度的识别对象对应,使用巨大的行动识别模型执行识别处理,所以计算成本(例如,计算量、计算时间、计算资源的占有量、耗电)变得庞大。

37.此外,作为以往技术,有基于设备被置于的环境或条件来执行推论处理的推论模型的技术。

38.但是,在上述技术中,由于对于从设备取得的数据基于间接性的信息来选择推论模型,所以有未选择适合于推论处理对象的数据的推论模型的情况。此外,由于将推论模型的选择处理和推论处理独立地执行,所以花费计算成本。

39.所以,有关本发明的一技术方案的信息处理方法,是处理器使用存储器执行的信息处理方法,通过将感测数据输入到第1推论模型中,从上述第1推论模型取得对于上述感测数据的第1推论结果;通过将上述第1推论结果输入到第3推论模型中,从上述第3推论模型取得表示从多个第2推论模型中选择的至少1个第2推论模型的模型选择信息;通过将上述第1推论结果输入到上述模型选择信息表示的上述至少1个第2推论模型中,从上述第2推

论模型取得对于上述第1推论结果的至少1个第2推论结果;将上述至少1个第2推论结果输出。

40.根据上述技术方案,由于使用从多个第2推论模型中选择的至少1个第2推论模型取得第2推论结果,所以在取得第2推论结果时,多个第2推论模型中的没有被选择的第2推论模型不工作。因此,能够削减没有被选择的第2推论模型的工作所需要的计算资源或电力。这样,上述信息处理方法在能够进行对于各种各样的推论对象的推论处理的同时,能够抑制该推论处理所花费的计算成本。此外,由于基于通过输入感测数据而得到的第1推论结果来选择第2推论模型,所以实质上成为基于该感测数据的特征来选择第2推论模型。因而,能够使适合于推论处理对象的数据的推论模型被选择的可能性提高。

41.例如,上述第3推论模型也可以是以下的模型:通过将训练用感测数据输入到上述第1推论模型中,从上述第1推论模型取得对于上述训练用感测数据的训练用第1推论结果;基于通过将上述训练用第1推论结果输入到上述多个第2推论模型中的至少1个第2推论模型的各个选择样式之中的被选择的至少1个第2推论模型中而得到的至少1个训练用第2推论结果、以及通过将上述训练用第1推论结果输入到上述第3推论模型中而取得的作为上述模型选择信息的训练用模型选择信息,利用机器学习被进行了训练。

42.根据上述技术方案,通过利用机器学习,也能够将进行根据感测数据的特征选择第2推论模型这样的复杂的推论处理的第3推论模型用其他的方法容易地生成。

43.例如,上述第3推论模型的训练,也可以包括以基于上述至少1个训练用第2推论结果并按照上述模型选择信息的形式生成的数据为参照数据、以上述训练用模型选择信息为输出数据的利用了机器学习的训练。

44.根据上述技术方案,通过根据训练用第2推论结果生成遵循模型选择信息的形式的数据,能够受到训练用第2推论结果的形式的制约而对第3推论模型进行训练。换言之,能够将输出各种各样的第2推论结果的多种多样的第2推论模型应用于本公开的实施方式。

45.例如,也可以是,上述模型选择信息包含与第2推论模型执行的任务对应的第1信息;上述模型选择信息表示的上述至少1个第2推论模型执行与上述第1信息对应的任务;生成上述参照数据,以使执行对上述至少1个训练用第2推论结果作出贡献的任务的第2推论模型优先地包含在上述训练用模型选择信息表示的至少1个第2推论模型中。

46.根据上述技术方案,由于执行对至少1个第2推论结果作出贡献的任务的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够自动地生成输出执行该作出贡献的任务的第2推论模型被选择的模型选择信息的第3推论模型。此外,参照数据中包含的对于第3推论模型的训练有效的数据变得更多,训练的效率提高。

47.例如,上述参照数据的生成也可以包括:生成上述参照数据,以使执行属于基于上述至少1个训练用第2推论结果的得分比阈值高的任务集的任务的第2推论模型优先地包含在上述训练用模型选择信息表示的至少1个第2推论模型中。

48.根据上述技术方案,由于执行得分比阈值高的任务集所述的任务的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够使由第3推论模型实质上选择的第2推论模型得到的第2推论结果的精度或正确性等的水平接近于规定的基准。

49.例如,也可以是,上述模型选择信息包含与上述第2推论模型的性能对应的第2信

息;上述模型选择信息表示的至少1个第2推论模型具有与上述第2信息对应的性能;上述参照数据的生成包括:生成上述参照数据,以使满足上述至少1个训练用第2推论结果中的性能要求的第2推论模型优先地包含在上述训练用模型选择信息表示的至少1个第2推论模型中。

50.根据上述技术方案,由于满足性能要求的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够自动地生成输出满足该性能要求的第2推论模型被选择的模型选择信息的第3推论模型。此外,参照数据中包含的对于第3推论模型的训练有效的数据变得更多,训练的效率提高。

51.例如,也可以是,上述第2信息包含上述第2推论模型的处理的难度;参照数据的生成包括:生成上述参照数据,以使具有与上述难度对应的性能的第2推论模型优先地包含在上述训练用模型选择信息表示的至少1个第2推论模型中。

52.根据上述技术方案,由于具有与难度对应的性能的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够使由第3推论模型实质上选择的第2推论模型进行的推论处理的处理性能(换言之使计算成本)接近于被要求的水平。

53.例如,也可以是,上述第2推论模型包括神经网络模型;上述第2信息作为上述第2推论模型的性能而包含表示上述神经网络模型的尺寸的尺寸信息;参照数据的生成包括:生成上述参照数据,以使具有上述第2信息中包含的上述尺寸信息的第2推论模型优先地包含在上述训练用模型选择信息表示的至少1个第2推论模型中。

54.根据上述技术方案,由于作为第2推论模型的性能而使用神经网络的尺寸信息,所以能够更容易地调整第2推论模型的性能。

55.此外,有关本发明的一技术方案的信息处理方法,是处理器使用存储器执行的信息处理方法,通过将感测数据输入到第1推论模型中,从上述第1推论模型取得对于上述感测数据的第1推论结果、以及表示从多个第2推论模型中选择的至少1个第2推论模型的模型选择信息;通过将上述第1推论结果输入到上述模型选择信息表示的上述至少1个第2推论模型中,从上述第2推论模型取得对于上述第1推论结果的至少1个第2推论结果;将上述至少1个第2推论结果输出。

56.根据上述技术方案,由于使用从多个第2推论模型中选择的至少1个第2推论模型取得第2推论结果,所以在取得第2推论结果时,多个第2推论模型中的没有被选择的第2推论模型不工作。因此,能够削减没有被选择的第2推论模型的工作所需要的计算资源或电力。这样,上述信息处理方法在能够进行对于各种各样的推论对象的推论处理的同时,能够抑制该推论处理所花费的计算成本。此外,由于基于通过输入感测数据而得到的第1推论结果来选择第2推论模型,所以实质上成为基于该感测数据的特征来选择第2推论模型。因而,能够使适合于推论处理对象的数据的推论模型被选择的可能性提高。

57.例如,上述第1推论模型也可以是以下的模型:通过将训练用感测数据输入到上述第1推论模型中,从上述第1推论模型取得对于上述训练用感测数据的训练用第1推论结果和训练用模型选择信息;基于通过将上述训练用第1推论结果输入到上述多个第2推论模型中的至少1个第2推论模型的各个选择样式之中的被选择的至少1个第2推论模型中而得到的至少1个训练用第2推论结果、以及上述训练用模型选择信息,利用机器学习被进行了训

练。

58.根据上述技术方案,通过利用机器学习,也能够将进行根据感测数据的特征选择第2推论模型这样的复杂的推论处理的推论模型作为第1推论模型用其他的方法容易地生成。

59.例如,上述第1推论模型的训练,也可以包括以基于上述至少1个训练用第2推论结果按照上述模型选择信息的形式生成的数据为参照数据、以上述训练用模型选择信息为输出数据的利用了机器学习的训练。

60.根据上述技术方案,通过根据训练用第2推论结果生成遵循模型选择信息的形式的数据,能够不受训练用第2推论结果的形式的制约而对第1推论模型进行训练。换言之,能够将输出各种各样的第2推论结果的多种多样的第2推论模型应用于本公开的实施方式。

61.例如,也可以是,上述模型选择信息包含与第2推论模型执行的任务对应的第1信息;上述模型选择信息表示的上述至少1个第2推论模型执行与上述第1信息对应的任务;生成上述参照数据,以使执行对上述至少1个训练用第2推论结果作出贡献的任务的第2推论模型优先地包含在上述训练用模型选择信息表示的至少1个第2推论模型中。

62.根据上述技术方案,由于执行对至少1个第2推论结果作出贡献的任务的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够自动地生成输出执行该作出贡献的任务的第2推论模型被选择的模型选择信息的第1推论模型。此外,参照数据中包含的对于第1推论模型的训练有效的数据变得更多,训练的效率提高。

63.例如,上述参照数据的生成也可以包括:生成上述参照数据,以使执行属于基于上述至少1个训练用第2推论结果的得分比阈值高的任务集的任务的第2推论模型优先地包含在上述训练用模型选择信息表示的至少1个第2推论模型中。

64.根据上述技术方案,由于执行属于得分比阈值高的任务集的任务的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够使由第1推论模型实质上选择的第2推论模型得到的第2推论结果的精度或正确性等的水平接近于规定的基准。

65.例如,也可以是,上述模型选择信息包含与上述第2推论模型的性能对应的第2信息;上述模型选择信息表示的至少1个第2推论模型具有与上述第2信息对应的性能;上述参照数据的生成包括:生成上述参照数据,以使满足上述至少1个训练用第2推论结果中的性能要求的第2推论模型优先地包含在上述训练用模型选择信息表示的至少1个第2推论模型中。

66.根据上述技术方案,由于满足性能要求的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够自动地生成输出满足该性能要求的第2推论模型被选择的模型选择信息的第1推论模型。此外,参照数据中包含的对于第1推论模型的训练有效的数据变得更多,训练的效率提高。

67.例如,也可以是,上述第2信息包含上述第2推论模型的处理的难度;参照数据的生成包括:生成上述参照数据,以使具有与上述难度对应的性能的第2推论模型优先地包含在上述训练用模型选择信息表示的至少1个第2推论模型中。

68.根据上述技术方案,由于具有与难度对应的性能的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够使由第1推论模型实质上

选择的第2推论模型进行的推论处理的处理性能(换言之使计算成本)接近于被要求的水平。

69.例如,也可以是,上述第2推论模型包括神经网络模型;上述第2信息作为上述第2推论模型的性能而包含表示上述神经网络模型的尺寸的尺寸信息;参照数据的生成包括:生成上述参照数据,以使具有上述第2信息中包含的上述尺寸信息的第2推论模型优先地包含在上述训练用模型选择信息表示的至少1个第2推论模型中。

70.根据上述技术方案,由于作为第2推论模型的性能而使用神经网络的尺寸信息,所以能够更容易地调整第2推论模型的性能。

71.此外,有关本发明的一技术方案的信息处理装置具备:第1取得部,通过将感测数据输入到第1推论模型中,从上述第1推论模型取得对于上述感测数据的第1推论结果;第2取得部,通过将上述第1推论结果输入到第3推论模型中,从上述第3推论模型取得表示从多个第2推论模型中选择的至少1个第2推论模型的模型选择信息;第3取得部,通过将上述第1推论结果输入到上述模型选择信息表示的上述至少1个第2推论模型中,从上述第2推论模型取得对于上述第1推论结果的至少1个第2推论结果;以及输出部,将上述至少1个第2推论结果输出。

72.根据上述技术方案,起到与上述信息处理方法同样的效果。

73.此外,有关本发明的一技术方案的信息处理装置具备:第1取得部,通过将感测数据输入到第1推论模型中,从上述第1推论模型取得对于上述感测数据的第1推论结果和表示从多个第2推论模型中选择的至少1个第2推论模型的模型选择信息;第2取得部,通过将上述第1推论结果输入到上述模型选择信息表示的上述至少1个第2推论模型中,从上述第2推论模型取得对于上述第1推论结果的至少1个第2推论结果;以及输出部,将上述至少1个第2推论结果输出。

74.根据上述技术方案,起到与上述信息处理方法同样的效果。

75.另外,这些包含性或具体的技术方案也可以由系统、方法、集成电路、计算机程序或计算机可读取的cd-rom等的记录介质实现,也可以由系统、方法、集成电路、计算机程序及记录介质的任意的组合来实现。

76.以下,一边参照附图一边对实施方式具体地进行说明。

77.另外,以下说明的实施方式都是表示包含性或具体的例子的。在以下的实施方式中表示的数值、形状、材料、构成要素、构成要素的配置位置及连接形态、步骤、步骤的顺序等是一例,不是限定本发明的意思。由此,关于以下的实施方式的构成要素中的、在表示最上位概念的独立权利要求中没有记载的构成要素,设为任意的构成要素进行说明。

78.(实施方式1)

79.在本实施方式中,对使推论模型效率良好地工作的信息处理方法及信息处理系统进行说明。以后,将信息处理方法也单称作处理方法,将信息处理系统也单称作处理系统。

80.在本实施方式中,对训练系统1及推论系统2进行说明。训练系统1是通过机器学习对选择模型进行训练的处理系统,所述选择模型选择在对于被输入的感测数据的推论处理中使用的推论模型。推论系统2是根据被输入的感测数据,使用用通过训练系统1学习后的任务选择模型进行了选择的推论模型,执行对于上述感测数据的推论处理的处理系统。以下,对训练系统1及推论系统2依次进行说明。

81.(1-1)训练系统1

82.图1是表示作为本实施方式的处理系统的训练系统1的结构的框图。

83.如图1所示,训练系统1基于被输入的感测数据10,输出对执行针对感测数据10的推论处理的推论模型进行了选择的推论模型(任务选择模型m1)。

84.训练系统1具备特征量提取部101、推论控制部102、合并部103、任务选择正解生成部104、任务选择模型训练部105和模型库30。训练系统1具备的各功能部可以通过处理器(例如cpu(central processing unit))(未图示)使用存储器执行规定的程序来实现。另外,训练系统1既可以作为1个装置实现,也可以由能够相互通信的多个装置实现。

85.特征量提取部101是使用特征量提取模型l1(第1推论模型)提取感测数据10的特征量(第1推论结果)的功能部。特征量提取部101具体而言,通过将被输入的感测数据10输入到特征量提取模型l1中,提取感测数据10的特征量。例如,特征量也可以是特征地图。生成的特征地图被提供给推论控制部102。特征量提取模型例如是被进行训练以将被输入的数据的特征地图输出的神经网络模型。

86.感测数据10例如是图像数据。另外,以下以感测数据10是图像数据的情况为例进行说明,但并不限于此。感测数据10除了上述以外,也可以使用从麦克风输出的声音数据、从lidar(light detection and ranging,激光探测与测距)等的雷达输出的点群数据、从压力传感器输出的压力数据、从温度传感器或湿度传感器输出的温度数据或湿度数据、或从气味传感器输出的气味数据等那样的能够取得正解数据的感测数据10。

87.推论控制部102是对基于使用1个以上的任务用推论模型(第2推论模型)的以特征地图为输入的推论处理的推论进行控制的功能部。任务用推论模型是基于被输入的特征地图,对在作为有关该特征地图的感测数据10的图像中包含的物体或人等的信息进行推论的模型,例如是神经网络模型。

88.推论控制部102从特征量提取部101取得特征地图。此外,推论控制部102使用模型库30保持的多个任务用推论模型执行推论处理。多个任务用推论模型包括执行各种各样的任务的任务用推论模型。这里,假设多个任务包括物体检测的任务a、姿势推断的任务b及属性判定的任务c而进行说明,但并不限定于此。

89.例如,物体检测的任务a是检测在作为被输入的感测数据10的图像中拍摄到的物体(例如,照明装置、搁架、抽屉、袋子等。可以包括人)的任务。例如,姿势推断的任务b是推断上述图像中拍摄到的人的姿势(例如,站立、伸腰、坐着等)的任务。例如,属性判定的任务c是判定上述图像中拍摄到的状况的属性(例如,场所是厨房,时段是早上等)的任务。

90.推论控制部102决定从多个任务中选择的1个以上的任务(也称作任务集)。推论控制部102还从多个任务中选择并决定至少一部分与上述任务集不同的新的任务集。这样,推论控制部102决定多个任务集。推论控制部102也可以作为上述多个任务集而决定能够从多个任务中选择的全部的任务集。

91.推论控制部102向分别执行从所决定的多个任务集中选择的任务集中包含的任务的任务用推论模型分别输入特征地图,执行推论处理。推论控制部102通过由合并部103将上述任务用推论模型分别输出的推论结果(第2推论结果)合并,取得合并信息。推论控制部102对于所决定的多个任务集取得合并信息。

92.合并部103是基于1个以上的推论结果执行合并处理并输出合并信息的功能部。换

言之,合并部103在被输入了1个以上的推论结果的情况下,生成将被输入的1个以上的推论结果合并的1个合并信息。合并部103作为1个以上的推论结果,取得由模型库30保持的1个以上的任务用推论模型推论出的结果。在合并信息中,包括任务集和表示根据感测数据10推断的状况(或行动)及其状况的推断的似然度的得分的组。在存在多个状况的情况下,在合并信息中包含多个状况及得分的组。另外,在任务集中包含的任务仅为1个的情况下,合并部103生成包含执行该1个任务的任务用推论模型输出的推论结果的合并信息。合并部103可以由神经网络模型实现。具体而言,合并部103可以由被进行训练以使得如果被输入了被输入的1个以上的推论结果则输出表示任务集和状况及得分的组的合并信息的神经网络模型实现。推论控制部102将所生成的合并信息向任务选择正解生成部104提供。另外,这里对合并部103的合并处理是解分类问题的处理(换言之,合并信息中包含的状况是分类结果)的例子进行说明,但并不限定于此。例如,合并部103的处理也可以是解后述的回归问题、物体检测问题等的处理。此外,在合并部103仅对单一的状况进行处理的情况下,合并信息也可以不包含状况。另外,合并部103的合并处理也可以由机器学习模型进行。

93.这里,使用图2对合并信息的生成具体地进行说明。图2是表示被输入到本实施方式的训练系统1中的图像的一例的说明图。

94.如图2所示,被输入到训练系统1中的图像20是拍摄有人进行作业的景象的图像。

95.具体而言,图像20是拍摄有人站立在住宅内的系统厨房中的景象的图像。在系统厨房的顶棚附近存在有门的搁架。在系统厨房的操作台上放置有袋子。人将厨房的顶棚附近的搁架的门打开,将物品收纳在该搁架中。

96.例如,如果对图像20执行由物体检测的任务a进行的检测处理,则能够检测到人、搁架、门等。如果对图像20执行由姿势推断的任务b进行的推断处理,则能够推断出人正在站立、或人正在伸腰等。如果对图像20执行由属性判定的任务c进行的判定处理,则能够判定出场所是厨房等。

97.在将上述那样的任务a、b及c的处理结果合并的情况下,例如生成包括任务a、b及c的集合,“在厨房中人伸腰而要将物品取出”的状况,以及与该状况建立了对应的得分90的合并信息。此外,在将上述那样的任务a、b的处理结果合并的情况下,生成包含任务a及b的集合,“人站立而要将物品收纳到搁架上”的状况,以及与该状况建立了对应的得分60的合并信息。

98.任务选择正解生成部104是生成在任务选择模型的训练中使用的正解数据(以下,也称作任务选择正解数据,或作为上位概念也称作模型选择信息的正解数据)的功能部。任务选择正解数据是用来对任务选择模型进行训练以使其选择模型库30保持的模型所涉及的多个任务中的、应对被输入到特征量提取部101中的感测数据10应执行的任务的正解数据(参照数据)。任务选择正解生成部104从推论控制部102取得合并信息,基于所取得的合并信息生成任务选择正解数据。具体而言,任务选择正解生成部104基于合并信息中包含的任务集和得分,生成任务选择正解数据。在合并信息中包含多个状况的情况下,从合并信息分别取得任务集以及与相同的状况建立了对应的得分(以下,也称作任务集和得分的组),基于所取得的多个任务集和得分的组,生成任务选择正解数据。在合并信息中包含单一的状况的情况下,基于多个合并信息各自中包含的任务集和得分的组,生成任务选择正解数据。

99.例如生成任务选择正解数据,以使执行至少贡献于1个第2推论结果的任务的任务用推论模型优先地包含在训练用模型选择信息表示的至少1个任务用推论模型中。更具体地讲,生成任务选择正解数据,以使执行属于基于至少1个任务用推论模型的推论结果的得分比阈值高的任务集的任务的任务用推论模型优先地包含在上述至少1个任务用推论模型中。

100.图3是表示本实施方式的任务集和得分的组的一例的说明图。图3例示取得与特定的状况建立了对应的任务集和得分的组的情况。

101.图3所示的最上方的组表示任务集a、b及c,以及对于通过由合并部103将通过向执行该任务集中包含的各个任务的任务用推论模型输入特征地图而输出的推论结果合并所得到的状况的得分90。

102.同样,图3所示的上起第二组表示任务集a及b,以及对于关于该任务集的状况的得分85。

103.同样,图3所示的上起第三组表示任务集a,以及对于关于该任务集的规定的状况的得分60。

104.任务选择正解生成部104从上述那样的多个任务集和得分的组中,按照得分的高低(即按照对于第2推论结果的贡献度)选择组,基于所选择的组的任务集来生成任务选择正解数据。

105.例如,从图3所示的得分为80以上的最上方和上起第二个的组的任务集,生成表示共通的任务a及b是应被选择的任务的任务选择正解数据。

106.另外,进而在合并信息中包含多个状况的情况下,也可以基于与和对感测数据10预先定义的状况(即状况的正解数据)一致的状况建立对应的任务集得分的组来生成任务选择正解数据。例如,在将任务a、b及c各自的推论结果合并而得到“在厨房中人伸腰要将物品取出”的状况和得分90的组合,将任务a及b各自的推论结果合并而得到“人站立要将物品收纳到搁架上”的状况和得分60的组合的情况下,当对于感测数据10预先定义的状况是“在厨房中人伸腰要将物品取出”时,取得包含任务a、b及c的任务集和得分90的组。

107.任务选择正解数据被按照任务选择模型的输出形式生成。换言之,任务选择正解数据被按照任务选择模型输出的模型选择信息的形式生成。

108.模型选择信息是表示以特征地图为输入而执行推论处理的至少1个任务用推论模型的信息。模型选择信息是用来确定任务用推论模型的信息,包含对应于任务的第1信息。例如,第1信息也可以是表示任务的信息,确定执行第1信息表示的任务的模型。

109.任务选择正解生成部104将所生成的任务选择正解数据和感测数据的组作为训练数据,向任务选择模型训练部105提供。

110.图4是表示本实施方式的训练数据的第一例的说明图。图4所示的训练数据包括感测数据、以及基于图3所示的任务集和得分的组生成的任务选择正解数据。

111.如图4所示,在训练数据中,建立对应而包括感测数据和作为模型选择信息的正解数据的任务选择正解数据。感测数据例如是被输入到训练系统1中的图像20,是在生成模型选择信息的正解数据时使用的感测数据。模型选择信息的正解数据是由任务选择正解生成部104使用上述感测数据生成的正解数据。

112.具体而言,在图4中建立对应而包括作为感测数据的图像20和作为模型选择信息

的正解数据的信息“a:1b:1c:0”。这意味着,在进行对于图像20的处理的任务中包括任务a及b并且不包括任务c。这里,模型选择信息以将在进行对于图像20的处理的任务中包括的任务用“1”表现、将在进行对于图像20的处理的任务中不包括的任务用“0”表现这样的形式被表现。当然,模型选择信息的形式并不限定于此。

113.任务选择模型训练部105是对任务选择模型m1进行训练的功能部。任务选择模型训练部105取得任务选择正解生成部104生成的训练数据,此外作为训练数据中包含的感测数据的特征量而从特征量提取部101取得特征地图。任务选择模型训练部105将所取得的特征地图输入到任务选择模型m1中,作为训练用模型选择信息而取得模型选择信息。并且,任务选择模型训练部105通过以任务选择正解数据为参照数据、以模型选择信息为输出数据的机器学习,对任务选择模型m1进行训练并输出。

114.任务选择模型m1是基于通过向模型库30保持的多个任务用推论模型中的至少1个任务用推论模型输入特征地图而得到的至少1个推论结果,和通过向任务选择模型m1输入特征地图而得到的模型选择信息,利用机器学习被训练的模型。任务选择模型m1例如是神经网络模型,是第3推论模型的一例。

115.具体而言,任务选择模型训练部105使用图4所示的训练数据对任务选择模型m1进行训练,以使得当训练数据中包含的感测数据被输入到训练系统1中时,任务选择模型m1输出在训练数据中与该感测数据建立了对应的模型选择信息的正解数据。例如,任务选择模型m1的训练,可以通过用损失函数计算将由特征量提取部101从感测数据提取出的特征地图输入到任务选择模型m1中的情况下输出的模型选择信息与训练数据中包含的模型选择信息的正解数据的差,调整任务选择模型m1中包含的参数以使该差变小来进行。

116.将如以上这样由训练系统1训练后的任务选择模型m1提供给推论系统2,用于感测数据的推论处理。

117.以下,对于如以上这样构成的训练系统1执行的处理进行说明。

118.图5是表示本实施方式的训练系统1执行的处理的流程图。

119.在步骤s1001中,特征量提取部101取得感测数据10。

120.在步骤s1002中,特征量提取部101通过进行提取在步骤s1001中取得的感测数据10的特征量的处理,取得感测数据10的特征地图。

121.在步骤s1003中,推论控制部102决定执行对于在步骤s1002中取得的特征地图的推论处理的任务集。此时,推论控制部102决定至少一部分不同的多个任务集。

122.在步骤s1004中,推论控制部102使用执行分别属于在步骤s1003中决定的多个任务集中的任务的模型,执行推论处理。

123.在步骤s1005中,合并部103通过将表示使用在步骤s1004中执行分别属于多个任务集的任务的模型执行的推论处理的结果的推论结果合并,生成合并信息。

124.在步骤s1006中,任务选择正解生成部104基于在步骤s1005中生成的合并信息,生成任务选择正解数据。

125.在步骤s1007中,任务选择模型训练部105通过使用在步骤s1006中生成的任务选择正解数据进行机器学习,对任务选择模型m1进行训练。

126.通过图5所示的一系列的处理,训练系统1对任务选择模型m1进行训练。训练系统1将训练后的任务选择模型m1提供给推论系统2。

127.(1-2)推论系统2

128.接着,对推论系统2进行说明。另外,关于与训练系统1的结构实质上相同的结构省略说明。

129.图6是表示本实施方式的推论系统2的功能结构的框图。

130.如图6所示,推论系统2基于被输入的感测数据10选择推论模型,通过所选择的推论模型执行对于感测数据10的推论处理。

131.如图6所示,推论系统2具备特征量提取部201、推论控制部202、任务选择部208、模型选择部210和模型库30。

132.特征量提取部201是使用特征量提取模型l1提取感测数据10的特征量的功能部。特征量提取部201是与训练系统1具备的特征量提取部101相同的功能部。特征量提取部201生成表示被输入的感测数据10的特征的特征地图,将所生成的特征地图提供给推论控制部202、任务选择部208。

133.推论控制部202是从特征量提取部201取得特征地图,对所取得的特征地图通过由模型选择部210选择的任务用推论模型执行推论处理的功能部。推论控制部202输出表示上述推论处理的结果的结果信息50。推论控制部202在执行上述推论处理之前,使由模型选择部210选择的任务用推论模型工作,使用工作的任务用推论模型执行上述推论处理。推论控制部202在执行上述推论处理时,仅使被保持的任务用推论模型中的由模型选择部210选择的任务用推论模型工作。不使未由模型选择部210选择的任务用推论模型工作。结果信息50相当于第2推论结果。

134.任务选择部208是选择推论控制部202在推论处理的执行中使用的任务用推论模型的任务的功能部。任务选择部208取得并保持训练系统1训练过的任务选择模型m1。任务选择部208从特征量提取部201取得特征地图,使用任务选择模型m1,生成确定执行应对该特征地图执行的任务的模型的模型选择信息,将模型选择信息提供给模型选择部210。

135.模型选择部210是选择推论控制部202在推论处理的执行中使用的任务用推论模型的功能部。

136.模型选择部210取得任务选择部208所生成的模型选择信息。接着,模型选择部210按照所取得的上述模型选择信息,从模型库30中选择任务用推论模型,提供给推论控制部202。具体而言,模型选择部210根据模型选择信息中包含的第1信息确定任务,选择执行所确定的任务的任务用推论模型。

137.另外,模型选择部210也可以还取得使推论系统2工作的硬件、特别是使推论控制部202工作的硬件的设备信息40,将所取得的设备信息40与上述模型选择信息一起考虑,从模型库30中选择任务用推论模型。设备信息40是包括静态的计算资源的量、当前或将来的计算资源的空闲状况等的信息。例如,在使推论控制部202工作的硬件具备的cpu或存储器的规格比较低的情况下,也可以从模型库30中取得具有比由模型选择信息表示的任务用推论模型的性能低的性能的任务用推论模型。

138.模型选择部210在考虑设备信息40而选择任务用推论模型的情况下,基于表示作为工作条件的任务用推论模型的性能的信息和设备信息40,决定可工作的任务用推论模型的计算量的上限。并且,模型选择部210在执行按照模型选择信息确定的任务的任务用推论模型中,选择上述计算量为上限以下的任务用推论模型。

139.模型库30是保持推论控制部202能够在推论处理的执行中使用的任务用推论模型的库。

140.另外,特征量提取部201相当于通过将感测数据输入到第1推论模型中、从上述第1推论模型取得对于感测数据的第1推论结果的第1取得部。

141.任务选择部208相当于通过将第1推论结果输入到第3推论模型中、从第3推论模型取得表示从多个第2推论模型中选择的至少1个第2推论模型的模型选择信息的第2取得部。

142.推论控制部202相当于通过将第1推论结果输入到模型选择信息表示的至少1个第2推论模型中、从第2推论模型取得对于第1推论结果的至少1个第2推论结果的第3取得部,以及输出至少1个第2推论结果的输出部。

143.以下,对如以上那样构成的推论系统2执行的处理进行说明。

144.图7是表示实施方式的推论系统2执行的处理的流程图。

145.在步骤s2001中,特征量提取部201取得感测数据10。

146.在步骤s2002中,特征量提取部201通过进行提取在步骤s2001中取得的感测数据10的特征量的处理,取得感测数据10的特征地图。

147.在步骤s2003中,任务选择部208取得在步骤s2002中取得的特征地图,通过将所取得的特征地图输入到任务选择模型m1中,取得输出的模型选择信息。

148.在步骤s2004中,模型选择部210在模型库30保持的任务用推论模型中,选择由在步骤s2003中生成的模型选择信息表示的任务用推论模型,提供给推论控制部102。

149.在步骤s2005中,推论控制部202通过将从特征量提取部201提供的特征地图输入到从模型选择部210提供的任务用推论模型中,执行推论处理,取得推论结果。推论控制部202将所取得的推论结果输出。

150.通过图7所示的一系列的处理,推论系统2能够使适合于对于感测数据10的推论处理的推论模型工作而执行推论处理。此时,推论系统2由于不使适合于对于感测数据10的推论处理的推论模型以外的推论模型工作,所以能够削减使用的计算资源或耗电。

151.(实施方式2)

152.在本实施方式中,代替实施方式1的任务选择模型而对性能选择模型进行训练,使用性能选择模型的输出结果,选择在关于感测数据的推论处理中使用的推论模型。另外,关于与实施方式1的结构实质上相同的结构省略说明。

153.(2-1)训练系统1

154.图8是表示作为本实施方式的处理系统的训练系统1的结构的框图。

155.如图8所示,训练系统1基于被输入的感测数据10,输出对执行针对感测数据10的推论处理的推论模型进行了选择的推论模型(性能选择模型m2)。

156.训练系统1具备特征量提取部301、推论控制部302、合并部303,性能选择正解生成部306、性能选择模型训练部307和模型库30。

157.特征量提取部301使用特征量提取模型l3,基于感测数据10生成特征地图。

158.推论控制部302基于所生成的特征地图,对使用由模型库30管理的任务用推论模型的推论处理进行控制。模型库30具有的多个任务用推论模型包括执行各种各样的任务的任务用推论模型,此外包括具有各种各样的性能的模型。例如,包括执行相同任务、性能相互不同的任务用推论模型。例如,“模型a1”是执行任务a的模型,是性能相对较低的模型。此

外,“模型b2”是执行任务b的模型,是性能相对为中等程度的模型。这里,将任务用推论模型的性能用1(低)、2(中等)及3(高)的3个等级表现,但并不限定于此。

159.推论控制部302对性能不同的任务用推论模型的至少1个分别输入特征地图,执行推论处理。例如,推论控制部302对执行物体检测的任务的任务用推论模型a1~a3、b1~b3及c1~c3分别输入特征地图,取得推论结果。推论结果各自可能例如物体的位置、大小、似然度等不同。另外,也可以仅对不同性能的任务用推论模型中的特定的性能的1个(例如仅对性能为中等的任务用推论模型)执行推论处理,也可以对不同性能的任务用推论模型中的全部执行推论处理。

160.合并部303基于关于各任务的1个以上的推论结果,生成合并信息。在本实施方式中,与实施方式1不同,由于不选择任务,所以合并信息包括状况及得分的组。合并部303关于各任务,选择不同性能的任务用推论模型的推论结果中的1个,基于所选择的推论结果生成合并信息。关于合并信息的生成,与实施方式1是同样的。另外,也可以仅对于不同性能的任务用推论模型的推论结果中的特定的性能的1个生成合并信息,也可以对于不同性能的任务用推论模型的推论结果中的全部生成合并信息。在后者的情况下,在合并信息中包括性能的组合(以下称作性能集合)。此外,在任务是1个的情况下,在合并信息中也可以代替状况而包括推论结果。

161.性能选择正解生成部306是生成在性能选择模型m2的训练中使用的正解数据(以下,也称作性能选择正解数据,或作为上位概念也称作模型选择信息的正解数据)的功能部。性能选择正解数据是用来对性能选择模型m2进行训练、以使其作为执行对于被输入到特征量提取部301中的感测数据10的推论处理的模型而选择具有适当的性能的模型的正解数据(参照数据)。性能选择正解生成部306从合并部303取得合并信息,基于所取得的合并信息,生成确定对推论处理要求的性能的数据,作为性能选择正解数据。

162.具体而言,性能选择正解生成部306合并信息越好则生成确定越低的性能的性能选择正解数据,合并信息越差则生成确定越高的性能的性能选择正解数据。合并信息是否良好的评价,既可以基于与合并信息的正解数据(例如,对于感测数据10预先定义的正解数据)的比较进行,也可以基于合并信息的内容进行。关于详细情况在后面叙述。性能选择正解生成部306将所生成的性能选择正解数据提供给性能选择模型训练部307。

163.生成性能选择正解数据,以使例如满足至少1个第2推论结果的性能要求的任务用推论模型优先地包含在训练用模型选择信息表示的至少1个任务用推论模型中。更具体地讲,生成性能选择正解数据,以使具有与任务用推论模型的处理的难度对应的性能的任务用推论模型优先地包含在训练用模型选择信息表示的至少1个任务用推论模型中。

164.性能选择正解数据按照性能选择模型m2的输出规定的形式而生成。换言之,性能选择正解数据按照性能选择模型m2输出的模型选择信息的形式生成。

165.模型选择信息是表示以特征地图为输入、执行推论处理的至少1个任务用推论模型的信息。模型选择信息是用来确定任务用推论模型的信息,包含与任务用推论模型的性能对应的第2信息。第2信息例如是表示任务用推论模型的性能的信息。具体而言,表示性能的信息也可以是任务用推论模型的处理的精度、或表示模型的处理的速度的信息、或它们的至少1个的得分。此外,表示性能的信息也可以包括表示神经网络模型的尺寸的尺寸信息。尺寸信息也可以包括神经网络模型的节点数、分支数或层数等。

166.此外,第2信息例如也可以是表示任务用推论模型的处理的难度的信息。按照该难度,由后述的模型选择部410选择与该难度对应的性能的任务用推论模型。表示难度的信息是表示处理的困难或容易的程度的信息。这里,“处理较困难”是指对该处理要求的精度较高,或对该处理要求的计算量较多等。难度既可以用离散值(0或1等)表现,也可以用连续值(0~1等)表现。

167.这里,对于性能选择正解数据的生成详细地进行说明。另外,在合并信息包含推论结果的情况下,将合并处理替换为推论处理而解释。

168.例如,在合并处理是解分类问题的处理的情况下,既可以在弄错了分类(即分类结果与正解数据不一致)时设定为难度较高,也可以在多个类别的似然度的至少一部分相互接近时设定为难度较高。另外,在后者中不能使用正解数据。

169.此外,在合并处理是解回归问题的处理的情况下,既可以按照合并信息与正解数据的差来设定难度,也可以将上述差原样设定为难度。此外,也可以在上述差超过了一定的阈值的情况下设定为难度较高。另外,上述的差既可以单单通过减法来计算,也可以通过以减法结果为输入的任意的函数来计算。

170.此外,在合并处理是解物体检测问题、即对于某个检测框的分类问题(将框分类的问题)和回归问题(决定框的坐标的问题)的组合的问题的处理的情况下,难度也可以组合使用上述的“分类问题”和“回归问题”的设定方法。此时,回归问题部分也可以以从1减去正解框与检测框的重合率(iou:intersection over union)所得的值(1-iou)为难度。此外,物体检测问题的难度也可以是将分类问题的难度与回归问题的难度一次结合的值、或相乘的值。

171.另外,在合并信息是多个的情况下,性能选择正解生成部306也可以计算各合并信息的难度,将计算出的难度分别合并来设定1个难度。例如,也可以在合并信息中包含的状况与对感测数据10预先定义的状况(即状况的正解数据)一致的情况下进行计数,根据计数的大小来设定难度。例如,也可以计数数越多(即一致数越多)则生成表示难度越低(即性能越低)的性能选择正解数据。此外,也可以计数数越少(即一致数越少)则生成表示难度越高(即性能越高)的性能选择正解数据。

172.性能选择正解生成部306将所生成的性能选择正解数据和感测数据的组作为训练数据,提供给性能选择模型训练部307。

173.图9是表示本实施方式的训练数据的例子的说明图。图9所示的训练数据包括感测数据和基于推论结果生成的性能选择正解数据。

174.具体而言,在图9中,建立对应而包括作为感测数据的图像20和作为模型选择信息的正解数据的信息“3”。这意味着要求进行对于图像20的处理的任务用推论模型的性能为“高”。这里,模型选择信息以将对进行对于图像20的处理的任务用推论模型要求的性能(或难度)用1(低)、2(中等)、3(高)的3个等级表现这样的形式来表现。当然,模型选择信息的形式并不限定于此。

175.性能选择模型训练部307是生成性能选择模型m2的功能部。性能选择模型训练部307取得性能选择正解生成部306所生成的性能选择正解数据,此外作为训练数据中包含的感测数据的特征量而从特征量提取部301取得特征地图。性能选择模型训练部307将所取得的特征地图输入到性能选择模型m2中,作为训练用模型选择信息而取得模型选择信息。接

着,性能选择模型训练部307通过以性能选择正解数据为参照数据、以模型选择信息为输出数据的机器学习,对性能选择模型m2进行训练并输出。性能选择模型m2是第3推论模型的一例。

176.性能选择模型训练部307使用图9所示的训练数据对性能选择模型m2进行训练,以使得当训练数据中包含的感测数据被输入到训练系统1中时,性能选择模型m2输出在训练数据中与该感测数据建立了对应的模型选择信息的正解数据。性能选择模型m2的训练,可以通过用损失函数计算在将由特征量提取部301从感测数据提取出的特征地图输入到性能选择模型m2中的情况下输出的模型选择信息与训练数据中包含的模型选择信息的正解数据的差,调整性能选择模型m2中包含的参数以使该差变小来进行。

177.将如以上这样由训练系统1训练后的性能选择模型m2提供给推论系统2,用于感测数据的推论处理。

178.以下,说明如以上这样构成的训练系统1执行的处理。

179.图10是表示本实施方式的训练系统1执行的处理的流程图。

180.在步骤s3001中,特征量提取部301取得感测数据10。

181.在步骤s3002中,特征量提取部301通过进行提取在步骤s3001中取得的感测数据10的特征量的处理,取得感测数据10的特征地图。

182.在步骤s3003中,推论控制部302将感测数据10输入到模型库30保持的性能分别不同的任务用推论模型中,执行推论处理。

183.在步骤s3004中,性能选择正解生成部306基于在步骤s3003中输出的推论结果,生成性能选择正解数据。

184.在步骤s3005中,性能选择模型训练部307通过使用在步骤s3004中生成的性能选择正解数据进行机器学习,对性能选择模型m2进行训练。

185.通过图10所示的一系列的处理,训练系统1对性能选择模型m2进行训练。训练系统1将训练后的性能选择模型m2提供给推论系统2。

186.(2-2)推论系统2

187.接着,对推论系统2进行说明。

188.图11是表示本实施方式的推论系统2的功能结构的框图。

189.如图11所示,推论系统2具备特征量提取部401、推论控制部402、性能选择部409、模型选择部410和模型库30。

190.特征量提取部401使用特征量提取模型l3生成表示被输入的感测数据10的特征的特征地图,将所生成的特征地图提供给推论控制部402、性能选择部409。

191.性能选择部409是选择推论控制部402在推论处理的执行中使用的任务用推论模型的性能的功能部。性能选择部409取得并保持训练系统1训练过的性能选择模型m2。性能选择部409从特征量提取部401取得特征地图,使用性能选择模型m2,生成确定应在对于该特征地图的推论处理中使用的任务用推论模型的性能的模型选择信息,提供给模型选择部410。

192.模型选择部410取得性能选择部409所生成的模型选择信息。接着,模型选择部410按照所取得的上述模型选择信息,从模型库30中选择任务用推论模型,提供给推论控制部402。具体而言,模型选择部410根据模型选择信息中包含的第2信息确定性能,选择具有所

确定的性能的任务用推论模型。

193.另外,模型选择部410也可以还将设备信息40与上述模型选择信息一起考虑,从模型库30中选择任务用推论模型。

194.模型选择部410在考虑设备信息40来选择任务用推论模型的情况下,基于作为工作条件的表示任务用推论模型的性能的信息和设备信息40,决定能够工作的任务用推论模型的计算量的上限。接着,模型选择部410在具有按照模型选择信息确定的性能的任务用推论模型中,选择上述计算量为上限以下的任务用推论模型。

195.以下,说明如以上那样构成的推论系统2执行的处理。

196.图12是表示实施方式的推论系统2执行的处理的流程图。

197.在步骤s4001中,特征量提取部401取得感测数据10。

198.在步骤s4002中,特征量提取部401通过进行提取在步骤s4001中所取得的感测数据10的特征量的处理,取得感测数据10的特征地图。

199.在步骤s4003中,性能选择部409取得在步骤s4002中所取得的特征地图,通过将所取得的特征地图输入到性能选择模型m2中,取得输出的模型选择信息。

200.在步骤s4004中,模型选择部410在模型库30保持的任务用推论模型中,选择由在步骤s4003中生成的模型选择信息表示的任务用推论模型,提供给推论控制部402。

201.在步骤s4005中,推论控制部402通过将从特征量提取部401提供的特征地图输入到从模型选择部410提供的任务用推论模型中,执行推论处理,取得推论结果。推论控制部402将所取得的推论结果输出。

202.通过图12所示的一系列的处理,推论系统2能够使适合于对于感测数据10的推论处理的推论模型工作而执行推论处理。此时,推论系统2由于不使适合于对于感测数据10的推论处理的推论模型以外的推论模型工作,所以能够削减使用的计算资源或耗电。

203.(实施方式3)

204.在本实施方式中,对实施方式1的任务选择模型及实施方式2的性能选择模型的两者进行训练,使用任务选择模型及性能选择模型的输出结果,选择在关于感测数据的推论处理中使用的推论模型。另外,关于与实施方式1或2的结构实质上相同的结构将说明简略化。

205.(3-1)训练系统1

206.图13是表示作为本实施方式的处理系统的训练系统1的结构的框图。

207.如图13所示,训练系统1基于被输入的感测数据10,输出对执行针对感测数据10的推论处理的推论模型进行了选择的推论模型(任务选择模型m1及性能选择模型m2)。

208.训练系统1具备特征量提取部501、推论控制部502、合并部503、任务选择正解生成部504、任务选择模型训练部505、性能选择正解生成部506和性能选择模型训练部507。

209.特征量提取部501使用特征量提取模型l5,基于感测数据10生成特征地图。

210.推论控制部502是分别执行从所决定的多个任务集中选择的任务集中包含的任务的任务用推论模型,将特征地图分别输入到性能不同的任务用推论模型的至少1个中,执行推论处理。

211.合并部503基于上述任务用推论模型分别输出的推论结果(第2推论结果),取得合并信息。在合并信息中,包括任务集和根据感测数据10推断的状况及表示该状况的推断的

似然度的得分的组。另外,在合并信息中也可以包括性能集合。

212.任务选择正解生成部504基于所生成的合并信息,生成任务选择正解数据。此外,任务选择正解生成部504基于所生成的任务选择正解数据,生成任务选择模型m1的训练数据。

213.任务选择模型训练部505使用所生成的训练数据,对任务选择模型m1进行训练。

214.性能选择正解生成部506基于所生成的合并信息,生成性能选择正解数据。具体而言,性能选择正解生成部506基于关于所生成的任务选择正解数据表示的任务集的合并信息,生成性能选择正解数据。例如,在任务选择正解数据表示的任务集是任务a、b及c的情况下,当生成性能为2(中等)的合并信息时,将作为将模型a2、模型b2及模型c2的推论结果分别合并后的结果的状况与状况的正解数据比较。例如,在状况与正解数据不一致的情况下,要求性能较高的任务用推论模型(换言之难度较高),生成表示3(高)的性能选择正解数据。此外,性能选择正解生成部506基于所生成的性能选择正解数据,生成性能选择模型m2的训练数据。另外,在上述中,假设在性能选择正解数据的生成中使用的合并信息是关于所生成的任务选择正解数据表示的任务集的合并信息,但并不限定于此,也可以是所生成的全部的合并信息。

215.性能选择模型训练部507使用所生成的训练数据,对性能选择模型m2进行训练。

216.将如以上这样由训练系统1训练后的任务选择模型m1及性能选择模型m2提供给推论系统2,用于感测数据的推论处理。

217.以下,说明如以上那样构成的训练系统1执行的处理。

218.图14是表示本实施方式的训练系统1执行的处理的流程图。

219.在步骤s5001中,特征量提取部501取得感测数据10。

220.在步骤s5002中,特征量提取部501通过进行提取在步骤s5001中所取得的感测数据10的特征量的处理,取得感测数据10的特征地图。

221.在步骤s5003中,推论控制部502决定执行对于在步骤s5002中所取得的特征地图的推论处理的任务集。此时,推论控制部502决定至少一部分不同的多个任务集。

222.在步骤s5004中,推论控制部502使用执行分别属于在步骤s5003中决定的多个任务集的任务的模型,执行推论处理。

223.在步骤s5005中,合并部503通过将表示在步骤s5004中使用分别属于多个任务集的任务的模型执行的推论处理的结果的推论结果合并,生成合并信息。

224.在步骤s5006中,任务选择正解生成部504基于在步骤s5005中生成的合并信息,生成任务选择正解数据。

225.在步骤s5007中,任务选择模型训练部105通过使用在步骤s5006中生成的任务选择正解数据进行机器学习,对任务选择模型m1进行训练。

226.在步骤s5008中,性能选择正解生成部506基于在步骤s5005中生成的合并信息和在步骤s5006中生成的任务选择正解数据,生成性能选择正解数据。

227.在步骤s5009中,性能选择模型训练部507通过使用在步骤s5008中生成的性能选择正解数据进行机器学习,对性能选择模型m2进行训练。

228.通过图14所示的一系列的处理,训练系统1对任务选择模型m1及性能选择模型m2进行训练。训练系统1将训练后的任务选择模型m1及性能选择模型m2提供给推论系统2。

229.(3-2)推论系统2

230.接着,对推论系统2进行说明。另外,关于与训练系统1的结构实质上相同的结构将说明简略化。

231.图15是表示本实施方式的推论系统2的功能结构的框图。

232.如图15所示,推论系统2具备特征量提取部601、推论控制部602、任务选择部608、性能选择部609、模型选择部610和模型库30。

233.特征量提取部601使用特征量提取模型l5生成表示被输入的感测数据10的特征的特征地图,将所生成的特征地图提供给推论控制部602、任务选择部608、性能选择部609。

234.模型选择部610取得任务选择部608所生成的模型选择信息(以下称作模型选择信息1)和性能选择部609所生成的模型选择信息(以下称作模型选择信息2)。接着,模型选择部610按照所取得的上述两个模型选择信息,从模型库30中选择任务用推论模型,提供给推论控制部602。具体而言,模型选择部610根据模型选择信息1中包含的第1信息确定任务,根据模型选择信息2中包含的第2信息确定性能。模型选择部610选择执行所确定的任务的所确定的性能的任务用推论模型。另外,模型选择信息也可以是1个,在此情况下,也可以在该1个模型选择信息中包含第1信息及第2信息。

235.另外,模型选择部610也可以还将设备信息40与上述两个模型选择信息一起考虑,从模型库30中选择任务用推论模型。

236.模型选择部610在考虑设备信息40而选择任务用推论模型的情况下,基于作为工作条件的表示任务用推论模型的性能的信息和设备信息40,决定能够工作的任务用推论模型的计算量的上限。接着,模型选择部610在执行按照模型选择信息1确定的任务、具有按照模型选择信息2确定的性能的任务用推论模型中,选择上述计算量为上限以下的任务用推论模型。

237.另外,模型选择部610在选择任务用推论模型时,关于以模型选择信息1、模型选择信息2及设备信息40的哪个为优先,可以有各种各样的样式。例如,也可以以设备信息40、模型选择信息1、模型选择信息2的顺序为优先,来选择任务用推论模型。

238.但是,优先顺序并不限定于上述,例如也可以是模型选择信息2、模型选择信息1、设备信息40的顺序,也可以是模型选择信息1、模型选择信息2、设备信息40的顺序。

239.以下,说明如以上那样构成的推论系统2执行的处理。

240.图16是表示实施方式的推论系统2执行的处理的流程图。

241.在步骤s6001中,特征量提取部601取得感测数据10。

242.在步骤s6002中,特征量提取部601通过进行提取在步骤s6001中所取得的感测数据10的特征量的处理,取得感测数据10的特征地图。

243.在步骤s6003中,任务选择部608取得在步骤s6002中所取得的特征地图,通过将所取得的特征地图输入到任务选择模型m1中,取得输出的模型选择信息1。

244.在步骤s6004中,性能选择部609取得在步骤s6002中所取得的特征地图,通过将所取得的特征地图输入到性能选择模型m2中,取得输出的模型选择信息2。

245.在步骤s6005中,模型选择部610在模型库30保持的任务用推论模型中,选择由在步骤s6003中生成的模型选择信息1及在步骤s6004中生成的模型选择信息2表示的任务用推论模型,提供给推论控制部602。

246.在步骤s6006中,推论控制部602通过将从特征量提取部601提供的特征地图输入到从模型选择部610提供的任务用推论模型中,执行推论处理,取得推论结果。推论控制部602将所取得的推论结果输出。

247.另外,步骤s6003及步骤s6004的处理的执行顺序也可以相反,也可以是同时并行。

248.通过图16所示的一系列的处理,推论系统2能够使适合于对于感测数据10的推论处理的推论模型工作而执行推论处理。此时,推论系统2由于不使适合于对于感测数据10的推论处理的推论模型以外的推论模型工作,所以能够削减使用的计算资源或耗电。

249.(实施方式4)

250.在本实施方式中,代替任务选择模型及性能选择模型,使用特征量提取模型的输出结果选择在关于感测数据的推论处理中使用的推论模型。另外,在本实施方式中,说明以任务及性能的两者的观点选择推论模型的例子,但也可以如实施方式1或2那样,以仅任务或仅性能的观点来选择推论模型。

251.(4-1)训练系统1

252.图17是表示作为本实施方式的处理系统的训练系统1的结构的框图。

253.如图17所示,训练系统1具备特征量提取部701、推论控制部702、合并部703、任务选择正解生成部704、性能选择正解生成部706和训练部711。

254.本实施方式的训练系统1在不具备实施方式3的任务选择模型训练部505和性能选择模型训练部507而代之具备训练部711这一点上与实施方式3的训练系统1不同。

255.此外,特征量提取部701在基于感测数据提取特征量这一点上与各实施方式相同,但在特征量的提取中使用的特征量提取模型不同。本实施方式的特征量提取模型m3通过输入感测数据,输出特征量和模型选择信息。另外,关于特征量提取模型m3的详细情况在后面叙述。

256.以下,以训练部711为中心进行说明。

257.训练部711是对特征量提取模型m3进行训练的功能部。训练部711取得任务选择正解生成部704所生成的任务选择正解数据和性能选择正解生成部706所生成的性能选择正解数据,此外取得感测数据10。训练部711将所取得的感测数据10输入到特征量提取模型m3中,作为训练用模型选择信息而取得模型选择信息。接着,训练部711通过以任务选择正解数据及性能选择正解数据为参照数据、以模型选择信息为输出数据的机器学习,对特征量提取模型m3进行训练并输出。这里,关于任务选择正解数据及性能选择正解数据,与实施方式3相同。

258.本实施方式的模型选择信息包含第1信息及第2信息。如上述那样,第1信息是对应于任务的信息,是用来确定任务的信息或用来确定执行任务的任务用推论模型的信息。此外,第2信息是对应于性能的信息,是用来确定性能的信息或用来确定具有性能的模型的信息。

259.特征量提取模型m3是基于通过将特征量提取模型m3输出的特征地图输入到模型库30保持的多个任务用推论模型中的至少1个任务用推论模型中而得到的至少1个推论结果(第2推论结果)和通过将感测数据10输入到特征量提取模型m3中而得到的模型选择信息,利用机器学习被训练后的模型。另外,特征量提取模型m3是第1推论模型的一例。

260.特征量提取模型m3如果被输入感测数据10,则将特征量和模型选择信息输出。具

体而言,特征量提取模型m3具备提取特征量的部分、以及如果被输入所提取出的特征量则输出模型选择信息的部分。例如,也可以将与向模型外部输出的特征量相同的特征量输入到将模型选择信息输出的部分中,也可以将不向模型外部输出的作为中间生成物的特征量(例如不是提取特征量的部分的最终层而是中间层输出的特征量)输入。

261.训练部711在使用任务选择正解数据及性能选择正解数据的特征量提取模型m3的训练中,将提取特征量的部分设为训练的对象外,仅将输出模型选择信息的部分设为训练的对象。例如,训练部711将提取特征量的部分的参数固定,将输出模型选择信息的部分的参数更新。另外,在提取特征量的部分的训练时同时对输出模型选择信息的部分进行训练的情况下,也可以将两者作为训练的对象而将参数更新。

262.以下,说明如以上那样构成的训练系统1执行的处理。

263.图18是表示本实施方式的训练系统1执行的处理的流程图。

264.主要说明训练系统1执行的处理中的与上述实施方式3的训练系统1执行的处理不同的部分。

265.图18所示的从步骤s7001到s7007的处理与上述实施方式3的训练系统1执行的从步骤s5001到s5006的处理以及步骤s5008的处理(参照图14)相同。

266.在步骤s7008中,训练部711通过使用在步骤s7006中生成的任务选择正解数据和在步骤s7007中生成的性能选择正解数据进行机器学习,对特征量提取模型m3进行训练。

267.通过图18所示的一系列的处理,训练系统1对特征量提取模型m3进行训练。训练系统1将训练后的特征量提取模型m3提供给推论系统2。

268.(4-2)推论系统2

269.图19是表示本实施方式的推论系统2的功能结构的框图。

270.如图19所示,推论系统2具备特征量提取部801、推论控制部802、模型选择部810和模型库30。

271.特征量提取部801是基于感测数据10输出特征量和模型选择信息的功能部。具体而言,特征量提取部801通过将感测数据10输入到特征量提取模型m3中,生成特征量和模型选择信息。模型选择信息包含确定任务及性能的信息。特征量提取部801将所生成的特征量(特征地图)提供给推论控制部802,将所生成的模型选择信息提供给模型选择部810。因而,特征量提取部801也可以说是同时拥有实施方式3的特征量提取部601、任务选择部608和性能选择部609的功能的功能部。

272.推论控制部802与实施方式3的推论控制部802同样,从特征量提取部801取得特征地图,通过将所取得的特征地图输入到由模型选择部810选择的任务用推论模型中而执行推论处理,将结果信息50(相当于第2推论结果)输出。

273.另外,特征量提取部801相当于通过将感测数据输入到第1推论模型中、从第1推论模型取得对于感测数据的第1推论结果和表示从多个第2推论模型中选择的至少1个第2推论模型的模型选择信息的第1取得部。

274.推论控制部802相当于通过将第1推论结果输入到模型选择信息表示的至少1个第2推论模型中、从第2推论模型取得对于第1推论结果的至少1个第2推论结果的第2取得部,以及将至少1个第2推论结果输出的输出部。

275.以下,说明如以上那样构成的推论系统2执行的处理。

276.图20是表示本实施方式的推论系统2执行的处理的流程图。

277.主要说明推论系统2执行的处理中的与上述实施方式3的推论系统2执行的处理不同的部分。

278.图20所示的步骤s8001的处理与上述实施方式3的推论系统2执行的步骤s6001的处理(参照图16)相同。

279.在步骤s8002中,特征量提取部801通过将在步骤s8001中取得的感测数据10输入到特征量提取模型m3中,生成特征地图及模型选择信息。

280.在步骤s8003中,模型选择部810在模型库30保持的任务用推论模型中,选择由在步骤s8003中生成的模型选择信息表示的任务用推论模型,提供给推论控制部802。

281.在步骤s8004中,推论控制部802通过将从特征量提取部801提供的特征地图输入到从模型选择部810提供的任务用推论模型中,执行推论处理,取得推论结果。推论控制部802将所取得的推论结果输出。

282.通过图20所示的一系列的处理,推论系统2能够使适合于对于感测数据10的推论处理的推论模型工作而执行推论处理。因此,本实施方式的推论系统2起到与上述实施方式3的推论系统2同样的效果。

283.(总结)

284.如以上这样,根据有关上述实施方式1至4的信息处理方法,由于使用从多个第2推论模型中选择的至少1个第2推论模型取得第2推论结果,所以在取得第2推论结果时,多个第2推论模型中的没有被选择的第2推论模型不工作。因此,能够削减没有被选择的第2推论模型的工作所需要的计算资源或电力。这样,上述信息处理方法在能够进行对于各种各样的推论对象的推论处理的同时,能够抑制该推论处理所花费的计算成本。此外,由于基于通过输入感测数据而得到的第1推论结果来选择第2推论模型,所以成为实质上基于该感测数据的特征来选择第2推论模型。因而,能够使适合于推论处理对象的数据的推论模型被选择的可能性提高。

285.此外,通过利用机器学习,能够比其他方法更容易地生成进行根据感测数据的特征选择第2推论模型这样的复杂的推论处理的第3推论模型。

286.此外,通过根据训练用第2推论结果生成遵循模型选择信息的形式的数据,能够不受训练用第2推论结果的形式的制约来对第3推论模型进行训练。换言之,能够对本公开的实施方式应用输出各种各样的第2推论结果的多种多样的第2推论模型。

287.此外,由于将执行贡献于至少1个第2推论结果的任务的第2推论模型优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够自动地生成将该做出贡献的选择执行任务的第2推论模型的模型选择信息输出的第3推论模型。此外,参照数据中包含的对于第3推论模型的训练有效的数据进一步变多,训练的效率提高。

288.此外,由于执行属于得分比阈值高的任务集的任务的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够使由第3推论模型实质上选择的第2推论模型得到的第2推论结果的精度或正确性等的水平接近于规定的基准。

289.此外,由于满足性能要求的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够自动地生成输出选择满足该性能要求的第2推论模型的模型选择信息的第3推论模型。此外,参照数据中包含的对于第3推论模型的训练有

效的数据变得更多,训练的效率提高。

290.此外,由于具有与难度对应的性能的第2推论模型优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够使由第3推论模型实质上选择的第2推论模型进行的推论处理的处理性能(换言之计算成本)接近于被要求的水平。

291.此外,由于作为第2推论模型的性能而使用神经网络的尺寸信息,所以能够更容易地调整第2推论模型的性能。

292.此外,由于使用从多个第2推论模型中选择的至少1个第2推论模型取得第2推论结果,所以在取得第2推论结果时,多个第2推论模型中的没有被选择的第2推论模型不工作。因此,能够削减没有被选择的第2推论模型的工作所需要的计算资源或电力。这样,上述信息处理方法在能够进行对于各种各样的推论对象的推论处理的同时,能够抑制该推论处理所花费的计算成本。此外,由于实质上基于感测数据选择第2推论模型,所以能够使适合于推论处理对象的数据的推论模型被选择的可能性提高。

293.此外,通过利用机器学习,能够将进行根据感测数据的特征选择第2推论模型这样的复杂的推论处理的推论模型作为第1推论模型也用其他的方法容易地生成。

294.此外,通过根据训练用第2推论结果生成遵循模型选择信息的形式的数据,能够受到训练用第2推论结果的形式的制约而对第1推论模型进行训练。换言之,能够将输出各种各样的第2推论结果的多种多样的第2推论模型应用于本公开的实施方式。

295.此外,由于执行对至少1个第2推论结果作出贡献的任务的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够自动地生成输出执行该作出贡献的任务的第2推论模型被选择的模型选择信息的第1推论模型。此外,参照数据中包含的对于第1推论模型的训练有效的数据变得更多,训练的效率提高。

296.此外,由于执行属于得分比阈值高的任务集的任务的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够使由第1推论模型实质上选择的第2推论模型得到的第2推论结果的精度或正确性等的水平接近于规定的基准。

297.此外,由于满足性能要求的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够自动地生成输出满足该性能要求的第2推论模型被选择的模型选择信息的第1推论模型。此外,参照数据中包含的对于第1推论模型的训练有效的数据变得更多,训练的效率提高。

298.此外,由于具有与难度对应的性能的第2推论模型被优先地包含在作为机器学习时的参照数据的训练用模型选择信息中,所以能够使由第1推论模型实质上选择的第2推论模型进行的推论处理的处理性能(换言之使计算成本)接近于被要求的水平。

299.此外,由于作为第2推论模型的性能而使用神经网络的尺寸信息,所以能够更容易地调整第2推论模型的性能。

300.另外,在上述实施方式及上述变形例中,各构成要素也可以由专用的硬件构成,或通过执行适合于各构成要素的软件程序来实现。各构成要素也可以通过cpu或处理器等的程序执行部将记录在硬盘或半导体存储器等的记录介质中的软件程序读出并执行来实现。这里,实现上述实施方式及上述变形例的信息处理装置等的软件是以下这样的程序。

301.即,该程序使计算机执行信息处理方法,所述信息处理方法是处理器使用存储器执行的信息处理方法,通过将感测数据输入到第1推论模型中,从上述第1推论模型取得对

于上述感测数据的第1推论结果;通过将上述第1推论结果输入到第3推论模型中,从上述第3推论模型取得表示从多个第2推论模型中选择的至少1个第2推论模型的模型选择信息;通过将上述第1推论结果输入到上述模型选择信息表示的上述至少1个第2推论模型中,从上述第2推论模型取得对于上述第1推论结果的至少1个第2推论结果;将上述至少1个第2推论结果输出。

302.此外,该程序使计算机执行信息处理方法,所述信息处理方法是处理器使用存储器执行的信息处理方法,通过将感测数据输入到第1推论模型中,从上述第1推论模型取得对于上述感测数据的第1推论结果、以及表示从多个第2推论模型中选择的至少1个第2推论模型的模型选择信息;通过将上述第1推论结果输入到上述模型选择信息表示的上述至少1个第2推论模型中,从上述第2推论模型取得对于上述第1推论结果的至少1个第2推论结果;将上述至少1个第2推论结果输出。

303.以上,基于实施方式对有关一个或多个技术方案的信息处理装置等进行了说明,但本发明并不限定于该实施方式。只要不脱离本发明的主旨,对本实施方式施以本领域技术人员想到的各种变形后的形态、或将不同实施方式的构成要素组合而构建的形态也可以也包含在一个或多个技术方案的范围内。

304.例如,在上述各实施方式中,说明了推论处理是物体检测、姿势推断、属性判定的例子,但并不限于此,也可以是场景推断、分段或到物体的距离的推断等。

305.此外,例如在上述各实施方式中,主要说明了第1信息是表示任务的信息的例子,但第1信息也可以是表示第2推论模型的信息。具体而言,也可以代替表示对至少1个训练用第2推论结果作出贡献的任务的信息,而将表示执行该任务的第2推论模型的信息包含在模型选择信息中。此外,也可以将表示输出对至少1个训练用第2推论结果作出贡献的第2推论结果的第2推论模型的信息包含在模型选择信息中。

306.产业上的可利用性

307.本发明能够用于进行行动识别的系统。

308.标号说明

309.1 训练系统

310.2 推论系统

311.10 感测数据

312.20 图像

313.30 模型库

314.40 设备信息

315.50 结果信息

316.101、201、301、401、501、601、701、801特征量提取部

317.102、202、302、402、502、602、702、802推论控制部

318.103、303、503、703合并部

319.104、504、704任务选择正解生成部

320.105、505 任务选择模型训练部

321.208、608任务选择部

322.210、410、610、810模型选择部

323.306、506、706性能选择正解生成部

324.307、507 性能选择模型训练部

325.409、609 性能选择部

326.711 训练部

327.l1、l3、l5、m3特征量提取模型

328.m1 任务选择模型

329.m2 性能选择模型

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1