人工智能的自动监控的制作方法

1.本发明涉及一种用于监控人工智能工作模型的监控器的监控器模型的自动化生成方法和装置。本发明还涉及一种相关的计算机程序产品和计算机可读介质。

背景技术:

2.神经网络是人工智能领域的一种流行技术,尤其用于有效地处理图像数据,并借助训练数据在系统运行时识别某些事物。在安全关键系统中使用这项技术的愿望也在增长。与传统的、基于规则的算法不同,神经网络的输出不是由开发人员在软件中实现的传统的、精确格式化的需求,而是由计算机通过设计时保存的测试数据学习的。

3.正如在传统算法中程序的解应符合要求一样,在神经网络或一般而言在人工智能算法中,结果应符合训练数据。严格地说,训练数据对应传统要求。监控器是一种流行的技术,用于在运行时检查复杂算法的局限性,并确保运行时的参数与要求中定义的操作参数相对应。

4.监控器是一种技术元素,通常是一种嵌入式系统,它使用非常简单的基于规则的算法来检查复杂系统在运行时的某些运行时间参数。这方面的一个例子是一个嵌入式系统,它检查另一个系统是否仍然处于激活状态或已经崩溃。

5.因此,以类似的方式为神经网络或一般的人工智能算法工作的监控器监控训练数据的遵从性。

6.到目前为止,一种传统的监控技术也被提出用于神经网络或其他人工智能算法中。与传统算法类似,可以检查运行时间参数是否遵从被ai算法计算的特定边界。然而,这种方法并没有太大的帮助,因为错误识别的路标和系统的相应反应很难用这种方法来区分,就像正确识别的路标的反应一样。

7.因此,到目前为止,人们一直试图特别关注高质量的训练数据。其他方法涉及基于ai的算法的形式验证,还有一些方法试图检测运行时图像数据的操作(英文:adversarial attacks对抗攻击)。

8.在chih-hong cheng,georg n

ü

hrenberg,hirotoshi yasuoka的《runtime monitoring neuron activation patterns》(https://arxiv.org/abs/1809.06573)中也可以找到一种监控器被开发用于,检查神经网络的决策是否基于训练数据。然而,在这种技术中,在对训练数据进行重新分析时,从神经网络中收集激活模式,然后在运行期间使用运行期间发生的模式的汉明距离来记录偏差。如果出现过高的偏差,监控器将向系统报告检测到的错误。

9.这种技术的主要问题是可扩展性差。作者给出了这样一种具有200个神经元的二元决策树的基于汉明距离的方法目前的技术可行性。在主要处理图像数据的深度学习领域,该神经元的数量被迅速超过。例如,alexnet有大约65万个神经元。此外,从检测到的模式到经过存储的模式的微小偏差是允许的,但是这调整是一个手动的任务。

技术实现要素:

10.本发明的目的是给出一种解决方案,用于改进对人工智能算法、例如人工神经网络的工作模型的监控。

11.本发明从独立权利要求的特征得出。有利的改进方案和设计是从属权利的技术内容。本发明的进一步特征、应用可能性和优点来自以下描述。

12.在本发明的一个方面,提出全自动生成用于人工神经网络或其它人工智能算法的监控器。

13.在这种技术中,与上述方法不同的是,有效激活模式或激活路径的数量不再传统地存储和手动调整,而是自动学习。

14.第一神经网络借助于模型从输入值的集合产生输出,这被称为工作模型。此外设置第二神经网络,即监控器模型,其输入值是第一神经网络的工作模型的所有神经元的激活函数的输出。备选地,可以选择基于ai的算法的任何其他代表性数据集,其表示给定数据组的分类。

15.监控器模型是由此来训练的:工作模型在完成训练后再次运行其训练数据用于分析。在这个过程中,监控器模型被训练,并以这种方式学习工作模型所能达到的所有“良好模式”。由于训练好的第二神经网络也学习激活模式的差异(varianz),因此在这个过程中会自动产生轻微偏差的公差。

16.本发明要求保护一种自动或计算机实现的生成用于监控人工智能工作模型的监控器的监控器模型的方法,

[0017]-其中通过工作模型执行输入数据的分类,

[0018]-并且使用工作模型的代表性数据集训练监控器模型。

[0019]

监控器模型可以被看作是工作模型的“超我”或“良心”。本发明的优点是,可以检测出在人工智能运行中的故障。

[0020]

监控器具有人工第一神经网络,代表性的数据集作为用于第一神经网络的输入。

[0021]

人工智能具有人工第二神经网络,其中,代表性数据集由第二神经网络神经元的激活函数的输出形成。

[0022]

在另一种形式中,可以通过将训练数据再次输入到已用训练数据完成训练的工作模型中进行分析、并且工作模型被运行训练监控器模型,其中,监控器模型学习工作模型可以实现的有效的激活模式和/或激活路径的集合。

[0023]

因此,监控器模型学习所有的“工作模型良好模式”。

[0024]

本发明还要求保护一种装置,其具有人工智能和监控人工智能工作模型的监控器,

[0025]-其中,所述人工智能被设置为通过所述工作模型对输入数据进行分类,

[0026]-并且利用所述工作模型的代表性数据集训练所述监控器的监控器模型。

[0027]

例如,装置可以是计算机。

[0028]

监控器具有人工的第一神经网络,用于第一神经网络的输入由代表性数据集形成。

[0029]

人工智能具有人工的第二神经网络,代表性数据集由第二神经网络神经元的激活函数的输出形成。

[0030]

在改进方案中,装置可以通过将训练数据再次输入到用训练数据训练完成的工作模型中进行分析并执行工作模型来训练监控器模型,其中监控器模型学习工作模型可以达到的有效的激活模式和/或激活路径的集合。

[0031]

本发明还要求保护一种计算机程序产品,包括计算机程序,其中计算机程序可加载到装置的存储装置中,当在装置上执行计算机程序时,该计算机程序用于执行本发明方法的步骤。

[0032]

本发明最后要求一种计算机可读介质,其上存储有计算机程序,其中计算机程序可加载到装置的存储装置中,其中当计算机程序在装置上执行时,该计算机程序用于执行本发明方法的步骤。

[0033]

本发明的进一步特征和优点从基于两个示意图的实施例的以下解释中得出。

附图说明

[0034]

在附图中:

[0035]

图1示出具有神经网络的实施例的框图和

[0036]

图2示出用于生成用于监控人工智能工作模型的监控器的监控器模型的自动化方法的流程图。

具体实施方式

[0037]

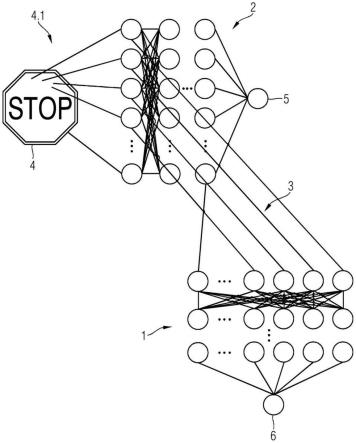

图1显示了具有神经网络和图像识别的实施例的框图。借助例如1000个停止标志4的图像训练第二神经网络2。通常假定像素4.1的集合作为输入矢量。作为第二神经网络2的输出5生成作为1和0之间的数字的概率,该数字指示给定图像(像素4.1集合)被认为代表停止标志4的概率有多高。

[0038]

现在使用1000个图像的训练集来训练第二神经网络2,即它的工作模型。工作模型训练完毕后,训练第一神经网络1的监控器模型,即监控器。工作模型再次分析1000个图像4.1或其代表性部分,监控器模型学习第二神经网络2的激活模式(=第二神经网络2的神经元的激活函数的输出)。

[0039]

在训练了工作模型和监控器模型之后,具有第一神经网络1和第二神经网络2的系统可用于检测停止标志4。现在,如果不包含停止标志4的图像被工作模型错误地识别为停止标志4,则当基于先前由监控器模型学习的激活模式3将分类归类为非典型并且因此表示工作模型偏离其要求时,该错误分类被第一神经网络1的监控器模型识别的概率很高。错误信息由第一神经网络1的输出6提供。因此,监控器模型也可以形象地描述为工作模型的“超我”或“良心”。

[0040]

图2示出了用于生成用于监控人工智能工作模型的监控器的监控器模型的自动化方法的流程图,例如作为监控器的第一神经网络1和作为人工智能的第二神经网络2。

[0041]

在第一步骤101中,以训练数据作为输入数据(例如对象的图像数据4.1)训练第二神经网络2。在第二步102中,选择训练数据的代表性数据集。在第三步骤103中,第二神经网络2及其工作模型利用代表数据集再次被运行,并且使用第二神经网络2的神经元的激活函数(=激活模式和/或激活路径)的输出训练第一神经网络1的监控器模型。这使得监控模型能够在工作模型运行时监控工作模型并检测错误。

[0042]

虽然本发明已由实施例更详细地说明和描述,但本发明不受所公开的实施例的限制,并且本领域技术人员可以从中推导出其他变体,而不脱离本发明的保护范围。

[0043]

附图标记清单

[0044]

1第一神经网络(监控器)

[0045]

2第二神经网络

[0046]

3第二神经网络2的神经元激活函数的输出

[0047]

4停止标志

[0048]

4.1像素的集合

[0049]

5第二神经网络的输出

[0050]

6第一神经网络的输出

[0051]

101第一步:工作模式的训练

[0052]

102第二步:选择具有代表性的数据集

[0053]

103第三步:训练监控器模型

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1