一种基于黑盒攻击的人脸对抗样本生成方法

1.本发明涉及一种样本生成方法,特别涉及一种基于黑盒攻击的人脸对抗样本生成方法。

背景技术:

2.随着人工智能技术的日益成熟,人和机器的界限开始变得模糊。尤其是深度神经网络在机器学习领域的许多任务中取得了巨大的成功,像人脸识别、图像识别及分类、语音识别、自动驾驶等。目前深度神经网络模型成为了解决视觉识别、监视、无人机和机器人这些任务的首要方案,但这些技术往往会产生一些安全问题,所以深度神经网络模型是否健壮在这些领域至关重要。

3.目前在该领域的研究可分为针对神经网络的攻击和防御两方面。攻击即研究如何构造或生成对抗样本来欺骗神经网络,防御即采取某些手段将对抗样本恢复为可被正确识别的输人数据或者训练不受对抗样本干扰的具有更加鲁棒性的神经网络。对于神经网络的攻击通常可根据威胁模型的不同分为白盒攻击和黑盒攻击。白盒攻击需要攻击者完全掌握目标模型的所有的内部结构和训练参数等,黑盒攻击则对目标模型的内部结构一无所知,只能通过观察模型的输入输出来生成对抗样本。如今白盒攻击算法很多且成功率极高,人们却很少去关注更贴近现实场景的黑盒攻击算法。可现实生活中很多系统的保密程度非常很可靠,几乎没有模型信息完全泄露的情况,因此白盒攻击的适用情况要远远少于黑盒攻击。

4.由于黑盒攻击算法对模型信息一无所知或了解甚少,通常需要大量的查询来收敛,或者在有限的查询预算下获得相对较大的扰动,在某种意义上,它们缺乏效率。因此,本课题旨在对现有的黑盒攻击算法进行改进。克服现有算法的不足,考虑通过用更少的查询对每个样本进行更小的扰动,减小搜索空间的维数,从而进一步提高搜索效率,有效地生成基于决策的黑盒攻击的对抗性样本。

5.这不仅可以促进更加有效的防御算法的产生,而且在个人隐私保护方面也做出了贡献。现在存在很多恶意软件利用人工智能系统对用户上传到网络上的图像数据进行采集并分析,实施违法犯罪行为。此时可以通过对抗样本技术对图像数据进行伪装或隐藏,欺骗基于神经网络的图像识别系统,从而达到保护用户隐私,防止信息泄露的目的。对抗样本还可应用于验证码的生成,目前使用神经网络对验证码进行快速高效的识别,这使得网站面临着被恶意破解密码、恶意大规模注册等威胁,针对验证码识别系统生成对抗样本来构建安全的验证码,具有积极的理论研究意义和重要的应用价值。

6.黑盒攻击是攻击者只能获取目标模型的输入输出信息,目前主要实现方法有基于迁移的攻击、基于分数的攻击和基于访问的攻击。基于迁移的攻击不依赖于模型信息,而是需要关于训练数据的信息,该数据用于训练一个完全可观察的替代模型,而该模型可以合成对抗干扰,它们依赖于经验观察,即对抗样本经常在模型之间迁移,且实用性不强。基于分数的攻击需要获得一个连续的预测分数,但这在大多数现实场景中并不适用。而基于决

策的攻击大都以高访问量的代价来提升个体攻击的成功率,虽然它更适合攻击物理世界,但普遍存在查询次数多、初始敏感点难选择的问题。因此,本发明提出新的算法来解决黑盒攻击出现的问题,在保证攻击成功率的同时,使得添加扰动尽量小并且减少黑盒攻击算法访问网络的次数。

技术实现要素:

7.本发明的目的是为了解决现有的黑盒攻击存在查询次数多、初始敏感点难选择的问题,而提出一种基于黑盒攻击的人脸对抗样本生成方法。

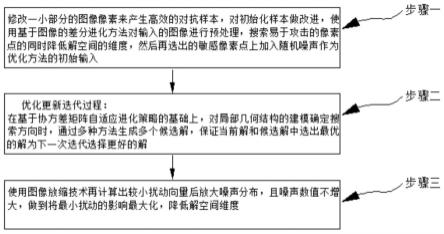

8.一种基于黑盒攻击的人脸对抗样本生成方法,所述方法通过以下步骤实现:

9.步骤一、修改一小部分的图像像素来产生高效的对抗样本,对初始化样本做改进,使用基于图像的差分进化方法对输入的图像进行预处理,搜索易于攻击的像素点的同时降低解空间的维度,然后再选出的敏感像素点上加入随机噪声作为优化方法的初始输入;

10.步骤二、优化更新迭代过程:

11.在基于协方差矩阵自适应进化策略的基础上,对局部几何结构的建模确定搜索方向时,通过多种方法生成多个候选解,保证当前解和候选解中选出最优的解为下一次迭代选择更好的解;

12.步骤三、使用图像放缩技术再计算出较小扰动向量后放大噪声分布,且噪声数值不增大,做到将最小扰动的影响最大化,降低解空间维度。

13.优选地,步骤一还包括初始对抗样本的选择的步骤,即:对于目标攻击直接使用目标图像当做对抗样本。

14.优选地,步骤二所述的在基于协方差矩阵自适应进化策略的基础上,对局部几何结构的建模确定搜索方向时,通过多种方法生成多个候选解,保证当前解和候选解中选出最优的解为下一次迭代选择更好的解的步骤,具体为:

15.在基于进化攻击算法中更新迭代的基础上,在父代(当前解)生成新的后代(候选解)时,改变噪声并生成多个后代,放在一起评估这些解的目标,选取最优的解。

16.优选地,步骤三所述的使用图像放缩技术再计算出较小扰动向量后放大噪声分布,且噪声数值不增大,做到将最小扰动的影响最大化,降低解空间维度的步骤为:

17.在对初始对抗样本时进行预处理时进行第一步降维,之后再在随机坐标采样和维度降采样中进一步降维,即均匀间隔地选取一部分像素作为搜索的子空间;在子空间中找到一个候选解时,根据像素的空间坐标进行双线性插值,得到一个全空间的候选解。

18.优选地,步骤一所述的修改一小部分的图像像素来产生高效的对抗样本,对初始化样本做改进的步骤,具体为:

19.针对人脸比对模型的攻击问题建模;攻击任务是在目标人脸图像的基础上构造一个对抗人脸图像,使得其与参考人脸图像的比对结果发生改变;对于人脸验证来说,该模型依靠另一张人脸图像来识别这对图像是否属于同一身份,并输出一个二进制标签。对于人脸识别,模型将输入图像与人脸图像图库集进行比较,然后将输入图像分类为特定身份,这的过程看作是多类分类任务;给定一个真实的人脸图像,攻击的目标是在原图像附近生成一个敌对的人脸图像,但是被模型错误分类,通过求解一个约束优化问题来解决

20.本发明的有益效果为:

21.本发明通过对黑盒攻击算法进化攻击算法、遗传算法进行学习,理解空间降维实现的手段,对协方差矩阵自适应进化策略进行深入研究。提出改进的基于决策的黑盒攻击产生样本的算法,用更少的查询对每个样本引入更小的扰动来有效地生成基于决策的黑盒攻击的对抗样本,限制访问模型的次数,提高搜索的效率,在人眼无法察觉到对抗样本与原始图像之间的差异的情况下,使得深度神经网络分类错误。最后选取合适的人脸数据集采用改进后的算法进。

22.具体地,

23.本发明在设计初始对抗样本时,考虑差分进化算法的变异、交叉、选择时的各种参数,选择最优的参数保证生成的样本具有对抗性。

24.父代解生成子代解时噪声的选取,能够快速高效的生成多个子代解并从中选择最优的。

附图说明

25.图1为本发明的方法流程图;

26.图2为本发明涉及的基于决策的黑盒攻击模型;

27.图3为本发明方法的原理思想介绍图示。

具体实施方式

28.具体实施方式一:

29.本实施方式的一种基于黑盒攻击的人脸对抗样本生成方法,如图1所示,所述方法通过以下步骤实现:

30.步骤一、实现尽可能小的干扰。现有的很多攻击算法几乎都是在整个图像所有像素点上添加微小的扰动,以达到欺骗模型的目的,这很难做到人眼不易察觉。本发明提出通过只修改一小部分的图像像素来产生高效的对抗样本,对初始化样本做改进,使用基于图像的差分进化方法对输入的图像进行预处理,搜索易于攻击的像素点的同时降低解空间的维度,然后再选出的敏感像素点上加入随机噪声作为优化方法的初始输入;改进后的对抗样本在后续的迭代更新中保持对抗性,同时在之后的处理过程中,不断减少对抗样本和原始图像的距离,使得原始图像与对抗样本间的距离最小化,实现人眼不易察觉的扰动;

31.步骤二、优化更新迭代过程:

32.在基于协方差矩阵自适应进化策略的基础上,对局部几何结构的建模确定搜索方向时,通过多种方法生成多个候选解,保证当前解和候选解中选出最优的解为下一次迭代选择更好的解;

33.步骤三、对于黑盒对抗攻击,搜索空间的维数非常大,所以降低搜索空间的维度是提高搜索效率的直接方法。本发明在进化攻击方法的思想上,融入了遗传算法的思想,将进化攻击方法和遗传算法二者优势结合起来,即:

34.使用图像放缩技术再计算出较小扰动向量后放大噪声分布,且噪声数值不增大,做到将最小扰动的影响最大化,降低解空间维度;提高搜索效率。

35.具体5实施方式二:

36.与具体实施方式一不同的是,本实施方式的一种基于黑盒攻击的人脸对抗样本生

成方法,步骤一还包括初始对抗样本的选择的步骤,由于深度神经网络对随机噪声有着很强的鲁棒性,在选择初始样本时,即:对于目标攻击直接使用目标图像当做对抗样本。

37.具体实施方式三:

38.与具体实施方式一或二不同的是,本实施方式的一种基于黑盒攻击的人脸对抗样本生成方法,步骤二所述的在基于协方差矩阵自适应进化策略的基础上,对局部几何结构的建模确定搜索方向时,通过多种方法生成多个候选解,保证当前解和候选解中选出最优的解为下一次迭代选择更好的解的步骤,具体为:

39.在基于进化攻击算法中更新迭代的基础上,在父代(当前解)生成新的后代(候选解)时,改变噪声并生成多个后代,放在一起评估这些解的目标,选取最优的解。

40.具体实施方式四:

41.与具体实施方式三不同的是,本实施方式的一种基于黑盒攻击的人脸对抗样本生成方法,步骤三所述的使用图像放缩技术再计算出较小扰动向量后放大噪声分布,且噪声数值不增大,做到将最小扰动的影响最大化,降低解空间维度的步骤为:

42.在对初始对抗样本时进行预处理时进行第一步降维,之后再在随机坐标采样和维度降采样中进一步降维,即均匀间隔地选取一部分像素作为搜索的子空间;在子空间中找到一个候选解(即候选对抗噪声)时,根据像素的空间坐标进行双线性插值,得到一个全空间的候选解。

43.具体实施方式五:

44.与具体实施方式四不同的是,本实施方式的一种基于黑盒攻击的人脸对抗样本生成方法,步骤一所述的修改一小部分的图像像素来产生高效的对抗样本,对初始化样本做改进的步骤,具体为:在黑盒攻击中攻击者无法访问模型参数和梯度,只能通过向目标模型发送查询来获取硬标签预测。这种攻击设置在现实世界的人脸识别系统中更为实用。图1是基于决策的黑盒攻击模型,可以看到通过访问黑盒模型次数的不断增加,生成的对抗样本也在不断优化,但由于查询次数较多,攻击效率不高。因此本研究在基于进化攻击的算法上进行改进,减少查询次数并生成更优良的对抗样本。

45.针对人脸比对模型的攻击问题建模;攻击任务是在目标人脸图像的基础上构造一个对抗人脸图像,使得其与参考人脸图像的比对结果发生改变;对于人脸验证来说,该模型依靠另一张人脸图像来识别这对图像是否属于同一身份,并输出一个二进制标签。对于人脸识别,模型将输入图像与人脸图像图库集进行比较,然后将输入图像分类为特定身份,这的过程看作是多类分类任务;给定一个真实的人脸图像,攻击的目标是在原图像附近生成一个敌对的人脸图像,但是被模型错误分类,通过求解一个约束优化问题来解决。

46.本发明实现原理:

47.所述的进化攻击算法的基本理论为:因为无法访问模型的配置和参数,只能发送查询来探测模型,因此可以采用黑盒优化算法最小化目标函数。进化攻击方法就是基于协方差矩阵自适应进化策略(cma-es)的一个简单有效的变体,即(1+1)-cma-es。在(1+1)-cma-es的每次更新迭代中,通过添加随机噪声,从其父代(当前解)生成新的后代(候选解),评估这两个解,并为下一次迭代选择更好的解。

48.如图3所示,大的圆圈表示目标图像;曲线i表示决策边界(这条曲线实际是不可见的),曲线的上方是不可行域,曲线下方是可行域;

×

点表示已经查询过的不可行解,小的圆

圈表示已经查询过的可行解,实心圆点表示当前可行解。其基本步骤如下:为了探索下一个可行解,需要进行采样。椭圆表示采样概率分布,其服从高斯分布。该分布的中心点为当前可行解,协方差矩阵是则是根据历史可行解进行估计的,其基本思想是:根据历史探索点,可以计算出各个方向的探索成功率;沿着成功率大的方向继续探索,更容易找到下一个可行解。因此,根据该分布进行第一步采样,如从绿色圆点出发的第一个橙色箭头,到达初始候选解(圆圈1)。经过第一步采样,可能找到下一个可行解,但是并不能保证的下降。因此,进行第二步探索,即以初始候选解为出发点,沿着目标图像x移动一小步(见第二个箭头),到达第二个候选解(即圆点2)。随后,在对第二个候选解进行查询,判断其是否满足约束:如果满足,则将其作为最新可行解,如图3所示,并对采样概率分布(即椭圆)进行更新;如果不满足,则保持当前解不变,重新上述采样过程。

49.并且设计了一个适当的分布来采样每次迭代中的随机噪声,它可以模拟搜索方向的局部几何形状。在上述搜索算法中,由于将图像的每个像素当作一个维度,导致整个搜索空间的维度非常高,这往往意味着搜索效率非常低。为此,在搜索中加入了两种加速方法:(1)随机坐标采样:即每次采样只在部分维度(即部分像素)进行,而不是所有维度。维度的选取以采样概率分布为依据,方差大的维度被选中的概率也更高。(2)维度降采样:假设对抗噪声在像素坐标系中也是空间平滑的,即相邻像素的对抗噪声相近。因此,均匀间隔地选取一部分像素作为搜索的子空间;但在子空间中找到一个候选解(即候选对抗噪声)时,根据像素的空间坐标进行双线性插值,得到一个全空间的候选解

50.本发明选用windows1064位进行运行试验,cpu为inteli7-67003.4ghz,深度学习框架为tensorflow2.2,编译环境为pycharm3.8/python语言,对本发明方法验证结果可行且效果理想。

51.本发明的实施例公布的是较佳的实施例,但并不局限于此,本领域的普通技术人员,极易根据上述实施例,领会本发明的精神,并做出不同的引申和变化,但只要不脱离本发明的精神,都在本发明的保护范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1