基于多尺度图像恢复的跨摄像机行人重识别方法及装置

1.本发明属于计算机视觉技术领域,具体涉及一种基于多尺度图像恢复的跨摄像机行人重识别方法及装置。

背景技术:

2.计算机视觉是指用摄影机和电脑代替人眼对目标进行识别、跟踪和测量等机器视觉,并进一步做图形处理,使电脑处理成为更适合人眼观察或传送给仪器检测的图像。它的主要任务就是通过对采集的图片或视频进行处理以获得相应场景的三维信息。行人重识别的目的是为了在不同场景和摄像机视角中匹配到特定的人。由于其在行人追踪、视频监控、智能安防等方面有着广泛的应用,已成为了计算机视觉领域的研究热点。

3.传统的行人重识别技术传统的行人重识别方法通常假设图库图像和查询图像有足够高的分辨率,仅考虑部分遮挡、人体姿态和视角变化的影响。但受摄像机硬件以及摄像机与目标人物之间距离的影响,捕获的行人图像分辨率往往具有很大差异。针对这一问题,有研究者提出跨分辨率行人重识别,即在传统的行人重识别数据集上,假设查询图像分辨率低于图库图像,利用固定倍数下采样来模拟跨分辨率场景,通过度量学习或者引入超分辨率技术来解决该问题。

4.然而,由于在真实世界中,图库图像和捕获的查询图像没有倍数关系,且不同摄像机捕获的行人图像尺度具有较大的差异,这使得现有的方法无法适应图像尺度的各种不规则变化,要么没有根本上恢复低质量图像丢失的细节,要么在恢复图像时仅考虑局部信息,从而导致识别准确率不够高,影响识别性能。

技术实现要素:

5.为了解决现有技术中存在的上述问题,本发明提供了一种基于多尺度图像恢复的跨摄像机行人重识别方法及装置。本发明要解决的技术问题通过以下技术方案实现:

6.一种基于多尺度图像恢复的跨摄像机行人重识别方法,包括:

7.获取跨摄像机查询图像并进行分辨率判断;

8.对所述查询图像中的低分辨率图像进行多尺度图像恢复,得到若干高质量图像;

9.对所述高质量图像和图库图像进行多尺度特征提取和融合,得到融合特征;

10.将所述融合特征与所述图库图像的特征进行对比分析,得到行人重识别结果。

11.在本发明的一个实施例中,获取跨摄像机查询图像并进行分辨率判断包括:

12.按照下式计算整个数据集图像的平均像素点a;

[0013][0014]

其中,hi,wi为第i张查询图像的高和宽,n为整个数据集图像的数量,avg表示对所有图像的像素点求和取平均;

[0015]

若所述查询图像的像素点低于整个数据集图像的平均像素点a,则判定该查询图像为低分辨率图像;否则,判定该查询图像为高分辨率图像。

[0016]

在本发明的一个实施例中,对所述查询图像中的低分辨率图像进行多尺度图像恢复,得到若干高质量图像包括:

[0017]

对低分辨率的查询图像进行特征提取,得到浅层特征图像;

[0018]

对所述浅层特征图像进行深层特征提取,得到深层特征图像;

[0019]

构建多个具有不同尺度的恢复transformer模型;

[0020]

分别利用不同的恢复transformer模型对所述浅层特征图像和所述深层特征图像进行图像恢复,对应得到多个高质量图像。

[0021]

在本发明的一个实施例中,对所述浅层特征图像进行深层特征提取,得到深层特征图像,包括:

[0022]

构建一个深度特征提取器;其中,所述深度特征提取器包括若干基于残差和滑动窗口的transformer块和第一卷积层,每个所述基于残差和滑动窗口的transformer块均包括若干基于滑动窗口机制的transformer层和第二卷积层;

[0023]

利用所述深度特征提取器对所述浅层特征图像进行深层特征提取,得到深层特征图像。

[0024]

在本发明的一个实施例中,对所述高质量图像和图库图像进行多尺度特征提取和融合,得到融合特征包括:

[0025]

构建若干个多尺度特征提取模型并进行训练;

[0026]

将若干不同尺度的高质量图像和图库图像作为多尺度特征提取模型的输入图像,利用不同的多尺度特征提取模型对相应的输入图像进行多尺度特征提取,对应得到多组不同尺度的特征;

[0027]

对每组不同尺度的特征分别进行融合处理,对应得到多个融合特征。

[0028]

在本发明的一个实施例中,每个所述多尺度特征提取模型均包括多个尺度不同的瓶颈层,用于提取不同的尺度特征;其中,

[0029]

每个瓶颈层均包括一个1

×

1卷积层、一个3

×

3深度可分离卷积层、一个批归一化层以及一个线性修正单元计划函数。

[0030]

在本发明的一个实施例中,对每组不同尺度的特征分别进行融合处理,对应得到多个融合特征,包括:

[0031]

构建包括一个非参数全局平均池化层和一个多层感知机的聚合门网络;

[0032]

利用所述聚合门网络对每组不同尺度的特征分别进行融合处理,得到多个融合特征。

[0033]

在本发明的一个实施例中,将所述融合特征与所述图库图像的特征进行对比分析,得到行人重识别结果包括:

[0034]

分别计算每个融合特征与图库图像特征之间的距离向量;

[0035]

将所有融合特征与图库图像特征之间的距离向量进行累加,得到累加距离值;

[0036]

根据所述累加距离值得到识别结果。

[0037]

本发明的另一个实施例还提供了基于多尺度图像恢复的跨摄像机行人重识别装置,包括:

[0038]

预处理模块,用于获取跨摄像机查询图像并进行分辨率判断;

[0039]

多尺度图像恢复模块,用于对所述查询图像中的低分辨率图像进行多尺度图像恢复,得到若干高质量图像;

[0040]

多特征提取融合模块,用于对所述高质量图像和图库图像进行多尺度特征提取和融合,得到融合特征;

[0041]

图像识别模块,用于将所述融合特征与所述图库图像的特征进行对比分析,得到行人重识别结果。

[0042]

本发明的有益效果:

[0043]

1、本发明通过引入多尺度图像恢复技术来恢复低质量图像丢失的信息,能够适应无约束跨摄像机行人重识别中图像尺度的不规则变化;同时采用多尺度特征提取和融合,充分利用图像的局部和全局信息,进一步提升跨摄像机行人重识别的性能;

[0044]

2、本发明对于不同尺度的融合特征图像,分别计算融合特征图像与图库图像之间的距离,通过距离直接相加来平衡不同图像的信息,使得识别结果更为准确。

[0045]

以下将结合附图及实施例对本发明做进一步详细说明。

附图说明

[0046]

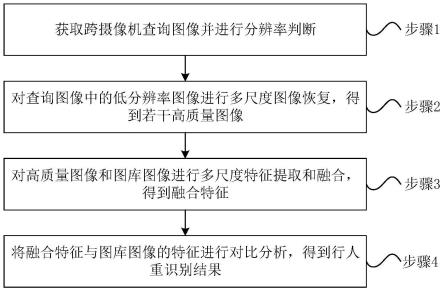

图1是本发明实施例提供的基于多尺度图像恢复的跨摄像机行人重识别方法的流程示意图;

[0047]

图2是本发明实施例提供的基于多尺度图像恢复的跨摄像机行人重识别方法的框架图;

[0048]

图3是本发明实施例提供的三种不同行人重识别场景的数据对比图;

[0049]

图4是本发明实施例提供的基于多尺度图像恢复的跨摄像机行人重识别方法的结构示意图。

具体实施方式

[0050]

下面结合具体实施例对本发明做进一步详细的描述,但本发明的实施方式不限于此。

[0051]

实施例一

[0052]

请参见图1,图1是本发明实施例提供的基于多尺度图像恢复的跨摄像机行人重识别方法的流程示意图,其包括:

[0053]

步骤1:获取跨摄像机查询图像并进行分辨率判断。

[0054]

首选,在本实施例中,查询图像可以通过多个摄像机从真实场景中捕获截取行人图像得到。此外,还需要获取图库图像用于后续的对比识别。

[0055]

然后,在得到查询图像之后,还需要对查询图像进行分辨率判断。

[0056]

具体的,在真实场景下,由于不同摄像机捕获的行人图像(也即查询图像)尺度具有较大的差异,即便同一摄像机捕获的行人图像也存在差异,因而得到的查询图像中,高质量和低质量图像往往同时存在。为了保证数据集中的图像在恢复后,图像质量尽量保持在同一水平,本实施例在捕获得到查询图像之后,还需要区分低质量和高质量图像。然后再对低质量的查询图像进行多尺度图像恢复,以得到具有更多细节信息的高质量图像。

[0057]

在本实施例中,主要采用平均像素点数作为阈值判断图像是低质量图像还是高质量图像,具体如下:

[0058]

首先,按照下式计算整个数据集图像的平均像素点a;

[0059][0060]

其中,hi,wi为第i张查询图像的高和宽,n为整个数据集图像的数量,avg表示对所有图像的像素点求和取平均;

[0061]

然后,比较查询图像的像素点和上述平均像素点的大小,若所述查询图像的像素点低于整个数据集图像的平均像素点a,则判定该查询图像为低分辨率图像,也即低质量图像;否则,判定该查询图像为高分辨率图像,也即高质量图像。

[0062]

当查询图像为高分辨率图像时,可直接跳转至步骤3以对其进行多尺度特征提取和融合处理,若查询图像为低分辨率图像,则执行步骤2,以对其进行多尺度图像恢复,也即多尺度图像重建。

[0063]

步骤2:对查询图像中的低分辨率图像进行多尺度图像恢复,得到若干高质量图像。

[0064]

具体的,请参见图2,图2是本发明实施例提供的基于多尺度图像恢复的跨摄像机行人重识别方法的框架图。在该框架中,主要利用恢复transformer来恢复行人的图像,其具体包括以下步骤:

[0065]

21)对低分辨率的查询图像进行特征提取,得到浅层特征图像;

[0066]

具体的,给定低分辨图像x

l

作为输入,先通过浅层特征提取器es(

·

)提取浅层特征fs,表示为:fs=es(x

l

)。

[0067]

在本实施例中,浅层特征提取器es(

·

)可以通过卷积层实现,对于具体的实现方式,可参考现有相关技术,本实施在此不做详细描述。

[0068]

22)对浅层特征图像进行深层特征提取,得到深层特征图像。

[0069]

首先,构建一个深度特征提取器;其中,所述深度特征提取器包括若干基于残差和滑动窗口的transformer块和第一卷积层,每个所述基于残差和滑动窗口的transformer块均包括若干基于滑动窗口机制的transformer层和第二卷积层。

[0070]

例如,本实施例设置深度特征提取器ed(

·

)由6个rstb(基于残差和滑动窗口的transformer块)和一个卷积层构成。每个rstb由六层stl(基于滑动窗口机制的transformer层)加一个卷积层组成,如图2所示。

[0071]

其中,每层stl均由两个归一化层layernorm,一个多头自注意力层msa,一个多层感知机mlp。该stl与原始的transformer层的不同是采用了滑动窗口机制,stl首先会将输入尺寸调整至然后再对每个窗口进行标准的自注意,整个过程公式如下:

[0072]

y=msa(ln(y))+y

[0073]

y=mlp(ln(y))+y

[0074]

其中,y表示单个窗口特征,msa是指多头自注意力,ln是指层归一化,mlp指多层感知机。

[0075]

然后,利用深度特征提取器对浅层特征图像进行深层特征提取,得到深层特征图像。

[0076]

具体的,通过深层特征提取器ed(

·

)从浅层特征fs获得深度特征fd,表示为:fd=ed(fs)。

[0077]

23)构建多个具有不同尺度的恢复transformer模型。

[0078]

由于查询图像之间,以及查询图像与图库图像之间分辨率差异大,显然对所有图像使用同样恢复尺度的transformer模型显然是不合适的。因此本实施例采用构建了一个多尺度高质量图像重构器,以从多个尺度来恢复图像。

[0079]

可选的,作为本发明的一种实现方式,可以使用{2,3,4,8}四个尺度来恢复图像。

[0080]

此外,为了使恢复的图像更真实,本技术还通过最小化l1像素损失来对构建的恢复transformer模型进行优化,表示为:

[0081][0082]

其中,m对应不同transformer的恢复尺度,x

l2h,m

为表示尺度为m的恢复transformer获得的高质量图像,xh为真实的高质量图像。

[0083]

24)分别利用不同的恢复transformer模型对所述浅层特征图像和所述深层特征图像进行图像恢复,对应得到多个高质量图像。

[0084]

具体的,聚合浅层特征fd和深度特征fs作为重构器r(

·

)的输入,得到高分辨率图像x

l2h

,整个流程可以表示为:

[0085]fs

=es(x

l

),fd=ed(fs)

[0086]

x

l2h

=r(fs+fd)

[0087]

本实施例通过引入多尺度图像恢复transformer来恢复低质量图像丢失的信息,能够适应无约束跨摄像机行人重识别中图像尺度的不规则变化,实现不同尺度图像的优势互补,进一步提升了识别准确率。

[0088]

可以理解的是,在本发明的另一个实施例中,还可以不对查询图像中的低分辨率进行多尺度transformer图像恢复,可直接执行步骤3的多尺度特征提取和融合。

[0089]

步骤3:对高质量图像和图库图像进行多尺度特征提取和融合,得到融合特征。具体过程如下:

[0090]

31)构建若干个多尺度特征提取模型并进行训练。

[0091]

在本实施例中,由于整个网络首先恢复图像,再对恢复前和恢复后的图像共同训练。对于每个输入图像,通过不同尺度transformer会产生不同的恢复图像,也即高质量查询图像,因此会导致恢复图像数量多且差异大,仅使用单一的特征提取网络无法得到最优结果。因此,本实施例创建了多个特征提取模型。

[0092]

具体地,多个特征提取模型表示为m1,m2,

…

,mr,其中每个模型对应单一尺度恢复transformer。对于每个特征提取模型,仅使用对应尺度恢复transformer模型得到的高质量图像和初始高质量图像对其进行训练,具体训练过程可参见现有相关技术,本实施例在此不做详细说明。

[0093]

需要说明的是,在构建特征提取模型时,除了多个对应恢复transformer模型尺度的模型外,还需要构建一个用于对图库图像进行特征提取的模型,其模型结构与其他模型结构相同。

[0094]

进一步地,由于在跨摄像机行人重识别场景下,图像尺度以及视角会有明显变化,仅学习单一尺度特征显然不是最好的选择。即使是在同一张图像中,不同尺度的特征关注的信息也是不同的。为了实现不同尺度特征的优势互补,最大化不同尺度的恢复图像的信息利用效率,本实施例对构建的特征提取模型采用多尺度特征学习的方法,通过多尺度特征学习,能够利用同一张图像中的全局和局部信息,并且能够更好的适应不同尺度图像。

[0095]

可选的,作为本发明的一种实现方式,每个多尺度特征提取模型均包括多个尺度不同的瓶颈层,用于提取不同的尺度特征;其中,

[0096]

每个瓶颈层均包括一个1

×

1卷积层、一个3

×

3深度可分离卷积层、一个批归一化层以及一个线性修正单元计划函数。

[0097]

考虑到计算效率,本实施例优选瓶颈层的数量最大值为4。

[0098]

32)将若干不同尺度的高质量图像和图库图像作为多尺度特征提取模型的输入图像,利用不同的多尺度特征提取模型对相应的输入图像进行多尺度特征提取,对应得到多组不同尺度的特征。

[0099]

具体的,给定输入h,该输入h可以是不同的恢复transformer模型得到的任意一个高质量图像,也可以是图库图像,还可以是高分辨率的查询图像,分别经过i个瓶颈层,获得的特征尺度分别为(2i+1)

×

(2i+1),公式表示如下:

[0100]fi

=bi(h)

[0101]

其中bi(

·

)表示连续经过i个瓶颈层,fi表示通过bi(

·

)获得的特征。

[0102]

33)对每组不同尺度的特征分别进行融合处理,对应得到多个融合特征。

[0103]

为了能够更好的利用不同尺度的特征,最大化不同尺度特征的兼容性和互补优势,本实施例使用动态统一聚合门对特征进行融合。

[0104]

首先,构建包括一个非参数全局平均池化层和一个多层感知机的聚合门网络。

[0105]

然后,利用聚合门网络对每组不同尺度的特征分别进行融合处理,得到多个融合特征,公式表示为:

[0106][0107]

其中a(

·

)为聚合门,实际上是由一个非参数全局平均池化层和一个多层感知机组成的微型网络,

⊙

代表哈达玛积,fh为最后获得的多尺度特征。

[0108]

步骤4:将融合特征与图库图像的特征进行对比分析,得到行人重识别结果。

[0109]

41)分别计算每个融合特征与图库图像特征之间的距离向量。

[0110]

42)将所有融合特征与图库图像特征之间的距离向量进行累加,得到累加距离值。

[0111]

43)根据所述累加距离值得到识别结果。

[0112]

具体的,每个融合特征与图库图像的特征之间的距离向量表示为dm,其中m为对应的transformer的恢复尺度。将所有融合特征与图库图像的特征之间的距离向量进行累加:

[0113][0114]

其中,m为针对恢复尺度为m的transformer特征提取模型,其可以取值为1、2、3、4、8,当m为1是表示图库图像。

[0115]

本实施例对于不同尺度的融合特征图像,分别计算融合特征图像与图库图像之间的距离,通过距离直接相加来平衡不同图像的信息,使得识别结果更为准确。

[0116]

本发明通过引入多尺度图像恢复transformer来恢复低质量图像丢失的信息,能够适应无约束跨摄像机行人重识别中图像尺度的不规则变化。同时采用多尺度特征提取和融合,充分利用图像的局部和全局信息,进一步提升跨摄像机行人重识别的性能。相比于传统的行人重识别方法,本发明的方法能够适应图像尺度的各种不规则变化,并且能够充分利用不同尺度图像的信息,提升行人重识别的准确度。

[0117]

实施例二

[0118]

下面将本发明提出的方法与现有的方法进行试验对比,以对本发明的有益效果进行验证。

[0119]

1、第一组试验:

[0120]

1.1试验内容:

[0121]

采用的跨摄像机数据集mta-reid上对现有的三种方法和本发明的方法进行对比试验。其中现有的三种方法分别为:

[0122]

现有方法一为文献《luo,h.,gu,y.,liao,x.,lai,s.,&jiang,w.(2019).bag of tricks and a strong baseline for deep person re-identification.in proceedings of the ieee/cvf conference on computer vision and pattern recognition workshops(pp.0-0).》中提出的方法,简称为strong baseline;

[0123]

现有方法二为文献《ye,m.,shen,j.,lin,g.,xiang,t.,shao,l.,&hoi,s.c.(2021).deep learning for person re-identification:a survey and outlook.ieee transactions on pattern analysis and machine intelligence》提出的方法,简称agw;

[0124]

现有方法三为文献《chen,t.,ding,s.,xie,j.,yuan,y.,chen,w.,yang,y.,...&wang,z.(2019).abd-net:attentive but diverse person re-identification.in proceedings of the ieee/cvf international conference on computer vision(pp.8351-8361)》提供的方法,简称abd。

[0125]

本发明的方法分为两个试验,一是在实现本发明的具体过程中,仅采用多尺度特征提取和融合技术,不使用mrt(多尺度图像恢复transformer)对低质量图像进行图像恢复;另一种是同时采用mrt和多尺度特征提取和融合技术。

[0126]

1.2、试验结果分析:

[0127]

试验结果如表1所示。

[0128]

表1本发明与现有方法跨摄像机数据集mta-reid的比较

[0129] maprank1rank5rank10方法一:strong baseline25.850.569.774.9方法二:agw27.753.871.776.5方法三:abd30.556.672.476.8本发明:不使用mrt31.160.073.978.1本发明35.063.876.180.1

[0130]

如表1所示,将本发明的方法与现有的三种行人重识别算法比较,在采用map(平均精度均值)、rank1(结果排列第一位为正确的概率)、rank5(结果排列第五位为正确的概率)

和rank10(结果排列第十位为正确的概率)四种指标进行评价。

[0131]

从表1可以看出,在跨摄像机数据集mta-reid上,strong baseline方法使用有效的训练技巧在map、rank1、rank5和rank10上分别达到了25.8%、50.5%、69.7%和74.9%。agw方法设计了一个加权的广义均值池化三联体损失,在这个跨摄像机数据集上map、rank1、rank5、rank10分别达到了27.7%、53.8%、71.7%、76.5%。abd方法通过集成注意力模块和多样性正则化,实现了30.5%、56.6%、72.4%、76.8%。我们的方法在map,rank1,rank5,rank10分别达到了35.0%,63.8%,76.1%,80.1%,远远高出其它方法的性能。其中,map比次优的方法高了4.5%,rank1、rank5、rank10比次优的方法分别高了7.2%、3.7%、3.3%。

[0132]

此外,从表1还可以看出,本发明不使用mrt(多尺度图像恢复transformer)时,已经能取得超越其它方法的效果。证明了本发明的方法两个部分:即多尺度图像恢复transformer和多尺度特征提取对于解决跨摄像机行人重识别的问题都非常有效。相比于现有方法能显著提高跨摄像机行人重识别的准确度。

[0133]

2、第二组试验:

[0134]

2.1试验内容

[0135]

采用传统的行人重识别、现有的跨分辨率行人重识别以及本发明的跨摄像机行人重识别方法分别对三组图像进行处理,并比较处理结果。

[0136]

2.2试验结果分析

[0137]

请参见图3,图3是本发明实施例提供的三种不同行人重识别场景的数据对比图;其中,左边的列来自图库图像,右边的列来自查询图像。a)来自传统行人重识别数据集market1501的图像。在分辨率上基本上没有区别,只是视角发生了变化。b)来自跨分辨率行人重识别数据集mlr-market1501的图像,分辨率和视角略有改变。c)来自跨摄像机行人重识别mta-reid的图像,图像的比例和视角发生了显著变化。由图3可以看出,本发明的方法更适用于真实环境。

[0138]

实施例三

[0139]

在上述实施例一的基础上,本实施例提供了一种基于多尺度特征融合的跨摄像机行人重识别装置。请参见图4,图4是本发明实施例提供的基于多尺度图像恢复的跨摄像机行人重识别方法的结构示意图,其包括:

[0140]

预处理模块1,用于获取跨摄像机查询图像并进行分辨率判断;

[0141]

多尺度图像恢复模块2,用于对所述查询图像中的低分辨率图像进行多尺度图像恢复,得到若干高质量图像;

[0142]

多特征提取融合模块3,用于对所述高质量图像和图库图像进行多尺度特征提取和融合,得到融合特征;

[0143]

图像识别模块4,用于将所述融合特征与所述图库图像的特征进行对比分析,得到行人重识别结果。

[0144]

本实施例提供的装置可以实现上述实施例一提供等方法,详细过程在此不再赘述。

[0145]

由此,本实施例提供的装置在进行跨摄像机行人重识别时,能够适应图像尺度的不规则变化,并且能够充分利用不同尺度图像局部和全局信息,极大提升了行人重识别的

准确度。

[0146]

以上内容是结合具体的优选实施方式对本发明所作的进一步详细说明,不能认定本发明的具体实施只局限于这些说明。对于本发明所属技术领域的普通技术人员来说,在不脱离本发明构思的前提下,还可以做出若干简单推演或替换,都应当视为属于本发明的保护范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1