视频处理方法、装置、设备及计算机可读存储介质与流程

1.本发明涉及视频处理技术领域,尤其涉及一种视频处理方法、装置、设备及计算机可读存储介质。

背景技术:

2.随着多媒体技术的发展,视频平台的兴起,视频已成为用户发布信息和娱乐的主流方式。不可避免的,总是会有一些不法分子由于利益等原因发布违规视频,例如,色情低俗视频、涉政视频和侵犯未成年人权益视频等等。因此,为了为用户提供积极、美好、绿色和健康的网络环境,视频审核变得尤为重要。

3.目前一般基于深度学习图像分类模型对视频进行审核,具体过程为:通过深度学习图像分类模型获取视频的每帧图片的违规分数,取最大违规分数代表视频的评分,然后将评分大于一定阈值的视频推送给人工审核,从而在很大程度上降低人工审核工作量,并提高了视频违规检测的效率。但是,由于仅针对视频的每帧图片进行审核,对于语音讲解涉政等违禁视频,则难以进行准确识别,导致色情低俗视频、涉政视频和侵犯未成年人权益视频等等违规视频的识别准确率较低。

技术实现要素:

4.本发明的主要目的在于提供一种视频处理方法、装置、设备及计算机可读存储介质,旨在解决现有违规视频的识别准确率低的技术问题。

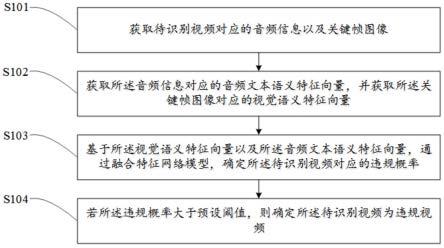

5.为实现上述目的,本发明提供一种视频处理方法,所述视频处理方法包括以下步骤:

6.获取待识别视频对应的音频信息以及关键帧图像;

7.获取所述音频信息对应的音频文本语义特征向量,并获取所述关键帧图像对应的视觉语义特征向量;

8.基于所述视觉语义特征向量以及所述音频文本语义特征向量,通过融合特征网络模型,确定所述待识别视频对应的违规概率;

9.若所述违规概率大于预设阈值,则确定所述待识别视频为违规视频。

10.进一步地,所述基于所述视觉语义特征向量以及所述音频文本语义特征向量,通过融合特征网络模型,确定所述待识别视频对应的违规概率的步骤包括:

11.基于所述视觉语义特征向量以及所述音频文本语义特征向量,确定所述待识别视频对应的多模态融合特征向量;

12.将所述多模态融合特征向量输入所述融合特征网络模型,将所述融合特征网络模型的输出作为所述违规概率。

13.进一步地,所述获取所述关键帧图像对应的视觉语义特征向量的步骤包括:

14.获取所述关键帧图像对应的图像文本特征向量以及关键帧图像特征向量;

15.基于敏感人物库获取所述关键帧图像对应的敏感人物特征向量;

16.将所述图像文本特征向量、所述关键帧图像特征向量以及所述敏感人物特征向量输入循环神经网络模型,将所述循环神经网络模型的输出作为所述视觉语义特征向量。

17.进一步地,所述获取所述关键帧图像对应的图像文本特征向量以及关键帧图像特征向量的步骤包括:

18.对所述关键帧图像进行文本识别,获得所述关键帧图像对应的图像文本信息;

19.将所述图像文本信息输入卷积神经网络模型,将所述卷积神经网络模型的输出作为所述图像文本特征向量;

20.将所述关键帧图像输入深层卷积神经网络模型,将所述深层卷积神经网络模型的输出作为所述关键帧图像特征向量。

21.进一步地,所述基于敏感人物库获取所述关键帧图像对应的敏感人物特征向量的步骤包括:

22.获取所述关键帧图像对应的人脸特征;

23.确定各个所述人脸特征与敏感人物库中的各个敏感人物特征之间的相似度;

24.获取各个所述相似度中大于预设相似度的目标相似度,将所述目标相似度对应的敏感人物特征作为所述敏感人物特征向量。

25.进一步地,所述获取所述音频信息对应的音频文本语义特征向量的步骤包括:

26.对所述音频信息进行语音识别,获得所述音频信息对应的音频文本信息;

27.将所述音频文本信息输入字符级卷积神经网络模型,将所述字符级卷积神经网络模型的输出作为所述音频文本语义特征向量。

28.进一步地,所述获取待识别视频对应的音频信息以及关键帧图像的步骤之前,所述视频处理方法还包括:

29.获取待检测视频对应的视频指纹;

30.若所述视频指纹与正常视频指纹库中的第一预设视频指纹不匹配,则确定所述视频指纹与违规视频指纹库中的第二预设视频指纹是否匹配;

31.若所述视频指纹与所述第二预设视频指纹不匹配,则确定所述待检测视频为待识别视频;

32.若所述视频指纹与所述第二预设视频指纹匹配,则确定所述待检测视频为违规视频。

33.此外,为实现上述目的,本发明还提供一种视频处理装置,所述视频处理装置包括:

34.第一获取模块,用于获取待识别视频对应的音频信息以及关键帧图像;

35.第二获取模块,用于获取所述音频信息对应的音频文本语义特征向量,并获取所述关键帧图像对应的视觉语义特征向量;

36.第一确定模块,用于基于所述视觉语义特征向量以及所述音频文本语义特征向量,通过融合特征网络模型,确定所述待识别视频对应的违规概率;

37.第二确定模块,用于若所述违规概率大于预设阈值,则确定所述待识别视频为违规视频。

38.此外,为实现上述目的,本发明还提供一种视频处理设备,所述视频处理设备包括:存储器、处理器及存储在所述存储器上并可在所述处理器上运行的视频处理程序,所述

视频处理程序被所述处理器执行时实现前述的视频处理方法的步骤。

39.此外,为实现上述目的,本发明还提供一种计算机可读存储介质,所述计算机可读存储介质上存储有视频处理程序,所述视频处理程序被处理器执行时实现前述的视频处理方法的步骤。

40.本发明通过获取待识别视频对应的音频信息以及关键帧图像;接着获取所述音频信息对应的音频文本语义特征向量,并获取所述关键帧图像对应的视觉语义特征向量;而后基于所述视觉语义特征向量以及所述音频文本语义特征向量,通过融合特征网络模型,确定所述待识别视频对应的违规概率;然后若所述违规概率大于预设阈值,则确定所述待识别视频为违规视频,能够根据待识别视频的音频信息以及关键帧图像准确确定该待识别视频是否为违规视频,通过在视频审核时兼容语音讲解等音频信息,提高违规视频识别的准确率。

附图说明

41.图1是本发明实施例方案涉及的硬件运行环境中视频处理设备一实施方式的结构示意图;

42.图2为本发明视频处理方法第一实施例的流程示意图;

43.图3为本发明视频处理装置一实施例的功能模块示意图。

44.本发明目的的实现、功能特点及优点将结合实施例,参照附图做进一步说明。

具体实施方式

45.应当理解,此处所描述的具体实施例仅仅用以解释本发明,并不用于限定本发明。

46.图1是本发明实施例方案涉及的硬件运行环境中视频处理设备的结构示意图。

47.本发明实施例视频处理设备可以是pc,也可以是智能手机等终端设备。

48.如图1所示,该视频处理设备可以包括:处理器1001,例如cpu,网络接口1004,用户接口1003,存储器1005,通信总线1002。其中,通信总线1002用于实现这些组件之间的连接通信。用户接口1003可以包括显示屏(display)、输入单元比如键盘(keyboard),可选用户接口1003还可以包括标准的有线接口、无线接口。网络接口1004可选的可以包括标准的有线接口、无线接口(如wi-fi接口)。存储器1005可以是高速ram存储器,也可以是稳定的存储器(non-volatile memory),例如磁盘存储器。存储器1005可选的还可以是独立于前述处理器1001的存储装置。

49.可选地,视频处理设备还可以包括摄像头、rf(radio frequency,射频)电路,传感器、音频电路、wifi模块等等。当然,视频处理设备还可配置陀螺仪、气压计、湿度计、温度计、红外线传感器等其他传感器,在此不再赘述。

50.本领域技术人员可以理解,图1中示出的终端结构并不构成对视频处理设备的限定,可以包括比图示更多或更少的部件,或者组合某些部件,或者不同的部件布置。

51.如图1所示,作为一种计算机存储介质的存储器1005中可以包括操作系统、网络通信模块、用户接口模块以及视频处理程序。

52.在图1所示的视频处理设备中,网络接口1004主要用于连接后台服务器,与后台服务器进行数据通信;用户接口1003主要用于连接客户端(用户端),与客户端进行数据通信;

而处理器1001可以用于调用存储器1005中存储的视频处理程序。

53.在本实施例中,视频处理设备包括:存储器1005、处理器1001及存储在所述存储器1005上并可在所述处理器1001上运行的视频处理程序,其中,处理器1001调用存储器1005中存储的视频处理程序时,并执行以下各个实施例中视频处理方法的步骤。

54.本发明还提供一种视频处理方法,参照图2,图2为本发明视频处理方法第一实施例的流程示意图。

55.本实施例中,该视频处理方法包括:

56.步骤s101,获取待识别视频对应的音频信息以及关键帧图像;

57.本实施例中,先获取待识别视频,例如,可以将每一个需要进行违规审核的待检测视频作为待识别视频,或者,先根据当前已审核的违规视频数据库以及正常视频数据库对待检测视频进行匹配,若待检测视频与违规视频数据库以及正常视频数据库均不匹配,则确定该待检测视频为待识别视频。

58.在获取到待识别视频时,获取待识别视频对应的音频信息以及关键帧图像,具体地,先对待识别视频进行音视频分离,得到待识别视频的音频信息以及视频信息,然后采用现有关键帧抽取方法对视频信息进行关键帧抽取,得到该待识别视频的关键帧图像,其中,该关键帧抽取方法可以为基于镜头的关键帧抽取方法、基于运动分析的关键帧抽取方法或者基于视频聚类的关键帧抽取方法。

59.步骤s102,获取所述音频信息对应的音频文本语义特征向量,并获取所述关键帧图像对应的视觉语义特征向量;

60.在本实施例中,在获取到音频信息以及关键帧图像时,获取音频信息对应的音频文本语义特征向量,并获取关键帧图像对应的视觉语义特征向量,具体地,可预先设置训练好的语义特征向量模型,将该音频信息输入该语义特征向量模型得到音频文本语义特征向量,或者,先获取音频信息的音频文本信息,通过音频文本信息得到该音频文本语义特征向量;对于关键帧图像,可以直接将关键帧图像输入对应的模型进行模型训练,得到视觉语义特征向量,或者,将关键帧图像输入对应的模型进行模型训练得到关键帧图像特征向量,对关键帧图像进行文本识别得到图像文本信息,将图像文本信息输入对应的模型进行模型训练得到图像文本特征向量,根据图像文本特征向量以及关键帧图像特征向量确定视觉语义特征向量。

61.步骤s103,基于所述视觉语义特征向量以及所述音频文本语义特征向量,通过融合特征网络模型,确定所述待识别视频对应的违规概率;

62.本实施例中,在获取到视觉语义特征向量以及音频文本语义特征向量时,基于视觉语义特征向量以及音频文本语义特征向量,通过融合特征网络模型,确定待识别视频对应的违规概率,具体地,可以将视觉语义特征向量以及音频文本语义特征向量输入融合特征网络模型进行模型训练,将模型训练结果作为违规概率,或者,将视觉语义特征向量以及音频文本语义特征向量进行融合得到多模态融合特征向量,将该多模态融合特征向量输入融合特征网络模型进行模型训练,将模型训练结果作为违规概率。

63.需要说明的是,融合特征网络模型包括两个全连接层和一个softmax分类器,该融合特征网络模型输出为违规概率。其中,在进行视频审核之前,先设置初始融合特征网络模型,获取第一训练样本以及对应的标签,该第一训练样本可以为违规视频的视觉语义特征

向量以及音频文本语义特征向量(或者多模态融合特征向量),对应的标签为违规视频,或者正常视频的视觉语义特征向量以及音频文本语义特征向量(或者多模态融合特征向量),对应的标签为正常视频,然后对初始融合特征网络模型进行模型训练,得到第一训练样本中每一个视频的预测违规概率,根据预测违规概率确定每一个视频的预测结果,例如预测违规概率大于预设阈值,则该预测违规概率对应的视频为违规视频,然后根据标签以及预测结果,确定该训练后的初始融合特征网络模型的损失函数,在损失函数小于预设值时,将该训练后的初始融合特征网络模型作为融合特征网络模型。

64.步骤s104,若所述违规概率大于预设阈值,则确定所述待识别视频为违规视频。

65.在本实施例中,在获得违规概率时,确定该违规概率是否大于预设阈值,若违规概率大于预设阈值,则确定待识别视频为违规视频,进而实现根据待识别视频的音频信息以及关键帧图像准确确定该待识别视频是否为违规视频。

66.本实施例提出的视频处理方法,通过获取待识别视频对应的音频信息以及关键帧图像;接着获取所述音频信息对应的音频文本语义特征向量,并获取所述关键帧图像对应的视觉语义特征向量;而后基于所述视觉语义特征向量以及所述音频文本语义特征向量,通过融合特征网络模型,确定所述待识别视频对应的违规概率;然后若所述违规概率大于预设阈值,则确定所述待识别视频为违规视频,能够根据待识别视频的音频信息以及关键帧图像准确确定该待识别视频是否为违规视频,通过在视频审核时兼容语音讲解等音频信息,提高违规视频识别的准确率。

67.基于第一实施例,提出本发明视频处理方法的第二实施例,在本实施例中,步骤s103包括:

68.步骤s201,基于所述视觉语义特征向量以及所述音频文本语义特征向量,确定所述待识别视频对应的多模态融合特征向量;

69.步骤s202,将所述多模态融合特征向量输入所述融合特征网络模型,将所述融合特征网络模型的输出作为所述违规概率。

70.本实施例中,在获取到视觉语义特征向量以及音频文本语义特征向量时,基于视觉语义特征向量以及音频文本语义特征向量,确定待识别视频对应的多模态融合特征向量,具体地,将视觉语义特征向量以及音频文本语义特征向量进行融合得到多模态融合特征向量,例如,可以将视觉语义特征向量以及音频文本语义特征向量进行字符串连接(concat),得到该多模态融合特征向量,当然,在其他实施例中,若视觉语义特征向量以及音频文本语义特征向量的维度相同,还可以对根据视觉语义特征向量以及音频文本语义特征向量相同维度的元素的均值,得到该多模态融合特征向量。

71.接着,将该多模态融合特征向量输入融合特征网络模型进行模型训练,将模型训练结果即融合特征网络模型的输出作为违规概率。

72.本实施例提出的视频处理方法,通过基于所述视觉语义特征向量以及所述音频文本语义特征向量,确定所述待识别视频对应的多模态融合特征向量;接着将所述多模态融合特征向量输入所述融合特征网络模型,将所述融合特征网络模型的输出作为所述违规概率,通过将视觉语义特征向量以及音频文本语义特征向量进行融合,进而根据视觉语义特征向量以及音频文本语义特征向量的融合结果确定该待识别视频是否为违规视频,提高了视频识别的效率,进一步提高违规视频识别的准确率。

73.基于第一实施例,提出本发明视频处理方法的第三实施例,在本实施例中,步骤s102包括:

74.步骤s301,获取所述关键帧图像对应的图像文本特征向量以及关键帧图像特征向量;

75.步骤s302,基于敏感人物库获取所述关键帧图像对应的敏感人物特征向量;

76.步骤s303,将所述图像文本特征向量、所述关键帧图像特征向量以及所述敏感人物特征向量输入循环神经网络模型,将所述循环神经网络模型的输出作为所述视觉语义特征向量。

77.本实施例中,在获取到关键帧图像时,获取关键帧图像对应的图像文本特征向量以及关键帧图像特征向量,具体地,先过去关键帧图像对应的图像文本信息,然后,根据图像文本信息进行模型训练得到图像文本特征向量,同时将关键帧图像输入对应的模型进行模型训练得到关键帧图像特征向量。

78.接着,基于敏感人物库获取关键帧图像对应的敏感人物特征向量,具体地,将关键帧图像分别与敏感人物库中的敏感人物特征进行匹配,得到匹配的目标敏感人物特征,将目标敏感人物特征作为敏感人物特征向量。其中,若视频审核为涉政视频审核,则预先收集包含国家领导人、分裂国家组织头目、邪教组织头目、暴恐组织头目、其他涉政敏感人员等在内的多类人脸图像,将人脸图像输入卷积神经网络模型进行模型训练,得到敏感人物特征,该敏感人物特征可以为128维的人脸特征,基于获得的多个敏感人物特征建立敏感人物库。

79.然后,将图像文本特征向量、关键帧图像特征向量以及敏感人物特征向量输入循环神经网络模型,将循环神经网络模型的输出作为视觉语义特征向量,其中,该循环神经网络模型可以为注意力机制的双向时间循环神经网络,该循环神经网络模型为预训练的双向时间循环神经网络,该视觉语义特征向量可以为128维的特征向量。

80.本实施例提出的视频处理方法,通过获取所述关键帧图像对应的图像文本特征向量以及关键帧图像特征向量;接着基于敏感人物库获取所述关键帧图像对应的敏感人物特征向量;而后将所述图像文本特征向量、所述关键帧图像特征向量以及所述敏感人物特征向量输入循环神经网络模型,将所述循环神经网络模型的输出作为所述视觉语义特征向量,通过基于图像文本特征向量、关键帧图像特征向量以及敏感人物特征向量得到视觉语义特征向量,以在视频识别时综合考量待识别视频中的敏感事件、涉政人物、反动宣传等多种违禁内容,以准确识别待识别视频中的涉政相关文章、宣传标语、涉政人物等,进一步提高违规视频识别的准确率。

81.基于第三实施例,提出本发明视频处理方法的第四实施例,在本实施例中,步骤s301包括:

82.步骤s401,对所述关键帧图像进行文本识别,获得所述关键帧图像对应的图像文本信息;

83.步骤s402,将所述图像文本信息输入卷积神经网络模型,将所述卷积神经网络模型的输出作为所述图像文本特征向量;

84.步骤s403,将所述关键帧图像输入深层卷积神经网络模型,将所述深层卷积神经网络模型的输出作为所述关键帧图像特征向量。

85.本实施例中,在获取到关键帧图像时,对所述关键帧图像进行文本识别,获得所述关键帧图像对应的图像文本信息,具体可采用现有图形文本识别算法例如orc对关键帧图像进行文本识别,得到图像文本信息。

86.接着,将图像文本信息输入卷积神经网络模型,将卷积神经网络模型的输出作为图像文本特征向量,并将关键帧图像输入深层卷积神经网络模型,将深层卷积神经网络模型的输出作为关键帧图像特征向量。

87.本实施例中,在进行视频识别之前,先搭建初始卷积神经网络模型以及初始深层卷积神经网络模型,采用第二训练样本(文本样本)对初始卷积神经网络模型进行模型训练,在训练后的初始卷积神经网络模型满足要求时,将该训练后的初始卷积神经网络模型作为卷积神经网络模型,以及,采用第三训练样本(图像样本)对初始深层卷积神经网络模型进行模型训练,在训练后的初始深层卷积神经网络模型满足要求时,将该训练后的初始深层卷积神经网络模型作为深层卷积神经网络模型。

88.本实施例提出的视频处理方法,通过对所述关键帧图像进行文本识别,获得所述关键帧图像对应的图像文本信息;接着将所述图像文本信息输入卷积神经网络模型,将所述卷积神经网络模型的输出作为所述图像文本特征向量;而后将所述关键帧图像输入深层卷积神经网络模型,将所述深层卷积神经网络模型的输出作为所述关键帧图像特征向量,能够通过图像文本信息以及关键帧图像准确得到图像文本特征向量及关键帧图像特征向量,以在视频识别时综合考量待识别视频中的涉政相关文章、宣传标语、涉政人物等,进一步提高违规视频识别的准确率。

89.基于第三实施例,提出本发明视频处理方法的第五实施例,在本实施例中,步骤s303包括:

90.步骤s501,获取所述关键帧图像对应的人脸特征;

91.步骤s502,确定各个所述人脸特征与敏感人物库中的各个敏感人物特征之间的相似度;

92.步骤s503,获取各个所述相似度中大于预设相似度的目标相似度,将所述目标相似度对应的敏感人物特征作为所述敏感人物特征向量。

93.本实施例中,在获取到关键帧图像,获取关键帧图像对应的人脸特征,该人脸特征包括关键帧图像中所出现的所有人脸的特征,例如,可采用深层卷积神经网络提取关键帧图像对应的人脸特征,或者采用现有的人脸识别算法提取关键帧图像对应的人脸特征,其中,该人脸特征可以为128维的向量。

94.接着,计算各个人脸特征与敏感人物库中的各个敏感人物特征之间的相似度,其中,敏感人物特征可以为128维的人脸特征向量,对于每一个人脸特征,基于余弦公式计算该人脸特征与各个敏感人物特征之间的余弦值,该余弦值即为对应的相似度。

95.然后,将各个相似度与预设相似度进行对比,获取各个相似度中大于预设相似度的目标相似度,确定敏感人物库中目标相似度对应的敏感人物特征即目标敏感人物特征,并将目标敏感人物特征作为敏感人物特征向量。

96.本实施例提出的视频处理方法,通过获取所述关键帧图像对应的人脸特征;接着确定各个所述人脸特征与敏感人物库中的各个敏感人物特征之间的相似度;而后获取各个所述相似度中大于预设相似度的目标相似度,将所述目标相似度对应的敏感人物特征作为

所述敏感人物特征向量,能够根据相似度准确获得敏感人物特征向量,进一步提高违规视频识别的准确率。

97.基于第一实施例,提出本发明视频处理方法的第六实施例,在本实施例中,步骤s102包括:

98.步骤s601,对所述音频信息进行语音识别,获得所述音频信息对应的音频文本信息;

99.步骤s602,将所述音频文本信息输入字符级卷积神经网络模型,将所述字符级卷积神经网络模型的输出作为所述音频文本语义特征向量。

100.在本实施例中,在获取到音频信息时,对所述音频信息进行语音识别,获得所述音频信息对应的音频文本信息,例如,采用现有的语音识别算法对音频信息进行语音识别,得到音频文本信息。

101.接着,将音频文本信息输入字符级卷积神经网络模型,将字符级卷积神经网络模型的输出作为所述音频文本语义特征向量,其中,在进行视频识别之前,先搭建初始字符级卷积神经网络模型,采用第四训练样本(文本样本)对初始字符级卷积神经网络模型进行模型训练,在训练后的初始字符级卷积神经网络模型满足要求时,将该训练后的初始字符级卷积神经网络模型作为字符级卷积神经网络模型,以通过字符级卷积神经网络模型得到音频文本信息对应的音频文本语义特征向量。

102.本实施例提出的视频处理方法,通过对所述音频信息进行语音识别,获得所述音频信息对应的音频文本信息;接着将所述音频文本信息输入字符级卷积神经网络模型,将所述字符级卷积神经网络模型的输出作为所述音频文本语义特征向量,能够根据音频文本信息准确得到音频文本语义特征向量,通过在视频审核时兼容语音讲解等音频信息,进一步提高违规视频识别的准确率。

103.基于上述各个实施例,提出本发明视频处理方法的第七实施例,在本实施例中,步骤s101之前,该视频处理方法还包括:

104.步骤s701,获取待检测视频对应的视频指纹;

105.步骤s702,若所述视频指纹与正常视频指纹库中的第一预设视频指纹不匹配,则确定所述视频指纹与违规视频指纹库中的第二预设视频指纹是否匹配;

106.步骤s703,若所述视频指纹与所述第二预设视频指纹不匹配,则确定所述待检测视频为待识别视频;

107.步骤s704,若所述视频指纹与所述第二预设视频指纹匹配,则确定所述待检测视频为违规视频。

108.本实施例中,先获取待检测视频,例如,可以将每一个需要进行违规审核的视频作为待检测视频,然后获取该待检测视频的视频指纹。并确定该视频指纹与正常视频指纹库中的第一预设视频指纹是否匹配。

109.若视频指纹与正常视频指纹库中的第一预设视频指纹不匹配,则该待检测视频为非正常视频,即待检测视频可能为违规视频或者未检测视频,此时,确定视频指纹与违规视频指纹库中的第二预设视频指纹是否匹配。若视频指纹与正常视频指纹库中的第一预设视频指纹匹配,例如该视频指纹属于第一预设视频指纹,则确定该待检测视频为正常视频。

110.若视频指纹与第二预设视频指纹匹配,则确定待检测视频为违规视频,否则确定

待检测视频为待识别视频。

111.本实施例提出的视频处理方法,通过获取待检测视频对应的视频指纹;接着若所述视频指纹与正常视频指纹库中的第一预设视频指纹不匹配,则确定所述视频指纹与违规视频指纹库中的第二预设视频指纹是否匹配;而后若所述视频指纹与所述第二预设视频指纹不匹配,则确定所述待检测视频为待识别视频;然后若所述视频指纹与所述第二预设视频指纹匹配,则确定所述待检测视频为违规视频,通过正常视频以及违规视频的视频指纹对待检测视频进行初始筛选,能够避免对属于正常视频或者违规视频的待检测视频进行再次审核,进一步提升了违规视频识别的效率。

112.本发明还提供一种视频处理装置,参照图3,所述视频处理装置包括:

113.第一获取模块10,用于获取待识别视频对应的音频信息以及关键帧图像;

114.第二获取模块20,用于获取所述音频信息对应的音频文本语义特征向量,并获取所述关键帧图像对应的视觉语义特征向量;

115.第一确定模块30,用于基于所述视觉语义特征向量以及所述音频文本语义特征向量,通过融合特征网络模型,确定所述待识别视频对应的违规概率;

116.第二确定模块40,用于若所述违规概率大于预设阈值,则确定所述待识别视频为违规视频。

117.进一步地,第一确定模块30,还用于:

118.基于所述视觉语义特征向量以及所述音频文本语义特征向量,确定所述待识别视频对应的多模态融合特征向量;

119.将所述多模态融合特征向量输入所述融合特征网络模型,将所述融合特征网络模型的输出作为所述违规概率。

120.进一步地,第二获取模块20,还用于:

121.获取所述关键帧图像对应的图像文本特征向量以及关键帧图像特征向量;

122.基于敏感人物库获取所述关键帧图像对应的敏感人物特征向量;

123.将所述图像文本特征向量、所述关键帧图像特征向量以及所述敏感人物特征向量输入循环神经网络模型,将所述循环神经网络模型的输出作为所述视觉语义特征向量。

124.进一步地,第二获取模块20,还用于:

125.对所述关键帧图像进行文本识别,获得所述关键帧图像对应的图像文本信息;

126.将所述图像文本信息输入卷积神经网络模型,将所述卷积神经网络模型的输出作为所述图像文本特征向量;

127.将所述关键帧图像输入深层卷积神经网络模型,将所述深层卷积神经网络模型的输出作为所述关键帧图像特征向量。

128.进一步地,第二获取模块20,还用于:

129.获取所述关键帧图像对应的人脸特征;

130.确定各个所述人脸特征与敏感人物库中的各个敏感人物特征之间的相似度;

131.获取各个所述相似度中大于预设相似度的目标相似度,将所述目标相似度对应的敏感人物特征作为所述敏感人物特征向量。

132.进一步地,第二获取模块20,还用于:

133.对所述音频信息进行语音识别,获得所述音频信息对应的音频文本信息;

134.将所述音频文本信息输入字符级卷积神经网络模型,将所述字符级卷积神经网络模型的输出作为所述音频文本语义特征向量。

135.进一步地,该视频处理装置,还用于:

136.获取待检测视频对应的视频指纹;

137.若所述视频指纹与正常视频指纹库中的第一预设视频指纹不匹配,则确定所述视频指纹与违规视频指纹库中的第二预设视频指纹是否匹配;

138.若所述视频指纹与所述第二预设视频指纹不匹配,则确定所述待检测视频为待识别视频;

139.若所述视频指纹与所述第二预设视频指纹匹配,则确定所述待检测视频为违规视频。

140.上述各程序单元所执行的方法可参照本发明视频处理方法各个实施例,此处不再赘述。

141.本发明还提供一种计算机可读存储介质。

142.本发明计算机可读存储介质上存储有视频处理程序,所述视频处理程序被处理器执行时实现如上所述的视频处理方法的步骤。

143.其中,在所述处理器上运行的视频处理程序被执行时所实现的方法可参照本发明视频处理方法各个实施例,此处不再赘述。

144.此外,本发明实施例还提出一种计算机程序产品,该计算机程序产品上包括视频处理程序,所述视频处理程序被处理器执行时实现如上所述的视频处理方法的步骤。

145.需要说明的是,在本文中,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者系统不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者系统所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括该要素的过程、方法、物品或者系统中还存在另外的相同要素。

146.上述本发明实施例序号仅仅为了描述,不代表实施例的优劣。

147.通过以上的实施方式的描述,本领域的技术人员可以清楚地了解到上述实施例方法可借助软件加必需的通用硬件平台的方式来实现,当然也可以通过硬件,但很多情况下前者是更佳的实施方式。基于这样的理解,本发明的技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品存储在如上所述的一个存储介质(如rom/ram、磁碟、光盘)中,包括若干指令用以使得一台终端设备(可以是手机,计算机,服务器,空调器,或者网络设备等)执行本发明各个实施例所述的方法。

148.以上仅为本发明的优选实施例,并非因此限制本发明的专利范围,凡是利用本发明说明书及附图内容所作的等效结构或等效流程变换,或直接或间接运用在其他相关的技术领域,均同理包括在本发明的专利保护范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1