一种基于图像解析的无人天车钢卷倾斜防范方法

1.本发明涉及钢卷加工技术领域,具体为一种基于图像解析的无人天车钢卷倾斜防范方法。

背景技术:

2.经济在发展,社会在进步,公众的生活质量不断提升,生产企业高效能建设、自动化运营水平不断提升,起重机在生产制造领域发挥的作用越来越重要,尤其是随着工业化进程深入推进,在货物搬运、基础设施建设、设备吊装等多个领域越来越依靠起重机械设备。

3.目前涉及天车吊运及库区管理业务多采用人工作业的方式,需要大量的人员参与,不仅人工成本较高而且操作水平参差不齐,生产效率也受到瓶颈限制。近些年来受到安全、质量、成本等多方面影响,实现库区物流智能化管理变得越来越重要,特别是在一些高危高强度作业区,对天车作业的无人化及智能化需求亟待解决。目前钢厂对于使用无人天车进行钢卷搬运已经相对成熟,然而在钢卷搬运过程中仍可能出现钢卷倾斜或者天车在未将钢卷夹紧的情况下去提拉钢卷,以至于发生钢卷掉落,造成重大安全生产事故。因此在钢卷夹取过程中及时的识别是否出现钢卷倾斜的情况对于无人天车的安全运作起着至关重要的作用;鉴于此,我们提出了一种基于图像解析的无人天车钢卷倾斜防范方法。

技术实现要素:

4.针对现有技术的不足,本发明提供了一种基于图像解析的无人天车钢卷倾斜防范方法,检测出天车中吊钩部分,通过夹取过程的特征变化来判断钢卷是否发生倾斜。根据工作场景不同,分别处理白天和夜晚两个场景。通过优化模型,使得模型对于小目标检测的泛化能力增强。

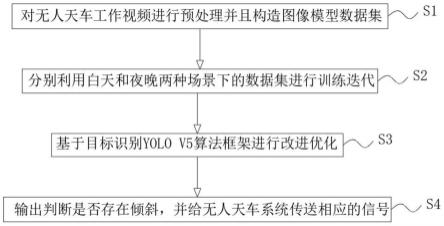

5.为实现以上目的,本发明通过以下技术方案予以实现:一种基于图像解析的无人天车钢卷倾斜防范方法,所述防范方法包括以下步骤:

6.s1:对无人天车工作视频进行预处理并且构造图像模型数据集;

7.s2:分别利用白天和夜晚两种场景下的数据集进行训练迭代,完成图像识别模型的构建和训练;

8.s3:基于目标识别yolo v5算法框架进行改进优化,将部分卷积层替换成可变形卷积,适当增加网络的复杂度;

9.s4:对于模型的输出判断是否存在倾斜,并给无人天车系统传送相应的信号。

10.可选的,所述s1包括以下步骤:

11.s11:当无人天车到达要夹取或放置钢卷的正上方的位置时,安装在无人天车下方的摄像头能够实时抓取视频流并进行抽帧处理;

12.s12:采用mosaic数据增强的方式,将图像数据通过随机缩放、随机裁剪、随机排列的方式进行拼接。

13.可选的,所述s1进一步的包括以下步骤:

14.s13:模型每次训练时,自适应的计算不同训练数据集中的最佳描框值,将图像缩放成固定的416*416、608*608等尺寸,并对原始图像自适应的添加最少的黑边;

15.s14:利用标记工具对预处理过的图像数据进行标记,生成yolo格式的标注文件。

16.可选的,所述s2包括以下步骤:

17.s21:yolo v5采用cspdarknet作为backbone,从输入图像数据中提取丰富的信息特征;cspdarknet复制基础层的特征映射图,通过dense block发送副本到下一个阶段,从而将基础层的特征映射图分离出来;

18.s22:yolo v5使用panet作为neck来聚合特征,panet基于mask r-cnn和fpn框架,同时加强了信息传播。

19.可选的,所述s2进一步的包括以下步骤:

20.s23:在yolo v5模型中,模型head与之前yolo v3版本的head模型相同,模型head主要用于最终检测部分,它在特征图上应用锚定框,并生成带有类概率、对象得分和包围框的最终输出向量;

21.s24:将标注好的白天与夜晚的数据分别送入模型中进行训练,分别测试单一场景下模型的检测效果。

22.可选的,所述s3包括以下步骤:

23.s31:替换了网络结构中的卷积为可变形卷积;

24.s32:通过focus操作,将原始608*608*3的图像采取切片的操作,先变成304*304*12的特征图,再经过一次拥有32个卷积核的卷积操作,输出304*304*32的特征图;

25.s33:fpn采用自顶向下的结构,将高层的强语义特征传递下来,对整个金字塔进行增强。

26.可选的,所述s3进一步的包括以下步骤:

27.s34:采用giou_loss作为boundingbox的损失函数;假设预测的boundingbox和ground truth boundingbox的坐标分别为:

[0028][0029][0030]

然后loss的计算过程为:

[0031]

第一步:计算bg的面积:

[0032]

第二步:计算b

p

的面积:

[0033]

第三步:计算bg与b

p

的重叠面积:

[0034][0035][0036]

[0037]

第四步:找到可以包含bg与b

p

的最小boxbc;

[0038][0039][0040]

第五步:计算bc的面积:

[0041]

第六步:计算iou=i/u,u=a

p

+a

g-l;

[0042]

第七步:计算

[0043]

第八步:计算最终的损失:l

giou

=1-giou;

[0044]

s35:用优化过的模型重新迭代训练。

[0045]

可选的,所述s4包括以下步骤:

[0046]

s41:以模型不能检测到吊钩上面的红色部分时候作为起始点,对其后3秒的视频流进行抽帧处理获取40到50帧图像数据;

[0047]

s42:通过flask框架搭载前后端交流的pipeline,并将模型部署到预先准备好的服务器上;

[0048]

s43:将天车上摄像头实时拍摄到的视频流传输到服务器中,对视频流进行抽帧处理获得图像数据,对图像数据进行预处理之后输入到模型中进行检测;

[0049]

s44:根据模型的检测结果调用相应的算法判断夹钳是否夹紧,钢卷是否发生倾斜;

[0050]

s45:将是否倾斜的结果信号传输给天车,使得天车可以进行下一步的操作。

[0051]

本发明提供了一种基于图像解析的无人天车钢卷倾斜防范方法。具备以下有益效果:

[0052]

该基于图像解析的无人天车钢卷倾斜防范方法,通过分析处理无人天车夹取以及放下钢卷的过程,获取用于判断钢卷倾斜的图像数据。针对相应的数据集,标定吊钩整体以及吊钩的红色钩子部分。将图像数据以及标签数据输入模型中进行迭代训练,将训练好的模型部署到服务器上,接收来自天车上摄像头的实时数据进行判断。将是否存在倾斜的信号返回给天车,以便于天车进行下一步的安全工作,防止钢卷倾斜发生掉落事故,实现无人天车更加安全的运作生产。

附图说明

[0053]

图1为本发明的一种流程示意图。

具体实施方式

[0054]

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

[0055]

请参阅图1,本发明提供一种技术方案:一种基于图像解析的无人天车钢卷倾斜防范方法,该防范方法包括以下步骤:

[0056]

s1:对无人天车工作视频进行预处理并且构造图像模型数据集。

[0057]

具体的,s1构造数据集的过程包括以下步骤:

[0058]

s11:当无人天车到达要夹取或放置钢卷的正上方的位置时,安装在无人天车下方的摄像头能够实时抓取视频流并进行抽帧处理;

[0059]

s12:采用mosaic数据增强的方式,将图像数据通过随机缩放、随机裁剪、随机排列的方式进行拼接;

[0060]

s13:模型每次训练时,自适应的计算不同训练数据集中的最佳描框值。将图像缩放成固定的416*416、608*608等尺寸,并对原始图像自适应的添加最少的黑边,提升目标检测速度;

[0061]

s14:利用标记工具对预处理过的图像数据进行标记,生成yolo格式的标注文件。

[0062]

s2:分别利用白天和夜晚两种场景下的数据集进行训练迭代,完成图像识别模型的构建和训练。

[0063]

步骤s2模型训练的过程还包括:

[0064]

s21:yolo v5采用cspdarknet作为backbone,从输入图像数据中提取丰富的信息特征;cspdarknet复制基础层的特征映射图,通过dense block发送副本到下一个阶段,从而将基础层的特征映射图分离出来。这样可以有效缓解梯度消失问题,支持特征传播,鼓励网络重用特征,从而减少网络参数数量;

[0065]

s22:yolo v5使用panet作为neck来聚合特征,panet基于mask r-cnn和fpn框架,同时加强了信息传播。该网络的特征提取器第三条通路的每个阶段都将前一阶段的特征映射作为输入,并用3x3卷积层处理它们。输出通过横向连接被添加到自上而下通路的同一阶段特征图中,这些特征图为下一阶段提供信息。同时使用自适应特征池化(adaptive feature pooling)恢复每个候选区域和所有特征层次之间被破坏的信息路径,聚合每个特征层次上的每个候选区域,避免被任意分配;

[0066]

s23:在yolo v5模型中,模型head与之前yolo v3版本的head模型相同。模型head主要用于最终检测部分,它在特征图上应用锚定框,并生成带有类概率、对象得分和包围框的最终输出向量;

[0067]

s24:将标注好的白天与夜晚的数据分别送入模型中进行训练,分别测试单一场景下模型的检测效果。

[0068]

s3:基于目标识别yolo v5算法框架进行改进优化,将部分卷积层替换成可变形卷积,适当增加网络的复杂度,提高模型检测夜晚场景的能力。

[0069]

步骤s3优化网络结构的过程还包括:

[0070]

s31:替换了网络结构中的卷积为可变形卷积;可变形卷积的效果已经被很多工作证明了其有效性,但是增加可变形卷积同时意味着预测时间的增加。因此这里只替换了最后一个stage的3x3卷积为可变形卷积;

[0071]

s32:通过focus操作,将原始608*608*3的图像采取切片的操作,先变成304*304*12的特征图,再经过一次拥有32个卷积核的卷积操作,输出304*304*32的特征图;

[0072]

s33:fpn采用自顶向下的结构,将高层的强语义特征传递下来,对整个金字塔进行增强,不过只增强了语义信息,对定位信息没有传递。pan针对这一点,在fpn的后面添加一个自底向上的金字塔对fpn进行补充,将低层的强定位特征传递上去,丰富特征金字塔;

[0073]

s34:采用giou_loss作为boundingbox的损失函数;假设预测的boundingbox和ground truth boundingbox的坐标分别为:

[0074][0075][0076]

然后loss的计算过程为:

[0077]

第一步:计算bg的面积:

[0078]

第二步:计算b

p

的面积:

[0079]

第三步:计算bg与b

p

的重叠面积:

[0080][0081][0082][0083]

第四步:找到可以包含bg与b

p

的最小boxbc;

[0084][0085][0086]

第五步:计算bc的面积:

[0087]

第六步:计算iou=i/u,u=a

p

+a

g-l;

[0088]

第七步:计算

[0089]

第八步:计算最终的损失:l

giou

=1-giou;

[0090]

s35:用优化过的模型重新迭代训练,提高模型检测的准确性

[0091]

s4:对于模型的输出判断是否存在倾斜,并给无人天车系统传送相应的信号,以便于天车进行下一步的工作。

[0092]

步骤s4判断倾斜的过程还包括:

[0093]

s41:夜晚场景的图像数据为灰度图像,色彩的缺失对于模型的检测造成了极大的困难。除了优化网络结构,在模型的判断方法上也做了相应的改进。根据大量的数据分析,能够发现模型检测一张图片的时间在0.02秒到0.25秒,平均一秒钟可以检测40到50帧图像。模型对于目标小且色彩缺失的既定目标的检测效果不稳定。针对此情况下吊钩是否夹紧钢卷的判断,首先以模型不能检测到吊钩上面的红色部分时候作为起始点,对其后3秒的视频流进行抽帧处理获取40到50帧图像数据。对于抽帧后得到的图像,如果检测出来的吊钩的宽度的变化范围维持在一定的水平即可认为吊钩已处于夹紧状态。经过对于视频流抽帧处理,确保检测时延在1s内。目前对于稳定状态的阈值通过进一步优化标注数据,可将宽度变化阈值设置为5。

[0094]

s42:通过flask框架搭载前后端交流的pipeline,并将模型部署到预先准备好的

服务器上。

[0095]

s43:将天车上摄像头实时拍摄到的视频流传输到服务器中,对视频流进行抽帧处理获得图像数据,对图像数据进行预处理之后输入到模型中进行检测。

[0096]

s44:根据模型的检测结果调用相应的算法判断夹钳是否夹紧,钢卷是否发生倾斜。

[0097]

s45:将是否倾斜的结果信号传输给天车,使得天车可以进行下一步的操作。

[0098]

尽管已经示出和描述了本发明的实施例,对于本领域的普通技术人员而言,可以理解在不脱离本发明的原理和精神的情况下可以对这些实施例进行多种变化、修改、替换和变型,本发明的范围由所附权利要求及其等同物限定。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1