基于多级确认实现人体特征感知的大数据情绪分析系统的制作方法

1.本发明涉及大数据情绪分析技术领域,具体来说,涉及基于多级确认实现人体特征感知的大数据情绪分析系统。

背景技术:

2.随着社会的不断进步和科技的不断发展,当代工作与生活压力也在不断的增大,影响着人们的情绪,导致人们情绪容易出现波动,尤其是随着现代家长对孩子升学教育越来越重视,家长辅导孩子作业时,面对孩子的学习问题,常常心情焦虑乃至生气发火,情绪难以控制。不仅影响亲子关系,也不利于孩子身心健康发展。

3.而当代的年轻人在就业与工作方面,同样面对巨大压力也导致其情绪的不稳定,表现在生活社交的方方面面,导致工作效率降低,甚至对人际交往造成恶劣影响。所以,如何意识到情绪问题以及做到如何控制也越来越需要引起当代人的重视,而情绪的改善可以有效地提高工作效率,缓解各方面的压力。

4.现有技术中存在相当多的情绪鉴定与分析装置或系统,通过对人们微表情的观察或者肢体动作的判断来分析用户的情绪波动,再通过有效的提醒来辅助用户注意自身的反应。但现有的对于情绪的鉴定存在着以下问题,例如对于情绪的鉴定正确率较低,无法通过数据化的信息对用户的情绪进行鉴定;对用户的分析鉴定效果较差,所识别的动作特征或表情情绪不够严谨规范,导致情绪鉴定无法对鉴定之后的情绪进行核实,使得最终的鉴定结果无法达到用户的情绪预期。

5.针对相关技术中的问题,目前尚未提出有效的解决方案。

技术实现要素:

6.针对相关技术中的问题,本发明提出基于多级确认实现人体特征感知的大数据情绪分析系统,以克服现有相关技术所存在的上述技术问题。

7.为此,本发明采用的具体技术方案如下:基于多级确认实现人体特征感知的大数据情绪分析系统,包括:

8.影像采集模块(1),用于获取实时视频图像数据;

9.人像追踪定位模块(2),用于利用追踪定位算法控制所述影像采集模块(1)的运行,以捕捉定位所述视频图像数据内人像数据;

10.人体特征感知模块(3),用于对所述人像数据进行识别,提取肢体特征量和面部特征量;

11.情绪分析模块(4),用于将所述肢体特征量和所述面部特征量分别与情绪数据库中的历史数据进行对比,确定用户肢体情绪和用户面部表情情绪,根据用户肢体情绪和用户面部表情情绪确定用户情绪;

12.反馈显示模块(5),用于反馈与显示情绪分析结果。

13.进一步地,所述影像采集模块(1)包括全景摄像头与变焦摄像头;所述全景摄像头

用于获取区域内全景视频图像数据;

14.所述人像追踪定位模块(2)用于根据所述全景视频图像数据获取帧差图像,根据帧差图像确定人像目标相对所述视频图像数据初始状态;还用于根据初始状态所述调整所述变焦摄像头的拍摄角度及焦距,以更清晰地捕捉定位所述人像数据。

15.进一步地,所述人像追踪定位模块(2)用于对所述全景摄像头进行标定,得到标定参数;

16.将所述全景摄像头拍摄的前一帧灰度图像与当前帧的灰度图像进行帧间差分,获得帧差图像;

17.检测所述帧差图像中的外轮廓,并取其中最大的轮廓作为检测得到的人像目标;

18.计算所述人像目标的中心像素的坐标数据及目标高度;

19.利用所述人像目标的中心像素坐标数据及所述标定参数计算人体在所述视频图像数据内的观测角度;

20.根据所述观测角度调整变焦摄像头的拍摄角度,且根据所述人像目标的目标高度调整所述变焦摄像头的焦距。

21.进一步地,所述帧间差分的计算公式为:

[0022][0023]

其中,id(x,y)为帧差图像,ic(x,y)与i

p

(x,y)分别表示前一帧与当前帧的图像,thr为差分阈值,abs为取绝对值。

[0024]

进一步地,所述人体特征感知模块(3)包括肢体感知模块(301)和面部感知模块(302);

[0025]

所述肢体感知模块(301)用于识别与提取所述人像数据内人体的骨架信息,并根据预设的网络模型单元对所述骨架信息进行分析,以提取人体运动的特征量;

[0026]

所述面部感知模块(302)用于识别与提取人像数据内面部的五官信息,并根据预设的网络模型单元对所述五官信息进行分析,以提取面部表情的特征量。

[0027]

进一步地,所述肢体感知模块(301)的原理包括以下步骤:所述肢体感知模块(301)用于接收与识别所述人像数据,并截取至少一帧图像以确定肢体所在位置;

[0028]

从截取的区域图像内提取人体的骨架信息;

[0029]

根据所述骨架信息构建人体坐标模型,并输出骨架信息中关键点的坐标位置;

[0030]

将预定时间内的骨架信息的坐标位置整合成张量依次输入到所述网络模型单元内的卷积神经网络模型和递归神经网络模型中,得到肢体动作特征向量;

[0031]

利用变换矩阵对肢体动作特征向量进行坐标变换,并基于相似度函数对经过变换的肢体动作特征向量进行计算,得到人体肢体运动部分的肢体特征量。

[0032]

进一步地,所述面部感知模块的原理包括以下步骤:

[0033]

若所述人像数据中存在面部图像,则定位与提取面部图像数据;

[0034]

将面部图像数据进行不同尺度的变换,构建图像金字塔;

[0035]

通过全卷积网络模型进行初步特征提取,并标定边框,根据已标定的边框进行边框回归调整窗口,再通过非极大值抑制进行窗口的过滤;

[0036]

通过监督识别面部图像对特征点进行回归,并输出面部坐标信息,构建面部坐标模型;

[0037]

对面部坐标模型进行去噪,去除表面噪点;

[0038]

利用训练好的网络模型单元整合面部坐标信息合成张量并输入到递归神经网络模型中进行处理,得到面部动作特征向量;

[0039]

利用变换矩阵对面部动作特征向量进行坐标变换,利用相似度函数对经过坐标变换的面部动作特征向量进行计算,得到面部运动部分的面部特征量。

[0040]

进一步地,所述相似度函数公式为:

[0041][0042]

其中,d(xi,yj)为种类xi和种类xj的相似度,mi为种类i的均值向量,mj为种类j的均值向量,与为种类i和种类j的类内方差。

[0043]

进一步地,还包括:

[0044]

云端服务器模块(6),用于同步与更新大数据库;

[0045]

处理控制模块(7),用于实现系统的智能化调度与控制;

[0046]

外设输入模块(8),用于连接外部设备并进行输入。

[0047]

进一步地,所述反馈显示模块(5)包括显示单元、告警单元及提醒建议单元。

[0048]

本发明的有益效果为:通过设置智能化影像采集及追踪定位,能够精确捕捉视频图像中人体所在区域并形成稳定高清的人像数据,从而在基础上保证人体特征感知的精确度;再通过对人体肢体特征与面部特征的单独识别、建模及特征量检测,形成肢体语言与表情语言相配合的情绪分析系统,大大提高检测的准确度与可信性,同时配合实时更新的大数据库并与其进行的对比分析,能够保证情绪分析系统的实时性与精确性,提高系统的自适应学习能力,更具人性化。

附图说明

[0049]

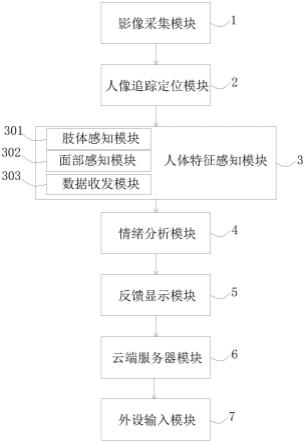

为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

[0050]

图1是根据本发明实施例的基于多级确认实现人体特征感知的大数据情绪分析系统的结构框图。

[0051]

图中:

[0052]

1、影像采集模块;2、人像追踪定位模块;3、人体特征感知模块;301、肢体感知模块;302、面部感知模块;303、数据收发模块;4、情绪分析模块;5、反馈显示模块;6、云端服务器模块;7、处理控制模块;8、外设输入模块。

具体实施方式

[0053]

根据本发明的实施例,提供了基于多级确认实现人体特征感知的大数据情绪分析系统。

[0054]

现结合附图和具体实施方式对本发明进一步说明,如图1所示,根据本发明实施例的基于多级确认实现人体特征感知的大数据情绪分析系统,包括以下模块组成:

[0055]

影像采集模块1,用于获取实时视频图像数据,其包括全景摄像头与变焦摄像头;

[0056]

其中,所述全景摄像头用于获取区域内全景视频图像数据,所述变焦摄像头用于进行拍摄角度及焦距的调整,获取视频图像数据内的人像数据。

[0057]

人像追踪定位模块2,该模块利用追踪定位算法控制所述影像采集模块1的运行,以捕捉定位所述视频图像数据内人像数据。

[0058]

人体特征感知模块3,用于对所述人像数据进行识别,提取肢体特征量和面部特征量;

[0059]

情绪分析模块4,用于将所述肢体特征量和所述面部特征量分别与情绪数据库中的历史数据进行对比,确定用户肢体情绪和用户面部表情情绪,根据用户肢体情绪和用户面部表情情绪确定用户情绪;

[0060]

反馈显示模块5,用于反馈与显示情绪分析结果。

[0061]

具体地,所述人像追踪定位模块2用于根据所述全景视频图像数据获取帧差图像,根据帧差图像确定人像目标相对所述视频图像数据初始状态;还用于根据初始状态所述调整所述变焦摄像头的拍摄角度及焦距,以更清晰地捕捉定位所述人像数据。

[0062]

其中,所述追踪定位算法包括以下步骤:

[0063]

s21、对所述全景摄像头进行标定,得到标定参数;

[0064]

s22、将所述全景摄像头拍摄的前一帧灰度图像与当前帧的灰度图像进行帧间差分,获得帧差图像;

[0065]

s23、检测所述帧差图像中的外轮廓,并取其中最大的轮廓作为检测得到的人像目标;

[0066]

s24、计算所述人像目标的中心像素的坐标数据及目标高度;

[0067]

s25、利用所述人像目标的中心像素坐标数据及所述标定参数计算人体在所述视频图像数据内的观测角度;

[0068]

s26、根据所述观测角度调整变焦摄像头的拍摄角度,且根据所述人像目标的目标高度调整所述变焦摄像头的焦距。

[0069]

在一个实施例中,所述帧间差分的计算公式为:

[0070][0071]

其中,id(x,y)为帧差图像,ic(x,y)与i

p

(x,y)分别表示前一帧与当前帧的图像,thr为差分阈值,abs为取绝对值。

[0072]

人体特征感知模块3,用于对所述人像数据进行识别,提取肢体特征量和面部特征量;

[0073]

该模块包括肢体感知模块301、面部感知模块302及数据收发模块303,所述肢体感

知模块(301)用于识别与提取所述人像数据内人体的骨架信息,并根据预设的网络模型单元对所述骨架信息进行分析,以提取人体运动的特征量;

[0074]

所述面部感知模块(302)用于识别与提取人像数据内面部的五官信息,并根据预设的网络模型单元对所述五官信息进行分析,以提取面部表情的特征量。所述肢体感知模块301包括肢体识别单元、肢体建模单元、网络模型单元及肢体特征量检测单元,所述面部感知模块302包括面部识别单元、面部建模单元、网络模型单元及面部特征量检测单元;

[0075]

其中,所述肢体识别单元用于识别与提取所述人像数据内人体的骨架信息,所述肢体建模单元用于构建人体坐标模型,所述肢体特征量检测单元用于提取人体运动的特征量;所述面部识别单元用于识别与提取人像数据内面部的五官信息,所述面部建模单元用于构建面部坐标模型,所述面部特征量检测单元用于提取面部表情的特征量。

[0076]

在一个实施例中,所述肢体感知模块301的原理包括以下步骤:

[0077]

s31、接收与识别所述人像数据,并截取至少一帧图像并确定肢体所在位置;

[0078]

s32、所述肢体识别单元从截取的区域图像内提取人体的骨架信息;

[0079]

s33、所述肢体建模单元根据所述骨架信息构建人体坐标模型,并输出骨架信息关键点坐标位置;

[0080]

s34、将预定时间内的人体骨架信息的坐标位置整合成张量依次输入到所述网络模型单元内的卷积神经网络模型中;

[0081]

s35、将所述卷积神经网络模型的输出输入到递归神经网络模型中,得到肢体动作特征向量;

[0082]

s36、所述肢体特征量检测单元利用变换矩阵对特征变化量进行坐标变换,并基于相似度函数对经过变换的肢体动作特征向量进行计算,得到人体肢体运动部分的肢体特征量。

[0083]

在一个实施例中,所述面部感知模块的原理包括以下步骤:

[0084]

s31

′

、若所述人像数据中存在面部图像,则利用所述面部识别单元定位与提取面部图像数据;

[0085]

s32

′

、通过所述面部建模单元将人脸图像数据进行不同尺度的变换,构建图像金字塔;

[0086]

s33

′

、通过全卷积网络模型进行初步特征提取与标定边框,并标定边框,根据已标定的边框进行边框回归调整窗口,再通过非极大值抑制进行窗口的过滤;

[0087]

s34

′

、通过监督识别面部图像对特征点进行回归,并输出面部坐标信息,构建面部坐标模型;

[0088]

s35

′

、对面部坐标模型进行去噪,去除表面噪点;

[0089]

s36

′

、利用训练好的网络模型单元整合面部坐标信息合成张量并输入到递归神经网络模型中进行处理,得到面部动作特征向量;

[0090]

s37

′

、所述面部特征量检测单元利用变换矩阵对面部动作特征向量进行坐标变换,利用相似度函数计算得到面部运动部分的面部特征量。

[0091]

在一个实施例中,所述相似度函数公式为:

[0092][0093]

其中,d(xi,yj)为种类xi和种类xj的相似度,mi为种类i的均值向量,mj为种类j的均值向量,与为种类i和种类j的类内方差。

[0094]

情绪分析模块4,用于根据所述特征值进行情绪分析;

[0095]

其中,所述情绪分析模块4包括肢体分析单元、面部分析单元及情绪数据库;

[0096]

所述肢体分析单元用于接收肢体特征量并通过与情绪数据库中的历史数据进行对比,实现鉴定与分析,确定用户肢体情绪;所述面部分析单元用于接收面部特征量并通过情绪数据库中的历史数据进行对比,实现鉴定与分析,确定用户面部表情情绪;所述情绪数据库通过所述云端服务器模块6实现实时更新与数据传输。

[0097]

反馈显示模块5,用于反馈与显示情绪分析结果;

[0098]

其中,所述反馈显示模块5包括显示单元、告警单元及提醒建议单元。

[0099]

云端服务器模块6,用于同步与更新大数据库;

[0100]

处理控制模块7,用于实现系统的智能化调度与控制;

[0101]

外设输入模块8,用于连接外部设备并进行输入。

[0102]

综上所述,借助于本发明的上述技术方案,通过设置智能化影像采集及追踪定位,能够精确捕捉视频图像中人体所在区域并形成稳定高清的人像数据,从而在基础上保证人体特征感知的精确度;再通过对人体肢体特征与面部特征的单独识别、建模及特征量检测,形成肢体语言与表情语言相配合的情绪分析系统,大大提高检测的准确度与可信性,同时配合实时更新的大数据库并与其进行的对比分析,能够保证情绪分析系统的实时性与精确性,提高系统的自适应学习能力,更具人性化。

[0103]

以上所述仅为本发明的较佳实施例而已,并不用以限制本发明,凡在本发明的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1