图像生成方法、图像生成装置及相关设备与流程

1.本发明涉及技术领域,特别是涉及一种图像生成方法、图像生成装置及相关设备。

背景技术:

2.人脸风格化指的是将视频或图片中真实的人脸图像转换成不同风格的人脸图像。在进行人脸风格化的过程中通常需要将真实的人脸图像输入至风格迁移模型中进行风格迁移,从而得到不同风格的该人脸的图像。

3.在对风格迁移模型进行训练的过程中,需要的训练样本至少为几千个图像组或几万个图像组,每一个图像组中均需要包括真实人脸图像和与其对应的风格化人脸图像。由于风格迁移模型训练所需的图像组数量较大,在网络上难以直接获取,通常需要人工绘制。因此,现有技术中存在获得风格迁移模型所使用的训练样本的成本和难度较大的问题。

技术实现要素:

4.本发明实施例的目的在于提供一种图像生成方法、图像生成装置及相关设备,以降低获取风格迁移模型所使用的训练样本的成本和难度。具体技术方案如下:

5.在本发明实施的第一方面,首先提供了一种图像生成方法,包括:

6.利用具有目标人脸风格的目标数据集,对预先训练的stylegan模型进行训练和模型参数调整,得到风格化模型,所述风格化模型用于生成具有所述目标人脸风格的人脸图像;

7.将随机噪声分别输入至所述stylegan模型和所述风格化模型,以使所述stylegan模型基于所述随机噪声输入得到第一人脸图像,所述风格化模型基于所述随机噪声输入和所述第一人脸图像得到第二人脸图像,所述第二人脸图像是将所述第一人脸图像进行风格迁移后,得到的具有所述目标人脸风格的人脸图像。

8.可选地,所述stylegan模型基于所述随机噪声输入得到所述第一人脸图像,包括:

9.所述stylegan模型的第一映射层基于所述随机噪声输入进行特征提取,得到第一隐藏特征;所述第一隐藏特征用于表征所述第一人脸图像中人脸区域的属性;

10.将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一目标特征;所述第一平均特征基于所述stylegan模型每一次训练时所述第一映射层输出的结果确定;

11.所述stylegan模型的第一综合模块基于所述第一目标特征输入进行图像生成,得到所述第一人脸图像。

12.可选地,所述将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一目标特征,包括:

13.将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一中间特征;

14.对所述第一中间特征对应的参数进行调整,得到所述第一目标特征。

15.可选地,所述风格化模型基于所述随机噪声输入和所述第一人脸图像得到所述第二人脸图像,包括:

16.所述风格化模型的第二映射层基于所述随机噪声输入进行特征提取,得到第二隐藏特征,所述第二隐藏特征用于表征所述第二人脸图像中人脸区域的属性;

17.将所述第二隐藏特征与预设的第二平均特征进行加权处理,得到第二目标特征;所述第二平均特征基于所述风格化模型每一次训练时所述第二映射层输出的结果确定;

18.所述风格化模型的第二综合模块基于所述第二目标特征输入和所述第一人脸图像输入进行图像生成,得到所述第二人脸图像。

19.可选地,所述将随机噪声分别输入至所述stylegan模型和所述风格化模型,获得第一人脸图像以及第二人脸图像,包括:

20.将所述stylegan模型和所述风格化模型进行混合,得到混合模型;其中,所述混合模型包括所述stylegan模型和所述风格化模型,且所述stylegan模型的第一综合模块的输出端与所述风格化模型的第二综合模块的输入端连接;

21.将所述随机噪声输入至所述stylegan模型和所述混合模型进行图像生成,得到第一人脸图像以及第二人脸图像。

22.可选地,所述利用具有目标人脸风格的目标数据集,对预先训练的stylegan模型进行训练和模型参数调整得到风格化模型之后,所述方法还包括:

23.获取样本真实图像的第三隐藏特征,所述第三隐藏特征用于表征所述样本真实图像中人脸区域的属性;

24.将所述第三隐藏特征与预设的所述第二平均特征进行加权处理,得到第三目标特征;

25.所述stylegan模型的第一综合模块基于所述第三隐藏特征输入进行图像生成,得到第一真实图像;

26.所述风格化模型的第二综合模块基于所述第三目标特征输入和所述第一真实图像输入进行图像生成,得到第二真实图像;所述第二真实图像是将所述第一真实图像进行风格迁移后,具有所述目标人脸风格的人脸图像。

27.可选地,所述将随机噪声分别输入至所述stylegan模型和所述风格化模型,获得第一人脸图像以及第二人脸图像之后,所述方法还包括:

28.确定所述样本真实图像中背景区域的属性,以及确定所述第二真实图像中背景区域的属性;

29.使用所述样本真实图像中背景区域的属性替换所述第二真实图像中背景区域的属性。

30.在本发明实施的第二方面,提供了一种图像生成装置,包括:

31.处理模块,用于利用具有目标人脸风格的目标数据集,对预先训练的stylegan模型进行训练和模型参数调整,得到风格化模型,所述风格化模型用于生成具有所述目标人脸风格的人脸图像;

32.输入模块,用于将随机噪声分别输入至所述stylegan模型和所述风格化模型,以使所述stylegan模型基于所述随机噪声输入得到第一人脸图像,所述风格化模型基于所述随机噪声输入和所述第一人脸图像得到第二人脸图像,所述第二人脸图像是将所述第一人脸图像进行风格迁移后,得到的具有所述目标人脸风格的人脸图像。

33.在本发明实施的第三方面,提供了一种电子设备,包括处理器、通信接口、存储器

和通信总线,其中,处理器,通信接口,存储器通过通信总线完成相互间的通信;

34.存储器,用于存放程序;

35.处理器,用于执行存储器上所存放的程序时,实现如第一方面所述的方法步骤。

36.在本发明实施的第三方面,提供了一种可读存储介质,其上存储有程序,该程序被处理器执行时实现如第一方面所述的方法。

37.在本发明实施例中,通过将随机噪声分别输入至所述stylegan模型和所述风格化模型,以获得第一人脸图像以及第二人脸图像。一方面,所述stylegan模型基于所述随机噪声输入得到所述第一人脸图像,所述第一人脸图像为真实人脸图像。另一方面,所述风格化模型基于所述随机噪声输入和所述第一人脸图像得到所述第二人脸图像,所述第二人脸图像为所述第一人脸图像对应的风格化图像。这样,通过本发明实施例提供的方法即可大量地稳定地生成用于对风格迁移模型进行训练的样本数据,降低了获得风格迁移模型所使用的训练样本的成本和难度。

附图说明

38.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍。

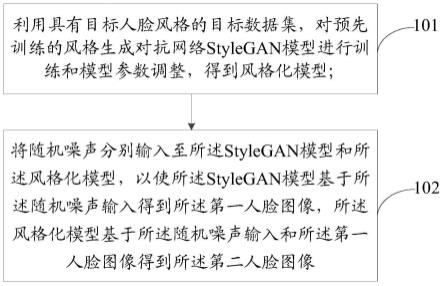

39.图1为本发明实施例中一种图像生成方法的流程示意图;

40.图2为本发明实施例中一种stylegan2模型的结构示意图;

41.图3为本发明实施例中一种风格化模型的结构示意图;

42.图4为本发明实施例中一种混合模型的结构示意图;

43.图5为本发明实施例中一种获得混合模型的流程示意图;

44.图6为本发明实施例中一种数据处理的流程示意图;

45.图7为本发明实施例中一种图像生成装置的结构示意图;

46.图8是本发明实施例中一种电子设备的结构图。

具体实施方式

47.下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行描述。

48.如图1所示,本发明实施例提供了一种图像生成方法,包括以下步骤:

49.步骤101,利用具有目标人脸风格的目标数据集,对预先训练的风格生成对抗网络(style generative adversarial network,stylegan)模型进行训练和模型参数调整,得到风格化模型,所述风格化模型用于生成具有所述目标人脸风格的人脸图像;

50.步骤102,将随机噪声分别输入至所述stylegan模型和所述风格化模型,以使所述stylegan模型基于所述随机噪声输入得到所述第一人脸图像,所述风格化模型基于所述随机噪声输入和所述第一人脸图像得到所述第二人脸图像,所述第二人脸图像是将所述第一人脸图像进行风格迁移后,得到的具有所述目标人脸风格的人脸图像。

51.应理解的是,对stylegan模型预先进行训练时所使用的训练数据集可以为任意数据集,在一些实施例中,所使用的所述训练数据集为开源的大样本数据集。例如,在一些实施例中,使用的所述训练数据集可以为雅虎网络相册高质量人脸(flickr-faces-high-quality(flickr-faces-hq),ffhq)数据集。在另一些实施例中,使用的所述训练数据库可

以为公众人物脸部数据库(public figures face database,pubfig)。

52.应理解的是,所述stylegan模型的具体结构在此不做限定。在具体实现时,所述stylegan模型可以为stylegan基础模型或在stylegan基础模型上进行优化得到的模型。例如,在一些实施例中,所述stylegan模型也可以为stylegan2模型。

53.为了方便描述,在后续的实施例中,所述stylegan模型均为所述预先训练的stylegan模型,且将使用所述stylegan模型为stylegan2模型的情况为例进行说明。

54.应理解的是,人脸风格可以理解为图像中人脸各处的显示风格,包括脸型、人脸表情、人脸朝向、发型、人脸肤色、人脸光照、头发丝形状、头发颜色和皱纹等不同的人脸属性。

55.所述目标数据集具有所述目标人脸风格可以理解为,所述目标数据集内的所有样本图像均具有所述目标人脸风格。所述目标数据集可以为任意数据集。例如,在一些实施例中,所述目标数据集可以为自建数据集,即通过采集具有所述目标人脸风格的图像来建立所述目标数据集。在另一些实施例中,所述目标数据集也可以为开源数据集。

56.在具体实现时,由于同一画师的作品中的五官画法、笔触、颜色涂法等较为统一,因此可以认为同一画师的作品通常具有相同的人脸风格。因此可以采集任一画师的作品集作为所述目标数据集,该画师作品具有的人脸风格即为所述目标数据集所具有的所述目标人脸风格。

57.需要说明的是,根据使用的所述目标数据集具有的所述目标人脸风格不同,训练得到的所述风格化模型生成的所述第二人脸图像所具有的所述目标人脸风格也不同。

58.由于stylegan2模型为预先训练的,因此在对stylegan2模型进行训练和模型参数调整时,使用的所述目标数据集可以为大样本数据集或小样本数据集。例如,在一些实施例中,所述目标数据集中包括的样本数量的范围为50~2000。在另一些实施例中,所述目标数据集中包括的样本数量的范围为80~300。

59.在具体实现时,小样本数据集的获取难度通常要小于大样本数据集的获取难度,而利用大样本数据集进行模型训练通常可以获得较好的效果。因此,在本实施例中,首先可以利用大样本数据集预先训练stylegan2模型,获得较好的训练效果。然后利用所述目标数据集,对stylegan2模型进行训练和模型参数调整,得到风格化模型。通过上述设置,一方面提高了所述风格化模型的训练效果,另一方面降低了所述目标数据集的获取难度。

60.在一些实施例中,由于所述目标数据集可以为小样本数据集,在利用所述目标数据集对stylegan2模型进行训练和模型参数调整的过程中,可能会出现过拟合的情况。因此,在一些实施例中,为了提高训练的效果,对stylegan2模型进行训练也可以理解为,通过风格生成对抗网络-自适应鉴别器增强(style generative adversarial network-adaptive discriminator augmentation,stylegan-ada)方法和早停(early stop)法对stylegan2模型进行训练。更进一步地,在另一些实施例中,对stylegan2模型进行训练还可以理解为,通过stylegan-ada方法、冻结鉴别器(freeze the discriminator,freezed)方法和early stop方法对stylegan2模型进行训练。

61.对stylegan2模型进行模型参数调整可以理解为,对stylegan2模型进行微调(finetune)。具体地,在对stylegan2模型进行训练得到训练好的stylegan2模型后,在训练好的stylegan2模型的基础上,对至少一个网络层的参数进行调整,从而得到所述风格化模型。

62.在具体实现时,可以对stylegan2模型进行多次的训练和多次的模型参数调整,得到不同的风格化模型。然后再对得到的多个所述风格化模型的风格迁移效果进行对比,从而确定最终的所述风格化模型,其中,所述风格化模型用于生成具有所述目标人脸风格的人脸图像。

63.将所述随机噪声输入至stylegan2模型后,stylegan2模型可以基于所述随机噪声输入生成所述第一人脸图像。在本实施例中,所述第一人脸图像可以认为是人脸风格为真实人脸风格的人脸图像。

64.将所述随机噪声输入至所述风格化模型后,所述风格化模型可以基于所述随机噪声输入生成所述第二人脸图像。在本实施例中,所述第二人脸图像是将所述第一人脸图像进行风格迁移后,得到的具有所述目标人脸风格的人脸图像。具体地,所述第二人脸图像的人脸内容基于所述第一人脸图像的人脸内容生成,但所述第二人脸图像具有所述目标人脸风格。

65.应理解的是,所述第一人脸图像和第二人脸图像可以认为是一个图像组,该图像组中包括真实人脸图像及其对应的风格化人脸图像。所述第一人脸图像可以理解为生成的真实人脸图像,所述第二人脸图像可以理解为所述第一人脸图像对应的风格化人脸图像。

66.需要说明的是,将随机噪声分别输入至stylegan2模型和所述风格化模型后,可以获得第一人脸图像以及第二人脸图像。因此,输入stylegan2模型和所述风格化模型的随机噪声相同。

67.在本发明实施例中,通过将随机噪声分别输入至所述stylegan模型和所述风格化模型,以获得第一人脸图像以及第二人脸图像。一方面,所述stylegan模型基于所述随机噪声输入得到所述第一人脸图像,所述第一人脸图像为真实人脸图像。另一方面,所述风格化模型基于所述随机噪声输入和所述第一人脸图像得到所述第二人脸图像,所述第二人脸图像为所述第一人脸图像对应的风格化图像。这样,通过本发明实施例提供的方法即可大量地稳定地生成用于对风格迁移模型进行训练的样本数据,降低了获得风格迁移模型所使用的训练样本的成本和难度。

68.应理解的是,stylegan2模型基于所述随机噪声输入得到所述第一人脸图像的具体方法在此不做限定。可选地,在一些实施例中,所述stylegan2模型基于所述随机噪声输入得到所述第一人脸图像,具体包括以下步骤:

69.所述stylegan2模型的第一映射层基于所述随机噪声输入进行特征提取,得到第一隐藏特征;所述第一隐藏特征用于表征所述第一人脸图像中人脸区域的属性;

70.将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一目标特征;所述第一平均特征基于所述stylegan2模型每一次训练时所述第一映射层输出的结果确定;

71.所述stylegan2模型的第一综合模块基于所述第一目标特征输入进行图像生成,得到所述第一人脸图像。

72.请参见图2,图2为本发明实施例中一种stylegan2模型的结构示意图。如图2所示,stylegan2模型包括第一映射层和第一综合模块。在一些实施例中,所述第一映射层也可以称为第一映射网络(mapping network),所述第一综合模块也可以称为第一综合网络(synthesis network)。

73.具体地,所述第一映射层用于基于所述随机噪声输入进行特征提取,得到第一隐藏特征,其中,第一隐藏特征也可以理解为用于表征所述第一人脸图像中人脸区域的属性的潜向量或潜在因子(latent code)。在具体实现时,人脸图像中人脸区域的不同属性之间通常互相关联且耦合性较高,latent code为对上述不同属性进行解耦后得到的特征。

74.由上可知,在本实施例中,通过所述第一映射层基于所述随机噪声输入进行特征提取,得到第一隐藏特征,可以提高对所述第一人脸图像中人脸区域的属性的表征效果,同时还提高了对所述第一人脸图像中人脸区域的不同属性进行调整的操作便捷性。

75.在所述第一映射层得到所述第一隐藏特征后,需要将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一目标特征。其中,所述第一平均特征基于所述stylegan2模型每一次预训练时所述第一映射层输出的结果确定。在本实施例中,将所述第一隐藏特征与预设的第一平均特征进行加权处理的过程中,所述第一隐藏特征和所述第一平均特征的权重在此不做限定。

76.应理解的是,所述第一平均特征基于所述stylegan2模型每一次训练时所述第一映射层输出的结果确定的具体方式在此不做限定。例如,在一些实施例中,在预先训练stylegan2模型时,记录每一次训练过程中所述第一映射层输出的结果,并基于每一次训练过程中所述第一映射层输出的结果确定均值,该均值即为所述第一平均特征。进一步地,在另一些实施例中,也可以剔除异常数据后,基于其他次训练过程中所述第一映射层输出的结果确定所述第一平均特征。

77.在本实施例中,通过将所述第一隐藏特征与预设的第一平均特征进行加权处理,再调整所述第一隐藏特征和所述第一平均特征的权重,可以使得所述第一目标特征的取值范围更加合理,从而提高所述第一人脸图像的生成效果,同时提高所述第一人脸图像的生成稳定性。

78.可选地,在一些实施例中,所述将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一目标特征,包括:

79.将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一中间特征;

80.对所述第一中间特征对应的参数进行调整,得到所述第一目标特征。

81.具体地,所述第一隐藏特征和所述第一平均特征均可以表示为高维向量,因此,在将所述第一隐藏特征与所述第一平均特征进行加权处理后,得到的所述第一中间特征也可以表示为高维向量。

82.应理解的是,所述第一中间特征对应的高维向量中的每一个元素均可以理解为所述第一中间特征的一个参数,或,理解为表征所述第一人脸图像中人脸区域的一个属性。因此,对所述第一中间特征对应的参数进行调整也可以理解为对高维向量中的元素进行编辑,从而达到编辑所述第一人脸图像中人脸区域的属性的效果。

83.为了方便理解,下面将举例说明。例如,在一个实施例中,所述第一人脸图像中人脸区域的属性包括亚洲人、张嘴、闭眼、转头、仰头和低头,且上述属性均可进行编辑。

84.由上可知,在本实施例中,所述第一中间特征为六维向量,且该六维向量中的每一个元素均与上述一个属性一一对应。在确定属性与元素的对应关系后,即可以通过调整对应的元素来对属性进行编辑。

85.例如,在一种情况下,希望所述第一人脸图像中的人脸为张嘴姿态,此时可以对该

六维向量中的第二个元素进行相应的调整,使得该六维向量表征的属性为张嘴姿态。又例如,在另一种情况下,希望所述第一人脸图像中的人脸为亚洲人且处于闭眼姿态,此时可以对该六维向量中的第一个元素和第三个元素均进行相应的调整,使得该六维向量表征的属性为亚洲人且为闭眼姿态。

86.在本实施例中,在将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一中间特征后,可以对所述第一中间特征对应的参数进行调整,得到所述第一目标特征。通过对所述第一中间特征对应的参数进行调整,可以得到不同的所述第一目标特征。根据所述第一目标特征的不同,所述第一人脸图像中人脸区域的属性也不同,从而使得所述第一样本图像中的人脸姿态不同。因此,通过上述设置,可以得到不同姿态的所述第一人脸图像,进一步地提高了数据的丰富性。

87.应理解的是,stylegan2模型的第一综合模块用于基于所述第一目标特征输入进行图像生成,得到所述第一人脸图像,所述第一人脸图像中人脸区域的属性基于所述第一目标特征确定。

88.其中,所述第一综合模块的结构在此不做限定。在一些实施例中,所述第一综合模块通常包括至少两个依次连接的第一图像处理层;且所述第一图像处理层输出的结果的分辨率自上层至下层逐渐提高。其中,所述第一图像处理层的数量和具体结构在此不做限定。

89.因此,stylegan2模型的第一综合模块基于所述第一目标特征输入进行图像生成,得到所述第一人脸图像也可以理解为,将所述第一目标特征输入所述第一综合模块的每一所述第一图像处理层。换言之,每一所述第一图像处理层均可以基于上一所述第一图像处理层输入以及所述第一目标特征输入进行图像处理,并将处理后的结果输入至下一所述第一图像处理层。在所述第一图像处理层为最上层所述第一图像处理层时,该第一图像处理层基于所述第一目标特征输入生成图像。在所述第一图像处理层为最下层所述第一图像处理层时,该第一图像处理层输出的结果为所述第一人脸图像。

90.应理解的是,所述风格化模型基于所述随机噪声输入和所述第一人脸图像得到所述第二人脸图像的具体方法在此不做限定。可选地,在一些实施例中,所述风格化模型基于所述随机噪声输入和所述第一人脸图像得到所述第二人脸图像,具体包括以下步骤:

91.所述风格化模型的第二映射层基于所述随机噪声输入进行特征提取,得到第二隐藏特征,所述第二隐藏特征用于表征所述第二人脸图像中人脸区域的属性;

92.将所述第二隐藏特征与预设的第二平均特征进行加权处理,得到第二目标特征;所述第二平均特征基于所述风格化模型每一次训练时所述第二映射层输出的结果确定;

93.所述风格化模型的第二综合模块基于所述第二目标特征输入和所述第一人脸图像输入进行图像生成,得到所述第二人脸图像。

94.请参见图3,图3为本发明实施例中一种风格化模型的结构示意图。如图3所示,所述风格化模型包括第二映射层和第二综合模块。在一些实施例中,所述第二映射层也可以称为第二mapping network,所述第二综合模块也可以称为第二synthesis network。

95.具体地,所述第二映射层用于基于所述随机噪声输入进行特征提取,得到第二隐藏特征,其中,第二隐藏特征也可以理解为用于表征所述第二人脸图像中人脸区域的属性的latent code。

96.由上可知,在本实施例中,通过所述第二映射层基于所述随机噪声输入进行特征

提取,得到第二隐藏特征,可以提高对所述第二人脸图像中人脸区域的属性的表征效果,同时还提高了对所述第二人脸图像中人脸区域的不同属性进行调整的操作便捷性。

97.在所述第二映射层得到所述第二隐藏特征后,需要将所述第二隐藏特征与预设的第二平均特征进行加权处理,得到第二目标特征。其中,所述第二平均特征基于所述风格化模型每一次训练时所述第二映射层输出的结果确定。在本实施例中,将所述第二隐藏特征与所述第二平均特征进行加权处理的过程中,所述第二隐藏特征和所述第二平均特征的权重在此不做限定。

98.应理解的是,所述第二平均特征基于所述风格化模型每一次训练时所述第二映射层输出的结果确定的具体方式在此不做限定。例如,在一些实施例中,在预先训练风格化模型时,记录每一次训练过程中所述第二映射层输出的结果,并基于每一次训练过程中所述第二映射层输出的结果确定均值,该均值即为所述第二平均特征。进一步地,在另一些实施例中,也可以剔除异常数据后,基于其他次训练过程中所述第二映射层输出的结果确定所述第二平均特征。

99.在本实施例中,通过将所述第二隐藏特征与预设的第二平均特征进行加权处理,再调整所述第二隐藏特征和所述第二平均特征的权重,可以使得所述第二目标特征的取值范围更加合理,从而提高所述第二人脸图像的生成效果,同时提高所述第二人脸图像的生成稳定性。

100.同时,所述风格化模型用于对所述第一人脸图像进行风格迁移,因此通过调整所述第二隐藏特征和所述第二平均特征的权重,可以控制所述风格化模型用于对所述第一人脸图像进行风格迁移的强度,或者说风格化强度。因此,在所述第二隐藏特征和所述第二平均特征的权重不同的情况下,根据风格化强度的不同,所述目标人脸风格也可以包括多个目标人脸子风格,从而得到更符合需求的风格化效果。

101.应理解的是,风格化模型的第二综合模块用于基于所述第二目标特征输入进行图像生成,得到所述第二人脸图像,所述第二人脸图像中人脸区域的属性基于所述第二目标特征确定。

102.其中,所述第二综合模块的结构在此不做限定。在一些实施例中,所述第二综合模块通常包括至少两个依次连接的第二图像处理层;且所述第二图像处理层输出的结果的分辨率自上层至下层逐渐提高。其中,所述第二图像处理层的数量和具体结构在此不做限定。

103.因此,所述风格化模型的第二综合模块基于所述第二目标特征输入进行图像生成,得到所述第二人脸图像也可以理解为,将所述第二目标特征输入所述第二综合模块的每一所述第二图像处理层。换言之,每一所述第二图像处理层均可以基于上一所述第二图像处理层输入以及所述第二目标特征输入进行图像处理,并将处理后的结果输入至下一所述第二图像处理层。在所述第二图像处理层为最上层的所述第二图像处理层时,该第二图像处理层基于所述第二目标特征输入生成图像。在所述第二图像处理层为最下层所述第二图像处理层时,该第二图像处理层输出的结果为所述第二人脸图像。

104.可选地,在一些实施例中,所述将随机噪声分别输入至所述stylegan模型和所述风格化模型,获得第一人脸图像以及第二人脸图像,具体包括以下步骤:

105.将所述stylegan模型和所述风格化模型进行混合,得到混合模型;其中,所述混合模型包括所述stylegan模型和所述风格化模型,且所述stylegan模型的第一综合模块的输

出端与所述风格化模型的第二综合模块的输入端连接;

106.将所述随机噪声输入至所述stylegan模型和所述混合模型进行图像生成,得到第一人脸图像以及第二人脸图像。

107.请参见图4,图4为本发明实施例中一种混合模型的结构示意图。如图4所示,所述混合模型包括stylegan2模型和所述风格化模型,且stylegan2模型的第一综合模块的输出端与所述风格化模型的第二综合模块的输入端连接。

108.stylegan2模型的第一综合模块的输出端与所述风格化模型的第二综合模块的输入端连接可以理解为,stylegan2模型的第一综合模块输出的结果会输入至所述风格化模型的第二综合模块。

109.如图4所示,在一种情况下,所述stylegan2模型的第一综合模块输出的结果仅输入至所述风格化模型的第二综合模块。在另一种情况下,所述stylegan2模型的第一综合模块输出的结果输入至所述风格化模型的第二综合模块,同时输出为所述第一人脸图像。

110.请参见图5,图5为本实施例提供的一种获得混合模型的流程示意图。如图5所示,首先采集具有所述目标人脸风格的样本数据形成所述目标数据库,然后通过stylegan-ada方法、freezed方法以及early stop方法,在所述目标数据集上对所述stylegan2模型进行训练和finetune,得到所述风格化模型。将所述风格化模型和所述stylegan2模型进行混合,得到所述混合模型。

111.在本实施例中,将所述stylegan模型和所述风格化模型进行混合,得到了所述混合模型。将所述随机噪声输入至所述stylegan模型和所述混合模型进行图像生成,得到第一人脸图像以及第二人脸图像。这样,仍然可以得到所述第一人脸图像以及第二人脸图像,用于对风格迁移模型进行训练。同时,在仅需要得到所述第二人脸图像的情况下,可以仅将所述随机噪声输入至所述混合模型进行处理,得到所述第二人脸图像。

112.由上可知,通过本实施例提供的方法,可以得到如图2所示的stylegan2模型、如图3所示的风格化模型以及如图4所示的混合模型。在需要生成不同的人脸图像的情况下,可以使用不同的模型,提高了图像生成的灵活性和便捷性。

113.可选地,在一些实施例中,所述步骤101之后,所述方法还包括以下步骤:

114.获取样本真实图像的第三隐藏特征,所述第三隐藏特征用于表征所述样本真实图像中人脸区域的属性;

115.将所述第三隐藏特征与预设的所述第二平均特征进行加权处理,得到第三目标特征;

116.所述stylegan模型的第一综合模块基于所述第三隐藏特征输入进行图像生成,得到第一真实图像;

117.所述风格化模型的第二综合模块基于所述第三目标特征输入和所述第一真实图像输入进行图像生成,得到第二真实图像;所述第二真实图像是将所述第一真实图像进行风格迁移后,具有所述目标人脸风格的人脸图像。

118.需要说明的是,所述第一人脸图像可以认为是具有真实人脸风格的人脸图像。而所述样本真实图像可以理解为在网络上获取或通过其他途径获取的真实人脸图像。所述第一人脸图像和所述样本真实图像的区别可以理解为,所述第一人脸图像中人脸区域对应的人是虚假的,所述样本真实图像中人脸区域对应的人是真实的。

119.需要说明的是,将所述第三隐藏特征与预设的所述第二平均特征进行加权处理,得到第三目标特征可以理解为,使用所述第三隐藏特征替换所述第二隐藏特征。因此,在本实施例中,所述第二隐藏特征不是由所述随机噪声生成,而是根据所述样本真实图像确定的。

120.由于所述风格化模型的目的是将所述目标人脸风格迁移至所述第一人脸图像,得到所述第二人脸图像。而所述第二平均特征用于控制人脸风格化的强度,因此,通过将所述第三隐藏特征替换所述第二隐藏特征可以输入所述样本真实图像的人脸属性,同时,通过将所述第三隐藏特征与预设的所述第二平均特征进行加权处理,仍然可以对所述样本真实图像的风格化强度进行调整。

121.需要说明的是,stylegan2模型的第一综合模块基于所述第三隐藏特征输入进行图像生成,得到第一真实图像可以理解为,使用所述第三隐藏特征替换所述第一目标特征。

122.由于stylegan2模型的目的是生成具有真实人脸风格的人脸图像,因此,使用所述第三隐藏特征替换所述第一目标特征可以提高生成的所述第一人脸图像与所述样本真实图像的相似度,提高所述第一人脸图像的真实度。当然,在一些实施例中,也可以直接使用所述样本真实图像替换所述第一人脸图像,即将所述样本真实图像和所述第二真实图像作为一个图像组。

123.在本实施例中,收集了所述样本真实图像,同时获取了样本真实图像的第三隐藏特征。通过使用所述第三隐藏特征替换所述第二隐藏特征和所述第一平均特征,提高了输出的所述第一真实图像和所述第二真实图像的稳定性,同时提高了用于对风格迁移模型进行训练的样本数据的来源多样本,使得用于对风格迁移模型进行训练的样本数据更加稳定和真实,进而提高对风格迁移模型的训练效果。

124.可选地,在一些实施例中,所述步骤102之后,所述方法还包括以下步骤:

125.确定所述样本真实图像中背景区域的属性,以及确定所述第二真实图像中背景区域的属性;

126.使用所述样本真实图像中背景区域的属性替换所述第二真实图像中背景区域的属性。

127.应理解的是,确定所述样本真实图像中背景区域的属性的具体方法在此不做限定。同样地,确定所述第二真实图像中背景区域的属性的具体方法在此不做限定。

128.例如,在一些实施例中,确定所述样本真实图像中背景区域的属性可以理解为,对所述样本真实图像进行图像分割,确定所述样本真实图像的背景区域。确定所述第二真实图像中背景区域的属性可以理解为对所述第二真实图像进行图像分割,确定所述第二真实图像的背景区域。

129.在本实施例中,确定所述样本真实图像中背景区域的属性,以及确定所述第二真实图像中背景区域的属性理解为,确定所述样本真实图像中背景区域,以及确定所述第二真实图像中背景区域。因此,使用所述样本真实图像中背景区域的属性替换所述第二真实图像中背景区域的属性可以理解为,使用所述样本真实图像中背景替换所述第二真实图像中背景。

130.在另一些实施例中,确定所述样本真实图像中背景区域的属性可以理解为,对所述样本真实图像进行图像分割,确定所述样本真实图像的背景区域的属性参数。确定所述

第二真实图像中背景区域的属性可以理解为对所述第二真实图像进行图像分割,确定所述第二真实图像的背景区域的属性参数。

131.在本实施例中,确定所述样本真实图像中背景区域的属性,以及确定所述第二真实图像中背景区域的属性理解为,确定所述样本真实图像中背景区域的属性参数,以及确定所述第二真实图像中背景区域的属性参数。因此,使用所述样本真实图像中背景区域的属性替换所述第二真实图像中背景区域的属性可以理解为,使用所述样本真实图像中背景参数替换所述第二真实图像中背景参数。

132.在对所述样本真实图像进行风格化迁移的过程中,可能会对所述样本真实图像中的背景区域同样进行了风格化迁移,使得所述第二真实图像中的背景区域与所述样本真实图像中的背景区域不同。

133.在本实施例中,需要确定所述样本真实图像中背景区域的属性,以及确定所述第二真实图像中背景区域的属性;使用所述样本真实图像中背景区域的属性替换所述第二真实图像中背景区域的属性。通过上述设置,使得所述第二真实图像中的背景区域与所述样本真实图像中的背景区域相同,保证了图像组内图像的背景相同。

134.需要说明的是,如图6所示,在一些实施例中,在获得所述第二真实图像后,还可以通过分段式(piecewise)方法,进一步地对齐所述样本真实图像和所述第二真实图像,进一步地提高所述第二真实图像的效果。

135.需要说明的是,在一些实施例中,在获得所述第二真实图像后,还可以通过使用所述样本真实图像中的服饰替换所述第二真实图像中的服饰,进一步地提高所述第二真实图像和所述样本真实图像服饰的匹配度和所述第二真实图像中服饰的丰富度。

136.需要说明的是,在一些实施例中,在获得所述第一人脸图像、第二人脸图像、第一真实图像和/或所述第二真实图像后,还可以在所述第一人脸图像、第二人脸图像、第一真实图像和/或所述第二真实图像增加配饰数据,进一步地丰富对风格迁移模型进行训练的样本数据的种类和数量。其中,所述配饰数据可以为眼镜数据、首饰数据和口罩数据等。

137.需要说明的是,在一些实施例中,在获得所述第一人脸图像、第二人脸图像、第一真实图像和/或所述第二真实图像后,还可以对所述第一人脸图像、第二人脸图像、第一真实图像和/或所述第二真实图像进行数据清理,剔除效果较差的数据,从而提高最终用于对风格迁移模型进行训练的样本数据的质量。

138.请参见图7,图7是本发明实施例提供的一种图像生成装置700的结构图。

139.如图7所示,本实施例提供了一种图像生成装置700,包括:

140.处理模块701,用于利用具有目标人脸风格的目标数据集,对预先训练的stylegan模型进行训练和模型参数调整,得到风格化模型,所述风格化模型用于生成具有所述目标人脸风格的人脸图像;

141.输入模块702,用于将随机噪声分别输入至所述stylegan模型和所述风格化模型,以使所述stylegan模型基于所述随机噪声输入得到所述第一人脸图像,所述风格化模型基于所述随机噪声输入和所述第一人脸图像得到所述第二人脸图像,所述第二人脸图像是将所述第一人脸图像进行风格迁移后,得到的具有所述目标人脸风格的人脸图像。

142.可选地,所述stylegan模型基于所述随机噪声输入得到所述第一人脸图像,包括:

143.所述stylegan模型的第一映射层基于所述随机噪声输入进行特征提取,得到第一

隐藏特征;所述第一隐藏特征用于表征所述第一人脸图像中人脸区域的属性;

144.将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一目标特征;所述第一平均特征基于所述stylegan模型每一次训练时所述第一映射层输出的结果确定;

145.所述stylegan模型的第一综合模块基于所述第一目标特征输入进行图像生成,得到所述第一人脸图像。

146.可选地,所述将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一目标特征,包括:

147.将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一中间特征;

148.对所述第一中间特征对应的参数进行调整,得到所述第一目标特征。

149.可选地,所述风格化模型基于所述随机噪声输入和所述第一人脸图像得到所述第二人脸图像,包括:

150.所述风格化模型的第二映射层基于所述随机噪声输入进行特征提取,得到第二隐藏特征,所述第二隐藏特征用于表征所述第二人脸图像中人脸区域的属性;

151.将所述第二隐藏特征与预设的第二平均特征进行加权处理,得到第二目标特征;所述第二平均特征基于所述风格化模型每一次训练时所述第二映射层输出的结果确定;

152.所述风格化模型的第二综合模块基于所述第二目标特征输入和所述第一人脸图像输入进行图像生成,得到所述第二人脸图像。

153.可选地,所述输入模块702包括:

154.混合单元,用于将所述stylegan模型和所述风格化模型进行混合,得到混合模型;其中,所述混合模型包括所述stylegan模型和所述风格化模型,且所述stylegan模型的第一综合模块的输出端与所述风格化模型的第二综合模块的输入端连接;

155.图像生成单元,用于将所述随机噪声输入至所述混合模型进行图像生成,得到第一人脸图像以及第二人脸图像。

156.可选地,所述图像生成装置700还包括:

157.获取模块,用于获取样本真实图像的第三隐藏特征,所述第三隐藏特征用于表征所述样本真实图像中人脸区域的属性;

158.加权处理模块,用于将所述第三隐藏特征与预设的所述第二平均特征进行加权处理,得到第三目标特征;

159.第一图像生成模块,用于所述stylegan模型的第一综合模块基于所述第三隐藏特征输入进行图像生成,得到第一真实图像;

160.第二图像生成模块,用于所述风格化模型的第二综合模块基于所述第三目标特征输入和所述第一真实图像输入进行图像生成,得到第二真实图像;所述第二真实图像是将所述第一真实图像进行风格迁移后,具有所述目标人脸风格的人脸图像。

161.可选地,所述图像生成装置700还包括:

162.确定模块,用于确定所述样本真实图像中背景区域的属性,以及确定所述第二真实图像中背景区域的属性;

163.替换模块,用于使用所述样本真实图像中背景区域的属性替换所述第二真实图像中背景区域的属性。

164.本技术实施例提供的图像生成装置700能够实现图1的方法实施例实现的各个过

程,为避免重复,这里不再赘述。

165.本发明实施例还提供了一种电子设备,如图8所示,包括处理器801、通信接口802、存储器803和通信总线804,其中,处理器801,通信接口802,存储器803通过通信总线804完成相互间的通信,

166.存储器803,用于存放程序;

167.处理器801,用于执行存储器803上所存放的程序时,实现如下步骤:

168.利用具有目标人脸风格的目标数据集,对预先训练的stylegan模型进行训练和模型参数调整,得到风格化模型,所述风格化模型用于生成具有所述目标人脸风格的人脸图像;

169.将随机噪声分别输入至所述stylegan模型和所述风格化模型,以使所述stylegan模型基于所述随机噪声输入得到所述第一人脸图像,所述风格化模型基于所述随机噪声输入和所述第一人脸图像得到所述第二人脸图像,所述第二人脸图像是将所述第一人脸图像进行风格迁移后,得到的具有所述目标人脸风格的人脸图像。

170.可选地,所述stylegan模型基于所述随机噪声输入得到所述第一人脸图像,包括:

171.所述stylegan模型的第一映射层基于所述随机噪声输入进行特征提取,得到第一隐藏特征;所述第一隐藏特征用于表征所述第一人脸图像中人脸区域的属性;

172.将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一目标特征;所述第一平均特征基于所述stylegan模型每一次训练时所述第一映射层输出的结果确定;

173.所述stylegan模型的第一综合模块基于所述第一目标特征输入进行图像生成,得到所述第一人脸图像。

174.可选地,所述将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一目标特征,包括:

175.将所述第一隐藏特征与预设的第一平均特征进行加权处理,得到第一中间特征;

176.对所述第一中间特征对应的参数进行调整,得到所述第一目标特征。

177.可选地,所述风格化模型基于所述随机噪声输入和所述第一人脸图像得到所述第二人脸图像,包括:

178.所述风格化模型的第二映射层基于所述随机噪声输入进行特征提取,得到第二隐藏特征,所述第二隐藏特征用于表征所述第二人脸图像中人脸区域的属性;

179.将所述第二隐藏特征与预设的第二平均特征进行加权处理,得到第二目标特征;所述第二平均特征基于所述风格化模型每一次训练时所述第二映射层输出的结果确定;

180.所述风格化模型的第二综合模块基于所述第二目标特征输入和所述第一人脸图像输入进行图像生成,得到所述第二人脸图像。

181.可选地,所述将随机噪声分别输入至所述stylegan模型和所述风格化模型,获得第一人脸图像以及第二人脸图像,包括:

182.将所述stylegan模型和所述风格化模型进行混合,得到混合模型;其中,所述混合模型包括所述stylegan模型和所述风格化模型,且所述stylegan模型的第一综合模块的输出端与所述风格化模型的第二综合模块的输入端连接;

183.将所述随机噪声输入至所述混合模型进行图像生成,得到第一人脸图像以及第二人脸图像。

184.可选地,所述利用具有目标人脸风格的目标数据集,对预先训练的stylegan模型进行训练和模型参数调整得到风格化模型之后,所述方法还包括:

185.获取样本真实图像的第三隐藏特征,所述第三隐藏特征用于表征所述样本真实图像中人脸区域的属性;

186.将所述第三隐藏特征与预设的所述第二平均特征进行加权处理,得到第三目标特征;

187.所述stylegan模型的第一综合模块基于所述第三隐藏特征输入进行图像生成,得到第一真实图像;

188.所述风格化模型的第二综合模块基于所述第三目标特征输入和所述第一真实图像输入进行图像生成,得到第二真实图像;所述第二真实图像是将所述第一真实图像进行风格迁移后,具有所述目标人脸风格的人脸图像。

189.可选地,所述将随机噪声分别输入至所述stylegan模型和所述风格化模型,获得第一人脸图像以及第二人脸图像之后,所述方法还包括:

190.确定所述样本真实图像中背景区域的属性,以及确定所述第二真实图像中背景区域的属性;

191.使用所述样本真实图像中背景区域的属性替换所述第二真实图像中背景区域的属性。

192.上述终端提到的通信总线可以是外设部件互连标准(peripheral component interconnect,简称pci)总线或扩展工业标准结构(extended industry standard architecture,简称eisa)总线等。该通信总线可以分为地址总线、数据总线、控制总线等。为便于表示,图中仅用一条粗线表示,但并不表示仅有一根总线或一种类型的总线。

193.通信接口用于上述终端与其他设备之间的通信。

194.存储器可以包括随机存取存储器(random access memory,简称ram),也可以包括非易失性存储器(non-volatile memory),例如至少一个磁盘存储器。可选地,存储器还可以是至少一个位于远离前述处理器的存储装置。

195.上述的处理器可以是通用处理器,包括中央处理器(central processing unit,简称cpu)、网络处理器(network processor,简称np)等;还可以是数字信号处理器(digital signal processing,简称dsp)、专用集成电路(application specific integrated circuit,简称asic)、现场可编程门阵列(field-programmable gate array,简称fpga)或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件。

196.在本发明提供的又一实施例中,还提供了一种可读存储介质,该可读存储介质中存储有指令,当其在处理器上运行时,使得处理器执行上述实施例中任一所述的图像生成方法。

197.在本发明提供的又一实施例中,还提供了一种包含指令的计算机程序产品,当其在计算机上运行时,使得计算机执行上述实施例中任一所述的图像生成方法。

198.在上述实施例中,可以全部或部分地通过软件、硬件、固件或者其任意组合来实现。当使用软件实现时,可以全部或部分地以计算机程序产品的形式实现。所述计算机程序产品包括一个或多个计算机指令。在计算机上加载和执行所述计算机程序指令时,全部或部分地产生按照本发明实施例所述的流程或功能。所述计算机可以是通用计算机、专用计

算机、计算机网络、或者其他可编程装置。所述计算机指令可以存储在计算机可读存储介质中,或者从一个计算机可读存储介质向另一个计算机可读存储介质传输,例如,所述计算机指令可以从一个网站站点、计算机、服务器或数据中心通过有线(例如同轴电缆、光纤、数字用户线(dsl))或无线(例如红外、无线、微波等)方式向另一个网站站点、计算机、服务器或数据中心进行传输。所述计算机可读存储介质可以是计算机能够存取的任何可用介质或者是包含一个或多个可用介质集成的服务器、数据中心等数据存储设备。所述可用介质可以是磁性介质,(例如,软盘、硬盘、磁带)、光介质(例如,dvd)、或者半导体介质(例如固态硬盘solid state disk(ssd))等。

199.需要说明的是,在本文中,诸如第一和第二等之类的关系术语仅仅用来将一个实体或者操作与另一个实体或操作区分开来,而不一定要求或者暗示这些实体或操作之间存在任何这种实际的关系或者顺序。而且,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括所述要素的过程、方法、物品或者设备中还存在另外的相同要素。

200.本说明书中的各个实施例均采用相关的方式描述,各个实施例之间相同相似的部分互相参见即可,每个实施例重点说明的都是与其他实施例的不同之处。尤其,对于系统实施例而言,由于其基本相似于方法实施例,所以描述的比较简单,相关之处参见方法实施例的部分说明即可。

201.以上所述仅为本发明的较佳实施例而已,并非用于限定本发明的保护范围。凡在本发明的精神和原则之内所作的任何修改、等同替换、改进等,均包含在本发明的保护范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1